Jag ska vara helt ärlig: första gången jag försökte hämta alla URL:er från en stor webbplats tänkte jag: ”Hur svårt kan det vara?” Några timmar senare satt jag fortfarande och klickade mig igenom ändlösa sidor, kopierade och klistrade in länkar i ett kalkylblad och ifrågasatte mina livsval. Om du någonsin har försökt att hitta alla sidor på en webbplats — oavsett om det handlar om en innehållsgenomgång, en leadlista eller en konkurrensanalys — vet du precis hur det känns. Det tar tid, det är lätt att göra fel och, ärligt talat, det är slöseri med både din tid och din kompetens.

Men här är den goda nyheten: du behöver inte längre göra det på det krångliga sättet. AI-drivna verktyg som förändrar spelplanen för företagsanvändare och gör det möjligt att hitta alla URL:er på en domän på minuter i stället för dagar. Faktum är att företag som använder AI-drivna verktyg för webbscraping rapporterar i datainsamlingsuppgifter, och vissa ser upp till jämfört med manuella metoder. Det är inte bara en siffra — det är timmar, eller till och med dagar, tillbaka i din kalender.

Så låt oss gå igenom varför det är så svårt att hitta alla sidor på en webbplats, varför generiska AI-modeller som GPT eller Claude egentligen inte hjälper särskilt mycket, och hur specialiserade AI-agenter — som Thunderbit — gör hela processen enkel. Och ja, jag visar exakt hur du extraherar varje URL du behöver, även om du inte kan koda.

Varför det är så svårt att hitta alla URL:er på en domän

Låt oss vara ärliga: webbplatser är inte byggda för att ge dig en prydlig lista över varje sida de innehåller. De är byggda för besökare, inte för människor som försöker hitta alla sidor på en webbplats på en gång. Här är varför uppgiften är så knepig:

- Manuellt kopiera-klistra-kaos: Att klicka sig igenom varje meny, varje lista och varje katalog, kopiera URL:er en och en, är ett säkert recept för belastningsskador — och för att missa hälften av sidorna.

- Sidindelning och oändlig scroll: Många sajter delar upp innehåll på flera sidor eller laddar fler resultat allt eftersom du scrollar. Missar du en ”Nästa”-knapp eller glömmer att scrolla tillräckligt långt missar du hela avsnitt.

- Inkonsekventa sidstrukturer: Vissa sidor listar länkar på ett sätt, andra använder en annan layout. Att hålla ordning på allt blir snabbt en mardröm.

- Dolda eller föräldralösa sidor: Alla sidor länkas inte från huvudnavigeringen. Vissa ligger djupt begravda och går bara att nå via webbplatskartan eller intern sökning.

- Mänskliga fel: Ju fler sidor du måste kopiera, desto större är risken att du gör misstag — dubbla URL:er, stavfel eller att du helt enkelt hoppar över något.

Och om du jobbar med en sajt som har hundratals eller tusentals sidor? Glöm det. Manuell extrahering skalar helt enkelt inte. Som ett datateam uttryckte det: bortom triviala fall .

Vad innebär det att ”hitta alla sidor på en webbplats”?

Innan vi hoppar in i lösningar, låt oss reda ut vad det faktiskt är vi är ute efter.

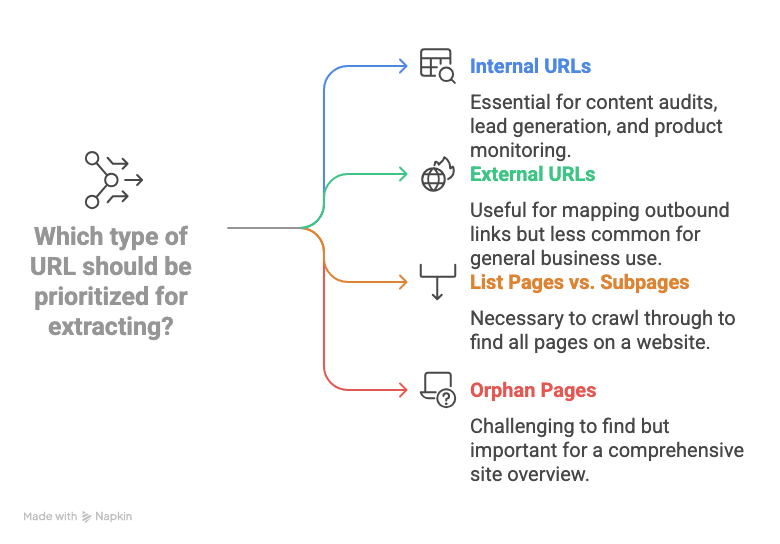

- Interna URL:er: Det här är länkar som pekar till sidor på samma domän (som /about-us eller /products/widget-123). För de flesta affärsanvändningsfall — innehållsgranskningar, leadgenerering, produktbevakning — är interna URL:er huvudmålet.

- Externa URL:er: Länkar som går till andra webbplatser. Ofta behöver du inte dessa, såvida du inte kartlägger utgående länkar.

- List-sidor vs. undersidor: Många webbplatser har ”nav”- eller ”list”-sidor (tänk kategorisidor, bloggarkiv, kataloger) som länkar vidare till detaljsidor (som produkt- eller profilsidor). För att verkligen hitta alla sidor på en webbplats behöver du crawla igenom dessa listor och fånga upp varje undersida de länkar till.

- Föräldralösa sidor: Det här är sidor som inte länkas från någon uppenbar plats. Ibland går de att hitta via webbplatskartor eller intern sökning, men de är lätta att missa.

Så när vi pratar om att hitta alla URL:er på en domän, menar vi: få fram varje intern sid-URL, från startsidan till den djupaste produkten eller artikeln, helst i ett format du kan använda, som ett kalkylblad.

Traditionella metoder för att hitta alla URL:er på en domän

Det finns några gamla beprövade sätt att ta sig an detta, men vart och ett kommer med sina egna huvudvärkspunkter:

Manuellt kopiera-klistra och webbläsarverktyg

Det här är ”råstyrke”-metoden: klicka på varje länk, kopiera varje URL, klistra in den i ett kalkylblad och hoppas att du inte missar något. Vissa använder webbläsartillägg för att hämta alla länkar från den aktuella sidan, men du måste fortfarande upprepa processen för varje sida, och du får själv hantera sidindelning eller dolda sektioner. Det fungerar för en sajt med fem sidor — inte lika bra för något större.

Använda webbplatssökning och webbplatskartor

- Googles site:-sökning: Skriv site:din-doman.com i Google så ser du ett gäng indexerade sidor. Men Google visar bara det som har indexerats (ofta med ett tak runt 1 000 resultat), så du missar nya, dolda eller lågkvalitativa sidor. medger att detta inte är en komplett lösning.

- XML-webbplatskartor: Många sajter har en /sitemap.xml som listar viktiga URL:er. Perfekt — om webbplatskartan är uppdaterad och inkluderar varje sida. Men alla sajter har inte en sådan, och vissa delar upp sina webbplatskartor i flera filer. Föräldralösa sidor brukar ofta inte komma med.

Tekniska crawlers och skript

- SEO-verktyg (som Screaming Frog): De crawlar en sajt som en sökmotor och spottar ut en lista med URL:er. De är kraftfulla, men kräver installation, konfiguration och ibland en betald licens för större sajter.

- Python-skript (som Scrapy): Utvecklare kan skriva skript för att crawla och extrahera URL:er. Men låt oss vara realistiska: om du inte är bekväm med kod är detta i princip inget alternativ. Dessutom går skript sönder när sajtens layout ändras, så du måste hela tiden jaga ikapp.

Kort sagt: Traditionella metoder är antingen för manuella, för ofullständiga eller för tekniska för de flesta företagsanvändare. Det är inte svårt att förstå varför så många ger upp halvvägs.

Varför generiska AI-modeller inte helt kan automatisera URL-extrahering

Du kanske tänker: ”Kan jag inte bara be ChatGPT eller Claude att hitta alla sidor på en webbplats åt mig?” Jag önskar att det vore så enkelt. Här är verkligheten:

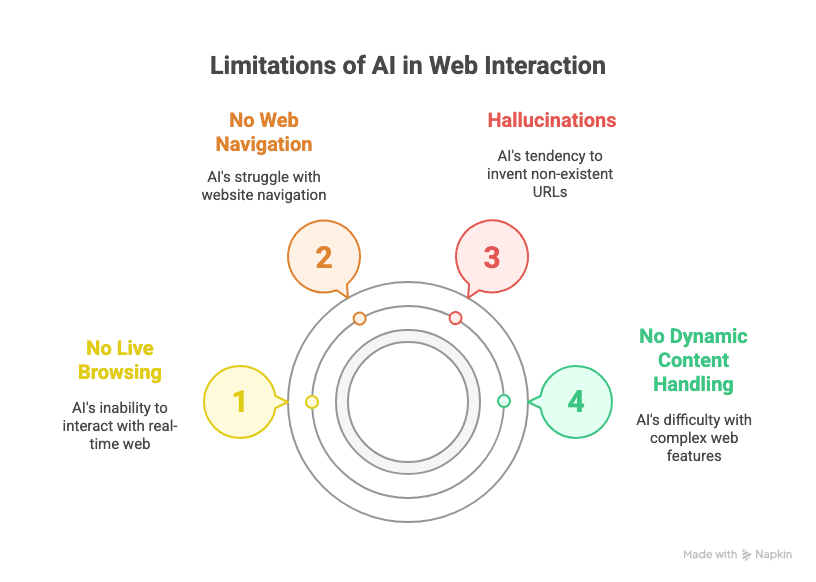

- Ingen live-surfning: Generella AI-modeller som GPT eller Claude kan faktiskt inte surfa på webben i realtid. De ”ser” inte en webbplats aktuella läge — de arbetar bara utifrån sin träningsdata eller det du själv klistrar in.

- Ingen webbnavigering: Även med plugins eller surfning aktiverad vet LLM:er inte hur man klickar på ”Nästa”, hanterar oändlig scroll eller systematiskt följer varje länk på en sajt.

- Hallucinationer: Be en generell AI om alla URL:er på en domän, så hittar den ofta på länkar som låter rimliga men som faktiskt inte finns. (Jag har sett den hitta på /about-us-sidor för sajter som aldrig haft en sådan.)

- Hanterar inte dynamiskt innehåll: Sajter som laddar innehåll med JavaScript, kräver inloggning eller använder komplex navigering ligger utom räckhåll för generella LLM:er.

Som säger: ”Om du vill skrapa hundratals eller tusentals sidor… räcker inte ChatGPT på egen hand.” Du behöver ett verktyg som är specialbyggt för uppgiften.

Vertikala AI-agenter är framtiden — och varför det spelar roll

Här kommer min erfarenhet från SaaS och automation in: vertikala AI-agenter — AI-verktyg byggda för en specifik domän, som webbdatainsamling — är det enda sättet att få tillförlitliga och skalbara resultat för affärsuppgifter. Varför?

- Generella LLM:er är bra för skrivande eller sök, men de är benägna att ”hallucinera” och klarar inte flerstegsarbetsflöden som går att upprepa med den stabilitet företag behöver.

- Enterprise-SaaS-verktyg måste automatisera många repetitiva, strukturerade uppgifter. Där briljerar vertikala AI-agenter — de är byggda för att göra en sak, och göra den bra, med minimalt antal fel.

- Det finns gott om exempel i olika branscher: Thunderbit för webbdatainsamling, Devin AI för mjukvaruutveckling, Alta för försäljningsautomatisering, Infinity Learns IL VISTA för utbildning, Rippling för HR, Harvey för juridik… listan kan göras lång.

Kort sagt: om du vill hitta alla sidor på en webbplats på ett tillförlitligt sätt behöver du en vertikal AI-agent byggd för just det — inte en allmän chatbot.

Möt Thunderbit: AI-driven URL-extrahering för alla

Det är här kommer in. Som ett AI-webbscraper-tillägg för Chrome är Thunderbit byggt för företagsanvändare — ingen kod, ingen teknisk installation, bara resultat. Här är vad som gör det annorlunda:

- Gränssnitt på naturligt språk: Beskriv bara vad du vill ha (”Lista alla sid-URL:er på den här webbplatsen”), så räknar Thunderbits AI ut hur det ska extraheras.

- AI föreslår fält: Thunderbit skannar sidan och föreslår automatiskt kolumnnamn (som ”Sid-URL”) — du behöver inte krångla med CSS-selektorer eller XPath.

- Hantera sidindelning och oändlig scroll: Thunderbit kan klicka på ”Nästa” eller scrolla ned automatiskt, så att du inte missar några sidor.

- Navigering till undersidor: Behöver du gå djupare? Thunderbit kan följa länkar till undersidor och hämta data därifrån också.

- Strukturerad export: Exportera resultaten direkt till Google Sheets, Excel, Notion, Airtable eller CSV — gratis och med ett klick.

- Ingen kod behövs: Om du kan surfa på en webbplats kan du använda Thunderbit. Så enkelt är det.

Och eftersom Thunderbit är en vertikal AI-agent är den byggd för stabilitet och upprepningsbarhet — perfekt för företagsanvändare som behöver automatisera samma uppgifter om och om igen.

Steg för steg: Så hittar du alla URL:er på en domän med Thunderbit

Redo att se hur det fungerar? Här är en icke-teknisk genomgång av hur du extraherar varje URL du behöver.

1. Installera Thunderbit Chrome-tillägg

Först av allt: . Det fungerar i Chrome, Edge, Brave och andra Chromium-baserade webbläsare. Fäst det i verktygsfältet för enkel åtkomst.

2. Öppna din mållista eller katalogsida

Gå till webbplatsen du vill extrahera URL:er från. Det kan vara startsidan, en webbplatskarta, en katalog eller vilken list-sida som helst som länkar till de sidor du bryr dig om.

3. Starta Thunderbit och ställ in dina fält

Klicka på Thunderbit-ikonen för att öppna tillägget. Starta en ny scraper-mall. Här händer magin:

- Klicka på ”AI föreslår fält”. Thunderbits AI skannar sidan och föreslår kolumner — leta efter en som heter ”Sid-URL”, ”Länk” eller liknande.

- Om du inte ser exakt det fält du vill ha, lägg bara till en kolumn som heter ”Sid-URL” (eller något som passar). Thunderbits AI är tränad att känna igen sådana termer och mappa dem till rätt data.

4. Aktivera sidindelning eller scrollning om det behövs

Om målsidan har flera sidor (som ”Sida 1, 2, 3…” eller en ”Ladda fler”-knapp), aktivera sidindelning i Thunderbit:

- Växla till läget ”Klicka genom sidindelning” för sajter med ”Nästa”-knappar, eller ”Oändlig scroll” för sajter som laddar mer innehåll när du scrollar.

- Thunderbit ber dig välja ”Nästa”-knappen eller scrollområdet — klicka bara på det, så sköter AI:n resten.

5. Börja skrapa och granska resultaten

Tryck på knappen ”Skrapa”. Thunderbit kommer att crawla igenom alla sidor och samla in varje URL den hittar. Du ser resultaten fyllas i som en tabell direkt i tillägget. För stora sajter kan det ta några minuter, men det går fortfarande mycket snabbare än att göra allt för hand.

6. Exportera din lista med URL:er

När skrapningen är klar klickar du på Exportera. Du kan skicka dina data direkt till:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Exportering är gratis och bevarar all formatering. Inget mer kopiera-klistra-kaos.

Jämförelse mellan Thunderbit och andra lösningar för URL-extrahering

| Metod | Användarvänlighet | Noggrannhet och täckning | Skalbarhet | Exportalternativ |

|---|---|---|---|---|

| Manuellt kopiera-klistra | Plågsamt | Låg (lätt att missa) | Ingen | Manuellt (Excel osv.) |

| Länkextraherare i webbläsaren | Okej för 1 sida | Medel | Dålig | Manuellt |

Google-sökning med site: | Lätt | Medel (inte komplett) | Begränsad till ca 1 000 | Manuellt |

| XML-webbplatskarta | Lätt (om den finns) | Bra (om uppdaterad) | Bra | Manuellt/Skript |

| SEO-verktyg (Screaming Frog) | Tekniskt | Hög | Hög (betald) | CSV, Excel |

| Python-skript (Scrapy osv.) | Väldigt tekniskt | Hög | Hög | Anpassat |

| Thunderbit | Väldigt lätt | Mycket hög | Hög | Google Sheets, CSV osv. |

Thunderbit ger dig noggrannheten och skalan hos en professionell crawler med användarvänligheten hos ett webbläsartillägg. Ingen kod, ingen installation, bara resultat.

Bonus: Extrahera mer än bara URL:er med Thunderbit

Här blir det riktigt intressant. Thunderbit är inte bara för URL:er — du kan extrahera:

- Titlar

- E-postadresser

- Telefonnummer

- Bilder

- All strukturerad data på sidan

Om du till exempel bygger en leadlista kan du låta Thunderbit hämta profil-URL, namn, e-postadress och telefonnummer från varje post i en katalog — allt i ett enda svep. Om du granskar produkter kan du hämta produkt-URL, namn, pris och lagersaldo. Thunderbit stöder till och med , så att den kan klicka sig in på varje länk och extrahera detaljer därifrån.

Och ja, Thunderbits extraherare för e-post och telefonnummer är helt gratis. Det är en stor sak för sälj- och marknadsteam.

Viktiga lärdomar: Så hittar du alla sidor på en webbplats med AI

Låt oss sammanfatta:

- Att extrahera alla URL:er från en domän är svårt med manuella eller generiska verktyg.

- Generella AI-modeller som GPT klarar inte webbnavigering, sidindelning eller dynamiskt innehåll.

- Vertikala AI-agenter som Thunderbit är specialbyggda för webbdatainsamling — stabila, upprepningsbara och enkla för företagsanvändare.

- Thunderbit gör det enkelt: installera tillägget, låt AI föreslå fält, aktivera sidindelning, skrapa och exportera. Ingen kod, inget krångel.

- Du kan extrahera mer än bara URL:er: titlar, e-postadresser, telefonnummer och mer — perfekt för leadgenerering, granskningar eller research.

Om du är trött på att kopiera och klistra in länkar eller brottas med tekniska crawlers, . Det finns en gratisnivå, så du kan själv se hur mycket tid — och hur mycket frustration — du sparar.

Och om du är nyfiken på andra sätt Thunderbit kan hjälpa till — som , eller — kolla in för fler guider och tips.

Redo att ta tillbaka din tid från manuell datainsamling? Framtiden för webbdatainsamling är vertikala AI-agenter — och Thunderbit leder vägen. Prova det, och låt nästa granskning, leadlista eller researchprojekt bli det enklaste hittills.

Läs mer

P.S. Om du någon gång blir frestad att kopiera och klistra in 1 000 URL:er för hand, kom bara ihåg: det finns AI för det nu. Dina handleder — och din chef — kommer att tacka dig.