Webben svämmar över av data, och 2026 är kapplöpningen för att förvandla det kaoset till affärsguld mer intensiv än någonsin. Jag har sett sälj-, e-handels- och driftteam förändra sina arbetsflöden genom att automatisera det som tidigare var timmar av enformig kopiera-klistra in. I dag, om du inte använder program för webbdatascraping, ligger du inte bara efter — du sitter förmodligen fortfarande fast i kalkylbladshelvetet medan dina konkurrenter redan dricker sin andra kopp kaffe.

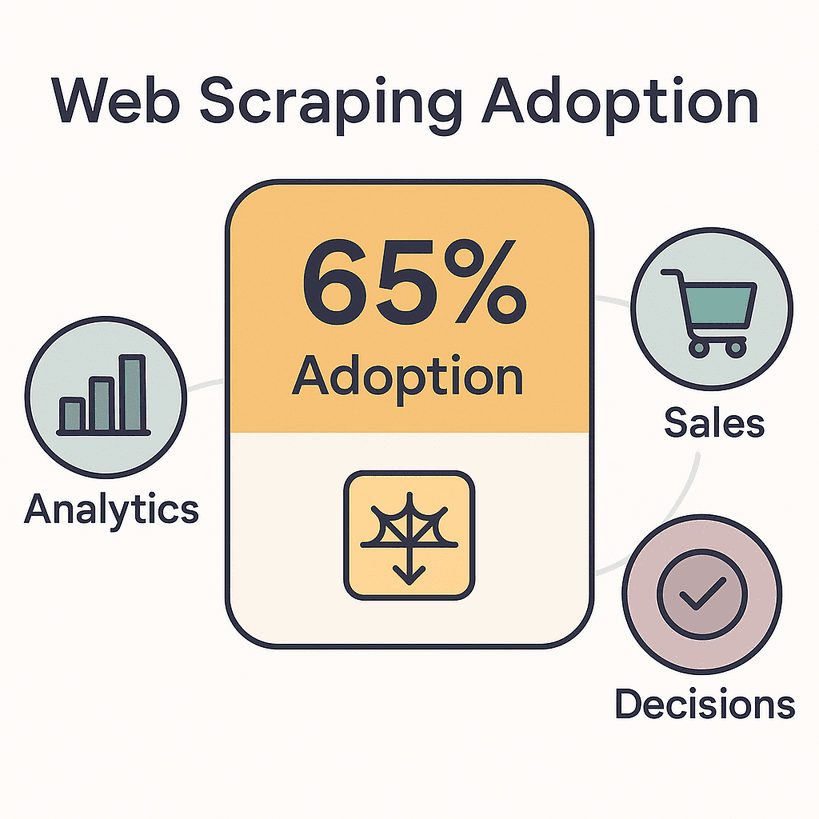

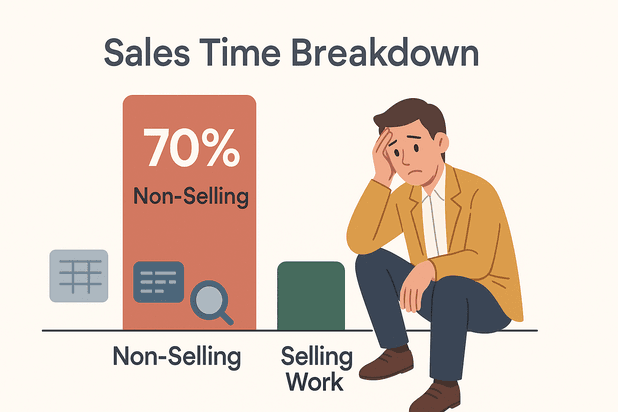

Så här ser verkligheten ut: för att driva analys, försäljning och beslutsfattande. Den globala marknaden för webbdatastraktion är redan värd , och den väntas fördubblas till 2030. Säljare lägger upp till på icke-säljande uppgifter som datainmatning och research. Det är mycket tid som i stället skulle kunna gå till att faktiskt stänga affärer — eller åtminstone ta en lunchrast.

Så, vilket är det bästa programmet för webbdatascraping 2026? Jag har granskat de fem främsta verktygen som förändrar spelreglerna för team i alla storlekar och med olika teknisk bakgrund. Oavsett om du är en icke-kodare som bara vill klicka och köra, eller en utvecklare som söker maximal flexibilitet, finns det något här för dig.

Vad gör det bästa programmet för webbdatascraping?

Låt oss vara ärliga: alla webbscrapers är inte skapade lika. Det bästa programmet för webbdatascraping 2026 utmärker sig genom att göra datainsamling snabb, tillförlitlig och tillgänglig för alla — inte bara för dem som drömmer i Python.

Här är de viktigaste kriterierna jag tittar efter (och vad affärsanvändare bryr sig mest om):

- Användarvänlighet: Kan icke-tekniska användare sätta upp en scraping på några minuter? Kodfria och AI-drivna gränssnitt är ett måste för de flesta team.

- Flexibilitet för datakällor: Klarar det webbsidor, PDF:er, bilder och dynamiskt innehåll (som oändlig scroll eller AJAX)? Ju fler källor, desto bättre.

- Automatisering och schemaläggning: Kan du schemalägga återkommande scrapingjobb, hantera paginering och automatisera navigering till undersidor? Automatisering är skillnaden mellan “ställ in och glöm” och “ställ in och passa hela tiden”.

- Integration och export: Går det att exportera direkt till Excel, Google Sheets, Notion, Airtable eller via API? Ju mindre manuellt pyssel, desto nöjdare team.

- Teknisk kunskap som krävs: Är det verkligen kodfritt, eller behöver du fräscha upp regex-kunskaperna? De bästa verktygen passar både icke-kodare och avancerade användare.

- Skalbarhet: Klarar det att skrapa hundratals eller tusentals sidor utan att svettas?

- Support och community: Finns det bra dokumentation, snabb support och en aktiv användarbas?

De här kriterierna är inte bara trevliga extrafunktioner — de skiljer verktygen som sparar dig timmar från dem som kostar dig dagar. 2026, med , är rätt scraper en konkurrensfördel.

Nu kör vi igenom topp fem.

Topp 5 bästa program för webbdatascraping 2026

- för kodfri, AI-driven scraping från flera källor

- för datapipelines i företagsklass

- för flexibel, utvecklarstyrd scraping med öppen källkod

- för visuell kodfri scraping med schemaläggning

- för lättanvänd datainsamling med klicka-och-välj

1. Thunderbit: Det enklaste AI-drivna programmet för webbdatascraping

är min främsta rekommendation för alla som vill skrapa webdata utan att skriva en enda rad kod. Och ja, jag är lite partisk — jag har hjälpt till att bygga det. Men hör mig: Thunderbit är byggt för affärsanvändare som vill ha resultat, inte huvudvärk.

Vad får Thunderbit att sticka ut?

- AI föreslår fält: Klicka bara på “AI föreslår fält” så läser Thunderbits AI sidan, rekommenderar vad som ska extraheras och sätter upp scrapern åt dig. Inga selektorer, inga mallar, inget drama.

- Scraping från flera källor: Skrapa inte bara webbsidor, utan också PDF:er och bilder. Thunderbit kan extrahera text, länkar, e-postadresser, telefonnummer och bilder — allt på två klick.

- Automatisering av undersidor och paginering: Behöver du hämta detaljer från varje produkt- eller profilsida? Thunderbits undersidescraping följer länkar, hämtar extra information och slår ihop allt i din tabell. Det hanterar dessutom oändlig scroll och paginering som en mästare.

- Batch- och schemalagd scraping: Klistra in en lista med URL:er, schemalägg återkommande jobb och låt Thunderbit göra det tunga lyftet — vare sig det gäller daglig prisbevakning eller veckovisa uppdateringar av leads.

- Direktexport: Exportera direkt till Excel, Google Sheets, Airtable, Notion, CSV eller JSON. Inga fler maratonpass med kopiera-klistra in.

- Anpassade AI-promptar: Vill du kategorisera, översätta eller märka data medan du skrapar? Lägg till en anpassad instruktion så fixar Thunderbits AI det.

- Moln- eller webbläsarläge: Kör scraping i molnet för hastighet (50 sidor åt gången) eller lokalt för sajter som kräver inloggning.

Thunderbit används av över , från säljteam till fastighetsmäklare och små e-handelsföretag. Den gratis nivån låter dig skrapa upp till 6 sidor (eller 10 med en provboost), och du betalar bara för det du använder — ett kredit per outputrad.

Varför jag gillar det: Thunderbit är det enda verktyg jag sett där en icke-teknisk användare kan gå från “jag behöver de här uppgifterna” till “här är mitt kalkylblad” på under fem minuter. Gränssnittet är verkligen användarvänligt (vi nördade ner oss i det), och AI:n anpassar sig till förändringar på webbplatsen så att du inte ständigt behöver laga trasiga scrapers.

Bäst för: Försäljning, e-handel, drift och alla som vill ha kodfri, AI-driven scraping utan underhåll.

Kolla in för fler guider.

2. Import.io: Webbdatascraping och integration i företagsklass

är tungviktaren för företag som behöver webdata i stor skala — och att den kopplas direkt till affärssystem.

Vad skiljer Import.io från mängden?

- Pipelines redo för företag: Import.io är inte bara en scraper; det är en fullfjädrad plattform för integration av webdata. Tänk “data-as-a-service” med kontinuerliga, automatiserade flöden.

- Självläkande AI: Om en webbplats ändras försöker Import.io:s AI mappa om fält automatiskt, så att dina pipelines inte kraschar över en natt.

- Robust automatisering: Schemalägg scraping per timme, dagligen eller på anpassade intervall. Få aviseringar om något går fel eller om datan ser konstig ut.

- Interaktiva arbetsflöden: Hantera sajter med inloggning, formulär eller flerstegsnavigering. Import.io kan spela in och upprepa komplexa sekvenser.

- Efterlevnad och styrning: Automatisk identifiering av personuppgifter, maskning och granskningsloggar — avgörande för reglerade branscher.

- API och integration: Strömma data direkt till Google Sheets, Excel, Tableau, Power BI, databaser eller dina egna appar via API.

Import.io används av varumärken som Unilever, Volvo och RedHat. Det är förstahandsvalet för användningsfall som prisbevakning över tusentals e-handelssajter, marknadsintelligens eller att mata AI-/ML-modeller med färsk webdata.

Prissättning: Import.io är en premiumlösning som börjar runt 299 dollar per månad för självbetjäningsplaner. Det finns en gratis provperiod, men ingen långsiktig gratisnivå. Om webdata är affärskritisk finns ROI:n där.

Bäst för: Företag och datadrivna organisationer som behöver tillförlitlighet, skala, efterlevnad och djup integration.

3. Scrapy: Ramverk med öppen källkod för webbscraping för utvecklare

är kraftpaketet med öppen källkod för utvecklare som vill ha maximal flexibilitet och kontroll. Om du (eller ditt team) kan koda i Python är Scrapy webbscrapingens schweiziska armékniv.

Varför utvecklare älskar Scrapy:

- Full anpassning: Skriv spiders (skript) för att crawla, parsa och bearbeta data exakt som du vill. Hantera flersidiga flöden, anpassad logik och avancerad datarensning.

- Asynkront och snabbt: Scrapys arkitektur är byggd för hastighet och skala — skrapa hundratals sidor per minut, eller miljoner med distribuerade crawlers.

- Utbyggbart: Ett enormt ekosystem av plugins och middleware för proxies, headless browsers (Splash/Playwright) och integrationer.

- Gratis och open source: Inga licensavgifter. Kör det på din egen hårdvara eller i molnet och skala så stort du behöver.

- Community-stöd: Över 55 000 GitHub-stjärnor och en massiv användarbas. Om du fastnar har någon sannolikt redan löst det.

Att tänka på: Scrapy kräver Python-kunskaper och vana vid kommandoraden. Det finns inget klicka-och-välj-gränssnitt — det här är kod först. Men för anpassade projekt, AI-träningsdata eller massiva crawls finns inget som slår det.

Bäst för: Organisationer med egna utvecklare, anpassade datapipelines eller komplexa scrapingbehov i stor skala.

4. Octoparse: Visuell webbdatascraping gjord enkel

är en favorit bland icke-kodare som vill ha kraftfull scraping med ett visuellt gränssnitt där man klickar och väljer.

Varför Octoparse är populärt:

- Visuell arbetsflödesbyggare: Klicka på element i en inbyggd webbläsare så identifierar Octoparse mönster automatiskt. Ingen kod, bara klicka och extrahera.

- Hanterar dynamiskt innehåll: Skrapa AJAX, oändlig scroll och sajter med inloggningsskydd. Simulera klick, scrollningar och formulärinsändningar.

- Molnscraping och schemaläggning: Kör uppgifter i molnet (snabbare, parallelliserat) och schemalägg återkommande jobb för alltid färsk data.

- Förbyggda mallar: Hundratals mallar för populära sajter (Amazon, Twitter, Zillow etc.) låter dig börja skrapa direkt.

- Export och API: Ladda ner resultat som CSV, Excel, JSON eller hämta data via API. Integrera med Google Sheets eller databaser.

Octoparse beskrivs ofta som “superenkelt att använda, även för nybörjare”. Den fria nivån är begränsad, men betalda planer (från cirka 83 dollar per månad) låser upp molnkörningar, schemaläggning och mer hastighet.

Bäst för: Icke-tekniska användare, marknadsförare, forskare och små team som behöver regelbunden, automatiserad datainsamling utan kod.

5. ParseHub: Användarvänlig dataextraktion för vardagsuppgifter

är ännu en favorit bland kodfria verktyg, särskilt för småföretag och frilansare som vill automatisera vardagliga datauppgifter.

Det som gör ParseHub så bra:

- Klicka-och-välj-enkelhet: Välj data genom att klicka på element i en webbläsarvy. Bygg arbetsflöden visuellt — ingen kod krävs.

- Hanterar JS och dynamiska sajter: Skrapa JavaScript-tunga sidor, oändlig scroll och flerstegsnavigering.

- Moln- och lokala körningar: Kör scraping på datorn eller i molnet. Schemalägg återkommande jobb och få tillgång till resultat via API (på högre planer).

- Exportalternativ: Ladda ner data som CSV, Excel eller JSON. API-åtkomst för automatisering.

- Plattformsoberoende: Finns för Windows, Mac och Linux.

ParseHubs gratisplan är begränsad (200 sidor/körning), men betalda planer (från cirka 189 dollar per månad) låser upp mer kraft, högre hastighet och API-åtkomst.

Bäst för: Småföretag, frilansare och team med enkla scrapingbehov som vill ha ett tillförlitligt, visuellt verktyg.

Jämförelsetabell: Bästa program för webbdatascraping i korthet

| Verktyg | Användarvänlighet | Datakällor | Automatisering och schemaläggning | Integration och export | Teknisk nivå | Prissättning |

|---|---|---|---|---|---|---|

| Thunderbit | Kodfritt, AI-drivet | Webb, PDF, bilder | Undersidor, paginering, schemalagt, batch | Excel, Sheets, Notion, Airtable, CSV, JSON | Ingen | Freemium (betala per rad) |

| Import.io | Klicka-och-välj-gränssnitt | Webb (statisk/dynamisk, inloggning) | Självläkande, schemalagt, aviseringar | API, BI-verktyg, Sheets, Excel, DB | Låg–Medel | 299+ dollar/månad |

| Scrapy | Kräver kod | Webb, API:er, (JS via tillägg) | Full automatisering via kod | Vad som helst (via kod) | Python-utvecklare | Gratis (open source) |

| Octoparse | Visuellt, kodfritt | Webb (dynamisk, inloggning) | Molnschemaläggning, mallar | CSV, Excel, JSON, API | Ingen | 83+ dollar/månad |

| ParseHub | Visuellt, kodfritt | Webb (JS, dynamisk) | Moln/lokalt, schemalagt | CSV, Excel, JSON, API | Ingen | 189+ dollar/månad |

Hur du väljer det bästa programmet för webbdatascraping för ditt företag

Osäker på vilket verktyg som passar dig? Här är mitt fusklapp:

- Icke-tekniska användare, snabba resultat: Välj eller . Thunderbit är oslagbart för omedelbar, AI-driven scraping och stöd för flera källor (webb, PDF, bilder). Octoparse är utmärkt för visuell, schemalagd scraping.

- Företagsintegration, efterlevnad och skala: är ditt bästa val. Det är byggt för kontinuerliga, tillförlitliga datapipelines och djup integration.

- Utvecklare, anpassade projekt eller massiva crawls: är vägen att gå. Du behöver Python-kunskaper, men får obegränsad flexibilitet.

- Småföretag, frilansare eller vardagsuppgifter: är ett stabilt, användarvänligt val för klicka-och-välj-scraping och måttlig automatisering.

Tips för att välja rätt verktyg:

- Matcha verktyget med teamets tekniska nivå och data-behov.

- Tänk på hur komplexa sajterna du behöver skrapa är (dynamiskt innehåll? inloggning?).

- Fundera över hur du ska använda datan — behöver du direkt export till Sheets eller djup API-integration?

- Börja med en gratis provperiod eller freemium-plan för att testa verkliga uppgifter.

- Underskatta inte värdet av bra support och dokumentation.

Slutsats: Lås upp affärsvärde med det bästa programmet för webbdatascraping

Webdata är bränslet för smartare affärsbeslut 2026. Rätt program för webbdatascraping kan spara dig timmar, minska fel och ge ditt team ett verkligt försprång — oavsett om du bygger leadlistor, bevakar konkurrenter eller matar din analysmotor.

För att sammanfatta:

- Thunderbit är den enklaste, AI-drivna kodfria scrapern för affärsanvändare.

- Import.io är lösningen i företagsklass för kontinuerliga, integrerade datapipelines.

- Scrapy är open source-verktyget för utvecklare som vill ha full kontroll.

- Octoparse och ParseHub gör visuell, kodfri scraping tillgänglig för alla.

De flesta av de här verktygen erbjuder gratis provperioder eller freemium-planer — så testa dem. Automatisera det tråkiga, lås upp nya insikter och låt teamet fokusera på det som verkligen spelar roll.

Lycka till med scraping — och må din data alltid vara färsk, strukturerad och redo att användas.

Vanliga frågor

1. Vad används program för webbdatascraping till?

Program för webbdatascraping automatiserar processen att extrahera information från webbplatser, PDF:er och bilder. Det används för leadgenerering, prisbevakning, marknadsundersökningar, innehållsaggregering med mera.

2. Är webbdatascraping lagligt?

Webbscraping är lagligt när du samlar in offentligt tillgänglig data och respekterar webbplatsens användarvillkor och integritetslagar. Granska alltid sajtens policy och använd data ansvarsfullt.

3. Behöver jag kunna koda för att använda program för webbdatascraping?

Inte nödvändigtvis! Verktyg som Thunderbit, Octoparse och ParseHub är skapade för icke-kodare. För mer komplexa eller skräddarsydda projekt kan utvecklarverktyg som Scrapy behövas.

4. Hur exporterar jag skrapad data till Excel eller Google Sheets?

De flesta moderna scrapers (Thunderbit, Octoparse, ParseHub) erbjuder export med ett klick till Excel, Google Sheets, CSV eller till och med direkt integration med Notion och Airtable.

5. Kan program för webbdatascraping hantera dynamiska sajter eller inloggningar?

Ja — toppverktyg som Import.io, Octoparse och ParseHub kan hantera dynamiskt innehåll (AJAX, oändlig scroll) och sajter med inloggningsskydd. Thunderbit stöder också scraping från dynamiska sidor och undersidor.

Vill du se hur modern webbscraping ser ut? eller utforska för fler tips, guider och fördjupningar i världen av AI-driven datainsamling.