Förra kvartalet satt vårt ops-team och la 40 timmar i veckan på att copy-pasta konkurrentdata rakt in i kalkylark. Det här kvartalet? 20 minuter, klart.

Vad var skillnaden? automatiserade verktyg för webbskrapning. De har gått från att vara något bara utvecklare orkade röra, till något som vilken säljare eller marknadsförare som helst kan sätta upp över lunchen.

Jag har byggt SaaS- och automationsverktyg i många år (och ja, jag var med och grundade ). 2026 års verktygsskörd är den starkaste hittills — AI-byggda från grunden, självläkande och faktiskt användbara även för icke-tekniska personer.

Här är 10 verktyg jag har testat praktiskt, jämförda efter användningsfall och kunskapsnivå.

Varför automatiserade verktyg för webbskrapning är viktiga för företag

Om vi ska vara helt ärliga: eran när man manuellt kopierade och klistrade data från webbplatser är över (om du inte råkar gilla belastningsskador och existentiell ångest). Automatiserade verktyg för webbskrapning har blivit affärskritiska för bolag i alla storlekar. Faktum är att , och webbskrapning är en central pusselbit i den strategin.

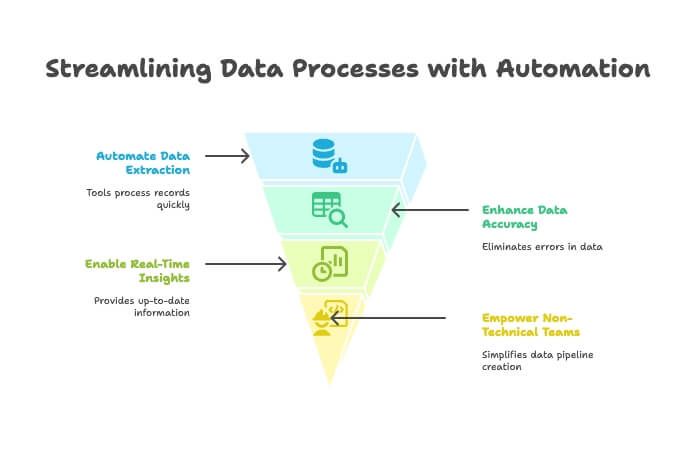

Därför är de här verktygen så värdefulla:

- Spara tid och minska manuellt arbete: Automatiserade skrapor kan tugga igenom tusentals poster på några minuter och frigöra tid till mer värdeskapande jobb. En användare uppgav att de sparade ”hundratals timmar” genom att automatisera datainsamlingen ().

- Högre datakvalitet: Inga fler stavfel eller borttappade rader. Automatiserad extraktion ger renare och mer pålitlig data.

- Snabbare beslut: Med data nära realtid kan du bevaka konkurrenter, följa priser eller bygga leadlistor utan att vänta på månadens praktikant-rapport.

- Gör det möjligt för icke-tekniska team: Tack vare no-code och AI-drivna verktyg kan även de som tror att ”XPath” är en yogaposition bygga datapipelines från webben ().

Det är inte direkt chockerande att , och nästan 80 % säger att deras organisation inte skulle kunna jobba effektivt utan den. 2026: om du inte automatiserar din datainsamling lämnar du sannolikt pengar — och insikter — på bordet.

Så valde vi de bästa automatiserade verktygen för webbskrapning

När marknaden för webbskrapningsprogram väntas kan det kännas som att köpa skor i en butik med 10 000 alternativ. Så här ringade jag in rätt verktyg:

- Användarvänlighet: Kan en icke-utvecklare komma igång snabbt? Eller är inlärningskurvan brutal?

- AI-funktioner: Använder verktyget AI för att automatiskt hitta datafält, hantera dynamiska sajter eller låta dig beskriva behov på vanlig svenska/engelska?

- Export och integrationer: Hur smidigt är det att få in data i Excel, Google Sheets, Airtable, Notion eller ert CRM?

- Pris: Finns gratis testperiod? Är betalplanerna rimliga för individer och små team, eller är det bara enterprise som gäller?

- Skalbarhet: Klarar verktyget både små engångskörningar och stora, schemalagda extraktioner?

- Målgrupp: Är det byggt för affärsanvändare, utvecklare eller båda?

- Unika styrkor: Vad är det som gör att verktyget faktiskt sticker ut?

Jag har tagit med verktyg för alla nivåer — från ”jag vill bara ha ett kalkylark” till ”jag vill crawla hela internet”. Nu kör vi.

1. Thunderbit: AI Web Scraper för alla

Jag börjar med verktyget jag kan utan och innan — eftersom mitt team och jag byggde det för att lösa exakt de problem jag sett affärsanvändare slita med i åratal. är inte en klassisk ”dra-och-släpp”-skrapa eller ett verktyg där du själv måste skriva selektorer. Det är en AI-driven dataassistent där du beskriver vad du vill ha, och verktyget gör grovjobbet — ingen kod, inget pill med XPath, inga tårar.

Varför Thunderbit ligger i topp

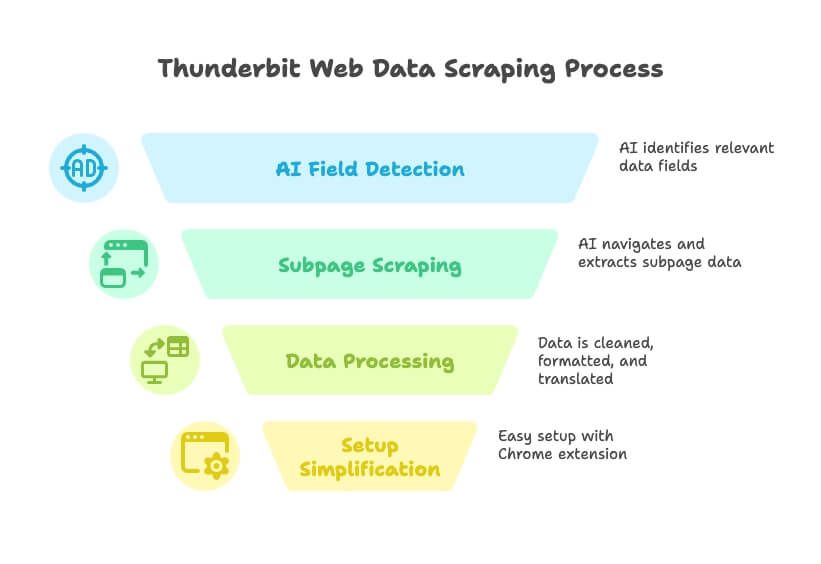

Thunderbit är det närmaste jag sett till att ”förvandla vilken webbplats som helst till en databas”. Så här funkar det:

- Styrt av naturligt språk: Säg bara vilken data du behöver (”Jag vill ha alla företagsnamn, e-postadresser och telefonnummer från den här katalogen”), så plockar AI:n upp relevanta fält.

- AI Suggest Fields: Med ett klick läser Thunderbit sidan och föreslår de bästa kolumnerna att extrahera — inget mer gissande eller trial-and-error.

- Undersidor och flernivåskrapning: Behöver du detaljer från varje annons/listnings undersida? Thunderbit kan klicka vidare, hämta extra info och lägga till den i tabellen.

- Datarensning, översättning och klassificering: Thunderbit hämtar inte bara rådata — det kan rensa, formatera, översätta och till och med kategorisera fält under skrapningen.

- Ingen krånglig setup: Installera , klicka på ”AI Suggest Fields” och du är igång på under en minut.

- Gratis test och låg kostnad: Generös gratisnivå (skrapa upp till 6 sidor gratis), och betalplaner från bara 9 USD/månad. Mindre än vad jag lägger på kaffe på en vecka.

Thunderbit är byggt för sälj-, marknads- och ops-team som behöver data — snabbt. Ingen kod, inga plugins, ingen utbildning. Som att ha en data-praktikant som faktiskt lyssnar och aldrig gnäller.

Thunderbits mest utmärkande funktioner

- AI-driven skrapning: AI:n fattar sidans struktur, anpassar sig när layouten ändras och hanterar även paginering och undersidor automatiskt ().

- Omedelbar export: Skicka resultat direkt till Excel, Google Sheets, Airtable, Notion eller ladda ner som CSV/JSON.

- Kör i molnet eller lokalt: Kör skrapningar i molnet för fart och skala, eller i webbläsaren om du behöver använda din inloggning/session.

- Schemalagd skrapning: Sätt återkommande jobb för att hålla data uppdaterad — perfekt för prisbevakning eller regelbundna lead-uppdateringar.

- Minimalt underhåll: Thunderbits AI anpassar sig när webbplatser förändras, så du lägger mindre tid på att laga trasiga skrapor ().

Vem passar det för? Alla som vill gå från ”jag behöver den här datan” till ”här är ditt kalkylark” på några minuter — särskilt icke-tekniska användare. Med och betyget 4,9★ blir Thunderbit snabbt förstavalet för affärsteam som vill ha resultat utan huvudvärk.

Vill du se det i praktiken? Kolla in eller bläddra bland fler .

2. Clay: Automatiserad data enrichment möter webbskrapning

Clay är som en schweizisk armékniv för growth-team. Det är inte bara en web scraper — det är ett automations-kalkylark som kopplar upp sig mot 50+ live-datakällor (tänk Apollo, LinkedIn, Crunchbase) och använder inbyggd AI för att berika leads, skriva outreach-mejl och poängsätta prospekt.

- Automatiserade arbetsflöden: Varje rad är ett lead, varje kolumn kan hämta data eller trigga en åtgärd. Vill du skrapa en företagslista, berika med LinkedIn-profiler och skicka ett personligt mejl? Clay fixar det.

- AI-integration: Använder GPT-4 för att skriva icebreakers, sammanfatta bios och mer.

- Integrationer: Kopplar direkt till HubSpot, Salesforce, Gmail, Slack med flera.

- Pris: Startar runt 99 USD/månad för pro-planen, med gratis test för lättare användning.

Bäst för: Outbound sales, growth hackers och marknadsförare som vill bygga egna lead-pipelines — där skrapning, enrichment och outreach sitter ihop. Kraftfullt, men kräver lite inkörning om du är ny på automationsverktyg ().

3. Bardeen: Web scraper i webbläsaren för arbetsflödesautomation

Bardeen är som att ha en webbläsarrobot som kan skrapa data och automatisera repetitiva webbuppgifter — direkt från ett Chrome-tillägg.

- No-code automation: Över 500 ”Playbooks” för skrapning, formulärifyllnad, flytta data mellan appar och mer.

- AI Command Builder: Beskriv uppgiften med vanlig text, så bygger Bardeen arbetsflödet.

- Integrationer: Funkar med Notion, Trello, Slack, Salesforce och 100+ andra appar.

- Pris: Gratis för lätt användning (100 automationskrediter/månad), betalplaner från 99 USD/månad för team.

Bäst för: Power users och go-to-market-team som vill automatisera både skrapning och uppföljningsåtgärder över flera appar. Väldigt flexibelt, men nybörjare kan uppleva en brantare inlärningskurva ().

4. Bright Data: Automatiserade webbskrapningsverktyg i enterprise-klass

Bright Data (tidigare Luminati) är tung utrustning för webbskrapning — tänk globalt proxynätverk, avancerade API:er och möjlighet att crawla tusentals sidor per dag.

- Enterprise-skala: Över 100 miljoner IP-adresser, Web Scraper IDE, Web Unlocker för att ta sig förbi anti-bot-skydd.

- Anpassningsbart: Bygg komplexa, storskaliga extraktioner med hög driftsäkerhet.

- Pris: Startar på 499 USD/månad för Web Scraper IDE, med mindre ”micro”-paket.

Bäst för: Stora företag, dataaggregatorer och avancerade användare som behöver robusta och skalbara lösningar. Om du crawlar tusentals sidor dagligen och måste undvika IP-blockering är Bright Data byggt för dig ().

5. Octoparse: Visuellt web scraper-verktyg för mellannivå

Octoparse är ett populärt no-code-verktyg med visuellt peka-och-klicka-gränssnitt — perfekt för dig som vill ha kraft utan att programmera.

- Dra-och-släpp-UI: Klicka på element för att definiera vad som ska extraheras, hantera inloggningar, paginering och mer.

- Mallar: 500+ färdiga mallar för vanliga sajter (Amazon, Twitter m.fl.).

- Molnskrapning: Kör jobb på Octoparses servrar, schemalägg extraktioner och använd IP-rotation.

- Pris: Gratisplan med begränsningar; betalplaner från 119 USD/månad.

Bäst för: Icke-programmerare och dataanalytiker som vill ha en kompetent skrapa utan kod. Bra för prisbevakning, produktlistor och researchprojekt ().

6. : Plattform för dataskrapning för företag

är en av veteranerna inom webbskrapning, som nu vuxit till en fullskalig plattform för dataextraktion.

- Peka-och-klicka-extraktion: Hanterar inloggningar, dropdowns och interaktiva element.

- Molnbaserat: Bearbeta tusentals URL:er parallellt, schemalägg extraktioner och använd API:er.

- Enterprise-fokus: Används för prisbevakning, marknadsanalys och för att bygga dataset för maskininlärning.

- Pris: Starter 199 USD/månad, Standard 599 USD/månad, Advanced 1 099 USD/månad.

Bäst för: Medelstora till stora företag och datateam som behöver stabila, underhållna lösningar för stora jobb. Troligen overkill för hobbyprojekt, men en riktig kraftmaskin i affärsskala ().

7. Parsehub: Flexibelt web scraper-verktyg med visuell editor

Parsehub är en desktop-app (Windows, Mac, Linux) där du bygger skrapor genom att klicka dig igenom en webbplats.

- Visuellt arbetsflöde: Välj element, sätt extraktionsregler och hantera inloggningar, dropdowns och infinite scroll.

- Molnfunktioner: Kör skrapningar i molnet, schemalägg jobb och få API-åtkomst.

- Pris: Gratisnivå för små jobb; betalplaner från 149 USD/månad.

Bäst för: Forskare, småföretag eller individer som vill ha mer kontroll än ett webbläsartillägg men inte är redo att koda en egen skrapa ().

8. Common Crawl: Öppen webbdata för AI och forskning

Common Crawl är inte ett verktyg i klassisk mening — det är ett enormt öppet dataset med webbcrawl-data som uppdateras varje månad.

- Skala: ~400 TB webbdata som täcker miljarder webbsidor.

- Gratis och öppet: Du behöver inte köra din egen crawler.

- Kräver teknisk kompetens: Du behöver big data-verktyg och viss ingenjörsvana för att filtrera och tolka datan.

Bäst för: Data scientists och ingenjörer som bygger AI-modeller eller gör storskalig forskning. Om du behöver generell webbtext eller långsiktiga arkiv är det en guldgruva ().

9. Crawly: Lättviktigt automatiserat webbskrapningsverktyg för startups

Crawly (av Diffbot) är en molnbaserad, AI-driven crawler som kan hämta data från miljontals webbplatser och returnera strukturerade resultat — utan att du behöver skriva parsregler.

- AI-extraktion: Använder maskinseende och NLP för att identifiera och extrahera innehåll.

- API-åtkomst: Fråga den insamlade datan och integrera med analysverktyg eller databaser.

- Pris: Enterprise-nivå; kontakta för pris.

Bäst för: Startups och team med viss teknisk kompetens som behöver storskalig, intelligent dataextraktion utan att bygga egna skrapor ().

10. Apify: Utvecklarvänligt web scraper-verktyg med marketplace

Apify är en molnplattform där du kan bygga egna skrapor (”Actors”) eller använda ett bibliotek av färdiga community-skrapor.

- Flexibilitet för utvecklare: Stöd för JavaScript/Python-baserad skrapning, headless Chrome, proxyhantering och schemaläggning.

- Marketplace: Stort bibliotek av färdiga skrapor för vanliga sajter.

- Pris: Gratisnivå med 5 USD/månad i krediter; betalplaner från 49 USD/månad.

Bäst för: Utvecklare och tekniskt kunniga analytiker som vill ha full kontroll och skalbarhet. Även icke-kodare kan använda färdiga Actors för vanliga uppgifter ().

Jämförelsetabell: automatiserade verktyg för webbskrapning

| Verktyg | Användarvänlighet | AI-funktioner | Pris (från) | Målgrupp | Unika styrkor |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Naturligt språk, AI Suggest Fields, skrapning av undersidor | 9 USD/mån | Icke-tekniska affärsanvändare | 2-klickssetup, ingen kod, direkt export, gratis test |

| Clay | ★★★★☆ | AI-berikning, GPT-4 | 99 USD/mån | Growth/sales ops | Automationskalkylark, enrichment, outreach |

| Bardeen | ★★★★☆ | AI-byggare för kommandon | 99 USD/mån | Power users, GTM-team | Webbläsar-RPA, 500+ playbooks, djupa integrationer |

| Bright Data | ★★☆☆☆ | Proxyrotation, anti-bot-AI | 499 USD/mån | Enterprise, utvecklare | Skala, driftsäkerhet, globala proxies |

| Octoparse | ★★★★☆ | Visuell AI-detektering | 119 USD/mån | Analytiker, icke-kodare | Dra-och-släpp, mallar, molnskrapning |

| Import.io | ★★★☆☆ | Interaktiva extraktorer | 199 USD/mån | Enterprise, datateam | Parallellitet, schemaläggning, API, support |

| Parsehub | ★★★★☆ | Visuella arbetsflöden | 149 USD/mån | Forskare, SMB | Desktop-app, hanterar dynamiska sajter |

| Common Crawl | ★☆☆☆☆ | N/A (endast dataset) | Gratis | Data scientists, ingenjörer | Massivt öppet dataset, webbskala-arkiv |

| Crawly | ★★☆☆☆ | AI-extraktion | Anpassat/Enterprise | Startups, tech-team | AI-drivet, inga parsregler, API-åtkomst |

| Apify | ★★★★☆ | Actor marketplace | 49 USD/mån | Utvecklare, tech-analytiker | Bygg/marketplace, molnautomation, flexibilitet |

Så väljer du rätt web scraper-verktyg för dina behov

Vilket automatiserat webbskrapningsverktyg som är bäst beror på teamets storlek, tekniska nivå och affärsmål. Här är min snabba guide:

- För icke-tekniska användare (sälj, marknad, ops): Välj . Det är byggt för dig — ingen kod, ingen setup, bara resultat. Perfekt för leadgenerering, prisbevakning och snabba dataprojekt.

- För team som älskar automation: Clay och Bardeen är starka om du vill kombinera skrapning med enrichment, outreach eller arbetsflödesautomation.

- För enterprise och utvecklare: Bright Data, och Apify är bäst för storskaliga, mycket anpassningsbara projekt.

- För forskare och analytiker: Octoparse och Parsehub ger visuella gränssnitt och kraftfulla funktioner utan att du behöver koda.

- För AI- och data science-projekt: Common Crawl och Crawly erbjuder enorma dataset och AI-driven extraktion för dig som vill bygga eller träna modeller.

Fråga dig själv: vill du vara igång på några minuter, eller behöver du en skräddarsydd enterprise-lösning? Om du är osäker — börja med en gratis testperiod. De flesta verktyg erbjuder det.

Thunderbits unika värde: AI-assistent för affärsdata

Bland alla verktyg sticker Thunderbit ut som det enda som på riktigt funkar som en ”AI-assistent” för webbskrapning och datatransformering. Det handlar inte bara om att hämta data — utan om att göra röriga webbplatser till rena, strukturerade insikter utan tekniska hinder.

- Gränssnitt med naturligt språk: Beskriv vad du behöver med vanlig text, så löser Thunderbit resten.

- Helautomatiserat flöde: Från extraktion till rensning, översättning och export — Thunderbit täcker hela kedjan.

- Perfekt för snabb testning: Behöver du validera en ny marknad, bygga en leadlista eller bevaka konkurrenter? Thunderbit är den snabbaste och mest kostnadseffektiva startpunkten.

Som att ha en dataanalytiker inbyggd i webbläsaren — en som aldrig ber om löneförhöjning eller tar semester.

Slutsats: börja smartare med rätt automatiserat webbskrapningsverktyg

Skrapningslandskapet 2026 är knappt igenkännligt jämfört med för två år sedan. Självläkande AI-skrapor, LLM-nativa pipelines och no-code-verktyg som faktiskt går att använda har förändrat spelplanen. Oavsett om du är ensam grundare, ett hungrigt säljteam eller en data scientist på enterprise-nivå finns det ett verktyg i listan som passar. Nyckeln är att matcha arbetsflöde och kompetens med rätt plattform — så du kan sluta brottas med kod och börja låsa upp insikter.

Om du vill slippa manuell copy-paste och jobba smartare: och se hur enkelt webbskrapning kan vara. Eller utforska alternativen ovan utifrån dina mål. Oavsett vilket tillhör framtiden för datadrivna företag dem som automatiserar.

Vill du lära dig mer? Besök för djupdykningar, guider och tips om hur du får ut mer av din webbdata. Lycka till med skrapningen — och må din data alltid vara ren och dina skrapor aldrig gå sönder (men om de gör det, låt AI:n ta hand om det).

Vanliga frågor

1. Varför är automatiserade verktyg för webbskrapning viktiga för affärsanvändare 2026?

Automatiserade verktyg för webbskrapning effektiviserar datainsamling, sparar tid och minskar manuellt arbete. De förbättrar datakvaliteten, stödjer beslut med uppdaterad information och gör det möjligt för icke-tekniska team att hämta och använda webbdata utan att skriva kod. Verktygen är nu centrala för sälj, marknad och operations.

2. Vad skiljer Thunderbit från andra verktyg för webbskrapning?

Thunderbit använder AI så att du kan beskriva vilken data du vill ha med vanlig text. Det identifierar automatiskt datafält, hanterar undersidor och paginering och exporterar resultat direkt till plattformar som Excel och Airtable. Det är byggt för icke-tekniska användare och erbjuder kraftfulla funktioner som datarensning och schemalagd skrapning till ett lågt pris.

3. Vilket verktyg är bäst för storskaliga enterprise-projekt?

Bright Data och passar bäst för enterprise. De erbjuder funktioner som proxyrotation, anti-bot-åtgärder, storskalig parallellitet och API-åtkomst, vilket gör dem lämpliga för organisationer som behöver bearbeta tusentals webbsidor pålitligt och i stor skala.

4. Finns det verktyg som kombinerar skrapning med automation och outreach?

Ja. Verktyg som Clay och Bardeen skrapar inte bara webbdata utan bygger in den i arbetsflöden. Clay berikar leads och automatiserar outreach, medan Bardeen låter användare automatisera webbläsarbaserade uppgifter och arbetsflöden med AI-drivna playbooks.

5. Vad är bästa alternativet för användare utan teknisk bakgrund?

Thunderbit är starkast för icke-tekniska användare tack vare gränssnittet med naturligt språk, AI-driven setup och hög användarvänlighet. Det kräver ingen kod eller krånglig konfiguration och passar affärsanvändare som behöver snabb och pålitlig data utan teknisk komplexitet.