En GitHub-sökning på "amazon scraper" ger ungefär . Begränsar du det till repositorier som pushats de senaste sex månaderna landar du på cirka — knappt 20 %. Resten? Övergivna guider, föråldrade wrappers och skript som slutade fungera i samma ögonblick som Amazon skärpte sitt skydd.

Jag har lagt mycket tid på att gräva i Amazon scraper-repositorier, läsa GitHub-ärenden och följa communitytrådar på Reddit och Stack Overflow. Mönstret är tydligt: någon hittar ett populärt repo, lägger en timme på att sätta upp det, kör det en gång och möts av en vägg av CAPTCHAs eller 503-fel. Amazons anti-bot-strategi 2026 är inte samma som för bara två år sedan — TLS-fingeravtryck, beteendeanalys och aggressiv CAPTCHA-användning har gjort den gamla spelboken "rotera user agents och hoppas på det bästa" nästan värdelös. Den här guiden går igenom de bästa praxis som faktiskt spelar roll om du vill få tillförlitliga Amazon-data från ett GitHub-repo, och vad du ska göra när, inte om, din scraper går sönder.

Vad är en Amazon Scraper på GitHub (och varför misslyckas så många)?

Ett Amazon scraper-GitHub-repo är vanligtvis ett open source-skript — oftast byggt i Python, Node.js eller Scrapy — som extraherar strukturerad data från Amazonsidor. Datamålen är välbekanta: produkttitel, pris, ASIN, betyg, antal recensioner, tillgänglighet, säljarinformation, kort för sökresultat och recensionstext.

Arkitekturen är oftast enkel:

- En HTTP-klient eller headless browser hämtar sidan.

- En HTML- eller JSON-parser extraherar fälten.

- Data sparas i CSV, JSON eller en databas.

Repositorier brukar delas in i fyra kategorier:

- Lätta Python-bibliotek (t.ex. )

- Scrapy-spindlar (t.ex. )

- Selenium- eller Playwright-automatiseringar för webbläsare

- API-wrapper-projekt som i praktiken är front ends till en kommersiell scrapingtjänst (t.ex. )

Felmönstret är förutsägbart. De flesta repos går sönder eftersom:

- Amazon ändrar sidlayouten eller HTML-fragment

- Amazon skickar en 503 eller CAPTCHA i stället för riktigt innehåll

- Scraparens TLS- och HTTP-fingeravtryck inte längre ser webbläsarliknande ut

- Mismatch i språk, lokalisering eller headers väcker misstänksamhet

- Underhållaren går vidare efter att ha löst sitt ursprungliga, smala användningsfall

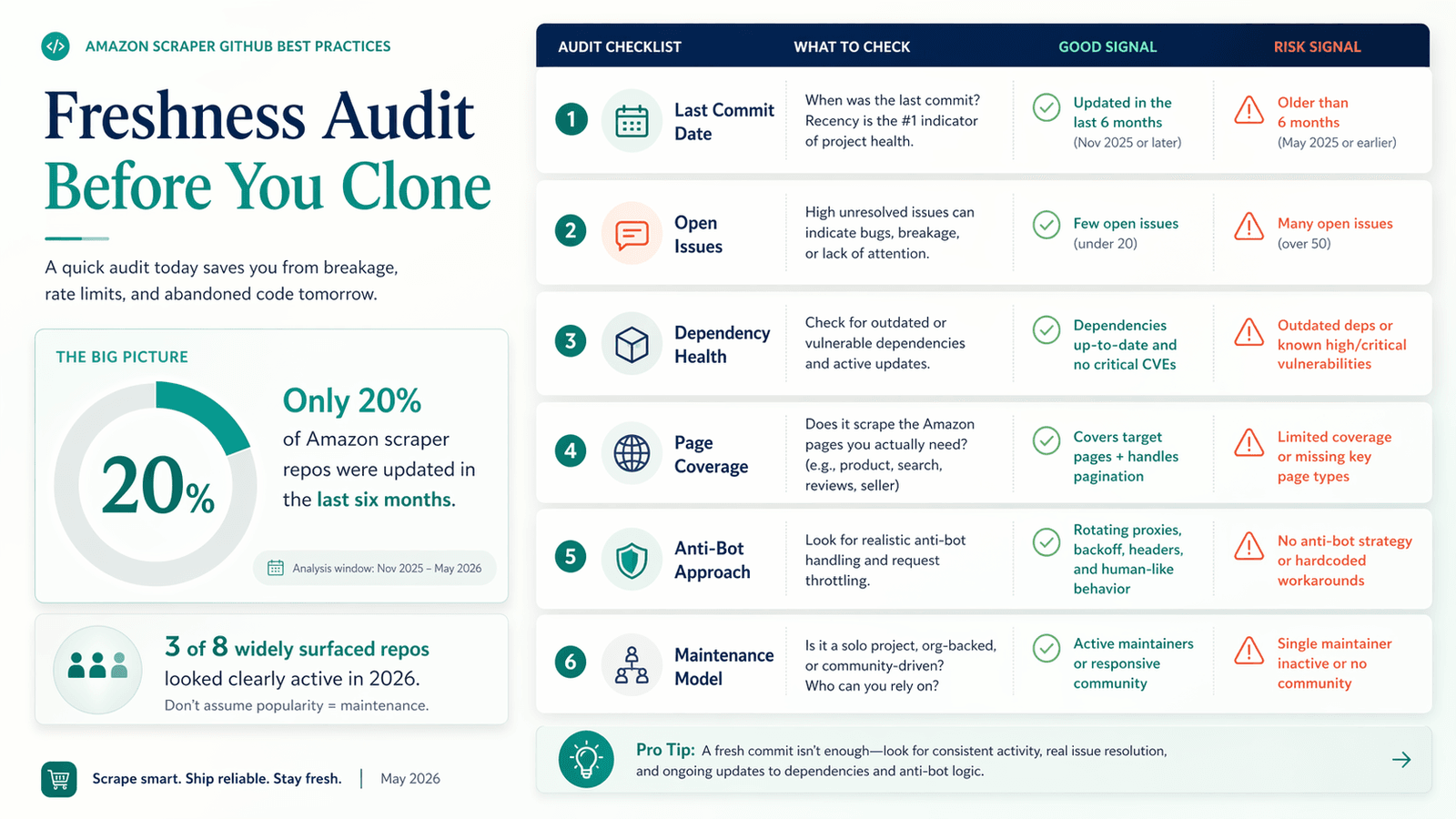

Höga stjärnbetyg och "för närvarande användbar" är två väldigt olika saker. I granskningen jag gjorde för den här artikeln såg bara ungefär tre av åtta brett synliga repos tydligt aktiva ut 2026.

Kör en färskhetsgranskning för 2026 innan du klonar något Amazon Scraper-GitHub-repo

Det här steget är viktigare för Amazon än för de flesta andra mål. Amazons försvar ändras snabbare än på en vanlig e-handelswebbplats, så ett repo som fungerar fint på en broschyrsajt kan bli värdelöst på Amazon inom några veckor. Ändå rekommenderar de flesta listor över "best amazon scraper github" repos utan att kontrollera om de fortfarande fungerar. Användare slösar timmar på att sätta upp trasiga verktyg.

Så kollar du om ett GitHub-repo fortfarande lever

Innan du git clone-ar något, gå igenom de här kontrollerna:

- Datum för senaste commit: Allt äldre än 6 månader är en tydlig varningssignal för Amazon.

- Öppna ärenden vs. svarsfrekvens: Sök i Issues-fliken efter "captcha", "503", "blocked" och "not working". Om sådana rapporter hopar sig utan svar från underhållaren, gå vidare.

- Tilläggens hälsa: Öppna

requirements.txtellerpackage.json. Föråldrade bibliotek (t.ex. gamlarequestsutan modern TLS-hantering) är en röd flagga. - Täckning av Amazons sidtyper: Klarar repo:t produktsidor, sökresultat OCH recensioner? Eller bara en av dem?

- Anti-bot-strategi: Hårdkodade headers utan proxy-stöd är ett upplägg från 2023 som inte håller 2026.

Checklista för färskhet i Amazon Scraper-GitHub

| Färskhetssignal | Vad du ska kontrollera | Varningstecken 🚩 |

|---|---|---|

| Datum för senaste commit | Commit-flöde eller datum för push till repo | Äldre än 6 månader |

| Öppna ärenden | Issues-fliken — filtrera på "captcha", "503", "blocked" | Upprepade fel utan svar från underhållaren |

| Tilläggens hälsa | requirements.txt / package.json | Föråldrade bibliotek, ingen modern TLS-strategi |

| Täckning av Amazon-sidor | README + kodexempel | Klarar bara en sidtyp (t.ex. produktsidor men inte sök eller recensioner) |

| Anti-bot-strategi | Källkod, proxykonfiguration | Bara hårdkodade headers och UA-strängar |

| Underhållsmodell | Är det en riktig scraper, en handledning eller en kommersiell API-wrapper? | Repo:t är i praktiken bara ett gränssnitt till en betaltjänst |

Vad granskningen faktiskt fann

Jag kollade åtta brett synliga Amazon scraper-repos mot de här kriterierna. Resultatet är nedslående:

| Repo / verktyg | Stjärnor | Signal för senaste commit | Omfattning | Status 2026 | Anteckningar |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2 872 | 2026-04-02 | Hanterad scraper-API-wrapper | Lever, men inte DIY | Färskt, men detta är egentligen ett front end till en hanterad tjänst |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Hanterat API för sök, detaljer, recensioner | Lever, men inte DIY | Bra täckning, men det är en API-produkt, inte en rå scraper |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Lättviktigt Python-bibliotek | Lever | Den tydligaste direkta GitHub-scrapern med curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Bara recensioner | Smal men användbar | Gammal och väldigt recension-specifik |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Senaste commit 2023; repo pushat 2024-08-20 | Scrapy-spindlar + proxy-mellanvara | Mer som en handledning, åldrande | Bra för lärande, inte en färdig 2026-stack |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Node CLI för sök, detaljer, recensioner | Hög risk | Bred täckning, men underhållet är för gammalt |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Sök till CSV | Död för 2026 | Populärt historiskt, tydligt föråldrat |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Handledning för sök/produkt | Död för 2026 | I praktiken arkivmaterial |

De publika ärendena berättar samma historia. har ett ärende med titeln "All requests receive captcha response." har "Doesn't seem to be working." har "Bypass Amazon protection." Det här är inte ovanliga kantfall — det är det första användare stöter på.

Anti-ban-spelboken: Så undviker du att bli blockerad med en Amazon Scraper från GitHub

Att bli blockerad är den enskilt största smärtpunkten för alla som använder ett amazon scraper github-projekt. Generella råd som "använd proxies och rotera user agents" räcker inte längre. Amazons anti-bot-stack för 2025–2026 omfattar TLS-fingeravtryck, beteendeanalys och aggressiv CAPTCHA-användning. Du behöver en flerskiktad strategi.

TLS-fingeravtrycksmatchning: varför vanlig requests leder till spärr

Det här är en av de mest förbisedda anti-ban-teknikerna. TLS-fingeravtryck fungerar så här: när ditt skript öppnar en säker anslutning till Amazon kan servern läsa ut mycket om klienten genom hur den "skakar hand" — vilka cipher suites som erbjuds, i vilken ordning extensioner skickas, inställningarna för HTTP/2. Webbläsare använder relativt fasta TLS- och HTTP/2-inställningar, och de kombinationerna går att identifiera via tekniker som .

Vanlig requests och standardmässiga httpx-upplägg kan kopiera headers, men de kopierar inte Chrome-liknande TLS- och HTTP/2-beteende. Amazon kan se skillnaden.

angriper detta direkt. Det erbjuder webbläsarimitering — stödda mål inkluderar chrome136, safari184 och firefox133 — så att din HTTP-klients TLS-fingeravtryck matchar en riktig webbläsare. I dokumentationen varnas uttryckligen för att generera slumpmässiga JA3-strängar: webbläsarfingeravtryck är i stort sett fasta per version, och slumpmässigt nonsens är lättare att upptäcka än ett verkligt kopierat fingeravtryck.

Communitydata bekräftar det här. En bekräftar att argumentet impersonate är användbart eftersom det roterar webbläsarprofiler och håller headers i synk. En annan noterar att Amazon blockerar klienter baserat på TLS-fingeravtryck "efter ungefär en månad eller två." En frågar specifikt om Amazon fingerprintar python-requests (spoiler: ja).

Om du fortfarande använder vanlig requests som din första Amazon-klient bör du uppdatera det antagandet innan du uppgraderar något annat.

Rätt proxyrotation (inte bara "använd proxies")

Poängen med proxies är inte att rotera så mycket som möjligt. Poängen är att få sessioner att se trovärdiga ut.

Residential vs datacenter: Datacenter-proxies är billigare men lättare att upptäcka. Residential-proxies kostar mer men är mycket svårare för Amazon att flagga. börjar på 4,00 USD/GB pay-as-you-go och ner till 3,50 USD/GB på större planer. börjar på 6 USD/GB. Amazon hör hemma i kategorin "sofistikerat mål" där residential-proxies är värda premiumpriset.

Rotation per begäran vs per session: Här gör de flesta guider fel. Att rotera proxy för varje enskild begäran samtidigt som cookies och headers förblir oförändrade kan se mindre mänskligt ut, inte mer. Det säkrare upplägget:

- Behåll flödet sök → produkt → recension på samma sticky session där det går

- Byt session när du startar en ny sökresa, inte vid varje begäran

- Rotera mellan sessioner, inte slumpmässigt inne i samma webbläsningssession

En noterade att vanliga ISP-IP-adresser inte fungerade alls lika bra som mobil-IP på populära e-handelswebbplatser. En annan rapporterade blockeringar även med roterande user agents och residential-proxies — en bra påminnelse om att proxies ensamma inte räcker.

Begäranshastighet, backoff och rate limiting

Amazons 503-sidor är inte slumpmässig otur. De är feedback.

Ett om att skrapa mer än 500 ASIN rapporterade en 503 på exakt samma punkt varje gång, runt ASIN 101, även med pauser. Mönstret är gammalt, men lärdomen är aktuell: rå volym från en IP eller ett fingeravtryck triggar till slut försvarsmekanismer.

Bästa praxis för pacing i egna GitHub-scrapers:

- Slumpmässiga fördröjningar mellan begäranden (inte fasta intervall, som går att upptäcka)

- 2 till 5 sekunder mellan publika produktbegäranden för enkla HTTP-klienter

- Exponentiell backoff efter 503 eller CAPTCHA — backa gradvis i stället för att försöka direkt igen

- Lägre concurrency än du tror att du behöver

- Fail-open-loggning i stället för hårda retry-loopar

De flesta amazon scraper github-repos saknar inbyggd rate limiting. Du måste lägga till det själv.

Header-orkestrering: mer än bara User-Agent-strängar

Amazon kontrollerar hela header-setet, inte bara User-Agent.

Ett realistiskt webbläsarheader-set bör inkludera:

User-AgentAcceptAccept-LanguageAccept-EncodingSec-CH-*-hintar när det är lämpligt- Anslutningsbeteende som stämmer med den valda webbläsarprofilen

Headers bör matcha marknadsplatsens lokalisering. En upptäckte att samma bot-upplägg bara upptäcktes i vissa lokaler, medan en annan kommentator pekade på regionspecifika headers som Accept-Language.

Regeln: headers, TLS-/webbläsarprofil och proxygeografi får inte motsäga varandra. Skicka inte Chrome-headers med en Firefox-UA. Använd inte en amerikansk proxy med Accept-Language: de-DE.

CAPTCHA-hantering: när du ska lösa och när du ska backa

Att stöta på en CAPTCHA betyder att Amazon redan är misstänksamt. Att lösa den nollställer inte din förtroendepoäng.

För enskilda CAPTCHA-händelser med låg frekvens:

- PyPI-paketet är en ren Python-lösare för Amazons text-CAPTCHA, men senaste versionen är från maj 2023 — se det som ett taktiskt verktyg, inte en hållbar strategi

- anger Amazon Captcha till 0,45 USD per 1 000 lösningar

För upprepade CAPTCHA-loopar:

- Sluta lösa och börja backa

- Upprepade CAPTCHAs betyder att sessionen är förbrukad — att lösa dem bygger inte upp förtroende för fingeravtrycket, sessionshistoriken eller IP-ryktet

- Om CAPTCHAs klustrar per proxy-subnät är problemet nätverkslagret, inte parsern

När du faktiskt behöver en headless browser (och när det är överdrivet)

Den felaktiga instinkten är att köra Playwright för allt.

Bra användningsfall för webbläsare:

- Sökresultat som beror på JavaScript-rendering eller lokalspecifikt tillstånd

- Recensionsflöden som omdirigerar till inloggnings- eller sign-in-sidor

- Flöden där cookies och webbläsarkontext är viktigare än rå hastighet

Dåliga användningsfall för webbläsare:

- Vanliga publika produktsidor

- Statisk extraktion av produktdetaljer där en webbläsarlik HTTP-klient räcker

- Storskalig bulkhämtning där beräkningseffektivitet spelar roll

Börja med den lättaste klient som fungerar. En om skrapning i stor skala beskrev utvecklingen: börja med requests, sedan curl_cffi, och gå bara över till en full webbläsare när de lättare alternativen misslyckas. Headless browsers är påtagligt långsammare och mer resurskrävande än HTTP-klienter för skrapning av Amazon-produktsidor.

Beslutsmatris för anti-ban i Amazon Scraper-GitHub-projekt

| Scenario | Rekommenderat upplägg | Varför |

|---|---|---|

| Publika produktsidor (liten skala) | curl_cffi + sticky residential-session | Billigaste vägen som ändå ser webbläsarlik ut |

| Sökresultatsidor | curl_cffi först, Playwright bara om rendering eller tillstånd bryter HTTP | Sök är mer tillståndsberoende och lokalkänsligt |

| Recensioner (inloggning krävs) | Webbläsarläge med riktiga cookies/session | Inloggning och dynamiska recensionsflöden är svårare att efterlikna med vanlig HTTP |

| Storskaligt (5k+ per dag) | Hanterat scraper-API, unlocker eller no-code-plattform | Egen GitHub-kod blir snabbt ett infrastrukturproblem |

När ditt Amazon Scraper-GitHub-projekt går sönder: ha en no-code-backup

Varje erfaren scraper har en plan B.

Amazon-uppdateringar kommer till slut att slå sönder vilket GitHub-repo som helst vid sämsta tänkbara tidpunkt. För e-handels-team betyder en trasig scraper missade prisändringar, föråldrad konkurrentdata och hål i dashboards.

Många som söker på "amazon scraper github" är egentligen affärsanvändare — e-handelsoperatörer, marknadsförare, FBA-forskare — som testade kodlösningar eftersom de inte hittade bättre alternativ. Forumdata visar också verklig frustration med Amazons officiella : begränsad åtkomst, begränsad data och som många säljare inte kan uppfylla.

Varför GitHub-Amazon-scrapers behöver ständig underhållning

Granskningen ovan gör det här tydligt:

- Föråldrade repos samlar på sig felrapporter utan åtgärder

- "Fungerande" repos pratar nu öppet om anti-bot-mekanismer i README:n

- Communitytrådar kretsar allt oftare kring TLS-fingeravtryck, CAPTCHA-loopar och proxykvalitet — inte CSS-selektorer

För affärsanvändare är det underhållsarbetet den verkliga dolda kostnaden. Repositoriet är gratis. Din tid att felsöka det klockan 02.00 är det inte.

Thunderbit som ett praktiskt alternativ till Amazon Scraper

erbjuder en som extraherar titel, pris, ASIN, betyg, varumärke, tillgänglighet, fraktursprung och ursprunglig URL — utan att du skriver kod.

Så här ser det ut i praktiken:

- Scraping i 2 klick jämfört med att sätta upp Python-miljöer, beroenden och proxykonfigurationer

- Omedelbar Amazon-mall — inget AI-overhead, bara extraktion med 1 klick

- Webbläsarbaserat scraping-läge för sidor som kräver inloggning (som recensionssidor som ställer till det för GitHub-scraper-användare)

- Molnbaserat scraping för publika produktsidor i hög hastighet (50 sidor åt gången)

- Gratis export till Google Sheets, Airtable, Notion, Excel — inte bara CSV/JSON

- Schemalagd scraper för löpande prisövervakning

- AI anpassar sig till layoutändringar — inget underhållsarbete för dig

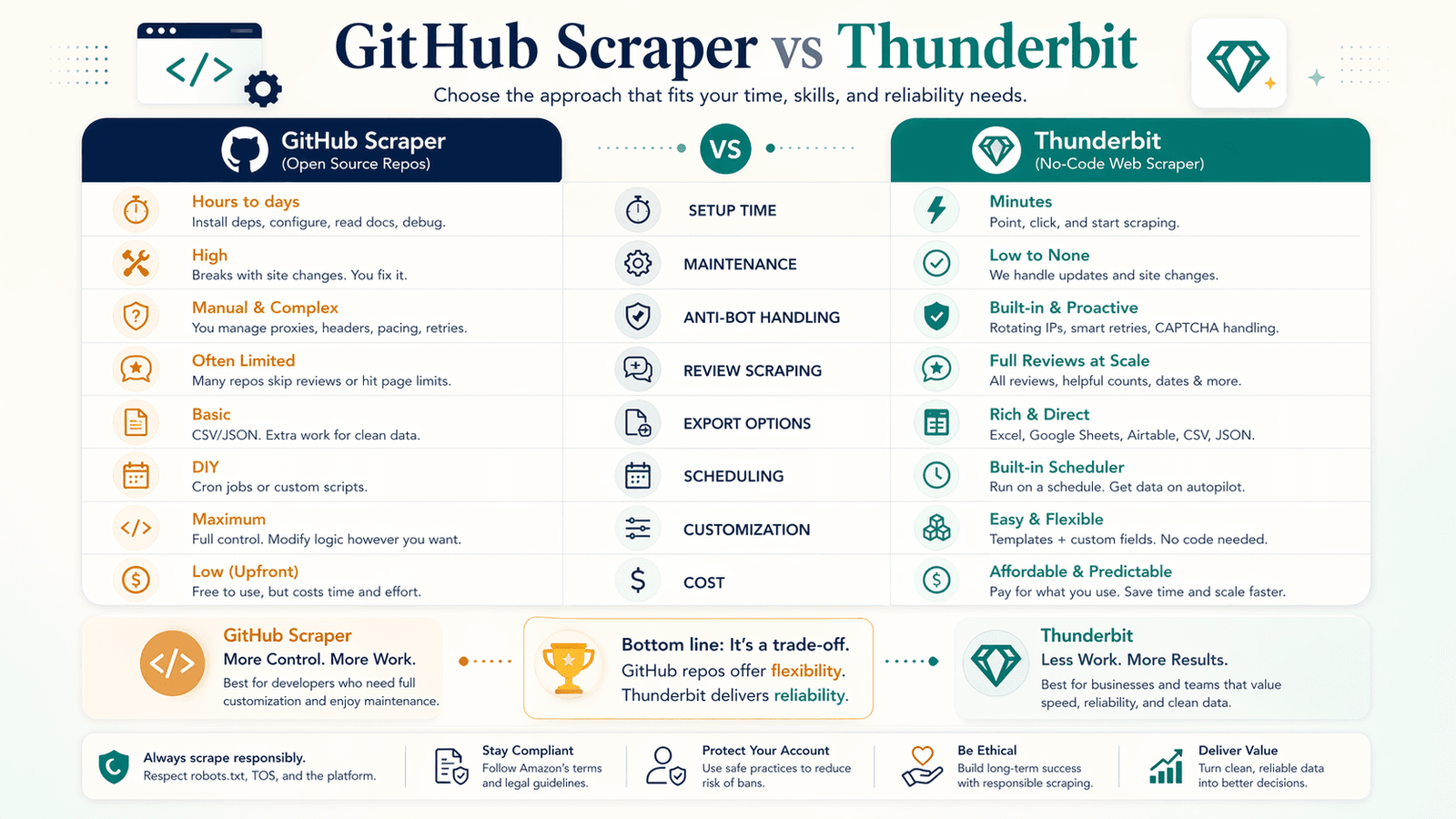

GitHub Amazon Scraper vs Thunderbit: ärlig jämförelse

| Faktor | GitHub-scraper (t.ex. AmzPy) | Thunderbit |

|---|---|---|

| Uppstartstid | 15–60 min (Python, beroenden, proxies) | ~2 min (installera Chrome-tillägget) |

| Underhåll | Du fixar trasigheter | AI anpassar sig till layoutändringar |

| Hantering av anti-bot | Görs själv (proxies, headers, TLS) | Inbyggt (moln- och webbläsarlägen) |

| Scraping av recensioner (inloggad) | Komplex sessionshantering | Webbläsarbaserat scraping-läge |

| Dataexport | Bara CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Schemaläggning | Görs själv (cron, Airflow osv.) | Inbyggd schemalagd scraper |

| Anpassning | Högre | Lägre |

| Kostnad | Gratis (plus proxykostnader) | Gratis nivå finns; kreditbaserat |

Den ärliga avvägningen: GitHub-repos ger mer anpassning; Thunderbit ger mer tillförlitlighet. Om ditt team prioriterar drifttid framför flexibilitet är no-code-vägen oftast det mer rationella valet.

Bästa praxis för schemalagd och återkommande Amazon-skrapning

De flesta amazon scraper github-projekt är byggda för engångskörningar, men verkliga affärsbehov — prisövervakning, lageruppföljning, konkurrentanalys — kräver återkommande scraping. GitHub-repos innehåller nästan aldrig schemaläggning inbyggd, så användarna får pussla ihop cron-jobb, Airflow eller n8n-flöden.

DIY-schemaläggning för GitHub-Amazon-scrapers

Den minsta fungerande återkommande uppsättningen:

- Cron-jobb på Linux eller macOS för att köra skriptet enligt schema

- Loggar med endast tillägg så att du kan felsöka fel i efterhand

- Deduplicering med ASIN + tidsstämpel så att du inte lagrar dubbletter

- Felaviseringar (även ett enkelt mejl vid icke-noll utgång) så att du vet när en körning går sönder klockan 03.00

För mer komplexa team:

- n8n för lättviktig workflow-automation (nämns ofta i communitytrådar)

- Airflow för tyngre schemalagda pipelines

- Tillstånd i databas om du behöver diffar och historik

Nyckeln är inte själva schemaläggaren — det är state management. Spåra senaste lyckade körning, senaste ASIN-mängd, ändrade priser och misslyckade URL:er.

Schemaläggning förenklad med Thunderbit

Thunderbits låter dig beskriva intervallet i vanlig svenska, mata in URL:er och klicka på "Schemalägg". AI:n omvandlar naturligt språk till ett cron-schema — ingen teknisk konfiguration behövs. För e-handelsteam utan utvecklare som bevakar priser eller konkurrenters produktlanseringar är det en tydlig minskning av driftsfriktion.

Bästa praxis för återkommande Amazon-skrapningar

De här gäller oavsett verktyg:

- Deduplicera med ASIN + tidsfönster — lagra inte samma produkt två gånger per körning

- Lagra priser som tal, inte råa strängar — sparar städning längre fram

- Lägg till skrapad tidsstämpel på varje rad — du behöver den för trendanalys

- Spåra deltas, inte bara nuvarande tillstånd — "priset sjönk 12 % sedan förra veckan" är mer användbart än "priset är 24,99 USD"

- Larma på meningsfulla förändringar — en konkurrent som sänker priset med 15 % är värd en notis; en fluktuation på 0,5 % är brus

- Tänk på datalagring — flat files funkar för små körningar; för 5k+ ASIN per dag, överväg databas eller molnark kalkylark

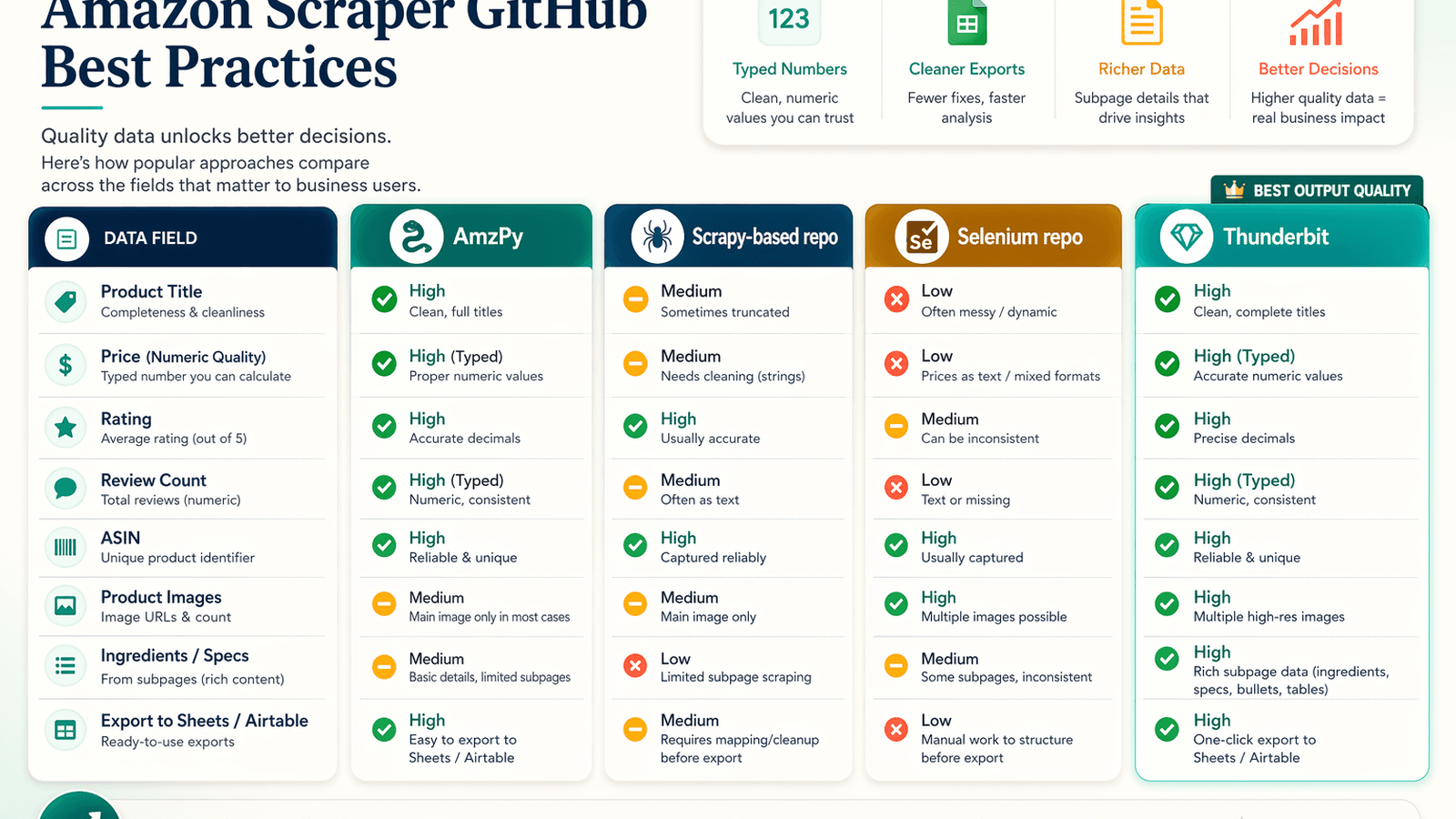

Kvalitet på utdata sida vid sida: vad varje Amazon Scraper-GitHub-lösning faktiskt ger

Ingen jämför faktisk utdatakvalitet mellan amazon scraper github-repositorier. Användare bryr sig djupt om datakvalitet — "vilket verktyg ger den renaste, mest kompletta datan" — men måste själva klona och testa varje repo. Det här avsnittet fyller den luckan.

Vad populära GitHub-repos faktiskt extraherar (och missar)

Baserat på exempel i README, publika exempel och dokumenterade utdataformat:

| Lösning | Vad den tydligt extraherar | Vanliga luckor / avvägningar |

|---|---|---|

| amzpy | Titel, pris, valuta, bild-URL, betyg, recensioner, varianter, ASIN | Mer inriktad på produktsidor; mindre rik på fullständiga recensioner/spec-avsnitt |

| tducret/amazon-scraper-python | CSV med titel, betyg, antal recensioner, produkt-URL, bild-URL, ASIN | Föråldrad, listningsfokuserad, svag anti-bot-strategi |

| python-scrapy-playbook scraper | Sökresultat, produktsidor, recensioner, CSV/JSON-pipelines | Mer som en handledning; förlitar sig på extern proxy-mellanvara; kräver sannolikt mer städning |

| omkarcloud/amazon-scraper | Sök, kategori, detaljer, topprecensioner, många bilder/videor/specifikationer | Inte en rå scraper — det är en hanterad API-tjänst |

| Thunderbit Amazon template | Titel, pris, ASIN, varumärke, betyg, recensioner, tillgänglighet, fraktursprung, berikning av undersidor | Mindre kontroll på kodnivå än egna skript |

Tabell för jämförelse av utdatakvalitet

| Datafält | AmzPy | Repo baserat på Scrapy | Selenium-repo | Thunderbit |

|---|---|---|---|---|

| Produkttitel | ✅ | ✅ | ✅ | ✅ |

| Pris (numeriskt) | ⚠️ sträng | ✅ | ⚠️ sträng | ✅ (numerisk typ) |

| Betyg | ✅ | ✅ | ✅ | ✅ |

| Antal recensioner | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Produktbilder | ❌ | ⚠️ endast miniatyr | ✅ | ✅ (full upplösning, exportbar) |

| Ingredienser/specifikationer | ❌ | ❌ | ❌ | ✅ (via scraping av undersidor + AI) |

| Export till Sheets/Airtable | ❌ | ❌ | ❌ | ✅ gratis |

Varför dataformat spelar roll för affärsanvändare

Rörig data skapar dolt arbete. Även en lyckad scraper kan bli ett operativt misslyckande om:

- Priser är strängar med valutasymboler i stället för rena tal

- Saknade värden är inkonsekventa (tom sträng vs null vs "N/A")

- Bilder bara är lågupplösta miniatyrer

- Recensionsfält eller specifikationer behöver efterbearbetning innan analys

För e-handels-ops-team påverkar ren data direkt analys-hastighet och beslutsfattande. Thunderbits AI formaterar data efter typ — tal som tal, datum som datum, URL:er som URL:er — så den är redo att användas direkt. GitHub-repos varierar kraftigt på den punkten, och städtiden blir snabbt betydande.

Snabbreferens: checklista för bästa praxis i Amazon Scraper-GitHub

- Kontrollera datum för senaste commit innan du klonar. Äldre än sex månader är en tydlig varningssignal på Amazon.

- Sök i issues efter "captcha", "503", "blocked" och "not working" innan du sätter upp något.

- Föredra

curl_cffieller en annan HTTP-klient som imiterar webbläsare framför vanligrequests. - Håll headers, TLS-profil, språk och proxygeografi konsekventa — inga motsägelser.

- Använd sticky sessions för webbläsningsflöden; rotera inte blint för varje begäran.

- Lägg till slumpmässig pacing och exponentiell backoff.

- Behandla upprepade CAPTCHAs som en förbrukad session, inte ett pussel som ska brute-forcas.

- Använd headless browsers bara när HTTP-klienter inte tillförlitligt kan återge sidan.

- Spara checkpoints och tillstånd så att misslyckade körningar kan återupptas säkert.

- Ha en backup-plan — oavsett om det är ett hanterat API eller ett no-code-verktyg som .

Juridiska och etiska överväganden för Amazon-scraping 2026

Några saker att känna till, kortfattat.

Amazons hållning är restriktiv och blir allt mer så. De tydligaste signalerna:

- Amazons egna hjälpsidor ger nu en som säger: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- Amazons förbjuder en bred uppsättning dynamiska sökvägar, recensionssökvägar, profil-sökvägar, önskelistor och erbjudandelistor.

- Amazons motsätter sig uttryckligen dold eller maskerad agentåtkomst, kringgående av säkerhetsåtgärder och att felaktigt identifiera en agent som Google Chrome. Amazon har också om incidenten.

- Amazon har mot OpenAI-crawlers i slutet av 2025.

Den praktiska risken är tydligt högre när du går från publika produktsidor till autentiserade flöden, maskerad automatisering eller kommersiell extraktion i hög volym. Det här är inte juridisk rådgivning — rådgör med ditt eget juristeam för just din situation.

Viktiga slutsatser: få tillförlitliga Amazon-data utan att bli spärrad

I ordning efter viktighet:

- Granska innan du klonar. Utgå från att de flesta GitHub-resultat är föråldrade, handledningar eller wrappers runt kommersiella API:er.

- Uppgradera nätverkslagret först. TLS-fingeravtryck och sessionskoherens spelar större roll än HTML-selektorer.

- Använd sticky residential-sessioner, inte slumpmässigt proxykaos. Rotera mellan sessioner, inte inom dem.

- Pausa begäranden som en människa, inte ett stresstest. Slumpmässiga fördröjningar och exponentiell backoff är icke-förhandlingsbara.

- Lös isolerade CAPTCHAs; pensionera upprepade utmanade sessioner. Brute-forca inte ett förbrukat fingeravtryck.

- Ha en fallback. Amazon kommer att ändra något mitt i veckan, och din GitHub-scraper går sönder. Ett underhållet no-code-verktyg som eller ett hanterat API kan hålla din datapipeline vid liv medan du felsöker.

- Prioritera utdatakvalitet. Ren, typad data sparar mer tid längre fram än en snabb men rörig scraper.

Om du vill ha tillförlitlighet framför anpassning erbjuder Thunderbit ett underhållet alternativ — kolla in eller titta på guider på . Utvecklare som vill ha full kontroll kan absolut använda GitHub-repos — men bara med de anti-ban- och underhållspraxis som beskrivs i den här guiden.

Vanliga frågor

Är det lagligt att skrapa Amazon-produktdata med en GitHub-scraper?

Amazons användarvillkor begränsar automatiserad datainsamling, och Amazon har aktivt drivit detta genom upphör-och-avstå-brev och tekniska motåtgärder (särskilt 2025–2026). Skrapning av offentligt tillgänglig produktdata befinner sig i en gråzon; skrapning bakom inloggning eller att maskera din bot som en riktig webbläsare innebär högre risk. Detta är inte juridisk rådgivning — rådgör med ditt juridiska team för ditt specifika användningsfall.

Hur ofta går Amazon scraper-GitHub-repos sönder?

Ofta. Amazon ändrar sidlayout, lägger till nya anti-bot-lager och avvecklar endpoints regelbundet. I granskningen för den här artikeln var bara ungefär 3 av 8 brett synliga repos tydligt fungerande 2026. Även "fungerande" repos har ofta öppna ärenden om CAPTCHAs och 503-fel. Räkna med att behöva felsöka eller uppdatera din setup varannan till varannan månad.

Vad är den bästa Amazon scraper på GitHub 2026?

Det finns ingen ensam vinnare — det beror på ditt användningsfall och din tekniska komfort. För en lättviktig, direkt Python-scraper är ett av de mer aktuella alternativen. För bredare täckning via ett hanterat API fungerar , men det är inte riktigt DIY. Använd färskhetschecklistan i den här artikeln för att utvärdera vilket repo som helst innan du satsar på det.

Kan Thunderbit skrapa Amazon utan kod?

Ja. Thunderbits extraherar produkttitel, pris, ASIN, betyg, varumärke, tillgänglighet och mer med ett enda klick. Den stöder webbläsarbaserat scraping-läge för sidor som kräver inloggning, molnbaserat scraping för publika sidor i hög hastighet, schemalagd scraping för återkommande jobb och gratis export till Google Sheets, Airtable, Notion och Excel. Du kommer igång genom att installera .

Hur undviker jag att få min IP spärrad när jag skrapar Amazon?

Använd en flerskiktsstrategi: (1) byt från vanlig requests till en TLS-imiterande klient som curl_cffi, (2) använd residential-proxies med sticky sessions i stället för slumpmässig rotation av datacenter-proxies, (3) lägg till slumpmässig pacing och exponentiell backoff, (4) håll hela header-setet konsekvent med din webbläsarprofil och marknadsplatsens lokalisering, och (5) behandla upprepade CAPTCHAs som en signal att pensionera sessionen, inte ett pussel att lösa i all oändlighet. För mer detaljer, se beslutsmatrisen för anti-ban tidigare i artikeln.