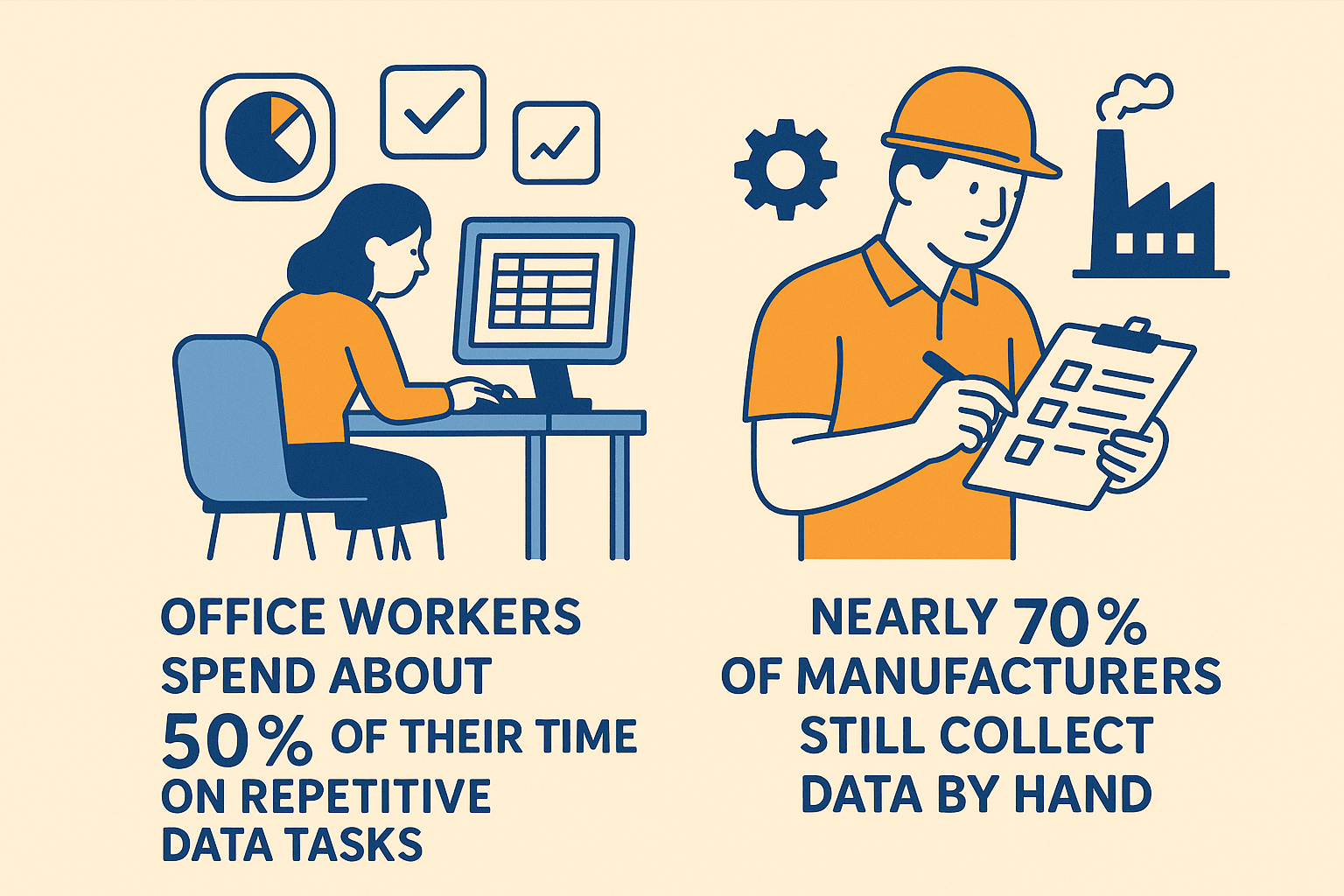

Se ti è mai capitato di annaffiare il giardino con un tubo bucato, sai bene quanto sia snervante vedere l’acqua che non arriva dove e quando serve. Ora pensa che quel tubo siano i dati della tua azienda—e invece di qualche goccia, ti ritrovi a gestire un vero fiume di informazioni che arrivano da decine di fonti diverse, tutte insieme. Benvenuto nel mondo moderno della gestione dei dati aziendali. Con di dati previsti entro il 2025, le aziende stanno facendo di tutto per non restare indietro. E la posta in gioco è altissima: i dipendenti passano circa in attività ripetitive legate ai dati, e quasi ancora raccoglie dati a mano. Non c’è da stupirsi se molti team si sentono come se stessero svuotando una barca che affonda con un cucchiaino.

Ed è qui che entrano in scena le data pipeline. Immaginale come l’impianto idraulico dei dati della tua azienda: collegano, puliscono e portano le informazioni esattamente dove servono—velocemente, in modo affidabile e senza sprechi. Dopo anni passati nel mondo SaaS e dell’automazione (e sì, anch’io ho costruito qualche “tubo” che ha fatto cilecca sotto pressione), ho visto quanto una buona data pipeline possa trasformare il caos in chiarezza. Vediamo insieme cos’è davvero una data pipeline, perché è fondamentale e come i nuovi strumenti—soprattutto gli estrattori web AI come —stanno rivoluzionando il lavoro di team commerciali, agenti immobiliari e non solo.

Cos’è una Data Pipeline? Spiegazione Semplice

In parole povere, una data pipeline è una serie di passaggi automatizzati che spostano i dati da una fonte a una destinazione, trasformandoli lungo il percorso per renderli davvero utili. Se ti piacciono le analogie (e chi non le ama?), eccone due classiche:

- Impianto idraulico: Proprio come i tubi portano l’acqua dal serbatoio al rubinetto—filtrandola e depurandola lungo il tragitto—una data pipeline trasporta dati grezzi da fonti (come database, API o siti web) verso destinazioni (dashboard o data warehouse), trasformandoli secondo necessità ().

- Catena di montaggio: Immagina una pizzeria: impasto, salsa, condimenti, cottura, confezionamento. Una data pipeline funziona allo stesso modo per le informazioni—gli “ingredienti” grezzi entrano, ogni fase aggiunge valore, e alla fine ottieni una “pizza” pronta per essere analizzata ().

In sintesi: una data pipeline raccoglie dati da varie fonti, li elabora (pulizia, unione, trasformazione) e li consegna dove il tuo team può davvero usarli—tutto in automatico e spesso in tempo reale.

Le Fasi Principali di una Data Pipeline

- Raccolta Dati (Ingestion): Prendere i dati da fonti come database, API, file o anche siti web tramite web scraping.

- Elaborazione/Trasformazione: Pulire, standardizzare e arricchire i dati (ad esempio: correggere errori, unire elenchi, calcolare totali).

- Archiviazione e Consegna: Salvare i dati lavorati in un data warehouse, dashboard o app, pronti per essere analizzati o usati.

Senza una pipeline, ti ritrovi a esportare manualmente, gestire mille fogli Excel e sperare che nulla vada perso nel passaggio.

Perché le Data Pipeline Sono Cruciali per le Aziende Moderne

Andiamo dritti al punto: perché dovresti interessarti alle data pipeline anche se non lavori nell’IT? Perché sono il motore invisibile dietro ogni decisione rapida e basata sui dati della tua azienda. Ecco come fanno la differenza:

- Insight tempestivi e decisioni più rapide: Con le pipeline, i dati arrivano quasi in tempo reale. Ad esempio, i team commerciali possono vedere subito i nuovi lead—contattarli entro 5 minuti porta a .

- Eliminazione dei silos informativi: Le pipeline integrano dati da diversi reparti (vendite, marketing, operations), offrendo una visione unica e mettendo fine alle discussioni su “quale foglio Excel è quello giusto”. considera i silos un ostacolo importante.

- Efficienza e automazione: Automatizzare le attività sui dati fa risparmiare un sacco di tempo. Un team marketing ha risparmiato solo automatizzando la reportistica.

- Cultura data-driven: Quando tutti hanno accesso a dati aggiornati, l’analisi self-service diventa realtà—niente più attese di settimane per un report dall’IT.

- ROI e vantaggio competitivo: Le aziende che adottano pipeline moderne vedono un in tre anni, grazie a decisioni migliori e maggiore efficienza.

Ecco una tabella che riassume i vantaggi per i diversi team:

| Team | Vantaggio della Pipeline | Impatto Esempio |

|---|---|---|

| Vendite | Dati su lead/clienti in tempo reale, aggiornamenti CRM | Risposta più rapida = 21× più lead qualificati (Voiso) |

| Operations | Metriche unificate e aggiornate | Inventario accurato = meno esaurimenti, previsioni migliori (Aampe) |

| Marketing | Analisi integrate, ottimizzazione campagne | 80 ore/mese risparmiate sui report (Coupler) |

| Finanza | Consolidamento automatico, report più veloci | Monitoraggio profitti in tempo reale, chiusure di fine mese più rapide |

| Analytics/BI | Dati centralizzati e puliti per l’analisi | Meno tempo a pulire, più tempo a generare insight |

In breve: le data pipeline trasformano i dati da problema a risorsa strategica.

La Gestione Tradizionale dei Dati: Perché Era Necessario Cambiare

Prima delle pipeline, la gestione dei dati era come cercare di radunare gatti: manuale, disordinata e lenta. Ecco com’era la situazione:

- Trasferimenti manuali: I team esportavano file CSV, li inviavano via email e copiavano dati tra sistemi. Un processo lento e pieno di errori. era speso in attività ripetitive.

- Silos informativi: Ogni reparto aveva i propri numeri, con report spesso in conflitto e riunioni infinite per allinearsi. conferma la presenza di silos nelle aziende.

- Aggiornamenti lenti e periodici: I report venivano aggiornati settimanalmente o mensilmente, quindi le decisioni erano sempre in ritardo rispetto alla realtà. Nel retail, .

- Processi soggetti a errori: I passaggi manuali portavano a errori—copia-incolla sbagliati, file obsoleti, bug logici. conteneva almeno un errore critico.

- Poca agilità: Serve un nuovo report o una metrica? Potevano volerci settimane di lavoro manuale o progetti IT su misura.

Con la crescita esponenziale dei dati, questi metodi non reggevano più. Era come correre una maratona con le infradito: lento, doloroso e decisamente sconsigliato (a meno che non ti piacciano le vesciche e le notti in bianco tra i fogli di calcolo).

Come le Data Pipeline Rivoluzionano la Gestione dei Dati

Le data pipeline cambiano le regole del gioco automatizzando e semplificando tutto il flusso dei dati. Ecco cosa cambia:

Prima (Manuale):

- I report di vendita settimanali richiedono 8 ore di lavoro.

- I dati sono sempre vecchi di una settimana.

- Gli errori passano inosservati e ogni nuova richiesta significa altro lavoro manuale.

Dopo (Pipeline):

- I dati vengono acquisiti, puliti e consegnati ogni giorno (o anche in tempo reale).

- I report si aggiornano automaticamente—niente più maratone notturne su Excel.

- Gli errori vengono intercettati subito e tutti lavorano sugli stessi dati aggiornati.

Per esempio, un’azienda retail con una pipeline può vedere ogni mattina vendite, inventario e performance marketing in dashboard aggiornate. Se le vendite di un prodotto calano improvvisamente, il team lo sa subito—non una settimana dopo. Questa sì che è agilità vera.

Componenti Fondamentali di una Data Pipeline

Ogni data pipeline, semplice o complessa, si basa su alcuni elementi chiave:

- Fonti Dati: Da dove arrivano i dati—database, app, file, API o siti web (tramite web scraping).

- Ingestion/Estrazione: Il processo di acquisizione dei dati dalle fonti nella pipeline.

- Trasformazione/Elaborazione: Pulizia, unione e formattazione dei dati per renderli utilizzabili.

- Archiviazione: Salvataggio dei dati elaborati in un data warehouse, data lake o database.

- Consegna (Consumo): Messa a disposizione dei dati in dashboard, report o altre app.

In breve: Fonte → Ingestion → Trasformazione → Archiviazione → Consegna.

Ad esempio, una pipeline commerciale può acquisire lead da un sito web (fonte), estrarli (ingestion), sistemare i numeri di telefono (trasformazione), salvarli in un CRM (archiviazione) e inviare notifiche ai commerciali (consegna).

Tipi di Data Pipeline: Batch vs. Real-Time

| Aspetto | Pipeline Batch | Pipeline Real-Time |

|---|---|---|

| Frequenza Dati | Periodica (giornaliera, oraria, settimanale) | Continua (secondi o millisecondi) |

| Latenza | Alta (minuti o ore) | Bassa (quasi istantanea) |

| Casi d’Uso | Report regolari, finanza mensile, carichi massivi | Dashboard live, rilevamento frodi, personalizzazione in tempo reale |

| Vantaggi | Più semplice, affidabile, ottima per analisi storiche | Insight immediati, reazioni rapide, ideale per operazioni sensibili al tempo |

| Sfide | I dati possono essere obsoleti tra un ciclo e l’altro | Più complessa, richiede infrastruttura di streaming solida |

La maggior parte delle aziende usa un mix: batch per paghe o analisi storiche, real-time per tutto ciò in cui la velocità fa la differenza (come trading, inventario live o allerta frodi).

Dove si Inserisce il Web Scraping nella Data Pipeline?

Qui viene il bello (e dove Thunderbit fa la differenza). Non tutti i dati sono ordinati in database o disponibili tramite API. Spesso le informazioni utili sono nascoste in siti web, PDF o immagini—non strutturate e difficili da esportare.

Il web scraping è la tecnica (e l’arte) di estrarre automaticamente dati dai siti web. In una data pipeline, il web scraping rappresenta un metodo di acquisizione dati per fonti altrimenti inaccessibili.

Casi d’Uso Aziendali Comuni del Web Scraping nelle Pipeline

- Monitoraggio prezzi della concorrenza: I retailer estraggono i prezzi dai siti dei competitor per adeguare i propri in modo dinamico ().

- Lead generation: I team commerciali estraggono contatti da directory, LinkedIn o siti di eventi, importandoli direttamente nel CRM.

- Ricerche di mercato: I marketer raccolgono recensioni, post su forum o commenti social per analisi di sentiment e trend.

- Immobiliare: Gli agenti aggregano annunci da più portali per analizzare il mercato locale o costruire database proprietari ().

- Raccolta dati pubblici: Estrazione da portali governativi, accademici o pubblici per ricerca o compliance.

Il web scraping è la “prima tappa” della pipeline per i dati esterni e non strutturati—trasformando pagine web in informazioni strutturate e utilizzabili.

Thunderbit: Ottimizzare la Raccolta Dati con l’Estrattore Web AI

Sono di parte, lo ammetto, ma vediamo come rende la raccolta dati non solo più semplice, ma anche più smart.

Cosa Rende Thunderbit Diverso?

- Estrazione in 2 click con AI Suggest: Basta cliccare su “AI Suggerisci Campi” e l’AI di Thunderbit legge la pagina, suggerisce le colonne migliori (come “Nome Prodotto”, “Prezzo”, “Valutazione”) ed estrae i dati. Niente codice, niente selettori complicati—solo risultati ().

- Gestisce qualsiasi sito, PDF o immagine: Thunderbit può estrarre dati non solo da pagine web, ma anche da PDF e immagini grazie all’OCR AI—supportando .

- Estrazione da sottopagine e paginazione: Hai bisogno di dettagli da sottopagine (come profili o pagine prodotto)? L’AI di Thunderbit può navigare, raccogliere informazioni aggiuntive e unirle automaticamente al dataset principale—senza configurazioni extra.

- Template istantanei per siti popolari: Per siti come Amazon, Zillow o LinkedIn, Thunderbit offre template pronti all’uso. Basta selezionare e partire—nessuna configurazione richiesta.

- Esportazione diretta nei tuoi strumenti: Esporta i dati direttamente su Excel, Google Sheets, Airtable o Notion. Oppure scarica in CSV/JSON per ulteriori elaborazioni.

- Estrazione programmata: Pianifica estrazioni ricorrenti (“ogni lunedì alle 9”) per mantenere la pipeline aggiornata—niente più aggiornamenti manuali.

- Arricchimento dati AI: Usa i Field AI Prompts per etichettare, categorizzare o tradurre i dati mentre vengono estratti.

Thunderbit in Azione: Esempio di Pipeline Reale

Immagina di essere un analista marketing che monitora le recensioni dei competitor su tre siti e-commerce. Con Thunderbit:

- Apri ogni sito, avvia l’estensione e lascia che AI Suggerisci Campi selezioni “Testo Recensione”, “Valutazione” e “Data”.

- Pianifica estrazioni settimanali—Thunderbit raccoglie le recensioni più recenti ed esporta tutto su Google Sheets.

- Usa i prompt AI per etichettare il sentiment (positivo/negativo/neutro) direttamente nell’output.

- La tua pipeline ora fornisce ogni settimana una dashboard aggiornata delle recensioni—senza copia-incolla manuale né buchi nei dati.

Ho visto team passare da ore di raccolta manuale a ottenere tutto ciò che serve in pochi minuti. E grazie alla semplicità di Thunderbit, anche chi non è tecnico può costruire e gestire la propria data pipeline.

Il Futuro: Data Pipeline Guidate dall’AI per Decisioni Intelligenti

Qui si fa davvero interessante. La prossima generazione di data pipeline non si limiterà a spostare dati—li renderà più intelligenti durante il flusso.

- Preparazione dati automatica: L’AI può pulire, arricchire e persino unire dataset in automatico. Immagina di dire alla pipeline: “Unisci vendite e dati meteo per regione” e l’AI fa tutto il resto ().

- Intelligenza in tempo reale: Le pipeline possono analizzare i dati mentre arrivano, segnalare anomalie e persino attivare azioni (come avvisare le vendite se un competitor abbassa i prezzi).

- Raccomandazioni AI: Oltre a fornire numeri, le pipeline possono suggerire insight—“Le vendite nella Regione X sono calate del 15%; probabilmente per una promozione della concorrenza”.

- Interfacce in linguaggio naturale: Presto potrai costruire o modificare pipeline semplicemente descrivendo ciò che vuoi in italiano.

Thunderbit sta già aprendo la strada con suggerimenti AI per i campi, arricchimento automatico e pianificazione in linguaggio naturale. L’obiettivo? Pipeline che non solo spostano dati, ma ti aiutano a capirli e sfruttarli—senza bisogno di essere un data engineer.

Riepilogo: Perché Ogni Azienda Dovrebbe Puntare sulle Data Pipeline

Ecco i punti chiave:

- Una data pipeline è la catena di fornitura dei tuoi dati—automatizza il percorso dai dati grezzi agli insight utili.

- Le pipeline risolvono i problemi tradizionali come lavoro manuale, silos informativi e report lenti e soggetti a errori.

- Ogni team ne beneficia: Le vendite rispondono più velocemente ai lead, il marketing ottiene analisi in tempo reale, le operations hanno inventario aggiornato e i manager una fonte unica di verità.

- Il web scraping è ora centrale nelle pipeline, grazie a strumenti AI come Thunderbit che rendono accessibili i dati esterni a tutti.

- Il futuro è guidato dall’AI: Le pipeline diventano sempre più intelligenti, automatizzate e facili da usare—mettendo la gestione dei dati nelle mani di chiunque, senza colli di bottiglia IT.

Se la tua azienda è ancora bloccata nell’era del copia-incolla, è il momento di cambiare. Parti in piccolo—automatizza un report settimanale, prova uno strumento come e scopri quanto tempo (e stress) puoi risparmiare. Il salto dal caos dei fogli di calcolo alla chiarezza delle pipeline è più vicino—e semplice—di quanto pensi.

Vuoi approfondire? Dai un’occhiata al per altre guide, oppure scopri come e .

Domande Frequenti

1. Cos’è una data pipeline in parole semplici?

Una data pipeline è un processo automatizzato che raccoglie, trasforma e consegna dati da varie fonti a una destinazione dove possono essere utilizzati—come un impianto idraulico per le informazioni aziendali.

2. Perché le data pipeline sono importanti per i team aziendali?

Fanno risparmiare tempo, riducono gli errori e garantiscono che tutti lavorino su dati aggiornati. Questo porta a decisioni più rapide, collaborazione migliore e ROI più alto per vendite, marketing, operations e altro ancora.

3. Come si inserisce il web scraping in una data pipeline?

Il web scraping funge da fonte dati, estraendo informazioni da siti che non offrono esportazioni o API. È essenziale per raccogliere dati esterni e non strutturati—come prezzi dei competitor, recensioni o elenchi pubblici.

4. Perché Thunderbit è una buona scelta per la raccolta dati nelle pipeline?

Thunderbit usa l’AI per rendere il web scraping semplice e potente—bastano due click per estrarre dati strutturati da qualsiasi sito, con funzioni come estrazione da sottopagine, template istantanei ed esportazione diretta nei tuoi strumenti preferiti.

5. Qual è il futuro delle data pipeline con l’AI?

Le pipeline guidate dall’AI automatizzeranno non solo il trasferimento, ma anche la pulizia, l’arricchimento e persino l’analisi dei dati—permettendo a chiunque di costruire e gestire pipeline con il linguaggio naturale e abilitando decisioni proattive in tempo reale.

Vuoi scoprire cosa può fare una data pipeline moderna per la tua azienda? e inizia subito a costruire flussi dati più intelligenti e veloci. Scopri di più