Lo web scraping è passato da competenza di nicchia a vero superpotere indispensabile per chiunque lavori nelle vendite, nelle operations o nella ricerca di mercato. Con il volume di dati sul web in continua esplosione — la creazione globale di dati è aumentata di quasi — non stupisce che consideri ormai i dati il “cuore” del processo decisionale. Ma ecco il punto: afferma che la gestione dei dati non strutturati, come l’HTML disordinato, è una sfida importante. Ho visto fin troppi team affogare in maratone di copia-incolla per trasformare informazioni dai siti web in fogli di calcolo — credimi, non è uno spettacolo piacevole.

È qui che entra in gioco BeautifulSoup in Python. In questo tutorial pratico ti guiderò passo dopo passo su come usare BeautifulSoup per lo web scraping, con un esempio concreto in Python che potrai adattare alle esigenze della tua azienda. E, visto che il mio obiettivo è sempre lavorare in modo più intelligente e non più faticoso, ti mostrerò anche come combinare BeautifulSoup con , il nostro estrattore web basato sull’IA, per velocizzare il flusso di lavoro e ottenere dati più puliti e strutturati — qualunque sia il tuo livello di programmazione.

Cos’è BeautifulSoup e perché usarlo per lo web scraping?

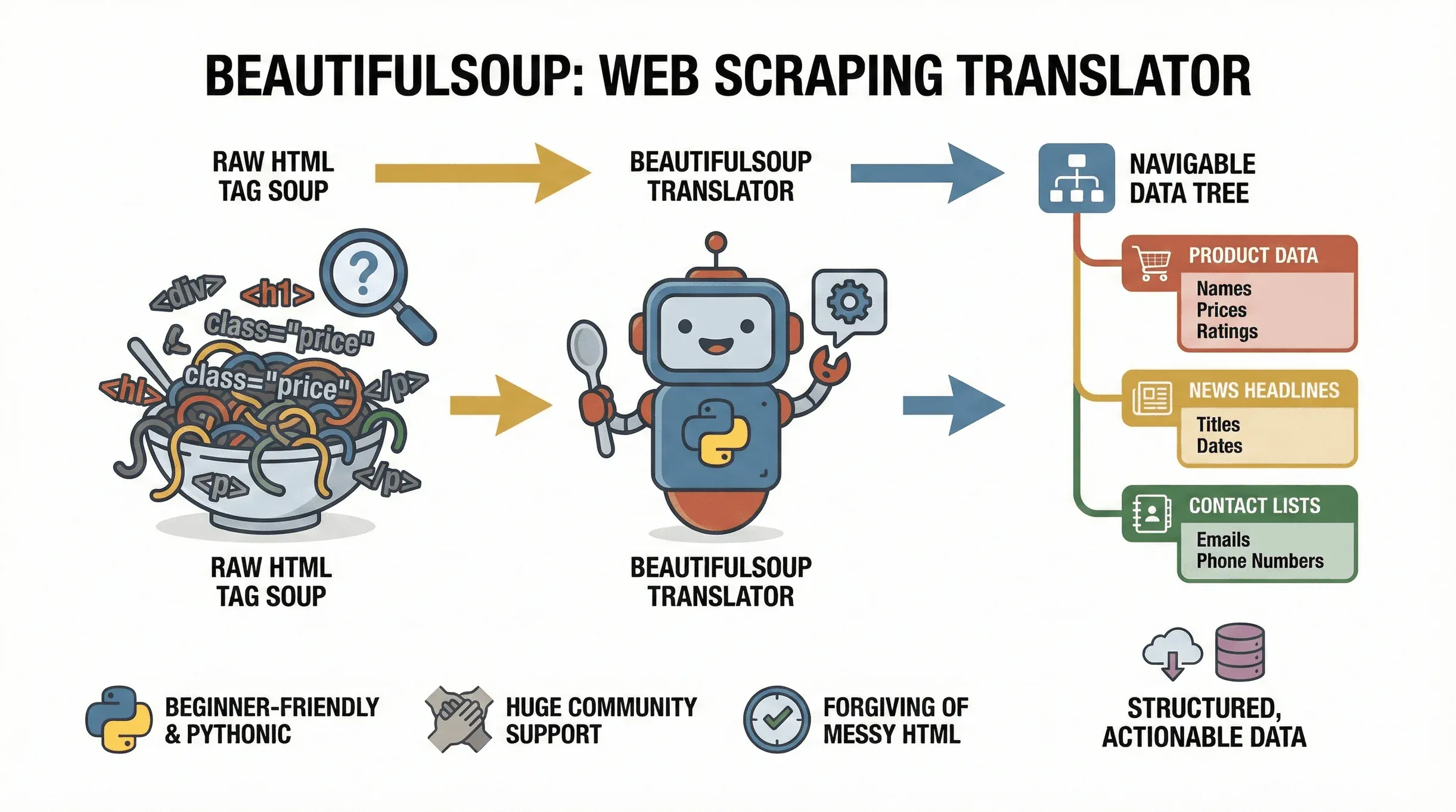

Partiamo dalle basi. è una libreria Python che rende semplice analizzare documenti HTML e XML. Pensala come un traduttore: prende il “tag soup” di una pagina web e lo trasforma in una struttura ad albero navigabile, così puoi trovare, estrarre e manipolare facilmente i dati che ti servono. Il progetto è ancora attivamente mantenuto —

Partiamo dalle basi. è una libreria Python che rende semplice analizzare documenti HTML e XML. Pensala come un traduttore: prende il “tag soup” di una pagina web e lo trasforma in una struttura ad albero navigabile, così puoi trovare, estrarre e manipolare facilmente i dati che ti servono. Il progetto è ancora attivamente mantenuto — beautifulsoup4 4.14.3 è stato pubblicato su PyPI a fine 2025 — quindi tutto ciò che impari qui è attuale. Che tu stia estraendo i prezzi dei prodotti da un sito e-commerce, raccogliendo titoli di notizie o facendo scraping di elenchi aziendali per trovare lead, BeautifulSoup è lo strumento di riferimento per trasformare le pagine web in dati strutturati e utilizzabili.

Perché è così popolare? Per cominciare, è estremamente adatto ai principianti. BeautifulSoup tollera bene l’HTML sporco o malformato (e diciamolo: il web ne è pieno), e la sua sintassi in stile Python ti permette di passare da zero allo scraping in poche righe di codice. È anche molto supportato, con milioni di download e una community enorme — quindi, se ti blocchi, una ricerca su Google di solito basta per trovare aiuto.

I casi d’uso tipici di BeautifulSoup includono:

- Estrarre nomi di prodotti, prezzi e valutazioni da pagine e-commerce

- Raccogliere titoli, autori e date di pubblicazione dai siti di notizie

- Analizzare tabelle o directory, come elenchi di aziende o contatti

- Recuperare email o numeri di telefono da siti di annunci

- Monitorare aggiornamenti, come variazioni di prezzo o nuove offerte di lavoro

Se i tuoi dati vivono in HTML statico, BeautifulSoup è il tuo migliore alleato per lo web scraping.

I vantaggi unici di BeautifulSoup per lo web scraping

Ci sono tantissime librerie Python per lo web scraping — quindi perché scegliere BeautifulSoup? Ecco come si confronta con la concorrenza:

- Semplicità: BeautifulSoup è leggero e facile da imparare. Non devi configurare un intero framework né scrivere tonnellate di codice boilerplate. È perfetto per attività di scraping rapide e occasionali, o per chi sta iniziando.

- Tolleranza agli errori: Sa gestire HTML rotto o malformato, cosa più comune di quanto si pensi.

- Flessibilità: Non sei costretto in un’architettura di crawling rigida. Ti basta passargli l’HTML ed estrarre ciò che ti serve.

- Integrazione: BeautifulSoup si integra bene con altre librerie Python come

requestsper scaricare pagine web,csvper salvare i dati epandasper l’analisi dei dati.

Come si confronta con altri strumenti?

| Strumento | Ideale per | Vantaggi | Svantaggi |

|---|---|---|---|

| BeautifulSoup | Analisi di HTML statico, principianti | Semplice, configurazione rapida, tollerante, flessibile | Non adatto a siti molto basati su JavaScript |

| Scrapy | Operazioni su larga scala, asincrone | Potente, scalabile, crawling integrato | Curva di apprendimento più ripida, più configurazione |

| Selenium | Contenuti JavaScript/dinamici | Può interagire con JS, compilare moduli, cliccare pulsanti | Più lento, più pesante, più dispendioso in risorse |

Se stai appena iniziando o devi analizzare rapidamente pagine statiche, BeautifulSoup è il “coltellino svizzero” dello web scraping (). Per siti più complessi o dinamici, potresti combinarlo con Selenium o Scrapy — ma BeautifulSoup è il modo migliore per imparare le basi.

Configurare l’ambiente Python per BeautifulSoup

Pronto a iniziare? Ecco come configurare il tuo ambiente:

-

Installa Python: Scarica l’ultima versione da .

-

Configura un ambiente virtuale (facoltativo, ma consigliato):

1python -m venv venv 2source venv/bin/activate # Su Windows: venv\Scripts\activate -

Installa BeautifulSoup e le dipendenze:

1pip install beautifulsoup4 requests lxml html5libbeautifulsoup4: la libreria principalerequests: per scaricare pagine weblxmlohtml5lib: parser HTML più veloci e affidabili

-

Suggerimenti per risolvere i problemi:

- Se ricevi un errore “pip not found”, prova con

pip3opy -m pip. - Su Mac/Linux, potresti aver bisogno di

sudoper i permessi. - Se sei su Windows, assicurati che Python sia aggiunto al PATH.

- Se ricevi un errore “pip not found”, prova con

Per verificare che tutto funzioni, esegui questo rapido test:

1from bs4 import BeautifulSoup

2import requests

3html = requests.get("http://example.com").text

4soup = BeautifulSoup(html, "html.parser")

5print(soup.title)Se vedi <title>Example Domain</title>, sei a posto ().

Un esempio Python Beautiful Soup passo dopo passo

Entriamo in un esempio reale di python beautiful soup. Immagina di voler estrarre i titoli delle ultime notizie da un sito pubblico di news. Ecco come fare:

1. Recupera la pagina web

1import requests

2from bs4 import BeautifulSoup

3url = "https://www.bbc.com/news"

4response = requests.get(url)

5html = response.text2. Analizza l’HTML

1soup = BeautifulSoup(html, "html.parser")3. Esamina la struttura HTML

Apri gli Strumenti per sviluppatori del browser (clic destro → Ispeziona) e cerca i tag che contengono i titoli. In molti siti di news, i titoli si trovano in tag <h3> con classi specifiche.

Per esempio, potresti vedere:

1<h3 class="gs-c-promo-heading__title">Titolo della notizia</h3>4. Estrai i dati

1headlines = soup.find_all("h3", class_="gs-c-promo-heading__title")

2for h in headlines:

3 print(h.get_text(strip=True))Questo stamperà tutti i titoli delle notizie presenti nella pagina.

5. Salva i dati in CSV

Salviamo quei titoli per analizzarli più tardi:

1import csv

2with open("headlines.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.writer(file)

4 writer.writerow(["titolo"])

5 for h in headlines:

6 writer.writerow([h.get_text(strip=True)])Ora hai un file CSV pronto per Excel o Google Sheets.

Comprendere la struttura HTML per estrarre i dati in modo efficace

Prima di scrivere qualsiasi codice, ispeziona sempre l’HTML della pagina. Ecco come fare:

- Apri gli Strumenti per sviluppatori: fai clic destro sulla pagina e seleziona “Ispeziona”.

- Trova i dati: passa il mouse sugli elementi per vedere quali tag contengono le informazioni che ti servono, ad esempio titoli, prezzi o autori.

- Annota tag e classi: cerca identificatori univoci come

class="product-title"oid="main-content". - Testa i selettori: usa i metodi

.find(),.find_all()o.select()di BeautifulSoup per indirizzare quegli elementi.

Suggerimento pratico: usa soup.prettify() per stampare una versione leggibile dell’HTML nella console Python.

Estrarre e strutturare i dati con BeautifulSoup

Supponiamo che tu voglia estrarre sia i titoli sia gli autori da una pagina blog:

1articles = soup.find_all("article")

2data = []

3for article in articles:

4 title = article.find("h2").get_text(strip=True)

5 author = article.find("span", class_="author").get_text(strip=True)

6 data.append({"title": title, "author": author})Ora hai un elenco di dizionari — perfetto per esportare in CSV o per ulteriori analisi.

Puoi estrarre link, immagini o qualsiasi attributo in questo modo:

1for link in soup.find_all("a"):

2 print(link.get("href"))Oppure le immagini:

1for img in soup.find_all("img"):

2 print(img.get("src"))Salvare i dati estratti: da Python a Excel o CSV

Una volta strutturati i dati, esportarli è facile. Ecco come farlo con il modulo csv:

1import csv

2with open("articles.csv", "w", newline='', encoding="utf-8") as file:

3 writer = csv.DictWriter(file, fieldnames=["title", "author"])

4 writer.writeheader()

5 for row in data:

6 writer.writerow(row)Oppure, se preferisci pandas:

1import pandas as pd

2df = pd.DataFrame(data)

3df.to_csv("articles.csv", index=False)

4df.to_excel("articles.xlsx", index=False)Usa sempre la codifica UTF-8 per evitare problemi con caratteri speciali, soprattutto quando lavori con dati internazionali.

Caso di studio: fare scraping dei dati di un sito di news con BeautifulSoup

Vediamo un esempio pratico di python beautiful soup: estrarre titoli degli articoli, autori e date di pubblicazione da un sito di news.

Supponiamo di voler fare scraping di per i dati degli articoli:

1import requests

2from bs4 import BeautifulSoup

3import csv

4url = "https://edition.cnn.com/world"

5response = requests.get(url)

6soup = BeautifulSoup(response.content, "html.parser")

7articles = soup.find_all("article")

8data = []

9for article in articles:

10 title_tag = article.find("h3")

11 date_tag = article.find("span", class_="date")

12 author_tag = article.find("span", class_="author")

13 title = title_tag.get_text(strip=True) if title_tag else ""

14 date = date_tag.get_text(strip=True) if date_tag else ""

15 author = author_tag.get_text(strip=True) if author_tag else ""

16 data.append({"title": title, "date": date, "author": author})

17with open("cnn_articles.csv", "w", newline='', encoding="utf-8") as file:

18 writer = csv.DictWriter(file, fieldnames=["title", "date", "author"])

19 writer.writeheader()

20 for row in data:

21 writer.writerow(row)Questo script recupererà gli ultimi articoli, estrarrà titolo, data e autore e li salverà in un CSV — sempre che il markup attuale di CNN corrisponda ancora ai tag sopra indicati. I grandi siti di news modificano spesso classi e struttura DOM, quindi controlla di nuovo la pagina prima di usarlo su dati di produzione. La struttura (<article> come contenitore, poi find sui tag figli) è il pattern stabile; i nomi di classe specifici come "date" e "author" sono segnaposto da adattare a ciò che la pagina live mostra in quel momento.

Migliorare il flusso di lavoro: combinare BeautifulSoup con Thunderbit

Ora parliamo di come rendere il tuo flusso di scraping ancora più fluido. è un’estensione Chrome per l’estrazione web basata sull’IA che elimina le congetture dall’estrazione dei dati. Con Thunderbit puoi:

- Usare “AI Suggest Fields”: Thunderbit legge la pagina e suggerisce automaticamente quali campi di dati estrarre — niente più caccia nell’HTML o modifica dei selettori.

- Fare scraping delle sottopagine: Thunderbit può seguire i link verso sottopagine, come pagine prodotto o articoli individuali, e arricchire il tuo dataset con dettagli extra.

- Esportare all’istante: invia i tuoi dati direttamente a Excel, Google Sheets, Airtable o Notion con un clic.

- Gestire la paginazione: Thunderbit può estrarre dati su più pagine, incluso lo scroll infinito.

- Programmare le estrazioni: imposta attività ricorrenti per mantenere i dati sempre aggiornati.

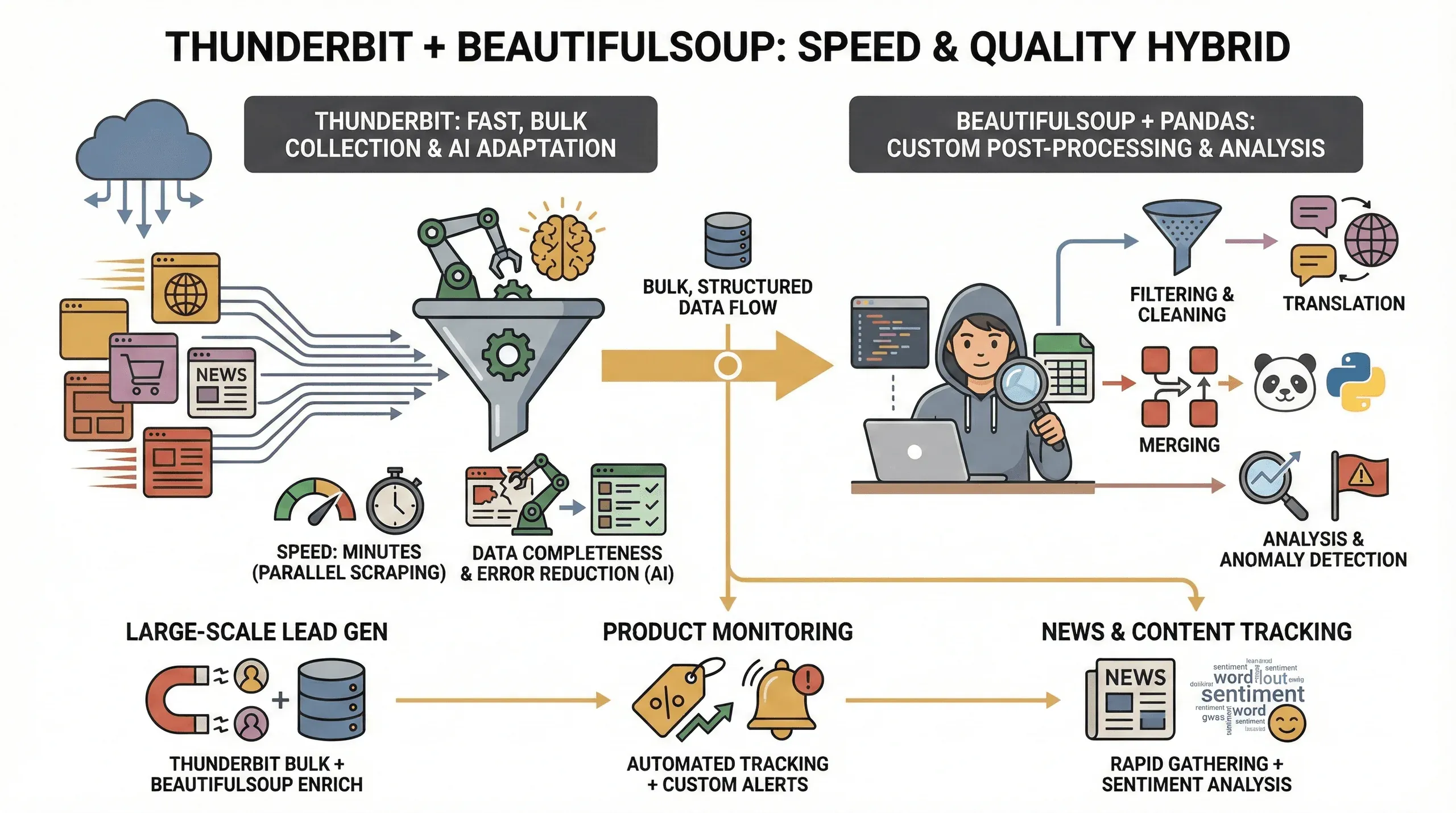

Ecco un flusso ibrido che adoro:

- Inizia con Thunderbit: apri il sito di destinazione, clicca l’icona di Thunderbit e lascia che “AI Suggest Fields” identifichi le colonne giuste, come titolo, autore e data.

- Esporta i dati: scarica i risultati in CSV oppure inviali a Google Sheets.

- Usa BeautifulSoup per l’elaborazione personalizzata: se ti serve un’analisi più approfondita, come pulizia del testo, deduplicazione o combinazione con altre fonti, carica il CSV esportato in Python e usa BeautifulSoup o pandas per il post-processing.

Questa combinazione ti offre il meglio di entrambi i mondi: la velocità di Thunderbit e il rilevamento dei campi basato sull’IA, più la flessibilità di BeautifulSoup per la logica personalizzata.

Velocità e qualità dei dati: perché usare insieme Thunderbit e BeautifulSoup?

Perché usare entrambi gli strumenti? Ecco cosa ho osservato:

Perché usare entrambi gli strumenti? Ecco cosa ho osservato:

- Velocità: Thunderbit può estrarre decine di pagine in parallelo (fino a 50 alla volta in modalità cloud), così ottieni i dati in minuti invece che in ore.

- Completezza dei dati: l’IA di Thunderbit si adatta ai cambiamenti di layout ed è in grado di estrarre dati strutturati anche da siti difficili, riducendo il rischio di campi mancanti.

- Riduzione degli errori: niente più script che si rompono quando cambia un nome di classe — l’IA di Thunderbit rivaluta la pagina ogni volta.

- Post-processing personalizzato: per esigenze avanzate, come filtraggio, traduzione o unione di dataset, BeautifulSoup e pandas ti danno pieno controllo.

Questo approccio ibrido è particolarmente utile per:

- Generazione lead su larga scala: usa Thunderbit per raccogliere i dati in massa, poi BeautifulSoup per ripulirli e arricchirli.

- Monitoraggio prodotti: Thunderbit gestisce lo scraping ripetitivo, mentre BeautifulSoup ti consente di analizzare trend o segnalare anomalie.

- Tracciamento di notizie e contenuti: raccogli rapidamente gli articoli con Thunderbit, poi usa Python per l’analisi del sentiment o l’estrazione di parole chiave.

Risolvere i problemi più comuni nello web scraping con BeautifulSoup

Lo web scraping non è sempre una passeggiata — ecco alcune difficoltà comuni e come risolverle:

- Contenuti dinamici: se un sito carica i dati con JavaScript, come scroll infinito o AJAX, BeautifulSoup da solo non li vedrà. In questi casi usa Selenium o la modalità browser di Thunderbit.

- Misure anti-bot: alcuni siti bloccano le richieste automatiche. Prova a impostare un header User-Agent personalizzato, aggiungi ritardi tra una richiesta e l’altra o usa lo scraping cloud di Thunderbit per superare i blocchi più semplici.

- Cambiamenti nella struttura HTML: se il tuo script smette improvvisamente di funzionare, probabilmente l’HTML del sito è cambiato. Ispeziona di nuovo la pagina e aggiorna i selettori. L’IA di Thunderbit può aiutarti adattandosi al volo.

- Dati mancanti: controlla sempre che gli elementi esistano prima di chiamare

.get_text(). Usa.get()invece di[]per gli attributi, così eviti KeyError. - Problemi di codifica: salva i file in UTF-8 per gestire correttamente i caratteri speciali.

E soprattutto, rispetta sempre robots.txt e i termini di servizio del sito. Fai scraping in modo responsabile — a nessuno piacciono i robot maleducati.

Conclusione e punti chiave

Lo web scraping con BeautifulSoup è una delle competenze più pratiche che tu possa imparare nel mondo odierno guidato dai dati. Ecco cosa abbiamo visto in questo tutorial su BeautifulSoup per lo web scraping:

- BeautifulSoup è il punto di partenza ideale per analizzare HTML statico ed estrarre dati strutturati con Python.

- La configurazione è semplicissima — basta installare Python, pip e un paio di librerie.

- Ispezionare l’HTML è fondamentale per colpire i dati giusti.

- Esportare in CSV/Excel rende i dati subito pronti per l’analisi aziendale.

- Combinare con Thunderbit ti offre rilevamento dei campi con IA, scraping più veloce ed esportazioni più semplici — perfetto per utenti business e non programmatori.

- I flussi ibridi (Thunderbit per l’estrazione in massa, BeautifulSoup per l’elaborazione personalizzata) offrono il miglior equilibrio tra velocità, qualità dei dati e flessibilità.

Se sei pronto a fare un salto di qualità nel tuo web scraping, prova entrambi gli strumenti: sperimenta con un semplice script BeautifulSoup e poi scopri quanto più veloce puoi andare con . E per altre guide pratiche, dai un’occhiata al .

Buon scraping — e che i tuoi dati siano sempre puliti, strutturati e pronti all’azione.

FAQ

1. Cos’è BeautifulSoup e a cosa serve?

BeautifulSoup è una libreria Python per analizzare documenti HTML e XML. Ti aiuta a estrarre dati dalle pagine web e a trasformarli in formati strutturati come elenchi o tabelle, rendendola ideale per progetti di web scraping.

2. Come si confronta BeautifulSoup con Selenium e Scrapy?

BeautifulSoup è leggero e facile da usare per pagine HTML statiche. Selenium è più adatto allo scraping di siti dinamici e ricchi di JavaScript, mentre Scrapy è un framework completo per scraping asincrono su larga scala. BeautifulSoup è la scelta migliore per principianti e attività rapide.

3. Posso usare insieme BeautifulSoup e Thunderbit?

Assolutamente sì. Thunderbit può identificare ed estrarre rapidamente i campi dalle pagine web usando l’IA, e puoi usare BeautifulSoup per il post-processing personalizzato o per un’analisi più approfondita dei dati esportati.

4. Quali sono le sfide più comuni nello web scraping con BeautifulSoup?

I problemi più comuni includono la gestione dei contenuti dinamici, la presenza di misure anti-bot e l’adattamento ai cambiamenti nella struttura HTML. Le funzionalità IA di Thunderbit o la modalità browser possono aiutarti a superare molte di queste difficoltà.

5. Come esportare in Excel o CSV i dati estratti con BeautifulSoup?

Puoi usare il modulo csv integrato di Python oppure la libreria pandas per salvare i dati estratti in file CSV o Excel. Usa sempre la codifica UTF-8 per gestire i caratteri speciali e garantire la compatibilità con gli strumenti di foglio di calcolo.

Pronto a provarlo tu stesso? Scarica e inizia subito a fare scraping in modo più intelligente. Per altri tutorial e consigli, visita il .

Scopri di più