Il mondo degli assistenti AI e dei framework agentici corre a una velocità impressionante, ma una cosa non è cambiata: tutti vogliono soluzioni più veloci, più leggere e più semplici da installare. L’ho visto in prima persona: che tu sia uno sviluppatore indipendente che smanetta su un Raspberry Pi o un responsabile IT che cerca di tenere sotto controllo i costi del cloud, la richiesta di soluzioni con “installazione minimale” è ovunque. Ultimamente mi arrivano più domande sulle alternative leggere a OpenClaw di quante riesca a contarne. Le persone vogliono sapere: esiste un modo per avere la potenza di OpenClaw senza un’installazione pesante, senza overhead di memoria e senza grattacapi operativi?

Se stai cercando un’alternativa leggera a OpenClaw o ti interessano soluzioni con ingombro minimo, sei in buona compagnia. In questa guida spiegherò cosa significa davvero “installazione minimale di OpenClaw”, perché conta e come valutare le migliori opzioni leggere per le tue esigenze — che tu stia lavorando su hardware datato, distribuendo su larga scala o semplicemente voglia evitare un altro “minestrone di dipendenze” sul tuo server.

Cos’è un’alternativa leggera a OpenClaw?

Partiamo dalle basi: cosa intendiamo con “alternativa leggera a OpenClaw”?

OpenClaw è un gateway self-hosted e un layer di orchestrazione per assistenti agentici. In parole semplici, è una piattaforma che collega le interfacce di chat (web, desktop o app di messaggistica) ai modelli AI e agli strumenti, gestendo aspetti come memoria, stato ed esecuzione sicura (). Ma c’è un problema: l’installazione standard di OpenClaw si basa su Docker, con più servizi e un minimo consigliato di 2 GB di RAM solo per il gateway — prima ancora di avviare grandi modelli linguistici.

Per alternativa leggera si intende qualsiasi strumento, framework o piattaforma che offra capacità simili da “assistant” o “agent” a quelle di OpenClaw, ma con dimensioni di installazione ridotte, minore uso di memoria/CPU e una configurazione più semplice. Pensa a distribuzioni in un singolo container, dipendenze minime e alla possibilità di funzionare su hardware modesto o in ambienti con risorse limitate.

Le differenze principali tra le installazioni standard di OpenClaw e le alternative leggere/minimali di solito riguardano:

- Complessità di installazione: le opzioni leggere spesso usano un singolo container Docker o persino un semplice binario, mentre la configurazione predefinita di OpenClaw può richiedere più container e volumi persistenti.

- Impronta delle risorse: le alternative minime sono progettate per usare meno RAM, CPU e spazio disco — a volte bastano 1–2 GB di RAM per l’intero stack.

- Ambito funzionale: potresti rinunciare ad alcune funzionalità avanzate di gateway o sandboxing in cambio di un’installazione più snella e facile da gestire.

In breve, un’alternativa leggera a OpenClaw serve a ottenere i vantaggi principali — chat AI, integrazione degli strumenti, memoria — senza il superfluo.

Perché gli utenti cercano soluzioni OpenClaw con ingombro minimo

Perché tutti sono improvvisamente ossessionati da installazioni minime e framework leggeri? Dalle mie conversazioni con utenti e team IT, i motivi sono abbastanza universali:

- Setup e onboarding più rapidi: nessuno vuole passare ore a gestire file Docker Compose o a risolvere conflitti tra dipendenze. Un’installazione minimale ti mette operativa in pochi minuti, non in ore.

- Minore consumo di risorse: che tu stia distribuendo su una VM cloud, su un Raspberry Pi o su un vecchio laptop, ogni gigabyte di RAM e ogni ciclo CPU conta. Un ingombro ridotto ti consente di eseguire più istanze, risparmiare sulle bollette del cloud o semplicemente evitare rallentamenti.

- Manutenzione più semplice: meno componenti significa meno cose che possono rompersi. Le alternative leggere sono spesso più facili da aggiornare, salvare e mettere in sicurezza.

- Adatte a scenari edge e offline: se devi eseguire un assistente on-premise, in laboratorio o in un ambiente sensibile alla privacy, le installazioni minime sono una vera salvezza.

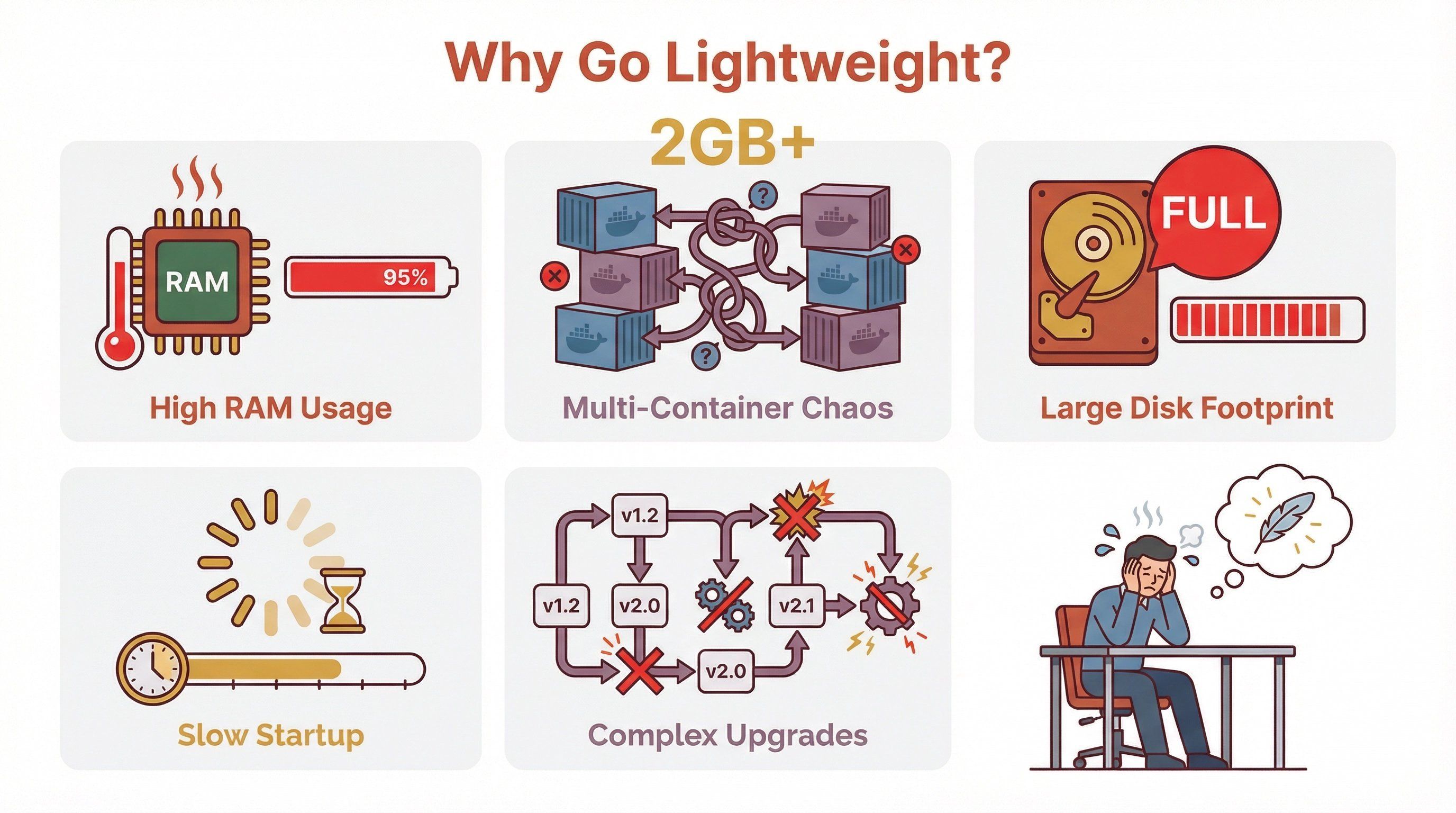

| Problema | Perché conta |

|---|---|

| Elevati requisiti di RAM/CPU | Limita la distribuzione su hardware più vecchio o più piccolo |

| Configurazione multi-container | Aumenta la complessità, con più cose da mantenere e proteggere |

| Grande ingombro su disco | Problematico per dispositivi edge o spazio di archiviazione limitato |

| Avvio lento | Frustrante per prototipazione rapida o scalabilità |

| Upgrade complessi | Più componenti = più grattacapi negli aggiornamenti |

Se hai mai provato a far girare OpenClaw su una VM cloud da 2 GB e l’hai vista arrancare, sai esattamente di cosa sto parlando.

Come l’installazione minimale di OpenClaw influisce sulle prestazioni del sistema

Facciamo un po’ di tecnica. La dimensione e la complessità della tua piattaforma assistant hanno un impatto diretto su prestazioni, stabilità e scalabilità del sistema.

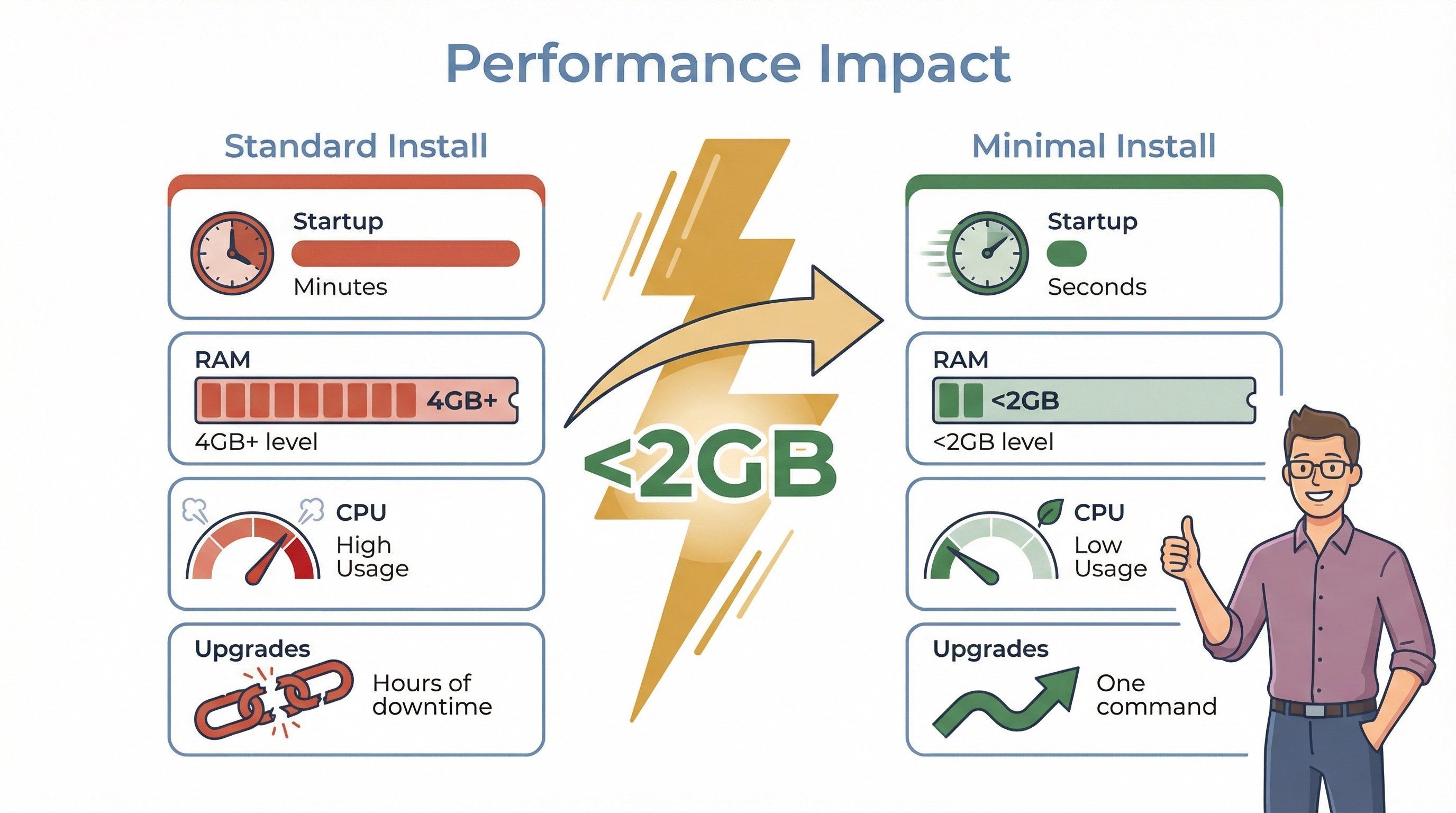

Le installazioni standard di OpenClaw (con Docker, memory store e sandboxing) possono facilmente consumare oltre 2 GB di RAM solo per la piattaforma, prima ancora di caricare un modello linguistico o un database vettoriale (). Aggiungi inferenza LLM locale o ingestione di documenti, e ti ritrovi a 4 GB, 8 GB o più.

Le alternative con installazione minimale sono progettate per:

- Avviarsi più velocemente: le installazioni in un solo container o in un binario possono essere pronte in pochi secondi, non in minuti.

- Usare meno memoria: delegando l’inferenza LLM a API esterne o usando modelli locali più piccoli, puoi mantenere l’uso di RAM sotto i 2 GB per l’intero stack ().

- Ridurre il carico CPU: meno overhead di orchestrazione significa più risorse per le attività AI vere e proprie.

- Abbassare il rischio di conflitti: meno servizi = meno collisioni di porte, incongruenze di dipendenze o sorprese negli upgrade.

Ecco un esempio reale: raccomanda un minimo di 2 GB di RAM (4 GB consigliati), mentre suggerisce almeno 4 GB. Al contrario, può funzionare in modalità utente singolo con un solo container e un’impronta di memoria molto più ridotta, soprattutto se usi API LLM remote.

Miglioramenti prestazionali che potresti notare:

- Tempi di avvio ridotti da minuti a secondi

- Uso della RAM ridotto del 50% o più

- Minore utilizzo della CPU durante i periodi di inattività

- Upgrade più rapidi e meno downtime

Criteri chiave per scegliere un’alternativa leggera a OpenClaw

Non tutte le alternative “leggere” sono uguali. Ecco cosa consiglio di valutare quando confronti le opzioni:

- Dimensione dell’installazione: quanto pesa il download? Puoi distribuire con un singolo container Docker o un binario?

- Uso di memoria: qual è il consumo base di RAM della piattaforma, inferenza LLM esclusa?

- Velocità di avvio: quanto tempo serve per passare da “docker run” a un assistente funzionante?

- Facilità di aggiornamento: il processo di upgrade è semplice, o finirai a inseguire draghi di dipendenze ogni mese?

- Compatibilità: supporta gli LLM, gli strumenti e le integrazioni di cui hai bisogno?

- Set di funzionalità: ottieni le funzioni assistant essenziali che ti servono, o sacrifichi troppo in nome della leggerezza?

- Sicurezza e isolamento: la piattaforma offre sandboxing o isolamento per l’esecuzione degli strumenti?

Ecco una checklist rapida che puoi usare:

| Criterio | Perché conta | Cosa cercare |

|---|---|---|

| Dimensione installazione | Distribuzione rapida, meno spazio richiesto | Immagine <500 MB, binario singolo |

| Uso di memoria | Funziona su hardware più piccolo, costo cloud più basso | Baseline <2 GB di RAM |

| Velocità di avvio | Prototipazione rapida, meno downtime | Pronto in <30 secondi |

| Aggiornamenti | Meno manutenzione, meno sorprese | Upgrade con un comando, API stabile |

| Compatibilità | Evita il lock-in del vendor, tutela il futuro | API OpenAI/Ollama, modello plugin |

| Funzionalità | Non perdere le funzioni indispensabili per troppa essenzialità | Memoria, strumenti, auth, RAG |

| Sicurezza | Esecuzione sicura degli strumenti, meno rischi | Isolamento del container o del processo |

Il trucco è trovare il giusto equilibrio tra impronta minima e funzionalità davvero necessarie. A volte “meno è meglio”, ma altre volte “meno” significa “non abbastanza”.

Alternative popolari a OpenClaw con ingombro minimo per un’installazione minimale

Sulla base dei recenti roundup di settore e della mia ricerca, ecco alcune delle migliori alternative leggere a OpenClaw per diversi scenari:

1.

- Ideale per: installazioni per singolo utente con risorse minime

- Perché è leggero: un singolo container Docker, modalità utente singolo opzionale, volume persistente per i dati, possibilità di usare API LLM remote per consumare pochissima RAM/CPU

- Punti di forza unici: utilizzabile anche offline, supporta Ollama ed endpoint compatibili con OpenAI, community attiva ()

- Compromessi: non replica nativamente il modello gateway/multi-surface di OpenClaw; l’isolamento degli strumenti è basilare

2.

- Ideale per: team multiutente che vogliono un’esperienza familiare tipo “clone di ChatGPT”

- Perché è leggero: distribuzione Docker, requisiti minimi dichiarati (2 GB di RAM), può essere eseguito come singolo servizio per piccoli team

- Punti di forza unici: autenticazione multiutente sicura, ampio supporto ai provider, recente rafforzamento della sicurezza ()

- Compromessi: più centrato sull’app web; non è un gateway per molte superfici di chat; alcune funzioni richiedono servizi aggiuntivi

3.

- Ideale per: workspace AI privato all-in-one con configurazione minima

- Perché è leggero: installazione Docker o desktop, database vettoriale integrato, può funzionare con 2 GB di RAM per l’uso di base

- Punti di forza unici: supporto multiutente, agenti, pipeline documentali, approccio privacy-first ()

- Compromessi: non è un gateway per interfacce di chat; l’isolamento degli strumenti dipende dalla tua architettura

4.

- Ideale per: Q&A privato sui documenti e app consapevoli del contesto

- Perché è leggero: profili Docker Compose, può funzionare con risorse moderate se si usano API LLM esterne

- Punti di forza unici: compatibilità con l’API OpenAI, forte attenzione alla privacy, opzioni flessibili per lo storage vettoriale ()

- Compromessi: non è un sostituto diretto del gateway di messaggistica di OpenClaw

5.

- Ideale per: builder visivo di workflow/agent con installazione minimale

- Perché è leggero: installazione via NPM o Docker, SQLite di default, può funzionare come singolo servizio

- Punti di forza unici: canvas visuale per i workflow, ecosistema di plugin, test locale semplice ()

- Compromessi: non è un assistente già pronto; dovrai costruire i tuoi connettori

Confronto tra alternative a OpenClaw con ingombro minimo: tabella delle funzionalità

Mettiamo queste opzioni fianco a fianco per un confronto rapido:

| Piattaforma | Percorso di installazione | RAM minima (piattaforma) | Velocità di avvio | Multiutente | Supporto backend LLM | Modello strumenti/plugin | Sicurezza/isolamento | Ideale per |

|---|---|---|---|---|---|---|---|---|

| Open WebUI | Docker (singolo) | Bassa–Media | Rapido | Opzionale | Ollama, compatibile con OpenAI | Strumenti Python | Base | Utente singolo, minimale |

| LibreChat | Docker (multi) | 2 GB min (4 GB raccom.) | Rapido | Sì | Molti provider | Agenti, plugin | Multi-servizio | Team, centrato sulla chat |

| AnythingLLM | Docker/Desktop | 2 GB+ | Rapido | Sì | Locale + hosted | Agenti, API | Database vettoriale integrato | Privato, all-in-one |

| PrivateGPT | Docker Compose | Media | Rapido | Opzionale | Locale + hosted | API RAG | Isolamento API | Q&A privato sui documenti |

| Flowise | NPM/Docker | Bassa–Media | Rapido | Opzionale | Nodi provider | Builder visuale | SQLite/DB | Builder visuale di workflow |

Nota: l’uso di RAM può aumentare se esegui LLM locali o ingerisci documenti di grandi dimensioni. Per installazioni davvero minime, usa API LLM remote o modelli piccoli.

Passi pratici per valutare e testare soluzioni con installazione minimale di OpenClaw

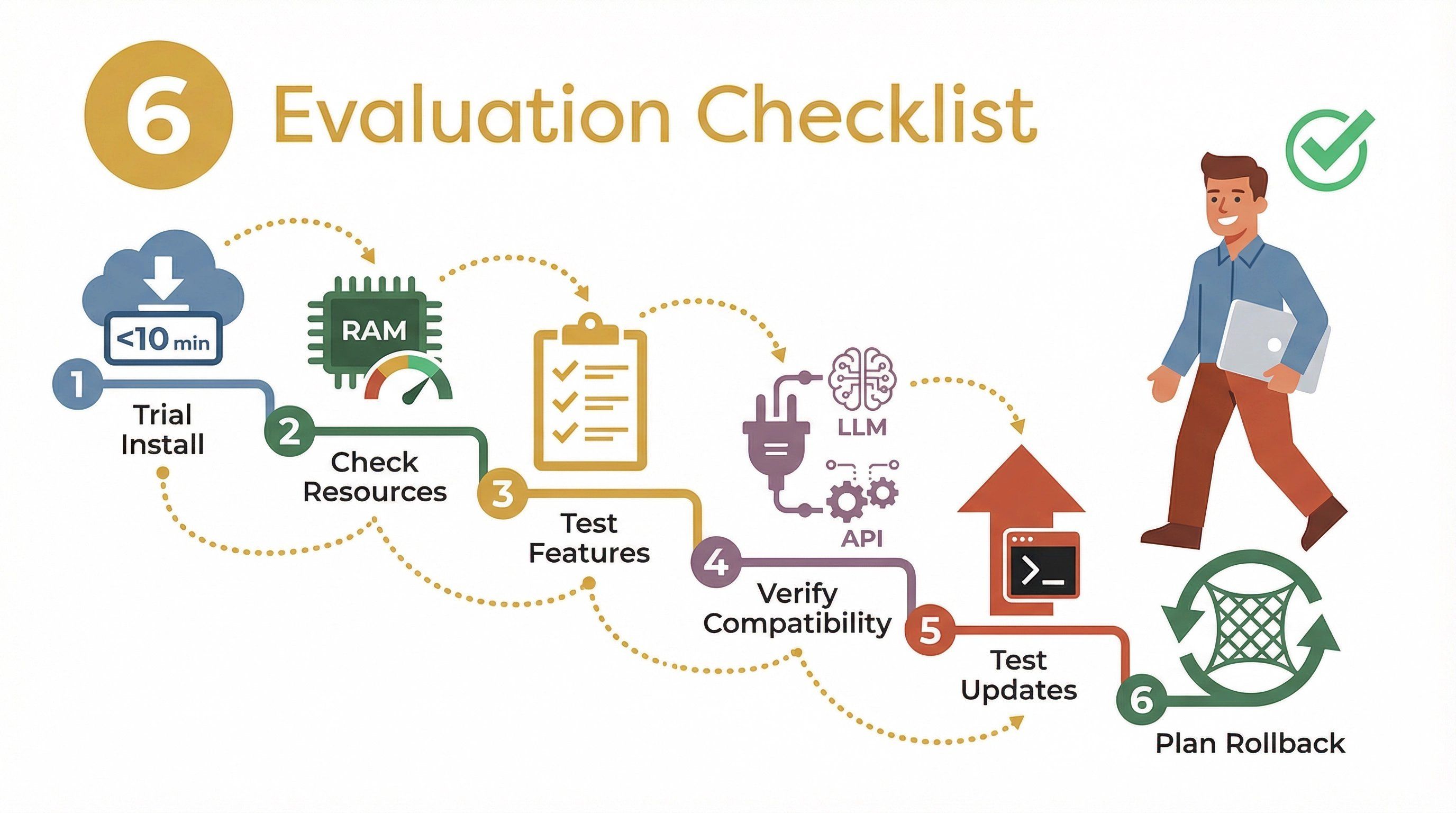

Pronto a provare un’alternativa leggera? Ecco il framework di valutazione semplice che uso io:

- Installazione di prova: distribuisci la piattaforma in una sandbox o in una VM di test. Misura il tempo di installazione e di avvio.

- Misura l’uso delle risorse: usa strumenti di sistema (come

htopodocker stats) per monitorare RAM e CPU durante l’uso inattivo e quello base. - Esegui i workflow di base: prova le funzioni principali — chat, esecuzione di strumenti/plugin, ingestione documentale, ecc.

- Verifica la compatibilità: collega gli LLM, i plugin o le API esterne che preferisci.

- Testa gli aggiornamenti: prova ad aggiornare la piattaforma per vedere quanto è fluido il processo.

- Test in sandbox: se possibile, esegui tutto in un ambiente usa-e-getta, così puoi tornare indietro facilmente se qualcosa va storto.

Ecco una checklist veloce:

| Passo | Cosa cercare |

|---|---|

| Installazione/Avvio | <10 minuti, nessuna dipendenza complessa |

| Uso delle risorse | <2 GB di RAM baseline, CPU bassa da inattivo |

| Test funzionale | Le funzioni core dell’assistente funzionano come previsto |

| Compatibilità | Si collega ai tuoi LLM e strumenti |

| Processo di aggiornamento | Upgrade con un comando o in-place |

| Ripristino | Facile tornare alla versione precedente |

Errori comuni quando si passa a alternative leggere a OpenClaw

Passare a un’installazione minimale non è sempre una passeggiata. Ecco alcune insidie comuni e come evitarle:

- Funzioni mancanti: alcune piattaforme leggere rinunciano a gateway avanzati o al sandboxing. Assicurati di non perdere qualcosa di critico per il tuo flusso di lavoro.

- Documentazione limitata: i progetti più piccoli possono avere documentazione scarna. Controlla i forum della community o le issue su GitHub per supporto.

- Problemi di integrazione: non tutti i plugin o gli strumenti sono supportati subito. Testa presto le integrazioni indispensabili.

- Compromessi sulla sicurezza: installazioni più semplici a volte significano meno isolamento o impostazioni di sicurezza meno rigide. Rafforza il deployment (autenticazione, TLS, firewall).

- Difficoltà di migrazione: spostare dati come cronologia chat o documenti da OpenClaw a una nuova piattaforma può essere complicato. Pianifica una finestra di migrazione e fai backup di tutto.

Il mio consiglio? Parti con un progetto pilota, testa a fondo e tieni in esecuzione la vecchia configurazione finché non sei davvero sicuro della nuova.

Conclusione: scegliere la soluzione giusta per le tue esigenze di installazione minimale

La crescita delle alternative leggere a OpenClaw è una risposta diretta ai problemi reali creati da installazioni pesanti e complesse. Che tu sia uno sviluppatore singolo, un piccolo team o un responsabile IT aziendale, esiste un’opzione con installazione minimale che può darti le funzioni assistant di cui hai bisogno — senza il superfluo.

Ecco cosa ti consiglierei:

- Definisci gli indispensabili: capisci quali funzionalità non puoi proprio sacrificare (multiutente, supporto plugin, sicurezza).

- Usa i criteri e le tabelle di confronto qui sopra per selezionare le alternative più adatte.

- Sperimenta e misura: testa nel tuo ambiente, misura l’uso delle risorse e verifica la compatibilità.

- Pianifica la migrazione: non avere fretta — sposta dati e workflow gradualmente.

E ricorda: la migliore installazione minimale di OpenClaw è quella che si adatta al tuo caso d’uso, al tuo hardware e alle competenze del tuo team. Leggero non deve significare limitato — solo più focalizzato.

Se ti interessa automatizzare l’estrazione di dati web come parte del tuo workflow da assistant, dai un’occhiata a , il nostro web scraper con AI pensato per una configurazione minimale e la massima produttività. E per altri approfondimenti su automazione, scraping e strumenti AI, passa dal .

FAQ

1. Cos’è un’alternativa leggera a OpenClaw?

Un’alternativa leggera a OpenClaw è uno strumento o framework che offre capacità simili da assistente AI a quelle di OpenClaw, ma con un’installazione più piccola, un uso minore di memoria/CPU e una configurazione più semplice — ideale per scenari di installazione minimale o ambienti con risorse limitate.

2. Perché dovrei interessarmi alle soluzioni OpenClaw con ingombro minimo?

Le soluzioni con ingombro minimo si configurano più velocemente, usano meno RAM/CPU, sono più facili da mantenere e possono funzionare su hardware datato o in ambienti edge/offline — perfette per prototipazione rapida o distribuzioni sensibili ai costi.

3. Quali sono i principali compromessi delle alternative leggere?

Potresti perdere alcune funzionalità avanzate (come gateway multi-surface o esecuzione sandboxed degli strumenti) e dover aggiungere componenti extra per raggiungere una parità completa con OpenClaw. Verifica sempre che le funzioni indispensabili siano supportate.

4. Come posso valutare se un’alternativa leggera è adatta a me?

Prova il processo di installazione, misura l’uso delle risorse, esegui i workflow principali, verifica la compatibilità con gli LLM e gli strumenti che preferisci e assicurati che la piattaforma soddisfi i requisiti di sicurezza e aggiornamento.

5. Quali sono le alternative leggere a OpenClaw più popolari?

Tra le opzioni più valide ci sono , , , e . Ognuna ha punti di forza diversi per esigenze diverse di installazione minimale.

Se sei pronto ad alleggerire il tuo stack e a recuperare RAM, prova una di queste soluzioni con installazione minimale. E se vuoi automatizzare l’estrazione di dati web senza grattacapi di configurazione, è sempre qui per aiutarti.

Scopri di più