Il web trabocca di dati e, se ti occupi di business, tecnologia o sei semplicemente curioso, ti sarà probabilmente capitato di desiderare di poter raccogliere informazioni da un sito web in blocco, senza passare tutto il pomeriggio a copiare e incollare. Ecco il punto: entro il 2025, quasi la metà di tutto il traffico internet sarà composta da bot che esplorano e acquisiscono dati dal web, e oltre il 70% delle aziende digitali si affida ai dati web pubblici per l’intelligence di mercato e le operazioni (). Ma, mentre il bisogno di dati web è esploso, il processo per estrarli può essere, beh, un po’ una seccatura — soprattutto con i siti web di oggi, dinamici e alimentati da JavaScript.

Ed è qui che entra in gioco JavaScript. Essendo il linguaggio del web, JavaScript è particolarmente adatto a gestire pagine dinamiche e interattive che mettono in difficoltà i vecchi scraper. Che tu sia uno sviluppatore che vuole automatizzare una ricerca, un professionista commerciale che costruisce liste di lead o semplicemente qualcuno a cui piace smanettare, questa guida ti accompagnerà attraverso tutto ciò che serve per creare un Estrattore Web JavaScript — dalle basi alle tecniche avanzate, fino a come evitare del tutto il codice con strumenti AI come .

Basi dell’Estrattore JavaScript: che cos’è il web scraping con JavaScript?

Partiamo dalle basi. Il web scraping è il processo di estrazione automatica di informazioni dai siti web. Immagina di avere un assistente velocissimo che può visitare centinaia di pagine, copiare i dati che ti servono e organizzarli in un foglio di calcolo ordinato — senza mai lamentarsi del tunnel carpale.

Un Estrattore Web JavaScript è semplicemente un estrattore web costruito con JavaScript. Puoi eseguire estrattori JavaScript in due modi principali:

- Nel browser: eseguendo script direttamente nella console del browser o usando estensioni del browser per raccogliere dati dalla pagina che stai visualizzando.

- Lato server (Node.js): usando JavaScript al di fuori del browser (grazie a Node.js) per recuperare pagine web, analizzarne il contenuto ed estrarre i dati in modo programmatico.

Perché è importante per chi lavora in azienda? Perché il web scraping alimenta tutto, dalla generazione di lead (estrazione di contatti da elenchi e directory) al monitoraggio dei prezzi (tenere d’occhio i concorrenti), fino alla ricerca di mercato (raccogliere recensioni, notizie o trend). In effetti, il 48% degli utenti di web scraping opera nell’e-commerce (). Se riesci a vederlo nel browser, molto probabilmente un estrattore JavaScript può raccoglierlo per te.

Perché fare web scraping con JavaScript? I vantaggi chiave per i siti moderni

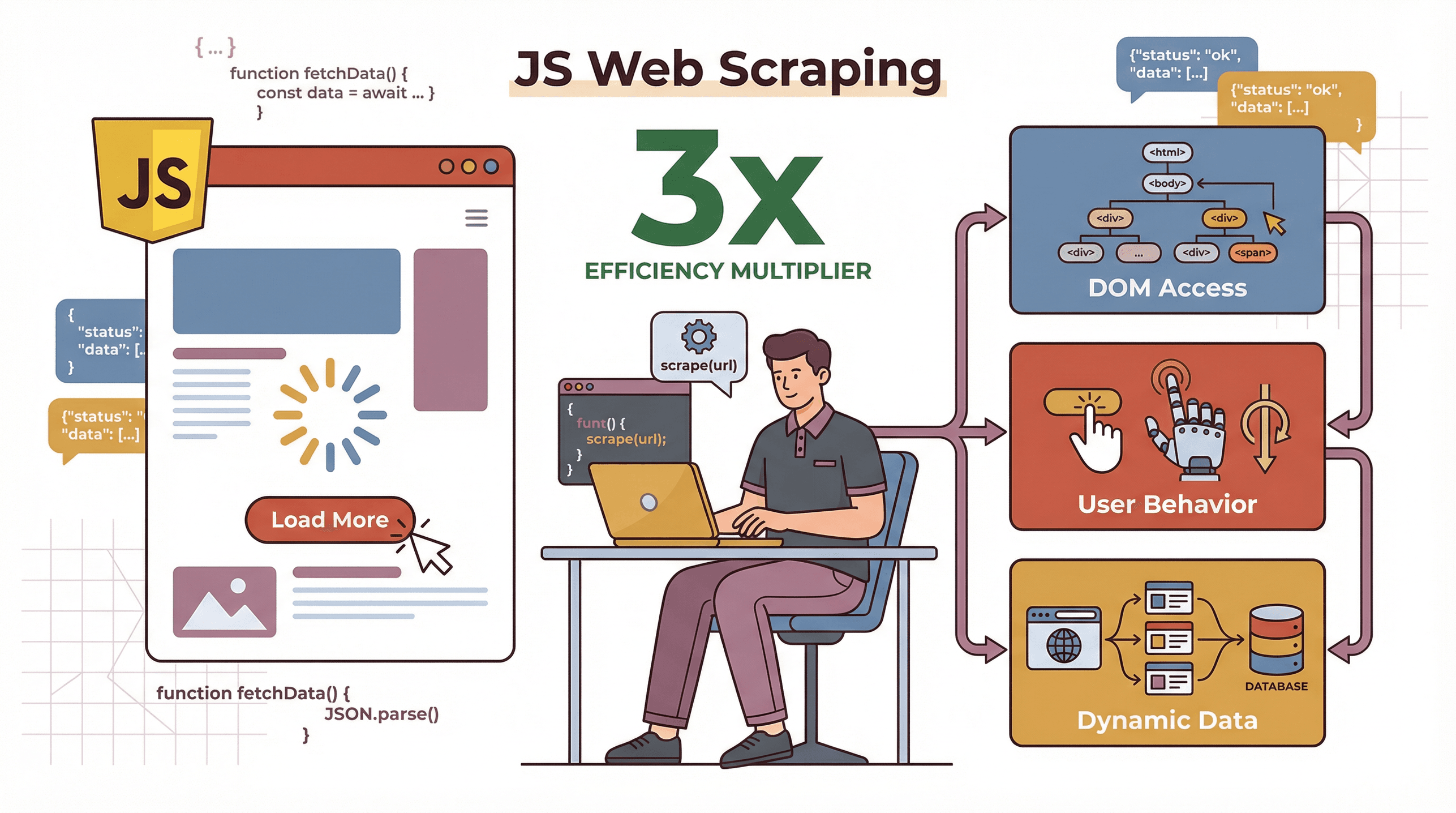

Quindi, perché usare JavaScript per lo scraping, soprattutto quando sembra che in ambito data science tutti parlino di Python? Ecco il segreto: i siti web moderni sono alimentati da JavaScript. Caricano i contenuti in modo dinamico, recuperano i dati dopo il caricamento della pagina e spesso richiedono interazioni dell’utente, come fare clic su “Carica altro” o scorrere la pagina. Gli estrattori JavaScript possono:

Quindi, perché usare JavaScript per lo scraping, soprattutto quando sembra che in ambito data science tutti parlino di Python? Ecco il segreto: i siti web moderni sono alimentati da JavaScript. Caricano i contenuti in modo dinamico, recuperano i dati dopo il caricamento della pagina e spesso richiedono interazioni dell’utente, come fare clic su “Carica altro” o scorrere la pagina. Gli estrattori JavaScript possono:

- Gestire contenuti dinamici: dato che JavaScript è il linguaggio in esecuzione nel browser, può vedere e interagire con contenuti che compaiono solo dopo l’esecuzione degli script.

- Imitare il comportamento di un utente reale: strumenti come Puppeteer consentono di automatizzare clic, scorrimenti e persino accessi, proprio come farebbe una persona.

- Lavorare in modo nativo con il DOM: JavaScript può accedere direttamente alla struttura della pagina e manipolarla, rendendo più facile estrarre esattamente ciò che serve.

Come se la cava JavaScript rispetto ad altri linguaggi? Ecco un confronto rapido:

| Fattore | JavaScript (Node.js) | Python | PHP |

|---|---|---|---|

| Contenuti dinamici | Ottimo: gira in modo nativo nel browser, perfetto per siti ricchi di JS | Richiede strumenti aggiuntivi (Selenium/Playwright) | Limitato |

| Velocità/Concorrenza | Elevata: modello async, recupera molte pagine in parallelo | Buona, ma serve asyncio/Scrapy per la concorrenza | Più lento, meno comune |

| Facilità d’uso | Media: i web developer si sentono a casa, l’async può confondere i principianti | Più facile per chi inizia, tante guide | Base, meno flessibile |

| Automazione browser | Di primo livello (Puppeteer, Playwright) | Buona (Selenium, Playwright) | Rara |

| Ideale per | Siti dinamici, interattivi o SPA; flussi di lavoro da web developer | Analisi dati, siti statici, script rapidi | Siti statici semplici |

Se il sito di destinazione è una single-page app oppure carica i dati durante lo scroll o al clic, JavaScript è spesso lo strumento migliore per il lavoro ().

Configurare il tuo primo Estrattore JavaScript: strumenti e ambiente

Pronto a sporcarti le mani? Ecco come configurare un ambiente base per lo scraping in JavaScript — senza bisogno di framework.

-

Installa Node.js

Scarica e installa Node.js da . Ti permette di eseguire JavaScript fuori dal browser. -

Inizializza un progetto

Apri il terminale ed esegui:1mkdir my-scraper 2cd my-scraper 3npm init -y -

Installa le librerie essenziali

Ti serviranno:- o

node-fetchper le richieste HTTP - per analizzare l’HTML (pensa a jQuery per il server)

1npm install axios cheerio - o

-

Ispeziona il sito di destinazione

Apri Chrome DevTools (clic destro > Ispeziona) e cerca gli elementi HTML che contengono i tuoi dati. Annotane classi, ID o tag.

Ecco uno script iniziale molto semplice:

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapePage(url) {

4 try {

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const pageTitle = $('head > title').text();

8 console.log("Titolo della pagina:", pageTitle);

9 } catch (err) {

10 console.error("Scraping fallito:", err);

11 }

12}

13scrapePage('https://example.com');Eseguilo con node scrape.js e vedrai il titolo della pagina stampato a schermo. Niente male per poche righe di codice!

Costruire un Estrattore Web JavaScript di base: guida passo per passo

Costruiamo qualcosa di più utile. Supponiamo che tu voglia estrarre titoli e prezzi dei libri da , un classico sito di pratica.

Passo 1: ispeziona la pagina

Ogni libro si trova dentro un <article class="product_pod">. Il titolo è in <h3><a title="Titolo del libro"></a></h3>, mentre il prezzo è in <p class="price_color">.

Passo 2: scrivi l’estrattore

1const axios = require('axios');

2const cheerio = require('cheerio');

3async function scrapeBooks() {

4 const url = 'http://books.toscrape.com/';

5 const { data: html } = await axios.get(url);

6 const $ = cheerio.load(html);

7 const books = [];

8 $('article.product_pod').each((i, elem) => {

9 const title = $(elem).find('h3 a').attr('title');

10 const price = $(elem).find('.price_color').text();

11 books.push({ title, price });

12 });

13 console.log(books);

14}

15scrapeBooks();Questo script recupera la pagina, analizza l’HTML, scorre ogni libro ed estrae titolo e prezzo. Il risultato? Un array ordinato di oggetti libro:

1[

2 { "title": "A Light in the Attic", "price": "£51.77" },

3 { "title": "Tipping the Velvet", "price": "£53.74" }

4]Passo 3: estendi alla paginazione

Vuoi estrarre più pagine? Cerca il लिंक “Next” e scorri le pagine aggiornando l’URL ogni volta. Con un po’ di codice in più, puoi estrarre l’intero sito.

Andare oltre: gestire contenuti dinamici e interazioni utente con JavaScript

E adesso la parte divertente — e a volte frustrante: i contenuti dinamici. Molti siti moderni non mostrano tutti i dati nell’HTML iniziale. Invece, li caricano con JavaScript dopo il caricamento della pagina oppure richiedono clic o scroll per mostrare altro.

Cheerio e Axios non vedranno questi contenuti: si limitano a ottenere l’HTML grezzo. Per estrarre siti dinamici, ti serve un browser headless come .

Usare Puppeteer per un web crawling JavaScript avanzato

Puppeteer ti permette di controllare Chrome (o Chromium) con il codice. Puoi:

- Aprire pagine

- Aspettare il caricamento degli elementi

- Fare clic su pulsanti, compilare moduli, scorrere

- Estrarre contenuti dopo che tutti gli script sono stati eseguiti

Ecco un semplice script con Puppeteer:

1const puppeteer = require('puppeteer');

2(async () => {

3 const browser = await puppeteer.launch();

4 const page = await browser.newPage();

5 await page.goto('https://example.com', { waitUntil: 'networkidle0' });

6 await page.waitForSelector('.dynamic-content');

7 const data = await page.evaluate(() => {

8 return Array.from(document.querySelectorAll('.dynamic-content'))

9 .map(el => el.textContent.trim());

10 });

11 console.log(data);

12 await browser.close();

13})();Puoi persino automatizzare gli accessi, fare clic su pulsanti “Carica altro” o gestire lo scroll infinito scorrendo la pagina in modo programmatico e aspettando che compaiano nuovi contenuti ().

Thunderbit: semplificare e potenziare lo scraping JavaScript

Diciamolo chiaramente: scrivere scraper da zero è potente, ma richiede tempo, competenze tecniche e manutenzione continua. Ecco perché sono così fan di , la nostra estensione Chrome basata su AI che trasforma lo scraping web in un’operazione da due clic.

Thunderbit è pensato per chi lavora in azienda: non serve programmare. Ecco come funziona:

- AI Suggest Fields: fai clic su un pulsante e l’AI di Thunderbit analizza la pagina, suggerendo le colonne migliori da estrarre (come “Nome prodotto”, “Prezzo”, “Email” e così via).

- Scraping in 2 clic: controlla i campi suggeriti, fai clic su “Scrape” e Thunderbit raccoglie tutti i dati, gestendo automaticamente paginazione e sottopagine.

- Gestione di sottopagine e paginazione: ti servono più dettagli? Thunderbit può seguire i link alle sottopagine (come dettagli prodotto o profili) e unire quei dati nella tua tabella.

- Modalità cloud o browser: esegui lo scraping nel browser (perfetto per le pagine con accesso effettuato) oppure usa il cloud di Thunderbit per ottenere più velocità (fino a 50 pagine alla volta).

- Esportazione gratuita e strutturata: esporta i dati in Excel, Google Sheets, Airtable, Notion, CSV o JSON — sempre gratis, indipendentemente da quanto estrai.

Thunderbit in azione: dall’estrazione dei dati all’esportazione

Immagina di voler estrarre informazioni di contatto da una directory aziendale:

- Installa Thunderbit ().

- Apri la pagina della directory.

- Fai clic su “AI Suggest Fields”. L’AI di Thunderbit suggerisce colonne come “Nome”, “Telefono”, “Azienda”.

- Fai clic su “Scrape”. Thunderbit raccoglie tutti i dati, anche su più pagine.

- Esporta in Sheets o Excel. Fatto.

Quello che prima richiedeva ore — o l’intervento di uno sviluppatore — ora richiede minuti. E, dato che Thunderbit usa l’AI, è resistente ai cambiamenti di layout dei siti: niente più script rotti ogni volta che un sito si aggiorna ().

Ecco come si confronta il web scraping JavaScript tradizionale con Thunderbit:

| Criterio | Scraper JS manuale | JS avanzato (Puppeteer) | Thunderbit AI Scraper |

|---|---|---|---|

| Competenze richieste | Programmazione | Programmazione avanzata | Nessuna (punta e clicca) |

| Contenuti dinamici | Limitati | Eccellenti | Integrati |

| Tempo di configurazione | Ore per sito | Da ore a giorni | Da secondi a minuti |

| Manutenzione | Alta | Alta | Bassa (l’AI si adatta) |

| Opzioni di esportazione | Codice personalizzato | Codice personalizzato | 1 clic verso Excel/Sheets ecc. |

| Costo | Gratis (ma richiede tempo) | Gratis (hardware, tempo) | Piano gratuito, poi da $15/mese |

Tecniche avanzate: web scraping complesso con librerie JavaScript

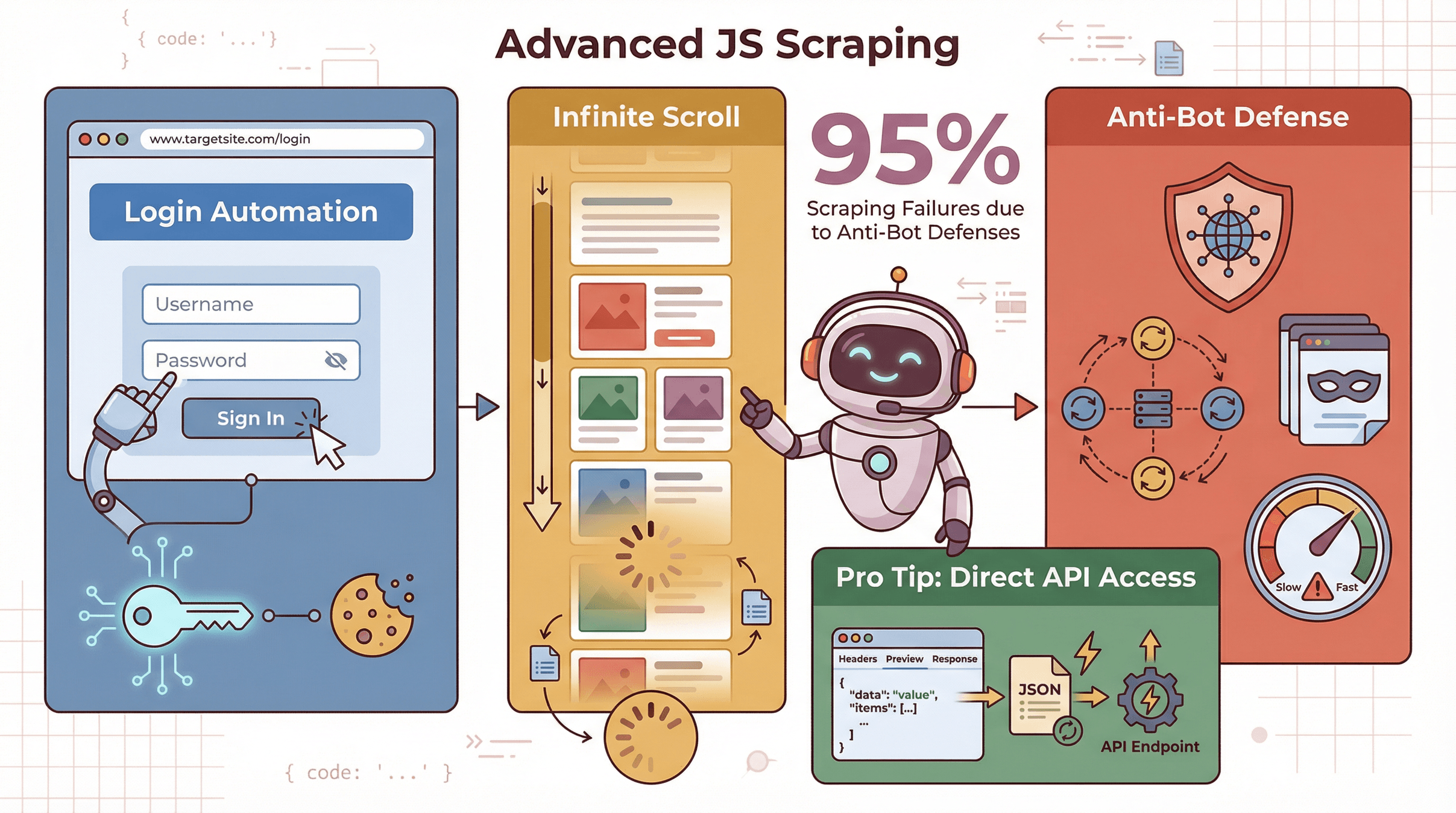

A volte devi andare oltre — estrarre dati dietro login, gestire lo scroll infinito o aggirare difese anti-scraping.

A volte devi andare oltre — estrarre dati dietro login, gestire lo scroll infinito o aggirare difese anti-scraping.

- Login/Sessioni: con Puppeteer puoi automatizzare l’accesso compilando moduli e facendo clic sui pulsanti, poi estrarre i dati come utente autenticato.

- Scroll infinito: scorri programmaticamente la pagina, attendi nuovi contenuti e ripeti finché tutti i dati non sono caricati ().

- Misure anti-scraping: usa proxy, ruota gli user agent e limita la frequenza delle richieste per evitare blocchi. Oltre il 95% dei fallimenti nello scraping è dovuto a difese anti-bot ().

Consiglio pro: a volte puoi saltare del tutto il browser trovando gli endpoint API nascosti del sito (controlla la scheda Network in DevTools). Se riesci a recuperare direttamente i dati JSON, il tuo scraper sarà molto più veloce.

Ottimizzare e mantenere il tuo Web Crawler JavaScript

Costruire uno scraper è solo metà del lavoro: l’altra metà è mantenerlo funzionante senza intoppi.

- Elaborazione asincrona: usa async/await e recupera le pagine in parallelo, ma senza sovraccaricare il server.

- Elaborazione a blocchi: processa i dati in chunk per evitare problemi di memoria.

- Gestione degli errori: intercetta gli errori, ritenta le richieste fallite e registra i problemi per il debug.

- Paginazione: rileva i link o i pulsanti “Next” e scorri le pagine.

- Resilienza dei selettori: usa ID o classi univoci; evita selettori fragili che si rompono se cambia il layout del sito.

- Monitoraggio: configura avvisi se il tuo scraper inizia a restituire dati vuoti o errori.

Buona pratica: lo scraping non è mai “imposta e dimentica”. Pianifica aggiornamenti e monitoraggio regolari ().

Confronto tra soluzioni di scraping JavaScript: tradizionale vs. Thunderbit

Ecco un confronto rapido, fianco a fianco, per chi lavora in azienda:

| Approccio | Tempo al valore | Competenze richieste | Gestisce contenuti dinamici | Manutenzione | Opzioni di esportazione | Scalabilità |

|---|---|---|---|---|---|---|

| JS manuale (Cheerio) | Lento | Programmazione | No | Alta | Lo codifichi tu | Buona per siti statici |

| JS avanzato (Puppeteer) | Medio | Programmazione+ | Sì | Alta | Lo codifichi tu | Più lento per pagina |

| Thunderbit | Veloce | Nessuna | Sì (con AI) | Bassa | 1 clic verso Sheets/CSV | Cloud o browser |

Per la maggior parte degli utenti business, Thunderbit è il modo più rapido per passare da “Mi servono questi dati” a “Ecco il mio foglio di calcolo”.

Conclusione e punti chiave

Creare un Estrattore Web JavaScript è un superpotere nel mondo guidato dai dati di oggi. Ecco cosa ho imparato — e cosa consiglio:

- Inizia in modo semplice: usa Cheerio e Axios per i siti statici.

- Passa al livello avanzato quando serve: usa Puppeteer per siti dinamici, interattivi o che richiedono login.

- Risparmia tempo con strumenti AI: per la maggior parte delle esigenze aziendali, ti permette di saltare il codice e ottenere risultati in pochi minuti.

- Prevedi la manutenzione: i siti cambiano — i tuoi scraper devono essere pronti ad adattarsi.

- Esegui sempre lo scraping in modo etico: rispetta i termini dei siti, evita di sovraccaricare i server e usa i dati in modo responsabile.

Se vuoi provare lo scraping senza complicazioni, e scopri quanto può essere semplice. E se vuoi approfondire, dai un’occhiata al per altre guide, consigli ed esempi reali.

Buono scraping — e che i tuoi selettori siano sempre unici!

FAQ

1. Che cos’è un Estrattore Web JavaScript?

Un Estrattore Web JavaScript è un programma (o script) scritto in JavaScript che estrae automaticamente dati dai siti web. Può essere eseguito nel browser o sul server (con Node.js) ed è particolarmente efficace con siti dinamici e ricchi di JavaScript.

2. Perché scegliere JavaScript invece di Python per il web scraping?

JavaScript è il linguaggio del web, quindi è ideale per estrarre contenuti che si caricano in modo dinamico o richiedono interazioni dell’utente. Python è ottimo per siti statici e analisi dati, ma per i contenuti dinamici servono strumenti aggiuntivi.

3. Di quali strumenti ho bisogno per creare un estrattore JavaScript?

Per i siti statici: Node.js, Axios (o fetch) e Cheerio. Per i siti dinamici: aggiungi Puppeteer o Playwright per l’automazione di browser headless. Per lo scraping senza codice, prova .

4. In che modo Thunderbit semplifica il web scraping?

Thunderbit usa l’AI per rilevare ed estrarre automaticamente i dati da qualsiasi sito web. Ti basta fare clic su “AI Suggest Fields”, poi su “Scrape”, ed esportare i dati — senza scrivere codice né armeggiare con i selettori.

5. Il web scraping è legale ed etico?

Il web scraping è legale se fatto in modo responsabile: estrai solo dati disponibili pubblicamente, rispetta i termini del sito e non sovraccaricare i server. Evita di raccogliere dati personali senza consenso e usa sempre i dati in modo etico.

Vuoi vedere lo scraping JavaScript in azione? Dai un’occhiata al per tutorial, oppure esplora altri contenuti sul .

Scopri di più