Oggi i dati sono il carburante che fa girare ogni azienda, e la sfida per trasformare le informazioni grezze del web in insight utili è più viva che mai. Ho potuto vedere di persona quanto uno specialista di data scraping preparato possa cambiare le carte in tavola: velocizza le ricerche di mercato, migliora le decisioni e può persino dare una marcia in più rispetto ai concorrenti. Ma trovare la persona giusta non è una passeggiata: non basta pubblicare un annuncio e aspettare. La domanda di esperti in data scraping è alle stelle, e la differenza tra una buona assunzione e una eccellente può significare avere dati puliti, pronti all’uso e conformi, oppure solo un mucchio di informazioni inutilizzabili.

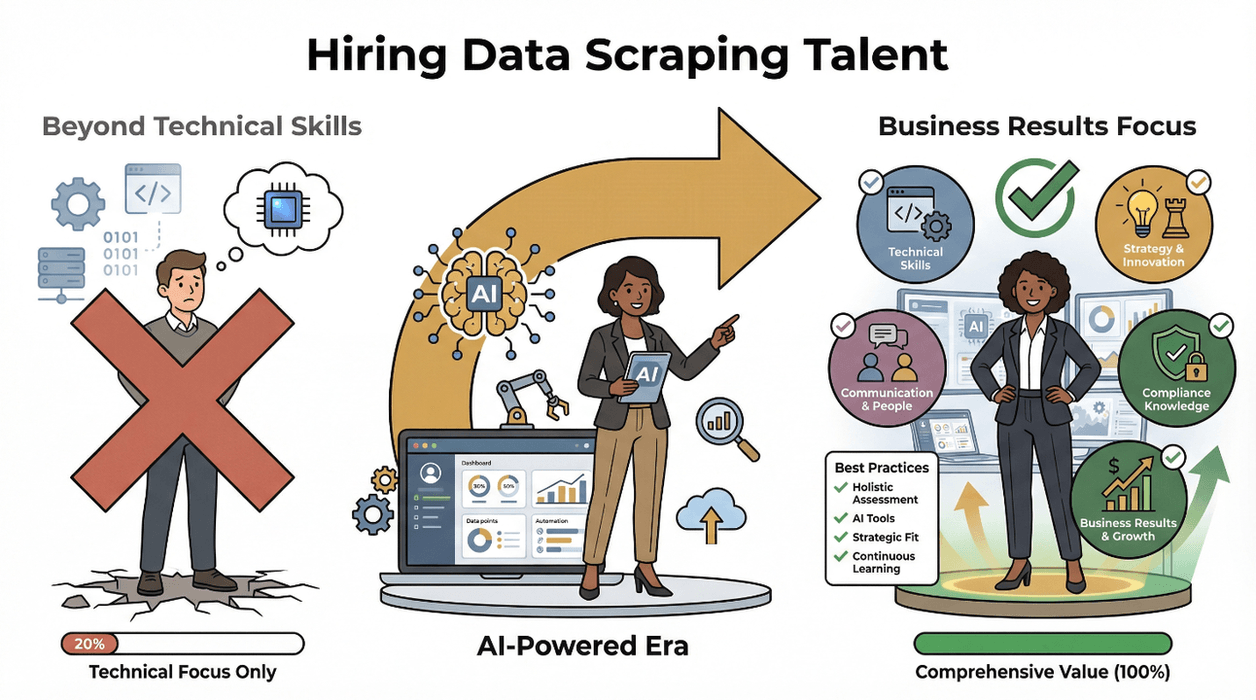

Se stai pensando di assumere specialisti in data scraping, sappi che non sei l’unico. Il mercato globale dell’estrazione dati dal web sta crescendo a vista d’occhio e aziende di ogni settore si affidano a un flusso costante di insight raccolti online per restare al passo (). Ma con l’arrivo di strumenti sempre più evoluti—soprattutto grazie a piattaforme AI come —e regole sempre più rigide, trovare il professionista giusto vuol dire guardare oltre le semplici skill tecniche. Ecco le dritte che ho imparato (spesso a mie spese) per assumere talenti nel data scraping che possano davvero far crescere il tuo business.

Se stai pensando di assumere specialisti in data scraping, sappi che non sei l’unico. Il mercato globale dell’estrazione dati dal web sta crescendo a vista d’occhio e aziende di ogni settore si affidano a un flusso costante di insight raccolti online per restare al passo (). Ma con l’arrivo di strumenti sempre più evoluti—soprattutto grazie a piattaforme AI come —e regole sempre più rigide, trovare il professionista giusto vuol dire guardare oltre le semplici skill tecniche. Ecco le dritte che ho imparato (spesso a mie spese) per assumere talenti nel data scraping che possano davvero far crescere il tuo business.

Definisci bene cosa ti serve prima di assumere

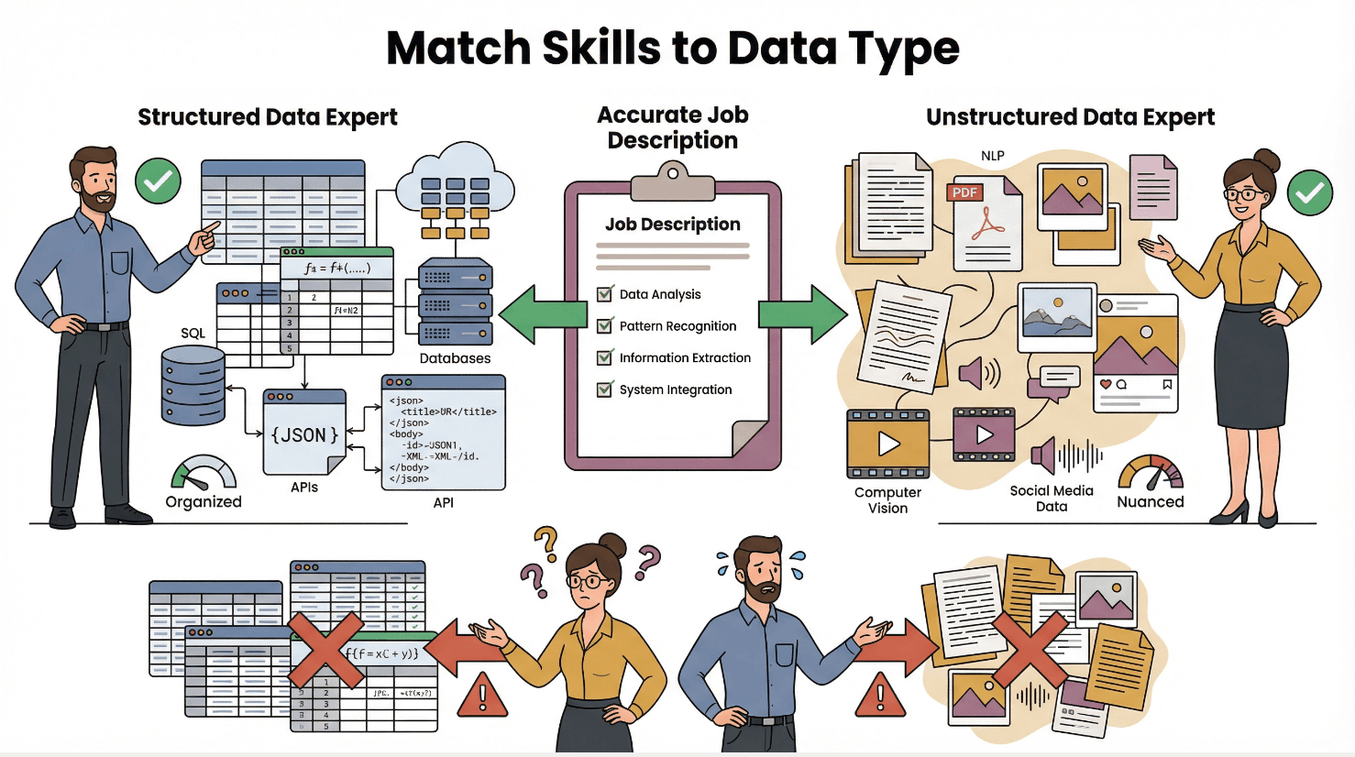

Prima ancora di scrivere la job description, fermati un attimo e chiediti: cosa dobbiamo davvero estrarre e perché? Ho visto troppi progetti andare fuori strada perché il team di selezione non aveva le idee chiare su questo punto. Ti serve estrarre dati strutturati (tipo tabelle di prezzi ordinate) o devi gestire dati disordinati e non strutturati (recensioni, immagini, testi liberi)? È un’attività una tantum o hai bisogno di scraping ricorrente e programmato?

Chiarire questi aspetti ti aiuterà a collegare gli obiettivi di business alle necessità tecniche, rendendo il processo di selezione molto più efficace. Ad esempio, estrarre dati strutturati da siti e-commerce richiede competenze diverse rispetto all’analisi del sentiment sui social o all’estrazione di informazioni legali da PDF.

Le aziende più organizzate partono sempre da una mappatura dettagliata delle esigenze: siti target, campi dati, frequenza di aggiornamento e requisiti di conformità, prima ancora di valutare i CV (). Questa chiarezza ti permette di attrarre candidati davvero in linea con il progetto, non solo chi sa scrivere uno script.

Dati strutturati vs non strutturati: facciamo chiarezza

Ecco la differenza:

- Dati strutturati: sono ordinati e prevedibili—come tabelle, fogli Excel o database. Esempi: elenchi di prodotti, prezzi di borsa, rubriche di contatti. Lo scraping di dati strutturati è di solito più semplice e strumenti come Thunderbit sono perfetti per trasformare tabelle web in fogli di calcolo pronti all’uso ().

- Dati non strutturati: sono disordinati e imprevedibili—come post di blog, immagini, PDF o recensioni utenti. Qui servono tecniche avanzate, come l’analisi del linguaggio naturale, l’AI o il riconoscimento immagini ().

La complessità dei dati determina il profilo ideale del candidato. Chi è esperto nello scraping di dati strutturati potrebbe trovarsi in difficoltà con fonti non strutturate, e viceversa. Assicurati che la job description rifletta le vere sfide del tuo progetto.

La complessità dei dati determina il profilo ideale del candidato. Chi è esperto nello scraping di dati strutturati potrebbe trovarsi in difficoltà con fonti non strutturate, e viceversa. Assicurati che la job description rifletta le vere sfide del tuo progetto.

Collega le competenze dei candidati alle tue esigenze

Una volta che hai chiaro cosa ti serve, è il momento di collegare questi requisiti alle competenze dei candidati. Ecco cosa guardo sempre:

- Competenze tecniche: conoscenza di strumenti di scraping (sia con codice che no-code), padronanza di HTML/CSS/JavaScript, esperienza con tecniche anti-bot e capacità di pulizia dati ().

- Problem solving: sanno gestire cambiamenti improvvisi nei siti, CAPTCHAs o requisiti che cambiano?

- Attenzione ai dettagli: non basta raccogliere dati, serve ottenere quelli giusti, nel formato corretto, ogni volta.

- Soft skill: comunicazione, autonomia, adattabilità. I progetti di data scraping richiedono spesso confronto con i team di business, flessibilità e molta pazienza.

I migliori candidati sono quelli con esperienza specifica sulle tue sfide. Se il tuo progetto prevede siti con forti difese anti-bot, cerca chi ha già lavorato con proxy, automazione browser o strumenti AI in grado di adattarsi a layout dinamici.

Valuta l’esperienza con strumenti moderni (Thunderbit e simili)

L’arrivo di strumenti AI e no-code come ha cambiato le regole del gioco. Oggi non conta solo chi scrive il miglior script Python, ma chi sa ottenere risultati rapidi, affidabili e su larga scala.

Thunderbit, ad esempio, permette di descrivere ciò che si vuole estrarre in linguaggio naturale, cliccare su “AI Suggerisci Campi” e lasciare che l’AI faccia il resto. È una mano santa per team non tecnici o per progetti multilingua (). In fase di selezione, chiedo sempre ai candidati se hanno esperienza con strumenti come Thunderbit e come li hanno utilizzati per risolvere problemi concreti.

La familiarità con strumenti AI è un grande vantaggio: significa che il candidato può adattarsi rapidamente a nuovi siti, gestire contenuti complessi o dinamici e ridurre la manutenzione manuale (). È anche segno che segue le ultime tendenze del settore.

Valuta la preparazione tecnica e la capacità di risolvere problemi reali

Le competenze tecniche sono la base, ma come valutarle davvero? Io punto molto sui test pratici e sulla revisione del portfolio. Chiedi ai candidati di raccontare un progetto recente: qual era l’obiettivo? Quali ostacoli hanno incontrato? Come hanno gestito le difese anti-bot o la pulizia dei dati?

Puoi anche proporre un esercizio pratico simile alle tue esigenze: “Estrai nomi, prezzi e immagini da questo sito e-commerce, gestendo paginazione e sottopagine.” Punti extra se riescono sia con codice che con uno strumento no-code come Thunderbit.

Cerca candidati che sappiano spiegare il loro approccio, documentare il processo e adattarsi quando le cose non vanno come previsto. I migliori trattano lo scraping come un processo continuo, non come un’attività una tantum ().

Testa le competenze anti-bot e di scraping avanzato

I siti web sono sempre più bravi a bloccare gli scraper, quindi il tuo specialista deve essere ancora più preparato. Durante il colloquio, chiedi della loro esperienza con:

- Difese anti-bot: come gestiscono CAPTCHAs, blocchi IP o il rilevamento dell’user-agent? Hanno usato automazione browser o proxy premium ()?

- Scraping approfondito: sanno estrarre dati non solo da pagine elenco, ma anche da pagine di dettaglio, sottopagine o persino PDF e immagini?

- Adattabilità: cosa fanno se un sito cambia layout da un giorno all’altro?

Un buon test tecnico può prevedere l’estrazione di dati da un sito con difese anti-bot di base, o la richiesta di arricchire una tabella visitando sottopagine—funzionalità che Thunderbit gestisce con lo scraping delle sottopagine.

Dai priorità all’esperienza con strumenti AI e no-code

L’epoca degli script personalizzati sta lasciando spazio a strumenti AI e no-code, che rendono il data scraping accessibile a molti più utenti. Gli specialisti che sanno sfruttare queste piattaforme ottengono risultati più rapidi e con meno manutenzione.

Thunderbit, ad esempio, offre:

- AI Suggerisci Campi: l’AI analizza la pagina e suggerisce le colonne da estrarre, senza configurazioni manuali.

- Scraping di sottopagine: visita automaticamente ogni sottopagina e arricchisce il dataset.

- Supporto multilingua: estrai dati da siti in 34 lingue, ideale per progetti internazionali.

- Esportazione immediata: invia i risultati direttamente su Excel, Google Sheets, Notion o Airtable.

Quando selezioni, cerca candidati che sappiano usare queste funzionalità. Chiedi di descrivere un progetto in cui hanno usato Thunderbit (o simili) per risolvere una sfida complessa, o proponi una demo live durante il colloquio.

Thunderbit come metro di valutazione: cosa guardare

Ecco alcune skill specifiche su Thunderbit che fanno la differenza:

- Istruzioni AI personalizzate: sanno usare i Field AI Prompts per estrarre e etichettare i dati con precisione?

- Scraping di sottopagine e paginazione: hanno esperienza nell’estrazione multi-livello con Thunderbit?

- Esportazione e integrazione dati: sono a loro agio nell’esportare dati su varie piattaforme e pulirli per l’uso aziendale?

- Aggiornamento continuo: seguono le ultime novità e aggiornamenti di Thunderbit?

Esempi di domande per il colloquio:

- “Raccontami di una volta in cui hai usato lo scraping delle sottopagine di Thunderbit per arricchire un dataset. Quali difficoltà hai incontrato?”

- “Come utilizzi AI Suggerisci Campi per velocizzare il tuo lavoro?”

- “Hai mai personalizzato i Field AI Prompts per un’estrazione dati complessa?”

Assicurati che il candidato conosca le regole legali ed etiche

Questo punto è fondamentale. Il fatto che i dati siano visibili online non significa che siano liberi da vincoli (). Quando assumi uno specialista, verifica che conosca i limiti legali ed etici del suo lavoro.

Regolamenti chiave da considerare:

- GDPR (Europa): tutela i dati personali e la privacy ().

- CCPA (California): regola la raccolta di dati personali dei californiani ().

- Copyright e diritti sui database: estrarre dati protetti da copyright o proprietari può essere illegale, anche se accessibili pubblicamente ().

- Termini di servizio: molti siti vietano lo scraping nei loro T&C ().

Le sentenze recenti tendono a favorire lo scraping di dati pubblici, ma il quadro normativo è in continua evoluzione (). Un buon professionista sa come muoversi in questo contesto e progettare soluzioni conformi ed etiche.

Come valutare la consapevolezza normativa

Durante il colloquio, verifica la conoscenza delle regole chiedendo:

- “Come ti assicuri che i tuoi progetti di scraping rispettino GDPR o CCPA?”

- “Quali accorgimenti adotti per evitare di estrarre dati protetti o sensibili?”

- “Come gestisci i siti che vietano esplicitamente lo scraping nei termini di servizio?”

Risposte vaghe, scarsa conoscenza delle leggi sulla privacy o un atteggiamento superficiale verso l’etica sono segnali d’allarme. Vuoi qualcuno che consideri la conformità parte integrante del lavoro.

Promuovi una cultura di apprendimento continuo e adattamento

Il data scraping è in continua evoluzione. I siti cambiano, le difese anti-bot si aggiornano e ogni mese spuntano nuovi strumenti. I migliori specialisti sono quelli che non smettono mai di imparare.

In fase di selezione, cerca segnali di aggiornamento professionale:

- Seguono blog di settore o partecipano a community di scraping?

- Hanno sperimentato nuovi strumenti o funzionalità, come gli ultimi aggiornamenti di Thunderbit?

- Sanno spiegare come hanno adattato il loro workflow a nuove regole o tecnologie?

Incoraggia il team a restare aggiornato sulle novità di Thunderbit, partecipare a webinar o contribuire a progetti open source. Una cultura dell’apprendimento porta benefici in efficienza, qualità dei dati e conformità.

Sfrutta le ultime novità di Thunderbit per migliorare sempre

Thunderbit aggiorna spesso le sue funzioni—come scraping programmato, suggerimenti AI per i campi e supporto multilingua. Chi resta aggiornato su queste novità può ottenere risultati migliori, più velocemente.

Ad esempio, con lo scraping programmato di Thunderbit, uno specialista può automatizzare raccolte regolari di dati, mantenendo i dataset sempre aggiornati. O, padroneggiando i Field AI Prompts, può estrarre e etichettare dati complessi con pochissimo intervento manuale.

Assumere chi è proattivo nell’apprendere e sperimentare nuove funzionalità è un grande vantaggio: manterrà la pipeline dati efficiente, qualunque cosa accada online.

Le soft skill contano: comunicazione, autonomia e problem solving

Le competenze tecniche sono fondamentali, ma le soft skill fanno davvero la differenza. Ecco cosa considero essenziale:

- Comunicazione chiara: sanno spiegare concetti tecnici anche a chi non è del settore?

- Autonomia: sono in grado di lavorare in modo indipendente e prendere decisioni?

- Tenacia: i progetti di scraping incontrano spesso ostacoli—insistono o si arrendono al primo errore?

- Adattabilità: sanno cambiare rotta se i requisiti cambiano o un sito viene ridisegnato?

Un esempio reale: ho lavorato con uno specialista che non solo ha fornito dati puliti, ma ha anche segnalato rischi di conformità e suggerito miglioramenti di processo. Questo tipo di iniziativa vale oro.

Scrivi una job description chiara e mirata per attrarre i migliori

Una buona assunzione parte da una job description precisa. Sii specifico su esigenze, competenze richieste e aspettative di conformità. Ecco una checklist:

- Responsabilità: quali dati dovrà estrarre? Quali strumenti userà?

- Competenze richieste: sia tecniche (Thunderbit, Python, tecniche anti-bot) che soft skill (comunicazione, autonomia).

- Note sulla conformità: sottolinea l’importanza della raccolta dati legale ed etica.

- Formazione continua: evidenzia l’impegno nell’aggiornamento e nella padronanza degli strumenti.

Usa un linguaggio che attiri candidati con visione sia tecnica che di business. Citare l’esperienza con Thunderbit o altri strumenti AI aiuta ad attrarre specialisti all’avanguardia.

Esempio di template per job description

Ecco un modello personalizzabile da cui partire:

| Titolo posizione | Specialista Data Scraping |

|---|---|

| Chi siamo | Siamo un’azienda data-driven alla ricerca di uno Specialista Data Scraping per estrarre, pulire e fornire dati web di alta qualità per insight di business. Lavorerai con strumenti innovativi come Thunderbit per automatizzare e ottimizzare i nostri flussi di raccolta dati. |

| Responsabilità | - Definire e realizzare progetti di data scraping (dati strutturati e non) - Utilizzare strumenti AI (Thunderbit, ecc.) per estrarre dati in modo efficiente - Gestire difese anti-bot, paginazione e scraping di sottopagine - Garantire la conformità legale ed etica (GDPR, CCPA, copyright, T&C) - Pulire, strutturare ed esportare dati su Excel, Google Sheets, Notion o Airtable - Comunicare risultati e raccomandazioni ai team di business - Restare aggiornato su strumenti e best practice di scraping |

| Requisiti | - Esperienza comprovata in data scraping (portfolio o esempi di progetto richiesti) - Familiarità con strumenti AI/no-code come Thunderbit - Ottime capacità di problem solving e comunicazione - Conoscenza delle normative sulla privacy e conformità - Impegno nell’apprendimento continuo |

| Plus | - Esperienza in progetti di scraping multilingua - Conoscenza di Field AI Prompts e labeling personalizzato - Partecipazione a community o progetti open source di web scraping |

Best practice per colloqui e valutazione

Selezionare specialisti in data scraping è un mix tra arte e metodo. Ecco cosa funziona:

- Test tecnico: proponi un esercizio pratico reale, sia con codice che con uno strumento no-code come Thunderbit.

- Revisione portfolio: chiedi progetti precedenti, esempi di codice o case study.

- Colloquio comportamentale: valuta soft skill come comunicazione, autonomia, adattabilità.

- Verifica conformità: testa la conoscenza di aspetti legali ed etici con domande su casi concreti.

- Valutazione da remoto: usa la condivisione schermo per demo live o assegna task a casa con requisiti chiari.

Un approccio bilanciato—tra tecnica, pratica e soft skill—ti aiuterà a trovare non solo uno scraper, ma un vero partner per i dati.

Conclusioni: come avere successo nell’assunzione di specialisti in data scraping

Assumere il giusto specialista in data scraping non significa solo trovare competenze tecniche. Si tratta di allineare le esigenze aziendali con il giusto mix di skill, strumenti e attenzione all’etica. Definisci i requisiti in modo chiaro, cerca candidati in grado di gestire sia dati strutturati che non strutturati e dai priorità all’esperienza con piattaforme moderne e AI come Thunderbit. Non dimenticare di valutare la consapevolezza normativa e la voglia di aggiornarsi: in questo settore, chi si ferma è perduto.

Il risultato? Dati puliti e utilizzabili che guidano decisioni più intelligenti, esecuzione più rapida e un vero vantaggio competitivo. Pronto a partire? Prova la o visita il per altri consigli su come costruire il tuo team dati.

Domande frequenti

1. Qual è la differenza tra dati strutturati e non strutturati nel data scraping?

I dati strutturati sono ordinati e prevedibili (come tabelle o database), quindi più facili da estrarre e analizzare. I dati non strutturati sono disordinati (testi, immagini, PDF) e richiedono tecniche avanzate per essere lavorati ().

2. Perché è importante l’esperienza con strumenti come Thunderbit quando si assume uno specialista in data scraping?

Gli strumenti AI come Thunderbit permettono di estrarre dati in modo più veloce e affidabile, anche per utenti non tecnici o progetti multilingua. Chi li conosce può ottenere risultati con meno configurazione e manutenzione ().

3. Come posso valutare la preparazione tecnica di un candidato in data scraping?

Attraverso test pratici, revisione del portfolio e domande su casi reali. Chiedi di svolgere un task concreto, gestire difese anti-bot o arricchire un dataset con scraping di sottopagine.

4. Quali aspetti legali ed etici devo considerare quando assumo uno specialista in data scraping?

Assicurati che il candidato conosca GDPR, CCPA, copyright e termini di servizio dei siti. Uno scraping responsabile rispetta privacy, proprietà intellettuale e requisiti di conformità ().

5. Come posso promuovere l’apprendimento continuo nel mio team di data scraping?

Favorisci una cultura di aggiornamento costante: invita il team a seguire blog di settore, sperimentare nuovi strumenti come Thunderbit e partecipare a community di scraping. L’apprendimento continuo porta a dati migliori e successo duraturo.

Vuoi costruire il tuo team dati ideale? Parti dalla chiarezza, seleziona per competenze e mentalità, e lascia che siano i dati (e Thunderbit) a fare la differenza.

Scopri di più