Sarò sincero: la prima volta che ho provato a estrarre tutti gli URL da un sito grande, ho pensato: “Quanto può essere difficile?”. Qualche ora dopo ero ancora lì a cliccare pagine infinite, copiare e incollare link in un foglio di calcolo e mettere in discussione le mie scelte di vita. Se hai mai provato a trovare tutte le pagine di un sito web — che sia per un audit dei contenuti, una lista di lead o una ricerca sui competitor — conosci bene la fatica. È un lavoro noioso, pieno di errori e, francamente, uno spreco di tempo e talento.

Ma ecco la buona notizia: non devi più farlo nel modo più complicato. Strumenti basati sull’AI come stanno cambiando le regole del gioco per chi lavora in azienda, rendendo possibile trovare tutti gli URL di un dominio in pochi minuti, non in giorni. Anzi, le aziende che usano strumenti di web scraping guidati dall’AI riportano un risparmio di tempo del 30–40% nelle attività di raccolta dati, e alcune arrivano a spendere fino all’80% di tempo in meno rispetto ai metodi manuali. Non è solo una statistica: sono ore, o giorni, di vita che ti riprendi.

Quindi, vediamo perché trovare tutte le pagine di un sito web è così complicato, perché i modelli AI generici come GPT o Claude non bastano davvero, e come agenti AI specializzati — come Thunderbit — rendano tutto molto più semplice. E sì, ti guiderò passo dopo passo per estrarre ogni URL che ti serve, anche se non sai programmare.

Perché trovare tutti gli URL di un dominio è così difficile

Diciamolo chiaramente: i siti web non sono progettati per consegnarti un elenco ordinato di tutte le pagine che contengono. Sono pensati per i visitatori, non per chi vuole trovare tutte le pagine di un sito web in un colpo solo. Ecco perché questa attività è così frustrante:

- La follia del copia-incolla manuale: cliccare su ogni menu, elenco e directory, copiare gli URL uno per uno, è la ricetta perfetta per il tunnel carpale e per perdersi metà delle pagine.

- Paginazione e scroll infinito: molti siti dividono i contenuti su più pagine o caricano altri risultati mentre scorri. Se ti sfugge un pulsante “Avanti” o non scorri abbastanza, ti perdi intere sezioni.

- Strutture delle pagine incoerenti: alcune pagine elencano i link in un formato, altre usano un layout diverso. Tenere tutto sotto controllo è un incubo.

- Pagine nascoste o orfane: non tutte le pagine sono collegate dalla navigazione principale. Alcune sono sepolte in profondità e si trovano solo tramite sitemap o ricerca interna.

- Errore umano: più pagine devi copiare, più è facile sbagliare — URL duplicati, refusi o semplicemente elementi saltati.

E se stai lavorando su un sito con centinaia o migliaia di pagine? Lascia perdere. L’estrazione manuale semplicemente non scala. Come ha detto un team dati, oltre i casi banali, .

Cosa significa “trovare tutte le pagine di un sito web”?

Prima di passare alle soluzioni, chiariamo bene cosa stiamo cercando davvero.

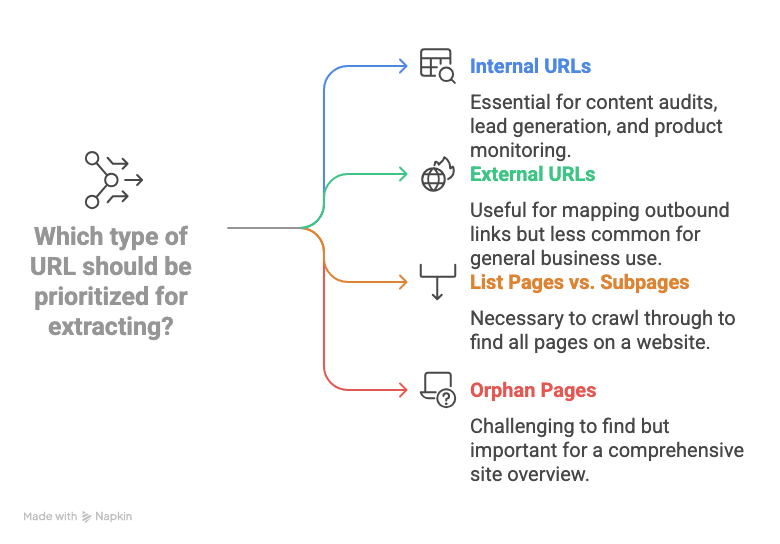

- URL interni: sono link che puntano a pagine dello stesso dominio (come /about-us o /products/widget-123). Per la maggior parte dei casi d’uso aziendali — audit dei contenuti, lead generation, monitoraggio prodotti — gli URL interni sono l’obiettivo principale.

- URL esterni: link che portano ad altri siti. Di solito non ti servono, a meno che tu non stia mappando i link in uscita.

- Pagine elenco vs sottopagine: molti siti hanno pagine “hub” o pagine elenco (pensa a categorie, archivi del blog, directory) che rimandano a pagine di dettaglio (come schede prodotto o profili). Per trovare davvero tutte le pagine di un sito web, devi attraversare questi elenchi e prendere ogni sottopagina collegata.

- Pagine orfane: sono pagine non collegate in modo evidente da nessuna parte. A volte le puoi intercettare tramite sitemap o ricerca interna, ma sono facili da perdere.

Quindi, quando parliamo di trovare tutti gli URL di un dominio, intendiamo: ottenere ogni URL di pagina interna, dalla homepage fino al prodotto o articolo più profondo, idealmente in un formato utilizzabile, come un foglio di calcolo.

I metodi tradizionali per trovare tutti gli URL di un dominio

Ci sono alcuni approcci “vecchia scuola” per affrontare il problema, ma ognuno ha i suoi grattacapi:

Copia-incolla manuale e strumenti del browser

È l’approccio “di forza bruta”: clicchi ogni link, copi ogni URL, lo incolli in un foglio di calcolo e speri di non dimenticare nulla. Alcune persone usano estensioni del browser per estrarre tutti i link della pagina corrente, ma devi comunque ripetere l’operazione per ogni pagina, e per la paginazione o le sezioni nascoste sei da solo. Va bene per un sito da cinque pagine, non certo per qualcosa di più grande.

Usare la ricerca del sito e le sitemap

- Ricerca site: di Google: digita site:tuodominio.com su Google e vedrai un po’ di pagine indicizzate. Ma Google mostra solo ciò che ha indicizzato (spesso con un limite di circa 1.000 risultati), quindi ti sfuggiranno pagine nuove, nascoste o di bassa qualità. La stessa ammette che non è una soluzione completa.

- Sitemap XML: molti siti hanno un /sitemap.xml che elenca gli URL importanti. Ottimo, se la sitemap è aggiornata e include ogni pagina. Ma non tutti i siti ce l’hanno, e alcuni dividono la sitemap in più file. Le pagine orfane spesso non compaiono.

Crawler tecnici e script

- Strumenti SEO (come Screaming Frog): eseguono la scansione di un sito come farebbe un motore di ricerca e restituiscono un elenco di URL. Sono potenti, ma richiedono configurazione, impostazioni e a volte una licenza a pagamento per siti grandi.

- Script Python (come Scrapy): gli sviluppatori possono scrivere script per scansionare ed estrarre URL. Ma diciamolo: se non ti senti a tuo agio con il codice, non è un’opzione praticabile. Inoltre, gli script si rompono quando cambia il layout del sito, quindi devi rincorrere continuamente gli aggiornamenti.

In sintesi: i metodi tradizionali sono troppo manuali, troppo incompleti o troppo tecnici per la maggior parte degli utenti business. Non è un caso che molte persone mollino a metà.

Perché i modelli AI generici non possono automatizzare del tutto l’estrazione degli URL

Potresti pensare: “Non posso semplicemente chiedere a ChatGPT o Claude di trovare tutte le pagine di un sito per me?”. Magari fosse così facile. Ecco la realtà:

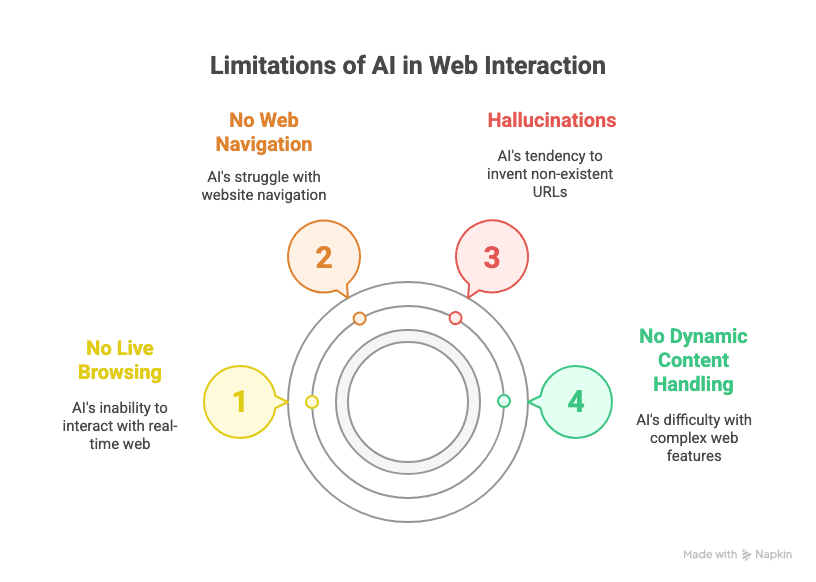

- Nessuna navigazione live: modelli AI generalisti come GPT o Claude non possono davvero navigare il web in tempo reale. Non “vedono” lo stato attuale di un sito: lavorano solo sui dati di addestramento o su ciò che incolli loro.

- Nessuna navigazione web: anche con plugin o funzioni di browsing, gli LLM non sanno cliccare “Avanti”, gestire lo scroll infinito o seguire in modo sistematico ogni link di un sito.

- Allucinazioni: se chiedi a un’AI generica tutti gli URL di un dominio, spesso si inventa link che sembrano plausibili ma che in realtà non esistono. (Ho visto inventarsi pagine /about-us per siti che non le avevano mai avute.)

- Nessuna gestione dei contenuti dinamici: i siti che caricano contenuti con JavaScript, richiedono login o usano navigazioni complesse sono fuori portata per gli LLM generici.

Come dice la : “Se vuoi estrarre centinaia o migliaia di pagine… ChatGPT da solo non basta.” Ti serve uno strumento progettato apposta per questo lavoro.

Gli agenti AI verticali sono il futuro (e perché conta)

Qui entra in gioco la mia esperienza in SaaS e automazione: gli agenti AI verticali — strumenti AI costruiti per un dominio specifico, come l’estrazione di dati dal web — sono l’unico modo per ottenere risultati affidabili e scalabili nelle attività aziendali. Perché?

- Gli LLM generalisti sono ottimi per scrivere o cercare informazioni, ma sono soggetti ad “allucinazioni” e non riescono a gestire workflow ripetibili e multi-step con la stabilità richiesta dalle aziende.

- Gli strumenti SaaS enterprise devono automatizzare moltissime attività ripetitive e strutturate. È qui che gli agenti AI verticali danno il meglio: sono costruiti per fare una cosa sola, e farla bene, con errori minimi.

- Gli esempi non mancano in vari settori: Thunderbit per l’estrazione di dati dal web, Devin AI per lo sviluppo software, Alta per l’automazione delle vendite, IL VISTA di Infinity Learn per l’istruzione, Rippling per l’HR, Harvey per il legale… e l’elenco continua.

In breve: se vuoi trovare tutte le pagine di un sito web in modo affidabile, ti serve un agente AI verticale progettato per questo scopo, non un chatbot generico.

Incontra Thunderbit: estrazione di URL con l’AI per tutti

Ed è qui che entra in gioco . Come estensione Chrome per AI web scraper, Thunderbit è pensato per chi lavora in azienda: niente codice, niente configurazioni tecniche, solo risultati. Ecco cosa lo rende diverso:

- Interfaccia in linguaggio naturale: descrivi semplicemente ciò che vuoi (“Elenca tutti gli URL delle pagine di questo sito”) e l’AI di Thunderbit capisce come estrarlo.

- AI Suggest Fields: Thunderbit analizza la pagina e suggerisce automaticamente i nomi delle colonne (come “URL della pagina”) — senza dover mettere mano a selettori CSS o XPath.

- Gestione di paginazione e scroll infinito: Thunderbit può cliccare automaticamente “Avanti” o scorrere verso il basso, così non perdi nessuna pagina.

- Navigazione nelle sottopagine: devi andare più a fondo? Thunderbit può seguire i link alle sottopagine ed estrarre dati anche da lì.

- Esportazione strutturata: esporta i risultati direttamente in Google Sheets, Excel, Notion, Airtable o CSV — gratis e con un solo clic.

- Nessuna programmazione richiesta: se sai navigare un sito web, sai usare Thunderbit. È davvero così semplice.

E poiché Thunderbit è un agente AI verticale, è costruito per stabilità e ripetibilità — perfetto per chi deve automatizzare le stesse attività più e più volte.

Passo dopo passo: come trovare tutti gli URL di un dominio con Thunderbit

Pronto a vedere come funziona? Ecco una guida pratica, non tecnica, per estrarre ogni URL di cui hai bisogno.

1. Installa l’estensione Chrome di Thunderbit

Prima cosa: . Funziona su Chrome, Edge, Brave e altri browser Chromium. Fissala alla barra degli strumenti per averla sempre a portata di mano.

2. Apri la pagina elenco o directory di destinazione

Vai al sito da cui vuoi estrarre gli URL. Può essere la homepage, una sitemap, una directory o qualsiasi pagina elenco che colleghi le pagine che ti interessano.

3. Avvia Thunderbit e imposta i campi

Fai clic sull’icona di Thunderbit per aprire l’estensione. Crea un nuovo modello di estrazione. Qui succede la magia:

- Fai clic su “AI Suggest Fields”. L’AI di Thunderbit analizzerà la pagina e suggerirà le colonne — cerca una voce chiamata “Page URL”, “Link” o simile.

- Se non vedi esattamente il campo che vuoi, aggiungi semplicemente una colonna chiamata “Page URL” (o quello che ha senso). L’AI di Thunderbit è addestrata a riconoscere questi termini e a mapparli ai dati corretti.

4. Attiva la paginazione o lo scorrimento, se necessario

Se la pagina di destinazione ha più pagine (come “Pagina 1, 2, 3…” o un pulsante “Carica altro”), attiva la paginazione in Thunderbit:

- Passa alla modalità “Click Pagination” per i siti con pulsanti “Avanti”, oppure a “Infinite Scroll” per i siti che caricano più contenuti mentre scorri.

- Thunderbit ti chiederà di selezionare il pulsante “Avanti” o l’area di scorrimento: basta fare clic e l’AI farà il resto.

5. Avvia lo scraping e controlla i risultati

Premi il pulsante “Scrape”. Thunderbit scorrerà tutte le pagine e raccoglierà ogni URL trovato. Vedrai i risultati comparire in una tabella direttamente nell’estensione. Per siti grandi, può volerci qualche minuto, ma è comunque molto più veloce che fare tutto a mano.

6. Esporta l’elenco degli URL

Una volta terminato lo scraping, fai clic su Export. Puoi inviare i dati direttamente a:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Le esportazioni sono gratuite e mantengono tutta la formattazione. Niente più problemi di copia-incolla.

Confronto tra Thunderbit e altre soluzioni per l’estrazione di URL

| Metodo | Facilità d’uso | Precisione e copertura | Scalabilità | Opzioni di esportazione |

|---|---|---|---|---|

| Copia-incolla manuale | Penoso | Bassa (facile dimenticare qualcosa) | Nessuna | Manuale (Excel, ecc.) |

| Estrattori di link del browser | Ok per 1 pagina | Media | Scarsa | Manuale |

Ricerca Google site: | Facile | Media (non completa) | Limitata a ~1.000 risultati | Manuale |

| Sitemap XML | Facile (se esiste) | Buona (se aggiornata) | Buona | Manuale/Script |

| Strumenti SEO (Screaming Frog) | Tecnico | Alta | Alta (a pagamento) | CSV, Excel |

| Script Python (Scrapy, ecc.) | Molto tecnico | Alta | Alta | Personalizzata |

| Thunderbit | Molto facile | Molto alta | Alta | Google Sheets, CSV, ecc. |

Thunderbit ti offre la precisione e la scalabilità di un crawler professionale con la semplicità di un’estensione del browser. Niente codice, niente configurazione: solo risultati.

Extra: estrarre con Thunderbit molto più che semplici URL

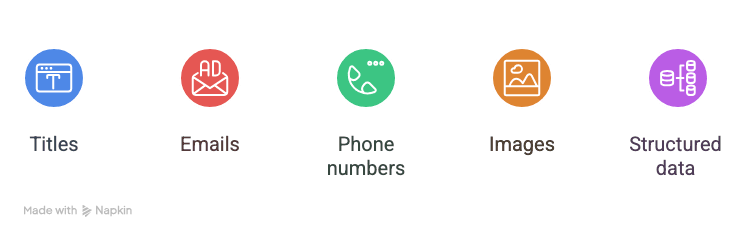

Qui le cose diventano davvero interessanti. Thunderbit non serve solo per gli URL: puoi estrarre:

- Titoli

- Numeri di telefono

- Immagini

- Qualsiasi dato strutturato presente nella pagina

Per esempio, se stai creando una lista di lead, puoi far sì che Thunderbit raccolga l’URL del profilo, il nome, l’email e il numero di telefono da ogni scheda in una directory, tutto in un solo passaggio. Se stai facendo l’audit di prodotti, puoi estrarre URL del prodotto, nome, prezzo e disponibilità. Thunderbit supporta persino lo , quindi può aprire ogni link ed estrarre i dettagli da lì.

E sì, gli estrattori di email e numeri di telefono di Thunderbit sono completamente gratuiti. È un bel vantaggio per team sales e marketing.

Punti chiave: come trovare tutte le pagine di un sito web con l’AI

Ricapitoliamo:

- Estrarre tutti gli URL da un dominio è difficile con strumenti manuali o generici.

- I modelli AI generici come GPT non riescono a gestire navigazione web, paginazione o contenuti dinamici.

- Gli agenti AI verticali come Thunderbit sono progettati appositamente per l’estrazione di dati dal web: stabili, ripetibili e facili da usare per chi lavora in azienda.

- Thunderbit semplifica tutto: installa l’estensione, usa l’AI per suggerire i campi, attiva la paginazione, fai lo scraping ed esporta. Nessun codice, nessuna complicazione.

- Puoi estrarre molto più che URL: titoli, email, numeri di telefono e altro ancora — perfetto per lead gen, audit o ricerca.

Se sei stanco di copiare e incollare link o di lottare con crawler tecnici, . C’è un piano gratuito, così puoi vedere con mano quanto tempo, e quanta pazienza, ti farà risparmiare.

E se vuoi scoprire altri modi in cui Thunderbit può aiutarti — come , o — dai un’occhiata al per altre guide e suggerimenti.

Pronto a riprenderti il tuo tempo dalla raccolta manuale dei dati? Il futuro dell’estrazione di dati dal web sono gli agenti AI verticali — e Thunderbit sta guidando il cambiamento. Provalo e fai in modo che il tuo prossimo audit, elenco di lead o progetto di ricerca sia il più semplice di sempre.

Leggi di più

P.S. Se ti viene mai voglia di copiare e incollare 1.000 URL a mano, ricordati solo questo: ora per questo c’è un’AI. I tuoi polsi (e il tuo capo) ti ringrazieranno.