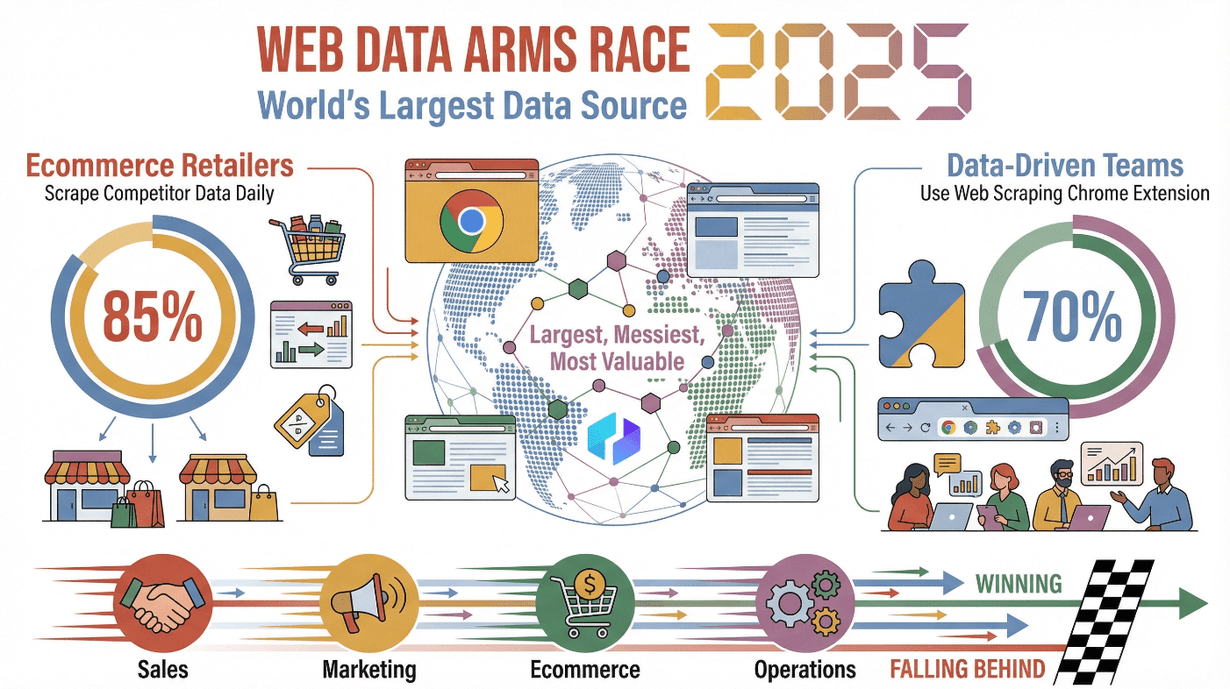

Il web oggi non è più solo il paradiso di video buffi e meme: ormai è la fonte di dati più vasta, caotica e preziosa che ci sia. Nel 2025, le aziende sono in piena “corsa all’oro” dei dati: e oltre . Che tu sia nel commerciale, nel marketing, nell’ecommerce o nelle operations, avere i dati giusti—subito e nel formato che ti serve—fa la differenza tra superare la concorrenza o restare indietro.

C’è però un problema: i siti web non sono pensati per facilitare l’estrazione dati. Sono disordinati, cambiano spesso e sono fatti per essere letti da persone, non da fogli Excel. Qui entrano in gioco gli strumenti di web scraping, che trasformano il caos in tabelle ordinate e pronte da usare. Dopo anni nel mondo SaaS e dell’automazione, ti assicuro che scegliere lo strumento giusto ti fa risparmiare ore, migliora la precisione e ti apre porte che spesso restano chiuse.

C’è però un problema: i siti web non sono pensati per facilitare l’estrazione dati. Sono disordinati, cambiano spesso e sono fatti per essere letti da persone, non da fogli Excel. Qui entrano in gioco gli strumenti di web scraping, che trasformano il caos in tabelle ordinate e pronte da usare. Dopo anni nel mondo SaaS e dell’automazione, ti assicuro che scegliere lo strumento giusto ti fa risparmiare ore, migliora la precisione e ti apre porte che spesso restano chiuse.

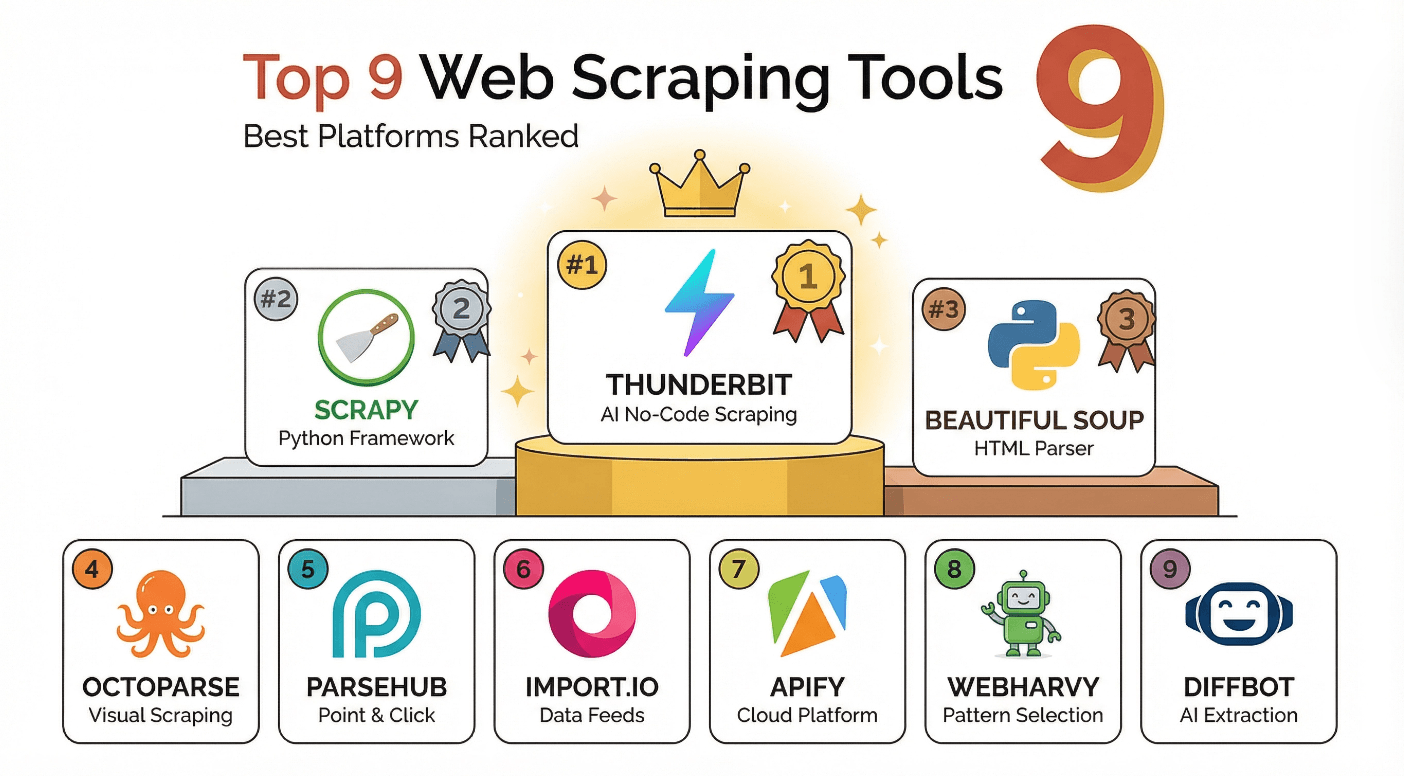

Quali strumenti di web scraping valgono davvero la pena nel 2025? Ho selezionato i nove migliori: dalle estensioni Chrome con AI per chi lavora in azienda, ai framework open-source per chi sviluppa. Vediamoli insieme.

Perché gli strumenti di web scraping sono indispensabili per le aziende di oggi

Gli strumenti di web scraping sono la chiave per vendite più intelligenti, marketing più mirato e processi aziendali più snelli. Ecco perché non possono mancare:

- Generazione di lead: I team commerciali pescano dati da elenchi, LinkedIn e siti di recensioni per creare liste di contatti super mirate.

- Analisi della concorrenza: Marketing ed ecommerce tengono d’occhio prezzi, nuovi prodotti e campagne dei rivali—spesso in tempo reale.

- Ricerche di mercato: Analisti e ricercatori aggregano recensioni, notizie e opinioni degli utenti per scovare trend prima degli altri.

- Monitoraggio prezzi: Brand e negozi controllano prezzi e disponibilità su centinaia di siti per restare competitivi ().

- Aggregazione di contenuti: I team operations raccolgono dati da portali di lavoro, annunci immobiliari o cataloghi fornitori per ottimizzare i flussi di lavoro.

Ecco una panoramica di come il web scraping può rivoluzionare i risultati aziendali:

| Caso d’uso aziendale | Problema manuale | Soluzione con web scraping |

|---|---|---|

| Generazione di lead | Copia-incolla da decine di siti | Estrazione automatica, esportazione massiva |

| Monitoraggio prezzi | Controlli manuali quotidiani | Estrazioni programmate, notifiche istantanee |

| Ricerche di mercato | Leggere centinaia di recensioni | Dati aggregati e strutturati |

| Aggregazione contenuti | Unire dati da più siti | Esportazione unificata su Excel/Sheets |

| Analisi concorrenza | Dati lenti e incompleti | Insight completi e in tempo reale |

Il ritorno sull’investimento è tangibile: le aziende che usano strumenti moderni , e .

Come abbiamo scelto i migliori strumenti di web scraping

Non tutti gli strumenti di web scraping sono uguali. Alcuni sono pensati per chi non sa programmare e vuole risultati subito; altri sono veri e propri laboratori per sviluppatori che gestiscono progetti enormi. Ecco i criteri che ho usato per la selezione:

- Facilità d’uso: È accessibile anche a chi non programma? L’interfaccia è chiara?

- Scalabilità: Gestisce centinaia o milioni di pagine? Permette di automatizzare e programmare le estrazioni?

- Opzioni di esportazione: Si può esportare su Excel, Google Sheets, Airtable, Notion o tramite API?

- Supporto e community: Ci sono guide, tutorial e assistenza rapida?

- Prezzo e valore: Esiste una versione gratuita? I piani a pagamento sono trasparenti e convenienti?

- Funzionalità uniche: Estrazione con AI, scraping di sottopagine, integrazione API o flussi di lavoro visuali.

Ho anche associato ogni strumento allo scenario aziendale ideale, così puoi trovare quello che fa per te.

1. Thunderbit

è la mia prima scelta per chi cerca un Estrattore Web AI semplice e potente, senza complicazioni tecniche. Come estensione Chrome, Thunderbit è pensato per team di vendita, marketing, ecommerce e operations che vogliono dati strutturati e affidabili in pochi clic.

Cosa rende Thunderbit speciale? Semplicità e potenza:

- Suggerimento campi con AI: Clicca su “AI Suggerisci Campi” e Thunderbit analizza la pagina, propone colonne (Nome, Prezzo, Email, ecc.) e crea prompt di estrazione per ogni campo.

- Scraping di sottopagine: Vuoi più dettagli? L’AI di Thunderbit visita automaticamente le sottopagine (come pagine prodotto o profili) e arricchisce la tabella—senza configurazioni.

- Esportazione immediata: Invia i dati direttamente su Excel, Google Sheets, Airtable o Notion. L’esportazione è sempre gratuita.

- Scraping programmato: Automatizza estrazioni ricorrenti (ad esempio controlli prezzi giornalieri) con una semplice frase.

- Estrattori gratuiti di email, telefono e immagini: Estrai contatti o immagini da qualsiasi sito con un clic.

- AI Autofill: Lascia che l’AI compili i moduli online per te—ideale per flussi di lavoro ripetitivi.

Thunderbit è già scelto da oltre , e il permette di estrarre dati da 6 pagine (o 10 con il boost di prova). I piani a pagamento partono da soli 15$/mese per 500 crediti—perfetto per team di ogni dimensione.

Vuoi vedere Thunderbit in azione? Dai un’occhiata al nostro o visita il per guide e consigli.

2. Scrapy

è il framework open-source di riferimento per sviluppatori che vogliono il massimo controllo sui progetti di web scraping. Scritto in Python, permette di creare spider personalizzati per estrarre e processare dati su larga scala.

Perché gli sviluppatori amano Scrapy?

- Framework avanzato: Supporta crawling multi-livello, pipeline personalizzate e integrazione con API.

- Scalabile: Gestisce progetti di grandi dimensioni, richieste simultanee e scraping massivo ().

- Estendibile: Puoi aggiungere middleware per proxy, user agent o rendering JavaScript (con Splash).

- Community attiva: Tantissimi tutorial, plugin e supporto per casi avanzati.

Scrapy è perfetto per team con competenze Python che devono integrare lo scraping in pipeline dati o creare workflow robusti e ripetibili. È gratuito e open-source, ma richiede configurazione e manutenzione del codice.

3. Beautiful Soup

è una libreria Python molto amata dai principianti per la sua semplicità nell’analizzare HTML e XML. Se devi estrarre rapidamente dati da pagine statiche, è la soluzione perfetta.

Perché scegliere Beautiful Soup?

- Facile da imparare: Curva di apprendimento dolce e tantissime guide ().

- Parsing flessibile: Gestisce HTML disordinato o incompleto senza problemi.

- Ideale per piccoli progetti: Perfetta per script veloci, estrazioni una tantum o per imparare le basi del web scraping.

Limiti? Non è pensata per siti dinamici o su larga scala e non gestisce JavaScript. In questi casi, va abbinata a requests o Selenium—oppure si passa a Scrapy.

4. Octoparse

è uno strumento no-code pensato per tutti: dal freelance alla grande azienda. Grazie all’interfaccia drag-and-drop, puoi estrarre dati anche da siti complessi o dinamici senza scrivere codice.

Perché Octoparse piace agli utenti:

- Nessuna programmazione: Workflow visuale, selettori drag-and-drop e template pronti all’uso.

- Modalità cloud e locale: Puoi eseguire scraping dal desktop o nel cloud per lavori più rapidi e voluminosi.

- Gestione paginazione e contenuti dinamici: Estrae dati da pagine “Carica altro”, scroll infinito e siti AJAX.

- Opzioni di esportazione: Scarica in CSV, Excel, JSON, HTML o esporta su database ().

Il piano gratuito copre piccoli lavori, mentre quelli a pagamento partono da circa 75$/mese. È molto usato per ricerche di mercato, analisi della concorrenza e da chi vuole risultati senza programmare.

5. ParseHub

è uno strumento visuale che eccelle su siti dinamici e ricchi di JavaScript. Il suo builder consente di selezionare, ciclare e estrarre dati anche da pagine complesse.

I punti di forza di ParseHub:

- Selezione visuale dei dati: Clicca sugli elementi, cicla tra le liste e gestisci pagine annidate.

- Supporto contenuti dinamici: Estrae dati caricati da JavaScript, gestisce menu a tendina e clic automatici.

- Esportazione flessibile: Scarica in CSV, Excel, JSON o integra con Dropbox/Amazon S3 ().

- Piano gratuito: Fino a 5 progetti e 200 pagine per run; i piani a pagamento sbloccano più potenza.

ParseHub è ideale per utenti intermedi che vogliono flessibilità senza dover programmare. È molto usato per ecommerce, portali di lavoro e annunci immobiliari.

6. Import.io

è pensato per l’estrazione e la visualizzazione dati su scala enterprise. Offre un’interfaccia intuitiva, supporto avanzato e strumenti di analisi integrati.

Cosa distingue Import.io?

- Estrazione point-and-click: Nessun codice—basta selezionare i dati desiderati.

- Visualizzazione dati: Strumenti integrati per analizzare, creare grafici e condividere risultati.

- Funzionalità enterprise: Compliance, servizi gestiti e supporto ad alto volume.

- Esportazione e integrazione: Scarica in CSV, Excel o integra con Google Sheets e strumenti BI ().

Il prezzo è su misura per grandi aziende, quindi è ideale per chi ha esigenze di big data e budget adeguato.

7. Apify

è una piattaforma per automazione web e data extraction su larga scala. È molto apprezzata dagli sviluppatori per la possibilità di creare, eseguire e condividere “actor” (script preimpostati o personalizzati).

Perché scegliere Apify:

- Marketplace di actor: Oltre 200 scraper pronti per i siti più comuni, oppure puoi crearne di tuoi in JavaScript/Python.

- API-first: Integra i dati estratti direttamente nei tuoi flussi di lavoro o applicazioni.

- Esecuzione in cloud: Gestisci lavori su larga scala, programma task ricorrenti e controlla tutto da una dashboard ().

- Prezzi flessibili: Piano gratuito per piccoli lavori; paghi solo ciò che usi per progetti più grandi.

Apify è perfetto per team tecnici che vogliono automatizzare, scalare e integrare i dati web nei processi aziendali.

8. WebHarvy

è uno strumento visuale che rileva automaticamente i pattern dei dati nelle pagine web. Ideale per chi non programma e vuole risultati senza imparare XPath o CSS.

Le caratteristiche principali di WebHarvy:

- Rilevamento automatico dei pattern: Clicca su un campo e WebHarvy trova tutti gli elementi simili ().

- Supporto AJAX/JavaScript: Gestisce contenuti dinamici, immagini e estrazione basata su parole chiave.

- Opzioni di esportazione: Scarica in Excel, CSV, XML, JSON o SQL.

- Licenza una tantum: Paghi una volta e usi per sempre (con un anno di aggiornamenti/supporto).

WebHarvy è molto apprezzato da piccole imprese, ricercatori e freelance che preferiscono un approccio visuale e non hanno bisogno di automazioni avanzate.

9. Diffbot

è il gigante dell’estrazione dati web con AI. Grazie a machine learning e computer vision, trasforma qualsiasi pagina pubblica in dati strutturati—senza configurazioni manuali.

Cosa rende Diffbot unico?

- Estrazione guidata dall’AI: Riconosce e estrae automaticamente entità, relazioni e informazioni dalle pagine ().

- Knowledge Graph: Accesso a un enorme database aggiornato di persone, aziende, prodotti e altro.

- Accesso API: Integra i dati strutturati nelle tue app, ricerche o analisi ().

- Enterprise-ready: Utilizzato da Microsoft, Adobe, Hubspot e altri grandi player.

I prezzi partono da 299$/mese per startup, con opzioni pay-per-call per l’API (). È ideale per ricerca, data science aziendale e chi cerca precisione AI su larga scala.

Tabella comparativa degli strumenti di web scraping

Ecco una panoramica comparativa dei nove strumenti:

| Strumento | Ideale per | No-Code | AI Integrata | Per sviluppatori/API | Scraping sottopagine | Opzioni di esportazione | Prezzo (base) |

|---|---|---|---|---|---|---|---|

| Thunderbit | Utenti business | Sì | Sì | No | Sì | Excel, CSV, Sheets, Notion, Airtable | Gratis (6 pagine), $15/mese |

| Scrapy | Sviluppatori | No | No | Sì | Sì (custom) | CSV, JSON, XML, DB | Gratis, open-source |

| Beautiful Soup | Principianti/dev | No | No | Sì | No | Personalizzato (via Python) | Gratis, open-source |

| Octoparse | Non-coder, team | Sì | No | Parziale | Sì | CSV, Excel, JSON, DB | Gratis, $75/mese |

| ParseHub | Siti dinamici/visual | Sì | No | Parziale | Sì | CSV, Excel, JSON, S3, Dropbox | Gratis, $189/anno |

| Import.io | Enterprise/analytics | Sì | No | Sì | Sì | CSV, Excel, Sheets, BI tools | Personalizzato, enterprise |

| Apify | Dev, automazione | No | No | Sì | Sì | CSV, JSON, Sheets, API | Gratis, pay-as-you-go |

| WebHarvy | Non-coder, PMI | Sì | No | No | Sì | Excel, CSV, XML, JSON, SQL | $139/anno (una tantum) |

| Diffbot | AI, ricerca, enterprise | No | Sì | Sì | Sì (AI crawl) | JSON, Knowledge Graph API | $299/mese |

Come scegliere lo strumento di web scraping giusto per te

Quale scegliere? Ecco una guida veloce:

- Per chi non programma/utenti business: Thunderbit, Octoparse, ParseHub, WebHarvy

- Per sviluppatori/automazione: Scrapy, Beautiful Soup, Apify

- Per esigenze enterprise/AI: Import.io, Diffbot

- Per siti dinamici o ricchi di JavaScript: ParseHub, Octoparse, Apify

- Per esportazioni strutturate e immediate: Thunderbit, Import.io

Il mio consiglio? Parti dal tuo obiettivo e dal livello tecnico. Se vuoi scraping AI senza complicazioni e esportazione istantanea, è imbattibile. Se cerchi controllo totale o vuoi creare crawler personalizzati, Scrapy o Apify sono ottimi. Per big data o AI, Import.io e Diffbot sono i top di gamma.

Quasi tutti offrono versioni di prova gratuite—sperimenta e trova quello che si adatta meglio al tuo flusso di lavoro.

Domande frequenti

1. Cos’è uno strumento di web scraping e perché mi serve?

Un estrattore web è un software che raccoglie dati dai siti e li trasforma in formati strutturati come fogli di calcolo o database. Le aziende li usano per generare lead, monitorare prezzi, fare ricerche di mercato e molto altro—risparmiando tempo e aumentando la precisione rispetto al copia-incolla manuale.

2. Il web scraping è legale?

Il web scraping è legale se si estraggono dati pubblici e si rispettano i termini d’uso dei siti. Evita sempre di raccogliere dati personali o sensibili senza consenso e verifica le normative locali.

3. Qual è il miglior strumento di web scraping per chi non programma?

Thunderbit, Octoparse, ParseHub e WebHarvy sono ottimi per utenti non tecnici. Thunderbit si distingue per i suggerimenti AI dei campi e l’esportazione immediata su Excel, Google Sheets, Notion o Airtable.

4. Posso estrarre dati da siti dinamici o con molto JavaScript?

Certo! Strumenti come ParseHub, Octoparse e Apify sono pensati per gestire contenuti dinamici, AJAX e pagine “Carica altro”. Anche l’AI di Thunderbit si adatta a molti layout moderni.

5. Come scelgo lo strumento di web scraping giusto per la mia azienda?

Valuta le tue competenze tecniche, il volume di dati, le esigenze di esportazione e il budget. Se non programmi, inizia con Thunderbit o Octoparse; se sei sviluppatore, Scrapy o Apify sono ideali; per grandi aziende con esigenze di big data, guarda Import.io o Diffbot. Quasi tutti offrono prove gratuite—testane alcuni e scegli quello che funziona meglio per te.

Vuoi trasformare il web nel tuo prossimo vantaggio competitivo? o visita il nostro per altre guide e consigli. Buon scraping!

Scopri di più