Il web si espande più in fretta della mia voglia di caffè—e fidati, non è poco. Nel 2026, l’estrazione di dati dal web non è più una roba da smanettoni: è la base di tutto, dall’intelligenza aziendale all’addestramento AI, fino all’automazione. Che tu stia monitorando i trend di mercato, alimentando il tuo prossimo LLM o semplicemente cercando di non farti fregare dai prezzi dei concorrenti, la fame di dati web strutturati e aggiornati in tempo reale non è mai stata così forte. E chi c’è al centro di questa corsa all’oro digitale? Python. Grazie al suo ecosistema vastissimo e a una sintassi che capisci al volo, Python resta la scelta top per chi fa web scraping, sia che tu stia scrivendo uno script al volo sia che tu stia gestendo crawler da migliaia di pagine.

Ma qui viene il bello: scegliere i pacchetti python per web scraping giusti può fare la differenza tra un progetto che fila liscio e uno che ti fa venire voglia di lanciare il PC dalla finestra. Ho visto team perdere giorni a combattere con blocchi anti-bot usando lo strumento sbagliato, o sprecare ore a decifrare HTML incasinato quando bastava una libreria più furba. Dopo anni nel mondo SaaS, automazione e AI (e dopo aver creato per rendere il web scraping accessibile a tutti), ho selezionato le 12 migliori librerie python per web scraping del 2026—ognuna con i suoi punti di forza, le sue stranezze e i casi d’uso ideali. Scopriamole insieme e trova quella perfetta per la tua prossima avventura tra i dati.

Perché Scegliere il Pacchetto Python Giusto per il Web Scraping è Fondamentale

Parliamoci chiaro: non tutti i progetti di web scraping sono uguali. A volte ti basta tirare giù qualche prezzo da una pagina statica. Altre volte, invece, ti trovi davanti a un sito pieno di JavaScript, più testardo di un gatto che non vuole uscire da sotto il letto. Scegliere la libreria giusta ti fa risparmiare ore (o giorni), riduce gli errori e ti aiuta a evitare i classici problemi come blocchi anti-bot o HTML scritto coi piedi.

Python è così popolare per il web scraping non solo perché “va di moda”. Librerie come requests e urllib3 superano , e quasi tutti i migliori strumenti di scraping sono pensati prima di tutto per Python. Ma con grande potere arriva anche grande responsabilità: se scegli lo strumento sbagliato, rischi di ritrovarti bloccato su un progetto lento come una connessione 56k. Scegli bene, e avrai dati puliti e ordinati prima che il tuo caffè si raffreddi.

Come Abbiamo Selezionato i Migliori Pacchetti Python per il Web Scraping

Non ho pescato a caso da una lista su PyPI. Ecco i criteri che ho usato per valutare ogni pacchetto:

- Prestazioni & Concorrenza: Riesce a scaricare centinaia (o migliaia) di pagine in poco tempo?

- Facilità d’Uso: È adatto anche a chi inizia o serve essere un ninja del codice?

- Potenza di Parsing HTML: Sa gestire markup disastrati, supporta selettori XPath/CSS e rende l’estrazione dati una passeggiata?

- Supporto ai Contenuti Dinamici: Se la cava con siti pieni di JavaScript o solo con pagine statiche?

- Community & Documentazione: Ha una community attiva e guide decenti, o rischi di perderti su Stack Overflow?

- Casi d’Uso Ideali: È pensato per script veloci, crawler massicci o qualcosa a metà?

Ho tenuto conto anche dei feedback reali degli sviluppatori, dei benchmark più recenti e delle mie (a volte dolorose) esperienze sul campo. Ora, vediamo i protagonisti.

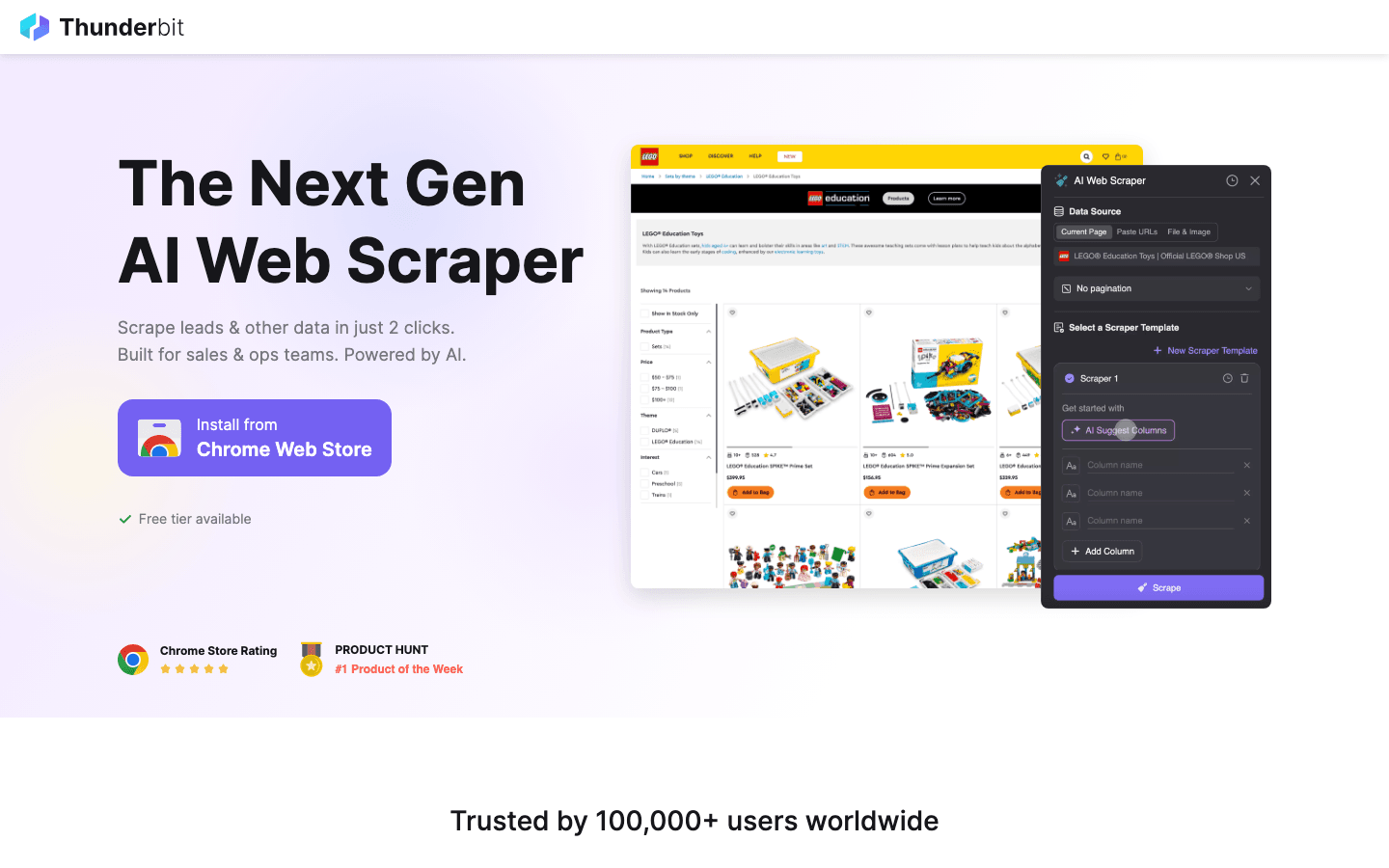

1. Thunderbit

non è la solita libreria Python: è un’estensione Chrome potenziata dall’AI che sta cambiando le regole del gioco, soprattutto per chi usa Python e vuole velocità, precisione e un tocco di intelligenza artificiale. Cosa rende Thunderbit speciale? Puoi dare istruzioni in linguaggio naturale all’AI su quali dati vuoi estrarre, e lei fa tutto: suggerisce i campi, naviga tra le sottopagine, gestisce la paginazione e ti permette di esportare direttamente su Excel, Google Sheets, Notion o Airtable.

non è la solita libreria Python: è un’estensione Chrome potenziata dall’AI che sta cambiando le regole del gioco, soprattutto per chi usa Python e vuole velocità, precisione e un tocco di intelligenza artificiale. Cosa rende Thunderbit speciale? Puoi dare istruzioni in linguaggio naturale all’AI su quali dati vuoi estrarre, e lei fa tutto: suggerisce i campi, naviga tra le sottopagine, gestisce la paginazione e ti permette di esportare direttamente su Excel, Google Sheets, Notion o Airtable.

Thunderbit è una manna per estrarre dati complessi e disordinati—tipo directory caotiche, elenchi di prodotti o siti dove l’HTML sembra un quadro astratto. La funzione AI Suggest Fields legge la pagina e ti propone le colonne migliori, mentre la Subpage Scraping arricchisce i tuoi dati visitando automaticamente le pagine di dettaglio collegate. E se sei stufo dei blocchi anti-bot, Thunderbit offre sia scraping via browser che in cloud.

Gli sviluppatori Python adorano Thunderbit per prototipazione rapida, lead generation e ricerche di mercato. Puoi usare i dati esportati direttamente nelle tue pipeline Python, o automatizzare i flussi di scraping tramite API. Non è una libreria di codice classica, ma sta diventando la scelta preferita per chi vuole passare meno tempo a scrivere codice e più tempo ad analizzare i dati.

Funzionalità principali:

- Suggerimento campi ed estrazione dati tramite AI

- Gestione di sottopagine, paginazione e anche PDF/immagini

- Esportazione in CSV, Excel, Google Sheets, Notion, Airtable

- Nessuna programmazione richiesta—perfetto sia per chi non sa programmare che per i professionisti Python che vogliono velocità

- Piano gratuito disponibile; le versioni a pagamento crescono con le tue esigenze

Ideale per: Lead generation, ricerche di mercato, prototipazione rapida e scraping di dati web complessi o disordinati.

2. Beautiful Soup

è la regina del parsing HTML in Python. Se sei alle prime armi o devi estrarre dati da pagine web statiche, è la tua migliore amica. Beautiful Soup brilla quando si tratta di navigare e interpretare HTML disordinato (“tag soup”), salvandoti quando i siti non seguono le regole.

è la regina del parsing HTML in Python. Se sei alle prime armi o devi estrarre dati da pagine web statiche, è la tua migliore amica. Beautiful Soup brilla quando si tratta di navigare e interpretare HTML disordinato (“tag soup”), salvandoti quando i siti non seguono le regole.

L’API è intuitiva—pensa a .find(), .select(), e .text—e si abbina alla perfezione con requests per scaricare le pagine. Sotto il cofano, puoi scegliere diversi parser (come lxml per la velocità o html5lib per la massima compatibilità). La documentazione è ottima e la community è enorme.

Funzionalità principali:

- API intuitiva e “pythonic” per navigare HTML/XML

- Gestisce markup rovinati o incoerenti senza problemi

- Supporta diversi parser per velocità o compatibilità

- Community enorme e tantissimi tutorial

Ideale per: Script veloci, scraping di pagine statiche e chi vuole imparare senza stress.

3. Scrapy

è il campione per il crawling automatizzato su larga scala. Se devi estrarre dati da centinaia o migliaia di pagine, gestire pipeline o programmare job ricorrenti, Scrapy è il framework che fa per te. Basato sul motore Twisted, è velocissimo e supporta crawling asincrono, pipeline per la pulizia dei dati ed esportazione integrata in JSON, CSV o database.

è il campione per il crawling automatizzato su larga scala. Se devi estrarre dati da centinaia o migliaia di pagine, gestire pipeline o programmare job ricorrenti, Scrapy è il framework che fa per te. Basato sul motore Twisted, è velocissimo e supporta crawling asincrono, pipeline per la pulizia dei dati ed esportazione integrata in JSON, CSV o database.

Scrapy è estendibile, con plugin per proxy, caching e anche un supporto limitato al rendering JavaScript (tramite Splash o Selenium). La curva di apprendimento è più ripida rispetto a Beautiful Soup, ma se vuoi fare scraping su larga scala, Scrapy è la scelta naturale.

Funzionalità principali:

- Crawling asincrono e ad alte prestazioni

- Pipeline integrate per pulizia e salvataggio dati

- Esportazione in vari formati (JSON, CSV, DB)

- Community ampia e ricco ecosistema di plugin

Ideale per: Progetti di scraping ricorrenti su larga scala, pipeline dati e chi cerca velocità e affidabilità.

4. Selenium

è lo strumento di riferimento per estrarre dati da siti dinamici o interattivi. Automatizza browser veri (Chrome, Firefox, ecc.), permettendoti di simulare azioni utente come click, scroll e invio di form. Se i dati che ti servono compaiono solo dopo l’esecuzione di JavaScript, Selenium può recuperarli—qualunque sia la complessità del sito.

è lo strumento di riferimento per estrarre dati da siti dinamici o interattivi. Automatizza browser veri (Chrome, Firefox, ecc.), permettendoti di simulare azioni utente come click, scroll e invio di form. Se i dati che ti servono compaiono solo dopo l’esecuzione di JavaScript, Selenium può recuperarli—qualunque sia la complessità del sito.

Il rovescio della medaglia? Selenium è lento e richiede molte risorse. Ogni scraping avvia un browser completo, quindi non aspettarti di processare migliaia di pagine al minuto. Ma per quei casi in cui nessun altro strumento funziona, Selenium è insostituibile.

Funzionalità principali:

- Automazione completa del browser (Chrome, Firefox, Edge, ecc.)

- Gestisce contenuti generati da JavaScript e elementi interattivi

- Supporta la modalità headless per scraping più veloce senza interfaccia grafica

- Community ampia e documentazione dettagliata

Ideale per: Siti dinamici e ricchi di JavaScript, automazione di login e gestione di CAPTCHA o interazioni complesse.

5. PyQuery

porta la sintassi di jQuery in Python, rendendo il parsing HTML familiare a chi ha già lavorato con jQuery in JavaScript. Si basa sul parser veloce

porta la sintassi di jQuery in Python, rendendo il parsing HTML familiare a chi ha già lavorato con jQuery in JavaScript. Si basa sul parser veloce lxml e ti permette di usare selettori CSS come $('div.classname') per trovare elementi.

PyQuery è ottimo per prototipazione rapida e per chi vuole codice conciso e leggibile. È più veloce di Beautiful Soup per query complesse e si integra facilmente con strumenti asincroni o Selenium per flussi di lavoro avanzati.

Funzionalità principali:

- Selettori e sintassi jQuery in Python

- Parsing veloce grazie a lxml

- Ideale per chi passa da JavaScript a Python

- Supporta chaining e query concise

Ideale per: Prototipazione, fan di jQuery e chi vuole scrivere meno codice per il parsing HTML.

6. LXML

è il fulmine del parsing HTML e XML in Python. Basato sulle librerie C

è il fulmine del parsing HTML e XML in Python. Basato sulle librerie C libxml2 e libxslt, è famoso per le sue prestazioni e il potente supporto a XPath e selettori CSS. Se lavori con documenti grandi o hai bisogno di query complesse, lxml è la scelta giusta.

Può essere usato direttamente o come backend per Beautiful Soup o PyQuery. L’API è un po’ più avanzata, ma la velocità e la flessibilità ripagano per i lavori più impegnativi.

Funzionalità principali:

- Parsing più veloce disponibile in Python

- Supporto completo a XPath e selettori CSS

- Gestisce documenti grandi e complessi in modo efficiente

- Usabile da solo o come parser per altre librerie

Ideale per: Parsing ad alte prestazioni, scraping su larga scala e progetti che richiedono query avanzate.

7. Requests

è lo standard per le richieste HTTP in Python. La sua API pulita e intuitiva rende il recupero delle pagine web semplice come

è lo standard per le richieste HTTP in Python. La sua API pulita e intuitiva rende il recupero delle pagine web semplice come requests.get(url). Gestisce cookie, sessioni e anche la decodifica JSON senza fatica.

Requests è sincrono (ogni richiesta aspetta la risposta), ma è perfetto per script veloci e scraping su piccola scala. Abbinalo a Beautiful Soup o lxml per un flusso di lavoro classico.

Funzionalità principali:

- API semplice e “pythonic” per richieste HTTP

- Gestisce cookie, sessioni e redirect

- Si integra perfettamente con le librerie di parsing

- Community enorme e documentazione completa

Ideale per: Script semplici, scraping di pagine statiche e chi vuole iniziare subito.

8. MechanicalSoup

è una libreria leggera che automatizza semplici interazioni con il browser—come compilare form o navigare tra più passaggi di login—senza avviare un browser completo. Si basa su

è una libreria leggera che automatizza semplici interazioni con il browser—come compilare form o navigare tra più passaggi di login—senza avviare un browser completo. Si basa su requests e Beautiful Soup, risultando molto più veloce e leggera di Selenium per siti che non dipendono troppo dal JavaScript.

Se devi fare login, inviare form o navigare tra poche pagine (e il sito non è troppo dinamico), MechanicalSoup è un’ottima via di mezzo.

Funzionalità principali:

- Automatizza la compilazione di form e la navigazione

- Basata su Requests e Beautiful Soup

- Leggera e veloce (senza overhead del browser)

- Facile da usare per interazioni moderate

Ideale per: Siti che richiedono login o invio di form, automazione semplice e chi vuole evitare il peso di Selenium.

9. Aiohttp

è il motore asincrono per richieste web ad alta velocità e concorrenza. Se devi estrarre dati da centinaia di pagine rapidamente, aiohttp ti permette di inviare richieste in parallelo, riducendo drasticamente i tempi. In un benchmark, estrarre 50 pagine ha richiesto solo 3 secondi con aiohttp, contro i 16 secondi delle richieste sincrone ().

è il motore asincrono per richieste web ad alta velocità e concorrenza. Se devi estrarre dati da centinaia di pagine rapidamente, aiohttp ti permette di inviare richieste in parallelo, riducendo drasticamente i tempi. In un benchmark, estrarre 50 pagine ha richiesto solo 3 secondi con aiohttp, contro i 16 secondi delle richieste sincrone ().

Aiohttp richiede di scrivere codice async def e usare await, ma i vantaggi in termini di velocità sono notevoli per lavori su larga scala.

Funzionalità principali:

- Framework HTTP client/server asincrono

- Supporta sessioni, cookie e HTTP/2

- Velocità elevata per richieste concorrenti

- Si integra con librerie di parsing asincrone

Ideale per: Scraping ad alta velocità e su larga scala, raccolta API e chi è a proprio agio con la programmazione asincrona.

10. Twisted

è il motore di rete event-driven che alimenta Scrapy. Anche se non è una libreria di scraping in senso stretto, gli utenti avanzati possono usarlo direttamente per creare crawler personalizzati, gestire protocolli non HTTP o implementare spider iper-concorrenti.

è il motore di rete event-driven che alimenta Scrapy. Anche se non è una libreria di scraping in senso stretto, gli utenti avanzati possono usarlo direttamente per creare crawler personalizzati, gestire protocolli non HTTP o implementare spider iper-concorrenti.

Twisted è potente ma ha una curva di apprendimento ripida. È ideale per scenari molto personalizzati o per chi vuole costruire framework da zero.

Funzionalità principali:

- Networking event-driven per HTTP, WebSockets, SSH e altro

- Supporta SSL, concorrenza e protocolli personalizzati

- Motore asincrono alla base di Scrapy

- Altamente flessibile per casi avanzati

Ideale per: Protocolli personalizzati, creazione di framework di scraping e utenti esperti che vogliono il massimo controllo.

11. Grab

è un toolkit all-in-one che combina richieste HTTP, parsing, automazione, rotazione proxy e gestione CAPTCHA. Simile a Scrapy nello spirito, punta a essere più semplice da imparare e usare, con supporto integrato per proxy, caching e spider asincroni.

è un toolkit all-in-one che combina richieste HTTP, parsing, automazione, rotazione proxy e gestione CAPTCHA. Simile a Scrapy nello spirito, punta a essere più semplice da imparare e usare, con supporto integrato per proxy, caching e spider asincroni.

La funzione di punta di Grab è il sistema Grab:Spider, che può gestire migliaia di richieste in parallelo usando multicurl. Se cerchi una soluzione completa con meno configurazione rispetto a Scrapy, Grab merita attenzione.

Funzionalità principali:

- Supporto integrato per proxy, rotazione user-agent e caching

- Sistema spider asincrono per alta concorrenza

- Parsing XPath e architettura modulare

- Usato in produzione per scraping su larga scala

Ideale per: Progetti di scraping all-in-one, attività con molti proxy e utenti che vogliono potenza senza la complessità di Scrapy.

12. Urllib3

è il motore HTTP di basso livello che alimenta molti client Python, incluso Requests. Offre pooling delle connessioni, thread safety, retry e controllo dettagliato sulle connessioni HTTP. La maggior parte degli sviluppatori lo usa indirettamente, ma urllib3 è la scelta giusta quando serve la massima performance o si stanno costruendo librerie di livello superiore.

è il motore HTTP di basso livello che alimenta molti client Python, incluso Requests. Offre pooling delle connessioni, thread safety, retry e controllo dettagliato sulle connessioni HTTP. La maggior parte degli sviluppatori lo usa indirettamente, ma urllib3 è la scelta giusta quando serve la massima performance o si stanno costruendo librerie di livello superiore.

Non è semplice come Requests, ma è collaudato e molto affidabile.

Funzionalità principali:

- Pooling delle connessioni e thread safety

- Controllo dettagliato sulle connessioni HTTP

- Base per molte altre librerie

- Alte prestazioni per richieste ripetute

Ideale per: Client HTTP personalizzati, crawler multi-thread e sviluppatori che lavorano sullo stack HTTP di Python.

Tabella Comparativa: Panoramica dei Pacchetti Python per il Web Scraping

| Pacchetto | Facilità d’Uso | Prestazioni | Contenuti Dinamici | Potenza di Parsing | Community/Docs | Ideale per |

|---|---|---|---|---|---|---|

| Thunderbit | ★★★★☆ (GUI/AI) | Veloce (cloud/local) | Sì (tramite AI) | Campi automatici, subpage | In crescita (trend AI) | Lead-gen, ricerche di mercato, no-code |

| Beautiful Soup | ★★★★★ (facile) | Media | No | HTML/XML, tollerante | Enorme | Pagine statiche, principianti |

| Scrapy | ★★☆☆☆ (ripida) | ★★★★★ (molto alta) | Solo plugin | CSS/XPath, pipelines | Grande, attiva | Scraping ricorrente su larga scala |

| Selenium | ★★☆☆☆ (media) | ★☆☆☆☆ (lenta) | Sì (completo) | DOM completo, JS | Matura | Siti JS, interattivi |

| PyQuery | ★★★★☆ (jQuery) | Veloce (lxml) | No* | Selettori jQuery | Media | Prototipazione, dev jQuery |

| LXML | ★★★☆☆ (avanzata) | ★★★★★ (più veloce) | No | XPath/CSS, XML | Media | Documenti grandi, query avanzate |

| Requests | ★★★★★ (molto facile) | ★★☆☆☆ (sincrona) | No | HTTP, JSON | Enorme | Script semplici, pagine statiche |

| MechanicalSoup | ★★★★☆ (facile) | ★★☆☆☆ (sincrona) | No | Form, navigazione | Piccola | Login, automazione form |

| Aiohttp | ★★☆☆☆ (async) | ★★★★★ (concorrente) | No | HTTP asincrono | Grande (async) | Scraping veloce e concorrente |

| Twisted | ★☆☆☆☆ (complessa) | ★★★★★ (custom) | No | Networking, protocolli | Di nicchia | Framework custom, utenti avanzati |

| Grab | ★★★☆☆ (modulare) | ★★★★☆ (async) | No | Proxy, XPath | Piccola | All-in-one, proxy/captcha intensivo |

| Urllib3 | ★★★★☆ (basso livello) | ★★★★☆ (pooled) | No | HTTP, pooling | Enorme | Client custom, crawler multi-thread |

*PyQuery può essere combinato con Selenium per siti dinamici.

Come Scegliere il Pacchetto Python Giusto per il Tuo Web Scraping

Quale pacchetto scegliere? Ecco una guida lampo:

- Pagine statiche, piccoli lavori o sei alle prime armi: Parti da Requests + Beautiful Soup.

- Scraping ricorrente, su larga scala o in produzione: Scrapy o Grab (per soluzioni all-in-one).

- Siti pieni di JavaScript o interattivi: Selenium (o Thunderbit se vuoi scraping AI e no-code).

- Scraping veloce e concorrente: Aiohttp (se ti piace l’async).

- Automazione di form o login: MechanicalSoup (per siti semplici), Selenium (per JS complesso).

- Parsing avanzato o documenti enormi: LXML o PyQuery.

- Networking/protocolli personalizzati: Twisted.

- Prototipazione rapida, lead-gen o dati disordinati: Thunderbit.

E non aver paura di combinare più strumenti—molti workflow uniscono queste librerie per la massima efficienza. Ad esempio, puoi usare Selenium per renderizzare una pagina e poi passare l’HTML a Beautiful Soup o PyQuery per il parsing.

Conclusione: Potenzia il Tuo Web Scraping con i Giusti Strumenti Python

Fare web scraping nel 2026 è più potente—e più indispensabile—che mai. Con i giusti pacchetti Python, puoi trasformare il caos del web in dati puliti e utili per il tuo business, la ricerca o la prossima grande idea. Che tu sia uno sviluppatore esperto o stia solo iniziando, in questa lista troverai lo strumento adatto a te.

Vuoi vedere come funziona lo scraping AI e no-code? . E se cerchi altri consigli, approfondimenti e tutorial, visita il per restare aggiornato su web scraping, automazione e flussi di lavoro data-driven.

Buon scraping—che i tuoi selettori trovino sempre il target giusto, i proxy non ti mollino mai e i tuoi dati siano puliti come il tuo codice.

Domande Frequenti

1. Qual è il miglior pacchetto Python per il web scraping per principianti?

Per la maggior parte dei principianti, la combo e è il modo più semplice per iniziare. Entrambi hanno API intuitive, tantissimi tutorial e coprono la maggior parte delle esigenze di scraping su pagine statiche.

2. Come posso estrarre dati da siti web ricchi di JavaScript con Python?

Usa per automatizzare un browser vero, oppure prova per uno scraping AI e no-code che gestisce anche contenuti dinamici. Per esigenze su larga scala, Scrapy può essere integrato con Splash o Selenium.

3. Qual è il pacchetto migliore per scraping su larga scala e ad alta velocità?

è pensato per crawling asincrono su larga scala. Se vuoi ancora più velocità e ti piace l’async, è una delle migliori scelte per richieste concorrenti.

4. Posso combinare questi pacchetti nel mio workflow?

Certo! Molti sviluppatori usano Requests o Selenium per scaricare le pagine, poi fanno il parsing con Beautiful Soup, lxml o PyQuery. Gli export di Thunderbit possono essere usati in script Python per analisi extra.

5. Thunderbit è una libreria Python o uno strumento indipendente?

Thunderbit è un’estensione Chrome e una piattaforma AI, non una libreria Python classica. Però i suoi output (CSV, Excel, Sheets, Notion, Airtable) si integrano facilmente nelle pipeline Python, rendendolo un alleato potente per chi sviluppa in Python.

Vuoi restare aggiornato sul mondo del web scraping? Iscriviti al e tieni d’occhio il per guide, confronti e consigli sull’automazione.

Scopri di più