Ogni singolo giorno, da qualche parte online, vengono pubblicati tra i 2 e i 3 milioni di articoli di news. Cercare di raccogliere questi dati in modo strutturato — titoli, date, fonti, testo completo degli articoli — è più o meno piacevole come montare un mobile senza istruzioni.

Da anni costruisco e testo strumenti di automazione in , e il panorama del news scraping nel 2026 è un mix strano di opportunità incredibili e frustrazione autentica. Google ha chiuso la sua API ufficiale News nel 2011, i siti di news adottano misure anti-bot sempre più aggressive (Cloudflare, CAPTCHA, barriere di rendering JavaScript), e i layout cambiano così spesso che uno scraper che funziona di lunedì può rompersi entro mercoledì. Nel frattempo, i team business — dalle PR alle vendite, fino ai ricercatori accademici e agli ingegneri AI — hanno bisogno di dati news strutturati più che mai.

Così ho deciso di testare 15 strumenti per il news scraping tra API, piattaforme no-code e librerie open source. L’obiettivo: darti un confronto normalizzato su prezzi, manutenzione, estrazione pulita del testo e reale aderenza ai casi d’uso, qualcosa che nessun’altra guida offre.

Cosa fa davvero emergere i migliori news scraper nel 2026?

La maggior parte degli articoli sui “migliori news scraper” salta del tutto i criteri di valutazione, quindi ecco quelli che ho testato davvero. Molti articoli sui “migliori news scraper” si limitano a elencare funzioni e andare avanti. Ma dopo anni passati a costruire infrastrutture di scraping, ho imparato che i criteri che contano per gli utenti business sono specifici — e spesso trascurati.

Ecco il framework di valutazione che ho usato:

| Criterio | Cosa ho valutato |

|---|---|

| Approccio | API, strumento browser no-code o libreria open source |

| Gestione anti-bot | Rotazione proxy, risoluzione CAPTCHA, supporto al browser headless |

| Estrazione pulita del testo | Riesce a rimuovere pubblicità, sidebar e navigazione e restituire solo il corpo dell’articolo? |

| Output dei metadati | Autore, data, immagini, URL sorgente, categoria |

| Formati di esportazione | CSV, JSON, Google Sheets, Airtable, Notion, ecc. |

| Paginazione / supporto bulk | Riesce a gestire risultati su più pagine e URL in batch? |

| Carico di manutenzione | Si rompe quando cambiano i layout dei siti? AI-adaptive vs. basato su selettori |

| Costo normalizzato per 1.000 risultati | Prezzi confrontati in modo omogeneo (incluso il piano gratuito) |

| Caso d’uso ideale | Monitoraggio PR, lead gen, ricerca accademica, pipeline LLM, ecc. |

Due criteri meritano un po’ di contesto in più. Il costo normalizzato per 1.000 risultati conta perché ogni fornitore calcola i prezzi in modo diverso — per credito, per richiesta, per ricerca, per riga. Senza normalizzazione, stai confrontando mele con sottomarini. E il carico di manutenzione è il problema più grande che sento dagli utenti. Forum dopo forum, il lamento è sempre lo stesso: “i siti news adorano rompere i miei crawler ogni martedì”. Ho valutato ogni strumento su una scala a tre livelli:

- 🟢 Bassa manutenzione: AI-adaptive o API completamente gestita — i cambi di layout non rompono il flusso di lavoro

- 🟡 Manutenzione media: gestisce l’anti-bot, ma la logica di estrazione può comunque rompersi

- 🔴 Alta manutenzione: basato su selettori — quando il sito cambia, devi sistemarlo manualmente

Quale news scraper si adatta al tuo ruolo? Una matrice decisionale

Le raccomandazioni sugli scraper trattano quasi sempre tutti i lettori allo stesso modo, ed è proprio questo il problema. Un responsabile PR che monitora le brand mention ha esigenze completamente diverse da uno sviluppatore Python che costruisce una pipeline RAG. Quindi, prima dell’elenco completo, ecco un framework rapido:

| Caso d’uso | Approccio migliore | Strumenti consigliati |

|---|---|---|

| Riepilogo quotidiano delle news (non tecnico) | Strumento browser no-code o RSS | Thunderbit, Octoparse, ParseHub |

| Monitoraggio PR / media su larga scala | News API con alert | Newscatcher, Webz.io, Newsdata.io |

| Estrazione di lead commerciali dalle news | AI scraper con arricchimento delle sottopagine | Thunderbit (scraping delle sottopagine + estrazione email/telefono), Apify |

| Ricerca accademica / costruzione di corpus | Libreria open source | Newspaper4k |

| Pipeline LLM / ingestion RAG | API di distillazione in Markdown | Thunderbit API, ScraperAPI |

| Competitive intelligence / pricing | Scraping programmato | Thunderbit (Scheduled Scraper), Bright Data |

Hai già capito in quale casella rientri? Vai avanti. Altrimenti, il riepilogo completo qui sotto ti aiuterà.

I 15 migliori news scraper a colpo d’occhio

Ecco il confronto principale — prezzi normalizzati in costo per 1.000 risultati al livello a pagamento più basso, manutenzione valutata sulla scala a tre livelli.

| Strumento | Tipo | Piano gratuito | Costo per 1K risultati (stima) | Anti-bot | Testo pulito | Manutenzione | Caso d’uso ideale |

|---|---|---|---|---|---|---|---|

| Thunderbit | AI no-code (estensione Chrome + cloud) | 6 pagine/mese gratis | ~$3–$15 | Forte (modalità browser + cloud) | Sì (AI + sottopagine) | 🟢 Bassa | Team business, lead gen, monitoraggio quotidiano |

| SerpApi | API | 250 ricerche/mese | ~$15 | Forte (specifico per SERP) | No (solo snippet) | 🟢 Bassa | Dashboard Google News SERP |

| ScraperAPI | API | 1.000 crediti/mese | ~$1–$5 | Forte (proxy + rendering JS) | No (HTML grezzo) | 🟡 Media | Sviluppatori che vogliono infrastruttura anti-bot |

| Newsdata.io | News API | 200 richieste/giorno | ~$5–$15 | N/A (API gestita) | Parziale (premium) | 🟢 Bassa | Metadati news strutturati |

| Apify | Piattaforma cloud | $5 di crediti gratis | ~$1–$6 | Forte | Variabile in base all’actor | 🟡 Media | Workflow cloud personalizzati |

| Oxylabs | API enterprise | Trial da 2.000 risultati | ~$0.50–$2 | Molto forte | Parziale | 🟢 Bassa | SERP + web su scala enterprise |

| ScrapingBee | API | Crediti di prova | ~$2–$5 | Forte (Chrome headless) | Parziale (base) | 🟡 Media | Siti news molto pesanti in JS |

| Scrapingdog | API SERP | 1.000 crediti | ~$0.10–$0.50 | Forte | No (dati SERP) | 🟢 Bassa | Monitoraggio SERP con budget limitato |

| Bright Data | Piattaforma enterprise | Trial da 1.000 richieste | ~$0.30–$0.50 | Molto forte | Sì (News Scraper) | 🟢 Bassa | Dati news enterprise su larga scala |

| Octoparse | Desktop + cloud no-code | Piano gratuito limitato | ~$5–$10 (ammortizzato) | Forte | Sì (con template) | 🟡 Media | Scraping visuale no-code |

| ParseHub | Desktop no-code | 5 progetti, 200 pagine/esecuzione | ~$5–$12 (ammortizzato) | Moderato | Sì (con configurazione) | 🔴 Alta | Principianti, piccoli progetti |

| Newscatcher | News API | Nessun piano gratuito pubblico | Personalizzato (enterprise) | N/A (API gestita) | Sì (arricchito NLP) | 🟢 Bassa | Monitoraggio PR/media |

| Webz.io | Piattaforma di dati news | Nessun piano gratuito self-serve | Personalizzato (enterprise) | N/A (feed gestito) | Sì (testo completo + metadati) | 🟢 Bassa | Archivi storici, training LLM |

| Newspaper4k | Python open source | Gratis | $0 (+ costi server) | Nessuno | Sì (appositamente progettato) | 🔴 Alta | Sviluppatori, costruzione di corpus |

| HasData | API SERP | Crediti gratis | ~$0.25–$0.60 | Forte | No (dati SERP) | 🟢 Bassa | Endpoint SERP news economico |

Conclusioni rapide: Scrapingdog e HasData sono le opzioni API più economiche per richiesta. Thunderbit e Newspaper4k sono in testa per il testo pulito degli articoli (in modi molto diversi). Bright Data e Oxylabs dominano la fascia enterprise. Problemi di manutenzione? Resta sugli strumenti 🟢.

1. Thunderbit — Miglior news scraper AI no-code per team business

è lo strumento che il mio team e io abbiamo costruito appositamente per risolvere il problema: “mi servono dati da questo sito e non voglio scrivere codice o mantenere selettori”. Per il news scraping, il flusso è semplice quanto si possa immaginare: apri una pagina news, fai clic su AI Suggest Fields, controlla le colonne che Thunderbit propone (titolo, data, fonte, URL, riepilogo — legge la struttura della pagina e capisce cosa c’è), poi fai clic su Scrape.

è lo strumento che il mio team e io abbiamo costruito appositamente per risolvere il problema: “mi servono dati da questo sito e non voglio scrivere codice o mantenere selettori”. Per il news scraping, il flusso è semplice quanto si possa immaginare: apri una pagina news, fai clic su AI Suggest Fields, controlla le colonne che Thunderbit propone (titolo, data, fonte, URL, riepilogo — legge la struttura della pagina e capisce cosa c’è), poi fai clic su Scrape.

Alcune funzionalità si combinano per rendere Thunderbit particolarmente forte per le news:

- Estrazione AI-adaptive: nessun selettore CSS da scrivere o mantenere. L’AI legge ogni volta il layout attuale della pagina, quindi quando un sito news si ridisegna (e lo fanno tutti), il tuo scraper non si rompe.

- Scraping delle sottopagine: dopo aver estratto un elenco di link agli articoli, puoi fare clic su Scrape Subpages per visitare ogni articolo ed estrarre il testo completo, l’autore, la data di pubblicazione e le immagini. È così che ottieni contenuti puliti dell’articolo, non solo i titoli.

- Field AI Prompt: puoi istruire l’AI colonna per colonna — per esempio, “estrae solo il corpo principale dell’articolo, escludi navigazione e annunci” oppure “classifica il sentiment di questo articolo come positivo, neutro o negativo”. È una funzione unica tra gli strumenti no-code ed è incredibilmente utile per l’analisi delle news.

- Browser Scraping vs. Cloud Scraping: la modalità browser usa la tua sessione personale (utile per i siti che bloccano gli IP cloud), mentre la modalità cloud può elaborare fino a 50 pagine alla volta per velocità.

- Scheduled Scraper: imposta esecuzioni giornaliere o settimanali con intervalli temporali in linguaggio naturale — perfetto per il monitoraggio continuo delle news.

- Esporta ovunque: Excel, CSV, Google Sheets, Airtable, Notion — supportati tutti.

Prezzi e limitazioni

Thunderbit offre un piano gratuito (6 pagine/mese) e una prova di 10 pagine. I piani a pagamento partono da circa per 500 crediti (1 credito = 1 riga). L’estensione Chrome è necessaria per la modalità browser. Le funzioni AI consumano crediti, quindi un uso intenso su migliaia di articoli richiederà un piano a pagamento — ma per la maggior parte dei team business che fanno monitoraggio quotidiano o ricerca settimanale, il costo è contenuto.

Manutenzione: 🟢 Bassa. L’AI legge la pagina ogni volta da zero.

Ideale per: team non tecnici di sales, PR e operations che vogliono dati news quotidiani senza costruire o mantenere scraper.

Per uno sguardo più approfondito su come Thunderbit gestisce , consulta la nostra guida.

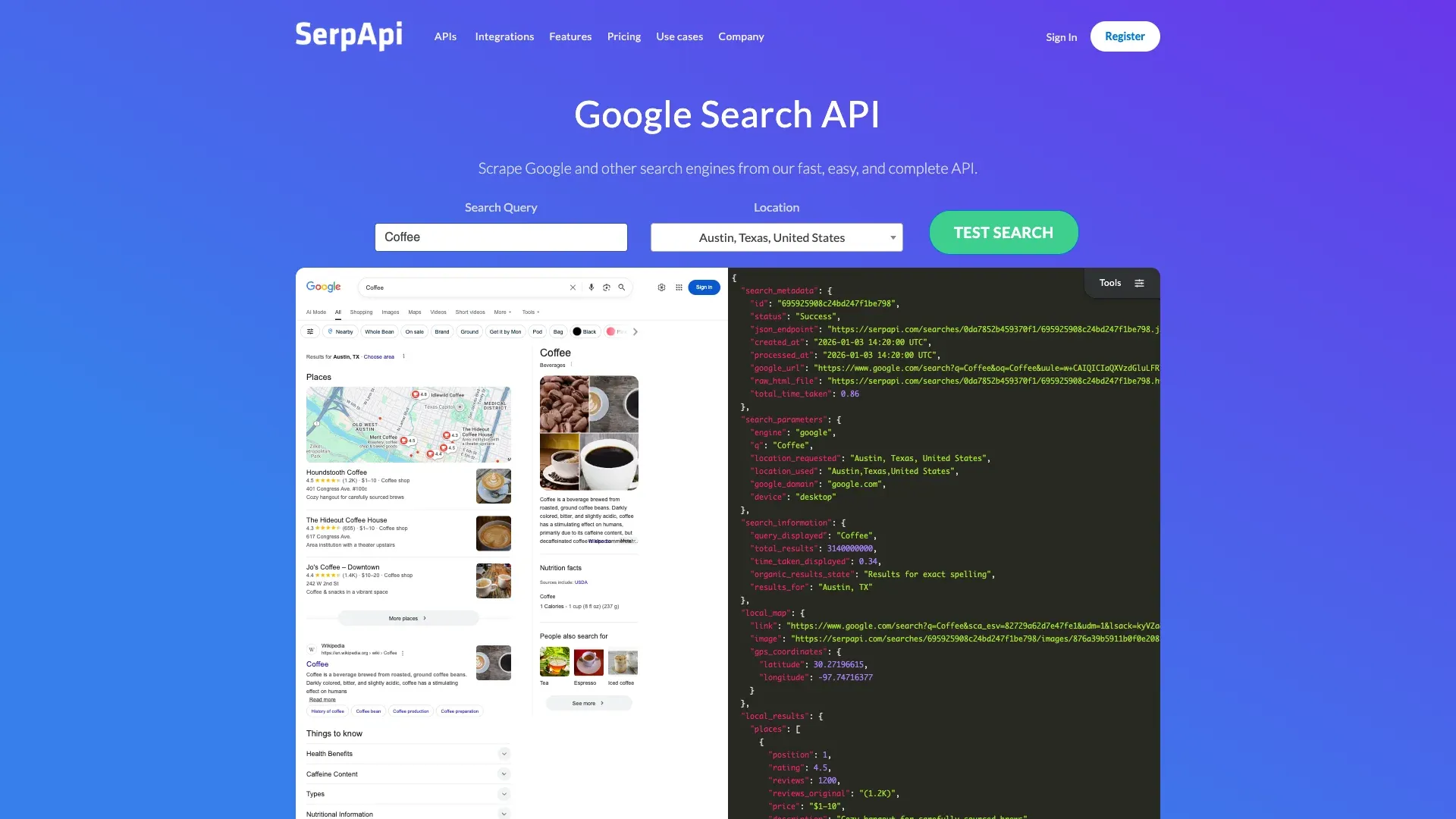

2. SerpApi — Il migliore per dati strutturati SERP di Google News

è un’API specifica per SERP che restituisce JSON strutturato dai risultati di Google News. Se il tuo caso d’uso è “dammi i primi risultati di Google News per una keyword, già strutturati e pronti per una dashboard”, SerpApi è una scelta solida. Restituisce titoli, fonte, data, snippet e miniature — ma non il testo completo dell’articolo. Servirebbe un passaggio separato (o un altro strumento) per ottenere il corpo vero e proprio.

è un’API specifica per SERP che restituisce JSON strutturato dai risultati di Google News. Se il tuo caso d’uso è “dammi i primi risultati di Google News per una keyword, già strutturati e pronti per una dashboard”, SerpApi è una scelta solida. Restituisce titoli, fonte, data, snippet e miniature — ma non il testo completo dell’articolo. Servirebbe un passaggio separato (o un altro strumento) per ottenere il corpo vero e proprio.

Funzioni principali:

- Output JSON strutturato dalle SERP di Google News

- Anti-detection gestita lato loro (specifica per SERP)

- Supporta più località e lingue di Google News

Prezzi: piano gratuito con 250 ricerche/mese. I piani a pagamento partono da 75 $/mese per 5.000 ricerche — circa 15 $ per 1.000 risultati.

Limite: restituisce solo snippet. Se ti serve il testo completo dell’articolo, SerpApi è il primo passaggio, non l’intera pipeline.

Manutenzione: 🟢 Bassa (API gestita, loro gestiscono i cambiamenti di Google).

Ideale per: sviluppatori che costruiscono dashboard di monitoraggio news o alimentano strumenti di analytics con dati SERP.

3. ScraperAPI — Miglior API di scraping economica con rotazione proxy

è un’API di scraping generica, non specifica per le news, ma efficace per recuperare pagine news. Il suo valore principale è la rotazione proxy, il rendering JavaScript e la gestione dei CAPTCHA — l’infrastruttura anti-bot che altrimenti dovresti costruire da solo.

è un’API di scraping generica, non specifica per le news, ma efficace per recuperare pagine news. Il suo valore principale è la rotazione proxy, il rendering JavaScript e la gestione dei CAPTCHA — l’infrastruttura anti-bot che altrimenti dovresti costruire da solo.

Funzioni principali:

- Rotazione proxy con IP residential e datacenter

- Rendering JavaScript per siti news dinamici

- Gestione CAPTCHA

- Restituisce HTML grezzo — il contenuto dell’articolo lo analizzi tu

Prezzi: piano gratuito con 1.000 crediti/mese (più crediti di prova). Il rendering JS costa più crediti per richiesta. I piani a pagamento partono da 49 $/mese. Il costo normalizzato è circa 1–5 $ per 1.000 richieste, a seconda dell’uso del JS.

Limite: nessun parsing integrato dell’articolo. Ottieni HTML, non testo pulito. Abbinalo a Newspaper4k o a un parser tuo per l’estrazione degli articoli.

Manutenzione: 🟡 Media (gestisce l’anti-bot, ma la logica di estrazione è tua).

Ideale per: sviluppatori che vogliono infrastruttura anti-bot senza costruire una propria rete proxy.

4. Newsdata.io — Miglior News API dedicata per metadati strutturati

è una News API costruita apposta che copre . Restituisce dati strutturati — titolo, descrizione, fonte, data, categorie, sentiment — e il testo completo degli articoli nei piani premium.

è una News API costruita apposta che copre . Restituisce dati strutturati — titolo, descrizione, fonte, data, categorie, sentiment — e il testo completo degli articoli nei piani premium.

Funzioni principali:

- Query per keyword, categoria, lingua, paese

- Analisi del sentiment inclusa

- Archivio news storico (piani a pagamento)

- Nessuna infrastruttura di scraping da gestire

Prezzi: piano gratuito con 200 richieste/giorno e campi limitati. I piani a pagamento sbloccano contenuti completi e dati storici. Il costo per 1.000 risultati dipende dal livello del piano ma si colloca nell’intervallo 5–15 $.

Limite: copre solo le fonti indicizzate da loro — non puoi puntarlo a un URL arbitrario e dire “scrapa questo”. Se una pubblicazione di nicchia non è nel loro indice, non la troverai qui.

Manutenzione: 🟢 Bassa (News API completamente gestita).

Ideale per: team che hanno bisogno di metadati news strutturati e non vogliono gestire alcuna infrastruttura di scraping.

5. Apify — Miglior piattaforma cloud per workflow personalizzati di news scraping

è una piattaforma cloud basata su actor con scraper predefiniti per Google News, pubblicazioni specifiche ed estrazione generica degli articoli. Sta nel punto giusto tra no-code e sviluppo completamente personalizzato.

è una piattaforma cloud basata su actor con scraper predefiniti per Google News, pubblicazioni specifiche ed estrazione generica degli articoli. Sta nel punto giusto tra no-code e sviluppo completamente personalizzato.

Funzioni principali:

- Actor già pronti per Google News, estrazione articoli e altro

- Supporto per rendering JavaScript ed esecuzione headless browser

- Esecuzione cloud con pianificazione

- Export in JSON, CSV, Excel, XML e altro

Prezzi: piano gratuito con . Livelli a pagamento a 49, 499 e 999 $/mese. Il costo per 1.000 risultati varia in base all’actor — circa 1–6 $ per gli actor di news scraping.

Limite: gli actor predefiniti sono mantenuti dalla community e possono rompersi quando i siti news cambiano. Richiede più configurazione rispetto ai veri strumenti no-code.

Manutenzione: 🟡 Media (gli actor possono richiedere aggiornamenti quando i siti cambiano).

Ideale per: team che vogliono esecuzione cloud e si sentono a loro agio nel scegliere e configurare actor dal marketplace.

6. Oxylabs — Miglior infrastruttura di scraping di livello enterprise

è un servizio di scraping enterprise con una pool di oltre 100 milioni di proxy, risoluzione CAPTCHA e rendering browser. La loro SERP Scraper API gestisce i risultati di Google News con geo-targeting, mentre la Web Scraper API funziona per pagine news arbitrarie.

è un servizio di scraping enterprise con una pool di oltre 100 milioni di proxy, risoluzione CAPTCHA e rendering browser. La loro SERP Scraper API gestisce i risultati di Google News con geo-targeting, mentre la Web Scraper API funziona per pagine news arbitrarie.

Funzioni principali:

- Infrastruttura proxy enorme con geo-targeting

- SERP Scraper API per Google News

- Web Scraper API per URL arbitrari

- Output JSON/CSV, richieste concorrenti su larga scala

Prezzi: parte da 49 $/mese per dati SERP. Prezzi enterprise personalizzati per volumi elevati. Prova gratuita fino a 2.000 risultati.

Limite: costoso per i team piccoli. Progettato principalmente per operazioni su larga scala.

Manutenzione: 🟢 Bassa (API enterprise completamente gestita).

Ideale per: aziende che hanno bisogno di dati news ad alto volume e geo-targettizzati con affidabilità enterprise.

7. ScrapingBee — Il migliore per siti news pesanti in JavaScript

è un’API di scraping focalizzata sul rendering JavaScript con esecuzione reale del browser. Se il sito news che ti serve carica i contenuti via JS lato client (e molti siti moderni lo fanno), ScrapingBee lo gestisce bene.

è un’API di scraping focalizzata sul rendering JavaScript con esecuzione reale del browser. Se il sito news che ti serve carica i contenuti via JS lato client (e molti siti moderni lo fanno), ScrapingBee lo gestisce bene.

Funzioni principali:

- Chrome headless con rotazione proxy

- Gestione CAPTCHA

- Funzione base di “Article Extraction” per alcune pagine

- Restituisce HTML grezzo, JSON o output in stile Markdown

Prezzi: piani da . A crediti, con costo maggiore per il rendering JS. Crediti di prova disponibili.

Limite: la funzione di estrazione articoli è basilare rispetto alle alternative basate su AI. Restituisce soprattutto HTML — per la maggior parte dei flussi dovrai comunque fare parsing.

Manutenzione: 🟡 Media (gestisce l’anti-bot, ma l’estrazione richiede configurazione da parte dell’utente).

Ideale per: sviluppatori che fanno scraping di siti news molto pesanti in JS e vogliono HTML renderizzato senza gestire browser headless.

8. Scrapingdog — Miglior API SERP economica per le news

è un’API SERP economica con un endpoint dedicato a Google News. I tempi di risposta sono rapidi (circa 2 secondi per richiesta nei test) e i prezzi sono i più competitivi di questa lista per le opzioni API.

è un’API SERP economica con un endpoint dedicato a Google News. I tempi di risposta sono rapidi (circa 2 secondi per richiesta nei test) e i prezzi sono i più competitivi di questa lista per le opzioni API.

Funzioni principali:

- Endpoint dedicato a Google News

- Output JSON strutturato (titoli, fonte, data, snippet)

- Tempi di risposta rapidi

Prezzi: parte da 40 $/mese per 400.000 richieste — circa 0,10 $ per 1.000 risultati, un prezzo davvero basso. Piano gratuito con 1.000 crediti.

Limite: restituisce solo dati SERP (titoli, snippet), non il contenuto completo dell’articolo. Stesso compromesso di SerpApi, ma a una frazione del prezzo.

Manutenzione: 🟢 Bassa (API SERP gestita).

Ideale per: sviluppatori attenti al budget che hanno bisogno di dati SERP di Google News su larga scala.

9. Bright Data — Il migliore per dati news enterprise su larga scala

è il peso massimo enterprise. La loro piattaforma include un prodotto dedicato News Scraper, una vasta infrastruttura proxy, risoluzione CAPTCHA, rendering browser e consegna downstream verso S3, Snowflake e altro.

è il peso massimo enterprise. La loro piattaforma include un prodotto dedicato News Scraper, una vasta infrastruttura proxy, risoluzione CAPTCHA, rendering browser e consegna downstream verso S3, Snowflake e altro.

Funzioni principali:

- Prodotto dedicato News Scraper

- Dataset predefiniti e raccolta in tempo reale

- Gestione automatica dei proxy e risoluzione CAPTCHA

- Raccolta programmata e alert

- Export in JSON, CSV, NDJSON, S3, Snowflake, GCS, Azure, SFTP

Prezzi: da circa con pagamento a consumo. Sono disponibili piani enterprise personalizzati. Trial da 1.000 richieste.

Limite: struttura di prezzo complessa con impegni minimi. Pensato soprattutto per budget enterprise.

Manutenzione: 🟢 Bassa (gestione enterprise, alta affidabilità).

Ideale per: grandi organizzazioni che hanno bisogno di pipeline affidabili e ad alto volume per dati news.

10. Octoparse — Miglior scraper visuale no-code per pagine news

Octoparse è un’app desktop con un builder visuale point-and-click. Ha template predefiniti per i siti news più comuni, gestisce paginazione e scroll infinito e offre esecuzione cloud per i run programmati.

Octoparse è un’app desktop con un builder visuale point-and-click. Ha template predefiniti per i siti news più comuni, gestisce paginazione e scroll infinito e offre esecuzione cloud per i run programmati.

Funzioni principali:

- Builder visuale point-and-click

- Template predefiniti per siti news

- Esecuzione cloud con pianificazione

- Rotazione IP e risoluzione CAPTCHA automatica

- Export in Excel, CSV, JSON, database, Google Sheets

Prezzi: piano gratuito con 10 task e 50.000 export/mese. Piani a pagamento da circa 89 $/mese.

Limite: l’estrazione basata su selettori significa che gli scraper si rompono quando i siti news aggiornano i layout. Richiede correzioni manuali — e i siti news aggiornano spesso i layout.

Manutenzione: 🟡 Media (i template aiutano, ma i selettori possono comunque rompersi).

Ideale per: utenti che vogliono un builder visuale no-code e non hanno problemi con una manutenzione occasionale dei template.

11. ParseHub — Miglior opzione no-code gratuita per principianti

ParseHub è uno scraper visuale point-and-click con un generoso piano gratuito. Gestisce contenuti renderizzati in JavaScript e funziona bene per progetti di ricerca una tantum o per estrazioni news su piccola scala.

ParseHub è uno scraper visuale point-and-click con un generoso piano gratuito. Gestisce contenuti renderizzati in JavaScript e funziona bene per progetti di ricerca una tantum o per estrazioni news su piccola scala.

Funzioni principali:

- Selezione visuale degli elementi (senza codice)

- Gestisce pagine renderizzate in JavaScript

- Export in CSV/JSON

- Piano gratuito: 5 progetti, 200 pagine per esecuzione

Prezzi: piano gratuito con 5 progetti e 200 pagine/run. Piani a pagamento da 189 $/mese.

Limite: basato su selettori CSS, quindi gli scraper si rompono spesso quando i layout cambiano. Scalabilità limitata e più lento degli strumenti API. Gli utenti su Reddit e nei forum sottolineano costantemente la curva di apprendimento e la fragilità.

Manutenzione: 🔴 Alta (i selettori si rompono spesso, niente adattamento AI).

Ideale per: principianti che fanno piccoli progetti di ricerca news una tantum e vogliono un punto di partenza gratuito.

12. Newscatcher — Miglior News API per PR e monitoraggio media

è una News API dedicata alla raccolta di contenuti news che copre . È progettata appositamente per media monitoring, PR tracking e trend analysis, con campi arricchiti da NLP come sentiment, summary ed estrazione di entità.

è una News API dedicata alla raccolta di contenuti news che copre . È progettata appositamente per media monitoring, PR tracking e trend analysis, con campi arricchiti da NLP come sentiment, summary ed estrazione di entità.

Funzioni principali:

- Copertura di oltre 70.000 fonti

- Arricchimenti NLP: sentiment, summary, estrazione entità, deduplica, clustering

- Query per keyword, topic, fonte, lingua, paese

- Accesso all’archivio storico

Prezzi: pricing enterprise (preventivi personalizzati). Nessun piano gratuito pubblico per i test, anche se potrebbero offrire trial su richiesta.

Limite: il pricing orientato all’enterprise può essere fuori portata per i team piccoli. Nessun piano gratuito self-serve.

Manutenzione: 🟢 Bassa (API completamente gestita).

Ideale per: team PR e media monitoring in aziende medio-grandi.

13. Webz.io — Migliore per archivi storici di news e dati di training LLM

è una piattaforma di dati news con un archivio storico enorme — miliardi di articoli che risalgono indietro di anni. Offre sia feed in tempo reale sia accesso ai dati storici, con output JSON strutturato che include testo completo degli articoli, metadati e arricchimenti.

è una piattaforma di dati news con un archivio storico enorme — miliardi di articoli che risalgono indietro di anni. Offre sia feed in tempo reale sia accesso ai dati storici, con output JSON strutturato che include testo completo degli articoli, metadati e arricchimenti.

Funzioni principali:

- Miliardi di articoli nell’archivio storico

- Feed in tempo reale e accesso ai dati storici

- Testo completo degli articoli con metadati strutturati

- Molto usato dai team AI/ML per dataset di training e pipeline RAG

Prezzi: pricing enterprise/personalizzato (basato sul volume di dati). Nessun piano gratuito self-serve per le news.

Limite: non pensato per utenti occasionali. Solo prezzi enterprise.

Manutenzione: 🟢 Bassa (feed di dati completamente gestito).

Ideale per: team AI/ML che costruiscono dataset di training e team enterprise che hanno bisogno di archivi storici profondi di news.

14. Newspaper4k — Miglior libreria open source per l’estrazione di articoli

è una libreria Python (successore di Newspaper3k) costruita appositamente per estrarre contenuti puliti degli articoli. Rimuove annunci, sidebar e navigazione, e restituisce solo l’articolo: titolo, corpo del testo, autori, data di pubblicazione, immagini, keyword e summary.

è una libreria Python (successore di Newspaper3k) costruita appositamente per estrarre contenuti puliti degli articoli. Rimuove annunci, sidebar e navigazione, e restituisce solo l’articolo: titolo, corpo del testo, autori, data di pubblicazione, immagini, keyword e summary.

Funzioni principali:

- Estrae il corpo pulito dell’articolo, rimuovendo il rumore

- Restituisce titolo, autori, data di pubblicazione, immagini, keyword, summary

- Completamente gratuita e open source

- Leggera e veloce per pagine HTML statiche

Prezzi: gratis. Ma ti serviranno il tuo server, la tua infrastruttura proxy e tempo di sviluppo.

Limite: nessuna gestione anti-bot integrata. Va in crisi con siti news molto dinamici o renderizzati in JS. Richiede conoscenze Python e una pipeline personalizzata per andare oltre l’estrazione di base. Quando cambia la struttura HTML di un sito, devi sistemarlo.

Manutenzione: 🔴 Alta (si rompe quando cambia l’HTML del sito, richiede correzioni manuali).

Ideale per: sviluppatori Python che costruiscono pipeline personalizzate di estrazione news e vogliono il massimo controllo sul parsing degli articoli.

15. HasData — Miglior API SERP economica con endpoint news

è una SERP API con un endpoint dedicato a Google News. Restituisce JSON strutturato con risultati news a prezzi competitivi.

è una SERP API con un endpoint dedicato a Google News. Restituisce JSON strutturato con risultati news a prezzi competitivi.

Funzioni principali:

- Endpoint dedicato a Google News

- Output JSON strutturato

- Tempo di risposta di circa 3–4 secondi per richiesta

- Crediti gratuiti per i test

Prezzi: parte da (5 crediti per richiesta news = 40.000 richieste). Circa 0,25–0,60 $ per 1.000 risultati.

Limite: restituisce dati SERP (titoli, snippet), non il contenuto completo degli articoli.

Manutenzione: 🟢 Bassa (API SERP gestita).

Ideale per: team attenti al budget che hanno bisogno di dati SERP di Google News senza pagare il prezzo di SerpApi.

Pattern da notare

Dopo aver passato in rassegna tutti e 15 gli strumenti, emergono alcuni pattern.

Le API SERP (SerpApi, Scrapingdog, HasData) sono ottime per dati strutturati sui titoli, ma ti lasciano a metà quando serve il testo completo dell’articolo. Le News API dedicate (Newsdata.io, Newscatcher, Webz.io) risolvono in modo eccellente il problema dei metadati, ma non possono fare scraping di URL arbitrari. Gli strumenti no-code (Thunderbit, Octoparse, ParseHub) ti danno la flessibilità per scrappare qualsiasi pagina — anche se i loro profili di manutenzione variano moltissimo. E Newspaper4k ti offre l’estrazione più pulita degli articoli, se sei disposto a costruire e mantenere tu stesso la pipeline.

API vs no-code vs open source: il costo reale per 1.000 articoli

Nessun altro normalizza questo confronto tra tutte le categorie. Ecco i conti:

| Metodo | Tempo di setup | Costo per 1K articoli | Manutenzione | Ideale per |

|---|---|---|---|---|

| Open source (Newspaper4k) | Ore–giorni | $0 (ma con costi server + tempo dev) | 🔴 Alta | Sviluppatori con esigenze personalizzate |

| News API (Newsdata.io, Newscatcher, Webz.io) | Minuti | $5–$50+ | 🟢 Bassa | Dati strutturati, archivi storici |

| Scraping API (ScraperAPI, ScrapingBee, Oxylabs) | 30 min | $1–$5 | 🟡 Media | Sviluppatori che vogliono gestione anti-bot |

| AI no-code (Thunderbit, Octoparse, ParseHub) | 2 minuti | $3–$15 | 🟢–🟡 | Utenti business, team non tecnici |

Il costo nascosto degli strumenti open source “gratuiti” è il tempo degli sviluppatori. Un senior developer che passa 4 ore al mese a sistemare una pipeline Newspaper4k rotta? Non è gratis — è costoso.

Dall’altro lato, API enterprise come Webz.io e Newscatcher hanno poca manutenzione ma costi che hanno senso solo su larga scala.

Per la maggior parte dei team business con cui parlo, il punto ideale è o uno strumento AI no-code (come Thunderbit) per scraping flessibile e ad hoc, oppure una News API dedicata per monitoraggio strutturato e continuo.

Il problema della manutenzione: perché la maggior parte dei news scraper si rompe (e quali no)

Questo merita una sezione a sé.

È il reclamo numero uno che vedo nei forum, nei ticket di supporto e nelle conversazioni con gli utenti. I siti news cambiano layout continuamente — a volte ogni settimana. Uno scraper costruito su selettori CSS o XPath può funzionare perfettamente oggi e restituire spazzatura domani.

Ecco come si collocano i 15 strumenti sul fronte manutenzione:

| Livello di manutenzione | Strumenti | Cosa succede quando un sito cambia |

|---|---|---|

| 🟢 Basso (AI-adaptive o API gestita) | Thunderbit, SerpApi, Newsdata.io, Newscatcher, Webz.io, Scrapingdog, HasData, Oxylabs, Bright Data | L’AI rilegge la pagina, oppure il provider API gestisce il cambiamento. Tu non tocchi nulla. |

| 🟡 Medio (template + proxy) | ScraperAPI, ScrapingBee, Apify, Octoparse | L’anti-bot è gestito, ma la tua logica di estrazione o l’actor/template può richiedere aggiornamenti. |

| 🔴 Alto (basato su selettori) | ParseHub, Newspaper4k | Quando il sito cambia, il tuo scraper si rompe. Devi correggere manualmente selettori o regole di parsing. |

L’approccio di Thunderbit merita una nota specifica: poiché l’AI legge la struttura attuale della pagina ogni volta che esegui uno scraping, non ci sono selettori hardcoded da mantenere. Ho visto i nostri utenti estrarre gli stessi siti news per mesi senza dover aggiornare la configurazione, anche dopo modifiche di layout da parte di quei siti. È quel tipo di affidabilità che conta quando stai facendo un briefing news quotidiano o un report competitivo settimanale.

Testo pulito degli articoli: quali news scraper rimuovono davvero il rumore?

“Ho ottenuto i dati, ma sono pieni di annunci, menu di navigazione e roba da sidebar.” È più o meno tre richieste di supporto su cinque che vedo sul news scraping.

Ecco il quadro onesto:

| Capacità di testo pulito | Strumenti |

|---|---|

| Restituisce testo pulito dell’articolo già pronto | Newspaper4k, Thunderbit (con scraping delle sottopagine + Field AI Prompt), Newsdata.io (premium), Webz.io, Bright Data (News Scraper), Newscatcher |

| Restituisce solo titoli/snippet (non il testo completo) | SerpApi, Scrapingdog, HasData, Oxylabs (modalità SERP) |

| Restituisce HTML grezzo (l’utente deve fare parsing) | ScraperAPI, ScrapingBee |

| Varia in base alla configurazione | Apify, Octoparse, ParseHub |

Newspaper4k è lo standard d’oro per eliminare il rumore dalle pagine news standard — è stato letteralmente costruito per quel lavoro. Ma richiede Python e va in crisi sui siti pesanti in JS.

Il Field AI Prompt di Thunderbit è l’equivalente no-code: puoi dire all’AI, colonna per colonna, di “estrarre solo il corpo principale dell’articolo, escludendo navigazione e annunci”, e può anche etichettare, classificare o riassumere il testo durante l’estrazione. Per i team che hanno bisogno di testo pulito degli articoli senza scrivere codice, è l’opzione più pratica che abbia trovato.

Se ti interessa confrontare l’estrazione basata su AI con i metodi tradizionali, il nostro articolo su entra più nel dettaglio.

Scraping delle news in modo responsabile: basi legali ed etiche

Non ho trovato articoli concorrenti che affrontino davvero questo punto — una lacuna da colmare, soprattutto per chi legge in ambito enterprise.

robots.txt: controllalo sempre. Molti grandi siti news vietano esplicitamente lo scraping di certi percorsi. Gli strumenti responsabili (Thunderbit incluso) permettono scraping basato sul browser che rispetta il contesto della sessione, ma dovresti comunque esaminare il file robots.txt del sito prima di lanciare attività su larga scala.

Termini di servizio: c’è una differenza sostanziale tra estrarre metadati (titoli, date, URL) per ricerca interna e ripubblicare articoli completi protetti da copyright. Il primo caso è in genere meno rischioso; il secondo può creare una reale esposizione legale. Casi recenti come e mostrano che il quadro legale è ancora in evoluzione.

Best practice: usa le API ufficiali quando disponibili (Google News RSS, Newsdata.io, Newscatcher). Fai caching in modo responsabile. Imposta limiti di frequenza alle richieste. Non aggirare mai i paywall. Diversi strumenti di questa lista — tra cui Thunderbit, ScraperAPI e Bright Data — offrono rate limiting integrato o funzioni di scraping etico che ti aiutano a restare dalla parte giusta del confine.

Questo articolo è informativo e non costituisce consulenza legale. Se fai scraping su scala enterprise, consulta il tuo team legale.

Come Thunderbit si inserisce nel tuo workflow di news scraping

Dato che il mio team ha costruito Thunderbit, ne conosco meglio di chiunque altro punti di forza e limiti per il news scraping. Ecco come appare davvero il flusso di lavoro.

Il workflow tipico per un utente business è questo:

- Apri una pagina news (risultati di Google News, homepage di una pubblicazione, una pagina di ricerca per topic) in Chrome.

- Fai clic sull’estensione Thunderbit e premi AI Suggest Fields. Thunderbit legge la pagina e propone colonne — titolo, data, fonte, URL, snippet, immagine, ecc.

- Regola le colonne se necessario. Vuoi la classificazione del sentiment? Aggiungi una colonna con un Field AI Prompt come “classifica il sentiment come positivo, neutro o negativo”. Vuoi solo articoli di una certa categoria? Aggiungi un prompt filtro.

- Fai clic su Scrape. Scegli Browser mode (usa la tua sessione, utile per i siti che bloccano gli IP cloud) oppure Cloud mode (più veloce, elabora fino a 50 pagine alla volta).

- Scrape Subpages per visitare ogni URL dell’articolo ed estrarre il testo completo, l’autore, la data di pubblicazione e le immagini.

- Esporta in Excel, CSV, , Airtable o Notion.

Per il monitoraggio continuo, Scheduled Scraper ti permette di impostare esecuzioni giornaliere o settimanali con intervalli in linguaggio naturale (per esempio, “ogni giorno feriale alle 8”). E poiché Thunderbit supporta , il monitoraggio di news internazionali è semplice.

Dove Thunderbit è meno ideale: scraping di milioni di articoli al mese al costo unitario più basso possibile — lì un’API enterprise come Bright Data o Webz.io sarà più conveniente. E se ti serve un arricchimento NLP profondo (estrazione entità, clustering, deduplica) integrato nella risposta API, Newscatcher è costruito apposta per questo.

Puoi provare Thunderbit gratis tramite l’ — non serve carta di credito.

Come scegliere il news scraper giusto

Il mio foglio rapido, distillato dopo aver testato tutti e 15:

- Utente business non tecnico che vuole dati news quotidiani? Parti da Thunderbit. Due clic, niente codice, l’AI gestisce i cambi di layout.

- Sviluppatore che costruisce una pipeline di monitoraggio? SerpApi o Scrapingdog per dati SERP. ScraperAPI o ScrapingBee per HTML grezzo con anti-bot.

- Team enterprise che ha bisogno di scala e affidabilità? Bright Data o Oxylabs.

- Team PR che monitora brand mention su migliaia di fonti? Newscatcher o Newsdata.io.

- Ricercatore che costruisce un corpus testuale? Newspaper4k (se sai usare Python) oppure lo scraping delle sottopagine di Thunderbit (se non lo sai).

- Ingegnere AI che alimenta una pipeline RAG? Thunderbit API o Webz.io per testo articolo pulito e strutturato.

- Budget stretto? Scrapingdog per le API, piano gratuito di Thunderbit per il no-code, Newspaper4k per l’open source.

Lo strumento giusto dipende dalla tua tolleranza alla manutenzione, dal budget e dal livello di competenza tecnica. Non sai quale scegliere? Parti da un piano gratuito — la maggior parte di questi strumenti lo offre — e vedi quale flusso si adatta davvero alla tua realtà.

Per altre opzioni e confronti, il nostro riepilogo dei copre il panorama più ampio. E se vuoi capire prima di impegnarti con uno strumento, quella guida è un buon punto di partenza.

Conclusione

Il news scraping nel 2026 è un problema risolto — basta scegliere lo strumento giusto per la tua situazione e il flusso dei dati parte. Le raccomandazioni valide per tutti sono finite. Le API SERP sono ottime per i titoli, ma non ti danno il testo degli articoli. Le News API dedicate sono fantastiche per i metadati strutturati, ma non possono fare scraping di URL arbitrari. Gli strumenti AI no-code come Thunderbit ti danno flessibilità e bassa manutenzione, mentre le librerie open source ti danno controllo al prezzo dei tuoi weekend.

La mia raccomandazione sincera: decidi se ti servono titoli, testo completo dell’articolo o metadati arricchiti — poi abbina questa esigenza al livello di manutenzione e al budget che puoi sostenere. E se vuoi vedere come appare un news scraping moderno, AI-adaptive, senza scrivere una riga di codice, . Credo che resterai sorpreso da quanto puoi ottenere in pochi clic.

Buono scraping — e che il testo dei tuoi articoli sia sempre pulito, i tuoi selettori non si rompano mai e il tuo export finisca nel foglio di calcolo giusto.

FAQ

1. Qual è il miglior news scraper per utenti non tecnici?

Thunderbit è l’opzione più forte per gli utenti non tecnici. Il suo flusso AI in 2 clic non richiede codifica né selettori CSS. L’AI legge automaticamente la struttura della pagina, suggerisce i campi di estrazione e si adatta quando i layout cambiano — quindi non devi mantenere nulla. Esporta anche direttamente in Google Sheets, Airtable e Notion.

2. Posso ottenere il testo completo degli articoli dai news scraper o solo i titoli?

Dipende dallo strumento. Le SERP API come SerpApi, Scrapingdog e HasData restituiscono solo titoli e snippet. Le News API dedicate come Newsdata.io e Webz.io restituiscono il testo completo nei piani premium. Gli strumenti no-code come Thunderbit possono estrarre il testo completo tramite lo scraping delle sottopagine, e Newspaper4k è costruito appositamente per l’estrazione pulita degli articoli in Python. Controlla sempre se uno strumento restituisce HTML grezzo, snippet o il corpo pulito dell’articolo prima di impegnarti.

3. I news scraper si rompono quando i siti web cambiano layout?

Gli strumenti basati su selettori (ParseHub, Octoparse, Newspaper4k, pipeline Scrapy personalizzate) si rompono spesso quando i siti news aggiornano i layout — e i siti news lo fanno spesso. Gli strumenti AI-adaptive come Thunderbit rileggono la struttura della pagina ogni volta, quindi i cambi di layout non rompono il flusso di lavoro. Le API gestite (SerpApi, Newsdata.io, Newscatcher) gestiscono i cambiamenti dal loro lato. Se la manutenzione è una priorità, dai precedenza agli strumenti valutati 🟢 Bassa nella tabella comparativa.

4. Qual è il modo più economico per fare scraping di news su larga scala?

Per lo scraping via API, Scrapingdog offre il costo per richiesta più basso (da circa 0,10 $ per 1.000 risultati). Per il no-code, il piano gratuito di Thunderbit copre i piccoli progetti e i piani a pagamento partono da circa 9 $/mese. Per l’open source, Newspaper4k è gratuito — ma considera il tempo degli sviluppatori e i costi server, che possono crescere in fretta.

5. È legale fare scraping dei siti news?

Lo scraping di dati pubblicamente accessibili per ricerca interna è in genere meno rischioso, ma la ripubblicazione di articoli completi protetti da copyright può creare un’esposizione legale. Controlla sempre robots.txt e i Termini di servizio del sito prima di fare scraping. Usa le API ufficiali quando disponibili, rispetta i limiti di frequenza e non aggirare mai i paywall. Casi recenti come hiQ v. LinkedIn e Meta v. Bright Data mostrano che il quadro legale è ancora in evoluzione. Per scraping su scala enterprise, consulta il tuo team legale.

Scopri di più