Quasi la metà di tutto il traffico internet è ormai generata da bot. La maggior parte estrae link, dati e URL su larga scala. Se lo fai ancora a mano, stai perdendo terreno.

Ho testato 12 strumenti per estrarre link — dalle estensioni Chrome con AI alle librerie Python — per capire quali mantengono davvero le promesse quando devi estrarre migliaia di URL in fretta.

Ecco cosa ho scoperto.

Perché gli estrattori di link sono importanti

Diciamolo chiaramente: il web trabocca di dati e le aziende stanno correndo per trasformare quel caos in insight concreti. e sono ormai strumenti mission-critical per i team che vogliono:

- Generare lead: i team di vendita possono raccogliere in pochi minuti i link ai profili aziendali da directory o LinkedIn, poi passare quegli URL a strumenti che estraggono le informazioni di contatto. Niente più clic infiniti.

- Aggregare contenuti e potenziare la SEO: i marketer possono raccogliere tutti gli URL degli articoli da un blog, monitorare i backlink dei concorrenti o analizzare la struttura di un sito per trovare link rotti.

- Monitorare i concorrenti e fare ricerche di mercato: i team operations possono raccogliere automaticamente link a nuovi prodotti, pagine prezzi o comunicati stampa, tenendo d’occhio la concorrenza senza fatica.

- Automatizzare i flussi di lavoro e risparmiare tempo: i moderni link scraper gestiscono URL in massa, eseguono il crawl delle sottopagine ed esportano i dati in formati strutturati (CSV, Excel, Google Sheets, Notion, e chi più ne ha più ne metta). Significa niente più maratone di copia-incolla né file di testo da ripulire.

Considerando che , farlo manualmente non è un’opzione. Il giusto estrattore di link è come avere un assistente potenziato che non si stanca mai, non perde mai un link e non chiede mai una pausa caffè.

Come abbiamo scelto i migliori estrattori di link

Con così tanti strumenti in circolazione, scegliere quello giusto può sembrare uno speed dating a una conferenza tech: tutti promettono di essere “quello giusto”, ma solo pochi mantengono davvero la parola. Ecco come ho ristretto la selezione ai migliori 12:

- Facilità d’uso: possono usarlo anche i non programmatori senza un dottorato in regex? Le soluzioni no-code e low-code hanno ottenuto punti extra.

- Estrazione in massa e multilivello: riesce a gestire centinaia di URL alla volta? Esegue il crawl delle sottopagine e segue automaticamente i link?

- Esportazione e integrazione: esporta in CSV, Excel, Google Sheets, Notion, Airtable o tramite API? Meno lavoro manuale c’è, meglio è.

- Tipo di utente e flessibilità: è pensato per utenti business, analisti o sviluppatori? Alcuni strumenti sono per tutti, altri sono più di nicchia.

- Funzionalità avanzate: riconoscimento basato su AI, pianificazione, scalabilità cloud, pulizia dei dati e modelli per siti comuni.

- Prezzo e scalabilità: piani gratuiti, pay-as-you-go o enterprise? Ho valutato cosa si ottiene in rapporto a quanto si spende.

Ho incluso di tutto, dalle estensioni del browser alle piattaforme enterprise, quindi sia che tu sia un founder solista sia un team dati di una Fortune 500, troverai la soluzione adatta.

Thunderbit: l’estrattore di link più intelligente per gli utenti business

Partiamo dal migliore. è il mio consiglio principale per l’estrazione di link, e non solo perché ho contribuito a costruirlo. Thunderbit è un' pensata per gli utenti business che vogliono risultati, e in fretta.

Cosa rende Thunderbit diverso? È come avere un tirocinante AI che ascolta davvero. Puoi usare il linguaggio naturale per descrivere ciò che vuoi (“Raccogli tutti i link dei prodotti e i prezzi da questa pagina”), e l’AI di Thunderbit si occupa del resto. Non serve armeggiare con i selettori né scrivere script.

Ma non finisce qui:

- Supporto per URL in massa: incolla un singolo URL oppure un elenco di centinaia — Thunderbit li gestisce tutti in un colpo solo.

- Navigazione tra sottopagine: devi estrarre link da una pagina elenco e poi visitare ogni pagina dettaglio per ottenere altri URL? La logica di scraping multilivello di Thunderbit fa al caso tuo.

- Esportazione strutturata: una volta estratti i link, puoi rinominare i campi, classificarli ed esportarli direttamente in Google Sheets, Notion, Airtable, Excel o CSV. Niente più problemi di post-elaborazione.

Thunderbit è usato da oltre 30.000 utenti in tutto il mondo, da team di vendita ad agenti immobiliari fino a piccoli e-commerce indipendenti. E sì, c’è anche un (fino a 6 pagine, oppure 10 con il bonus di prova), così puoi provarlo senza rischi.

Le funzionalità più forti di Thunderbit

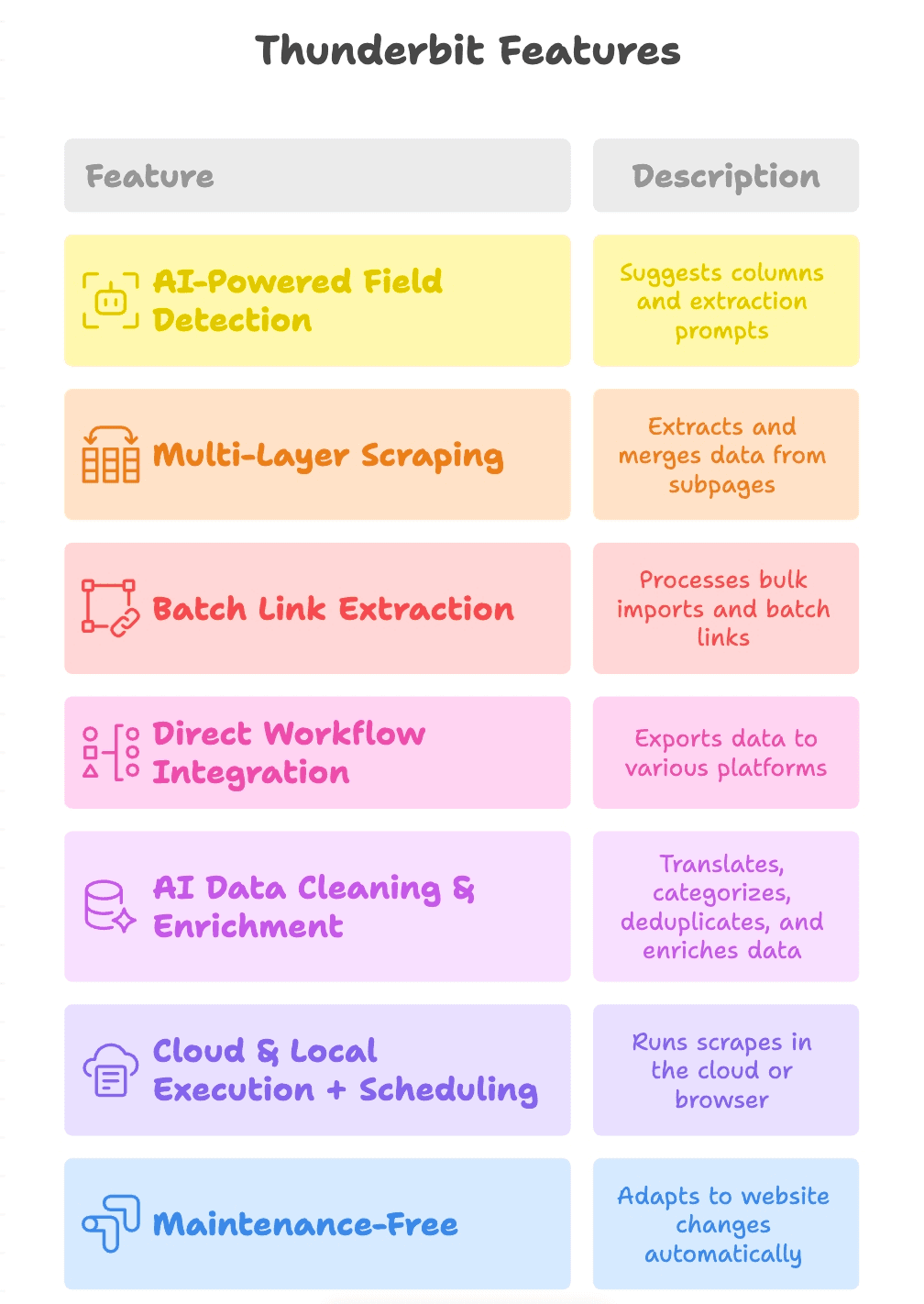

Vediamo cosa distingue davvero Thunderbit:

- Rilevamento dei campi con AI: basta cliccare su “AI Suggerisci campi” e Thunderbit legge la pagina, propone colonne (come “Link prodotto”, “URL PDF”, “Email di contatto”) e crea persino prompt di estrazione per ogni campo.

- Scraping multilivello: Thunderbit può seguire i link da una pagina principale alle sottopagine (come le schede prodotto o i download PDF), estrarre altri link e unire tutto in un’unica tabella.

- Estrazione di link in batch: che tu debba estrarre una sola pagina o mille, Thunderbit gestisce importazioni massive ed estrazione batch con facilità.

- Integrazione diretta nei flussi di lavoro: esporta i risultati in Google Sheets, Notion, Airtable oppure scaricali come CSV/Excel. I dati arrivano esattamente dove servono al tuo team.

- Pulizia e arricchimento dati con AI: Thunderbit può tradurre, categorizzare, deduplicare e persino arricchire i dati mentre estrae, così l’output è già pronto all’uso, non solo un dump grezzo.

- Esecuzione cloud e locale + pianificazione: esegui gli scraping nel cloud per velocità, oppure nel browser per i siti che richiedono il login. Pianifica attività ricorrenti per mantenere i dati aggiornati.

- Senza manutenzione: l’AI di Thunderbit si adatta ai cambiamenti del sito, così passi meno tempo a sistemare scraper rotti e più tempo a ottenere risultati.

Octoparse: estrattore di link no-code per tutti

è un classico del mondo scraping no-code. È un’app desktop (Windows/Mac) con un’interfaccia visiva point-and-click. Carichi una pagina web, fai clic sui link che ti interessano e Octoparse fa il resto.

- Ottimo per i principianti: non serve programmare. Basta cliccare, estrarre e via.

- Gestisce paginazione e contenuti dinamici: Octoparse può cliccare i pulsanti “Next”, scorrere la pagina e persino effettuare il login ai siti.

- Scraping cloud e pianificazione: i piani a pagamento permettono di eseguire i job nel cloud e pianificare attività ricorrenti.

- Opzioni di esportazione: scarica i dati in CSV, Excel, JSON oppure inviali a database.

Il piano gratuito è generoso per piccoli lavori (fino a 10 task e 50.000 righe/mese), ma gli utenti più intensivi avranno bisogno di un piano a pagamento (a partire da circa 75 $/mese).

Apify: estrattore di URL flessibile per flussi di lavoro personalizzati

è il coltellino svizzero dello scraping web. Offre un marketplace di “actor” predefiniti (strumenti di scraping) e la possibilità di scrivere i propri script in JavaScript o Python.

- Predefinito e personalizzabile: usa gli actor della community per i task comuni oppure crea i tuoi per flussi di lavoro su misura.

- Scraping in massa e pianificato: metti in coda gli URL, esegui job in parallelo e pianifica scraping ricorrenti.

- API-first: esporta in JSON, CSV, Excel o Google Sheets e integralo nella tua pipeline dati.

- Pay-as-you-go: crediti gratuiti ogni mese, poi fatturazione in base all’uso.

Apify è ideale per team semi-tecnici e sviluppatori che vogliono flessibilità e scalabilità.

Bright Data URL Scraper: scraping di link di livello enterprise

è pensato per le aziende che devono fare scraping su larga scala. Il suo Data Collector offre un URL Scraper preconfigurato per lavori ad alto volume.

- Gestisce scale enormi: estrai migliaia o milioni di pagine con un’infrastruttura proxy solida per evitare blocchi.

- Modelli preimpostati: scraper pronti all’uso per e-commerce, social, immobiliare e altro ancora.

- Funzionalità enterprise: strumenti di compliance, supporto esperto e anti-blocking avanzato.

- Prezzo: parte da circa 350 $ per 100.000 caricamenti di pagina — decisamente orientato alle grandi aziende.

Se sei una startup, potrebbe essere eccessivo. Ma per scraping mission-critical e ad alto volume, Bright Data è una potenza.

WebHarvy: estrattore di link visivo con semplicità point-and-click

è un’app desktop (Windows) che ti permette di estrarre link semplicemente cliccandoci sopra nel browser integrato.

- Super semplice: fai clic su un link e WebHarvy evidenzia tutti gli elementi simili da estrarre.

- Supporto per le espressioni regolari: pattern integrati per le attività più comuni, senza bisogno di codice.

- Esporta in Excel, CSV, JSON, XML, SQL: perfetto per gli utenti business che vogliono dati in formati familiari.

- Licenza una tantum: paghi una volta, lo usi per sempre.

Perfetto per piccole imprese, ricercatori o chiunque voglia un modo rapido e senza complicazioni per ottenere link senza programmare.

Web Scraper (estensione Chrome): estrazione rapida di link direttamente nel browser

La è uno strumento gratuito e open source che trasforma il browser in uno scraper.

- Definisci sitemap: gli dici come navigare e cosa estrarre.

- Gestisce paginazione e crawl multilivello: esegue il crawl di categorie, sottocategorie e pagine dettaglio.

- Esporta in CSV/XLSX: scarica i dati direttamente dal browser.

- Template della community: molte sitemap condivise per siti popolari.

È perfetto per lavori rapidi e una tantum, oppure per studenti e piccoli team con budget limitato.

ScraperAPI: estrattore di link scalabile per sviluppatori

è per gli sviluppatori che vogliono recuperare pagine web su larga scala senza preoccuparsi di proxy, blocchi o CAPTCHA.

- Guidato da API: invii un URL e ottieni in risposta HTML o dati già estratti.

- Gestisce scala e contromisure anti-bot: rotazione proxy, rendering JS e risoluzione CAPTCHA integrati.

- Si integra con il tuo codice: usalo con Python, Node.js o qualsiasi altro linguaggio.

- Prezzo: piano gratuito (~1000 chiamate API), poi pagamento per richiesta.

Ottimo per crawler personalizzati o quando servono affidabilità e velocità su larga scala.

ParseHub: estrattore di link visivo con selezione avanzata

è un’app desktop (Windows, Mac, Linux) che ti permette di creare progetti di scraping in modo visivo.

- Selezione e navigazione avanzate: clicca, fai loop ed estrai link in modo condizionale — anche da elementi dinamici o nascosti.

- Gestisce pagine annidate: esegui il crawl di categorie, poi delle pagine dettaglio, poi estrai altri link.

- Esporta in CSV, Excel, JSON: esecuzioni cloud e accesso API nei piani a pagamento.

- Piano gratuito: 5 progetti, fino a 200 pagine per esecuzione.

ParseHub è molto apprezzato da marketer e ricercatori che vogliono potenza senza codice.

Scrapy: estrattore di link Python per sviluppatori

è lo standard di riferimento per gli sviluppatori Python che vogliono il controllo totale.

- Prima il codice: crea spider personalizzati per eseguire crawl ed estrarre link a qualsiasi scala.

- Gestisce il crawl distribuito: efficiente, asincrono e altamente personalizzabile.

- Esporta in CSV, JSON, XML o database: sei tu a controllare l’output.

- Open source e gratuito: ma dovrai gestire tu l’ambiente.

Se ti senti a tuo agio con Python, Scrapy è potente quanto basta.

Diffbot: estrattore di link con AI per dati strutturati

è il “cervello AI” dello scraping web. Analizza le pagine e restituisce dati strutturati — link inclusi — senza configurazione manuale.

- Riconoscimento automatico dei contenuti: dai un URL e ricevi dati strutturati (articoli, prodotti, link, ecc.).

- Crawlbot e Knowledge Graph: esegui il crawl di interi siti oppure interroga il loro enorme indice web.

- Guidato da API: integra il tutto con i tuoi strumenti BI o con la pipeline dati.

- Prezzi enterprise: parte da circa 299 $/mese, ma il valore è proporzionato a ciò che paghi.

Ideale per le aziende che vogliono dati puliti e strutturati senza dover gestire scraper.

Cheerio: estrattore di link leggero per Node.js

è un parser HTML veloce, simile a jQuery, per Node.js.

- Molto veloce: analizza l’HTML in millisecondi.

- Sintassi familiare: se conosci jQuery, conosci già Cheerio.

- Ottimo per pagine statiche: non esegue il rendering del JS, ma è perfetto per contenuti renderizzati lato server.

- Open source e gratuito: abbinalo ad axios o fetch per le richieste.

Ideale per sviluppatori che costruiscono script personalizzati e vogliono velocità e semplicità.

Puppeteer: automazione del browser per l’estrazione avanzata di link

è una libreria Node.js per controllare Chrome in modalità headless.

- Automazione completa del browser: carica pagine, clicca, scorri e interagisci come un utente reale.

- Gestisce contenuti dinamici e login: perfetto per siti pieni di JavaScript o flussi complessi.

- Controllo fine: attendi gli elementi, fai screenshot, intercetta le richieste di rete.

- Open source e gratuito: ma richiede molte risorse ed è più lento degli strumenti leggeri.

Usa Puppeteer quando devi estrarre link da siti che non vanno d’accordo con gli scraper base.

Confronto rapido: quale estrattore di link fa al caso tuo?

Ecco un confronto veloce dei 12 strumenti:

| Strumento | Ideale per | Supporto per batch e sottopagine | Opzioni di esportazione dati | Prezzo |

|---|---|---|---|---|

| Thunderbit | Non programmatori, business | Sì (AI, multilivello) | Excel, CSV, Sheets, Notion, Airtable | Prova gratuita, da circa 9 $/mese |

| Octoparse | Utenti no-code, analisti | Sì | CSV, Excel, JSON, cloud storage | Piano gratuito, circa 75 $/mese |

| Apify | Semi-tech, sviluppatori | Sì | CSV, JSON, Sheets via API | Crediti gratuiti, basato sull’uso |

| Bright Data | Enterprise | Sì (alto volume) | CSV, JSON, NDJSON via API | Circa 350 $/100k pagine |

| WebHarvy | Non programmatori, desktop | Sì | Excel, CSV, JSON, XML, SQL | Licenza a pagamento |

| Estensione Web Scraper | Chiunque, rapido/gratuito | Sì | CSV, XLSX | Gratuito, open source |

| ScraperAPI | Sviluppatori, utenti API | Sì | JSON (HTML via API) | 1k richieste gratuite, piani a pagamento |

| ParseHub | Non programmatori, avanzato | Sì | CSV, Excel, JSON, API | 5 progetti gratuiti, piani a pagamento |

| Scrapy | Sviluppatori, Python | Sì | CSV, JSON, XML, DB | Gratuito, open source |

| Diffbot | Enterprise, AI | Sì (crawl AI) | JSON (dati strutturati via API) | Da circa 299 $/mese+ |

| Cheerio | Sviluppatori, Node.js | Sì (codice personalizzato) | Personalizzato (JSON, ecc.) | Gratuito, open source |

| Puppeteer | Sviluppatori, siti complessi | Sì (automazione completa) | Personalizzato (output via script) | Gratuito, open source |

Come scegliere il giusto estrattore di link per la tua azienda

Allora, come scegliere? Ecco il mio foglio rapido:

- Nessuna competenza di programmazione? Parti da Thunderbit, Octoparse, ParseHub, WebHarvy o dall’estensione Web Scraper.

- Hai bisogno di flussi di lavoro personalizzati? Apify, ScraperAPI o Cheerio sono ottimi per gli sviluppatori.

- Scala enterprise? Bright Data o Diffbot sono fatti per questo.

- Sei uno sviluppatore Python o Node.js? Scrapy (Python) oppure Cheerio/Puppeteer (Node.js) ti danno il controllo totale.

- Vuoi esportare direttamente in Sheets/Notion? Thunderbit è la scelta migliore.

Abbina lo strumento al tuo livello tecnico, al volume di dati e alle esigenze di integrazione. La maggior parte offre prove gratuite, quindi non aver paura di sperimentare.

Il valore unico di Thunderbit per l’estrazione di link nel 2026

Torniamo a ciò che rende Thunderbit davvero diverso:

- Semplicità con AI: descrivi in italiano semplice ciò che vuoi — l’AI di Thunderbit fa il resto.

- Scraping multilivello: estrai link dalle pagine principali, segui le sottopagine e raccogli altri URL — tutto in un unico flusso.

- Import in massa ed elaborazione batch: incolla centinaia di URL, estrai i link in blocco ed esporta subito dati strutturati.

- Integrazione nei workflow: esporta direttamente in Google Sheets, Notion, Airtable oppure scarica come CSV/Excel.

- Manutenzione zero: l’AI di Thunderbit si adatta ai cambiamenti del sito, così non devi continuare a sistemare scraper rotti.

Thunderbit colma il divario tra “estrarre solo dati” e “ottenere dati che puoi davvero usare”. È lo strumento che avrei voluto avere anni fa, quando ero sommerso da attività manuali sui dati.

Conclusione: estrai link in modo più intelligente e migliora il tuo flusso di lavoro

I dati web sono il carburante della crescita aziendale — e il giusto estrattore di link è il tuo motore. Che tu stia costruendo liste di lead, monitorando i concorrenti o automatizzando la ricerca, qui c’è uno strumento adatto alle tue esigenze e alle tue competenze.

Se vuoi vedere come si presenta oggi l’estrazione di link, . Credo che rimarrai sorpreso da quanto puoi ottenere in pochi clic. E se Thunderbit non fosse perfetto per te, prova anche alcuni degli altri strumenti di questa lista — non c’è mai stato momento migliore per automatizzare le cose noiose e concentrarsi su ciò che conta davvero.

Buon scraping — e che i tuoi link siano sempre puliti, strutturati e pronti all’azione. Se vuoi approfondire il web scraping, dai un’occhiata al per altre guide e consigli.

FAQ

1. Perché gli estrattori di link sono essenziali?

Con quasi la metà del traffico internet generata da bot e le aziende che estraggono dati in modo aggressivo, gli estrattori di link sono fondamentali per trasformare il caos del web in insight concreti. Aiutano ad automatizzare attività come la generazione di lead, l’aggregazione di contenuti, gli audit SEO e il monitoraggio dei concorrenti, facendo risparmiare un’enorme quantità di tempo ed انرژی?