Lo scorso trimestre, il nostro team operativo ha passato 40 ore a settimana a copiare e incollare i dati dei concorrenti nei fogli di calcolo. Questo trimestre, gli bastano 20 minuti.

La differenza? Gli strumenti di web scraping automatizzato. Sono passati da roba per soli sviluppatori a qualcosa che qualsiasi addetto alle vendite o marketer può configurare durante la pausa pranzo.

Da anni creo SaaS e strumenti di automazione (e sì, ho co-fondato ). La generazione di strumenti del 2026 è la più solida di sempre: nativi per l’AI, autoriparanti e davvero utilizzabili anche da chi non ha competenze tecniche.

Ecco 10 strumenti che ho valutato in prima persona, confrontati per caso d’uso e livello di competenza.

Perché gli strumenti di web scraping automatizzato sono importanti per le aziende

Diciamolo chiaramente: l’epoca in cui si copiavano e incollavano manualmente i dati dai siti web è finita (a meno che non vi piacciano le lesioni da sforzo ripetitivo e l’angoscia esistenziale). Gli strumenti di web scraping automatizzato sono diventati fondamentali per le aziende di ogni dimensione. In effetti, , e il web scraping è una parte fondamentale di questa strategia.

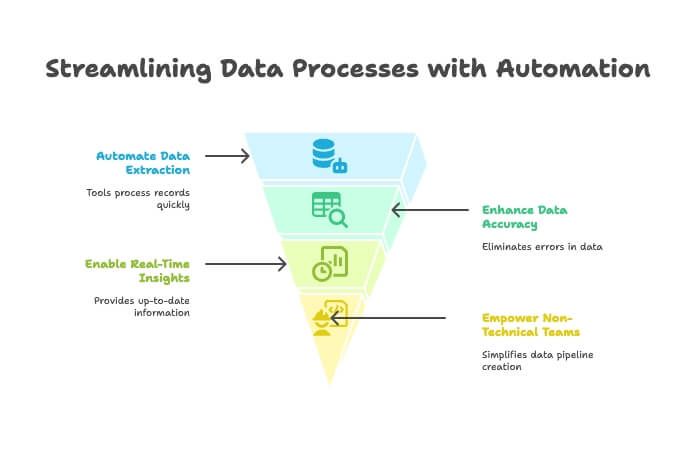

Ecco perché questi strumenti sono così preziosi:

- Risparmiare tempo e ridurre il lavoro manuale: gli scraper automatizzati possono elaborare migliaia di record in pochi minuti, liberando il team per attività a maggior valore. Un utente ha dichiarato di aver risparmiato “centinaia di ore” automatizzando la raccolta dati ().

- Migliorare l’accuratezza dei dati: niente più refusi o voci mancanti. L’estrazione automatizzata significa dati più puliti e affidabili.

- Supportare decisioni più rapide: con flussi di dati in tempo reale, puoi monitorare i concorrenti, tracciare i prezzi o creare liste di lead senza aspettare il report mensile dello stagista.

- Abilitare i team non tecnici: grazie agli strumenti no-code e guidati dall’AI, persino chi pensa che “XPath” sia una posizione yoga può ora costruire pipeline di dati web ().

Non sorprende che , e che quasi l’80% affermi che la propria organizzazione non potrebbe operare efficacemente senza di essi. Nel 2026, se non automatizzi la raccolta dei dati, probabilmente stai lasciando sul tavolo soldi — e insight.

Come abbiamo scelto i migliori strumenti di web scraping automatizzato

Con il mercato del software per web scraping destinato a , scegliere lo strumento giusto può sembrare come fare shopping per scarpe in un negozio con 10.000 opzioni. Ecco come ho ristretto il campo:

- Facilità d’uso: una persona non sviluppatrice riesce a iniziare velocemente? C’è una curva di apprendimento ripida?

- Funzionalità AI: lo strumento usa l’AI per rilevare automaticamente i campi dati, gestire siti dinamici o permetterti di descrivere ciò che ti serve in italiano semplice?

- Esportazione e integrazione dei dati: quanto facilmente puoi portare i dati in Excel, Google Sheets, Airtable, Notion o nel tuo CRM?

- Prezzi: esiste una prova gratuita? I piani a pagamento sono accessibili per singoli e piccoli team, oppure sono solo per enterprise?

- Scalabilità: lo strumento sa gestire sia piccoli lavori una tantum sia estrazioni grandi e pianificate?

- Utente target: è pensato per utenti business, sviluppatori o entrambi?

- Punti di forza unici: cosa distingue questo strumento dalla massa?

Ho incluso strumenti per ogni livello di competenza — da “voglio solo un foglio di calcolo” a “voglio rastrellare tutto Internet”. Entriamo nell’elenco.

1. Thunderbit: lo strumento di web scraper potenziato dall’AI per tutti

Inizio dallo strumento che conosco meglio — perché, beh, io e il mio team lo abbiamo costruito proprio per risolvere i problemi che ho visto affrontare per anni dagli utenti business. non è il classico scraper “drag-and-drop” o “scriviti il tuo selettore”. È un assistente dati potenziato dall’AI che ti permette di descrivere ciò che vuoi e poi fa il lavoro pesante — niente codice, niente smanettamenti con XPath, niente lacrime.

Perché Thunderbit è in cima alla lista

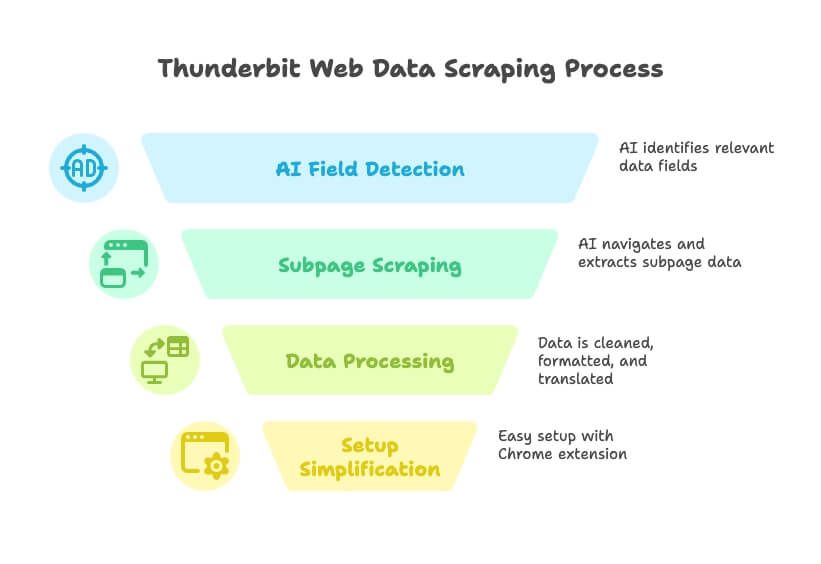

Thunderbit è la cosa più vicina che abbia visto a “trasformare qualsiasi sito web in un database”. Ecco come funziona:

- Basato sul linguaggio naturale: basta dire a Thunderbit quali dati ti servono (“voglio tutti i nomi delle aziende, le email e i numeri di telefono da questo elenco”) e l’AI rileverà automaticamente i campi pertinenti.

- Suggerimento campi AI: con un clic, Thunderbit legge la pagina e suggerisce le colonne migliori da estrarre — niente più tentativi o prove ed errori.

- Scraping di sottopagine e multi-livello: ti servono i dettagli dalla sottopagina di ogni scheda? Thunderbit può cliccare, raccogliere le informazioni extra e aggiungerle alla tua tabella.

- Pulizia, traduzione e classificazione dei dati: Thunderbit non si limita a raccogliere dati grezzi — può pulire, formattare, tradurre e persino categorizzare i campi أثناء l’estrazione.

- Nessun grattacapo di configurazione: installa l’, fai clic su “AI Suggest Fields” e in meno di un minuto stai già estraendo dati.

- Prova gratuita e costo contenuto: generoso piano gratuito (puoi estrarre fino a 6 pagine gratis), con piani a pagamento a partire da soli 9 $/mese. Meno di quanto spendo in caffè in una settimana.

Thunderbit è pensato per team di sales, marketing e operations che hanno bisogno di dati, in fretta. Niente codice, niente plugin, nessuna formazione richiesta. È come avere uno stagista dei dati che ascolta davvero e non si lamenta mai.

Le funzionalità distintive di Thunderbit

- Scraping guidato dall’AI: l’AI comprende la struttura della pagina, si adatta ai cambiamenti di layout e gestisce automaticamente anche paginazione e sottopagine ().

- Esportazione istantanea dei dati: invia i risultati direttamente a Excel, Google Sheets, Airtable, Notion oppure scaricali in CSV/JSON.

- Esecuzione nel cloud o in locale: esegui gli scraping nel cloud per velocità e scalabilità, oppure nel browser se devi usare il tuo login/sessione.

- Scraping pianificato: imposta attività ricorrenti per mantenere i dati sempre aggiornati — perfetto per monitorare i prezzi o aggiornare regolarmente i lead.

- Nessuna manutenzione: l’AI di Thunderbit si adatta ai cambiamenti dei siti web, così perdi meno tempo a sistemare scraper rotti ().

Per chi è? Per chiunque voglia passare da “mi serve questo dato” a “ecco il tuo foglio di calcolo” in pochi minuti — soprattutto per gli utenti non tecnici. Con e una valutazione di 4,9★, Thunderbit sta rapidamente diventando la scelta di riferimento per i team business che vogliono risultati, non problemi.

Vuoi vederlo in azione? Dai un’occhiata al o esplora altre .

2. Clay: arricchimento dati automatizzato e web scraping insieme

Clay è come il coltellino svizzero dei team growth. Non è solo un web scraper: è un foglio di calcolo per l’automazione che si collega a oltre 50 fonti dati live (pensa ad Apollo, LinkedIn, Crunchbase) e usa l’AI integrata per arricchire i lead, scrivere email di outreach e assegnare punteggi ai prospect.

- Automazione dei workflow: ogni riga è un lead, ogni colonna può recuperare dati o attivare un’azione. Vuoi estrarre un elenco di aziende, arricchirlo con i profili LinkedIn e inviare un’email personalizzata? Clay fa per te.

- Integrazione AI: usa GPT-4 per scrivere icebreaker, riassumere bio e altro ancora.

- Integrazioni: si collega in modo nativo a HubSpot, Salesforce, Gmail, Slack e molto altro.

- Prezzi: parte da circa 99 $/mese per il piano professional, con prova gratuita per un uso leggero.

Ideale per: outbound sales, growth hacker e marketer che vogliono costruire pipeline di lead personalizzate — combinando scraping, arricchimento e outreach in un unico posto. È potente, ma la curva di apprendimento c’è se sei alle prime armi con gli strumenti di automazione ().

3. Bardeen: strumento di web scraping nel browser per l’automazione dei workflow

Bardeen è come avere un robot del browser che può estrarre dati e automatizzare attività web ripetitive — tutto da un’estensione Chrome.

- Automazione no-code: oltre 500 “Playbooks” per scraping, compilazione di moduli, spostamento di dati tra app e altro ancora.

- AI Command Builder: descrivi il tuo compito in italiano semplice e Bardeen costruisce il workflow.

- Integrazioni: funziona con Notion, Trello, Slack, Salesforce e più di 100 altre app.

- Prezzi: gratuito per un uso leggero (100 crediti di automazione/mese), con piani a pagamento da 99 $/mese per i team.

Ideale per: power user e team go-to-market che vogliono automatizzare lo scraping e le attività di follow-up su più app. C’è molta flessibilità, ma i principianti potrebbero trovare la curva di apprendimento un po’ ripida ().

4. Bright Data: strumenti di web scraping automatizzato di livello enterprise

Bright Data (ex Luminati) è la meccanica pesante del web scraping: pensa a reti proxy globali, API avanzate e capacità di rastrellare migliaia di pagine al giorno.

- Su scala enterprise: oltre 100 milioni di IP, Web Scraper IDE, Web Unlocker per aggirare le difese anti-bot.

- Personalizzabile: crea estrazioni complesse e su larga scala con alta affidabilità.

- Prezzi: da 499 $/mese per Web Scraper IDE, con pacchetti “micro” più piccoli disponibili.

Ideale per: grandi aziende, aggregatori di dati e utenti avanzati che hanno bisogno di soluzioni robuste e scalabili. Se devi rastrellare migliaia di pagine al giorno e vuoi evitare blocchi IP, Bright Data è fatto per te ().

5. Octoparse: strumento visivo di web scraper per utenti intermedi

Octoparse è uno strumento no-code molto popolare con interfaccia visiva point-and-click — perfetto per chi vuole potenza senza programmare.

- Interfaccia drag-and-drop: fai clic sugli elementi per definire cosa estrarre, gestire login, paginazione e altro.

- Template: oltre 500 modelli pronti per siti comuni (Amazon, Twitter, ecc.).

- Scraping nel cloud: esegui i job sui server di Octoparse, pianifica le estrazioni e usa la rotazione IP.

- Prezzi: piano gratuito con limiti; i piani a pagamento partono da 119 $/mese.

Ideale per: non programmatori e analisti di dati che vogliono uno scraper capace senza scrivere codice. Ottimo per monitoraggio prezzi, schede prodotto e progetti di ricerca ().

6. : piattaforma di data scraping per le aziende

è uno dei pionieri del web scraping, oggi evoluto in una piattaforma completa di estrazione dati.

- Estrazione point-and-click: gestisce login, menu a tendina ed elementi interattivi.

- Basato sul cloud: elabora migliaia di URL in parallelo, pianifica estrazioni e accedi alle API.

- Focus enterprise: usato per monitoraggio prezzi, ricerche di mercato e creazione di dataset per il machine learning.

- Prezzi: piano Starter a 199 $/mese, Standard a 599 $/mese, Advanced a 1.099 $/mese.

Ideale per: aziende medio-grandi e team dati che hanno bisogno di soluzioni affidabili e mantenute per lavori pesanti. Probabilmente eccessivo per progetti amatoriali, ma una potenza per esigenze su scala business ().

7. Parsehub: strumento di web scraper flessibile con editor visivo

Parsehub è un’app desktop (Windows, Mac, Linux) che ti permette di costruire scraper cliccando attraverso l’interfaccia di un sito web.

- Workflow visivo: seleziona gli elementi, imposta le regole di estrazione e gestisci login, menu a tendina e infinite scroll.

- Funzioni cloud: esegui gli scraping nel cloud, pianifica i job e usa l’accesso API.

- Prezzi: livello gratuito per piccoli lavori; i piani a pagamento partono da 149 $/mese.

Ideale per: ricercatori, piccole imprese o singoli utenti che vogliono più controllo di un’estensione browser ma non sono pronti a programmare il proprio scraper ().

8. Common Crawl: dati web aperti per AI e ricerca

Common Crawl non è uno strumento nel senso tradizionale — è un enorme dataset aperto di dati di crawl del web, aggiornato ogni mese.

- Scala: circa 400 TB di dati web, che coprono miliardi di pagine.

- Gratis e aperto: non devi gestire un crawler tuo.

- Richiede competenze tecniche: servono strumenti di big data e un po’ di capacità ingegneristiche per filtrare e analizzare i dati.

Ideale per: data scientist e ingegneri che costruiscono modelli AI o fanno ricerca su larga scala. Se ti servono testi web generici o archivi storici, è una miniera d’oro ().

9. Crawly: strumento leggero di web scraping automatizzato per startup

Crawly (di Diffbot) è un crawler cloud potenziato dall’AI che può raccogliere dati da milioni di siti web e restituire risultati strutturati — senza regole di parsing.

- Estrazione AI: usa machine vision e NLP per identificare ed estrarre contenuti.

- Accesso API: interroga i dati raccolti e integrali con analytics o database.

- Prezzi: livello enterprise; contattare per i prezzi.

Ideale per: startup e team con competenze tecniche che hanno bisogno di estrazione dati web intelligente su larga scala senza costruire scraper propri ().

10. Apify: strumento di web scraper adatto agli sviluppatori con marketplace

Apify è una piattaforma cloud su cui puoi costruire i tuoi scraper (“Actors”) oppure usare una libreria di scraper predefiniti creati dalla community.

- Flessibilità per sviluppatori: supporta scraping basato su JavaScript/Python, Chrome headless, gestione proxy e scheduling.

- Marketplace: ampia libreria di scraper pronti per i siti più comuni.

- Prezzi: livello gratuito con 5 $/mese in crediti; i piani a pagamento partono da 49 $/mese.

Ideale per: sviluppatori e analisti con competenze tecniche che vogliono controllo totale e scalabilità. Anche chi non programma può usare gli Actor già pronti per i compiti più comuni ().

Tabella comparativa degli strumenti di web scraping automatizzato

| Strumento | Facilità d’uso | Funzionalità AI | Prezzo iniziale | Utente target | Punti di forza unici |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Linguaggio naturale, AI Suggest Fields, scraping di sottopagine | 9 $/mese | Utenti business non tecnici | Configurazione in 2 clic, niente codice, esportazione istantanea, prova gratuita |

| Clay | ★★★★☆ | Arricchimento AI, GPT-4 | 99 $/mese | Growth / sales ops | Foglio di calcolo per l’automazione, arricchimento, outreach |

| Bardeen | ★★★★☆ | AI Command Builder | 99 $/mese | Power user, team GTM | Browser RPA, oltre 500 playbook, integrazioni profonde |

| Bright Data | ★★☆☆☆ | Rotazione proxy, AI anti-bot | 499 $/mese | Aziende, sviluppatori | Scala, affidabilità, proxy globali |

| Octoparse | ★★★★☆ | Rilevamento AI visivo | 119 $/mese | Analisti, no-coder | Drag-and-drop, template, scraping nel cloud |

| Import.io | ★★★☆☆ | Estrattori interattivi | 199 $/mese | Aziende, team dati | Concorrenti, scheduling, API, supporto |

| Parsehub | ★★★★☆ | Workflow visivi | 149 $/mese | Ricercatori, PMI | App desktop, gestisce siti dinamici |

| Common Crawl | ★☆☆☆☆ | N/D (solo dataset) | Gratis | Data scientist, ingegneri | Enorme dataset aperto, archivi su scala web |

| Crawly | ★★☆☆☆ | Estrazione AI | Personalizzato/Enterprise | Startup, team tecnici | Potenziato dall’AI, niente regole di parsing, accesso API |

| Apify | ★★★★☆ | Marketplace di Actor | 49 $/mese | Sviluppatori, analisti tecnici | Build/marketplace, automazione cloud, flessibilità |

Come scegliere lo strumento di web scraper giusto per le tue esigenze

Scegliere il miglior strumento di web scraping automatizzato dipende dalle dimensioni del team, dalle competenze tecniche e dagli obiettivi di business. Ecco la mia guida rapida:

- Per utenti non tecnici (sales, marketing, operations): Scegli . È fatto per te — niente codice, niente configurazione, solo risultati. Perfetto per lead generation, monitoraggio prezzi e progetti dati rapidi.

- Per team ossessionati dall’automazione: Clay e Bardeen brillano se vuoi combinare scraping con arricchimento, outreach o automazione dei workflow.

- Per aziende enterprise e sviluppatori: Bright Data, e Apify sono le scelte migliori per progetti su larga scala e altamente personalizzabili.

- Per ricercatori e analisti: Octoparse e Parsehub offrono interfacce visive e funzionalità potenti senza bisogno di programmare.

- Per progetti AI e data science: Common Crawl e Crawly forniscono dataset enormi ed estrazione potenziata dall’AI per chi vuole costruire o addestrare modelli.

Chiediti: vuoi iniziare in pochi minuti o devi costruire una soluzione personalizzata di livello enterprise? Se non sei sicuro, parti da una prova gratuita — la offrono quasi tutti gli strumenti.

Il valore unico di Thunderbit: assistente AI per i dati aziendali

Tra tutti questi strumenti, Thunderbit si distingue come l’unico che agisce davvero da “assistente AI” per il web scraping e la trasformazione dei dati. Non si tratta solo di raccogliere dati: si tratta di trasformare siti disordinati in insight puliti e strutturati, senza ostacoli tecnici.

- Interfaccia in linguaggio naturale: descrivi ciò che ti serve in italiano semplice e Thunderbit fa il resto.

- Automazione completa del flusso di lavoro: dall’estrazione alla pulizia, traduzione ed esportazione — Thunderbit copre l’intero processo.

- Perfetto per sperimentare rapidamente: devi validare un nuovo mercato, costruire una lista di lead o monitorare i concorrenti? Thunderbit è il punto di partenza più veloce ed economico.

È come avere un analista dei dati integrato nel browser — uno che non chiede mai un aumento e non va mai in ferie.

Conclusione: parti con il piede giusto scegliendo lo strumento di web scraping automatizzato adatto

Il panorama dello scraping nel 2026 è irriconoscibile rispetto a due anni fa. Gli scraper AI autoriparanti, le pipeline native per LLM e gli strumenti no-code davvero usabili hanno cambiato le carte in tavola. Che tu sia un founder solitario, un piccolo team sales agguerrito o uno data scientist enterprise, in questa lista c’è uno strumento adatto alle tue esigenze. La chiave è abbinare flusso di lavoro e competenze alla piattaforma giusta — così puoi smettere di lottare con il codice e iniziare a sbloccare insight.

Se sei pronto a dire addio al copia-incolla manuale e a iniziare in modo più intelligente, e scopri quanto può essere semplice il web scraping. Oppure esplora le altre opzioni qui sopra in base ai tuoi obiettivi. In ogni caso, il futuro del business data-driven appartiene a chi automatizza.

Vuoi saperne di più? Dai un’occhiata al per approfondimenti, tutorial e consigli su come ottenere il massimo dai tuoi dati web. Buon scraping — e ricorda: che i tuoi dati siano sempre puliti e i tuoi scraper non si rompano mai (ma se succede, lascia che se ne occupi l’AI).

FAQ

1. Perché gli strumenti di web scraping automatizzato sono importanti per gli utenti business nel 2026?

Gli strumenti di web scraping automatizzato semplificano la raccolta dei dati, facendo risparmiare tempo e riducendo il lavoro manuale. Migliorano l’accuratezza dei dati, supportano decisioni in tempo reale e permettono ai team non tecnici di estrarre e usare dati web senza scrivere codice. Oggi questi strumenti sono fondamentali per sales, marketing e operations.

2. Cosa rende Thunderbit diverso dagli altri strumenti di web scraping?

Thunderbit usa l’AI per permettere agli utenti di descrivere in italiano semplice quali dati desiderano. Rileva automaticamente i campi dati, gestisce sottopagine e paginazione ed esporta subito i risultati su piattaforme come Excel e Airtable. È pensato per utenti non tecnici e offre funzionalità potenti come pulizia dati e scraping pianificato a un prezzo contenuto.

3. Qual è lo strumento migliore per progetti di scraping enterprise su larga scala?

Bright Data e sono ideali per l’uso enterprise. Offrono funzionalità come rotazione proxy, misure anti-bot, concorrenza su larga scala e accesso API, rendendoli adatti alle organizzazioni che devono elaborare migliaia di pagine web in modo affidabile e su larga scala.

4. Esistono strumenti che combinano scraping con automazione e outreach?

Sì, strumenti come Clay e Bardeen non solo estraggono dati web, ma li integrano anche nei workflow. Clay arricchisce i lead e automatizza l’outreach, mentre Bardeen consente di automatizzare attività e workflow basati sul browser con playbook guidati dall’AI.

5. Qual è la scelta migliore per utenti senza competenze tecniche?

Thunderbit si distingue per gli utenti non tecnici grazie alla sua interfaccia in linguaggio naturale, alla configurazione guidata dall’AI e alla facilità d’uso. Non richiede codice né configurazioni ed è ideale per utenti business che hanno bisogno di dati rapidi e affidabili senza complessità tecniche.