Diciamolo senza giri di parole: Amazon è praticamente insieme il centro commerciale, il supermercato e il negozio di elettronica di tutto Internet. Se lavori nelle vendite, nell’e-commerce o nelle operations, sai già che quello che succede su Amazon non resta su Amazon: influenza prezzi, scorte e persino il tuo prossimo grande lancio di prodotto. Ma c’è un problema: tutti quei dettagli preziosi su prodotti, prezzi, valutazioni e recensioni sono chiusi dentro un’interfaccia web pensata per gli acquirenti, non per i team affamati di dati. Quindi, come fai a mettere le mani su quei dati senza passare i weekend a fare copia e incolla come se fossimo nel 1999?

È qui che entra in gioco il web scraping. In questa guida ti mostrerò due modi per estrarre i dati dei prodotti Amazon: l’approccio classico “rimboccati le maniche e scrivilo in Python” e il percorso moderno “lascia fare il lavoro pesante all’AI” con un no code web scraper come . Ti guiderò attraverso codice Python reale, con tutti gli intoppi e le soluzioni pratiche, poi ti mostrerò come Thunderbit possa ottenere gli stessi dati in un paio di clic, senza bisogno di programmare. Che tu sia uno sviluppatore, un analista di business o semplicemente qualcuno stanco dell’inserimento manuale dei dati, qui troverai quello che ti serve.

Perché estrarre i dati dei prodotti Amazon? (amazon scraper python, web scraping with python)

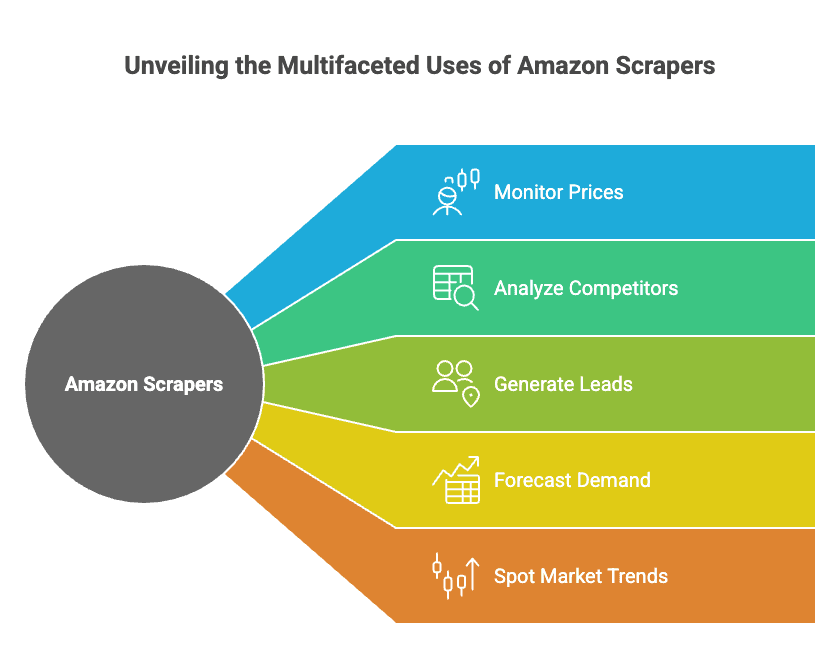

Amazon non è solo il più grande rivenditore online del mondo: è anche il più grande mercato a cielo aperto per l’intelligence competitiva. Con e , Amazon è una miniera d’oro per chi vuole:

- Monitorare i prezzi (e adeguare i tuoi in tempo reale)

- Analizzare la concorrenza (seguire nuovi lanci, valutazioni e recensioni)

- Generare lead (trovare venditori, fornitori o persino potenziali partner)

- Prevedere la domanda (osservando i livelli di stock e le classifiche di vendita)

- Individuare i trend di mercato (analizzando recensioni e risultati di ricerca)

E non è solo teoria: aziende reali stanno ottenendo ROI concreti. Per esempio, un rivenditore di elettronica ha usato dati sui prezzi estratti da Amazon per , mentre un altro brand ha visto dopo aver automatizzato il monitoraggio dei prezzi dei concorrenti.

Ecco una tabella rapida dei casi d’uso e del tipo di ROI che puoi aspettarti:

| Caso d’uso | Chi lo usa | ROI / beneficio tipico |

|---|---|---|

| Monitoraggio dei prezzi | E-commerce, operations | Margini di profitto +15% o più, vendite +4%, 30% in meno di tempo per gli analisti |

| Analisi della concorrenza | Vendite, prodotto, operations | Adeguamento più rapido dei prezzi, competitività migliore |

| Ricerca di mercato (recensioni) | Prodotto, marketing | Iterazione di prodotto più veloce, copy pubblicitario migliore, insight SEO |

| Generazione di lead | Vendite | Oltre 3.000 lead/mese, 8+ ore risparmiate per commerciale a settimana |

| Previsione di scorte e domanda | Operations, supply chain | Riduzione del 20% delle scorte eccessive, meno rotture di stock |

| Individuazione dei trend | Marketing, dirigenti | Individuazione precoce di prodotti e categorie in crescita |

E c’è di più: oggi dichiara un valore misurabile dall’analisi dei dati. Se non fai scraping su Amazon, stai lasciando sul tavolo insight e denaro.

Panoramica: Amazon Scraper Python vs. strumenti no code per web scraper

Ci sono due modi principali per portare i dati di Amazon fuori dal browser e dentro i tuoi fogli di calcolo o dashboard:

-

Amazon Scraper Python (web scraping with python):

Scrivi il tuo script usando librerie Python come Requests e BeautifulSoup. Ti offre il massimo controllo, ma devi saper programmare, gestire le misure anti-bot e mantenere lo script ogni volta che Amazon cambia il sito.

-

Strumenti no code per web scraper (come Thunderbit):

Usa uno strumento che ti permette di puntare, cliccare ed estrarre i dati, senza programmare. Gli strumenti moderni come usano persino l’AI per capire quali dati prendere, gestire sottopagine e paginazione, ed esportare tutto direttamente in Excel o Google Sheets.

Ecco come si confrontano:

| Criterio | Scraper Python | No code (Thunderbit) |

|---|---|---|

| Tempo di configurazione | Alto (installazione, codice, debug) | Basso (installa l’estensione) |

| Competenze richieste | Programmazione richiesta | Nessuna (puntare e cliccare) |

| Flessibilità | Illimitata | Alta per i casi d’uso comuni |

| Manutenzione | Correggi il codice | Lo strumento si aggiorna da solo |

| Gestione anti-bot | Devi gestire proxy e header | Integrata, gestita per te |

| Scalabilità | Manuale (thread, proxy) | Scraping nel cloud, parallelizzato |

| Esportazione dati | Personalizzata (CSV, Excel, DB) | Un clic per Excel e Sheets |

| Costi | Gratis (il tuo tempo + proxy) | Freemium, a pagamento per scala |

| Ideale per | Sviluppatori, esigenze personalizzate | Utenti business, risultati rapidi |

Nelle prossime sezioni ti guiderò in entrambi gli approcci: prima vedremo come costruire un Amazon scraper in Python, con codice reale, poi come fare la stessa cosa con l’AI Web Scraper di Thunderbit.

Per iniziare con Amazon Scraper Python: prerequisiti e setup

Prima di immergerci nel codice, sistemiamo l’ambiente.

Ti servirà:

- Python 3.x (scaricalo da )

- Un editor di codice (io preferisco VS Code, ma va bene qualsiasi altro)

- Le seguenti librerie:

requests(per le richieste HTTP)beautifulsoup4(per il parsing dell’HTML)lxml(parser HTML veloce)pandas(per tabelle/esportazione dati)re(espressioni regolari, integrato)

Installa le librerie:

1pip install requests beautifulsoup4 lxml pandasConfigurazione del progetto:

- Crea una nuova cartella per il progetto.

- Apri l’editor, crea un nuovo file Python (ad esempio

amazon_scraper.py). - Sei pronto per partire!

Passo dopo passo: web scraping con Python per i dati dei prodotti Amazon

Vediamo come fare scraping di una singola pagina prodotto Amazon. (Niente paura, tra poco passeremo anche allo scraping di più prodotti e più pagine.)

1. Inviare richieste e recuperare l’HTML

Per prima cosa recuperiamo l’HTML di una pagina prodotto. (Sostituisci l’URL con quello di qualsiasi prodotto Amazon.)

1import requests

2url = "<https://www.amazon.com/dp/B0ExampleASIN>"

3response = requests.get(url)

4html_content = response.text

5print(response.status_code)Attenzione: questa richiesta di base probabilmente verrà bloccata da Amazon. Potresti vedere un errore 503 o un CAPTCHA invece della pagina prodotto. Perché? Perché Amazon capisce che non sei un browser reale.

Gestire le misure anti-bot di Amazon

Amazon non ama i bot. Per evitare il blocco, dovrai:

- Impostare un header User-Agent (farti passare per Chrome o Firefox)

- Ruotare gli User-Agent (non usare sempre lo stesso)

- Limitare il ritmo delle richieste (aggiungere ritardi casuali)

- Usare proxy (per scraping su larga scala)

Ecco come impostare gli header:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64)... Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4}

5response = requests.get(url, headers=headers)Vuoi fare le cose in modo più avanzato? Usa una lista di User-Agent e ruotali a ogni richiesta. Per lavori grandi, conviene usare un servizio proxy (ce ne sono molti sul mercato), ma per scraping su piccola scala header e ritardi bastano di solito.

Estrarre i campi chiave del prodotto

Una volta ottenuto l’HTML, è il momento di analizzarlo con BeautifulSoup.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html_content, "lxml")Adesso estraiamo le informazioni importanti:

Titolo del prodotto

1title_elem = soup.find(id="productTitle")

2product_title = title_elem.get_text(strip=True) if title_elem else NonePrezzo

Il prezzo di Amazon può trovarsi in più punti. Prova così:

1price = None

2price_elem = soup.find(id="priceblock_ourprice") or soup.find(id="priceblock_dealprice")

3if price_elem:

4 price = price_elem.get_text(strip=True)

5else:

6 price_whole = soup.find("span", {"class": "a-price-whole"})

7 price_frac = soup.find("span", {"class": "a-price-fraction"})

8 if price_whole and price_frac:

9 price = price_whole.text + price_frac.textValutazione e numero di recensioni

1rating_elem = soup.find("span", {"class": "a-icon-alt"})

2rating = rating_elem.get_text(strip=True) if rating_elem else None

3review_count_elem = soup.find(id="acrCustomerReviewText")

4reviews_text = review_count_elem.get_text(strip=True) if review_count_elem else ""

5reviews_count = reviews_text.split()[0] # ad esempio, "1,554 ratings"URL dell’immagine principale

Amazon a volte nasconde immagini ad alta risoluzione in JSON dentro l’HTML. Ecco una rapida soluzione con regex:

1import re

2match = re.search(r'"hiRes":"(https://.*?.jpg)"', html_content)

3main_image_url = match.group(1) if match else NoneOppure prendi il tag dell’immagine principale:

1img_tag = soup.find("img", {"id": "landingImage"})

2img_url = img_tag['src'] if img_tag else NoneDettagli del prodotto

Specifiche come brand, peso e dimensioni si trovano di solito in una tabella:

1details = {}

2rows = soup.select("#productDetails_techSpec_section_1 tr")

3for row in rows:

4 header = row.find("th").get_text(strip=True)

5 value = row.find("td").get_text(strip=True)

6 details[header] = valueOppure, se Amazon usa il formato “detailBullets”:

1bullets = soup.select("#detailBullets_feature_div li")

2for li in bullets:

3 txt = li.get_text(" ", strip=True)

4 if ":" in txt:

5 key, val = txt.split(":", 1)

6 details[key.strip()] = val.strip()Stampa i risultati:

1print("Titolo:", product_title)

2print("Prezzo:", price)

3print("Valutazione:", rating, "basata su", reviews_count, "recensioni")

4print("URL immagine principale:", main_image_url)

5print("Dettagli:", details)Scraping di più prodotti e gestione della paginazione

Un prodotto va bene, ma probabilmente ti serve un elenco completo. Ecco come fare scraping delle pagine di ricerca e di più pagine.

Ottenere i link dei prodotti da una pagina di ricerca

1search_url = "<https://www.amazon.com/s?k=bluetooth+headphones>"

2res = requests.get(search_url, headers=headers)

3soup = BeautifulSoup(res.text, "lxml")

4product_links = []

5for a in soup.select("h2 a.a-link-normal"):

6 href = a['href']

7 full_url = "<https://www.amazon.com>" + href

8 product_links.append(full_url)Gestire la paginazione

Gli URL di ricerca di Amazon usano &page=2, &page=3 e così via.

1for page in range(1, 6): # estrae le prime 5 pagine

2 search_url = f"<https://www.amazon.com/s?k=bluetooth+headphones&page={page}>"

3 res = requests.get(search_url, headers=headers)

4 if res.status_code != 200:

5 break

6 soup = BeautifulSoup(res.text, "lxml")

7 # ... estrai i link dei prodotti come sopra ...Ciclo sulle pagine prodotto ed esportazione in CSV

Raccogli i dati dei prodotti in una lista di dizionari, poi usa pandas:

1import pandas as pd

2df = pd.DataFrame(product_data_list) # lista di dict

3[df.to_csv("amazon_products.csv", index=False)Oppure in Excel:

1df.to_excel("amazon_products.xlsx", index=False)Best practice per progetti Amazon Scraper Python

Diciamolo chiaramente: Amazon cambia continuamente il sito e combatte gli scraper. Ecco come mantenere il progetto in funzione:

- Ruota header e User-Agent (usa una libreria come

fake-useragent) - Usa proxy per lo scraping su larga scala

- Limita il ritmo delle richieste (ritardi casuali con

time.sleep()tra le richieste) - Gestisci gli errori in modo elegante (ripeti in caso di 503, rallenta se vieni bloccato)

- Scrivi una logica di parsing flessibile (cerca più selettori per ogni campo)

- Monitora i cambiamenti dell’HTML (se lo script all’improvviso restituisce sempre

None, controlla la pagina) - Rispetta robots.txt (Amazon vieta lo scraping di molte sezioni: procedi responsabilmente)

- Pulisci i dati man mano (rimuovi simboli di valuta, virgole e spazi)

- Resta in contatto con la community (forum, Stack Overflow, r/webscraping di Reddit)

Checklist per mantenere il tuo scraper:

- [ ] Ruota User-Agent e header

- [ ] Usa proxy se fai scraping su larga scala

- [ ] Aggiungi ritardi casuali

- [ ] Organizza il codice in moduli per aggiornarlo facilmente

- [ ] Monitora ban o CAPTCHA

- [ ] Esporta i dati con regolarità

- [ ] Documenta i selettori e la logica

Per un approfondimento, consulta la mia .

L’alternativa no code: fare scraping di Amazon con l’AI Web Scraper di Thunderbit

Bene, hai visto il metodo Python. Ma se non vuoi programmare, o semplicemente vuoi ottenere i dati in due clic e andare avanti con la tua giornata? Qui entra in gioco .

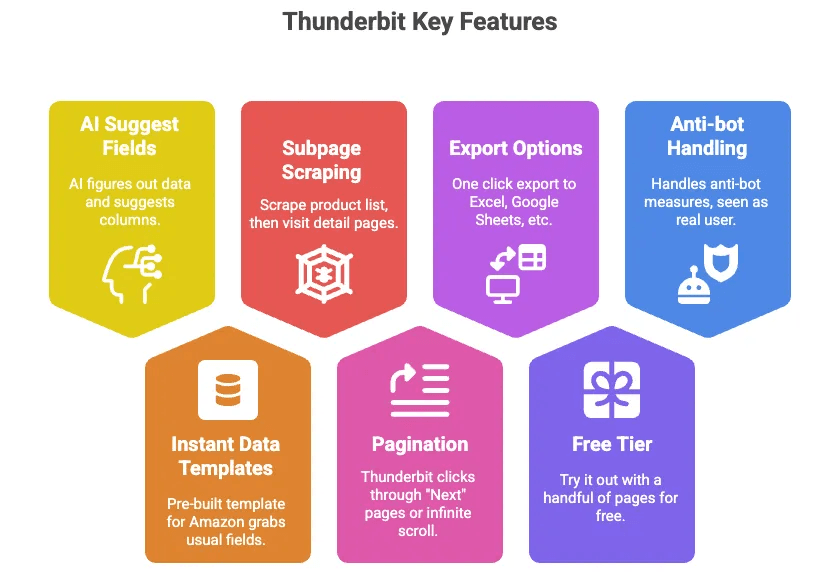

Thunderbit è un’estensione Chrome AI web scraper che ti permette di estrarre i dati dei prodotti Amazon, e i dati praticamente di qualsiasi sito, senza scrivere codice. Ecco perché mi piace:

- Suggerimento campi con AI: basta cliccare un pulsante e l’AI di Thunderbit capisce quali dati ci sono nella pagina e suggerisce le colonne (come Titolo, Prezzo, Valutazione, ecc.).

- Template dati immediati: per Amazon c’è un template già pronto che estrae tutti i campi più comuni, senza configurazione.

- Scraping delle sottopagine: estrai una lista di prodotti e poi lascia che Thunderbit visiti automaticamente la pagina dettaglio di ciascun prodotto per recuperare più informazioni.

- Paginazione: Thunderbit può cliccare per te le pagine “Avanti” o gestire lo scroll infinito.

- Esporta in Excel, Google Sheets, Airtable, Notion: con un clic, i dati sono pronti all’uso.

- Piano gratuito: prova con alcune pagine gratis.

- Gestisce per te le misure anti-bot: poiché gira nel tuo browser (o nel cloud), Amazon lo vede come un utente reale.

Passo dopo passo: usare Thunderbit per estrarre i dati dei prodotti Amazon

Ecco quanto è semplice:

-

Installa Thunderbit:

Scarica la e accedi.

-

Apri Amazon:

Vai alla pagina Amazon che vuoi estrarre (risultati di ricerca, pagina prodotto, qualsiasi cosa).

-

Clicca “AI Suggest Fields” o usa un template:

Thunderbit suggerirà le colonne da estrarre oppure puoi scegliere il template Amazon Product.

-

Rivedi le colonne:

Se vuoi, modifica le colonne (aggiungi/rimuovi campi, rinomina, ecc.).

-

Clicca “Scrape”:

Thunderbit prende i dati dalla pagina e li mostra in una tabella.

-

Gestisci sottopagine e paginazione:

Se hai estratto una lista, clicca “Scrape Subpages” per visitare la pagina dettaglio di ciascun prodotto e recuperare più informazioni. Thunderbit può anche cliccare automaticamente le pagine “Avanti”.

-

Esporta i dati:

Clicca “Export to Excel” o “Export to Google Sheets”. Fatto.

-

(Opzionale) Programma lo scraping:

Ti servono questi dati ogni giorno? Usa lo scheduler di Thunderbit per automatizzare tutto.

Tutto qui. Niente codice, niente debug, niente proxy, niente stress. Per una guida visiva, guarda il o la .

Amazon Scraper Python vs. no code web scraper: confronto diretto

Mettiamo tutto insieme:

| Criterio | Scraper Python | Thunderbit (No code) |

|---|---|---|

| Tempo di configurazione | Alto (installazione, codice, debug) | Basso (installa l’estensione) |

| Competenze richieste | Programmazione richiesta | Nessuna (puntare e cliccare) |

| Flessibilità | Illimitata | Alta per i casi d’uso comuni |

| Manutenzione | Correggi il codice | Lo strumento si aggiorna da solo |

| Gestione anti-bot | Devi gestire proxy e header | Integrata, gestita per te |

| Scalabilità | Manuale (thread, proxy) | Scraping nel cloud, parallelizzato |

| Esportazione dati | Personalizzata (CSV, Excel, DB) | Un clic per Excel e Sheets |

| Costi | Gratis (il tuo tempo + proxy) | Freemium, a pagamento per scala |

| Ideale per | Sviluppatori, esigenze personalizzate | Utenti business, risultati rapidi |

Se sei uno sviluppatore che ama smanettare e ha bisogno di qualcosa di super personalizzato, Python è il tuo alleato. Se vuoi velocità, semplicità e zero codice, Thunderbit è la strada giusta.

Quando scegliere Python, no code o AI Web Scraper per i dati Amazon

Scegli Python se:

- Ti serve una logica personalizzata o vuoi integrare lo scraping nei sistemi backend

- Fai scraping su scala enorme (decine di migliaia di prodotti)

- Vuoi capire come funziona lo scraping sotto il cofano

Scegli Thunderbit (no code, AI web scraper) se:

- Vuoi dati velocemente, senza programmare

- Sei un utente business, un analista o un marketer

- Devi dare al tuo team la possibilità di ottenere i dati in autonomia

- Vuoi evitare la fatica di proxy, misure anti-bot e manutenzione

Usali entrambi se:

- Vuoi prototipare rapidamente con Thunderbit e poi costruire una soluzione Python personalizzata per la produzione

- Vuoi usare Thunderbit per la raccolta dati e Python per la pulizia/analisi dei dati

Per la maggior parte degli utenti business, Thunderbit coprirà il 90% delle esigenze di scraping su Amazon in una frazione del tempo. Per l’altro 10% — ciò che è super personalizzato, su larga scala o profondamente integrato — Python resta comunque il re.

Conclusione e punti chiave

Estrarre i dati dei prodotti Amazon è un superpotere per qualsiasi team di vendite, e-commerce o operations. Che tu stia monitorando i prezzi, analizzando la concorrenza o semplicemente cercando di risparmiare al tuo team l’ennesimo copia e incolla, esiste una soluzione adatta a te.

- Lo scraping con Python ti dà il controllo totale, ma richiede una curva di apprendimento e una manutenzione continua.

- I no code web scraper come Thunderbit rendono l’estrazione dei dati Amazon accessibile a tutti: niente codice, niente stress, solo risultati.

- L’approccio migliore? Usa lo strumento che si adatta alle tue competenze, ai tempi e agli obiettivi del tuo business.

Se sei curioso, prova Thunderbit: è gratis per iniziare e rimarrai sorpreso da quanto velocemente puoi ottenere i dati che ti servono. E se sei uno sviluppatore, non aver paura di combinare gli strumenti: a volte il modo più rapido per costruire è lasciare che l’AI faccia le parti noiose per te.

FAQ

1. Perché un’azienda dovrebbe estrarre i dati dei prodotti Amazon?

Estrarre dati da Amazon permette alle aziende di monitorare i prezzi, analizzare la concorrenza, raccogliere recensioni per la ricerca di prodotto, prevedere la domanda e generare lead di vendita. Con oltre 600 milioni di prodotti e quasi 2 milioni di venditori su Amazon, è una ricca fonte di intelligence competitiva.

2. Quali sono le principali differenze tra usare Python e strumenti no code come Thunderbit per fare scraping su Amazon?

Gli scraper Python offrono la massima flessibilità, ma richiedono competenze di programmazione, tempo di configurazione e manutenzione continua. Thunderbit, un AI web scraper no code, consente di estrarre dati Amazon all’istante tramite un’estensione Chrome, senza programmare, con gestione anti-bot integrata e opzioni di esportazione in Excel o Sheets.

3. È legale fare scraping dei dati di Amazon?

I termini di servizio di Amazon in genere vietano lo scraping e l’azienda implementa attivamente misure anti-bot. Tuttavia, molte aziende continuano a estrarre dati pubblicamente disponibili operando in modo responsabile, ad esempio rispettando i limiti di frequenza ed evitando richieste eccessive.

4. Che tipo di dati posso estrarre da Amazon usando strumenti di web scraping?

I campi più comuni includono titoli dei prodotti, prezzi, valutazioni, numero di recensioni, immagini, specifiche, disponibilità e persino informazioni sui venditori. Thunderbit supporta anche lo scraping delle sottopagine e la paginazione per acquisire dati su più inserzioni e pagine.

5. Quando dovrei scegliere lo scraping in Python invece di uno strumento come Thunderbit, o viceversa?

Usa Python se ti servono controllo totale, logica personalizzata o vuoi integrare lo scraping nei sistemi backend. Usa Thunderbit se vuoi risultati rapidi senza programmare, devi scalare facilmente o sei un utente business alla ricerca di una soluzione con poca manutenzione.

Vuoi approfondire? Dai un’occhiata a queste risorse:

Buon scraping — e che i tuoi fogli di calcolo siano sempre aggiornati.