Una ricerca su GitHub per "amazon scraper" restituisce circa . Se limitiamo i risultati ai repository aggiornati negli ultimi sei mesi, scendiamo a circa — appena il 20%. Il resto? Tutorial abbandonati, wrapper obsoleti e script che hanno smesso di funzionare nel momento in cui Amazon ha rafforzato le difese.

Ho passato molto tempo a esaminare repository Amazon scraper, leggendo issue su GitHub e seguendo discussioni della community su Reddit e Stack Overflow. Il pattern è sempre lo stesso: qualcuno trova un repo popolare, impiega un’ora per configurarlo, lo esegue una volta e si trova davanti a una muraglia di CAPTCHA o errori 503. Nel 2026 l’atteggiamento anti-bot di Amazon non è più quello di due anni fa — fingerprinting TLS, analisi comportamentale e distribuzione aggressiva di CAPTCHA hanno reso quasi inutile il vecchio piano "ruota gli user agent e spera per il meglio". Questa guida copre le best practice che contano davvero se vuoi ottenere dati Amazon affidabili da un repository GitHub e cosa fare quando il tuo scraper si rompe — non se, ma quando.

Cos’è un Amazon Scraper su GitHub (e perché ne falliscono così tanti)?

Un repository GitHub per Amazon scraper è in genere uno script open source — di solito basato su Python, Node.js o Scrapy — che estrae dati strutturati dalle pagine Amazon. Gli obiettivi di estrazione sono quelli che ti aspetteresti: titolo del prodotto, prezzo, ASIN, valutazioni, numero di recensioni, disponibilità, informazioni sul venditore, schede dei risultati di ricerca e testo delle recensioni.

L’architettura è di solito semplice:

- Un client HTTP o un browser headless recupera la pagina.

- Un parser HTML o JSON estrae i campi.

- I dati vengono salvati in CSV, JSON o in un database.

I repository in genere rientrano in quattro categorie:

- Librerie Python leggere (ad es. )

- Spider Scrapy (ad es. )

- Automazioni browser con Selenium o Playwright

- Progetti wrapper API che in realtà sono front-end di un servizio di scraping commerciale (ad es. )

Il pattern di fallimento è prevedibile. La maggior parte dei repo si rompe perché:

- Amazon cambia il layout della pagina o i frammenti HTML

- Amazon restituisce un 503 o un CAPTCHA invece del contenuto reale

- Il fingerprint TLS e HTTP dello scraper non sembra più quello di un browser

- Disallineamenti di localizzazione, lingua o header fanno scattare i sospetti

- Il maintainer va avanti dopo aver risolto il suo caso d’uso originale e molto ristretto

Avere tanti star e essere "attualmente utilizzabile" sono due cose molto diverse. Nell’audit che ho eseguito per questo articolo, solo circa tre degli otto repository più visibili sembravano chiaramente attivi nel 2026.

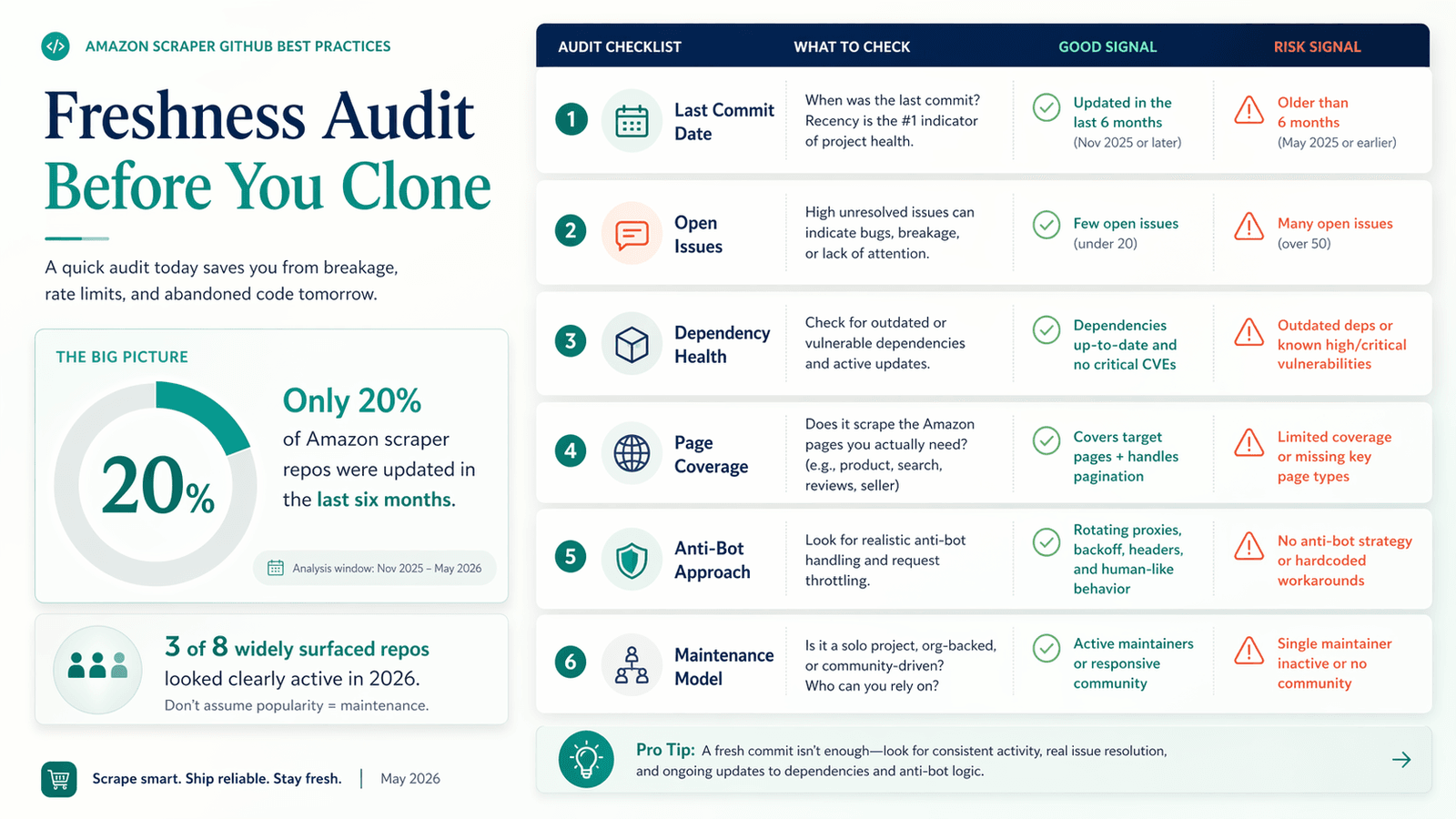

Esegui un audit di freschezza 2026 prima di clonare qualsiasi repository Amazon Scraper GitHub

Questo passaggio conta più per Amazon che per la maggior parte degli altri target. L’atteggiamento difensivo di Amazon cambia più rapidamente rispetto a un tipico sito e-commerce, quindi un repo che funziona bene su un sito vetrina può diventare inutile su Amazon in poche settimane. Eppure molte liste "best amazon scraper github" raccomandano repository senza verificare se funzionino ancora. Gli utenti perdono ore a configurare strumenti rotti.

Come verificare se un repository GitHub è ancora vivo

Prima di fare git clone di qualsiasi cosa, passa in rassegna questi controlli:

- Data dell’ultimo commit: Qualsiasi cosa più vecchia di 6 mesi è un forte campanello d’allarme su Amazon.

- Issue aperte vs. tasso di risposta: Cerca nella scheda Issues le parole "captcha", "503", "blocked" e "not working". Se questi report si accumulano senza risposte del maintainer, lascia perdere.

- Salute delle dipendenze: Apri

requirements.txtopackage.json. Librerie deprecate (ad es. vecchirequestssenza gestione TLS moderna) sono un segnale rosso. - Copertura dei tipi di pagina Amazon: Il repo gestisce pagine prodotto, risultati di ricerca E recensioni? O solo uno di questi?

- Approccio anti-bot: Header codificati in modo fisso senza supporto proxy sono un approccio da 2023 che non regge nel 2026.

Checklist di freschezza per Amazon Scraper GitHub

| Segnale di freschezza | Cosa controllare | Campanello d’allarme 🚩 |

|---|---|---|

| Data dell’ultimo commit | Feed dei commit o data di push del repo | Più vecchio di 6 mesi |

| Issue aperte | Scheda Issues — filtra per "captcha", "503", "blocked" | Problemi ricorrenti senza risposte del maintainer |

| Salute delle dipendenze | requirements.txt / package.json | Librerie deprecate, nessuna strategia TLS moderna |

| Copertura delle pagine Amazon | README + esempi di codice | Gestisce solo un tipo di pagina (ad es. prodotto ma non ricerca o recensioni) |

| Approccio anti-bot | Codice sorgente, configurazione proxy | Solo header e stringhe UA codificati |

| Modello di manutenzione | È un vero scraper, un tutorial o un wrapper API commerciale? | Il repo è in realtà solo un front-end per un servizio a pagamento |

Cosa ha trovato davvero l’audit

Ho confrontato otto repository Amazon scraper molto visibili con questi criteri. I risultati sono tutt’altro che rassicuranti:

| Repo / strumento | Star | Segnale dell’ultimo commit | Ambito | Stato nel 2026 | Note |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2.872 | 2026-04-02 | Wrapper API gestito per scraper | Vivo, ma non fai-da-te | Fresco, ma in realtà è un front-end di un servizio gestito |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | API gestita per ricerca, dettagli, recensioni | Vivo, ma non fai-da-te | Copertura buona, ma è un prodotto API, non uno scraper grezzo |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Libreria Python leggera | Vivo | Il più chiaro scraper GitHub diretto che usa curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Solo recensioni | Ristretto ma utilizzabile | Vecchio e molto specifico per le recensioni |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Ultimo commit 2023; repo aggiornato nel 2024-08-20 | Spider Scrapy + middleware proxy | Da tutorial, invecchiato | Utile per imparare, non come stack 2026 pronto all’uso |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | CLI Node per ricerca, dettagli, recensioni | Alto rischio | Copertura ampia, ma la manutenzione è troppo vecchia |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Dalla ricerca al CSV | Morto per il 2026 | Storicamente popolare, chiaramente obsoleto |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Tutorial su ricerca/prodotto | Morto per il 2026 | Di fatto archivistico |

Le issue pubbliche raccontano la stessa storia. ha un issue intitolato "All requests receive captcha response." ha "Doesn't seem to be working." ha "Bypass Amazon protection." Non sono casi limite oscuri — sono le prime cose in cui inciampano gli utenti.

Il playbook anti-blocco: come evitare il ban con un Amazon Scraper da GitHub

Essere bloccati è il problema più grande per chiunque usi un progetto amazon scraper github. Consigli generici come "usa proxy e ruota gli user agent" non bastano più. Lo stack anti-bot 2025-2026 di Amazon include fingerprinting TLS, analisi comportamentale e distribuzione aggressiva di CAPTCHA. Serve un approccio a più livelli.

Corrispondenza del fingerprint TLS: perché i semplici requests ti fanno bannare

Questa è una delle tecniche anti-blocco più sottovalutate. Il fingerprinting TLS funziona così: quando il tuo script apre una connessione sicura ad Amazon, il server può capire molto del client da come effettua l’"handshake" — i cipher suite offerti, l’ordine delle estensioni, le impostazioni HTTP/2. I browser usano impostazioni TLS e HTTP/2 relativamente fisse, e quelle combinazioni sono identificabili tramite tecniche come .

I normali requests e le configurazioni HTTPX standard possono copiare gli header, ma non replicano il comportamento TLS e HTTP/2 simile a Chrome. Amazon nota la differenza.

risolve il problema in modo diretto. Offre impersonificazione del browser — i target supportati includono chrome136, safari184 e firefox133 — così il fingerprint TLS del tuo client HTTP corrisponde a quello di un browser reale. La documentazione avverte esplicitamente di non generare stringhe JA3 casuali: i fingerprint dei browser sono in gran parte fissi per versione, e un insieme casuale di valori è più facile da rilevare rispetto a un fingerprint reale copiato.

I dati della community confermano il quadro. Un conferma che l’argomento impersonate è utile perché ruota i profili browser e mantiene gli header allineati. Un altro nota che Amazon blocca i client in base al fingerprint TLS "dopo circa un mese o due." Un chiede in modo specifico se Amazon stia fingerprintando python-requests (spoiler: sì).

Se stai ancora usando i semplici requests come client Amazon principale, correggi prima questa assunzione di qualsiasi altra cosa.

Rotazione proxy fatta bene (non solo "usa proxy")

Lo scopo dei proxy non è ruotare il più possibile. Lo scopo è rendere le sessioni credibili.

Residential vs datacenter: I proxy datacenter costano meno ma sono più facili da rilevare. I proxy residential costano di più ma sono molto più difficili da segnalare per Amazon. Il parte da 4,00 $/GB pay-as-you-go, fino a 3,50 $/GB sui piani più grandi. parte da 6 $/GB. Amazon rientra nella categoria dei target sofisticati, dove i proxy residential valgono il sovrapprezzo.

Rotazione per richiesta vs per sessione: È qui che molti tutorial sbagliano. Ruotare il proxy ad ogni richiesta mantenendo cookie e header costanti può sembrare meno umano, non di più. Il pattern più sicuro:

- Mantieni il percorso ricerca → prodotto → recensioni sulla stessa sessione sticky quando possibile

- Cambia sessione quando inizi un nuovo percorso di ricerca, non ad ogni richiesta

- Ruota tra sessioni, non in modo casuale dentro una singola sessione di navigazione

Un ha notato che i normali IP ISP non si comportavano affatto bene quanto gli IP mobili sui siti e-commerce più popolari. Un altro ha riportato blocchi anche con user agent in rotazione e proxy residential — un buon promemoria che i proxy da soli non bastano.

Ritmo delle richieste, backoff e rate limiting

Le pagine 503 di Amazon non sono semplice sfortuna. Sono feedback.

Un su scraping di più di 500 ASIN ha riportato un 503 sempre nello stesso punto, intorno all’ASIN 101, anche con pause tra le richieste. Il pattern è vecchio, ma la lezione è attuale: un volume grezzo da un singolo IP o fingerprint prima o poi attiva le difese.

Ritmo best practice per scraper GitHub fai-da-te:

- Ritardi casuali tra le richieste (non intervalli fissi, che sono rilevabili)

- 2-5 secondi tra richieste pubbliche di prodotto per client HTTP semplici

- Exponential backoff dopo un 503 o un CAPTCHA — aumenta progressivamente il tempo di attesa invece di riprovare subito

- Concorrenza più bassa di quella che pensi ti serva

- Logging fail-open invece di loop di retry stretti

La maggior parte dei repository amazon scraper github non ha un rate limiting integrato. Dovrai aggiungerlo tu.

Orchestrazione degli header: molto più che le stringhe User-Agent

Amazon controlla l’intero set di header, non solo lo User-Agent.

Un set di header realistico per browser dovrebbe includere:

User-AgentAcceptAccept-LanguageAccept-Encoding- hint

Sec-CH-*quando appropriato - comportamento di connessione coerente con il profilo browser scelto

Gli header devono corrispondere alla localizzazione del marketplace. Un ha scoperto che la stessa configurazione bot veniva rilevata solo in alcune localizzazioni, e un altro commentatore indicava header legati alla regione come Accept-Language.

La regola: header, profilo TLS/browser e geografia del proxy non devono contraddirsi a vicenda. Non inviare header Chrome con uno user agent Firefox. Non usare un proxy USA con Accept-Language: de-DE.

Gestione dei CAPTCHA: quando risolverli e quando fare backoff

Incontrare un CAPTCHA significa che Amazon è già sospettosa. Risolverlo non azzera il punteggio di fiducia.

Per eventi di CAPTCHA isolati e poco frequenti:

- Il pacchetto PyPI è un risolutore Python puro per CAPTCHA testuali Amazon, anche se l’ultima release risale a maggio 2023 — trattalo come uno strumento tattico, non come una strategia duratura

- indica il CAPTCHA Amazon a 0,45 $ ogni 1.000 soluzioni

Per loop di CAPTCHA ripetuti:

- Smetti di risolverli e inizia a fare backoff

- CAPTCHA ripetuti significano che la sessione è bruciata — risolverli non ricostruisce la fiducia nel fingerprint, nella cronologia della sessione o nella reputazione IP

- Se i CAPTCHA si concentrano per subnet proxy, il problema è il livello di rete, non il parser

Quando ti serve davvero un browser headless (e quando è eccessivo)

L’istinto sbagliato è far girare Playwright per tutto.

Casi d’uso adatti a un browser:

- Risultati di ricerca che dipendono dal rendering JavaScript o da stato dipendente dalla localizzazione

- Flussi recensioni che reindirizzano a pagine di login o sign-in

- Workflow in cui cookie e contesto del browser contano più della velocità grezza

Casi d’uso in cui un browser è una cattiva scelta:

- Normali pagine pubbliche di prodotto

- Estrazione statica delle schede prodotto dove basta un client HTTP simile a un browser

- Recuperi bulk su larga scala in cui conta l’efficienza computazionale

Parti dal client più leggero che funziona. Un sullo scraping su larga scala descrive la progressione: partire da requests, poi curl_cffi, e passare a un browser completo solo quando le opzioni più leggere falliscono. I browser headless sono molto più lenti e più esigenti in termini di risorse rispetto ai client HTTP per lo scraping delle pagine prodotto Amazon.

Matrice decisionale anti-blocco per i progetti Amazon Scraper GitHub

| Scenario | Approccio consigliato | Perché |

|---|---|---|

| Pagine pubbliche di prodotto (piccola scala) | curl_cffi + sessione residential sticky | Il percorso più economico che sembra comunque un browser |

| Pagine dei risultati di ricerca | curl_cffi per primo, Playwright solo se il rendering o lo stato rompono l’HTTP | La ricerca è più statale e sensibile alla localizzazione |

| Recensioni (login richiesto) | Modalità browser con cookie/sessione reali | Login e flussi dinamici delle recensioni sono più difficili da emulare con il solo HTTP |

| Grande scala (5k+ al giorno) | API scraper gestita, unlocker o piattaforma no-code | Il codice GitHub fai-da-te diventa da solo un problema infrastrutturale |

Quando il tuo progetto Amazon Scraper GitHub si rompe: tieni pronto un piano B no-code

Ogni scraper esperto tiene un piano B.

Gli aggiornamenti di Amazon prima o poi romperanno qualsiasi repository GitHub nel momento peggiore possibile. Per i team e-commerce, uno scraper rotto significa cambi di prezzo mancati, dati competitor obsoleti e buchi nei dashboard.

Molte persone che cercano "amazon scraper github" sono in realtà utenti business — operations e-commerce, marketer, ricercatori FBA — che hanno provato soluzioni in codice perché non riuscivano a trovare alternative migliori. I dati dei forum mostrano anche una frustrazione reale verso la ufficiale di Amazon: accesso restrittivo, dati limitati e che molti venditori non riescono a soddisfare.

Perché gli scraper Amazon su GitHub richiedono manutenzione continua

L’audit sopra lo rende evidente:

- I repository obsoleti accumulano report di problemi senza correzioni

- I repo "funzionanti" parlano ormai apertamente di misure anti-bot nel README

- Le discussioni della community si concentrano sempre più su fingerprint TLS, loop CAPTCHA e qualità dei proxy — non sui selettori CSS

Per gli utenti business, quel carico di manutenzione è il vero costo nascosto. Il repo è gratis. Non lo è il tuo tempo a debuggare alle 2 di notte.

Thunderbit come alternativa pratica ad Amazon Scraper

offre un che estrae titolo, prezzo, ASIN, valutazioni, brand, disponibilità, origine della spedizione e URL originale — senza scrivere codice.

Cosa significa in pratica:

- Scraping in 2 clic invece di configurare ambienti Python, dipendenze e proxy

- Template Amazon immediato — nessun overhead AI, solo estrazione con 1 clic

- Modalità browser scraping per pagine che richiedono login (come le pagine recensioni che frustrano gli utenti di scraper GitHub)

- Cloud scraping per pagine pubbliche ad alta velocità (50 pagine alla volta)

- Esportazione gratuita verso Google Sheets, Airtable, Notion, Excel — non solo CSV/JSON

- Scheduled scraper per il monitoraggio continuo dei prezzi

- L’AI si adatta ai cambiamenti di layout — nessun onere di manutenzione per te

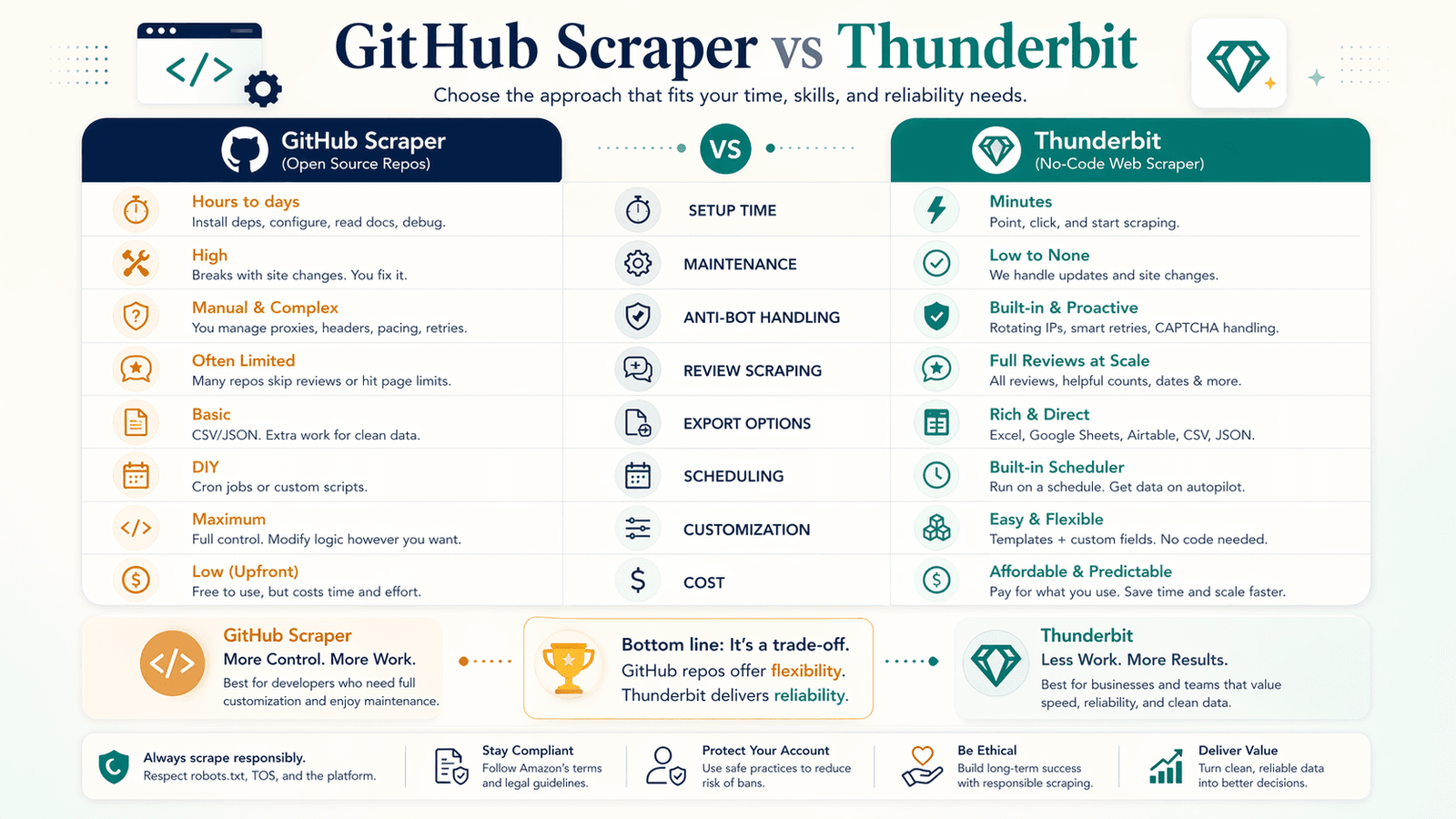

Amazon Scraper GitHub vs Thunderbit: confronto onesto

| Fattore | Scraper GitHub (ad es. AmzPy) | Thunderbit |

|---|---|---|

| Tempo di configurazione | 15–60 min (Python, dipendenze, proxy) | ~2 min (installa l’estensione Chrome) |

| Manutenzione | Sei tu a correggere i guasti | L’AI si adatta ai cambiamenti di layout |

| Gestione anti-bot | Fai-da-te (proxy, header, TLS) | Integrata (modalità cloud + browser) |

| Scraping recensioni (con login) | Gestione complessa della sessione | Modalità browser scraping |

| Export dati | Solo CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Pianificazione | Fai-da-te (cron, Airflow, ecc.) | Scheduled scraper integrato |

| Personalizzazione | Più alta | Più bassa |

| Costo | Gratis (più i costi dei proxy) | Piano gratuito disponibile; basato su crediti |

Il compromesso onesto: i repository GitHub offrono più personalizzazione; Thunderbit offre più affidabilità. Se al tuo team interessa più l’uptime della flessibilità, il percorso no-code è di solito la scelta più razionale.

Best practice per lo scraping Amazon schedulato e ricorrente

La maggior parte dei progetti amazon scraper github è costruita per esecuzioni singole, ma i casi d’uso business reali — monitoraggio dei prezzi, tracking dell’inventario, analisi della concorrenza — richiedono scraping ricorrente. I repository GitHub quasi mai includono lo scheduling in modo nativo, lasciando gli utenti a combinare cron job, Airflow o workflow n8n.

Scheduling fai-da-te per scraper Amazon GitHub

La configurazione minima per esecuzioni ricorrenti:

- Cron job su Linux o macOS per eseguire lo script a intervalli programmati

- Log append-only per poter fare debug dei fallimenti a posteriori

- Deduplicazione per ASIN + timestamp per non salvare dati duplicati

- Avvisi di errore (anche una semplice email in caso di exit code non zero) per sapere quando un’esecuzione si rompe alle 3 del mattino

Per team più complessi:

- n8n per un’automazione di workflow leggera (citato spesso nei thread della community)

- Airflow per pipeline pianificate più pesanti

- Stato salvato su database se servono differenze e storico

La best practice chiave non è lo scheduler in sé — è la gestione dello stato. Tieni traccia dell’ultimo run riuscito, dell’ultimo set di ASIN, dei prezzi cambiati e degli URL falliti.

Scheduling reso più semplice con Thunderbit

Lo di Thunderbit ti permette di descrivere l’intervallo in linguaggio naturale, inserire gli URL e fare clic su "Schedule." L’AI converte il linguaggio naturale in una pianificazione cron — nessuna configurazione tecnica. Per i team e-commerce non tecnici che monitorano prezzi o lanci di prodotti dei competitor, è una riduzione significativa dell’attrito operativo.

Best practice per scrape Amazon ricorrenti

Queste valgono qualunque strumento usi:

- Deduplica per finestra ASIN + timestamp — non salvare lo stesso prodotto due volte nello stesso run

- Memorizza i prezzi come numeri, non come stringhe grezze — semplifica la pulizia a valle

- Aggiungi il timestamp di scraping a ogni riga — ti servirà per l’analisi delle tendenze

- Tieni traccia dei delta, non solo dello stato corrente — "il prezzo è sceso del 12% rispetto alla scorsa settimana" è più utile di "il prezzo è 24,99 $"

- Avvisa sui cambiamenti significativi — un calo del 15% da parte di un competitor merita una notifica; una fluttuazione dello 0,5% è rumore

- Pensa all’archiviazione dei dati — i file flat vanno bene per piccoli run; per 5k+ ASIN al giorno, considera un database o un foglio cloud

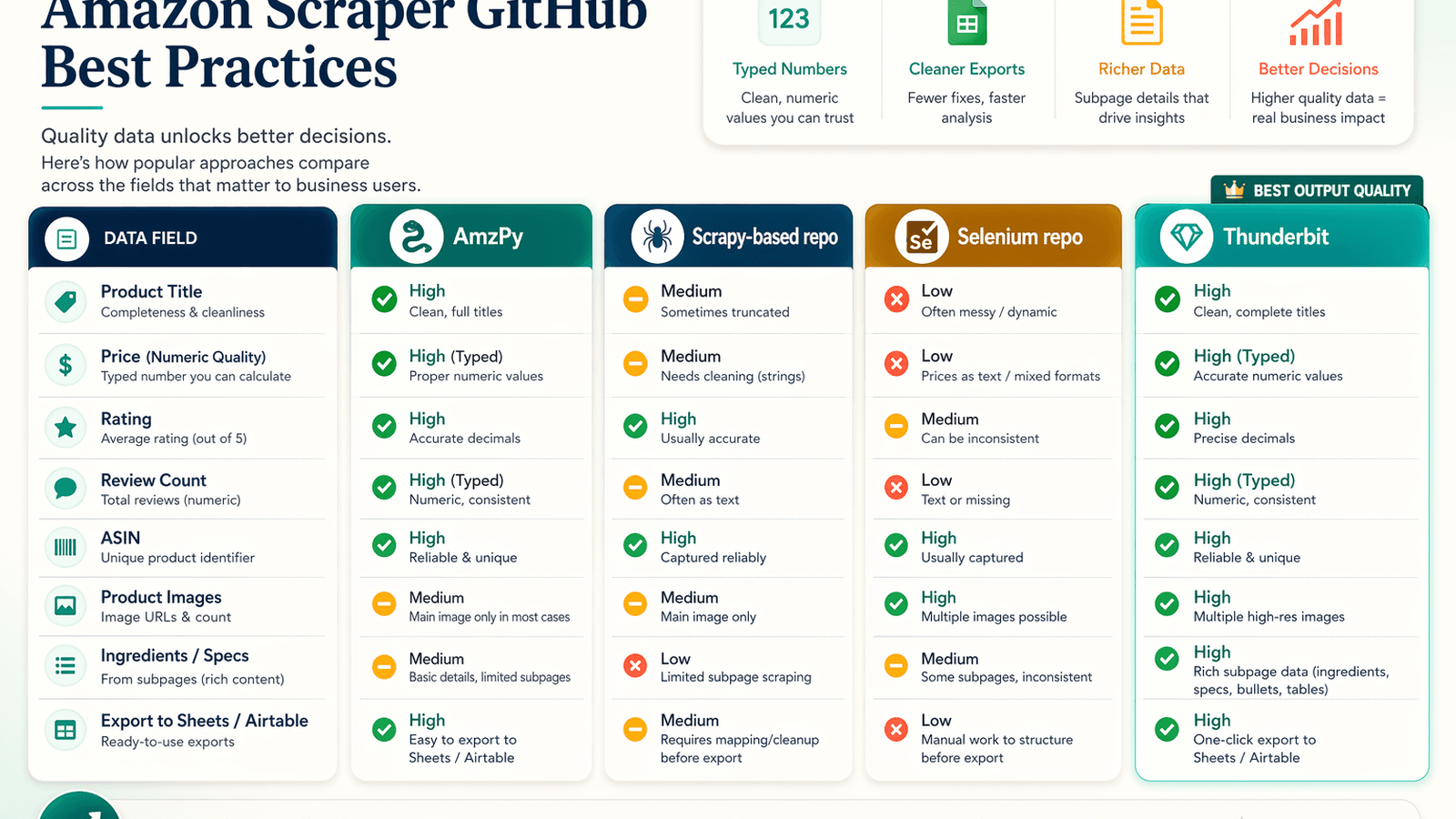

Qualità dell’output affiancata: cosa restituisce davvero ciascun approccio Amazon Scraper GitHub

Nessuno confronta davvero la qualità dell’output tra i repository amazon scraper github. Gli utenti tengono molto alla qualità dei dati — "quale strumento restituisce i dati più puliti e completi" — ma devono clonare e testare ogni repo da soli. Questa sezione colma quel vuoto.

Cosa estraggono davvero i repository GitHub più usati (e cosa perdono)

In base agli esempi nel README, agli esempi pubblici e ai formati di output documentati:

| Approccio | Cosa estrae chiaramente | Lacune / compromessi comuni |

|---|---|---|

| amzpy | Titolo, prezzo, valuta, URL immagine, valutazioni, recensioni, varianti, ASIN | Orientato alla pagina prodotto; meno ricco su recensioni complete/sezioni specifiche |

| tducret/amazon-scraper-python | CSV con titolo, valutazione, numero recensioni, URL prodotto, URL immagine, ASIN | Obsoleto, focalizzato sulle listing, storia anti-bot debole |

| python-scrapy-playbook scraper | Risultati di ricerca, pagine prodotto, recensioni, pipeline CSV/JSON | Da tutorial; dipende da middleware proxy esterno; richiede più pulizia |

| omkarcloud/amazon-scraper | Ricerca, categoria, dettagli, top recensioni, molte immagini/video/specifiche | Non è uno scraper grezzo — è un servizio API gestito |

| Template Amazon di Thunderbit | Titolo, prezzo, ASIN, brand, valutazione, recensioni, disponibilità, origine della spedizione, arricchimento delle sottopagine | Meno controllo a livello di codice rispetto a script personalizzati |

Tabella di confronto della qualità dell’output

| Campo dati | AmzPy | Repo basato su Scrapy | Repo Selenium | Thunderbit |

|---|---|---|---|---|

| Titolo prodotto | ✅ | ✅ | ✅ | ✅ |

| Prezzo (numerico) | ⚠️ stringa | ✅ | ⚠️ stringa | ✅ (tipo numerico) |

| Valutazione | ✅ | ✅ | ✅ | ✅ |

| Numero recensioni | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Immagini prodotto | ❌ | ⚠️ solo miniature | ✅ | ✅ (alta risoluzione, esportabili) |

| Ingredienti/specifiche | ❌ | ❌ | ❌ | ✅ (tramite scraping delle sottopagine + AI) |

| Export su Sheets/Airtable | ❌ | ❌ | ❌ | ✅ gratis |

Perché la formattazione dei dati conta per gli utenti business

Dati disordinati generano lavoro nascosto. Anche uno scraper riuscito può essere un fallimento operativo se:

- I prezzi sono stringhe con simboli di valuta invece di numeri puliti

- I valori mancanti sono incoerenti (stringa vuota vs null vs "N/A")

- Le immagini sono solo miniature a bassa risoluzione

- I campi delle recensioni o delle specifiche richiedono post-processing prima dell’analisi

Per i team di operations e-commerce, dati puliti incidono direttamente sulla velocità di analisi e sul processo decisionale. L’AI di Thunderbit formatta i dati per tipo — numeri come numeri, date come date, URL come URL — così sono pronti all’uso subito. I repository GitHub variano molto su questo fronte, e il tempo necessario per la pulizia cresce in fretta.

Riepilogo rapido: checklist delle best practice per Amazon Scraper GitHub

- Controlla la data dell’ultimo commit prima di clonare. Più vecchia di sei mesi è un forte campanello d’allarme su Amazon.

- Cerca nelle issue "captcha", "503", "blocked" e "not working" prima della configurazione.

- Preferisci

curl_cffio un altro client HTTP che impersona un browser rispetto ai semplicirequests. - Mantieni coerenti header, profilo TLS, lingua e geografia del proxy — niente contraddizioni.

- Usa sessioni sticky per i flussi di navigazione; non ruotare ciecamente a ogni richiesta.

- Aggiungi ritmi casuali ed exponential backoff.

- Considera i CAPTCHA ripetuti come una sessione bruciata, non come un rompicapo da forzare.

- Usa browser headless solo quando i client HTTP non riescono a riprodurre in modo affidabile la pagina.

- Salva checkpoint e stato in modo che i run falliti possano riprendere in sicurezza.

- Tieni un piano di fallback — che sia un’API gestita o uno strumento no-code come .

Considerazioni legali ed etiche sullo scraping Amazon nel 2026

Alcune cose da sapere, in breve.

L’atteggiamento di Amazon è restrittivo e lo diventa sempre di più. I segnali più forti:

- Le pagine di supporto di Amazon ora restituiscono una che dice: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- Il vieta un’ampia gamma di percorsi dinamici, di recensioni, profilo, wishlist e liste offerte.

- La contesta esplicitamente l’accesso covert o mascherato da agente, l’elusione delle misure di sicurezza e l’identificazione falsa di un agente come Google Chrome. Amazon ha anche sull’incidente.

- Amazon ha contro i crawler OpenAI a fine 2025.

Il rischio pratico è chiaramente più alto quando si passa da pagine prodotto pubbliche a flussi autenticati, automazione mascherata o estrazione commerciale ad alto volume. Questo non è un parere legale — consulta il tuo team legale per il tuo caso specifico.

Punti chiave: ottenere dati Amazon affidabili senza farsi bloccare

In ordine di importanza:

- Fai un audit prima di clonare. Considera la maggior parte dei risultati GitHub come obsoleti, tutorial o wrapper di API commerciali.

- Migliora prima il layer di rete. Il fingerprinting TLS e la coerenza della sessione contano più dei selettori HTML.

- Usa sessioni residential sticky, non caos casuale di proxy. Ruota tra sessioni, non al loro interno.

- Ritma le richieste come un utente, non come un test di stress. Ritardi casuali ed exponential backoff non sono negoziabili.

- Risolvi i CAPTCHA isolati; ritira le sessioni ripetutamente sfidate. Non forzare un fingerprint bruciato.

- Tieni un fallback pronto. Amazon cambierà qualcosa in settimana e il tuo scraper GitHub si romperà. Uno strumento no-code mantenuto come o un’API gestita può mantenere in vita la pipeline dati mentre fai debug.

- Dai priorità alla qualità dell’output. Dati puliti e tipizzati fanno risparmiare più tempo a valle di quanto ne risparmi uno scraper veloce ma sporco.

Se vuoi affidabilità più che personalizzazione, Thunderbit offre un’alternativa mantenuta — prova il o guarda i tutorial sul . Gli sviluppatori che vogliono il pieno controllo possono assolutamente usare i repository GitHub — ma solo con le pratiche anti-blocco e di manutenzione trattate in questa guida.

FAQ

È legale fare scraping dei dati prodotto Amazon con uno scraper GitHub?

I Termini di servizio di Amazon limitano la raccolta automatizzata dei dati, e Amazon ha applicato attivamente queste restrizioni con lettere di cease-and-desist e contromisure tecniche (soprattutto nel 2025-2026). Lo scraping di dati prodotto pubblicamente accessibili è una zona grigia; fare scraping dietro login o mascherare il bot come un browser reale comporta un rischio più alto. Questo non è un parere legale — consulta il tuo team legale per il tuo caso d’uso specifico.

Con quale frequenza si rompono i repository Amazon scraper su GitHub?

Frequentemente. Amazon modifica i layout delle pagine, aggiunge nuovi livelli anti-bot e depreca endpoint con regolarità. Nell’audit per questo articolo, solo circa 3 degli 8 repository più visibili risultavano chiaramente funzionanti nel 2026. Anche i repo "funzionanti" hanno spesso issue aperte su CAPTCHA ed errori 503. Aspettati di dover risolvere problemi o aggiornare la configurazione ogni poche settimane o mesi.

Qual è il miglior Amazon scraper su GitHub nel 2026?

Non esiste un vincitore unico — dipende dal caso d’uso e dal tuo livello di comfort tecnico. Per uno scraper Python leggero e diretto, è una delle opzioni più attuali. Per una copertura più ampia tramite API gestita, funziona ma non è davvero fai-da-te. Applica la checklist di freschezza di questo articolo per valutare qualsiasi repo prima di impegnarti.

Thunderbit può fare scraping di Amazon senza codice?

Sì. Il di Thunderbit estrae titolo prodotto, prezzo, ASIN, valutazioni, brand, disponibilità e altro con un solo clic. Supporta la modalità browser scraping per le pagine che richiedono login, cloud scraping per le pagine pubbliche ad alta velocità, scraping pianificato per lavori ricorrenti ed export gratuito verso Google Sheets, Airtable, Notion ed Excel. Puoi iniziare installando la .

Come evito che il mio IP venga bannato أثناء lo scraping di Amazon?

Usa un approccio a più livelli: (1) passa dai semplici requests a un client che impersona il TLS come curl_cffi, (2) usa proxy residential con sessioni sticky invece della rotazione casuale dei datacenter, (3) aggiungi ritmi casuali ed exponential backoff, (4) mantieni coerente l’intero set di header con il tuo profilo browser e la localizzazione del marketplace e (5) considera i CAPTCHA ripetuti come un segnale per ritirare la sessione, non come un rompicapo da risolvere all’infinito. Per maggiori dettagli, vedi la matrice decisionale anti-blocco più sopra in questo articolo.