Kalau kamu pernah coba menyusun daftar prospek B2B, melakukan analisis kompetitor, atau sekadar menjaga CRM tetap up to date, kamu pasti paham betapa pentingnya LinkedIn. Tapi jujur saja—copy-paste info profil satu per satu itu rasanya sama nggak asyiknya seperti menatap cat yang lagi kering, dan tool bawaan LinkedIn sendiri juga jarang kasih data yang benar-benar kamu butuhkan. Itu sebabnya, di 2026, makin banyak tim sales dan operasional yang memilih untuk scrape LinkedIn dengan Python—mengubah berjam-jam klik yang melelahkan jadi beberapa baris kode dan spreadsheet penuh prospek.

Tapi ada satu tantangan besar: LinkedIn sekarang ibarat Fort Knox-nya data bisnis. Dengan lebih dari 1,3 miliar anggota dan 310 juta pengguna aktif bulanan (), platform ini jadi sumber utama leads B2B—tapi juga salah satu yang paling ketat pertahanannya terhadap bot dan scraper. Bahkan, LinkedIn memblokir lebih dari 30 juta akun pada 2025 hanya karena scraping atau otomatisasi (). Jadi, bagaimana cara mengekstrak data LinkedIn dengan Python di 2026—tanpa bikin akunmu masuk penjara digital? Mari kita bahas langkah demi langkah, mulai dari setup, scraping yang aman, pembersihan data, sampai bagaimana tools seperti Thunderbit bisa mempercepat workflow kamu.

Apa Maksudnya Scrape LinkedIn dengan Python?

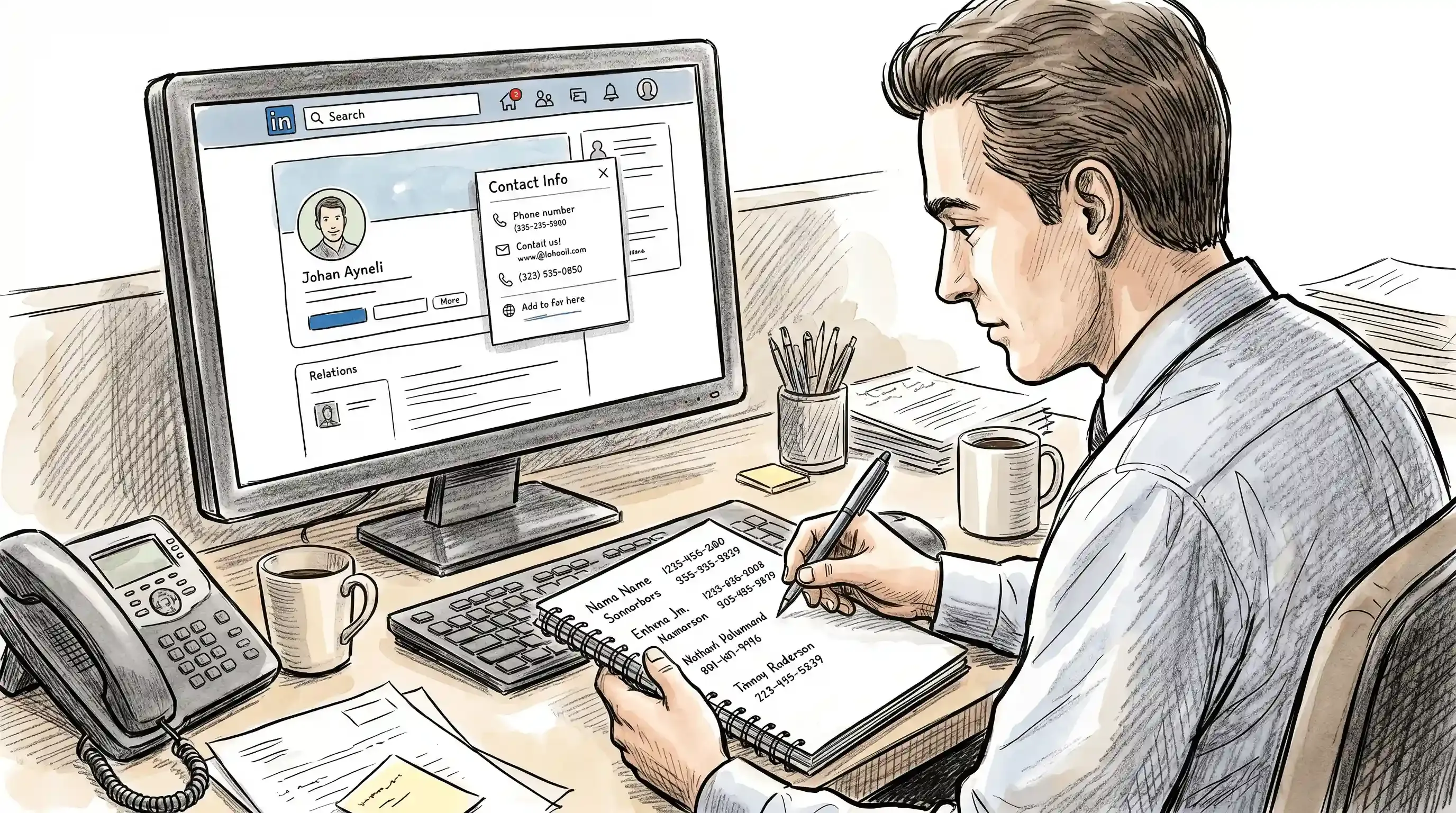

Saat kita ngomongin scraping LinkedIn dengan Python, yang dimaksud sebenarnya adalah memakai script dan library Python untuk mengotomatiskan proses pengambilan data dari halaman web LinkedIn. Jadi, alih-alih menyalin nama, jabatan, atau info perusahaan satu per satu, kamu bikin script yang mengerjakan bagian beratnya—membuka profil, mengambil field yang dibutuhkan, lalu menyimpannya dalam format yang rapi dan terstruktur.

Pengumpulan data manual itu ibarat memetik apel satu-satu. Ekstraksi data LinkedIn dengan Python ibarat menggoyang seluruh pohonnya lalu menampung apel itu di keranjang. Keyword inti di sini—linkedin data extraction python, python linkedin scraper, dan automate linkedin scraping—semuanya mengarah ke ide yang sama: memakai kode untuk mengumpulkan data LinkedIn dalam skala besar, lebih cepat, dan semoga lebih aman daripada cara manual.

Contoh penggunaan scraping LinkedIn dalam bisnis:

- Membangun daftar leads tertarget untuk outreach sales

- Memperkaya data CRM dengan jabatan dan perusahaan terbaru

- Memantau tren rekrutmen kompetitor atau pergerakan eksekutif

- Memetakan jaringan industri untuk riset pasar

- Mengumpulkan posting perusahaan atau lowongan kerja untuk analisis

Singkatnya, kalau kamu butuh data LinkedIn yang rapi dan nggak mau menghabiskan akhir pekan cuma buat klik “Connect,” Python bisa jadi sahabat kamu.

Mengapa Mengotomatisasi Scraping LinkedIn? Use Case Bisnis Utama

Mari realistis: LinkedIn bukan cuma media sosial—ini adalah fondasi sales dan marketing B2B modern. Inilah alasan tim bisnis sangat tertarik mengotomatisasi scraping LinkedIn pada 2026:

- Lead Generation: dan 62% mengatakan LinkedIn benar-benar menghasilkan leads. LinkedIn menghasilkan 277% lebih banyak leads dibanding Facebook dan Twitter digabung.

- Riset Pasar & Kompetitor: LinkedIn adalah satu-satunya tempat kamu bisa melihat struktur organisasi, tren perekrutan, dan berita perusahaan secara real time dalam skala besar.

- CRM Enrichment: Menjaga CRM tetap segar tanpa otomatisasi itu mimpi buruk. Dengan scraping LinkedIn, kamu bisa memperbarui jabatan, perusahaan, dan info kontak secara massal.

- Analisis Konten & Event: Ingin tahu siapa yang posting, bicara, atau sedang merekrut di niche kamu? Data dari scraping LinkedIn bisa menjawabnya.

Berikut tabel singkat use case yang paling umum:

| Tim | Use Case | Nilai yang Dihasilkan |

|---|---|---|

| Sales | Membangun daftar leads, persiapan outreach | Lebih banyak meeting, konversi lebih tinggi |

| Marketing | Riset audiens, kurasi konten | Targeting lebih tepat, engagement lebih tinggi |

| Operations | Enrichment CRM, pemetaan organisasi | Data lebih bersih, input manual lebih sedikit |

| Recruiting | Sourcing talenta, pelacakan kompetitor | Rekrutmen lebih cepat, pipeline lebih cerdas |

Soal ROI, tim yang memakai otomatisasi berbasis AI untuk prospecting melaporkan penghematan 2–3 jam per hari (), dan perusahaan seperti TripMaster melihat ROI 650% dari lead gen berbasis LinkedIn (). Ini bukan sekadar hemat waktu—ini benar-benar pengganda pipeline.

Python vs. Solusi Scraping LinkedIn Lainnya: Apa yang Perlu Anda Tahu

Jadi, kenapa pilih Python ketimbang ekstensi browser atau tool SaaS? Ini gambaran jujurnya:

Copy-Paste Manual

- Kelebihan: Nggak perlu setup, tanpa risiko (kecuali tanganmu pegal)

- Kekurangan: Lambat, rawan salah, dan mustahil diskalakan

Ekstensi Browser (seperti PhantomBuster, Evaboot)

- Kelebihan: Setup mudah, tanpa coding, cukup oke untuk pekerjaan kecil

- Kekurangan: Skala terbatas, risiko banned tinggi, sering butuh Sales Navigator, ada biaya bulanan

SaaS API (seperti Bright Data, Apify)

- Kelebihan: Skala besar, perawatan rendah, compliance ditangani penyedia

- Kekurangan: Mahal kalau volumenya tinggi, data kadang tertunda/cache, fleksibilitas lebih rendah

Python Script

- Kelebihan: Fleksibilitas maksimal, biaya per baris paling rendah dalam skala besar, data real-time

- Kekurangan: Butuh skill teknis tinggi, risiko banned paling besar, perawatan berkelanjutan

Berikut perbandingan side-by-side:

| Dimensi | DIY Python | Ekstensi Browser | SaaS API |

|---|---|---|---|

| Waktu setup | Hari–minggu | Menit | Jam |

| Skill teknis | Tinggi | Rendah | Sedang |

| Biaya (10K baris) | ~$200 (proxy) | $50–300 | $300–500 |

| Batas skala | Tinggi | Rendah–Sedang | Tinggi |

| Risiko banned | Tertinggi | Tinggi | Terendah |

| Kebaruan data | Real-time | Real-time | Cached |

| Perawatan | Berjalan terus | Rendah | Tidak ada |

| Compliance | Risiko milik user | Risiko milik user | Ditanggung provider |

Intinya: Kalau kamu teknis dan ingin kontrol penuh, Python memang susah ditandingi. Tapi untuk kebanyakan pengguna bisnis, tools seperti menawarkan jalur yang jauh lebih cepat dan lebih aman untuk mendapatkan data LinkedIn—terutama saat proteksi LinkedIn makin ketat dari tahun ke tahun.

Mulai: Menyiapkan Python LinkedIn Scraper Anda

Siap terjun? Berikut cara menyiapkan environment Python kamu untuk scraping LinkedIn di 2026:

1. Install Python dan Library Penting

- Python 3.10+ direkomendasikan untuk kompatibilitas terbaik.

- Library inti:

- Playwright (standar baru untuk browser automation)

- Selenium (masih populer, tapi lebih lambat dan lebih mudah terdeteksi)

- Beautiful Soup (untuk parsing HTML)

- Requests (untuk HTTP request sederhana; kegunaannya terbatas di LinkedIn)

- pandas (untuk pembersihan dan ekspor data)

Install lewat pip:

1pip install playwright selenium beautifulsoup4 pandasUntuk Playwright, kamu juga perlu menginstal browser binary:

1playwright install2. Siapkan Browser Driver

- Playwright mengelola driver-nya sendiri.

- Selenium membutuhkan atau .

- Pastikan versi browser dan driver cocok.

3. Siapkan Login

- Kamu perlu akun LinkedIn (sebaiknya akun lama, dengan aktivitas nyata).

- Untuk kebanyakan script, biasanya kamu akan:

- Mengotomatiskan alur login (berisiko CAPTCHA)

- Menyisipkan cookie sesi

li_atkamu (lebih cepat, tapi tetap berisiko)

4. Patuhi Ketentuan LinkedIn

Peringatan: Scraping LinkedIn, bahkan memakai akun milik sendiri, melanggar User Agreement mereka. Lanskap hukumnya rumit (lihat kasus hiQ v. LinkedIn), dan LinkedIn sekarang sangat agresif dalam penegakan. Gunakan script ini untuk tujuan edukasi atau riset internal, dan jangan pernah menjual atau mendistribusikan data hasil scraping secara publik.

Menavigasi Pembatasan LinkedIn: Cara Mengurangi Risiko Akun Diblokir di 2026

Di sini biasanya mulai rumit. Pertahanan anti-bot LinkedIn pada 2026 nggak main-main. Mereka sudah menutup seluruh bisnis (RIP Proxycurl) dan membatasi lebih dari 30 juta akun pada 2025 saja (). Jadi, bagaimana cara scraping tanpa kena masalah?

Risiko Utama

- Rate Limit: Pengguna tanpa login biasanya mendapat sekitar 50 tampilan profil per hari per IP. Akun yang sudah login bisa melakukan beberapa ratus sebelum terkena CAPTCHA atau banned ().

- CAPTCHA: Sering muncul, terutama setelah melihat profil atau login secara cepat beruntun.

- Pembatasan Akun: LinkedIn bisa mengunci, membatasi, atau mem-banned akun secara permanen karena aktivitas mencurigakan.

Strategi Terbukti untuk Mengurangi Risiko

- Gunakan Mobile atau Aged Residential Proxy: Mobile proxy punya tingkat bertahan 85% di LinkedIn, dibanding 50% untuk residential dan nyaris nol untuk datacenter IP ().

- Acak Jeda Waktu: Jangan pakai

time.sleep(5)yang tetap. Sebaiknya acak jeda antara 2–8 detik. - Hangatkan Akun Terlebih Dulu: Jangan langsung membuka 100 profil dari akun baru. Mulailah pelan-pelan dan tiru perilaku pengguna asli.

- Scraping di Jam Kerja: Sesuaikan dengan zona waktu akun kamu.

- Rotasi User Agent per Sesi: Tapi jangan diganti di tengah sesi—LinkedIn akan menandainya.

- Scroll Secara Natural: Gunakan browser automation untuk scroll dan memicu konten lazy-load.

- Pisahkan IP per Akun: Jangan pernah menjalankan banyak akun di balik satu proxy.

- Pantau Tanda Peringatan Awal: Error 429, redirect ke

/authwall, atau body profil kosong berarti kamu sudah dekat dengan ban.

Tips pro: Bahkan plugin stealth terbaik sekalipun (Playwright Stealth, undetected-chromedriver) cuma menutupi jejak di permukaan. Deteksi LinkedIn jauh lebih dalam—jadi jangan terlalu pede.

Memilih Library Python yang Tepat untuk Ekstraksi Data LinkedIn

Pada 2026, lanskap Python scraping sudah jauh lebih jelas. Berikut perbandingan library utamanya:

| Library | HTML Statis | JS-rendered | Login flow | Kecepatan | Paling cocok untuk |

|---|---|---|---|---|---|

| Requests + BS4 | ✅ | ❌ | ❌ | Paling cepat | Halaman kecil yang publik saja |

| Selenium 4.x | ✅ | ✅ | ✅ | Lambat | Proyek legacy, dukungan browser luas |

| Playwright (Python) | ✅ | ✅ | ✅ | Cepat | Default untuk LinkedIn di 2026 |

| Scrapy | ✅ | Dengan plugin | Dengan usaha | Cepat | Crawling terstruktur dalam volume besar |

Kenapa Playwright jadi pemenangnya untuk LinkedIn:

- 12% lebih cepat dalam memuat halaman dan 15% lebih hemat memori dibanding Selenium ()

- Mampu menangani loading asinkron LinkedIn tanpa trik manual

- Manajemen tab bawaan untuk scraping paralel

- Plugin stealth resmi untuk menghindari fingerprint dasar

Tips untuk pemula: Kalau baru mulai, Playwright adalah pilihan terbaik. Selenium masih berguna untuk proyek lama, tapi lebih lambat dan lebih mudah terdeteksi.

Langkah demi Langkah: Script Pertama Python LinkedIn Scraper Anda

Mari lihat contoh dasar memakai Selenium (untuk pemula) dan Playwright (untuk production). Ingat: script ini hanya untuk tujuan edukasi.

Contoh 1: Login dan Scrape Profil Minimal dengan Selenium

1from selenium import webdriver

2from selenium.webdriver.common.by import By

3from selenium.webdriver.common.keys import Keys

4import time, random

5driver = webdriver.Chrome()

6driver.get("https://www.linkedin.com/login")

7driver.find_element(By.ID, "username").send_keys("you@example.com")

8driver.find_element(By.ID, "password").send_keys("yourpassword" + Keys.RETURN)

9time.sleep(random.uniform(3, 6)) # jeda acak

10# Kunjungi profil

11driver.get("https://www.linkedin.com/in/some-profile/")

12time.sleep(random.uniform(4, 8))

13# Scroll untuk memicu lazy-load

14driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

15# Ambil data (disederhanakan)

16name = driver.find_element(By.CSS_SELECTOR, "h1").text

17print("Nama:", name)

18driver.quit()Catatan: Untuk production, sebaiknya kamu menyisipkan cookie li_at daripada login setiap kali (untuk menghindari CAPTCHA).

Contoh 2: Playwright Async Scraper (Direkomendasikan untuk 2026)

1import asyncio

2from linkedin_scraper import BrowserManager, PersonScraper

3async def main():

4 async with BrowserManager() as browser:

5 await browser.load_session("session.json") # menyimpan sesi login Anda

6 scraper = PersonScraper(browser.page)

7 person = await scraper.scrape("https://linkedin.com/in/username")

8 print(person.name, person.experiences)

9asyncio.run(main())()

Tempat memasukkan langkah anti-ban:

- Gunakan mobile proxy di browser manager Anda

- Acak jeda antar aksi

- Scrape dalam batch kecil, jangan sekaligus

Peringatan: Scraper berbasis selector akan rusak setiap kali LinkedIn memperbarui DOM mereka (biasanya setiap beberapa minggu). Siapkan waktu untuk maintenance script kamu.

Membersihkan dan Memformat Data LinkedIn dengan Python

Scraping itu baru setengah perang. Data LinkedIn sering berantakan—bayangkan nama duplikat, jabatan yang nggak konsisten, dan karakter Unicode yang aneh. Ini cara merapikannya:

1. Gunakan pandas untuk Mengolah Tabel

1import pandas as pd

2df = pd.read_csv("linkedin_raw.csv")

3df = df.drop_duplicates(subset=["email", "phone"]) # dedup exact

4df["name"] = df["name"].str.lower().str.strip()2. Fuzzy Matching untuk Nama Perusahaan

1from rapidfuzz import fuzz

2def is_similar(a, b):

3 return fuzz.ratio(a, b) > 90

4# Contoh: "Acme Corp" vs "ACME Corporation"3. Normalisasi Nomor Telepon dan Email

1import phonenumbers

2from email_validator import validate_email, EmailNotValidError

3# Normalisasi nomor telepon

4num = phonenumbers.parse("+1 415-555-1234", None)

5print(phonenumbers.format_number(num, phonenumbers.PhoneNumberFormat.E164))

6# Validasi email

7try:

8 v = validate_email("someone@example.com")

9 print(v.email)

10except EmailNotValidError as e:

11 print("Email tidak valid:", e)4. Ekspor ke Excel, Google Sheets, atau CRM

- Excel:

df.to_excel("cleaned_data.xlsx") - Google Sheets: Gunakan library

gspread - Airtable: Gunakan

pyairtable - Salesforce/HubSpot: Gunakan Python API client masing-masing

Tips pro: Selalu lakukan pembersihan dan deduplikasi sebelum data masuk ke CRM. Nggak ada yang lebih nyebelin bagi sales rep selain menelepon prospek yang sama dua kali.

Meningkatkan Efisiensi Scraping LinkedIn dengan Thunderbit

Sekarang, mari bicara soal bikin hidupmu jauh lebih mudah. Sebesar apa pun saya suka Python, memelihara scraper untuk LinkedIn itu rasanya seperti main pukul tikus tanpa akhir. Itulah sebabnya, di Thunderbit, kami membangun yang menghilangkan repotnya ekstraksi data LinkedIn.

Kenapa Thunderbit?

- Scraping 2 Klik: Cukup klik “AI Suggest Fields” dan Thunderbit membaca halaman, mengusulkan kolom, lalu mengekstrak datanya—tanpa kode, tanpa selector, tanpa pusing.

- Scraping Subpage: Scrape halaman hasil pencarian, lalu biarkan Thunderbit membuka tiap profil dan memperkaya tabel kamu secara otomatis.

- Template Instan: Sudah tersedia untuk LinkedIn, Amazon, Google Maps, dan lainnya—mulai dalam hitungan detik.

- Ekspor Gratis: Kirim data ke Excel, Google Sheets, Airtable, Notion, atau unduh sebagai CSV/JSON.

- AI Autofill: Otomatiskan pengisian formulir dan workflow repetitif—cocok untuk sales ops dan admin CRM.

- Cloud atau Browser Scraping: Pilih mode yang sesuai dengan use case dan kebutuhan login kamu.

- Tanpa Maintenance: AI Thunderbit beradaptasi dengan perubahan layout LinkedIn, jadi kamu nggak perlu terus-terusan memperbaiki script yang rusak.

Thunderbit dipercaya oleh lebih dari 100.000 pengguna di seluruh dunia dan memiliki rating 4,4★ di Chrome Web Store (). Buat sebagian besar pengguna bisnis, ini adalah cara tercepat dan paling aman untuk mengekstrak data LinkedIn—tanpa mempertaruhkan akun atau kewarasan kamu.

Tips Lanjutan: Menskalakan dan Mengotomatisasi Workflow Scraping LinkedIn

Kalau kamu siap naik level, berikut cara memperbesar permainan scraping LinkedIn kamu:

1. Menjadwalkan Script

- cron (Linux/Mac) atau Task Scheduler (Windows) untuk pekerjaan sederhana

- APScheduler atau Prefect 3 untuk scheduling dan retry native Python

- Airflow untuk orkestrasi tingkat enterprise

2. Deployment ke Cloud

- AWS Lambda (dengan Playwright di container)

- GCP Cloud Run

- Railway / Fly.io / Render untuk hosting Playwright yang mudah

- Apify untuk workflow cloud yang memang fokus scraping

3. Monitoring dan Deteksi Drift

- Sentry untuk pelacakan error

- Alert custom untuk lonjakan error 429 atau perubahan DOM

- Diff berbasis hash untuk mendeteksi saat layout LinkedIn berubah

4. Integrasi CRM

- Gunakan API untuk Salesforce, HubSpot, Notion, atau Airtable agar data yang sudah dibersihkan langsung masuk otomatis

- Bangun pipeline: Scheduler → Scraper → pembersihan/dedupe pandas → Enrichment → kirim ke CRM → Alert

5. Tetap Patuh

- Jangan pernah scraping lebih dari beberapa ratus profil per akun per hari

- Rotasi proxy dan user agent

- Pantau sinyal awal ban dan hentikan script jika muncul

Tips pro: Bahkan dengan semua otomatisasi ini, LinkedIn bisa saja dan memang akan mengubah aturan. Selalu siapkan rencana cadangan—dan pertimbangkan Thunderbit untuk workflow yang paling penting.

Kesimpulan & Poin Utama

Scraping LinkedIn dengan Python pada 2026 sekarang lebih kuat sekaligus lebih berisiko dari sebelumnya. Inilah yang perlu kamu ingat:

- LinkedIn adalah sumber data B2B nomor satu—tapi juga yang paling ketat pertahanannya terhadap scraper.

- Python memberi fleksibilitas maksimum untuk ekstraksi data LinkedIn, tetapi datang dengan risiko banned tinggi dan maintenance berkelanjutan.

- Playwright kini menjadi standar emas untuk scraping LinkedIn—lebih cepat dan lebih andal daripada Selenium.

- Mengurangi risiko banned bergantung pada proxy, jeda, dan meniru perilaku pengguna asli—mobile proxy bertahan 85%, residential 50%, datacenter 0%.

- Pembersihan data itu wajib—gunakan pandas, fuzzy matching, dan library validasi sebelum memasukkan data ke CRM.

- Thunderbit menawarkan alternatif yang lebih aman dan cepat—dengan scraping berbasis AI, enrichment subpage, ekspor instan, dan tanpa coding.

- Untuk scale-up, semuanya harus diotomatisasi—dari penjadwalan hingga monitoring hingga integrasi CRM.

Dan yang paling penting: scrape dengan etis dan bertanggung jawab. Tim hukum LinkedIn nggak terkenal ramah humor.

Kalau kamu sudah capek berhadapan dengan pertahanan LinkedIn yang terus berubah, . Ini tool yang dulu saya harap sudah ada waktu saya mulai—dan mungkin bisa menyelamatkan kamu (dan akun LinkedIn kamu) dari banyak masalah.

Ingin mendalami lebih jauh? Lihat untuk panduan lain tentang web scraping, otomasi, dan best practice sales ops.

FAQ

1. Apakah scraping LinkedIn dengan Python legal pada 2026?

Lanskap hukumnya kompleks. Walau kasus hiQ v. LinkedIn memutuskan bahwa scraping data publik tidak melanggar CFAA, LinkedIn tetap bisa—dan memang—menegakkan User Agreement mereka yang melarang scraping. Pada 2025, LinkedIn menutup Proxycurl dan membatasi lebih dari 30 juta akun karena scraping. Selalu gunakan script untuk tujuan internal atau edukasi, dan jangan pernah menjual atau menyebarkan data hasil scraping secara publik.

2. Apa cara paling aman untuk mengotomatisasi scraping LinkedIn?

Gunakan akun lama, mobile proxy (tingkat bertahan 85%), acak jeda, dan lakukan scraping pada jam kerja. Jangan pernah memakai datacenter IP, dan pantau sinyal awal ban. Buat kebanyakan pengguna bisnis, tools seperti menawarkan alternatif yang jauh lebih rendah risikonya dibanding script Python buatan sendiri.

3. Library Python mana yang terbaik untuk scraping LinkedIn pada 2026?

Playwright kini menjadi pilihan default—lebih cepat, lebih andal, dan lebih baik dalam menangani konten dinamis LinkedIn dibanding Selenium. Untuk halaman publik yang sederhana, Requests + Beautiful Soup masih bisa dipakai, tetapi untuk hal yang melibatkan login atau JavaScript, gunakan Playwright.

4. Bagaimana cara membersihkan dan memformat data LinkedIn setelah scraping?

Gunakan pandas untuk pengolahan tabel dan deduplikasi, RapidFuzz untuk fuzzy matching, phonenumbers dan email-validator untuk info kontak, lalu ekspor ke Excel, Google Sheets, atau CRM kamu memakai library Python masing-masing.

5. Bagaimana Thunderbit meningkatkan ekstraksi data LinkedIn?

Thunderbit memakai AI untuk menyarankan field, menangani scraping subpage, dan mengekspor data langsung ke tools favorit kamu—tanpa coding. Thunderbit juga beradaptasi dengan perubahan layout LinkedIn yang sering terjadi, sehingga mengurangi maintenance dan risiko banned. Plus, gratis untuk dicoba dan dipercaya oleh lebih dari 100.000 pengguna di seluruh dunia.

Penasaran ingin melihat scraping LinkedIn bekerja—tanpa ribet? dan mulai ekstraksi data hanya dengan dua klik. Tim sales kamu (dan akun LinkedIn kamu) akan berterima kasih.

Pelajari Lebih Lanjut