Kalau Anda pernah mencoba menyusun daftar prospek penjualan yang benar-benar tertarget, mencari pasar baru, atau membandingkan kompetitor, Anda pasti tahu betapa berharganya Google Maps. Tapi yang menarik: dengan lebih dari 1,5 miliar pencarian “dekat saya” setiap bulan dan 76% pencari lokal mengunjungi bisnis dalam 24 jam (), kebutuhan akan data bisnis berbasis lokasi yang selalu terbaru belum pernah setinggi sekarang.

Baik Anda bekerja di sales, marketing, maupun operasional, mengekstrak data terstruktur dari Google Maps bisa jadi pembeda antara cold call biasa dan lead hangat yang jauh lebih mudah dikonversi.

Saya sudah bertahun-tahun berkecimpung di SaaS dan otomasi, dan saya melihat langsung bagaimana tim memanfaatkan Python (dan sekarang, alat bertenaga AI seperti ) untuk mengubah Google Maps menjadi aset strategis.

Di panduan ini, saya akan menguraikan cara mengambil data Google Maps dengan Python di 2026—langkah demi langkah, lengkap dengan kode, tips kepatuhan, dan perbandingan dengan solusi tanpa kode. Jadi, apakah Anda pro Python atau hanya ingin jalur tercepat menuju data yang bisa langsung ditindaklanjuti, Anda ada di tempat yang tepat.

Apa Arti Mengambil Data Google Maps dengan Python?

Mari mulai dari dasar: mengambil data Google Maps dengan Python berarti mengekstrak informasi bisnis secara terprogram—seperti nama, alamat, rating, ulasan, nomor telepon, dan koordinat—dari Google Maps, supaya bisa dianalisis, difilter, dan diekspor untuk kebutuhan bisnis.

Ada dua cara utama untuk melakukannya:

- Google Maps Places API: Cara resmi dan berlisensi. Anda memakai API key untuk mengirim kueri ke server Google dan menerima data JSON terstruktur. Metode ini stabil, dapat diprediksi, dan (sebagian besar) sesuai aturan, tetapi memiliki kuota dan biaya.

- Web scraping HTML: Anda mengotomatiskan browser (dengan alat seperti Playwright atau Selenium) untuk memuat Google Maps, melakukan pencarian, lalu mengurai halaman yang dirender. Metode ini lebih fleksibel tetapi rapuh—struktur situs Google sering berubah, dan scraping HTML dapat melanggar ketentuan Google.

Bidang data umum yang bisa diekstrak:

- Nama bisnis

- Kategori/jenis

- Alamat lengkap (plus kota, provinsi, kode pos, negara)

- Latitude dan longitude

- Nomor telepon

- URL situs web

- Rating dan jumlah ulasan

- Level harga

- Status bisnis (buka/tutup)

- Jam operasional

- Place ID (pengenal unik milik Google)

- URL Google Maps

Kenapa ini penting? Karena bidang-bidang ini mendukung semuanya, mulai dari lead generation dan perencanaan wilayah sampai benchmarking kompetitor dan riset pasar. Kuncinya adalah menargetkan data yang tepat untuk tujuan bisnis Anda—jangan scraping secara membabi buta.

Mengapa Tim Sales dan Marketing Mengekstrak Data Google Maps Menggunakan Python

Mari lebih praktis. Kenapa begitu banyak tim sales dan marketing terobsesi dengan data Google Maps di 2026?

- Lead Generation: Membuat daftar bisnis lokal yang sangat tertarget, lengkap dengan info kontak dan rating, untuk kampanye outreach.

- Perencanaan Wilayah: Memetakan wilayah penjualan, zona pengiriman, atau area layanan berdasarkan kepadatan dan jenis bisnis yang nyata.

- Pemantauan Kompetitor: Melacak lokasi, rating, dan ulasan kompetitor dari waktu ke waktu untuk melihat tren dan peluang.

- Riset Pasar: Menganalisis kategori bisnis, jam buka, dan sentimen ulasan untuk menyusun strategi go-to-market.

- Pemilihan Lokasi: Untuk properti dan retail, mengevaluasi lokasi potensial berdasarkan fasilitas di sekitar, arus pengunjung, dan kompetisi.

Dampak nyata: Menurut , 92% organisasi sales berencana meningkatkan investasi AI/data, dan tim yang memakai data lokal yang tertarget melihat tingkat konversi hingga 8× lebih tinggi dibandingkan yang mengandalkan daftar cold lead generik (). Sebuah studi lead gen untuk franchise menemukan pendapatan baru $15 untuk setiap $1 yang dibelanjakan pada daftar lead berbasis Google Maps.

Memetakan tujuan bisnis ke bidang Google Maps:

| Tujuan Bisnis | Bidang Google Maps yang Dibutuhkan |

|---|---|

| Daftar lead lokal | nama, alamat, telepon, situs web, kategori |

| Perencanaan wilayah | nama, lat/lng, business_status, opening_hours |

| Benchmarking kompetitor | nama, rating, userRatingCount, priceLevel, reviews |

| Pemilihan lokasi | category, lat/lng, review density, openingDate |

| Intel sentimen/menu | reviews, editorialSummary, photos, types |

| Outreach email/telepon | nationalPhoneNumber, websiteUri (lalu diperkaya sesuai kebutuhan) |

Menyiapkan Google Maps Scraper dengan Python: Alat dan Persyaratan

Sebelum mulai scraping, Anda perlu menyiapkan lingkungan Python dan mengumpulkan alat yang tepat. Ini yang Anda butuhkan di 2026:

1. Instal Python dan Library yang Diperlukan

Versi Python yang disarankan: 3.10 atau lebih baru.

Instal library inti:

1pip install \

2 requests==2.33.1 httpx==0.28.1 \

3 beautifulsoup4==4.14.3 lxml==6.0.3 \

4 pandas==2.3.3 \

5 selenium==4.43.0 playwright==1.58.0 \

6 googlemaps==4.10.0 google-maps-places==0.8.0 \

7 schedule==1.2.2 APScheduler==3.11.2 \

8 python-dotenv==1.2.2 tenacity==9.1.4

9playwright install chromiumFungsinya:

requests,httpx: Permintaan HTTP (panggilan API)beautifulsoup4,lxml: Parsing HTML (untuk web scraping)pandas: Pembersihan, analisis, dan ekspor dataselenium,playwright: Automasi browser (untuk scraping HTML)googlemaps,google-maps-places: Klien API Google Mapsschedule,APScheduler: Penjadwalan tugaspython-dotenv: Memuat API key dengan aman dari file.envtenacity: Logika retry untuk penanganan error

2. Dapatkan Google Maps API Key (untuk scraping berbasis API)

- Buka .

- Buat atau pilih project.

- Aktifkan billing (wajib, bahkan untuk penggunaan tier gratis).

- Aktifkan “Places API (New)” di APIs & Services > Library.

- Buka Credentials > Create Credentials > API Key.

- Batasi key Anda ke API dan IP tertentu demi keamanan.

- Simpan API key di file

.env(jangan pernah commit ke kode):

1GOOGLE_MAPS_API_KEY=your_actual_api_key_hereCatatan: Per Maret 2025, Google tidak lagi menawarkan kredit gratis universal $200 per bulan. Sebagai gantinya, Anda mendapat ambang batas gratis bulanan per tier API (lihat ).

Cara Mengekstrak Data dari Google Maps Menggunakan Python: Panduan Langkah demi Langkah

Mari kita pecah dua pendekatan utama—berbasis API dan scraping HTML—supaya Anda bisa memilih yang paling cocok dengan kebutuhan Anda.

Pendekatan 1: Menggunakan Google Maps Places API (Direkomendasikan)

Langkah 1: Instal dan Impor Library yang Diperlukan

1import os

2import httpx

3import pandas as pd

4from dotenv import load_dotenvLangkah 2: Muat API Key dengan Aman

1load_dotenv()

2API_KEY = os.environ["GOOGLE_MAPS_API_KEY"]Langkah 3: Susun Kueri Pencarian Anda

Anda akan menggunakan endpoint Text Search untuk menemukan bisnis yang sesuai dengan kriteria Anda.

1URL = "https://places.googleapis.com/v1/places:searchText"

2FIELD_MASK = ",".join([

3 "places.id", "places.displayName", "places.formattedAddress",

4 "places.location", "places.rating", "places.userRatingCount",

5 "places.priceLevel", "places.types",

6 "places.nationalPhoneNumber", "places.websiteUri",

7 "nextPageToken",

8])Langkah 4: Kirim Permintaan API

1def text_search(query, lat, lng, radius=3000, min_rating=4.0):

2 body = {

3 "textQuery": query,

4 "minRating": min_rating, # filter di sisi server

5 "includedType": "restaurant",

6 "openNow": False,

7 "pageSize": 20,

8 "locationBias": {

9 "circle": {

10 "center": {"latitude": lat, "longitude": lng},

11 "radius": radius,

12 }

13 },

14 }

15 headers = {

16 "Content-Type": "application/json",

17 "X-Goog-Api-Key": API_KEY,

18 "X-Goog-FieldMask": FIELD_MASK, # Selalu set ini!

19 }

20 r = httpx.post(URL, json=body, headers=headers, timeout=30)

21 r.raise_for_status()

22 return r.json()Langkah 5: Tangani Pagination dan Kumpulkan Hasil

1def collect_all_results(query, lat, lng, radius=3000, min_rating=4.0):

2 results = []

3 next_page_token = None

4 while True:

5 data = text_search(query, lat, lng, radius, min_rating)

6 places = data.get('places', [])

7 results.extend(places)

8 next_page_token = data.get('nextPageToken')

9 if not next_page_token:

10 break

11 return resultsLangkah 6: Ekspor Data dengan Pandas

1df = pd.DataFrame(collect_all_results("coffee shops in Brooklyn", 40.6782, -73.9442))

2df.to_csv("brooklyn_coffee_shops.csv", index=False)Tips pro:

- Selalu set header

X-Goog-FieldMaskuntuk mengontrol biaya. Jika Anda meminta ulasan atau foto, harga per 1.000 permintaan bisa naik dari $5 menjadi $25 (). - Gunakan filter di sisi server (seperti

minRating,includedType,locationBias) agar tidak membuang kredit pada hasil yang tidak relevan. - Simpan cache nilai

place_iduntuk deduplikasi dan pembaruan di masa depan.

Pendekatan 2: Web Scraping HTML Google Maps (Untuk Penggunaan Edukasi/Sekali Pakai)

Peringatan: Google Maps adalah aplikasi satu halaman. Anda harus memakai automasi browser (Playwright atau Selenium), dan scraping HTML dapat melanggar ketentuan Google. Gunakan ini untuk riset, bukan produksi.

Langkah 1: Instal Playwright dan Jalankan Browser

1from playwright.sync_api import sync_playwright

2import time, re

3def scrape_maps(query, max_results=100):

4 with sync_playwright() as pw:

5 browser = pw.chromium.launch(headless=True)

6 ctx = browser.new_context(

7 user_agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

8 locale="en-US",

9 )

10 page = ctx.new_page()

11 page.goto("https://www.google.com/maps", timeout=60_000)

12 page.fill("#searchboxinput", query)

13 page.click('button[aria-label="Search"]')

14 page.wait_for_selector('div[role="feed"]')

15 feed = page.locator('div[role="feed"]')

16 prev = 0

17 while True:

18 feed.evaluate("el => el.scrollBy(0, el.scrollHeight)")

19 time.sleep(2)

20 count = page.locator('div[role="feed"] > div > div[jsaction]').count()

21 if count == prev or count >= max_results:

22 break

23 prev = count

24 if page.locator("text=You've reached the end of the list").count():

25 break

26 rows = []

27 cards = page.locator('div[role="feed"] > div > div[jsaction]')

28 for i in range(cards.count()):

29 c = cards.nth(i)

30 name = c.locator("div.fontHeadlineSmall").inner_text() if c.locator("div.fontHeadlineSmall").count() else ""

31 rating_el = c.locator('span[role="img"]').first

32 raw = rating_el.get_attribute("aria-label") if rating_el.count() else ""

33 m = re.search(r"([\d.]+)\s+stars?\s+([\d,]+)\s+Reviews", raw or "")

34 rating = float(m.group(1)) if m else None

35 reviews = int(m.group(2).replace(",", "")) if m else None

36 rows.append({"name": name, "rating": rating, "reviews": reviews})

37 browser.close()

38 return rowsTips:

- Google mengacak class CSS setiap beberapa minggu, jadi kode ini mungkin perlu diperbarui secara berkala.

- Gunakan jeda yang menyerupai perilaku manusia dan hindari scraping terlalu cepat untuk mengurangi risiko diblokir.

- Jangan pernah mencoba melewati CAPTCHA atau sistem SearchGuard Google—ini bisa membuat Anda menghadapi risiko hukum.

Hindari Scraping Membabi Buta: Cara Menargetkan Data yang Anda Butuhkan dengan Presisi

Scraping semuanya hanya akan membuang waktu dan membuat dataset membengkak. Berikut cara untuk menargetkan hanya data yang penting:

- Buat daftar URL yang tertarget: Gunakan filter pencarian Google Maps sendiri (kategori, lokasi, rating, buka sekarang) untuk mempersempit hasil sebelum scraping.

- Gunakan pencocokan frasa: Cari jenis bisnis atau kata kunci yang spesifik (misalnya, “vegan bakery in Austin”).

- Filter lokasi: Tentukan kota, lingkungan, atau bahkan koordinat dan radius untuk akurasi yang sangat presisi.

- Filter di sisi server (API): Gunakan

minRating,includedType, danlocationBiasdi body permintaan API Anda. - Filter di sisi klien (Python): Setelah scraping, gunakan pandas untuk memfilter bisnis dengan rating di atas 4.0, lebih dari 50 ulasan, atau kategori tertentu.

Contoh: Memfilter hanya restoran di Manhattan dengan rating di atas 4.0

1df = pd.DataFrame(results)

2filtered = df[(df['rating'] >= 4.0) & (df['types'].apply(lambda x: 'restaurant' in x))]

3filtered.to_csv("manhattan_top_restaurants.csv", index=False)Menggunakan Library Python untuk Mengatur dan Mengekspor Data Google Maps

Setelah data berhasil di-scrape, saatnya membersihkan, menganalisis, dan mengekspornya untuk tim Anda.

Membersihkan dan Menyusun Data dengan Pandas

1import pandas as pd

2df = pd.read_json("brooklyn_restaurants.json")

3df = (

4 df.dropna(subset=["name", "address"])

5 .drop_duplicates(subset=["place_id"])

6 .assign(

7 name=lambda d: d["name"].str.strip(),

8 phone=lambda d: d["phone"].astype(str)

9 .str.replace(r"\D", "", regex=True)

10 .str.replace(r"^1?(\d\{10\})$", r"+1\1", regex=True),

11 rating=lambda d: pd.to_numeric(d["rating"], errors="coerce"),

12 user_ratings_total=lambda d: pd.to_numeric(

13 d["user_ratings_total"], errors="coerce"

14 ).fillna(0).astype("int32"),

15 )

16)Menganalisis dan Meringkas Data

Contoh: Rating rata-rata berdasarkan lingkungan

1by_neighborhood = (

2 df.groupby("neighborhood", as_index=False)

3 .agg(avg_rating=("rating", "mean"),

4 n_places=("place_id", "nunique"),

5 median_reviews=("user_ratings_total", "median"))

6 .sort_values("avg_rating", ascending=False)

7)Mengekspor ke Excel atau CSV

1df.to_csv("brooklyn_top.csv", index=False)

2df.to_excel("brooklyn_top.xlsx", index=False, sheet_name="Top Rated")Dataset besar? Gunakan format Parquet untuk kecepatan dan efisiensi ukuran:

1df.to_parquet("brooklyn_top.parquet", compression="zstd")Thunderbit: Alternatif Bertenaga AI untuk Google Maps Scraper Python

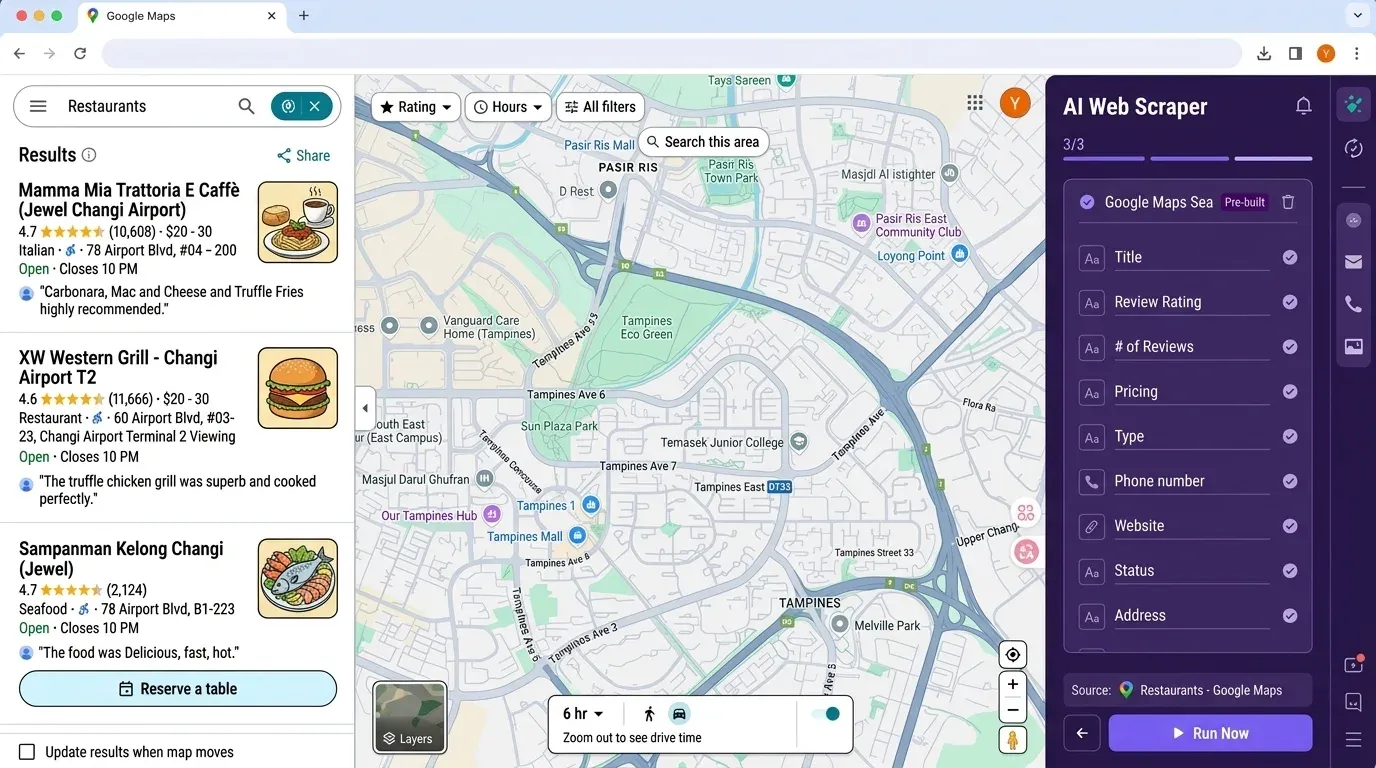

Sekarang, kalau Anda berpikir, “Ini terlalu banyak langkah untuk sekadar daftar lead,” Anda tidak sendirian. Itulah alasan kami membangun —web scraper tanpa kode yang didukung AI, yang membuat ekstraksi data Google Maps (dan banyak lagi) semudah beberapa klik.

Kenapa Thunderbit?

- Tanpa coding atau API key: Cukup buka , buka Google Maps, lalu klik “AI Suggest Fields.”

- Deteksi field berbasis AI: AI Thunderbit membaca halaman dan menyarankan kolom yang tepat—nama, alamat, rating, telepon, situs web, dan lainnya.

- Scraping subhalaman: Ingin memperkaya tabel dengan data dari situs web tiap bisnis? Thunderbit bisa mengunjungi setiap subhalaman dan menarik info tambahan secara otomatis.

- Ekspor ke Excel, Google Sheets, Airtable, atau Notion: Tak perlu lagi mengutak-atik pandas—cukup klik “Export” dan data Anda siap dipakai tim.

- Scraping terjadwal: Atur tugas berulang untuk memantau kompetitor atau menyegarkan daftar lead secara otomatis.

- Tanpa perawatan: AI Thunderbit menyesuaikan diri dengan perubahan situs, jadi Anda tidak terus-menerus memperbaiki skrip yang rusak.

Alur kerja Thunderbit vs Python:

| Langkah | Python Scraper | Thunderbit |

|---|---|---|

| Instal alat | 30–60 menit (Python, pip, library) | 2 menit (Chrome Extension) |

| Setup API key | 10–30 menit (Cloud Console) | Tidak perlu |

| Pemilihan field | Kode manual, field mask | AI Suggest Fields (1 klik) |

| Ekstraksi data | Tulis/jalankan skrip, tangani error | Klik “Scrape” |

| Ekspor | pandas ke CSV/Excel | Ekspor ke Excel/Sheets/Notion |

| Pemeliharaan | Update manual saat situs berubah | AI menyesuaikan otomatis |

Bonus: Thunderbit dipercaya oleh lebih dari , dan paket gratisnya memungkinkan Anda men-scrape hingga 6 halaman (atau 10 dengan trial boost) tanpa biaya.

Tetap Patuh: Ketentuan Layanan Google Maps dan Etika Scraping

Di sinilah banyak tutorial Python jadi berbahaya karena sudah ketinggalan zaman. Ini yang perlu Anda tahu di 2026:

- Google Maps Platform ToS §3.2.3 secara tegas melarang scraping, caching, atau mengekspor data di luar API resmi (). Satu-satunya pengecualian: nilai latitude/longitude boleh disimpan hingga 30 hari; Place ID bisa disimpan tanpa batas waktu.

- Pengguna API terikat kontrak: Jika Anda memakai API key, Anda telah menyetujui ketentuan Google—meskipun Anda hanya men-scrape data publik.

- Melewati hambatan teknis (CAPTCHA, SearchGuard) kini bisa menjadi pelanggaran DMCA §1201, yang dapat berujung pada sanksi pidana ().

- GDPR dan hukum privasi: Jika Anda mengumpulkan data pribadi (email, telepon, nama reviewer) dari Google Maps, Anda harus memiliki dasar hukum yang sah dan menghormati permintaan penghapusan. CNIL Prancis menjatuhkan denda €200.000 kepada KASPR pada 2024 karena scraping kontak LinkedIn ().

- Praktik terbaik:

- Gunakan Places API sebagai pilihan default jika memungkinkan.

- Batasi laju permintaan (≤10 QPS untuk API, 1–2 req/det untuk scraping HTML).

- Jangan pernah melewati CAPTCHA atau blok teknis.

- Jangan mendistribusikan ulang data pribadi hasil scraping.

- Patuhi permintaan opt-out dan penghapusan.

- Selalu tinjau hukum setempat—GDPR, CCPA, dan aturan lain benar-benar ditegakkan.

Intinya: Jika kepatuhan menjadi perhatian, tetaplah memakai API dan minimalkan data yang Anda kumpulkan. Bagi kebanyakan pengguna bisnis, alat tanpa kode seperti Thunderbit mengurangi risiko Anda (tanpa API key, tanpa redistribusi).

Menjadwalkan dan Mengotomatiskan Scraping Google Maps dengan Python

Kalau Anda perlu menjaga data tetap segar—misalnya untuk pemantauan kompetitor mingguan atau pembaruan daftar lead bulanan—otomasi adalah sahabat Anda.

Penjadwalan Sederhana dengan schedule

1import schedule, time

2from my_scraper import run_job

3schedule.every().day.at("03:00").do(run_job, query="restaurants in Brooklyn")

4schedule.every(6).hours.do(run_job, query="coffee shops in Manhattan")

5while True:

6 schedule.run_pending()

7 time.sleep(30)Penjadwalan Siap Produksi dengan APScheduler

1from apscheduler.schedulers.background import BackgroundScheduler

2from apscheduler.triggers.cron import CronTrigger

3sched = BackgroundScheduler(timezone="America/New_York")

4sched.add_job(

5 run_job,

6 CronTrigger(hour=3, minute=15, jitter=600), # 03.15 ± 10 menit

7 kwargs={"query": "restaurants in Brooklyn"},

8 id="brooklyn_daily",

9 max_instances=1,

10 coalesce=True,

11 misfire_grace_time=3600,

12)

13sched.start()Tips untuk Otomasi yang Aman

- Tambahkan jitter acak pada jadwal agar tidak terlihat pola yang mudah ditebak.

- Untuk scraping HTML, jangan pernah menjalankan lebih dari 1–2 permintaan per detik.

- Untuk penggunaan API, pantau kuota Anda dan aktifkan peringatan billing.

- Selalu catat error dan simpan file “dead-letter” untuk permintaan yang gagal.

Bonus Thunderbit: Dengan Thunderbit, Anda bisa menjadwalkan scraping berulang langsung di UI—tanpa kode, tanpa cron job, tanpa setup server.

Poin Utama: Ekstraksi Data Google Maps yang Efisien, Tertarget, dan Patuh Aturan

Mari kita rangkum inti pembahasannya:

- Google Maps adalah sumber nomor 1 untuk data lokasi bisnis, mendukung semuanya, dari lead gen sampai riset pasar.

- Scraping dengan Python menawarkan fleksibilitas dan kontrol, tetapi datang dengan beban setup, pemeliharaan, dan kepatuhan—terutama ketika langkah anti-bot Google dan penegakan hukum makin ketat.

- Ekstraksi berbasis API adalah jalur paling aman dan paling mudah diskalakan untuk sebagian besar tim. Selalu gunakan field mask dan filter di sisi server untuk mengontrol biaya.

- Scraping HTML rapuh dan berisiko—gunakan hanya untuk riset sekali pakai, dan jangan pernah melewati hambatan teknis.

- Targetkan data Anda: Gunakan pencocokan frasa, filter lokasi, dan alur kerja pandas untuk mengekstrak hanya yang Anda perlukan.

- Thunderbit adalah jalur tercepat untuk non-coder: didukung AI, tanpa setup, ekspor instan, dan penjadwalan bawaan.

- Kepatuhan itu penting: Hormati ketentuan Google, hukum privasi, dan batas laju permintaan agar tidak berurusan dengan masalah hukum.

Untuk tutorial dan tips lainnya, lihat dan kami.

FAQ

1. Apakah legal mengambil data Google Maps dengan Python di 2026?

Mengambil data Google Maps melalui API resmi diperbolehkan selama masih dalam ketentuan Google, asalkan Anda menghormati kuota dan tidak mendistribusikan ulang data yang dibatasi. Scraping HTML Google Maps secara eksplisit dilarang oleh ToS Google dan berisiko secara hukum, terutama jika Anda melewati hambatan teknis atau mengumpulkan data pribadi tanpa persetujuan. Selalu cek hukum setempat (GDPR, CCPA, dll.) dan ikuti praktik terbaik kepatuhan.

2. Apa bedanya memakai Google Maps API dan web scraping HTML?

API bersifat stabil, berlisensi, dan memang dirancang untuk ekstraksi data, tetapi memerlukan API key serta tunduk pada kuota dan biaya. Scraping HTML memakai automasi browser untuk mengekstrak data dari halaman yang dirender, tetapi rapuh (struktur situs sering berubah), bisa melanggar ketentuan, dan lebih berisiko secara hukum. Untuk sebagian besar kebutuhan bisnis, API adalah jalur yang direkomendasikan.

3. Berapa biaya untuk mengekstrak data Google Maps menggunakan Python di 2026?

Harga Places API Google dihitung per 1.000 permintaan, mulai dari $5 (Essentials) hingga $25 (Enterprise+Atmosphere), tergantung field yang Anda minta. Ada ambang batas gratis bulanan (10.000 untuk Essentials, 5.000 untuk Pro, 1.000 untuk Enterprise), tetapi scraping skala besar bisa cepat menambah biaya. Selalu gunakan field mask dan filter di sisi server untuk mengontrol biaya.

4. Bagaimana Thunderbit dibandingkan dengan scraper Google Maps berbasis Python?

Thunderbit adalah web scraper tanpa kode yang didukung AI, memungkinkan Anda mengekstrak data Google Maps (dan banyak lagi) tanpa pemrograman, API key, atau pemeliharaan. Ini ideal untuk tim sales dan marketing yang ingin ekspor cepat dan andal ke Excel, Google Sheets, Airtable, atau Notion. Untuk pengguna teknis yang butuh logika kustom, Python menawarkan fleksibilitas lebih, tetapi membutuhkan setup dan pengelolaan kepatuhan yang lebih besar.

5. Bagaimana cara mengotomatiskan ekstraksi data Google Maps yang berulang?

Dengan Python, gunakan library penjadwalan seperti schedule atau APScheduler untuk menjalankan scraper pada interval tertentu (harian, mingguan, dan seterusnya). Tambahkan jitter acak agar tidak mudah terdeteksi dan pantau kuota API Anda. Dengan Thunderbit, Anda bisa menjadwalkan scraping berulang langsung di UI—tanpa kode atau setup server.

Siap mengubah Google Maps menjadi kekuatan super untuk sales dan marketing Anda? Baik Anda penggemar Python atau ingin solusi tanpa kode yang paling cepat, alatnya sudah tersedia di 2026. Coba untuk scraping instan bertenaga AI—atau turun langsung ke API dan mulai membangun. Apa pun pilihannya, semoga daftar lead Anda selalu segar, ekspor Anda rapi, dan kampanye Anda dipenuhi prospek lokal berkualitas tinggi yang mudah dikonversi. Selamat scraping!

Pelajari Lebih Lanjut