Kecepatan berita digital saat ini benar-benar luar biasa. Setiap menit, ribuan judul berita dipublikasikan, diperbarui, atau diam-diam diedit—di media arus utama, blog niche, dan feed media sosial.

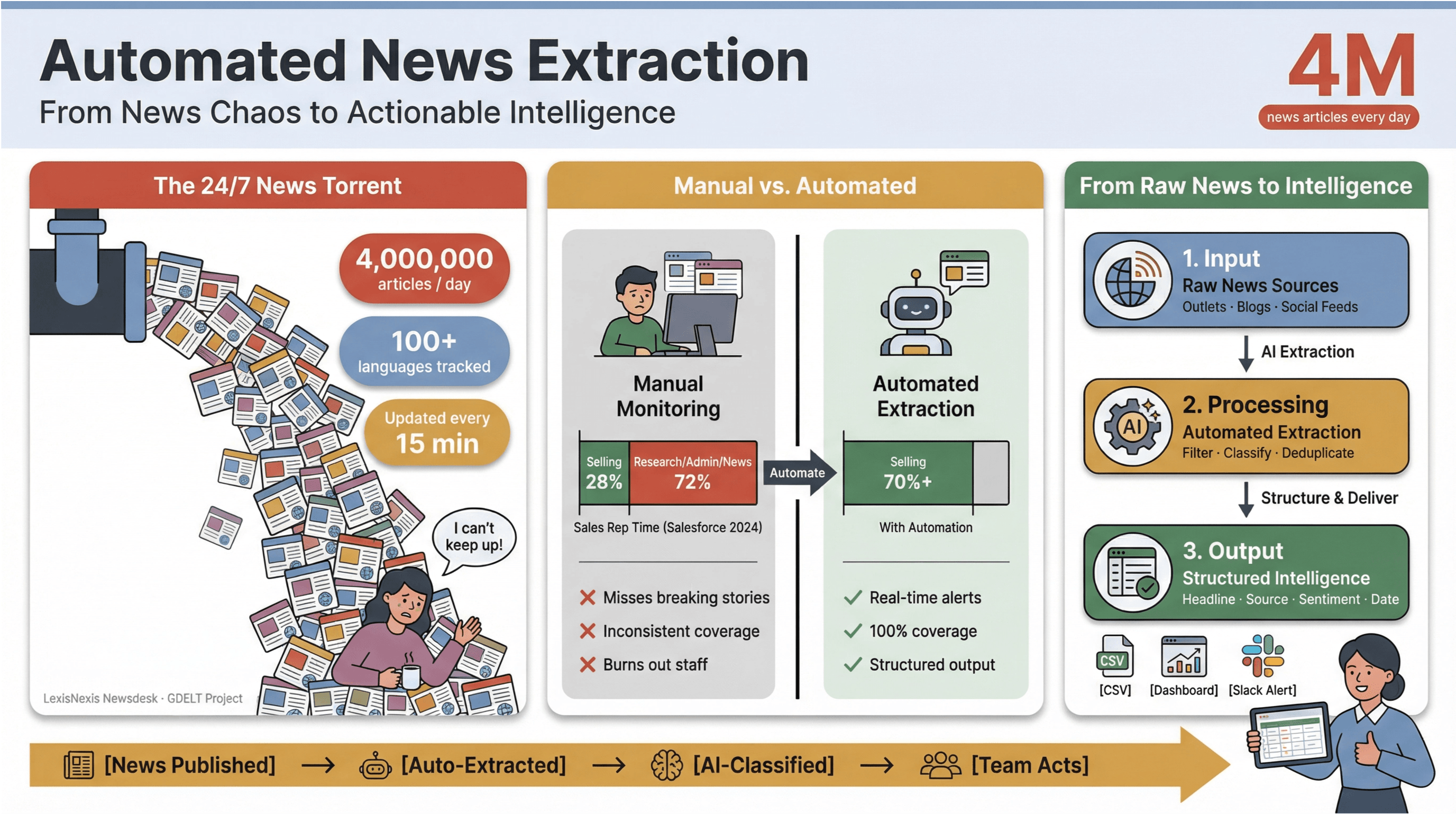

Sebagai gambaran, memproses lebih dari 4 juta artikel berita setiap hari, sementara melacak berita dalam 100+ bahasa dan memperbarui feed globalnya setiap 15 menit.

Bagi siapa pun yang bekerja di media, riset, atau business intelligence, mencoba mengikuti derasnya arus ini secara manual ibarat menimba kapal yang hampir tenggelam dengan cangkir kopi.

Saya sudah melihat langsung bagaimana pemantauan berita manual menghabiskan waktu dan menguras sumber daya. Tim sales menghabiskan kurang dari sepertiga waktunya untuk benar-benar menjual——sisanya habis untuk riset, administrasi, dan ya, bolak-balik membuka tab berita tanpa henti.

Itulah mengapa ekstraksi berita otomatis menjadi senjata rahasia bagi tim modern: ini satu-satunya cara untuk mengubah kekacauan siklus berita 24/7 menjadi intel yang terstruktur dan bisa ditindaklanjuti—tanpa membuat tim kelelahan atau melewatkan cerita yang paling penting.

Mari kita bahas apa sebenarnya yang dimaksud dengan ekstraksi berita otomatis, mengapa ini penting bagi siapa pun yang peduli pada data berita real-time, dan bagaimana membangun alur kerja yang tangguh dan patuh aturan menggunakan alat terbaik (termasuk bagaimana membuat seluruh prosesnya sangat sederhana—bahkan untuk orang non-teknis seperti ibu saya).

Ekstraksi Berita Otomatis: Mengapa Ini Penting untuk Ruang Redaksi Modern

Ekstraksi berita otomatis persis seperti namanya: menggunakan software untuk mengumpulkan konten berita secara otomatis dan mengubahnya menjadi data yang terstruktur dan mudah dicari—bayangkan baris dan kolom, bukan halaman web atau PDF yang berantakan. Dalam praktiknya, ini berarti Anda bisa memantau ratusan (atau ribuan) sumber, mengekstrak field penting seperti judul, cap waktu, penulis, dan isi teks, lalu mengalirkan data itu ke dashboard, alert, atau analitik lanjutan—tanpa pernah menyentuh Ctrl+C/Ctrl+V.

Mengapa ini penting? Karena di lanskap berita saat ini, kecepatan adalah segalanya. Baik Anda editor ruang redaksi, manajer PR yang memantau penyebutan merek, atau analis bisnis yang mengikuti gerak kompetitor, menjadi yang pertama tahu bisa berarti perbedaan antara menangkap peluang atau tertinggal. Alat ekstraksi otomatis memungkinkan bahkan tim kecil untuk tampil jauh lebih besar—mengumpulkan data berita real-time dari seluruh web, mengurangi beban kerja manual, dan menampilkan cerita yang paling penting.

Mengapa ini penting? Karena di lanskap berita saat ini, kecepatan adalah segalanya. Baik Anda editor ruang redaksi, manajer PR yang memantau penyebutan merek, atau analis bisnis yang mengikuti gerak kompetitor, menjadi yang pertama tahu bisa berarti perbedaan antara menangkap peluang atau tertinggal. Alat ekstraksi otomatis memungkinkan bahkan tim kecil untuk tampil jauh lebih besar—mengumpulkan data berita real-time dari seluruh web, mengurangi beban kerja manual, dan menampilkan cerita yang paling penting.

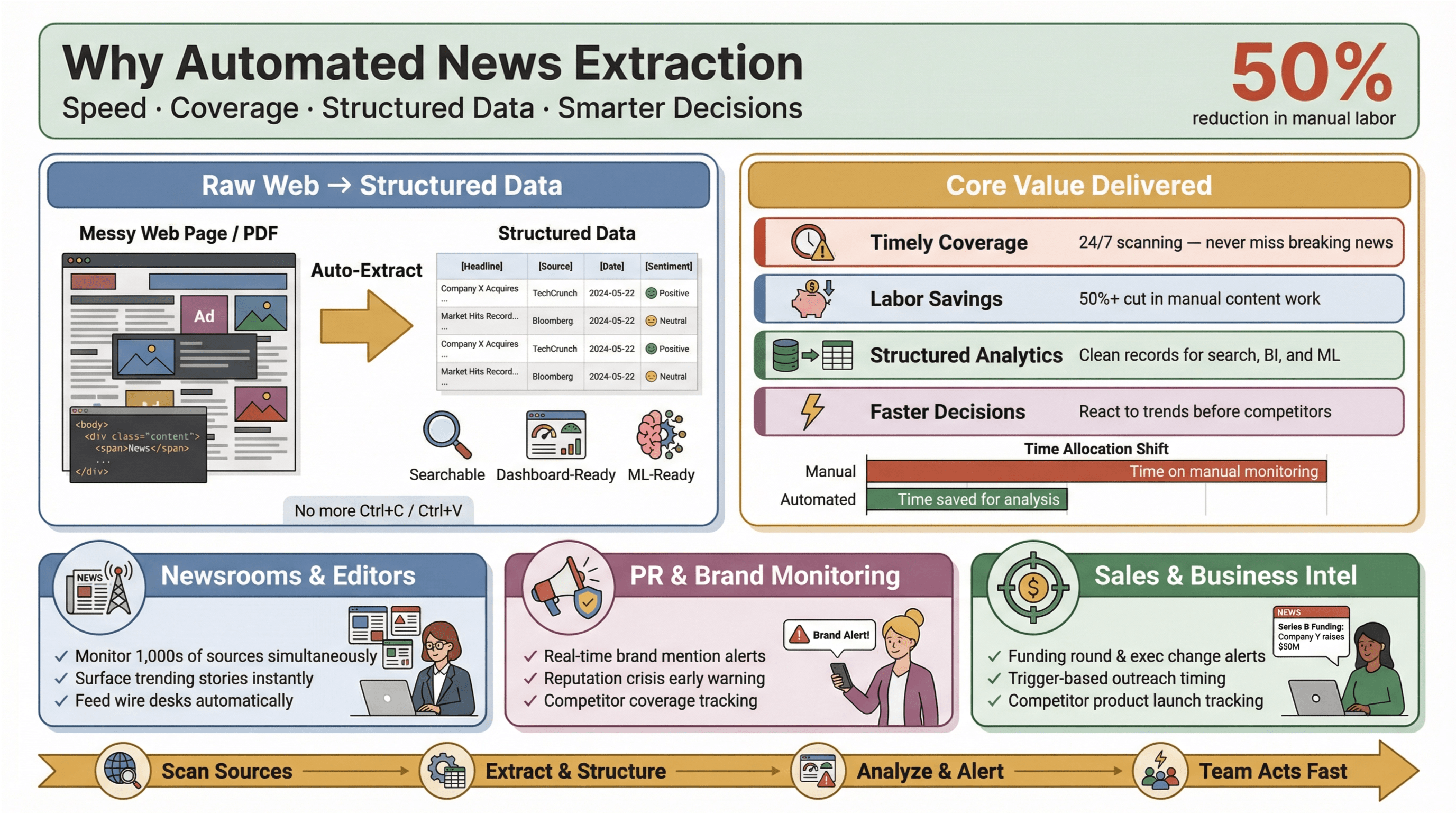

Dan dampaknya nyata: studi menunjukkan bahwa otomatisasi bisa memangkas kerja manual untuk pembaruan konten hingga setidaknya 50%, sehingga waktu bisa dipakai untuk analisis dan pengambilan keputusan yang sesungguhnya.

Nilai Inti Ekstraksi Berita Otomatis di Industri Berita

Mari kita lebih praktis. Apa sebenarnya yang diberikan ekstraksi berita otomatis untuk ruang redaksi dan tim bisnis?

- Liputan yang tepat waktu dan menyeluruh: Tidak ada lagi berita penting yang terlewat hanya karena seseorang lupa memeriksa feed. Alat otomatis memindai sumber 24/7, memastikan Anda tidak ketinggalan momen apa pun.

- Hemat tenaga dan biaya: Tim kecil maupun menengah bisa memantau sebanyak sumber seperti perusahaan besar—tanpa harus merekrut pasukan intern.

- Data terstruktur untuk analitik: Alih-alih menyaring artikel yang tidak terstruktur, Anda mendapatkan catatan yang bersih dan rapi, siap untuk pencarian, dashboard, dan machine learning.

- Keputusan yang lebih cepat dan cerdas: Data berita real-time berarti Anda bisa merespons perubahan pasar, krisis PR, atau tren yang muncul sebelum kompetitor.

Ambil contoh PR dan komunikasi: platform seperti dan memposisikan pemantauan media real-time sebagai hal yang penting untuk melindungi reputasi dan bertindak cepat terhadap pemberitaan yang merugikan. Di sales, alert berita real-time menjadi “context card” untuk prospecting—misalnya putaran pendanaan, pergantian eksekutif, atau peluncuran produk yang memicu outreach pada saat yang tepat.

Memilih Alat News scraping yang Tepat untuk Berbagai Skenario

Tidak semua alat news scraping dibuat sama. Pilihan yang tepat bergantung pada tujuan, tingkat kenyamanan teknis, dan jenis berita yang Anda pedulikan. Berikut kerangka yang bisa membantu Anda memilih yang paling cocok:

Menilai Kemudahan Penggunaan dan Aksesibilitas

Bagi sebagian besar pengguna bisnis dan jurnalis, kemudahan penggunaan itu wajib. Anda butuh alat yang langsung bisa dipakai, tanpa coding atau setup yang rumit. Platform no-code dan low-code seperti , , dan memungkinkan Anda membangun scraper secara visual—cukup arahkan, klik, lalu ekstrak.

Thunderbit, khususnya, menonjol dengan proses dua langkah: jelaskan apa yang Anda inginkan, biarkan AI menyarankan field, lalu tekan “Scrape.” Bahkan pengguna non-teknis bisa menyiapkan pipeline data berita dalam hitungan menit, bukan jam.

Pertimbangan Keamanan dan Privasi Data

Semakin besar data, semakin besar pula tanggung jawabnya. Alat news scraping sering mengakses konten sensitif, jadi keamanan dan kepatuhan harus jadi prioritas. Perhatikan:

- Enkripsi data (saat transit dan saat disimpan)

- Kebijakan privasi yang jelas (Thunderbit, misalnya, menyatakan tidak menjual data pengguna dan hanya mengakses konten yang Anda pilih untuk di-scrape)

- Izin yang terperinci (terutama untuk ekstensi browser—selalu cek data apa saja yang bisa diakses alat tersebut)

- Kepatuhan terhadap hukum setempat (GDPR, CCPA, dan untuk pengguna UE, )

Untuk ketenangan ekstra, pilih vendor yang bereputasi baik, verifikasi izin ekstensi, dan batasi akses hanya pada yang benar-benar diperlukan.

Mencocokkan Alat dengan Jenis Berita dan Kebutuhan Industri

Beberapa alat unggul pada domain berita tertentu:

- Keuangan: API seperti dan menawarkan clustering, sentiment, dan deteksi peristiwa untuk berita finansial.

- Teknologi & Startup: Scraping kustom dengan Thunderbit atau Octoparse memungkinkan Anda menargetkan blog niche, press release, atau daftar acara.

- Politik & Kebijakan: Basis data berlisensi seperti dan menyediakan akses ke sumber premium dan arsip.

Jika Anda perlu memantau campuran sumber arus utama, niche, dan internasional—termasuk yang tidak punya API—scraper berbasis AI yang fleksibel seperti Thunderbit adalah pilihan terbaik.

Keunggulan Unik Thunderbit untuk Ekstraksi Data Berita Real-Time

Sekarang, mari kita bahas apa yang membuat jadi pilihan unggulan untuk ekstraksi berita otomatis—terutama jika Anda ingin data berita real-time tanpa kerepotan teknis.

Thunderbit adalah ekstensi Chrome AI-powered web scraper yang dirancang untuk pengguna bisnis, jurnalis, dan analis yang membutuhkan konten berita terstruktur dan terbaru dari situs apa pun. Inilah alasan mengapa ini jadi andalan saya:

- AI Suggest Fields: Thunderbit membaca halaman berita dan secara otomatis menyarankan kolom terbaik untuk diekstrak—judul, cap waktu, penulis, ringkasan, dan lainnya. Tidak perlu repot dengan selector atau template.

- Subpage Scraping: Butuh artikel lengkap, bukan hanya judulnya? Thunderbit bisa membuka setiap link berita, mengekstrak isi teks, entity, dan tag, lalu menggabungkannya ke dalam satu tabel terstruktur.

- Bulk Export & Instant Updates: Ekspor data berita langsung ke Excel, Google Sheets, Airtable, atau Notion dengan satu klik. Tidak ada lagi maraton copy-paste atau berurusan dengan CSV.

- Scheduled Scraping: Atur pekerjaan berulang (setiap jam, setiap hari, atau interval kustom) agar pipeline berita tetap segar—ideal untuk berita breaking, pemantauan pasar, atau riset berkelanjutan.

- Adaptabilitas: AI Thunderbit menyesuaikan diri dengan perubahan layout dan situs berita long-tail, sehingga Anda menghabiskan lebih sedikit waktu memperbaiki scraper yang rusak dan lebih banyak waktu menganalisis data.

Dengan lebih dari dan rating 4,8 bintang, Thunderbit dipercaya oleh tim di seluruh dunia untuk berbagai kebutuhan, mulai dari pemantauan PR hingga competitive intelligence.

Deteksi Field Berbasis AI dan Subpage Scraping

Salah satu fitur andalan Thunderbit adalah deteksi field berbasis AI. Cukup klik “AI Suggest Fields,” dan alat ini akan memindai halaman berita—mengidentifikasi field penting seperti judul, tanggal, penulis, dan ringkasan. Anda bisa menyesuaikan atau menambahkan field khusus (misalnya, “beri tag artikel ini sebagai ‘earnings’ jika menyebut hasil kuartalan”), dan AI Thunderbit akan menangani sisanya.

Subpage scraping adalah pengubah permainan untuk berita: scrape halaman utama atau daftar bagian untuk judul, lalu biarkan Thunderbit membuka setiap URL artikel untuk mengekstrak cerita lengkap, entity, dan bahkan gambar. Artinya Anda mendapatkan catatan berita yang lengkap dan diperkaya—siap untuk pencarian, dashboard, atau analisis AI lanjutan.

Ekspor Massal dan Pembaruan Instan

Thunderbit membuat ekspor data berita jadi mudah. Dengan satu klik, Anda bisa mengirim feed berita terstruktur ke Google Sheets, Airtable, Notion, atau mengunduhnya sebagai CSV/Excel. Bagi tim yang hidup di spreadsheet atau alat BI, ini sangat menghemat waktu.

Dan karena Thunderbit mendukung scheduled scraping, Anda bisa mengaturnya berjalan setiap jam, setiap hari, atau sesuai jadwal kustom Anda—memastikan data berita selalu terbaru. Tidak perlu lagi menunggu Google Alerts mengindeks berita dengan keterlambatan berhari-hari.

Mengatasi Tantangan Operasional dalam Solusi Data Berita Real-Time

Bahkan dengan alat terbaik, ekstraksi berita real-time tetap memiliki tantangan tersendiri. Berikut cara mengatasi yang paling umum:

Mengelola Latensi dan Kesegaran Data

- Jadwalkan scraping berdasarkan kecepatan berita: Untuk berita breaking, atur scraper berjalan setiap 15–30 menit (menyesuaikan ). Untuk beat yang lebih lambat, harian atau per jam mungkin sudah cukup.

- Pantau jeda antara waktu terbit dan waktu pengambilan: Lacak selisih antara kapan artikel dipublikasikan dan kapan sistem Anda mengambilnya. Jika jedanya makin besar, cek kemungkinan blokir atau perlambatan.

- Scrape ulang untuk “quiet edits”: Artikel berita sering diperbarui setelah terbit. Jadwalkan scrape kedua 24 jam kemudian untuk menangkap koreksi atau edit diam-diam ().

Menangani Batas API dan Variasi Sumber

- Patuhi kuota API: Jika Anda menggunakan news API, perhatikan rate limit—sebarkan permintaan dari waktu ke waktu, dan cache hasil bila memungkinkan ().

- Deduplikasi dan kanonisasi: Cerita berita sering muncul di beberapa URL atau diperbarui. Tangkap canonical URL dan gunakan hash (misalnya, judul + tanggal) untuk menghindari duplikasi ().

- Tangani konten dinamis: Untuk situs dengan infinite scroll atau lazy loading, gunakan alat yang mendukung dynamic rendering dan pantau perubahan layout ().

Analisis Data Berita yang Cerdas: Peran AI dan Machine Learning

Mengekstrak berita hanyalah langkah pertama. Nilai sesungguhnya datang dari menganalisis dan bertindak berdasarkan data itu—dan di sinilah AI dan machine learning bersinar.

- Ekstraksi entity: Gunakan NLP untuk menarik nama orang, organisasi, dan tempat yang disebut dalam setiap artikel ().

- Klasifikasi topik: Secara otomatis beri tag artikel berdasarkan topik, sentimen, atau urgensi—memungkinkan dashboard dan alert yang lebih cerdas ().

- Pengelompokan peristiwa: Kelompokkan cerita yang duplikat atau saling terkait dari berbagai media, sehingga Anda melihat gambaran besarnya (bukan sekadar banjir judul yang hampir sama).

- Personalisasi dan penargetan: Gunakan data berita real-time untuk mensegmentasi audiens, meningkatkan targeting iklan, atau merekomendasikan konten—menaikkan engagement dan ROI.

Misalnya, tim PR menggunakan analitik berita real-time untuk menemukan krisis yang muncul sebelum viral, sementara tim sales memperkaya daftar prospek dengan “trigger event” seperti putaran pendanaan atau perekrutan eksekutif.

Checklist Praktik Terbaik untuk Ekstraksi Berita Otomatis

Berikut checklist ringkas agar pipeline ekstraksi berita Anda tetap berjalan lancar:

| Praktik Terbaik | Mengapa Penting | Cara Menerapkannya |

|---|---|---|

| Jadwalkan scraping yang sering | Minimalkan jeda data, tangkap berita breaking | Sesuaikan frekuensi pembaruan dengan kecepatan berita (misalnya setiap 15 menit untuk beat yang cepat) |

| Gunakan ekstraksi berbasis AI | Menyesuaikan diri dengan perubahan layout, mengurangi waktu setup | Alat seperti Thunderbit, Diffbot, Zyte API |

| Deduplikasi dan kanonisasi | Hindari alert duplikat, pastikan data bersih | Tangkap canonical URL, gunakan hash untuk deduplikasi |

| Pantau kualitas ekstraksi | Temukan field yang hilang, pergeseran, atau kegagalan | Lacak % catatan lengkap, jeda, dan tingkat error |

| Patuhi batasan hukum/kepatuhan | Hindari risiko hukum, jaga kepercayaan | Utamakan API/feed resmi, tinjau syarat, minimalkan data pribadi |

| Ekspor ke format terstruktur | Memudahkan analitik lanjutan | CSV, Excel, Sheets, Notion, Airtable |

| Jadwalkan scrape ulang untuk edit | Menangkap perubahan setelah publikasi | Kunjungi ulang artikel setelah 24 jam/1 minggu (model GDELT) |

| Amankan pipeline Anda | Lindungi data sensitif | Enkripsi, kontrol akses, alat bereputasi |

Membangun Workflow Ekstraksi Berita Otomatis yang Tangguh

Siap membangun “kotak hitam” Anda sendiri untuk data berita? Berikut workflow langkah demi langkahnya:

- Identifikasi sumber Anda: Buat daftar situs berita, blog, atau API yang ingin Anda pantau.

- Siapkan ekstraksi: Gunakan Thunderbit atau alat pilihan Anda untuk menentukan field (AI Suggest Fields membuat ini sangat mudah).

- Jadwalkan scraping: Atur frekuensi berdasarkan kecepatan berita—per jam untuk berita breaking, harian untuk beat yang lebih lambat.

- Pengayaan subpage: Untuk setiap judul, scrape artikel lengkap untuk isi teks, entity, dan tag.

- Deduplikasi dan normalisasi: Tangkap canonical URL, hash record, dan standarkan field.

- Ekspor dan integrasi: Kirim data terstruktur ke Excel, Google Sheets, Airtable, atau Notion untuk dianalisis.

- Pantau dan sesuaikan: Lacak kualitas ekstraksi, awasi perubahan layout, dan sesuaikan bila perlu.

- Tetap patuh: Tinjau syarat, hormati robots.txt, dan minimalkan data pribadi.

Untuk alur visual, bayangkan:

Sumber → Ekstraksi (field AI) → Pengayaan subpage → Deduplikasi → Ekspor → Analisis/Alert → Pemantauan

Kesimpulan & Poin Penting

Ekstraksi berita otomatis bukan lagi sekadar fitur tambahan—ini sudah jadi kebutuhan bagi siapa pun yang harus tetap unggul di dunia di mana berita muncul (dan berubah) setiap menit. Dengan mengikuti praktik terbaik dan menggunakan alat yang tepat, Anda bisa mengubah derasnya berita digital menjadi aliran intel yang stabil, terstruktur, dan bisa ditindaklanjuti.

Poin penting:

- Skala dan kecepatan berita online menuntut otomatisasi—pemantauan manual jelas tidak akan mampu mengejar.

- Alat ekstraksi berita otomatis menghemat waktu, menekan biaya, dan memberi tim kecil kemampuan untuk menyaingi liputan organisasi yang jauh lebih besar.

- Memilih alat yang tepat berarti menyeimbangkan kemudahan penggunaan, keamanan, dan adaptabilitas—Thunderbit menonjol karena kesederhanaannya berbasis AI dan opsi ekspor real-time.

- Bangun workflow Anda di sekitar kesegaran data, deduplikasi, kepatuhan, dan pemantauan kualitas untuk memastikan data berita yang andal dan bisa ditindaklanjuti.

- AI dan machine learning membuka nilai yang lebih besar—memungkinkan targeting, personalisasi, dan pengambilan keputusan yang lebih cerdas.

Kalau Anda masih copy-paste judul berita atau menunggu Google Alerts menyusul, sekarang saatnya naik level. dan lihat betapa mudahnya ekstraksi berita otomatis. Untuk lebih banyak tips, workflow, dan pembahasan mendalam, cek .

FAQ

1. Apa itu ekstraksi berita otomatis, dan bagaimana cara kerjanya?

Ekstraksi berita otomatis adalah proses menggunakan software untuk mengumpulkan artikel berita dan mengubahnya menjadi data terstruktur (seperti tabel atau JSON) untuk analisis, pencarian, atau alert. Alat seperti Thunderbit menggunakan AI untuk mengidentifikasi field penting (judul, cap waktu, penulis, isi teks) dan mengekstraknya dari halaman web atau API secara otomatis.

2. Mengapa data berita real-time begitu penting bagi bisnis?

Data berita real-time memungkinkan bisnis merespons cepat terhadap peristiwa pasar, krisis PR, atau pergerakan kompetitor. Baik Anda bekerja di sales, PR, atau riset, berita yang selalu terbaru membantu Anda membuat keputusan yang lebih cerdas dan lebih cepat, serta tetap unggul dari kompetisi.

3. Bagaimana Thunderbit memudahkan news scraping bagi pengguna non-teknis?

Thunderbit menawarkan proses sederhana dua langkah: jelaskan data yang Anda inginkan, lalu biarkan AI menyarankan field. Dengan fitur seperti subpage scraping dan ekspor instan ke Excel atau Google Sheets, bahkan pengguna non-teknis bisa membangun pipeline data berita yang tangguh dalam hitungan menit.

4. Apa saja pertimbangan hukum dan kepatuhan dalam news scraping?

Selalu tinjau syarat layanan situs target, utamakan API atau feed resmi bila tersedia, dan hormati arahan robots.txt. Hindari scraping konten yang memerlukan login atau berada di balik paywall tanpa izin, dan minimalkan pengumpulan data pribadi agar tetap patuh pada hukum privasi.

5. Bagaimana cara memastikan workflow ekstraksi berita saya tetap andal dari waktu ke waktu?

Jadwalkan scraping rutin, pantau kualitas ekstraksi, dan gunakan alat yang bisa menyesuaikan diri dengan perubahan layout (seperti ekstraksi berbasis AI dari Thunderbit). Lakukan deduplikasi record, lacak jeda antara publikasi dan ekstraksi, serta buat alert untuk kegagalan atau field yang hilang agar pipeline tetap sehat dan selalu mutakhir.

Pelajari Lebih Lanjut