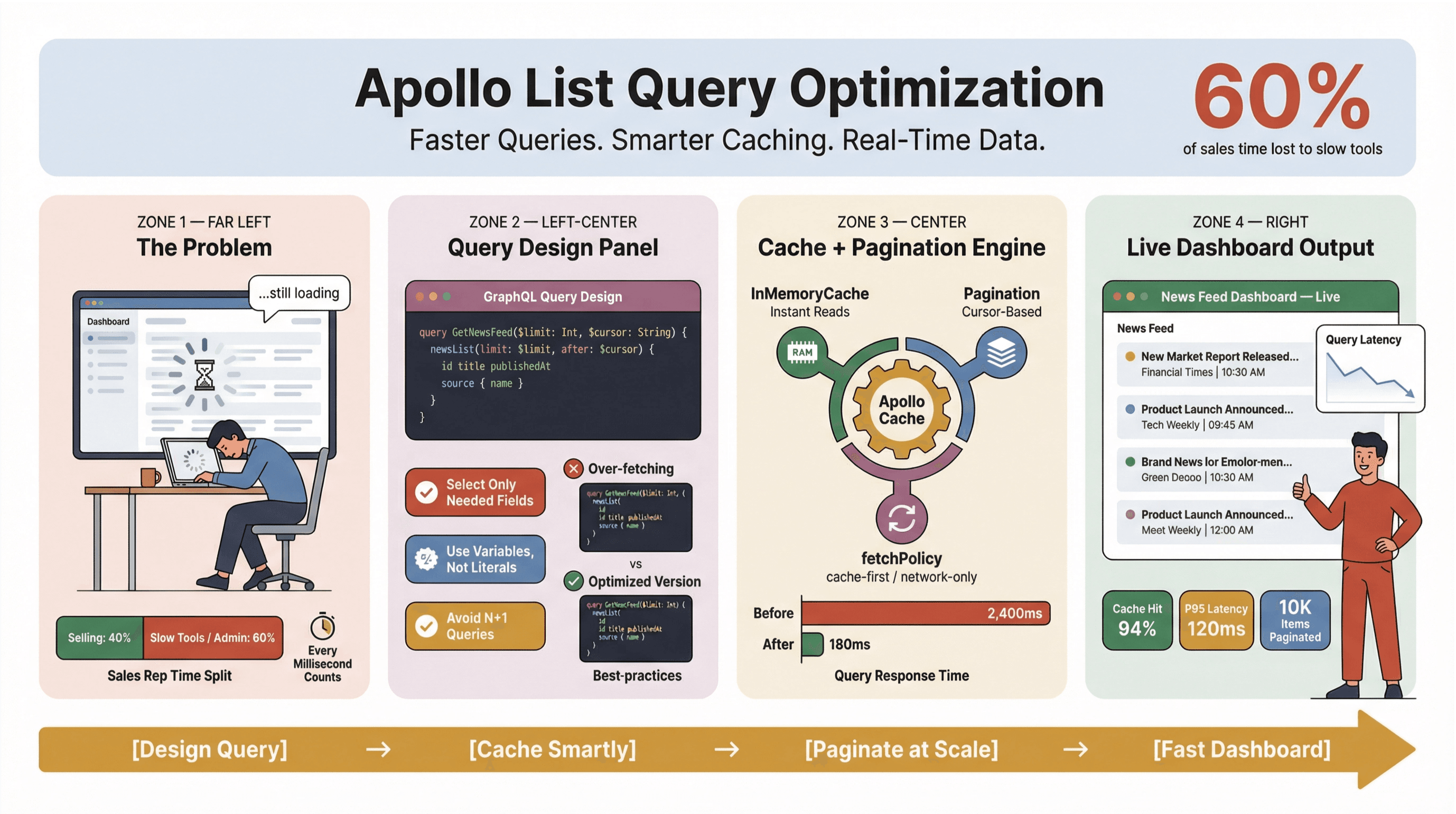

Mengoptimalkan query list di apollo itu bukan cuma urusan teknis doang—ini sudah level skill “survival” buat siapa pun yang hidup dari data berita real-time, ekstraksi berita otomatis, atau workflow sales dan operasional yang serba ngebut. Saya sudah sering lihat sendiri: begitu query list mulai lemot, dashboard yang tadinya lancar langsung berubah jadi bottleneck—tim sales bengong nunggu loader muter-muter, sementara tim ops kelabakan cari jalan pintas pakai spreadsheet. Di dunia di mana , tiap milidetik itu benar-benar mahal.

Terus, gimana caranya bikin query list apollo client jadi super ngebut, stabil, dan gampang diskalakan—apalagi kalau kamu lagi scraping berita, tracking lead, atau ngejalanin dashboard yang sifatnya mission-critical (kalau kata apollo missions: “failure is not an option”)? Di panduan ini, saya bakal share best practice yang saya pelajari (kadang lewat cara yang lumayan “nyesek”), mulai dari desain query, caching, pagination, sampai integrasi tool no-code seperti buat ngotomatisasi kerjaan “kasar” ekstraksi berita. Mau kamu developer, product manager, atau orang yang paling sering kena semprot tiap dashboard ngelag, ini playbook kamu buat performa list Apollo GraphQL.

Mengapa Perlu Mengoptimalkan Query Apollo List? (apollo client list performance, optimize apollo list queries)

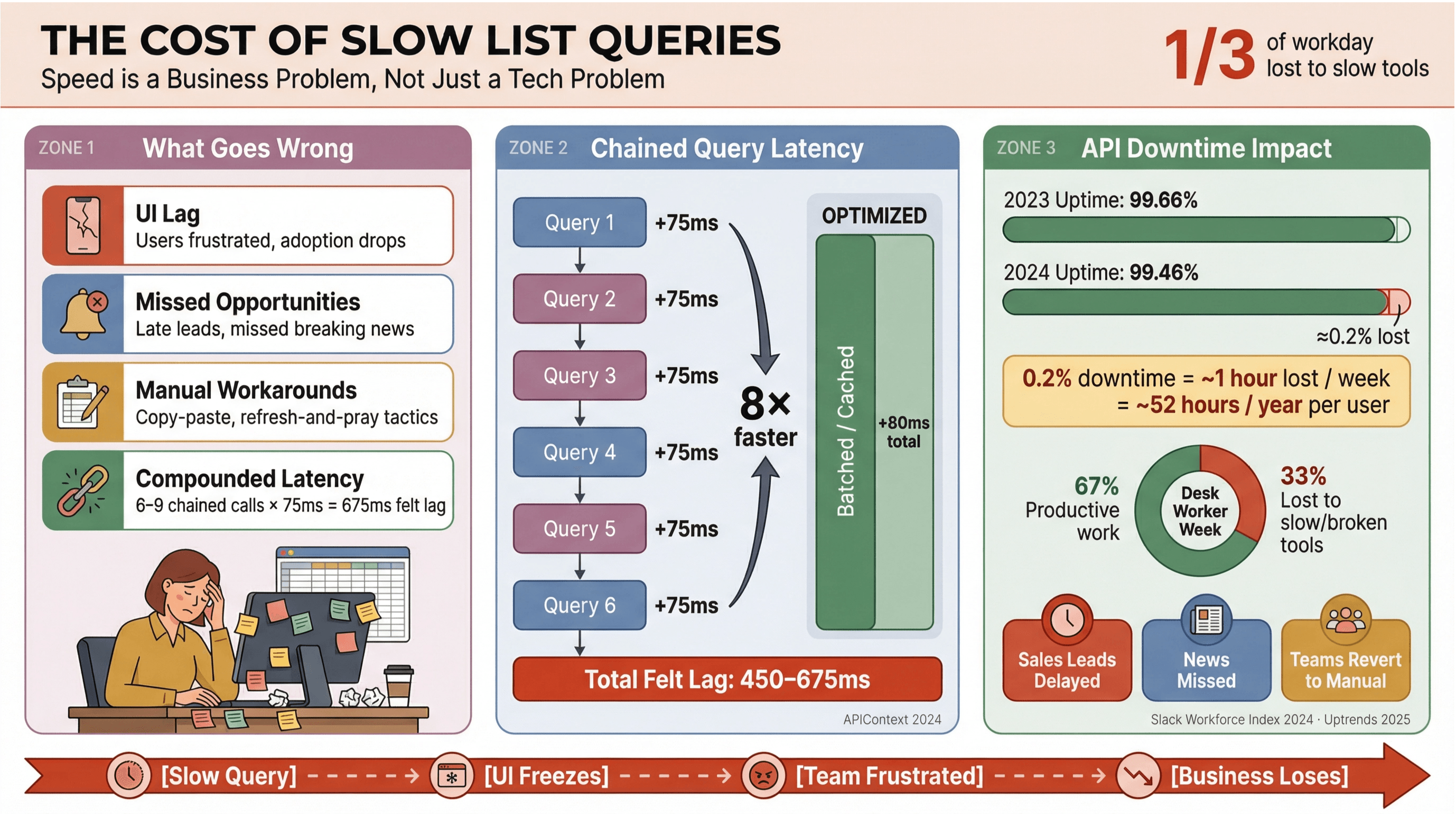

Kita jujur aja: nggak ada yang suka nunggu headline berita atau lead sales nongol. Di lingkungan bisnis—terutama yang ngandelin atau data real-time—query list apollo yang lambat itu bukan cuma bikin emosi; efeknya bisa jadi biaya membengkak, keputusan ketunda, dan ujung-ujungnya orang balik lagi ke kerja manual. juga nemuin pekerja kantoran menghabiskan sekitar sepertiga hari mereka untuk tugas bernilai rendah, seringnya gara-gara tool yang lambat atau kerjaan yang kepisah-pisah.

Ini yang biasanya kejadian kalau query list nggak dioptimalkan:

- UI Lag: Pengguna kerasa jedanya, jadi frustrasi, akhirnya adopsi turun.

- Peluang Hilang: Di sales atau monitoring berita, telat beberapa detik aja bisa bikin lead panas keburu dingin atau breaking news kelewat.

- Jalan Pintas Manual: Tim balik ke copy-paste, spreadsheet, atau strategi “refresh dan berdoa”.

- Latensi Berlipat: Tiap panggilan API yang lambat itu numpuk—kalau workflow kamu memicu 6–9 query yang saling bergantung, delay 75ms per call bisa kerasa jadi 450–675ms lag ().

Dan ini bukan melulu soal speed. , dengan rata-rata uptime turun dari 99,66% jadi 99,46% cuma dalam setahun—yang setara hampir satu jam produktivitas hilang per minggu untuk aplikasi yang berat di list. Kalau bisnis kamu bergantung pada data berita real-time, risikonya kebangetan kalau diabaikan.

Memilih Struktur Data dan Field yang Tepat (apollo graphql list best practices)

Salah satu kesalahan paling sering saya lihat (dan ya, saya juga pernah “kepleset” di sini) adalah memperlakukan setiap query list seperti query detail. Di GraphQL, kamu bisa ambil data pas sesuai kebutuhan—jadi manfaatin. Overfetching itu musuh performa, apalagi buat tool scraping berita dan dashboard real-time.

Menyesuaikan Field untuk Ekstraksi Berita Otomatis

Misalnya kamu bikin news feed. Emang kamu beneran butuh isi artikel lengkap, semua tag, komentar, plus bio penulis di query list? Biasanya sih nggak. Ini bedanya:

Query List yang Efisien:

1query NewsFeed($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 cursor

5 node {

6 id

7 title

8 url

9 sourceName

10 publishedAt

11 }

12 }

13 pageInfo { endCursor hasNextPage }

14 }

15}Query List yang Tidak Efisien (Jangan Ditiru):

1query NewsFeedTooHeavy($after: String, $first: Int) {

2 newsFeed(after: $after, first: $first) {

3 edges {

4 node {

5 id title url publishedAt

6 fullText

7 summary

8 entities { ... }

9 relatedArticles { ... }

10 }

11 }

12 }

13}Query pertama itu ringkas dan fokus—cocok buat ranking, filtering, dan render baris. Query kedua? Itu query detail yang nyamar, narik payload gede dan bikin semuanya melambat (, ).

Tips pro: Pakai pendekatan dua tingkat—di list cukup ambil field ringan, lalu load detail berat (misalnya full text atau enrichment NLP) cuma saat user buka item atau hover.

Memanfaatkan Cache Apollo Client agar Query Lebih Cepat (apollo client list performance)

Cache apollo client itu “senjata rahasia” biar query list terasa responsif. Kalau setting-nya bener, kamu bisa:

- Menampilkan query berulang secara instan (tanpa bolak-balik network)

- Mengurangi beban server dan biaya API

- Membuat navigasi back/forward dan perubahan filter tetap mulus

Tapi cache itu bukan sulap—tetap butuh sedikit setup dan disiplin.

Menetapkan Kebijakan Cache yang Efektif

Apollo mendukung beberapa :

| Policy | Fungsinya | Kapan Paling Cocok untuk List Berita |

|---|---|---|

| cache-first | Membaca dari cache, ambil dari network jika belum ada | Membuka ulang list, ganti filter, navigasi back/forward |

| network-only | Selalu ambil dari network | Refresh manual, “headline terbaru” |

| cache-and-network | Tampilkan cache dulu, lalu update dari respons network | Tampilan awal cepat + update di belakang (ideal untuk feed) |

| no-cache | Selalu fetch, tidak pernah simpan ke cache | Query sensitif sekali pakai (jarang untuk list) |

Untuk data berita real-time, saya paling suka cache-and-network—user dapat hasil instan, lalu data di-update di background. Tapi, hati-hati sama flicker UI kalau urutan data berubah pas refresh ().

Tips konfigurasi cache:

- Pakai ID yang stabil (

idatau_id) buat normalisasi (). - Sesuaikan ukuran cache dan garbage collection buat list besar ().

- Hindari nyimpen blob besar yang tidak ternormalisasi di

ROOT_QUERY—ini bisa bikin aplikasi “ngos-ngosan” ().

Menerapkan Pagination dan Membatasi Jumlah Item (apollo graphql list best practices)

Kalau kamu load ratusan atau ribuan artikel berita atau lead sales sekaligus, itu sama aja “ngundang masalah”. Pagination itu bukan cuma fitur UX—ini kebutuhan performa.

Apollo mendukung pagination dan . Ini perbandingannya:

| Jenis Pagination | Kelebihan | Kekurangan | Paling Cocok Untuk |

|---|---|---|---|

| Offset-based | Sederhana, mudah diterapkan | Bisa loncat/duplikat jika data berubah | List kecil atau statis |

| Cursor-based | Stabil, tahan terhadap perubahan data | Sedikit lebih kompleks | Feed berita, list besar |

Untuk kebanyakan list berita real-time atau lead, pagination berbasis cursor itu pilihan paling aman. Data tetap konsisten walau item baru masuk atau item lama dihapus ().

Tips pagination di Apollo:

- Konfigurasikan

keyArgsbuat ngontrol cache key pada field yang dipaginasi (). - Bikin fungsi

mergebuat ngegabungin halaman di cache. - Pakai

fetchMorebuat load halaman berikutnya tanpa nimpa hasil sebelumnya.

Pola Pagination Praktis untuk Tool Scraping Berita

UI scraping berita yang umum biasanya:

- Menampilkan 20–50 headline terbaru (field ringan saja)

- Load lebih banyak saat scroll atau klik “next page”

- Ambil detail hanya saat dibutuhkan

Hasilnya: UI tetap ngebut, API nggak kewalahan, dan user jadi lebih produktif.

Mengintegrasikan Thunderbit untuk Ekstraksi Berita Otomatis

Sekarang kita masuk ke pertanyaan besar: data berita terstruktur ini asalnya dari mana? Nah, di sinilah masuk sebagai “game changer”.

Thunderbit adalah ekstensi Chrome AI web scraper no-code yang bisa mengekstrak headline berita, URL, sumber, penulis, tanggal publikasi, ringkasan, dan gambar dari hampir semua website—tanpa perlu ngoding. Saya lihat banyak tim pakai Thunderbit buat ngotomatisasi ekstraksi berita end-to-end, mengubah halaman web yang berantakan jadi data rapi dan terstruktur yang bisa langsung masuk ke database atau GraphQL API.

Menggabungkan Thunderbit dengan Apollo untuk Data Berita Real-Time

Ini alur kerja yang saya suka buat tim sales dan ops yang butuh berita terbaru:

- Lapisan Ekstraksi: Pakai dari Thunderbit buat narik data berita terstruktur dari situs target secara terjadwal.

- Lapisan Penyimpanan: Simpan hasil scraping di database yang dioptimalkan untuk pengambilan cepat.

- Lapisan GraphQL: Ekspos field list

newsFeeddan field detailnewsArticle(id)lewat API kamu. - Lapisan Client: Pakai apollo client buat ambil list (field ringan, dipaginasi), dan ambil detail hanya saat diperlukan.

Pipeline “scrape → store → query” ini bikin query apollo kamu selalu kerja dengan data yang segar dan terstruktur—tanpa copy-paste manual atau script rapuh.

Bonus: Thunderbit juga bisa memperkaya list kamu dengan field tambahan (misalnya sentimen atau kategori) lewat saran field berbasis AI, jadi feed berita kamu makin “pinter” (kalau mau nyebutnya: apollp ai vibe-nya dapet).

Panduan Langkah demi Langkah: Mengoptimalkan Query Apollo List

Siap eksekusi? Ini checklist andalan saya buat optimasi query list apollo:

-

Ringkas Query Anda

- Minta hanya field yang dibutuhkan untuk menampilkan list (judul, URL, timestamp, dll.).

- Pindahkan field berat (full text, gambar, enrichment) ke query detail.

-

Terapkan Pagination

- Gunakan pagination berbasis cursor untuk list besar atau dinamis.

- Konfigurasikan

keyArgsdan fungsimergeagar cache tetap benar.

-

Manfaatkan Cache Apollo

- Normalisasi entitas dengan ID yang stabil.

- Pilih fetch policy yang tepat (

cache-and-networksangat cocok untuk berita). - Sesuaikan ukuran cache dan garbage collection sesuai volume data.

-

Integrasikan Ekstraksi Otomatis

- Gunakan Thunderbit untuk mengotomatiskan scraping berita agar data selalu up-to-date.

- Ekspor data terstruktur langsung ke database atau spreadsheet.

-

Pantau dan Troubleshoot

- Gunakan untuk memeriksa query, cache, dan performa.

- Waspadai penulisan cache yang besar, watched query berlebihan, dan UI yang tersendat.

- Lacak latensi p95/p99 dan error rate (, ).

Memantau dan Mengatasi Masalah Performa Query

Devtools Apollo itu ngebantu banget. Kamu bisa:

- Cek query yang aktif dan kondisi cache

- Nemuin query duplikat atau watcher yang kebanyakan

- Ngedeteksi blob cache besar atau masalah normalisasi

Kalau kamu lihat UI lag atau update lambat, cek ini dulu:

- Query list kebanyakan muatan (ringkas)

- Normalisasi cache jelek (benerin ID)

- Masalah merge pagination (audit

keyArgsdanmerge)

Dan jangan lupa ukur tail latency—bukan cuma rata-rata. Biasanya “rasa sakit” user ngumpet di situ.

Membandingkan Pendekatan Scraping Berita Tradisional vs. Berbasis AI

Kalau flashback dikit: dulu scraping berita itu identik dengan nulis script custom, ngurus headless browser, dan berharap layout situs nggak berubah semalaman. Sekarang, dengan tool berbasis AI seperti Thunderbit, kamu bisa otomatisin semuanya—tanpa kode, tanpa drama.

| Pendekatan | Kelebihan | Keterbatasan untuk Pengguna Bisnis |

|---|---|---|

| Scraping dengan script | Sangat fleksibel, murah saat skala besar | Perawatan tinggi, butuh waktu engineering |

| Platform scraping terkelola | Cepat mulai, urusan anti-bot ditangani | Tetap perlu konfigurasi, biaya naik seiring pemakaian |

| Ekstraksi berbasis AI (Thunderbit) | Tahan layout berantakan, tanpa coding | Output perlu QA, integrasi ke skema Anda |

| Scraper visual no-code | Mudah untuk non-engineer | Bisa rusak saat UI berubah, skala terbatas |

| Infrastruktur proxy/unlocker | Menembus blokir, throughput tinggi | Tetap butuh logika ekstraksi, risiko kepatuhan |

Catatan legal: Scraping data publik umumnya legal, tapi tetap wajib patuhi terms of service dan rate limit ().

Poin Penting: Praktik Terbaik Apollo GraphQL untuk List

Ringkasan yang paling penting:

- Utamakan cepat dan jelas: Ringkas query list, pakai pagination, dan manfaatkan cache secara agresif.

- Struktur itu penting: Ambil hanya yang diperlukan—pindahkan field berat ke query detail.

- Cache adalah teman Anda: Gunakan normalisasi dan fetch policy Apollo biar data bisa tampil instan.

- Otomatiskan ekstraksi: Tool seperti bikin scraping berita dan enrichment list bisa dikerjain siapa saja.

- Pantau dan iterasi: Pakai Devtools dan dashboard observability buat nangkep bottleneck lebih awal.

Buat tim sales, ops, dan berita, praktik ini artinya lebih sedikit waktu nunggu, lebih banyak waktu eksekusi—dan jauh lebih sedikit chat Slack “kok lambat banget?”.

Penutup: Langkah Berikutnya untuk Mengoptimalkan Query Apollo List Anda

Kalau kamu masih pakai query list yang berat, tanpa pagination, atau nggak ramah cache, ini momen yang pas buat audit dan upgrade. Mulai dari yang kecil: kurangin field, tambahin pagination, dan rapihin cache. Habis itu, naik level dengan integrasi tool ekstraksi otomatis seperti biar data kamu selalu segar dan siap ditindaklanjuti.

Mau lebih dalem? Cek , , atau gabung buat tips real dan troubleshooting. Dan kalau kamu siap ngotomatisasi ekstraksi berita, cobain dari Thunderbit—ini beneran bisa ngubah cara kerja buat siapa pun yang butuh data real-time tanpa ribet.

Selamat meng-query—semoga apollo lists kamu selalu kelar loading sebelum kopi keburu dingin.

FAQs

1. Kenapa query list apollo melambat di dashboard berita real-time atau sales?

Query list bisa melambat kalau ngambil data kebanyakan, nggak pakai pagination, atau caching-nya berantakan. Di workflow yang frekuensinya tinggi seperti monitoring berita, delay kecil pun bisa numpuk, bikin UI lag dan produktivitas turun.

2. Bagaimana struktur terbaik query list apollo untuk ekstraksi berita otomatis?

Minta hanya field yang diperlukan untuk menampilkan list (misalnya judul, URL, timestamp). Pindahkan field berat (seperti teks artikel penuh atau gambar) ke query detail, dan paginasi hasilnya supaya payload tetap kecil dan cepat.

3. Bagaimana cache apollo client meningkatkan performa list?

Cache apollo nyimpen data yang sudah pernah diambil, jadi query yang sama bisa dijawab instan. Normalisasi cache yang benar dan fetch policy (seperti cache-and-network) bisa mempercepat tampilan list secara signifikan sekaligus ngurangin beban server.

4. Bagaimana Thunderbit membantu scraping berita dan integrasi dengan apollo?

Thunderbit adalah AI web scraper no-code yang mengekstrak data berita terstruktur dari website mana pun. Kamu bisa pakai buat ngotomatisasi ekstraksi berita, lalu masukin datanya ke database atau GraphQL API untuk dipakai bareng apollo client.

5. Tool apa yang bisa dipakai untuk memantau dan troubleshooting performa query list apollo?

memungkinkan kamu memeriksa query, kondisi cache, dan performa secara real time. Gabungkan dengan dashboard observability (seperti New Relic atau Uptrends) buat mantau latensi dan error rate, lalu iterasi desain query biar hasilnya makin optimal.

Butuh lebih banyak tips soal web scraping, otomasi, dan workflow data real-time? Mampir ke buat bahasan mendalam, tutorial, dan update terbaru seputar produktivitas berbasis AI.

Pelajari Lebih Lanjut