Sejujurnya, saat pertama kali saya mencoba mengambil semua URL dari sebuah website besar, saya berpikir, “Emang sesulit apa sih?” Beberapa jam kemudian, saya masih saja klik dari satu halaman ke halaman lain, copy-paste tautan ke spreadsheet, dan mulai mempertanyakan pilihan hidup saya. Kalau Anda pernah mencoba menemukan semua halaman di sebuah website—baik untuk content audit, daftar prospek, maupun riset kompetitor—Anda pasti paham rasanya. Ini melelahkan, rawan salah, dan jujur saja, buang-buang waktu serta tenaga.

Tapi ada kabar baik: Anda tidak perlu lagi melakukannya dengan cara lama yang merepotkan. Tools berbasis AI seperti sedang mengubah permainan bagi pengguna bisnis, karena memungkinkan Anda menemukan semua URL di sebuah domain dalam hitungan menit, bukan hari. Faktanya, perusahaan yang menggunakan tools web scraping berbasis AI melaporkan untuk tugas pengumpulan data, dan ada yang melihat hingga dibanding metode manual. Itu bukan sekadar angka—itu berarti jam, bahkan hari, waktu hidup Anda kembali.

Jadi, mari kita bahas kenapa menemukan semua halaman di sebuah website itu begitu sulit, kenapa model AI umum seperti GPT atau Claude sebenarnya tidak banyak membantu, dan bagaimana agen AI spesialis—seperti Thunderbit—membuat proses ini jadi mudah. Dan ya, saya juga akan memandu Anda langkah demi langkah untuk mengekstrak setiap URL yang Anda butuhkan, bahkan kalau Anda bukan programmer.

Kenapa Menemukan Semua URL di Sebuah Domain Itu Sulit

Kalau dipikir-pikir, website memang tidak dirancang untuk menyerahkan daftar rapi berisi semua halaman yang ada di dalamnya. Website dibuat untuk pengunjung, bukan untuk orang yang ingin menemukan semua halaman di sebuah website sekaligus. Inilah kenapa tugas ini jadi merepotkan:

- Copy-Paste Manual yang Melelahkan: Klik setiap menu, daftar, dan direktori, salin URL satu per satu, lalu tempel ke spreadsheet—ini resep pasti untuk carpal tunnel (dan melewatkan separuh halaman).

- Pagination dan Infinite Scroll: Banyak situs membagi konten ke beberapa halaman atau memuat hasil tambahan saat Anda scroll. Kalau tombol “Next” terlewat atau Anda tidak scroll cukup jauh, Anda akan kehilangan seluruh bagian.

- Struktur Halaman yang Tidak Konsisten: Ada halaman yang menampilkan tautan dalam satu format, ada yang memakai tata letak berbeda. Mengelolanya semua itu benar-benar bikin pusing.

- Halaman Tersembunyi atau Orphan: Tidak semua halaman ditautkan dari navigasi utama. Ada yang tersembunyi jauh di dalam, hanya bisa diakses lewat sitemap atau pencarian internal.

- Kesalahan Manusia: Semakin banyak halaman yang harus disalin, semakin besar kemungkinan Anda membuat kesalahan—URL dobel, typo, atau sekadar melewatkan sesuatu.

Dan kalau Anda bekerja dengan situs yang punya ratusan atau ribuan halaman? Lupakan saja. Ekstraksi manual memang tidak bisa diskalakan. Seperti yang dikatakan salah satu tim data, untuk kasus yang tidak benar-benar sepele, .

Apa Arti “Menemukan Semua Halaman di Sebuah Website”?

Sebelum masuk ke solusi, mari kita perjelas dulu apa yang sebenarnya kita cari.

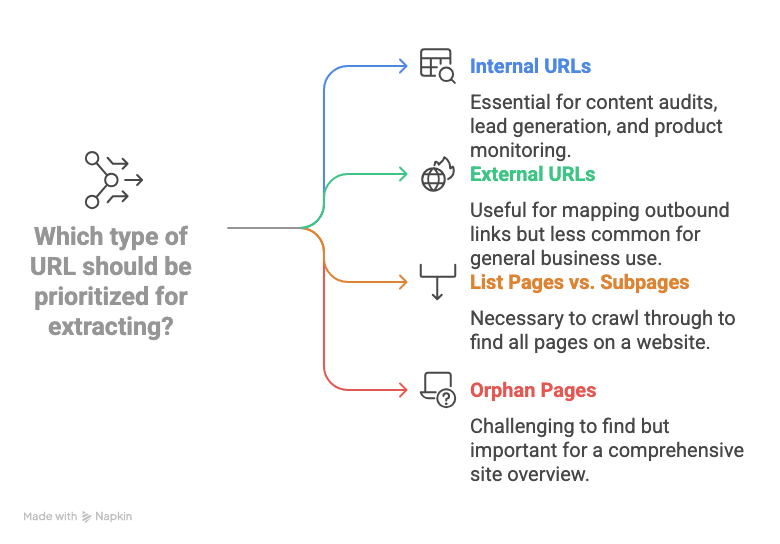

- URL Internal: Ini adalah tautan yang mengarah ke halaman di domain yang sama (seperti /about-us atau /products/widget-123). Untuk sebagian besar kebutuhan bisnis—content audit, lead generation, pemantauan produk—URL internal adalah target utama.

- URL Eksternal: Tautan yang menuju website lain. Biasanya Anda tidak membutuhkannya, kecuali Anda sedang memetakan outbound link.

- Halaman Daftar vs. Subhalaman: Banyak situs memiliki halaman “hub” atau “daftar” (misalnya: halaman kategori, arsip blog, direktori) yang menaut ke halaman detail (seperti halaman produk atau profil). Untuk benar-benar menemukan semua halaman di sebuah website, Anda perlu menelusuri daftar ini dan mengambil setiap subhalaman yang ditautkan.

- Orphan Page: Ini adalah halaman yang tidak ditautkan dari mana pun yang mudah terlihat. Kadang bisa ditemukan lewat sitemap atau pencarian internal, tapi sangat mudah terlewat.

Jadi, saat kita bicara tentang menemukan semua URL di sebuah domain, maksudnya adalah: dapatkan setiap URL halaman internal, mulai dari homepage sampai halaman produk atau artikel paling dalam, idealnya dalam format yang bisa langsung dipakai seperti spreadsheet.

Metode Tradisional untuk Menemukan Semua URL di Sebuah Domain

Ada beberapa cara lama untuk menangani ini, tapi masing-masing punya masalahnya sendiri:

Copy-Paste Manual dan Tools Browser

Ini pendekatan “brute force”: klik setiap tautan, salin setiap URL, tempel ke spreadsheet, dan berharap tidak ada yang terlewat. Sebagian orang memakai ekstensi browser untuk mengambil semua tautan dari halaman yang sedang dibuka, tapi Anda tetap harus mengulanginya untuk setiap halaman, dan Anda sendiri yang harus menangani pagination atau bagian tersembunyi. Cocok untuk situs lima halaman—tapi tidak untuk yang lebih besar.

Memakai Site Search dan Sitemap

- Pencarian site: dari Google: Ketik site:domainanda.com di Google, lalu Anda akan melihat banyak halaman yang terindeks. Tapi Google hanya menampilkan yang sudah terindeks (sering dibatasi sekitar 1.000 hasil), jadi Anda akan melewatkan halaman baru, tersembunyi, atau berkualitas rendah. mengakui bahwa ini bukan solusi yang lengkap.

- XML Sitemap: Banyak situs punya /sitemap.xml yang mencantumkan URL penting. Bagus—kalau sitemap-nya selalu terbaru dan memuat semua halaman. Tapi tidak semua situs memilikinya, dan ada yang memecah sitemap menjadi beberapa file. Orphan page sering kali tidak ikut tercantum.

Crawler Teknis dan Script

- SEO Tools seperti Screaming Frog: Tools ini menelusuri situs seperti mesin pencari lalu menghasilkan daftar URL. Sangat kuat, tapi butuh pengaturan, konfigurasi, dan kadang lisensi berbayar untuk situs besar.

- Script Python seperti Scrapy: Developer bisa menulis script untuk menelusuri dan mengekstrak URL. Tapi jujur saja, kalau Anda tidak nyaman dengan kode, ini bukan opsi yang realistis. Ditambah lagi, script mudah rusak saat layout situs berubah, jadi Anda terus mengejar perubahan.

Intinya: Metode tradisional itu terlalu manual, terlalu tidak lengkap, atau terlalu teknis untuk kebanyakan pengguna bisnis. Ada alasan kenapa banyak orang menyerah di tengah jalan.

Kenapa Model AI Umum Tidak Bisa Sepenuhnya Mengotomatiskan Ekstraksi URL

Mungkin Anda berpikir, “Bukannya saya bisa tinggal minta ChatGPT atau Claude untuk menemukan semua halaman di sebuah website?” Andai semudah itu. Kenyataannya begini:

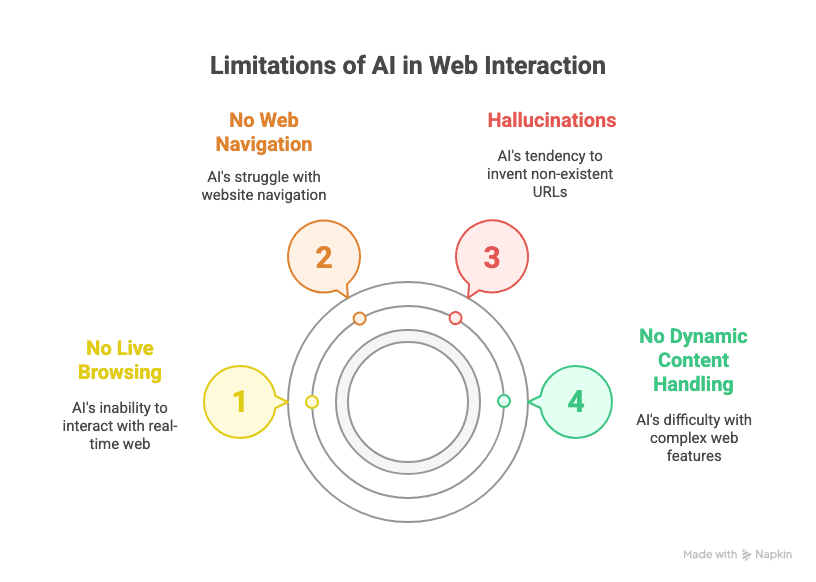

- Tidak Bisa Browsing Langsung: Model AI umum seperti GPT atau Claude tidak benar-benar bisa menjelajah web secara real time. Mereka tidak “melihat” kondisi website saat ini—mereka hanya bekerja berdasarkan data latih atau apa pun yang Anda tempelkan.

- Tidak Bisa Navigasi Web: Bahkan dengan plugin atau browsing yang diaktifkan, LLM tidak tahu cara klik “Next”, menangani infinite scroll, atau mengikuti setiap tautan di situs secara sistematis.

- Halusinasi: Saat diminta semua URL di sebuah domain, AI umum sering mengarang tautan yang terdengar masuk akal tapi sebenarnya tidak ada. (Saya pernah melihatnya mengarang halaman /about-us untuk situs yang memang tidak pernah punya halaman itu.)

- Tidak Bisa Menangani Konten Dinamis: Situs yang memuat konten dengan JavaScript, mengharuskan login, atau memakai navigasi kompleks berada di luar jangkauan LLM umum.

Seperti yang ditulis dalam : “Kalau Anda ingin melakukan scraping ratusan atau ribuan halaman… ChatGPT saja tidak cukup.” Anda butuh tool yang memang dibuat khusus untuk tugas ini.

Agen AI Vertikal adalah Masa Depan (dan Kenapa Itu Penting)

Di sini pengalaman saya di SaaS dan otomasi mulai relevan: agen AI vertikal—tools AI yang dibuat untuk domain spesifik, seperti ekstraksi data web—adalah satu-satunya cara untuk mendapatkan hasil yang andal dan bisa diskalakan untuk kebutuhan bisnis. Kenapa?

- LLM serbaguna memang bagus untuk menulis atau pencarian, tapi rentan “halusinasi” dan tidak bisa menangani workflow multi-langkah yang berulang dengan stabilitas yang dibutuhkan bisnis.

- Tools SaaS enterprise perlu mengotomatiskan banyak tugas struktural yang berulang. Di sinilah agen AI vertikal unggul—mereka dibuat untuk melakukan satu hal, dan melakukannya dengan baik, dengan kesalahan minimal.

- Contohnya banyak di berbagai industri: Thunderbit untuk ekstraksi data web, Devin AI untuk pengembangan software, Alta untuk otomasi penjualan, IL VISTA milik Infinity Learn untuk pendidikan, Rippling untuk HR, Harvey untuk legal… dan masih banyak lagi.

Singkatnya: kalau Anda ingin menemukan semua halaman di sebuah website dengan andal, Anda butuh agen AI vertikal yang memang dibuat untuk tugas itu—bukan chatbot serbaguna.

Kenalan dengan Thunderbit: Ekstraksi URL Berbasis AI untuk Semua Orang

Di sinilah berperan. Sebagai ekstensi Chrome AI web scraper, Thunderbit dirancang untuk pengguna bisnis—tanpa coding, tanpa setup teknis, langsung hasil. Inilah yang membuatnya berbeda:

- Antarmuka Bahasa Alami: Cukup jelaskan apa yang Anda mau (“Daftarkan semua URL halaman di situs ini”), dan AI Thunderbit akan mencari cara mengekstraknya.

- AI Suggest Fields: Thunderbit memindai halaman dan otomatis menyarankan nama kolom (misalnya “Page URL”)—tidak perlu repot dengan CSS selector atau XPath.

- Menangani Pagination dan Infinite Scroll: Thunderbit bisa klik “Next” atau scroll ke bawah otomatis, jadi Anda tidak melewatkan halaman apa pun.

- Navigasi Subhalaman: Perlu masuk lebih dalam? Thunderbit juga bisa mengikuti tautan ke subhalaman dan mengambil data dari sana.

- Ekspor Terstruktur: Ekspor hasil langsung ke Google Sheets, Excel, Notion, Airtable, atau CSV—gratis dan cukup sekali klik.

- Tanpa Coding: Kalau Anda bisa membuka website, Anda bisa memakai Thunderbit. Sesederhana itu.

Dan karena Thunderbit adalah agen AI vertikal, ia dibuat untuk stabilitas dan pengulangan—cocok untuk pengguna bisnis yang perlu mengotomatiskan tugas yang sama berulang kali.

Langkah demi Langkah: Cara Menemukan Semua URL di Sebuah Domain dengan Thunderbit

Siap lihat cara kerjanya? Berikut panduan non-teknis untuk mengekstrak setiap URL yang Anda butuhkan.

1. Instal Ekstensi Chrome Thunderbit

Hal pertama: . Aplikasi ini berfungsi di Chrome, Edge, Brave, dan browser Chromium lainnya. Sematkan ke toolbar agar mudah diakses.

2. Buka Halaman Daftar atau Direktori Target Anda

Buka website yang ingin Anda ambil URL-nya. Bisa homepage, sitemap, direktori, atau halaman daftar apa pun yang menaut ke halaman yang Anda butuhkan.

3. Jalankan Thunderbit dan Atur Field Anda

Klik ikon Thunderbit untuk membuka ekstensi. Mulai scraper template baru. Di sinilah keajaiban terjadi:

- Klik “AI Suggest Fields”. AI Thunderbit akan memindai halaman dan menyarankan kolom—cari yang berlabel “Page URL”, “Link”, atau serupa.

- Kalau Anda tidak melihat field yang persis Anda inginkan, cukup tambahkan kolom bernama “Page URL” (atau nama yang paling sesuai). AI Thunderbit dilatih untuk mengenali istilah ini dan memetakannya ke data yang tepat.

4. Aktifkan Pagination atau Scrolling Jika Perlu

Kalau halaman target Anda punya beberapa halaman (seperti “Halaman 1, 2, 3…” atau tombol “Load more”), aktifkan pagination di Thunderbit:

- Pindah ke mode “Click Pagination” untuk situs dengan tombol “Next”, atau “Infinite Scroll” untuk situs yang memuat lebih banyak konten saat Anda scroll.

- Thunderbit akan meminta Anda memilih tombol “Next” atau area scroll—cukup klik, lalu AI akan mengurus sisanya.

5. Mulai Scraping dan Tinjau Hasil Anda

Klik tombol “Scrape”. Thunderbit akan menelusuri semua halaman dan mengumpulkan setiap URL yang ditemukan. Anda akan melihat hasilnya muncul dalam tabel langsung di ekstensi. Untuk situs besar, ini bisa memakan beberapa menit, tapi tetap jauh lebih cepat daripada melakukannya manual.

6. Ekspor Daftar URL Anda

Setelah scraping selesai, klik Export. Anda bisa mengirim data langsung ke:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Ekspor gratis dan semua format tetap terjaga. Tidak ada lagi drama copy-paste.

Membandingkan Thunderbit dengan Solusi Ekstraksi URL Lainnya

| Metode | Kemudahan Penggunaan | Akurasi & Cakupan | Skalabilitas | Opsi Ekspor |

|---|---|---|---|---|

| Copy-Paste Manual | Menyiksa | Rendah (mudah terlewat) | Tidak ada | Manual (Excel, dll.) |

| Browser Link Extractors | Cukup untuk 1 halaman | Sedang | Buruk | Manual |

Pencarian Google site: | Mudah | Sedang (tidak lengkap) | Terbatas sekitar 1.000 | Manual |

| XML Sitemap | Mudah (jika ada) | Baik (jika terbaru) | Baik | Manual/Script |

| SEO Tools (Screaming Frog) | Teknis | Tinggi | Tinggi (berbayar) | CSV, Excel |

| Script Python (Scrapy, dll.) | Sangat teknis | Tinggi | Tinggi | Kustom |

| Thunderbit | Sangat mudah | Sangat tinggi | Tinggi | Google Sheets, CSV, dll. |

Thunderbit memberi Anda akurasi dan skala crawler profesional dengan kemudahan penggunaan ekstensi browser. Tanpa kode, tanpa setup, langsung hasil.

Bonus: Mengekstrak Lebih dari Sekadar URL dengan Thunderbit

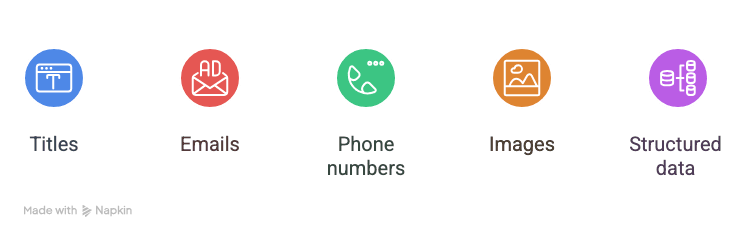

Di sinilah semuanya jadi makin menarik. Thunderbit bukan cuma untuk URL—Anda juga bisa mengekstrak:

- Judul

- Nomor telepon

- Gambar

- Data terstruktur apa pun di halaman

Misalnya, kalau Anda sedang membangun daftar prospek, Anda bisa meminta Thunderbit mengambil URL profil, nama, email, dan nomor telepon dari setiap entri direktori—semuanya sekaligus. Kalau Anda sedang mengaudit produk, Anda bisa mengambil URL produk, nama, harga, dan status stok. Thunderbit bahkan mendukung , jadi ia bisa masuk ke tiap tautan dan mengekstrak detail dari sana.

Dan ya, extractor email dan nomor telepon dari Thunderbit benar-benar gratis. Itu sangat penting untuk tim sales dan marketing.

Poin Penting: Cara Menemukan Semua Halaman di Sebuah Website dengan AI

Mari kita rangkum:

- Menarik semua URL dari sebuah domain itu sulit jika memakai metode manual atau tools generik.

- Model AI umum seperti GPT tidak bisa menangani navigasi web, pagination, atau konten dinamis.

- Agen AI vertikal seperti Thunderbit dibuat khusus untuk ekstraksi data web—stabil, bisa diulang, dan mudah digunakan oleh pengguna bisnis.

- Thunderbit membuat semuanya sederhana: instal ekstensi, gunakan AI untuk menyarankan field, aktifkan pagination, scrape, dan ekspor. Tanpa kode, tanpa ribet.

- Anda bisa mengekstrak lebih dari sekadar URL: judul, email, nomor telepon, dan lainnya—sempurna untuk lead gen, audit, atau riset.

Kalau Anda sudah capek copy-paste tautan atau bergulat dengan crawler teknis, . Ada paket gratis, jadi Anda bisa lihat sendiri berapa banyak waktu (dan kewarasan) yang bisa dihemat.

Dan kalau Anda penasaran dengan cara lain Thunderbit bisa membantu—misalnya , , atau —kunjungi untuk lebih banyak panduan dan tips.

Siap merebut kembali waktu Anda dari pengumpulan data manual? Masa depan ekstraksi data web adalah agen AI vertikal—dan Thunderbit memimpin perjalanannya. Coba sekarang, dan biarkan audit berikutnya, daftar prospek berikutnya, atau proyek riset berikutnya jadi yang paling mudah sejauh ini.

Baca Selengkapnya

P.S. Kalau Anda pernah tergoda untuk copy-paste 1.000 URL dengan tangan, ingat saja: sekarang sudah ada AI untuk itu. Pergelangan tangan Anda (dan bos Anda) pasti berterima kasih.