Hampir separuh dari seluruh trafik internet sekarang datang dari bot. Kebanyakan dari mereka kerjaannya nge-scrape link, data, dan URL dalam skala gede. Kalau kamu masih ngurusin itu manual, ya jelas bakal ketinggalan.

Saya ngetes 12 alat ekstraktor link—mulai dari ekstensi Chrome berbasis AI sampai library Python—buat lihat mana yang beneran bisa diandelin saat kamu perlu ngambil ribuan URL dengan cepat.

Ini hasilnya.

Kenapa Ekstraktor Link Itu Penting

Real talk: web itu penuh banget sama data, dan bisnis lagi balapan buat ngubah “kekacauan” itu jadi insight yang bisa langsung dieksekusi. dan sekarang udah jadi kebutuhan wajib buat tim yang pengin:

- Menghasilkan lead: Tim sales bisa narik link profil perusahaan dari direktori atau LinkedIn dalam hitungan menit, lalu masukin URL itu ke tool lain buat ambil info kontak. Nggak perlu klik-klik capek.

- Mengumpulkan konten dan meningkatkan SEO: Marketer bisa ngumpulin semua URL artikel dari blog, mantau backlink kompetitor, atau audit struktur situs buat nemuin link yang rusak.

- Memantau kompetitor dan riset pasar: Tim operasional bisa otomatis ngumpulin link produk baru, halaman harga, atau siaran pers—jadi bisa ngikutin gerak kompetitor tanpa ribet.

- Mengotomatiskan alur kerja dan menghemat waktu: Link scraper modern bisa ngurus URL massal, ngerayapi subhalaman, dan ekspor data dalam format terstruktur (CSV, Excel, Google Sheets, Notion, dan lainnya). Artinya, nggak ada lagi maraton copy-paste atau beberes file teks yang amburadul.

Dengan fakta bahwa , ngerjain ini manual jelas bukan opsi. Ekstraktor link yang tepat itu kayak asisten super: nggak pernah capek, nggak pernah kelewat link, dan nggak pernah minta break ngopi.

Cara Kami Memilih Ekstraktor Link Terbaik

Dengan pilihan seabrek, milih ekstraktor link yang pas itu rasanya kayak speed-dating di konferensi tech—semua ngaku “paling cocok”, tapi yang beneran terbukti cuma sedikit. Ini kriteria yang saya pakai buat nyaring 12 terbaik:

- Kemudahan Dipakai: Apakah orang non-teknis bisa pakai tanpa harus jago regex? Solusi no-code dan low-code dapat poin plus.

- Scraping Massal & Multi-Level: Bisa ngurus ratusan URL sekaligus? Bisa ngerayapi subhalaman dan ngikutin link otomatis?

- Ekspor & Integrasi: Bisa ekspor ke CSV, Excel, Google Sheets, Notion, Airtable, atau lewat API? Makin minim kerja manual, makin oke.

- Tipe Pengguna & Fleksibilitas: Ini buat pengguna bisnis, analis, atau developer? Ada yang cocok buat semua, ada juga yang super spesifik.

- Fitur Lanjutan: Pengenalan berbasis AI, penjadwalan, skala berbasis cloud, pembersihan data, dan template buat situs umum.

- Harga & Skalabilitas: Ada paket gratis, pay-as-you-go, atau enterprise? Saya nilai value yang kamu dapat dibanding biaya yang dibayar.

Saya masukin semuanya—dari ekstensi browser sampai platform enterprise—jadi mau kamu founder solo atau tim data perusahaan gede, harusnya bisa nemu yang paling pas.

Thunderbit: Ekstraktor Link Paling Cerdas untuk Pengguna Bisnis

Kita mulai dari yang paling atas. adalah rekomendasi utama saya buat ekstraksi link—dan bukan cuma karena saya ikut ngebangunnya. Thunderbit adalah yang dibuat buat pengguna bisnis yang butuh hasil cepat.

Apa yang bikin Thunderbit beda? Rasanya kayak punya intern AI yang beneran ngerti instruksi. Kamu tinggal jelasin pakai bahasa natural apa yang kamu mau (“Ambil semua link produk dan harganya dari halaman ini”), lalu AI Thunderbit yang beresin sisanya. Nggak perlu utak-atik selector atau nulis skrip.

Dan fiturnya nggak berhenti di situ:

- Dukungan URL Massal: Tempel satu URL atau daftar ratusan URL—Thunderbit proses semuanya sekaligus.

- Navigasi Subhalaman: Perlu ambil link dari halaman daftar lalu buka tiap halaman detail buat URL tambahan? Logika scraping multi-layer Thunderbit siap bantu.

- Ekspor Terstruktur: Setelah link diekstrak, kamu bisa ganti nama field, ngelompokkan, lalu ekspor langsung ke Google Sheets, Notion, Airtable, Excel, atau CSV. Nggak perlu pusing post-processing.

Thunderbit dipercaya lebih dari 30.000 pengguna di seluruh dunia—mulai dari tim sales, agen properti, sampai toko e-commerce independen. Dan ya, ada (scrape hingga 6 halaman, atau 10 dengan boost trial), jadi kamu bisa coba tanpa rasa was-was.

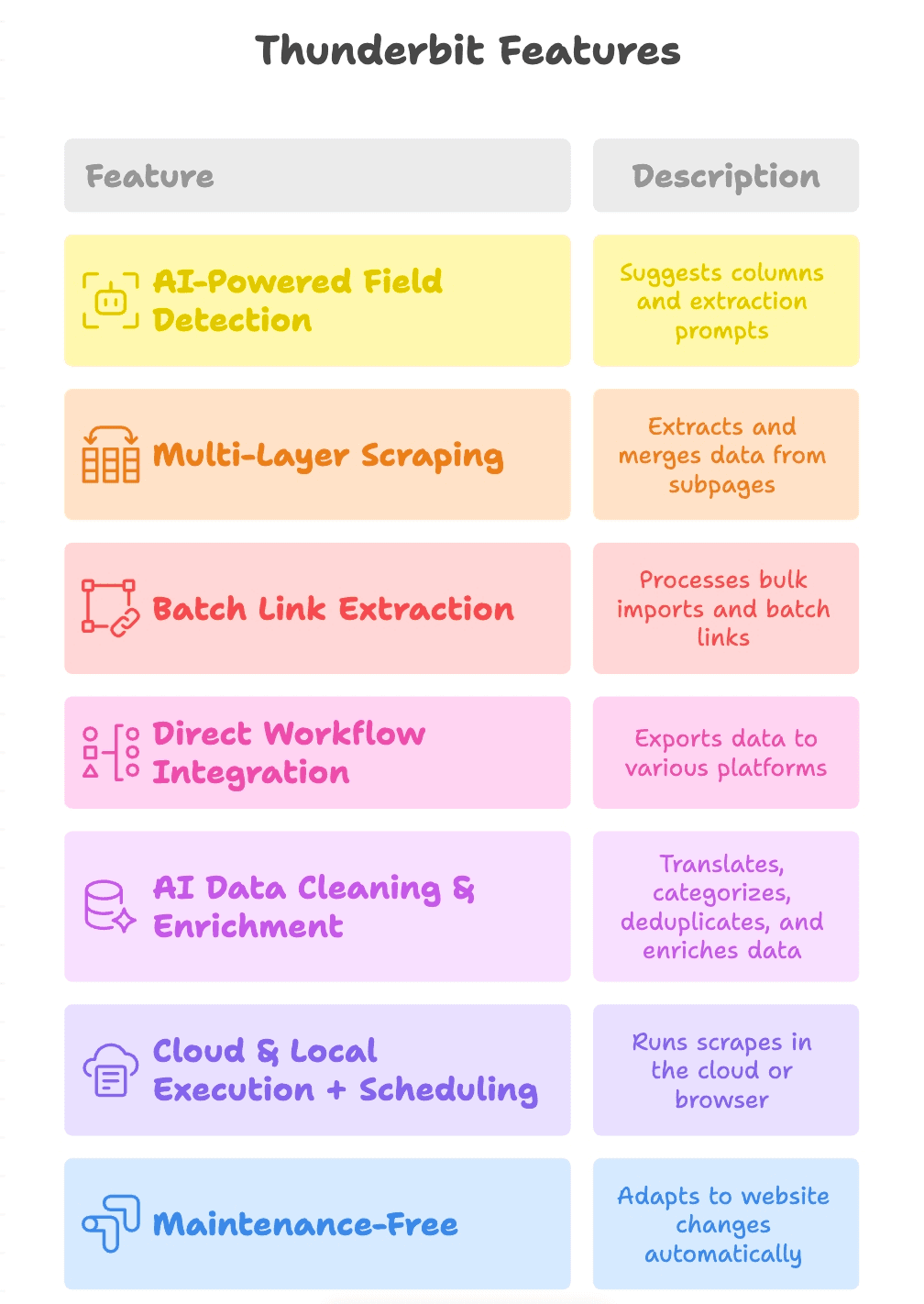

Fitur Unggulan Thunderbit

Sekarang kita bedah hal-hal yang bikin Thunderbit beneran standout:

- Deteksi Field Berbasis AI: Tinggal klik “AI Suggest Fields”, Thunderbit baca halaman, nyaranin kolom (misalnya “Link Produk”, “URL PDF”, “Email Kontak”), bahkan bikin prompt ekstraksi buat tiap field.

- Scraping Multi-Layer: Thunderbit bisa ngikutin link dari halaman utama ke subhalaman (kayak halaman detail produk atau unduhan PDF), ekstrak link tambahan, lalu gabungin semuanya ke satu tabel.

- Ekstraksi Link Batch: Mau scrape link satu halaman atau seribu, Thunderbit bisa proses impor massal dan ekstraksi batch dengan gampang.

- Integrasi Alur Kerja Langsung: Ekspor hasil ke Google Sheets, Notion, Airtable, atau unduh sebagai CSV/Excel. Data langsung nyampe ke tempat yang tim butuhin.

- Pembersihan & Enrichment Data dengan AI: Thunderbit bisa nerjemahin, ngategorikan, ngapus duplikasi, bahkan memperkaya data saat proses scraping—hasilnya siap dipakai, bukan sekadar dump mentah.

- Eksekusi Cloud & Lokal + Penjadwalan: Jalanin scraping di cloud biar lebih ngebut, atau di browser buat situs yang butuh login. Jadwalkan job berkala biar data selalu up to date.

- Minim Perawatan: AI Thunderbit adaptif sama perubahan situs, jadi kamu lebih jarang benerin scraper yang rusak dan lebih fokus ke hasil.

Octoparse: Link Scraper No-Code untuk Semua Orang

itu “legend” di dunia scraping no-code. Ini aplikasi desktop (Windows/Mac) dengan UI visual point-and-click. Kamu buka halaman web, klik link yang mau diambil, dan Octoparse yang ngurus sisanya.

- Cocok untuk Pemula: Tanpa coding. Tinggal klik, ekstrak, kelar.

- Mendukung Pagination & Konten Dinamis: Octoparse bisa pencet tombol “Next”, scroll, bahkan login ke situs.

- Scraping Cloud & Penjadwalan: Paket berbayar bikin job bisa jalan di cloud dan dijadwalkan rutin.

- Opsi Ekspor: Unduh data sebagai CSV, Excel, JSON, atau kirim ke database.

Paket gratisnya lumayan lega buat kerjaan kecil (hingga 10 task dan 50.000 baris/bulan), tapi pengguna berat biasanya butuh paket berbayar (mulai sekitar $75/bulan).

Apify: Ekstraktor URL Fleksibel untuk Alur Kerja Kustom

itu “pisau Swiss”-nya web scraping. Ada marketplace berisi “actor” siap pakai (alat scraping), dan kamu juga bisa nulis skrip sendiri pakai JavaScript atau Python.

- Siap Pakai & Bisa Dikustomisasi: Pakai actor komunitas buat kebutuhan umum, atau bikin sendiri buat workflow khusus.

- Scraping Massal & Terjadwal: Antrekan URL, jalanin job paralel, dan jadwalkan scraping berkala.

- Berbasis API: Ekspor ke JSON, CSV, Excel, atau Google Sheets, dan integrasikan ke pipeline data.

- Pay-As-You-Go: Ada kredit gratis tiap bulan, lalu tagihan berdasarkan pemakaian.

Apify ideal buat tim semi-teknis dan developer yang butuh fleksibilitas sekaligus skalabilitas.

Bright Data URL Scraper: Scraping Link Kelas Enterprise

dibuat buat perusahaan yang perlu scraping skala besar. Data Collector mereka nyediain URL Scraper preset buat kerjaan volume tinggi.

- Skala Sangat Besar: Scrape ribuan sampai jutaan halaman, dengan infrastruktur proxy kuat buat ngindarin pemblokiran.

- Template Siap Pakai: Scraper siap buat e-commerce, sosial, properti, dan lainnya.

- Fitur Enterprise: Alat kepatuhan, dukungan ahli, dan anti-blocking tingkat lanjut.

- Harga: Mulai sekitar $350 untuk 100.000 page loads—jelas targetnya bisnis besar.

Kalau kamu startup, ini mungkin terasa terlalu “berat”. Tapi buat scraping volume tinggi yang bener-bener krusial, Bright Data itu kuat banget.

WebHarvy: Ekstraktor Link Visual yang Tinggal Klik

adalah aplikasi desktop (Windows) yang bikin kamu bisa ambil link cukup dengan ngeklik di browser bawaan.

- Sangat Mudah: Klik satu link, WebHarvy bakal nyorot elemen serupa buat diekstrak.

- Dukungan Regular Expression: Pola bawaan buat kebutuhan umum, tanpa coding.

- Ekspor ke Excel, CSV, JSON, XML, SQL: Cocok buat pengguna bisnis yang pengin format yang familiar.

- Lisensi Sekali Bayar: Bayar sekali, pakai selamanya.

Pas buat UMKM, peneliti, atau siapa pun yang butuh cara cepat dan praktis ambil link tanpa coding.

Web Scraper (Ekstensi Chrome): Scraping Link Cepat di Browser

adalah alat gratis open-source yang ngubah browser kamu jadi scraper.

- Definisikan Sitemap: Tentuin cara navigasi dan apa yang harus diekstrak.

- Mendukung Pagination & Crawling Multi-Level: Rayapi kategori, subkategori, sampai halaman detail.

- Ekspor ke CSV/XLSX: Unduh data langsung dari browser.

- Template Komunitas: Banyak sitemap yang dibagikan buat situs populer.

Cocok buat kerjaan cepat sekali jalan, atau buat pelajar dan tim kecil yang budget-nya ketat.

ScraperAPI: Link Scraper Skalabel untuk Developer

ditujukan buat developer yang pengin ngambil halaman web skala besar tanpa pusing soal proxy, blokir, atau CAPTCHA.

- Berbasis API: Kirim URL, dapet HTML atau data hasil scraping.

- Siap untuk Skala & Anti-Bot: Rotasi proxy, rendering JS, dan pemecahan CAPTCHA udah tersedia.

- Mudah Diintegrasikan ke Kode: Bisa dipakai dengan Python, Node.js, atau bahasa apa pun.

- Harga: Ada paket gratis (~1000 panggilan API), lalu bayar per request.

Bagus buat crawler kustom atau saat kamu butuh keandalan dan kecepatan di skala besar.

ParseHub: Link Scraper Visual dengan Seleksi Lebih Canggih

adalah aplikasi desktop (Windows, Mac, Linux) buat bikin proyek scraping secara visual.

- Seleksi & Navigasi Lanjutan: Klik, loop, dan ekstrak link pakai kondisi—bahkan dari elemen dinamis atau tersembunyi.

- Mendukung Halaman Bertingkat: Rayapi kategori, lanjut ke halaman detail, lalu ambil link tambahan.

- Ekspor ke CSV, Excel, JSON: Eksekusi cloud dan akses API tersedia di paket berbayar.

- Paket Gratis: 5 proyek, hingga 200 halaman per run.

ParseHub jadi favorit marketer dan peneliti yang pengin fitur kuat tanpa coding.

Scrapy: Ekstraktor Link Python untuk Developer

adalah standar emas buat developer Python yang pengin kontrol penuh.

- Berbasis Kode: Bangun spider kustom buat ngerayapi dan mengekstrak link di skala apa pun.

- Mendukung Crawling Terdistribusi: Efisien, asinkron, dan super bisa dikustomisasi.

- Ekspor ke CSV, JSON, XML, atau Database: Output sepenuhnya kamu yang atur.

- Open-Source & Gratis: Tapi kamu perlu ngurus environment sendiri.

Kalau kamu nyaman dengan Python, Scrapy termasuk yang paling gahar.

Diffbot: Link Scraper Berbasis AI untuk Data Terstruktur

adalah “otak AI” buat web scraping. Dia menganalisis halaman dan ngembaliin data terstruktur—termasuk link—tanpa setup manual.

- Pengenalan Konten Otomatis: Masukkan URL, dapatkan data terstruktur (artikel, produk, link, dll.).

- Crawlbot & Knowledge Graph: Rayapi seluruh situs, atau query indeks web mereka yang besar.

- Berbasis API: Integrasikan dengan alat BI atau pipeline data.

- Harga Enterprise: Mulai sekitar $299/bulan, sebanding sama kualitasnya.

Paling cocok buat perusahaan yang pengin data rapi dan terstruktur tanpa ngurus scraper sendiri.

Cheerio: Link Scraper Ringan untuk Node.js

adalah parser HTML cepat gaya jQuery buat Node.js.

- Sangat Cepat: Parsing HTML dalam hitungan milidetik.

- Sintaks Familiar: Kalau kamu paham jQuery, bakal cepat nyambung sama Cheerio.

- Ideal untuk Halaman Statis: Nggak ngerender JS, tapi pas banget buat konten server-rendered.

- Open-Source & Gratis: Biasanya dipasangkan dengan axios atau fetch buat request.

Cocok buat developer yang bikin skrip kustom dan ngincer kecepatan plus kesederhanaan.

Puppeteer: Otomasi Browser untuk Scraping Link Tingkat Lanjut

adalah library Node.js buat ngendaliin Chrome dalam mode headless.

- Otomasi Browser Penuh: Muat halaman, klik, scroll, dan interaksi kayak user beneran.

- Mendukung Konten Dinamis & Login: Ideal buat situs berat JavaScript atau workflow kompleks.

- Kontrol Detail: Nunggu elemen, ambil screenshot, ngintersep request jaringan.

- Open-Source & Gratis: Tapi lebih berat resource dan lebih lambat dibanding alat ringan.

Pakai Puppeteer kalau kamu perlu ambil link dari situs yang “nggak ramah” buat scraper sederhana.

Perbandingan Singkat: Ekstraktor Link Mana yang Paling Cocok?

Berikut ringkasan cepat 12 alat tersebut:

| Tool | Paling Cocok Untuk | Dukungan Massal & Subhalaman | Opsi Ekspor Data | Harga |

|---|---|---|---|---|

| Thunderbit | Non-teknis, bisnis | Ya (AI, multi-level) | Excel, CSV, Sheets, Notion, Airtable | Trial gratis, mulai ~US$9/bln |

| Octoparse | Pengguna no-code, analis | Ya | CSV, Excel, JSON, penyimpanan cloud | Ada paket gratis, ~US$75/bln |

| Apify | Semi-teknis, developer | Ya | CSV, JSON, Sheets via API | Kredit gratis, berbasis pemakaian |

| Bright Data | Enterprise | Ya (volume tinggi) | CSV, JSON, NDJSON via API | ~US$350/100k halaman |

| WebHarvy | Non-teknis, desktop | Ya | Excel, CSV, JSON, XML, SQL | Lisensi berbayar |

| Web Scraper Extension | Siapa saja, cepat/gratis | Ya | CSV, XLSX | Gratis, open-source |

| ScraperAPI | Developer, pengguna API | Ya | JSON (HTML via API) | Gratis 1k request, paket berbayar |

| ParseHub | Non-teknis, kebutuhan lanjut | Ya | CSV, Excel, JSON, API | Gratis 5 proyek, berbayar |

| Scrapy | Developer, Python | Ya | CSV, JSON, XML, DB | Gratis, open-source |

| Diffbot | Enterprise, AI | Ya (AI crawl) | JSON (data terstruktur via API) | ~US$299/bln+ |

| Cheerio | Developer, Node.js | Ya (kode kustom) | Kustom (JSON, dll.) | Gratis, open-source |

| Puppeteer | Developer, situs kompleks | Ya (otomasi penuh) | Kustom (output via skrip) | Gratis, open-source |

Memilih Link Scraper yang Tepat untuk Bisnis Anda

Jadi, pilih yang mana? Ini contekan versi saya:

- Tidak bisa coding? Mulai dari Thunderbit, Octoparse, ParseHub, WebHarvy, atau ekstensi Web Scraper.

- Butuh workflow kustom? Apify, ScraperAPI, atau Cheerio cocok buat developer.

- Skala enterprise? Bright Data atau Diffbot memang dibuat buat kebutuhan besar.

- Developer Python atau Node.js? Scrapy (Python) atau Cheerio/Puppeteer (Node.js) ngasih kontrol penuh.

- Ingin ekspor langsung ke Sheets/Notion? Thunderbit pilihan paling aman.

Sesuaikan alat dengan kenyamanan teknis, volume data, dan kebutuhan integrasi kamu. Kebanyakan juga nyediain trial gratis, jadi jangan ragu buat coba beberapa.

Nilai Unik Thunderbit untuk Ekstraksi Link di 2026

Kita balik lagi ke poin yang bikin Thunderbit beneran beda:

- Sederhana Berkat AI: Jelaskan kebutuhan kamu pakai bahasa sehari-hari—AI Thunderbit yang ngurus sisanya.

- Scraping Multi-Layer: Ambil link dari halaman utama, lanjut ke subhalaman, lalu ambil URL tambahan—dalam satu alur.

- Impor Massal & Pemrosesan Batch: Tempel ratusan URL, ekstrak link secara massal, dan ekspor data terstruktur seketika.

- Integrasi Workflow: Ekspor langsung ke Google Sheets, Notion, Airtable, atau unduh sebagai CSV/Excel.

- Tanpa Perawatan: AI Thunderbit adaptif saat situs berubah, jadi kamu nggak terus-terusan benerin scraper yang rusak.

Thunderbit ngejembatani jarak antara “sekadar scraping data” dan “dapet data yang beneran siap dipakai.” Ini tool yang saya harap udah saya punya dari dulu, waktu masih tenggelam di kerjaan data manual.

Kesimpulan: Scraping Link Lebih Cerdas untuk Workflow yang Lebih Kencang

Data web itu bahan bakar pertumbuhan bisnis—dan ekstraktor link yang tepat adalah mesinnya. Mau kamu lagi bangun daftar lead, mantau kompetitor, atau ngotomatisasi riset, pasti ada tool di daftar ini yang nyambung sama kebutuhan dan level skill kamu.

Kalau kamu pengin lihat seperti apa ekstraksi link modern, . Kamu mungkin bakal kaget, ternyata banyak banget yang bisa kelar cuma dalam beberapa klik. Dan kalau Thunderbit ternyata bukan yang paling pas, cobain opsi lain dari daftar ini—ini momen terbaik buat ngotomatisasi kerjaan membosankan dan fokus ke hal yang beneran penting.

Selamat scraping—semoga link kamu selalu rapi, terstruktur, dan siap dipakai. Kalau pengin ngulik web scraping lebih dalam, mampir ke buat panduan dan tips lainnya.

FAQ

1. Kenapa ekstraktor link itu penting?

Dengan hampir setengah trafik internet berasal dari bot dan bisnis makin agresif ngumpulin data, ekstraktor link jadi penting banget buat ngubah “kekacauan” web jadi insight yang bisa ditindaklanjuti. Tool ini bantu ngotomatisasi kerjaan kayak lead generation, agregasi konten, audit SEO, dan pemantauan kompetitor—hemat waktu dan tenaga besar-besaran.

2. Apa yang membuat Thunderbit menonjol dibanding ekstraktor link lain?

Thunderbit pakai AI biar scraping jadi simpel—kamu cukup jelasin tujuan pakai bahasa biasa, dan sisanya otomatis. Thunderbit dukung input URL massal, scraping multi-layer, deteksi field cerdas, plus ekspor mulus ke platform kayak Google Sheets dan Notion. Cocok buat pengguna bisnis dan non-teknis yang pengin hasil kuat tanpa ribet teknis.

3. Apakah ada alat ekstraktor link yang cocok untuk developer dan workflow kustom?

Ada. Apify, ScraperAPI, Cheerio, Puppeteer, dan Scrapy memang ditujukan buat developer. Mereka nyediain scripting, integrasi API, dan fleksibilitas buat ngurus scraping kompleks, kerjaan skala besar, serta otomasi tingkat lanjut.

4. Alat mana yang terbaik untuk pengguna tanpa pengalaman coding?

Thunderbit, Octoparse, ParseHub, WebHarvy, dan ekstensi Web Scraper Chrome adalah pilihan utama buat pengguna non-teknis. Tool-tool ini punya antarmuka visual, template siap pakai, dan fitur berbasis AI yang bikin ekstraksi link gampang buat siapa saja.

5. Bagaimana cara memilih ekstraktor link yang tepat?

Pertimbangkan kemampuan teknis kamu, volume data, dan kebutuhan ekspor. Pengguna non-teknis sebaiknya pilih Thunderbit atau Octoparse, sementara developer mungkin lebih cocok pakai Scrapy atau Puppeteer. Untuk skala besar, perusahaan bisa pertimbangkan Bright Data atau Diffbot. Mulai dari trial gratis dulu biar yakin yang paling pas.