Mari jujur—Amazon pada dasarnya adalah mal, supermarket, dan toko elektronik untuk seluruh internet. Kalau Anda bekerja di bidang sales, e-commerce, atau operations, Anda pasti sudah tahu bahwa apa yang terjadi di Amazon tidak berhenti di Amazon—itu memengaruhi harga, inventaris, bahkan peluncuran produk besar berikutnya. Tapi ada satu masalah: semua detail produk, harga, rating, dan ulasan yang menggiurkan itu terkunci di balik antarmuka web yang dibuat untuk pembeli, bukan untuk tim yang haus data. Jadi, bagaimana cara mendapatkan data itu tanpa menghabiskan akhir pekan untuk copy-paste seperti tahun 1999?

Di sinilah web scraping berperan. Dalam panduan ini, saya akan menunjukkan dua cara mengekstrak data produk Amazon: pendekatan klasik “siapkan tangan dan tulis kodenya di Python”, dan cara modern “biarkan AI yang mengerjakan bagian beratnya” dengan no code web scraper seperti . Saya akan membahas kode Python nyata (beserta berbagai kendala dan cara mengatasinya), lalu menunjukkan bagaimana Thunderbit bisa memberi Anda data yang sama hanya dalam beberapa klik—tanpa perlu coding. Entah Anda developer, analis bisnis, atau sekadar orang yang bosan input data manual, panduan ini untuk Anda.

Mengapa Mengekstrak Data Produk Amazon? (amazon scraper python, web scraping with python)

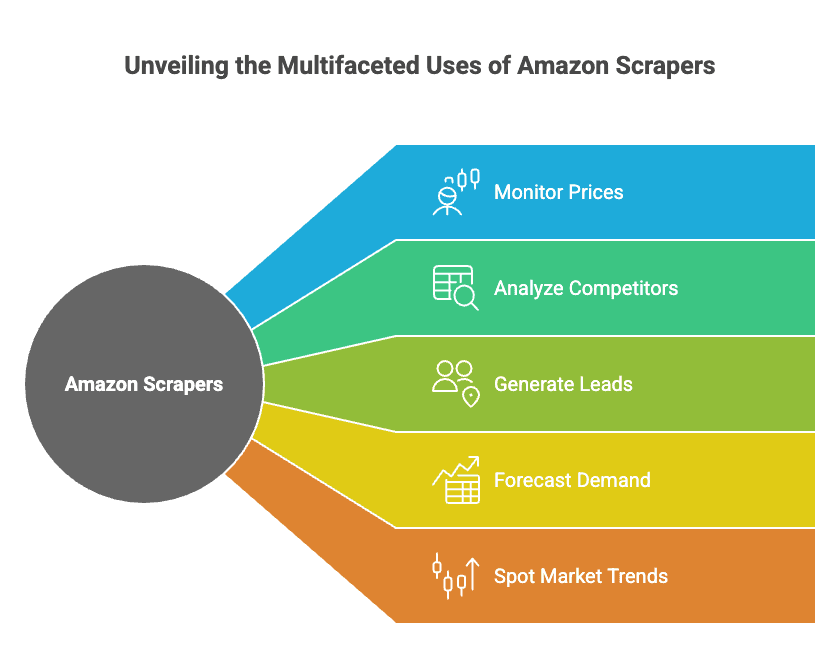

Amazon bukan cuma retailer online terbesar di dunia—tetapi juga pasar terbuka terbesar di dunia untuk competitive intelligence. Dengan dan , Amazon adalah tambang emas bagi siapa pun yang ingin:

- Memantau harga (dan menyesuaikan harga Anda secara real time)

- Menganalisis pesaing (melacak peluncuran baru, rating, dan ulasan mereka)

- Menghasilkan lead (menemukan penjual, pemasok, atau bahkan calon mitra)

- Memprediksi permintaan (dengan memantau stok dan peringkat penjualan)

- Menangkap tren pasar (dengan menambang ulasan dan hasil pencarian)

Dan ini bukan sekadar teori—bisnis nyata melihat ROI yang nyata. Misalnya, sebuah retailer elektronik menggunakan data harga Amazon hasil scraping untuk , sementara merek lain melihat setelah mengotomatiskan pelacakan harga pesaing.

Berikut tabel singkat use case dan jenis ROI yang bisa Anda harapkan:

| Use Case | Siapa yang Menggunakan | ROI / Manfaat Tipikal |

|---|---|---|

| Pemantauan Harga | E-commerce, Ops | Kenaikan margin keuntungan 15%+, kenaikan penjualan 4%, waktu analis 30% lebih sedikit |

| Analisis Pesaing | Sales, Product, Ops | Penyesuaian harga lebih cepat, daya saing meningkat |

| Riset Pasar (Ulasan) | Product, Marketing | Iterasi produk lebih cepat, copy iklan lebih baik, insight SEO |

| Generasi Lead | Sales | 3.000+ lead/bulan, hemat 8+ jam per rep per minggu |

| Inventaris & Peramalan Permintaan | Ops, Supply Chain | Pengurangan overstock 20%, lebih sedikit stock-out |

| Menangkap Tren | Marketing, Eksekutif | Deteksi dini produk dan kategori yang sedang naik daun |

Dan ini yang paling penting: sekarang melaporkan nilai yang terukur dari analitik data. Kalau Anda tidak melakukan scraping Amazon, berarti Anda meninggalkan insight (dan uang) di meja.

Gambaran Umum: Amazon Scraper Python vs. No Code Web Scraper Tools

Ada dua cara utama untuk mengambil data Amazon dari browser dan memasukkannya ke spreadsheet atau dashboard Anda:

-

Amazon Scraper Python (web scraping with python):

Tulis skrip sendiri menggunakan library Python seperti Requests dan BeautifulSoup. Ini memberi Anda kontrol penuh, tetapi Anda harus tahu cara coding, menangani anti-bot, dan memelihara skrip saat Amazon mengubah situsnya.

-

No Code Web Scraper Tools (seperti Thunderbit):

Gunakan alat yang memungkinkan Anda point, click, dan mengekstrak data—tanpa perlu pemrograman. Alat modern seperti bahkan memakai AI untuk menentukan data apa yang harus diambil, menangani subpage dan pagination, lalu mengekspor langsung ke Excel atau Google Sheets.

Berikut perbandingannya:

| Kriteria | Python Scraper | No Code (Thunderbit) |

|---|---|---|

| Waktu Setup | Tinggi (install, coding, debugging) | Rendah (install ekstensi) |

| Keahlian yang Dibutuhkan | Harus bisa coding | Tidak ada (point & click) |

| Fleksibilitas | Tak terbatas | Tinggi untuk use case umum |

| Pemeliharaan | Anda yang memperbaiki kode | Tool memperbarui dirinya sendiri |

| Penanganan Anti-Bot | Anda yang mengelola proxy, header | Sudah встроенный, ditangani untuk Anda |

| Skalabilitas | Manual (thread, proxy) | Cloud scraping, paralel |

| Ekspor Data | Kustom (CSV, Excel, DB) | Satu klik ke Excel, Sheets |

| Biaya | Gratis (waktu Anda + proxy) | Freemium, bayar untuk skala |

| Paling Cocok Untuk | Developer, kebutuhan kustom | Pengguna bisnis, hasil cepat |

Di bagian berikutnya, saya akan memandu Anda melalui kedua pendekatan—pertama, cara membangun Amazon scraper di Python (dengan kode nyata), lalu cara melakukan hal yang sama dengan AI web scraper milik Thunderbit.

Memulai Amazon Scraper Python: Prasyarat & Setup

Sebelum masuk ke kode, mari siapkan environment Anda.

Yang Anda butuhkan:

- Python 3.x (unduh dari )

- Code editor (saya suka VS Code, tapi yang lain juga bisa)

- Library berikut:

requests(untuk HTTP request)beautifulsoup4(untuk parsing HTML)lxml(parser HTML cepat)pandas(untuk tabel data/ekspor)re(regular expressions, bawaan)

Install library:

1pip install requests beautifulsoup4 lxml pandasSetup project:

- Buat folder baru untuk project Anda.

- Buka editor, buat file Python baru (misalnya,

amazon_scraper.py). - Anda siap memulai!

Langkah demi Langkah: Web Scraping dengan Python untuk Data Produk Amazon

Mari kita bahas cara scraping satu halaman produk Amazon. (Jangan khawatir, nanti kita bahas scraping banyak produk dan halaman juga.)

1. Mengirim Request dan Mengambil HTML

Pertama, mari ambil HTML dari halaman produk. (Ganti URL dengan produk Amazon apa pun.)

1import requests

2url = "<https://www.amazon.com/dp/B0ExampleASIN>"

3response = requests.get(url)

4html_content = response.text

5print(response.status_code)Perhatian: Request dasar ini kemungkinan besar akan diblokir Amazon. Anda mungkin melihat error 503 atau CAPTCHA, bukan halaman produk. Kenapa? Karena Amazon tahu Anda bukan browser asli.

Menangani Langkah Anti-Bot Amazon

Amazon tidak suka bot. Agar tidak diblokir, Anda perlu:

- Mengatur header User-Agent (pura-pura menjadi Chrome atau Firefox)

- Merotasi User-Agent (jangan pakai yang sama terus-menerus)

- Memberi jeda pada request (tambahkan delay acak)

- Menggunakan proxy (untuk scraping skala besar)

Berikut cara mengatur header:

1headers = {

2 "User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64)... Safari/537.36",

3 "Accept-Language": "en-US,en;q=0.9",

4}

5response = requests.get(url, headers=headers)Ingin lebih canggih? Gunakan daftar User-Agent dan rotasi untuk setiap request. Untuk pekerjaan besar, Anda sebaiknya memakai layanan proxy (banyak pilihannya), tetapi untuk scraping skala kecil, header dan delay biasanya sudah cukup.

Mengekstrak Field Produk Utama

Setelah Anda punya HTML, saatnya parsing dengan BeautifulSoup.

1from bs4 import BeautifulSoup

2soup = BeautifulSoup(html_content, "lxml")Sekarang, mari ambil data pentingnya:

Judul Produk

1title_elem = soup.find(id="productTitle")

2product_title = title_elem.get_text(strip=True) if title_elem else NoneHarga

Harga Amazon bisa muncul di beberapa tempat. Coba ini:

1price = None

2price_elem = soup.find(id="priceblock_ourprice") or soup.find(id="priceblock_dealprice")

3if price_elem:

4 price = price_elem.get_text(strip=True)

5else:

6 price_whole = soup.find("span", {"class": "a-price-whole"})

7 price_frac = soup.find("span", {"class": "a-price-fraction"})

8 if price_whole and price_frac:

9 price = price_whole.text + price_frac.textRating dan Jumlah Ulasan

1rating_elem = soup.find("span", {"class": "a-icon-alt"})

2rating = rating_elem.get_text(strip=True) if rating_elem else None

3review_count_elem = soup.find(id="acrCustomerReviewText")

4reviews_text = review_count_elem.get_text(strip=True) if review_count_elem else ""

5reviews_count = reviews_text.split()[0] # misalnya, "1,554 ratings"URL Gambar Utama

Amazon terkadang menyembunyikan gambar resolusi tinggi dalam JSON di dalam HTML. Berikut pendekatan regex singkat:

1import re

2match = re.search(r'"hiRes":"(https://.*?.jpg)"', html_content)

3main_image_url = match.group(1) if match else NoneAtau, ambil tag gambar utama:

1img_tag = soup.find("img", {"id": "landingImage"})

2img_url = img_tag['src'] if img_tag else NoneDetail Produk

Spesifikasi seperti merek, berat, dan dimensi biasanya ada di tabel:

1details = {}

2rows = soup.select("#productDetails_techSpec_section_1 tr")

3for row in rows:

4 header = row.find("th").get_text(strip=True)

5 value = row.find("td").get_text(strip=True)

6 details[header] = valueAtau, jika Amazon menggunakan format “detailBullets”:

1bullets = soup.select("#detailBullets_feature_div li")

2for li in bullets:

3 txt = li.get_text(" ", strip=True)

4 if ":" in txt:

5 key, val = txt.split(":", 1)

6 details[key.strip()] = val.strip()Cetak hasilnya:

1print("Title:", product_title)

2print("Price:", price)

3print("Rating:", rating, "berdasarkan", reviews_count, "ulasan")

4print("Main image URL:", main_image_url)

5print("Details:", details)Scraping Banyak Produk dan Menangani Pagination

Satu produk memang bagus, tapi Anda mungkin butuh daftar lengkap. Berikut cara scraping hasil pencarian dan banyak halaman.

Mengambil Link Produk dari Halaman Pencarian

1search_url = "<https://www.amazon.com/s?k=bluetooth+headphones>"

2res = requests.get(search_url, headers=headers)

3soup = BeautifulSoup(res.text, "lxml")

4product_links = []

5for a in soup.select("h2 a.a-link-normal"):

6 href = a['href']

7 full_url = "<https://www.amazon.com>" + href

8 product_links.append(full_url)Menangani Pagination

URL pencarian Amazon menggunakan &page=2, &page=3, dan seterusnya.

1for page in range(1, 6): # scrape 5 halaman pertama

2 search_url = f"<https://www.amazon.com/s?k=bluetooth+headphones&page=\{page\}>"

3 res = requests.get(search_url, headers=headers)

4 if res.status_code != 200:

5 break

6 soup = BeautifulSoup(res.text, "lxml")

7 # ... ekstrak link produk seperti di atas ...Loop Halaman Produk dan Ekspor ke CSV

Kumpulkan data produk Anda dalam list berisi dictionary, lalu gunakan pandas:

1import pandas as pd

2df = pd.DataFrame(product_data_list) # list of dicts

3df.to_csv("amazon_products.csv", index=False)Atau ke Excel:

1df.to_excel("amazon_products.xlsx", index=False)Best Practice untuk Proyek Amazon Scraper Python

Mari realistis—Amazon terus mengubah situsnya dan memerangi scraper. Berikut cara menjaga project Anda tetap berjalan:

- Rotasi header dan User-Agent (gunakan library seperti

fake-useragent) - Gunakan proxy untuk scraping skala besar

- Berikan jeda pada request (random

time.sleep()di antara request) - Tangani error dengan baik (retry saat 503, mundur jika diblokir)

- Tulis logika parsing yang fleksibel (cari beberapa selector untuk setiap field)

- Pantau perubahan HTML (jika skrip Anda tiba-tiba mengembalikan

Noneuntuk semuanya, cek halamannya) - Hormati robots.txt (Amazon melarang scraping di banyak bagian—lakukan dengan bertanggung jawab)

- Bersihkan data saat proses berjalan (hapus simbol mata uang, koma, whitespace)

- Tetap terhubung dengan komunitas (forum, Stack Overflow, Reddit r/webscraping)

Checklist untuk memelihara scraper Anda:

- [ ] Rotasi User-Agent dan header

- [ ] Gunakan proxy jika scraping dalam skala besar

- [ ] Tambahkan delay acak

- [ ] Modularkan kode agar mudah diperbarui

- [ ] Pantau ban atau CAPTCHA

- [ ] Ekspor data secara berkala

- [ ] Dokumentasikan selector dan logika Anda

Untuk pembahasan lebih dalam, lihat saya.

Alternatif No Code: Scraping Amazon dengan Thunderbit AI Web Scraper

Oke, jadi Anda sudah melihat cara pakai Python. Tapi bagaimana kalau Anda tidak ingin coding—atau Anda hanya ingin mendapatkan data dalam dua klik lalu lanjut menjalani hidup Anda? Di situlah berperan.

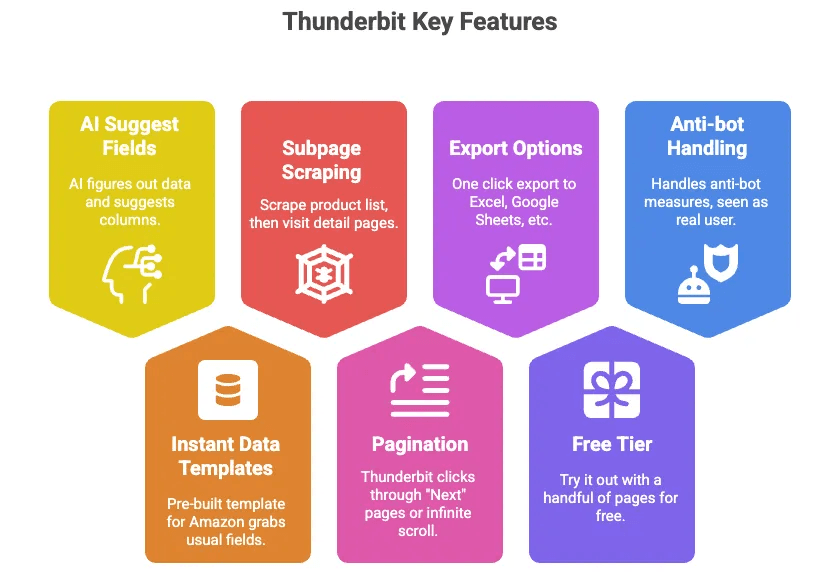

Thunderbit adalah ekstensi Chrome AI web scraper yang memungkinkan Anda mengekstrak data produk Amazon (dan data dari hampir semua situs web) tanpa coding sama sekali. Inilah alasan saya menyukainya:

- AI Suggest Fields: Cukup klik tombol, lalu AI Thunderbit akan mencari tahu data apa yang ada di halaman dan menyarankan kolom (seperti Title, Price, Rating, dll.).

- Instant Data Templates: Untuk Amazon, ada template bawaan yang mengambil semua field umum—tanpa setup apa pun.

- Subpage Scraping: Scrape daftar produk, lalu biarkan Thunderbit mengunjungi halaman detail tiap produk dan mengambil info tambahan secara otomatis.

- Pagination: Thunderbit bisa mengklik halaman “Next” atau scroll tak terbatas untuk Anda.

- Ekspor ke Excel, Google Sheets, Airtable, Notion: Satu klik, dan data Anda siap dipakai.

- Free Tier: Coba beberapa halaman secara gratis.

- Menangani masalah anti-bot untuk Anda: Karena berjalan di browser Anda (atau di cloud), Amazon melihatnya sebagai pengguna sungguhan.

Langkah demi Langkah: Menggunakan Thunderbit untuk Scrape Data Produk Amazon

Begini mudahnya:

-

Install Thunderbit:

Unduh dan masuk.

-

Buka Amazon:

Pergi ke halaman Amazon yang ingin Anda scrape (hasil pencarian, detail produk, apa pun).

-

Klik “AI Suggest Fields” atau Gunakan Template:

Thunderbit akan menyarankan kolom untuk diekstrak (atau Anda bisa memilih template Amazon Product).

-

Tinjau Kolom:

Sesuaikan kolom jika perlu (tambah/hapus field, ubah nama, dll.).

-

Klik “Scrape”:

Thunderbit mengambil data dari halaman dan menampilkannya dalam tabel.

-

Tangani Subpages & Pagination:

Jika Anda menscrape daftar, klik “Scrape Subpages” untuk mengunjungi halaman detail tiap produk dan mengambil info tambahan. Thunderbit juga bisa otomatis mengklik halaman “Next”.

-

Ekspor Data Anda:

Klik “Export to Excel” atau “Export to Google Sheets.” Selesai.

-

(Opsional) Jadwalkan Scraping:

Butuh data ini setiap hari? Gunakan scheduler Thunderbit untuk mengotomatiskannya.

Selesai. Tanpa kode, tanpa debugging, tanpa proxy, tanpa pusing. Untuk panduan visual, lihat atau .

Amazon Scraper Python vs. No Code Web Scraper: Perbandingan Berdampingan

Mari kita satukan semuanya:

| Kriteria | Python Scraper | Thunderbit (No Code) |

|---|---|---|

| Waktu Setup | Tinggi (install, coding, debugging) | Rendah (install ekstensi) |

| Keahlian yang Dibutuhkan | Harus bisa coding | Tidak ada (point & click) |

| Fleksibilitas | Tak terbatas | Tinggi untuk use case umum |

| Pemeliharaan | Anda yang memperbaiki kode | Tool memperbarui dirinya sendiri |

| Penanganan Anti-Bot | Anda yang mengelola proxy, header | Sudah bawaan, ditangani untuk Anda |

| Skalabilitas | Manual (thread, proxy) | Cloud scraping, paralel |

| Ekspor Data | Kustom (CSV, Excel, DB) | Satu klik ke Excel, Sheets |

| Biaya | Gratis (waktu Anda + proxy) | Freemium, bayar untuk skala |

| Paling Cocok Untuk | Developer, kebutuhan kustom | Pengguna bisnis, hasil cepat |

Kalau Anda developer yang suka bereksperimen dan butuh sesuatu yang sangat kustom, Python adalah teman Anda. Kalau Anda menginginkan kecepatan, kesederhanaan, dan tanpa coding, Thunderbit adalah pilihan tepat.

Kapan Memilih Python, No Code, atau AI Web Scraper untuk Data Amazon

Pilih Python jika:

- Anda butuh logika kustom atau ingin mengintegrasikan scraping ke sistem backend

- Anda scraping dalam skala sangat besar (puluhan ribu produk)

- Anda ingin belajar cara kerja scraping di balik layar

Pilih Thunderbit (no code, AI web scraper) jika:

- Anda ingin data cepat, tanpa coding

- Anda adalah pengguna bisnis, analis, atau marketer

- Anda perlu memberdayakan tim agar bisa mengambil data sendiri

- Anda ingin menghindari repotnya proxy, anti-bot, dan pemeliharaan

Gunakan keduanya jika:

- Anda ingin prototipe cepat dengan Thunderbit, lalu membangun solusi Python kustom untuk produksi

- Anda ingin memakai Thunderbit untuk pengumpulan data dan Python untuk pembersihan/analisis data

Bagi kebanyakan pengguna bisnis, Thunderbit akan memenuhi 90% kebutuhan Amazon scraping Anda dalam waktu yang jauh lebih singkat. Untuk 10% sisanya—yang sangat kustom, skala besar, atau terintegrasi mendalam—Python masih rajanya.

Kesimpulan & Poin Penting

Scraping data produk Amazon adalah kekuatan super bagi tim sales, e-commerce, atau operations. Entah Anda melacak harga, menganalisis pesaing, atau sekadar ingin menyelamatkan tim Anda dari copy-paste tanpa akhir, ada solusi untuk Anda.

- Scraping dengan Python memberi Anda kontrol penuh, tetapi datang dengan kurva belajar dan pemeliharaan berkelanjutan.

- No code web scraper seperti Thunderbit membuat ekstraksi data Amazon dapat diakses semua orang—tanpa coding, tanpa pusing, hanya hasil.

- Pendekatan terbaik? Gunakan alat yang sesuai dengan keterampilan, timeline, dan tujuan bisnis Anda.

Kalau Anda penasaran, coba Thunderbit—gratis untuk memulai, dan Anda akan kagum betapa cepatnya Anda bisa mendapatkan data yang dibutuhkan. Dan kalau Anda developer, jangan takut untuk memadukan keduanya: kadang cara tercepat membangun sesuatu adalah membiarkan AI menangani bagian yang membosankan untuk Anda.

FAQ

1. Mengapa sebuah bisnis ingin melakukan scraping data produk Amazon?

Scraping Amazon memungkinkan bisnis memantau harga, menganalisis pesaing, mengumpulkan ulasan untuk riset produk, memprediksi permintaan, dan menghasilkan lead penjualan. Dengan lebih dari 600 juta produk dan hampir 2 juta penjual di Amazon, ini adalah sumber competitive intelligence yang sangat kaya.

2. Apa perbedaan utama antara menggunakan Python dan tool no-code seperti Thunderbit untuk scraping Amazon?

Python scraper menawarkan fleksibilitas maksimum tetapi membutuhkan keahlian coding, waktu setup, dan pemeliharaan berkelanjutan. Thunderbit, AI web scraper tanpa coding, memungkinkan pengguna mengekstrak data Amazon secara instan lewat ekstensi Chrome—tanpa coding, dengan penanganan anti-bot bawaan serta opsi ekspor ke Excel atau Sheets.

3. Apakah legal melakukan scraping data dari Amazon?

Ketentuan layanan Amazon umumnya melarang scraping, dan mereka secara aktif menerapkan langkah anti-bot. Namun, banyak bisnis tetap melakukan scraping data yang tersedia secara publik sambil tetap bertanggung jawab, misalnya dengan menghormati batas laju request dan menghindari request berlebihan.

4. Data apa saja yang bisa saya ekstrak dari Amazon menggunakan web scraping tools?

Field data umum mencakup judul produk, harga, rating, jumlah ulasan, gambar, spesifikasi produk, ketersediaan, bahkan informasi penjual. Thunderbit juga mendukung subpage scraping dan pagination untuk menangkap data di berbagai listing dan halaman.

5. Kapan saya harus memilih scraping dengan Python dibanding tool seperti Thunderbit (atau sebaliknya)?

Gunakan Python jika Anda butuh kontrol penuh, logika kustom, atau berencana mengintegrasikan scraping ke sistem backend. Gunakan Thunderbit jika Anda menginginkan hasil cepat tanpa coding, perlu skala dengan mudah, atau merupakan pengguna bisnis yang mencari solusi dengan pemeliharaan rendah.

Ingin mendalami lebih jauh? Lihat sumber daya berikut:

Selamat scraping—semoga spreadsheet Anda selalu terbarui.