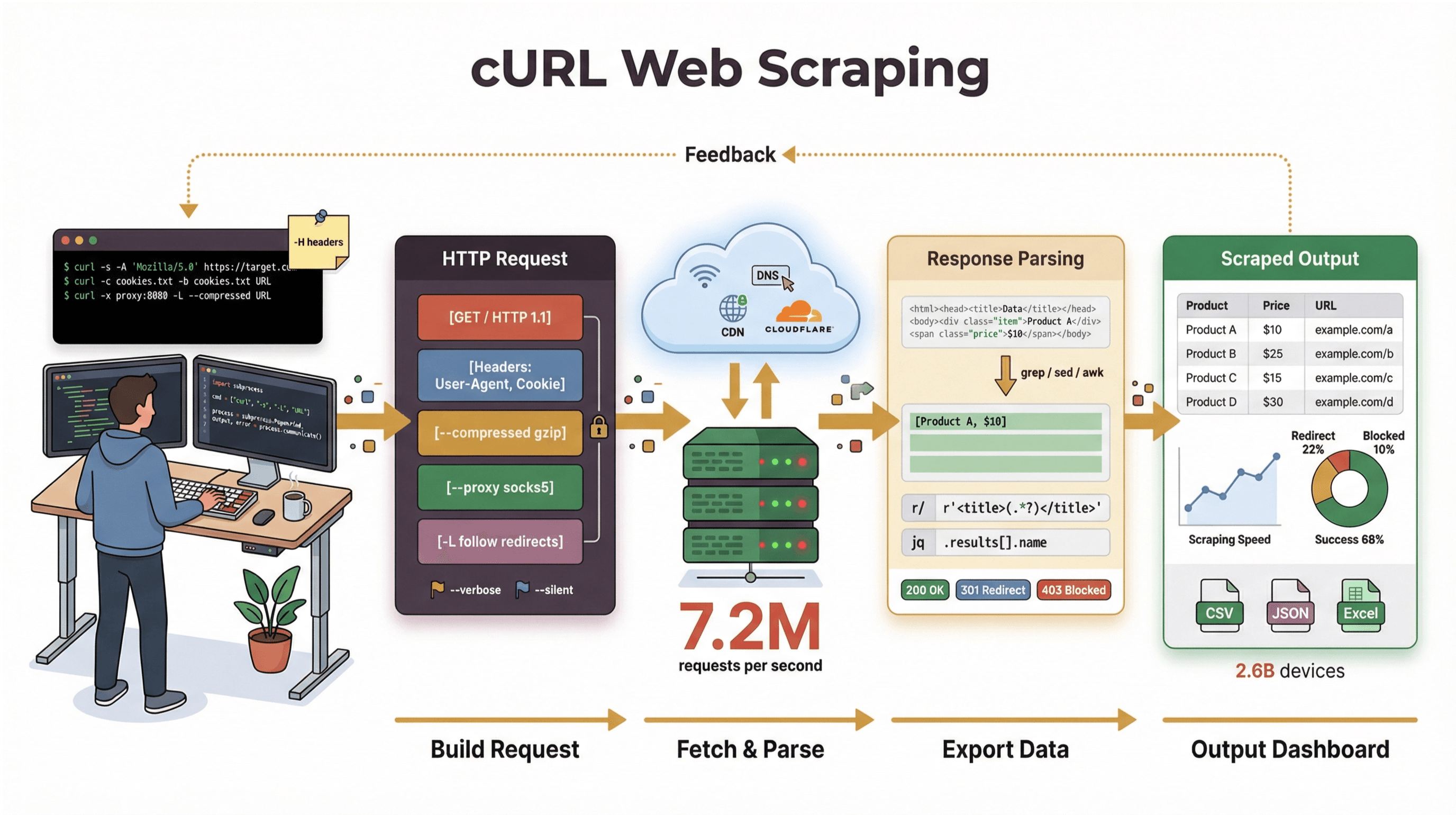

On jotain ajattoman tyydyttävää siinä, kun avaat terminaalin, naputat yhden komennon ja näet raakadatan valuvan sisään – ihan kuin olisit kurkistanut Matrixin kulissien taakse. Kehittäjille ja teknisille tehopelaajille on juuri se taikasauva: vaatimaton komentorivityökalu, joka pyörii huomaamatta miljardeissa laitteissa pilvipalvelimista älyjääkaappeihin. Ja vaikka vuonna 2026 markkinoilla on vaikka kuinka paljon kiiltäviä no-code- ja AI-scraping-työkaluja, web scraping cURLilla (ja ylipäätään web-scraping-with-curl) on yhä monen ensivalinta, kun tarvitaan nopeutta, kontrollia ja helppoa skriptattavuutta.

Olen vuosien ajan rakentanut automaatiotyökaluja ja auttanut tiimejä kesyttämään verkkodataa, ja silti tartun cURLiin aina, kun pitää napata sivu talteen, debugata APIa tai prototypoida scraping-työnkulku. Tässä oppaassa käyn läpi curl web scraping tutorial -kokonaisuuden: perusteet ja edistyneemmät niksit, oikeita komento-esimerkkejä, käytännön vinkkejä sekä rehellinen katsaus siihen, missä cURL loistaa (ja missä se tulee vastaan). Ja jos olet enemmän liiketoimintakäyttäjä, joka ei halua koskea komentoriviin, näytän myös, miten —AI-pohjainen web scraperimme—vie sinut kahdella klikkauksella “tarvitsen tämän datan” -tilasta “tässä on taulukko” -tilaan ilman koodausta.

Olen vuosien ajan rakentanut automaatiotyökaluja ja auttanut tiimejä kesyttämään verkkodataa, ja silti tartun cURLiin aina, kun pitää napata sivu talteen, debugata APIa tai prototypoida scraping-työnkulku. Tässä oppaassa käyn läpi curl web scraping tutorial -kokonaisuuden: perusteet ja edistyneemmät niksit, oikeita komento-esimerkkejä, käytännön vinkkejä sekä rehellinen katsaus siihen, missä cURL loistaa (ja missä se tulee vastaan). Ja jos olet enemmän liiketoimintakäyttäjä, joka ei halua koskea komentoriviin, näytän myös, miten —AI-pohjainen web scraperimme—vie sinut kahdella klikkauksella “tarvitsen tämän datan” -tilasta “tässä on taulukko” -tilaan ilman koodausta.

Sukelletaan siis aiheeseen: miksi cURL on edelleen relevantti web scrapingissa vuonna 2025, miten sitä käytetään fiksusti ja milloin kannattaa siirtyä vielä tehokkaampiin työkaluihin.

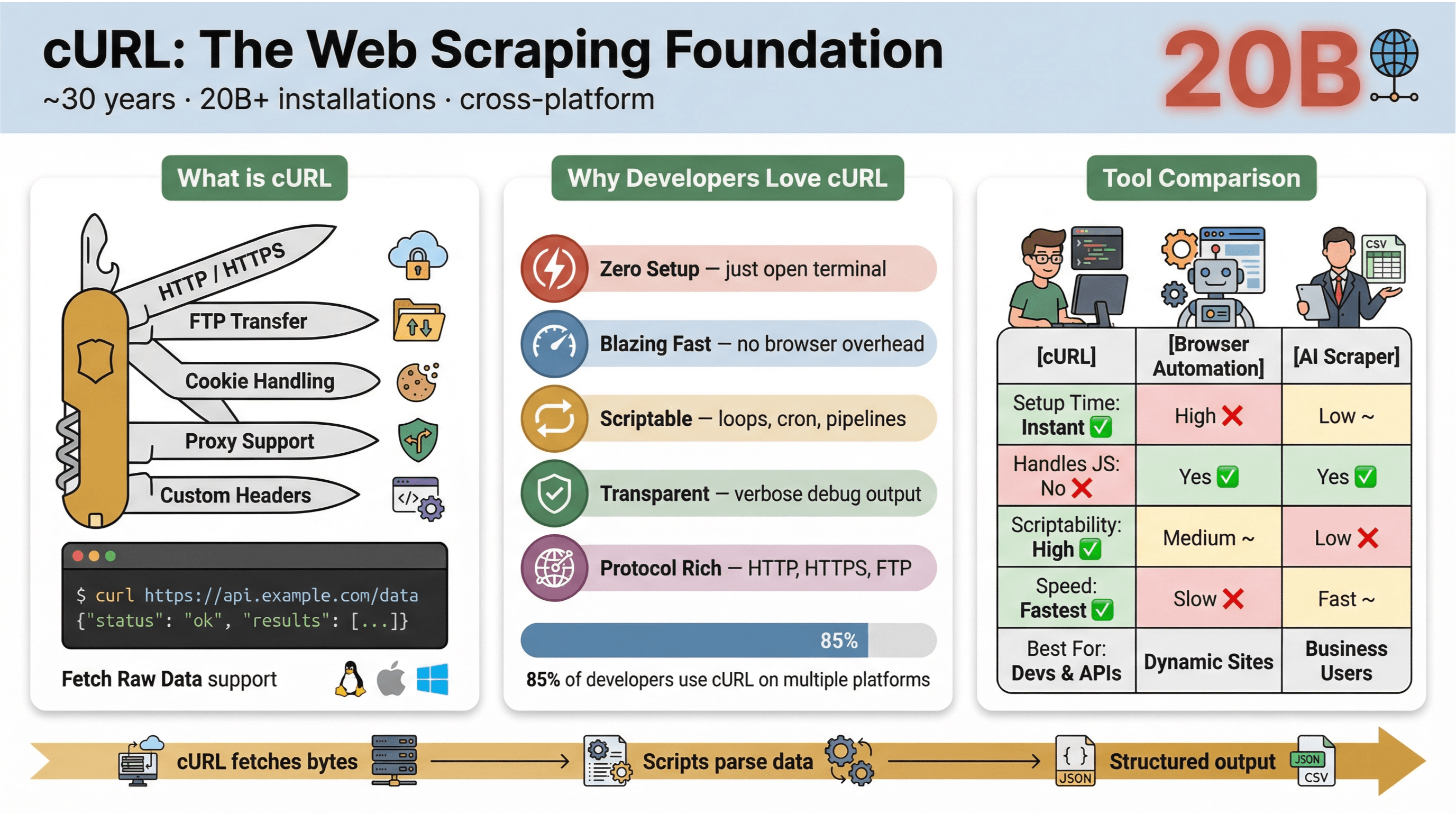

Mikä cURL on? Web-scraping-with-curlin perusta

Ytimekkäästi: on komentorivityökalu ja kirjasto, jolla siirretään dataa URL-osoitteiden kautta. Se on ollut olemassa lähes 30 vuotta (kyllä, oikeasti) ja löytyy käytännössä kaikkialta—käyttöjärjestelmien sisältä, skripteistä ja taustalla pyörivistä datasiirroista yli . Jos olet joskus hakenut nopeasti verkkosivun, testannut APIa tai ladannut tiedoston yhdellä komennolla, olet todennäköisesti käyttänyt cURLia.

Siksi cURL on niin suosittu web scrapingissa:

Siksi cURL on niin suosittu web scrapingissa:

- Kevyt ja monialustainen: toimii Linuxissa, macOS:ssä, Windowsissa ja jopa sulautetuissa laitteissa.

- Laaja protokollatuki: HTTP, HTTPS, FTP ja paljon muuta.

- Skriptattava: erinomainen automaatioon, cron-ajastuksiin ja “liimakoodiksi”.

- Ei vaadi käyttäjän vuorovaikutusta: suunniteltu ei-interaktiiviseen käyttöön—loistava eräajoihin ja putkiin.

Mutta pidetään jalat maassa: cURLin päätehtävä on hakea raakadataa—HTML:ää, JSONia, kuvia, mitä tahansa. Se ei jäsennä, renderöi tai rakenna dataa puolestasi. Ajattele cURLia web scrapingin “ensimmäisenä kilometrinä”: se tuo tavunauhan perille, mutta rakenteisen tiedon tekemiseen tarvitset muita työkaluja (kuten Python-skriptejä, grep/sed/awkia tai AI web scraperin).

Jos haluat viralliset ohjeet, katso .

Miksi käyttää cURLia web scrapingissa? (curl web scraping tutorial)

Miksi kehittäjät ja tekniset käyttäjät palaavat cURLiin yhä uudelleen, vaikka uusia työkaluja tulee jatkuvasti? Tässä syyt, joiden takia cURL erottuu:

- Minimaalinen aloituskynnys: ei asennuksia, ei riippuvuuksia—avaa terminaali ja aloita.

- Nopeus: data tulee heti ilman selaimen latailua.

- Skriptattavuus: URL-listojen läpikäynti, pyyntöjen automatisointi ja komentojen ketjutus on helppoa.

- Ominaisuudet ja protokollat: evästeet, proxyt, uudelleenohjaukset, omat headerit ja paljon muuta.

- Läpinäkyvyys: verbose/debug-näkymä kertoo tarkasti, mitä tapahtuu.

yli 85 % vastaajista kertoi käyttävänsä cURLin komentorivityökalua, ja lähes kaikki käyttivät sitä useilla alustoilla. Se on edelleen HTTP-pyyntöjen linkkuveitsi: nopeisiin datanoutoihin ja vianetsintään.

Pikavertailu cURLin ja muiden scraping-tapojen välillä:

| Ominaisuus | cURL | Selaimen automaatio (esim. Selenium) | AI Web Scraper (esim. Thunderbit) |

|---|---|---|---|

| Käyttöönotto | Heti | Työläs | Helppo |

| Skriptattavuus | Korkea | Keskitaso | Matala (ei koodia) |

| JavaScriptin käsittely | Ei | Kyllä | Kyllä (Thunderbit: selaimen kautta) |

| Evästeet/istunnot | Manuaalinen | Automaattinen | Automaattinen |

| Datan jäsentäminen | Manuaalinen (parse myöhemmin) | Manuaalinen (parse myöhemmin) | AI-/mallipohjainen |

| Paras käyttö | Devit, nopeat haut | Monimutkaiset, dynaamiset sivut | Liiketoimintakäyttäjät, rakenteinen vienti |

Yhteenveto: cURL on ylivoimainen nopeissa, skriptattavissa datanoudoissa—etenkin staattisilla sivuilla ja API-rajapinnoissa. Mutta kun tarvitset monimutkaisen HTML:n jäsentämistä, JavaScriptiä tai suoraa rakenteista vientiä, kannattaa käyttää erikoistuneempaa työkalua.

Alkuun pääseminen: peruskomennot cURL-web scrapingiin

Mennään käytäntöön. Näin käytät cURLia perus-scraping-tehtäviin vaihe vaiheelta.

Raaka-HTML:n hakeminen cURLilla

Yksinkertaisin tapaus: hae sivun HTML.

1curl https://books.toscrape.com/Komento hakee -etusivun (julkinen demokohde web scrapingiin). Terminaaliin tulostuu raaka-HTML—etsi esimerkiksi <title>-tagia tai tekstiä kuten “In stock.”

Tulosteen tallentaminen tiedostoon

Haluatko tallettaa HTML:n myöhempää jäsentämistä varten? Käytä -o-lippua:

1curl -o page.html https://books.toscrape.com/Nyt sinulla on page.html, jossa on koko HTML-sisältö. Tämä on kätevä, kun jatkat analyysiä muilla työkaluilla.

POST-pyyntöjen lähettäminen cURLilla

Tarvitsetko lomakkeen lähettämistä tai API-kutsua? Käytä -d-lippua POST-dataan. Esimerkki -palvelulla, joka on tehty HTTP-testaukseen:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Saat JSON-vastauksen, joka “peilaa” lähettämäsi datan—erinomainen testaukseen ja prototypointiin.

Headerien tarkastelu ja debuggaus

Usein haluat nähdä vastausheaderit tai selvittää, miksi pyyntö ei toimi:

-

Vain headerit (HEAD-pyyntö):

1curl -I https://books.toscrape.com/ -

Headerit + body:

1curl -i https://httpbin.org/get -

Verbose/debug-tuloste:

1curl -v https://books.toscrape.com/

Näillä lipuilla näet, mitä “pellin alla” tapahtuu—välttämätöntä vianetsinnässä.

Pikataulukko komennoista:

| Tehtävä | Komento-esimerkki | Huomio |

|---|---|---|

| Hae HTML | curl URL | Tulostaa HTML:n terminaaliin |

| Tallenna tiedostoon | curl -o file.html URL | Kirjoittaa tulosteen tiedostoon |

| Tarkista headerit | curl -I URL tai curl -i URL | -I = vain HEAD, -i = headerit mukana bodyn kanssa |

| Lähetä lomakedata (POST) | curl -d "a=1&b=2" URL | Lähettää form-enkoodatun datan |

| Debuggaa pyyntö/vastaus | curl -v URL | Näyttää yksityiskohtaiset request/response-tiedot |

Lisää esimerkkejä löytyy .

Seuraava taso: edistynyt web scraping cURLilla (web-scraping-with-curl)

Kun perusteet ovat hallussa, cURLista löytyy paljon ominaisuuksia vaativampiin scraping-tilanteisiin.

Evästeet ja istunnot

Monet sivustot vaativat evästeitä kirjautumisen tai istunnon ylläpitoon. cURLilla voit tallentaa ja käyttää evästeitä pyyntöjen välillä:

1# Tallenna evästeet kirjautumisen jälkeen

2curl -c cookies.txt https://example.com/login

3# Käytä evästeitä seuraavissa pyynnöissä

4curl -b cookies.txt https://example.com/accountNäin voit jäljitellä selaimen istuntoa ja päästä kirjautumisen taakse (kunhan sivu ei vaadi JavaScript-haastetta).

User-Agentin feikkaus ja omat headerit

Osa sivustoista näyttää eri sisältöä User-Agentin tai headerien perusteella. Oletuksena cURL tunnistautuu muodossa “curl/VERSION”, mikä voi laukaista estoja tai vaihtoehtoisen sisällön. Selaimen matkiminen:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Voit asettaa myös omia headereita, kuten kieliasetuksen:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Tämä auttaa saamaan saman sisällön kuin oikea selain.

Proxyn käyttö web scrapingissa

Tarvitsetko pyynnöt proxyn kautta (esim. geotestaus tai IP-estojen välttely)? Käytä -x-lippua:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Käytä proxyja vastuullisesti ja sivuston ehtojen mukaisesti.

Monisivuinen scraping automaatiolla

Haluatko hakea useita sivuja, kuten sivutettuja listauksia? Yksinkertainen shell-silmukka riittää:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneTämä hakee Books to Scrape -katalogin sivut 2–5 ja tallentaa jokaisen omaan tiedostoonsa. (Sivu 1 on etusivu.)

Web-scraping-with-curlin rajoitteet: mitä kannattaa tietää

Vaikka cURL on loistava, se ei ole hopealuoti. Tässä kohdat, joissa se jää vajaaksi:

- Ei JavaScriptin suorittamista: cURL ei pysty renderöimään JavaScriptillä rakennettua sisältöä tai ratkaisemaan botinestohaasteita ().

- Jäsentäminen jää sinulle: saat raaka-HTML:n tai JSONin, mutta joudut parsimaan itse—usein lisäskripteillä.

- Rajoittunut istunnonhallinta: monivaiheiset kirjautumiset, tokenit ja lomakeketjut muuttuvat nopeasti sotkuisiksi.

- Ei valmista rakenteistusta: cURL ei muunna sivuja riveiksi, taulukoiksi tai taulukkolaskentaan.

- Helppo jäädä botintunnistuksen haaviin: monet sivustot käyttävät nykyään kehittyneitä suojauksia (JavaScript, fingerprinting, CAPTCHA), joita cURL ei käytännössä ohita ().

Pikavertailu:

| Rajoite | Pelkkä cURL | Modernit scraping-työkalut (esim. Thunderbit) |

|---|---|---|

| JavaScript-tuki | Ei | Kyllä |

| Datan rakenteistus | Manuaalinen | Automaattinen (AI/malli) |

| Istunnonhallinta | Manuaalinen | Automaattinen |

| Botineston ohitus | Rajallinen | Edistynyt (selainpohjainen/AI) |

| Helppokäyttöisyys | Tekninen | Ei-tekninen |

Staattisille sivuille ja API-kutsuihin cURL on erinomainen. Dynaamisissa tai suojatuissa kohteissa kannattaa siirtyä seuraavalle tasolle.

Thunderbit vs. cURL: paras lähestymistapa ei-teknisille käyttäjille

Puhutaan seuraavaksi -ratkaisusta, AI-pohjaisesta web scraper -Chrome-laajennuksestamme. Jos olet myyjä, markkinoija tai operaatioiden tekijä ja haluat vain siirtää dataa sivustolta Exceliin, Google Sheetiin tai Notioniin—ilman komentoriviä—Thunderbit on tehty sinulle.

Näin Thunderbit vertautuu cURLiin:

| Ominaisuus | cURL | Thunderbit |

|---|---|---|

| Käyttöliittymä | Komentorivi | Osoita ja klikkaa (Chrome-laajennus) |

| AI-kenttäsuositukset | Ei | Kyllä (AI lukee sivun ja ehdottaa sarakkeet) |

| Sivutus/alaisivut | Manuaalinen skriptaus | Automaattinen (AI tunnistaa ja kerää) |

| Datan vienti | Manuaalinen (parse + tallenna) | Suoraan Exceliin, Google Sheetiin, Notioniin, Airtableen |

| JavaScript/suojatut sivut | Ei | Kyllä (selainpohjainen scraping) |

| No-code | Ei (vaatii skriptausta) | Kyllä (kuka tahansa voi käyttää) |

| Ilmainen taso | Aina ilmainen | Ilmainen jopa 6 sivuun (10 kokeiluboostilla) |

Thunderbitissa avaat laajennuksen, klikkaat “AI Suggest Fields”, ja AI ehdottaa, mitä kannattaa poimia. Voit kerätä taulukoita, listoja, tuotedetaljeja ja jopa käydä alisivuilla automaattisesti. Lopuksi viet datan suoraan suosittuihin työkaluihin—ei parsimista, ei säätöä.

Thunderbitiin luottaa yli , ja se on erityisen suosittu myynnin, verkkokaupan ja kiinteistöalan tiimeissä, jotka tarvitsevat rakenteista dataa nopeasti.

Haluatko testata? .

cURL + Thunderbit yhdessä: joustavat scraping-strategiat

Teknisenä käyttäjänä sinun ei tarvitse valita vain yhtä työkalua. Moni tiimi käyttää cURLia ja Thunderbitia rinnakkain, jotta joustavuus on maksimaalinen:

- Prototypoi cURLilla: testaa endpointit nopeasti, tarkista headerit ja ymmärrä, miten sivusto vastaa.

- Skaalaa Thunderbitilla: kun tarvitset rakenteista dataa, monisivuista keruuta tai toistettavaa työnkulkua, vaihda Thunderbitiin ja vie data suoraan.

Esimerkkityönkulku markkinatutkimukseen:

- Hae muutama sivu cURLilla ja tarkastele HTML-rakennetta.

- Päätä, mitkä kentät haluat (esim. tuotenimet, hinnat, arviot).

- Avaa Thunderbit, klikkaa “AI Suggest Fields” ja anna AI:n rakentaa poiminta.

- Kerää kaikki sivut (myös alisivut tai sivutetut listat) ja vie Google Sheetiin.

- Analysoi, jaa ja tee päätöksiä—ilman manuaalista parsimista.

Päätöstaulukko:

| Tilanne | Käytä cURLia | Käytä Thunderbitia | Käytä molempia |

|---|---|---|---|

| Nopea API- tai staattisen sivun haku | ✅ | ||

| Tarvitset rakenteisen datan taulukkoon | ✅ | ||

| Headerien/evästeiden debuggaus | ✅ | ||

| Dynaamisten/JS-raskaiden sivujen keruu | ✅ | ||

| Toistettava no-code-työnkulku | ✅ | ||

| Prototypointi ja sitten skaalaus | ✅ | ✅ | Hybrid workflow |

Yleiset haasteet ja sudenkuopat cURL-web scrapingissa

Ennen kuin innostut liikaa cURLista, tässä käytännön ongelmat, joihin törmäät:

- Botinestot: monet sivustot käyttävät kehittyneitä suojauksia (JavaScript-haasteet, CAPTCHA, fingerprinting), joita cURL ei ohita ().

- Datan laatu: HTML muuttuu, kenttiä puuttuu tai layout vaihtelee—skriptit hajoavat.

- Ylläpitokuorma: jokainen sivuston muutos vaatii parsimislogiikan päivitystä.

- Laki ja compliance: tarkista aina käyttöehdot, robots.txt ja soveltuva lainsäädäntö. Julkinen data ei automaattisesti tarkoita vapaata käyttöä (, ).

- Skaalausrajat: pieniin töihin cURL on loistava, mutta isossa mittakaavassa joudut hallitsemaan proxyja, rate limitejä ja virheenkäsittelyä.

Vinkit vianetsintään ja vastuulliseen keruuseen:

- Aloita aina luvallisista tai demo-sivustoista (kuten ).

- Kunnioita rate limitejä—älä kuormita endpointteja.

- Vältä henkilötietojen keruuta ilman laillista perustetta.

- Jos vastaan tulee JavaScript- tai CAPTCHA-seinä, harkitse selainpohjaista työkalua kuten Thunderbit.

Vaiheittainen yhteenveto: Näin keräät dataa verkkosivuilta cURLilla

Pikamuistilista web-scraping-with-curl -tekemiseen:

- Määritä kohde-URL(t): aloita staattisesta sivusta tai API-endpointista.

- Hae sivu:

curl URL - Tallenna tiedostoon:

curl -o file.html URL - Tarkista headerit/debuggaa:

curl -I URL,curl -v URL - Lähetä POST-data:

curl -d "a=1&b=2" URL - Hallitse evästeet/istunnot:

curl -c cookies.txt ...,curl -b cookies.txt ... - Aseta headerit/User-Agent:

curl -A "..." -H "..." URL - Seuraa uudelleenohjauksia:

curl -L URL - Käytä proxyja (tarvittaessa):

curl -x proxy:port URL - Automatisoi monisivuinen keruu: shell-silmukoilla tai skripteillä.

- Jäsennä ja rakenna data: käytä lisätyökaluja tarpeen mukaan.

- Siirry Thunderbitiin, kun tarvitset rakenteista no-code-keruuta tai dynaamisia sivuja.

Lopuksi: oikean web scraping -työkalun valinta

Web-scraping-with-curl on edelleen arvokas taito teknisille käyttäjille vuonna 2026—erityisesti nopeisiin datanoutoihin, prototypointiin ja automaatioon. cURLin nopeus, skriptattavuus ja yleisyys tekevät siitä vakiotyökalun jokaisen kehittäjän pakissa. Mutta kun webistä tulee yhä dynaamisempi ja suojatumpi, ja kun liiketoimintakäyttäjät haluavat rakenteista dataa ilman koodia, -tyyppiset työkalut laajentavat mahdollisuuksien rajoja.

Tärkeimmät opit:

- Käytä cURLia staattisille sivuille, API-rajapinnoille ja nopeaan prototypointiin—kun haluat täyden kontrollin.

- Siirry Thunderbitiin (tai vastaaviin AI web scraper -työkaluihin), kun tarvitset rakenteista dataa, dynaamisten/JavaScript-raskaiden sivujen käsittelyä tai no-code-työnkulun.

- Yhdistä molemmat: prototypoi cURLilla, rakenna ja skaalaa Thunderbitilla.

- Kerää dataa vastuullisesti—kunnioita ehtoja, rate limitejä ja lain rajoja.

Haluatko nähdä, miten helppoa web scraping voi olla? ja testaa AI-pohjaista tiedonpoimintaa itse. Lisää oppaita ja vinkkejä löydät . Saatat pitää myös näistä:

Onnistuneita scraping-hetkiä—ja toivottavasti datasi pysyy aina siistinä, rakenteisena ja vain yhden komennon (tai klikkauksen) päässä.

UKK

1. Pystyykö cURL käsittelemään JavaScriptillä renderöityjä sivuja?

Ei. cURL ei suorita JavaScriptiä, vaan hakee palvelimen palauttaman raaka-HTML:n. Jos sivu vaatii JavaScriptiä sisällön näyttämiseen tai botinestojen läpäisyyn, cURL ei pääse dataan käsiksi. Tällöin kannattaa käyttää selainpohjaisia työkaluja kuten .

2. Miten tallennan cURLin tulosteen suoraan tiedostoon?

Käytä -o-lippua: curl -o filename.html URL. Tällöin vastausrunko kirjoitetaan tiedostoon eikä tulosteta terminaaliin.

3. Mikä ero on cURLilla ja Thunderbitilla web scrapingissa?

cURL on komentorivityökalu raakadatan hakemiseen—erinomainen teknisille käyttäjille ja automaatioon. Thunderbit on AI-pohjainen Chrome-laajennus, joka on suunniteltu liiketoimintakäyttäjille: se poimii rakenteista dataa miltä tahansa sivulta, toimii dynaamisilla sivuilla ja vie tulokset suoraan Exceliin tai Google Sheetiin ilman koodausta.

4. Onko verkkosivujen scraping cURLilla laillista?

Julkisen datan keruu on Yhdysvalloissa viimeaikaisten oikeuspäätösten jälkeen usein laillista, mutta tarkista aina sivuston käyttöehdot, robots.txt ja soveltuva lainsäädäntö. Vältä henkilötietojen tai suojatun datan keruuta ilman lupaa ja noudata rate limitejä sekä eettisiä käytäntöjä (, ).

5. Milloin kannattaa siirtyä cURLista edistyneempään työkaluun kuten Thunderbitiin?

Kun tarvitset dynaamisten/JavaScript-raskaiden sivujen keruuta, haluat rakenteisen datan taulukkoon tai suosit no-code-työnkulkua, Thunderbit on parempi valinta. cURL sopii nopeisiin teknisiin tehtäviin; Thunderbit toistettavaan, liiketoimintaystävälliseen tiedonpoimintaan.

Lisää web scraping -vinkkejä löydät tai kanavaltamme .