Digitaalisen uutisvirran tahti on nykyään suorastaan päätähuimaava. Joka minuutti julkaistaan, päivitetään tai hiljaisesti muokataan tuhansia otsikoita – valtamedioissa, niche-blogeissa ja sosiaalisen median syötteissä.

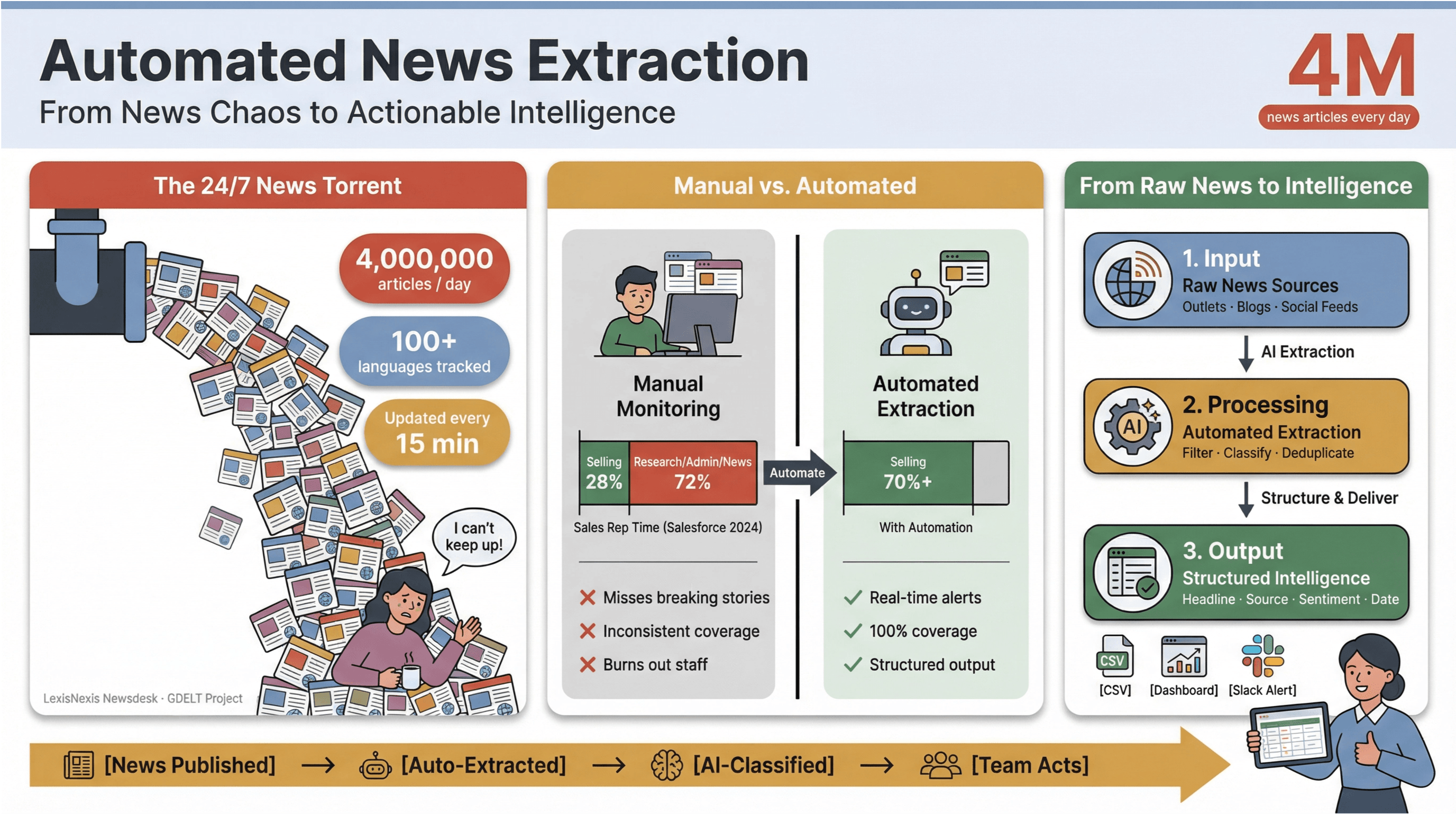

Suhteuttaakseni: käsittelee yli 4 miljoonaa uutisartikkelia joka päivä, kun taas seuraa uutisia yli 100 kielellä ja päivittää globaalin syötteensä 15 minuutin välein.

Kenelle tahansa media-alalla, tutkimuksessa tai liiketoimintatiedon parissa työskentelevälle tämän tulvan perässä pysyminen käsin on kuin yrittäisi tyhjentää uppoavaa venettä kahvikupilla.

Olen nähnyt omin silmin, miten uutisten manuaalinen seuranta syö aikaa ja kuluttaa resursseja. Myyntitiimit käyttävät varsinaiseen myyntiin alle kolmanneksen työviikostaan – – ja loppu aika kuluu tutkimukseen, hallintoon ja kyllä, loputtomaan uutiset-välilehtien välillä hyppimiseen.

Siksi automaattinen uutisten poiminta on noussut nykyaikaisten tiimien salaiseksi aseeksi: se on ainoa tapa muuttaa 24/7-uutissyklin kaaos jäsennellyksi, toimintaa ohjaavaksi tiedoksi – ilman että henkilöstö palaa loppuun tai tärkeimmät jutut jäävät huomaamatta.

Käydään läpi, mitä automaattinen uutisten poiminta oikeasti tarkoittaa, miksi se on välttämätöntä kaikille reaaliaikaisesta uutisdatasta kiinnostuneille ja miten rakennat kestävän, sääntöjen mukaisen työnkulun parhailla työkaluilla (mukaan lukien miten tekee koko prosessista hämmästyttävän helpon – jopa kaltaisilleni ei-teknisille ihmisille, kuten äidilleni).

Automaattinen uutisten poiminta: miksi se on välttämätöntä nykyaikaisille uutishuoneille

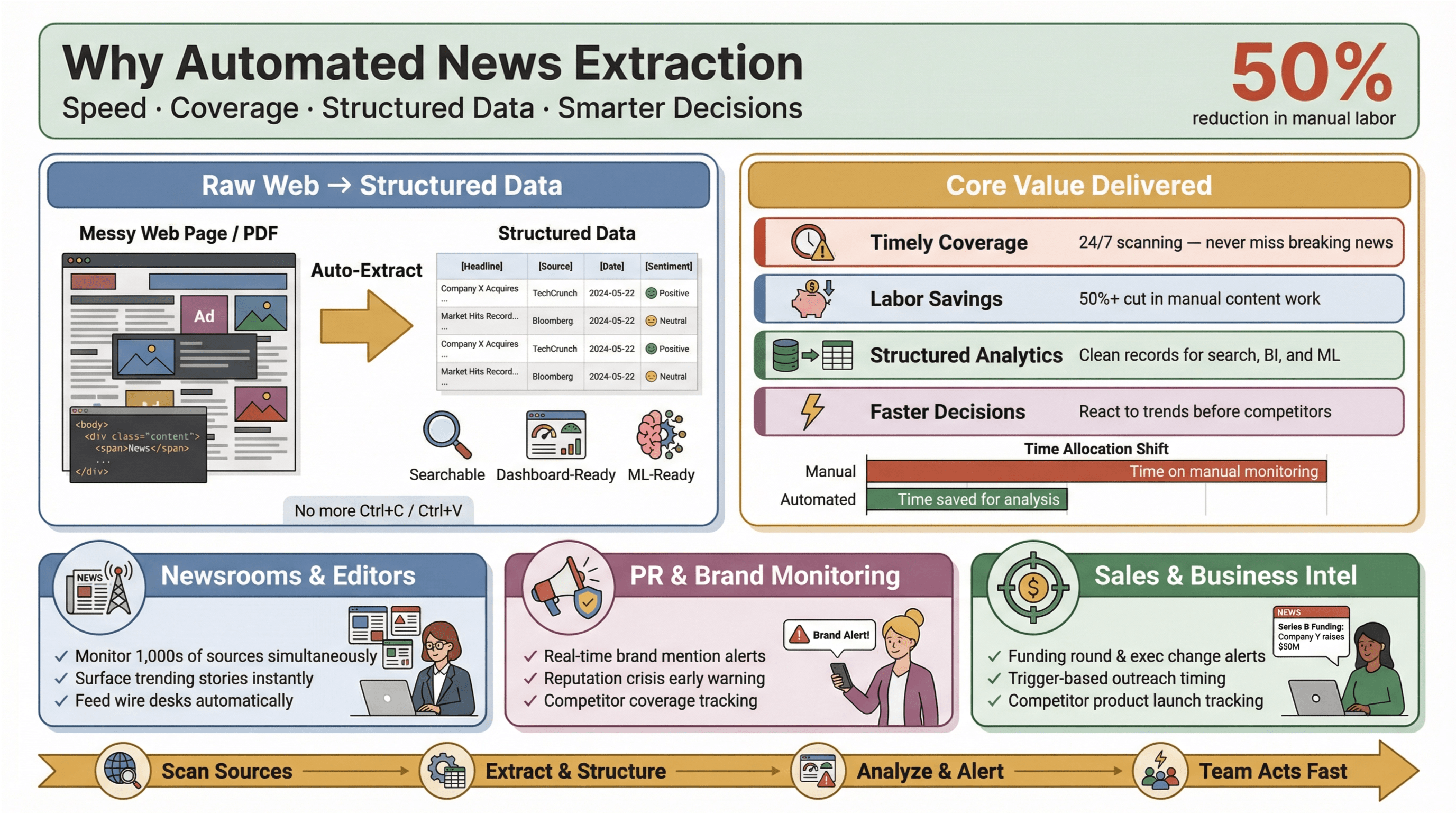

Automaattinen uutisten poiminta on juuri sitä miltä se kuulostaa: ohjelmiston käyttöä uutissisällön automaattiseen keräämiseen ja sen muuntamiseen jäsennellyksi, haettavaksi dataksi – ajattele rivejä ja sarakkeita sekavien verkkosivujen tai PDF-tiedostojen sijaan. Käytännössä voit seurata satoja (tai tuhansia) lähteitä, poimia keskeiset kentät kuten otsikon, aikaleiman, kirjoittajan ja leipätekstin, ja syöttää datan koontinäyttöihin, hälytyksiin tai jatkoanalytiikkaan – koskematta kertaakaan Ctrl+C/Ctrl+V:hen.

Miksi tällä on merkitystä? Koska tämän päivän uutismaailmassa nopeus on kaikki kaikessa. Olitpa uutispäällikkö, brändimainintoja seuraava PR-johtaja tai kilpailijoiden liikkeitä tarkkaileva analyytikko, ensimmäisenä tietoon pääseminen voi ratkaista, hyödynnätkö mahdollisuuden vai jäätkö vain kiriin. Automaattiset poimintatyökalut auttavat pieniäkin tiimejä lyömään yläluokassa omaan kokoluokkaansa nähden – ne kokoavat reaaliaikaista uutisdataa verkosta, vähentävät manuaalista työtä ja nostavat esiin tärkeimmät tarinat.

Miksi tällä on merkitystä? Koska tämän päivän uutismaailmassa nopeus on kaikki kaikessa. Olitpa uutispäällikkö, brändimainintoja seuraava PR-johtaja tai kilpailijoiden liikkeitä tarkkaileva analyytikko, ensimmäisenä tietoon pääseminen voi ratkaista, hyödynnätkö mahdollisuuden vai jäätkö vain kiriin. Automaattiset poimintatyökalut auttavat pieniäkin tiimejä lyömään yläluokassa omaan kokoluokkaansa nähden – ne kokoavat reaaliaikaista uutisdataa verkosta, vähentävät manuaalista työtä ja nostavat esiin tärkeimmät tarinat.

Vaikutus on myös mitattavissa: tutkimusten mukaan automaatio voi vähentää sisällön päivityksiin kuluvaa manuaalista työtä vähintään 50 %, jolloin aikaa vapautuu varsinaiseen analyysiin ja päätöksentekoon.

Automaattisen uutisten poiminnan ydinrooli uutisalalla

Käydään käytännön kautta. Mitä automaattinen uutisten poiminta oikeastaan tarjoaa uutishuoneille ja liiketoimintatiimeille?

- Ajantasainen ja kattava seuranta: Ei enää breaking news -uutisten missaamista siksi, että joku unohti tarkistaa syötteen. Automaattiset työkalut skannaavat lähteitä 24/7, joten et missaa olennaista.

- Työ- ja kustannussäästöt: Pienet ja keskisuuret tiimit voivat seurata yhtä montaa lähdettä kuin suuret toimijat – ilman armeijaa harjoittelijoita.

- Jäsennelty data analytiikkaa varten: Rakenteettomien artikkelien penkomisen sijaan saat siistin, jäsennellyn tietueen, joka on valmis hakuun, koontinäyttöihin ja koneoppimiseen.

- Nopeammat ja fiksummat päätökset: Reaaliaikainen uutisdata auttaa reagoimaan markkinamuutoksiin, PR-kriiseihin tai uusiin trendeihin ennen kilpailijoita.

Otetaan PR ja viestintä esimerkiksi: ja asemoivat reaaliaikaisen media-seurannan olennaiseksi maineen suojaamisessa ja haitallisiin uutisiin nopeasti toimimisessa. Myynnissä reaaliaikaiset uutishälytykset muuttuvat prospektoinnin “kontekstikorteiksi” – esimerkiksi rahoituskierrokset, johtajavaihdokset tai tuotelanseeraukset, jotka käynnistävät yhteydenoton juuri oikealla hetkellä.

Oikeiden uutisten poimintatyökalujen valinta eri tilanteisiin

Kaikki uutisten poimintatyökalut eivät ole samanarvoisia. Oikea valinta riippuu tavoitteistasi, teknisestä osaamisestasi ja siitä, millaisista uutisista olet kiinnostunut. Tässä kehikko, joka auttaa valitsemaan sopivimman:

Käytettävyyden ja saavutettavuuden arviointi

Useimmille liiketoimintakäyttäjille ja journalisteille helppokäyttöisyys on ehdoton vaatimus. Haluat työkalun, joka toimii suoraan laatikosta ilman koodausta tai monimutkaista asennusta. No-code- ja low-code-alustat kuten , ja antavat sinun rakentaa poimintoja visuaalisesti – osoita, klikkaa ja poimi.

Thunderbit erottuu erityisesti kahden askeleen prosessillaan: kuvaile, mitä haluat, anna tekoälyn ehdottaa kenttiä ja paina “Poimi”. Jopa ei-tekniset käyttäjät voivat rakentaa uutisdataan perustuvan työnkulun minuuteissa, ei tunneissa.

Tietoturvaan ja tietosuojaan liittyvät näkökohdat

Suuren datan mukana tulee suuri vastuu. Uutisten poimintatyökalut käsittelevät usein arkaluonteista sisältöä, joten tietoturvan ja sääntöjenmukaisuuden pitää olla ykkösasia. Etsi ainakin nämä:

- Datan salaus (siirron aikana ja levossa)

- Selkeät tietosuojakäytännöt (Thunderbit esimerkiksi ilmoittaa, ettei se myy käyttäjätietoja ja että se pääsee vain siihen sisältöön, jonka valitset poimittavaksi)

- Hienojakoiset käyttöoikeudet (erityisesti selainlaajennuksissa – tarkista aina, mihin dataan työkalu voi päästä käsiksi)

- Paikallisen lainsäädännön noudattaminen (GDPR, CCPA ja EU-käyttäjille myös )

Mielenrauhan vuoksi valitse luotettavia toimittajia, tarkista laajennusten käyttöoikeudet ja rajoita pääsy vain välttämättömään.

Työkalujen sovittaminen uutistyyppeihin ja toimialan tarpeisiin

Jotkin työkalut ovat erityisen hyviä tietyissä uutiskategorioissa:

- Talous: API-rajapinnat kuten ja tarjoavat ryhmittelyä, sentimenttianalyysiä ja tapahtumien tunnistusta talousuutisiin.

- Teknologia ja startupit: Räätälöity poiminta Thunderbitillä tai Octoparsella auttaa kohdistamaan niche-blogeihin, lehdistötiedotteisiin tai tapahtumalistauksiin.

- Politiikka ja lainsäädäntö: Lisensoidut tietokannat kuten ja tarjoavat pääsyn premium-lähteisiin ja arkistoihin.

Jos sinun pitää seurata sekä valtamediaa, niche-lähteitä että kansainvälisiä lähteitä – myös sellaisia, joilla ei ole APIa – joustavat tekoälypohjaiset poimijat kuten Thunderbit ovat paras valinta.

Thunderbitin ainutlaatuiset edut reaaliaikaisen uutisdatan poiminnassa

Nyt puhutaan siitä, mikä tekee erottuvan valinnan automaattiseen uutisten poimintaan – erityisesti jos haluat reaaliaikaista uutisdataa ilman teknistä päänvaivaa.

Thunderbit on tekoälyllä toimiva web-scraper Chrome-laajennus, joka on suunniteltu liiketoimintakäyttäjille, journalisteille ja analyytikoille, jotka tarvitsevat ajantasaista, jäsenneltyä uutissisältöä miltä tahansa verkkosivustolta. Tästä syystä siitä on tullut minun luottotyökaluni:

- AI Suggest Fields: Thunderbit lukee uutissivun ja ehdottaa automaattisesti parhaat poimittavat sarakkeet – otsikko, aikaleima, kirjoittaja, tiivistelmä ja paljon muuta. Ei tarvetta säätää valitsimia tai mallipohjia.

- Alasivujen poiminta: Tarvitsetko koko artikkelin etkä vain otsikkoa? Thunderbit voi käydä läpi jokaisen uutislinkin, poimia leipätekstin, entiteetit ja tunnisteet sekä yhdistää kaiken yhdeksi jäsennellyksi taulukoksi.

- Massavienti ja välittömät päivitykset: Vie uutisdata suoraan Exceliin, Google Sheetiin, Airtableen tai Notioniin yhdellä klikkauksella. Ei enää loputonta kopiointia ja liittämistä tai CSV:iden kanssa säätämistä.

- Ajastettu poiminta: Aseta toistuvat ajot (tunneittain, päivittäin tai omalla aikataulullasi), jotta uutisputkesi pysyy tuoreena – ihanteellinen breaking newsiin, markkinaseurantaan tai jatkuvaan tutkimukseen.

- Mukautuvuus: Thunderbitin tekoäly mukautuu asettelumuutoksiin ja pitkän hännän uutissivustoihin, joten käytät vähemmän aikaa rikkoutuneiden poimintojen korjaamiseen ja enemmän aikaa datan analysointiin.

Yli ja 4,8 tähden arvosanan ansiosta se on tiimien luottotyökalu kaikkialla maailmassa PR-seurannasta kilpailijatiedusteluun.

Tekoälyyn perustuva kenttien tunnistus ja alasivujen poiminta

Yksi Thunderbitin parhaista ominaisuuksista on sen tekoälypohjainen kenttien tunnistus. Klikkaa vain “AI Suggest Fields”, niin työkalu skannaa uutissivun ja tunnistaa tärkeät kentät, kuten otsikon, päivämäärän, kirjoittajan ja tiivistelmän. Voit säätää tai lisätä omia kenttiä (esimerkiksi “merkitse tämä artikkeli ‘tulokseksi’, jos siinä mainitaan neljännesvuositulokset”), ja Thunderbitin tekoäly hoitaa loput.

Alasivujen poiminta on uutisille todellinen pelinmuuttaja: poimi etusivun tai osion listaus otsikoineen, ja anna Thunderbitin käydä jokaisessa artikkelin URL-osoitteessa poimimassa koko juttu, entiteetit ja jopa kuvat. Näin saat täydelliset, rikastetut uutistietueet – valmiina hakuun, koontinäyttöihin tai jatkoanalyysiin tekoälyllä.

Massavienti ja välittömät päivitykset

Thunderbit tekee uutisdatan viemisestä vaivatonta. Yhdellä klikkauksella voit lähettää jäsennellyn uutisvirran Google Sheetiin, Airtableen tai Notioniin tai ladata sen CSV-/Excel-muodossa. Tiimeille, jotka elävät taulukoissa tai BI-työkaluissa, tämä säästää valtavasti aikaa.

Koska Thunderbit tukee ajastettua poimintaa, voit asettaa sen ajamaan tunnin välein, päivittäin tai oman aikataulusi mukaan – jolloin uutisdatasi pysyy aina ajan tasalla. Ei enää odottelua siihen, että Google Alerts indeksoi jutut päivien viiveellä.

Toiminnallisten haasteiden voittaminen reaaliaikaisissa uutisratkaisuissa

Parhaillakin työkaluilla reaaliaikainen uutisten poiminta tuo mukanaan omat haasteensa. Näin selätät yleisimmät niistä:

Viiveen ja datan tuoreuden hallinta

- Ajoita poiminnat uutisnopeuden mukaan: Breaking newsin kohdalla aja poimintoja 15–30 minuutin välein (GDELT Projectin päivityssykliä vastaten). Hitaammissa aiheissa päivittäin tai tunneittain riittää.

- Seuraa julkaisun ja noudon välistä viivettä: Mittaa ero sen välillä, milloin artikkeli julkaistiin ja milloin järjestelmäsi haki sen. Jos viive kasvaa, tarkista estot tai hidastumiset.

- Poimi uudelleen “hiljaiset muokkaukset”: Uutisartikkeleita päivitetään usein julkaisun jälkeen. Ajoita toinen poiminta 24 tunnin päähän, jotta saat korjaukset tai huomaamattomat muokkaukset talteen ().

API-rajoitusten ja lähteiden vaihtelun käsittely

- Noudata API-kiintiöitä: Jos käytät uutis-API-rajapintoja, seuraa rate limit -rajoja – jaksota pyyntöjä ja välimuistita tulokset, kun mahdollista ().

- Poista duplikaatit ja kanonisoi: Uutiset esiintyvät usein useissa URL-osoitteissa tai niitä päivitetään. Tallenna kanoniset URLit ja käytä hash-arvoja (esim. otsikko + päivämäärä) duplikaattien välttämiseksi ().

- Käsittele dynaaminen sisältö: Sivustoilla, joilla on loputon vieritys tai lazy loading, käytä työkaluja, jotka tukevat dynaamista renderöintiä, ja seuraa asettelumuutoksia ().

Älykäs uutisdatan analyysi: tekoälyn ja koneoppimisen rooli

Uutisten poiminta on vasta ensimmäinen askel. Todellinen arvo syntyy, kun dataa analysoidaan ja siihen reagoidaan – ja juuri siinä tekoäly ja koneoppiminen loistavat.

- Entiteettien poiminta: Käytä NLP:tä nostaaksesi esiin kussakin artikkelissa mainitut henkilöt, organisaatiot ja paikat ().

- Aiheluokittelu: Merkitse artikkelit automaattisesti aiheen, sentimentin tai kiireellisyyden mukaan – näin saat älykkäämmät koontinäytöt ja hälytykset ().

- Tapahtumien ryhmittely: Ryhmitä päällekkäiset tai toisiinsa liittyvät jutut eri julkaisujen välillä, jotta näet kokonaisuuden etkä vain lähes identtisten otsikoiden tulvaa.

- Personointi ja kohdentaminen: Hyödynnä reaaliaikaista uutisdataa yleisöjen segmentointiin, mainonnan kohdentamiseen tai sisällön suositteluun – ja nosta sitoutumista sekä ROI:ta.

Esimerkiksi PR-tiimit käyttävät reaaliaikaista uutisanalytiikkaa havaitakseen nousevat kriisit ennen kuin ne leviävät viraaleiksi, kun taas myyntitiimit rikastavat potentiaalisten asiakkaiden listoja “laukaisutapahtumilla” kuten rahoituskierroksilla tai johdon rekrytoinneilla.

Parhaiden käytäntöjen tarkistuslista automaattiseen uutisten poimintaan

Tässä nopea muistilista, joka pitää uutisten poimintaputkesi sujuvana:

| Paras käytäntö | Miksi sillä on merkitystä | Miten toteuttaa |

|---|---|---|

| Ajoita poiminnat tiheästi | Minimoi viiveen, nappaa breaking news -uutiset | Sovita päivitystiheys uutisnopeuteen (esim. 15 min välein nopeissa aiheissa) |

| Käytä tekoälypohjaista poimintaa | Mukautuu asettelumuutoksiin, lyhentää käyttöönottoaikaa | Työkalut kuten Thunderbit, Diffbot, Zyte API |

| Poista duplikaatit ja kanonisoi | Vältä päällekkäiset hälytykset, varmista siisti data | Tallenna kanoniset URLit, käytä hash-arvoja duplikaattien poistoon |

| Seuraa poiminnan laatua | Havaitse puuttuvat kentät, poikkeamat tai virheet | Seuraa täydellisten tietueiden osuutta, viivettä ja virheprosentteja |

| Kunnioita lakia ja sääntöjä | Vältä oikeudelliset riskit, säilytä luottamus | Suosi virallisia API-rajapintoja/syötteitä, tarkista ehdot, minimoi henkilötiedot |

| Vie jäsennellyissä muodoissa | Mahdollista jatkoanalytiikka | CSV, Excel, Sheets, Notion, Airtable |

| Ajoita uudelleenpoiminnat muokkausten varalle | Tuo esiin julkaisun jälkeiset muutokset | Palaa artikkeleihin 24 h/1 vkon jälkeen (GDELT-malli) |

| Suojaa putkesi | Suojaa arkaluonteinen data | Salaus, pääsynhallinta, luotettavat työkalut |

Kestävän automaattisen uutisten poimintatyönkulun rakentaminen

Valmiina rakentamaan oman uutisdatan “mustan laatikon”? Tässä vaiheittainen työnkulku:

- Tunnista lähteesi: Listaa uutissivustot, blogit tai API-rajapinnat, joita haluat seurata.

- Aseta poiminta: Määritä kentät Thunderbitillä tai valitsemallasi työkalulla (AI Suggest Fields tekee tästä helppoa).

- Ajoita poiminnat: Määritä tahti uutisnopeuden mukaan – tunneittain breaking newsille, päivittäin hitaammille aiheille.

- Alasivujen rikastus: Poimi jokaisesta otsikosta koko artikkeli, leipäteksti, entiteetit ja tunnisteet.

- Poista duplikaatit ja normalisoi: Tallenna kanoniset URLit, laske tietueista hashit ja yhdenmukaista kentät.

- Vie ja integroi: Lähetä jäsennelty data Exceliin, Google Sheetiin, Airtableen tai Notioniin analysoitavaksi.

- Seuraa ja mukauta: Tarkkaile poiminnan laatua, huomioi asettelumuutokset ja säädä tarvittaessa.

- Pysy sääntöjen mukaisena: Tarkista ehdot, kunnioita robots.txt-tiedostoa ja minimoi henkilötiedot.

Visuaalisena työnkulkuna ajattele näin:

Lähteet → Poiminta (tekoälykentät) → Alasivujen rikastus → Duplikaattien poisto → Vienti → Analyysi/hälytykset → Valvonta

Yhteenveto ja tärkeimmät opit

Automaattinen uutisten poiminta ei ole enää vain “kiva lisä” – se on välttämättömyys kaikille, joiden pitää pysyä kärjessä maailmassa, jossa uutiset julkaistaan ja muuttuvat minuutti minuutilta. Noudattamalla parhaita käytäntöjä ja käyttämällä oikeita työkaluja voit muuttaa digitaalisen uutistulvan tasaiseksi virraksi toimintakelpoista, jäsenneltyä tietoa.

Tärkeimmät opit:

- Verkkouutisten mittakaava ja nopeus edellyttävät automaatiota – manuaalinen seuranta ei yksinkertaisesti pysy perässä.

- Automaattiset uutisten poimintatyökalut säästävät aikaa, pienentävät kustannuksia ja antavat pienille tiimeille mahdollisuuden vastata paljon suurempien organisaatioiden kattavuuteen.

- Oikean työkalun valinnassa tasapainotetaan käytettävyys, tietoturva ja mukautuvuus – Thunderbit erottuu tekoälypohjaisella helppoudellaan ja reaaliaikaisilla vientivaihtoehdoillaan.

- Rakenna työnkulku tuoreuden, duplikaattien poiston, sääntöjenmukaisuuden ja laadunvalvonnan ympärille varmistaaksesi luotettavan, käyttökelpoisen uutisdatan.

- Tekoäly ja koneoppiminen avaavat vielä suuremman arvon – ne mahdollistavat älykkäämmän kohdentamisen, personoinnin ja päätöksenteon.

Jos kopioit ja liität yhä otsikoita tai odotat Google Alertsin kiriä kiinni, nyt on aika nostaa tasoa. ja näe, miten helppoa automaattinen uutisten poiminta voi olla. Lisää vinkkejä, työnkulkuja ja syväanalyyseja löydät .

Usein kysytyt kysymykset

1. Mitä automaattinen uutisten poiminta on ja miten se toimii?

Automaattinen uutisten poiminta on prosessi, jossa ohjelmisto kerää uutisartikkeleita ja muuntaa ne jäsennellyksi dataksi (kuten taulukoiksi tai JSONiksi) analyysiä, hakua tai hälytyksiä varten. Thunderbitin kaltaiset työkalut käyttävät tekoälyä tunnistaakseen keskeiset kentät (otsikko, aikaleima, kirjoittaja, leipäteksti) ja poimiakseen ne automaattisesti verkkosivuilta tai API-rajapinnoista.

2. Miksi reaaliaikainen uutisdata on niin tärkeää yrityksille?

Reaaliaikainen uutisdata auttaa yrityksiä reagoimaan nopeasti markkinatapahtumiin, PR-kriiseihin tai kilpailijoiden liikkeisiin. Olitpa myynnissä, PR:ssä tai tutkimuksessa, ajantasainen uutisdata auttaa tekemään fiksumpia ja nopeampia päätöksiä ja pysymään kilpailun edellä.

3. Miten Thunderbit tekee uutisten poiminnasta helpompaa ei-teknisille käyttäjille?

Thunderbit tarjoaa yksinkertaisen kahden vaiheen prosessin: kuvaile, mitä dataa haluat, ja anna tekoälyn ehdottaa kenttiä. Alasivujen poiminnan ja välittömän viennin Exceliin tai Google Sheetiin kaltaisilla ominaisuuksilla jopa ei-tekniset käyttäjät voivat rakentaa kestävän uutisdatan työnkulun minuuteissa.

4. Mitkä ovat uutisten poiminnan juridiset ja sääntöjenmukaisuuteen liittyvät näkökohdat?

Tarkista aina kohdesivustojen käyttöehdot, suosi virallisia API-rajapintoja tai syötteitä silloin kun niitä on saatavilla, ja noudata robots.txt-ohjeita. Vältä kirjautumisen takana olevan tai maksumuurilla suojatun sisällön poimimista ilman lupaa ja minimoi henkilötietojen kerääminen yksityisyyslakien noudattamiseksi.

5. Miten varmistan, että uutisten poimintatyönkulkuni pysyy luotettavana pitkällä aikavälillä?

Ajoita säännölliset poiminnat, seuraa poiminnan laatua ja käytä työkaluja, jotka mukautuvat asettelumuutoksiin (kuten Thunderbitin tekoälypohjainen poiminta). Poista duplikaatit, seuraa julkaisun ja poiminnan välistä viivettä ja aseta hälytykset virheille tai puuttuville kentille, jotta putkesi pysyy terveenä ja ajan tasalla.

Lisää luettavaa