Olen rehellinen: kun yritin ensimmäisen kerran poimia kaikki URL-osoitteet isolta verkkosivustolta, ajattelin: “Miten vaikeaa tämä muka voi olla?” Muutamaa tuntia myöhemmin klikkailin yhä loputtomien sivujen läpi, kopioin linkkejä taulukkolaskentaan ja kyseenalaistin elämänvalintojani. Jos olet joskus yrittänyt löytää kaikki sivut verkkosivustolta — oli kyse sitten sisällön auditoinnista, liidilistan kokoamisesta tai kilpailija-analyysistä — tiedät, miten turhauttavaa se on. Se on hidasta, virhealtista ja suoraan sanottuna ajan sekä osaamisen haaskausta.

Hyvä uutinen on tämä: sinun ei enää tarvitse tehdä sitä vaikeimman kautta. Tekoälypohjaiset työkalut, kuten , muuttavat peliä yrityskäyttäjille ja tekevät mahdolliseksi löytää kaikki URL-osoitteet verkkotunnukselta minuuteissa, ei päivissä. Itse asiassa yritykset, jotka käyttävät tekoälyyn perustuvia web-kaavintatyökaluja, raportoivat tiedonkeruussa, ja jotkut näkevät jopa verrattuna manuaalisiin menetelmiin. Se ei ole vain tilasto — se on tunteja, joskus päiviä, takaisin omaan elämääsi.

Käydään siis läpi, miksi kaikkien sivujen löytäminen verkkosivustolta on niin hankalaa, miksi yleiset tekoälymallit kuten GPT tai Claude eivät oikein auta, ja miten erikoistuneet tekoälyagentit — kuten Thunderbit — tekevät tästä prosessista vaivatonta. Ja kyllä, käyn läpi tarkat vaiheet, joilla poimit kaikki tarvitsemasi URL-osoitteet, vaikka et olisi koodari.

Miksi kaikkien URL-osoitteiden löytäminen verkkotunnukselta on niin haastavaa

Myönnetään se: verkkosivustot eivät ole rakennettu siten, että saisit niistä siistin listan kaikista sivuista. Ne on tehty kävijöitä varten, eivät ihmisille, jotka yrittävät löytää kaikki sivut verkkosivustolta yhdellä kertaa. Tästä syystä tehtävä on niin hankala:

- Manuaalinen kopioi ja liitä -ruljanssi: Jokaisen valikon, listan ja hakemiston läpiklikkaaminen ja URL-osoitteiden kopioiminen yksi kerrallaan on varma resepti rasitusvammoihin — ja siihen, että puolet sivuista jää löytymättä.

- Sivutus ja loputon vieritys: Moni sivusto jakaa sisällön useille sivuille tai lataa lisää tuloksia sitä mukaa kun vierität. Jos unohdat “Seuraava”-painikkeen tai et vieritä tarpeeksi pitkälle, kokonaisia osioita jää väliin.

- Epäyhtenäiset sivurakenteet: Joillakin sivuilla linkit ovat yhdessä muodossa, toisilla aivan eri tavalla rakennettuina. Kaiken seuraaminen on painajainen.

- Piilotetut tai orvot sivut: Kaikki sivut eivät ole linkitettyinä päävalikkoon. Osa on syvällä piilossa ja löytyy vain sivukartan tai sisäisen haun kautta.

- Ihmisen tekemät virheet: Mitä enemmän sivuja kopioit, sitä todennäköisemmin teet virheitä — tuplaat URL-osoitteita, kirjoitat väärin tai jätät jotain kokonaan pois.

Ja jos työskentelet sivustolla, jolla on satoja tai tuhansia sivuja? Voit unohtaa manuaalisen poiminnan. Se ei yksinkertaisesti skaalaudu. Kuten eräs data-tiimi totesi, kaikkeen, mikä menee vähänkään yksinkertaista pidemmälle, .

Mitä tarkoittaa “löytää kaikki sivut verkkosivustolta”?

Ennen kuin mennään ratkaisuihin, selvennetään, mitä oikeastaan etsimme.

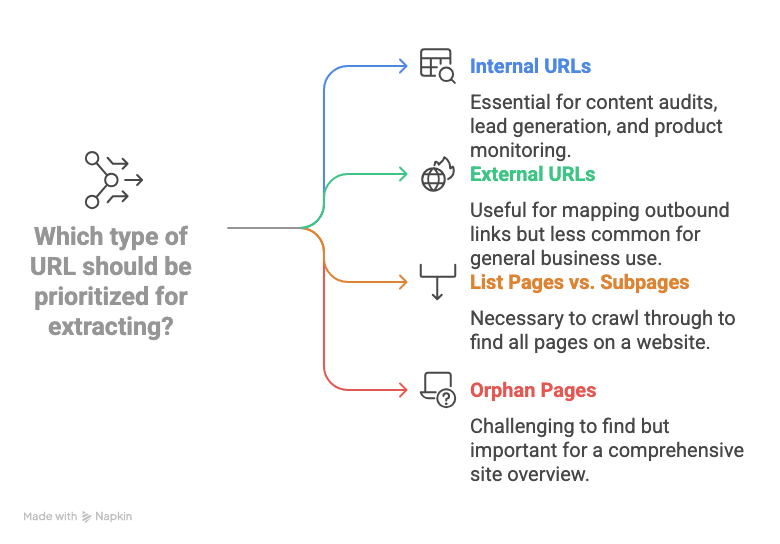

- Sisäiset URL-osoitteet: Nämä ovat linkkejä, jotka osoittavat saman verkkotunnuksen sivuille (kuten /about-us tai /products/widget-123). Useimmissa liiketoiminnan käyttötapauksissa — sisällön auditoinnissa, liidien hankinnassa, tuote-seurannassa — sisäiset URL-osoitteet ovat pääkohde.

- Ulkoiset URL-osoitteet: Linkkejä, jotka vievät muille verkkosivustoille. Näitä et yleensä tarvitse, ellei tarkoituksena ole kartoittaa ulospäin johtavia linkkejä.

- Listasivut vs. alasivut: Monilla sivustoilla on “hubi”- tai listausivuja (ajattele: kategoriat, blogiarkistot, hakemistot), jotka linkittävät yksityiskohtaisille sivuille (kuten tuote- tai profiilisivuille). Jotta voisit todella löytää kaikki sivut verkkosivustolta, sinun täytyy käydä nämä listat läpi ja poimia kaikki niiden linkittämät alasivut.

- Orvot sivut: Nämä ovat sivuja, joihin ei ole linkkiä mistään ilmeisestä paikasta. Joskus ne voi löytää sivukarttojen tai sisäisen haun kautta, mutta ne jäävät helposti huomaamatta.

Kun siis puhumme kaikkien URL-osoitteiden löytämisestä verkkotunnukselta, tarkoitamme tätä: poimi jokainen sisäinen sivun URL etusivulta aina syvimpään tuote- tai artikkelisivuun asti, mieluiten muodossa, jota voit käyttää suoraan, kuten taulukkolaskennassa.

Perinteiset tavat löytää kaikki URL-osoitteet verkkotunnukselta

Tähän on muutama vanhan koulukunnan tapa, mutta jokaisessa on omat ongelmansa:

Manuaalinen kopioi ja liitä sekä selaintyökalut

Tämä on “raakaa voimaa” -lähestymistapa: klikkaa jokaista linkkiä, kopioi jokainen URL, liitä se taulukkoon ja toivo, ettet missaa mitään. Jotkut käyttävät selaimen laajennuksia, joilla voi napata kaikki linkit nykyiseltä sivulta, mutta sama täytyy silti tehdä jokaiselle sivulle erikseen, ja sivutus sekä piilotetut osiot jäävät sinun vastuullesi. Toimii ehkä viisisivuisella sivustolla — ei juuri isommilla.

Sivustohaku ja sivukartat

- Googlen site:-haku: Kirjoita Googleen site:yourdomain.com, niin näet joukon indeksoituja sivuja. Mutta Google näyttää vain sen, minkä se on indeksoinut (usein enintään noin 1 000 tulosta), joten uudet, piilotetut tai heikkolaatuiset sivut jäävät pois. myöntävät, ettei tämä ole täydellinen ratkaisu.

- XML-sivukartat: Monilla sivustoilla on /sitemap.xml, joka listaa tärkeät URL-osoitteet. Hienoa — jos sivukartta on ajan tasalla ja sisältää jokaisen sivun. Mutta kaikilla sivustoilla sellaista ei ole, ja osa jakaa sivukarttansa useaan tiedostoon. Orvot sivut jäävät usein ulkopuolelle.

Teknisiä crawlereita ja skriptejä

- SEO-työkalut (kuten Screaming Frog): Nämä käyvät sivuston läpi kuin hakukone ja tuottavat URL-osoitelistauksen. Ne ovat tehokkaita, mutta vaativat käyttöönottoa, asetusten säätämistä ja joskus maksullisen lisenssin isommille sivustoille.

- Python-skriptit (kuten Scrapy): Kehittäjät voivat kirjoittaa skriptejä, jotka käyvät sivuston läpi ja poimivat URL-osoitteet. Mutta ollaanpa rehellisiä: jos et ole tottunut koodiin, tämä ei ole realistinen vaihtoehto. Lisäksi skriptit hajoavat, kun sivuston rakenne muuttuu, joten olet jatkuvasti jälkijunassa.

Yhteenveto: Perinteiset menetelmät ovat useimmille yrityskäyttäjille joko liian manuaalisia, liian puutteellisia tai liian teknisiä. Ei ole sattumaa, että niin moni luovuttaa puolivälissä.

Miksi yleiset tekoälymallit eivät voi täysin automatisoida URL-osoitteiden poimintaa

Saatat ajatella: “Eikö ChatGPT:ltä tai Claudelta voisi vain pyytää, että löytää kaikki sivut verkkosivustolta puolestani?” Haluaisin, että se olisi noin helppoa. Todellisuus on tämä:

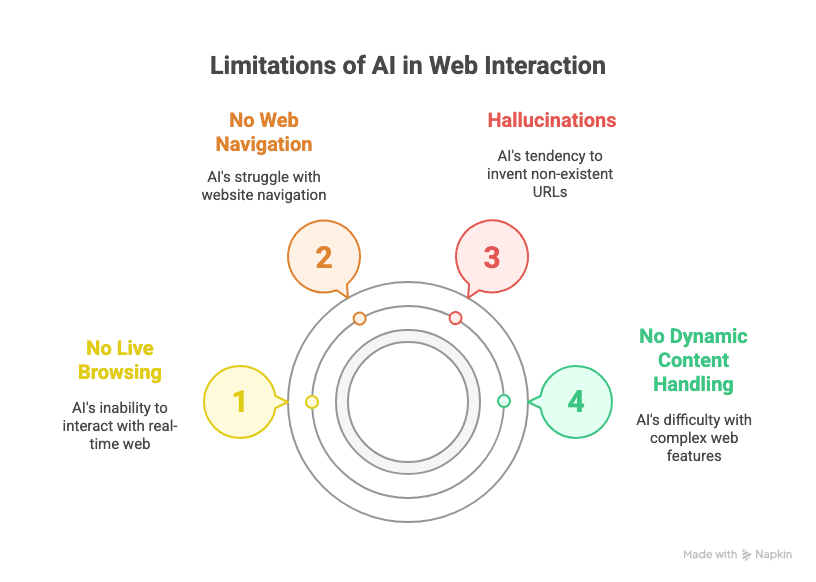

- Ei reaaliaikaista selaamista: Yleiskäyttöiset tekoälymallit kuten GPT tai Claude eivät oikeasti selaa verkkoa reaaliajassa. Ne eivät “näe” verkkosivuston nykytilaa — ne toimivat vain koulutusdatansa tai sen perusteella, mitä itse liität niille.

- Ei verkkonavigointia: Vaikka lisäosat tai selaustoiminnot olisivat käytössä, LLM-mallit eivät osaa klikata “Seuraava”-painiketta, käsitellä loputonta vieritystä tai seurata järjestelmällisesti jokaista linkkiä sivustolla.

- Hallusinaatiot: Pyydä yleistä tekoälyä listaamaan kaikki URL-osoitteet verkkotunnukselta, niin se keksii usein linkkejä, jotka kuulostavat uskottavilta mutta eivät oikeasti ole olemassa. (Olen nähnyt sen keksivän /about-us-sivuja sivustoille, joilla ei koskaan ollut sellaista.)

- Ei dynaamisen sisällön käsittelyä: Sivustot, jotka lataavat sisältönsä JavaScriptillä, vaativat kirjautumisen tai käyttävät monimutkaista navigointia, jäävät yleisten LLM-mallien ulottumattomiin.

Kuten sanoo: “Jos haluat poimia satoja tai tuhansia sivuja… ChatGPT yksin ei riitä.” Tarvitset tähän tarkoitukseen rakennetun työkalun.

Pystysuuntaiset tekoälyagentit ovat tulevaisuus — ja miksi sillä on väliä

Tässä kohtaa SaaS- ja automaatio-osaamiseni astuu kuvaan: pystysuuntaiset tekoälyagentit — eli tekoälytyökalut, jotka on rakennettu tiettyä aluetta varten, kuten web-datan poimintaan — ovat ainoa tapa saada luotettavia ja skaalautuvia tuloksia liiketoiminnan tehtäviin. Miksi?

- Yleiskäyttöiset LLM-mallit ovat erinomaisia kirjoittamiseen ja hakuun, mutta ne hallusinoivat helposti eivätkä pysty käsittelemään monivaiheisia, toistettavia työnkulkuja yritysten tarvitsemalla vakaudella.

- Yritystason SaaS-työkalujen täytyy automatisoida paljon toistuvia, rakenteisia tehtäviä. Siinä pystysuuntaiset tekoälyagentit loistavat — ne on rakennettu tekemään yhtä asiaa hyvin, mahdollisimman vähin virhein.

- Esimerkkejä löytyy eri toimialoilta: Thunderbit web-datan poimintaan, Devin AI ohjelmistokehitykseen, Alta myynnin automaatioon, Infinity Learnin IL VISTA koulutukseen, Rippling HR:ään, Harvey juridiikkaan… lista jatkuu.

Lyhyesti: jos haluat löytää kaikki sivut verkkosivustolta luotettavasti, tarvitset siihen rakennetun pystysuuntaisen tekoälyagentin — et yleiskäyttöistä chatbottia.

Tutustu Thunderbitiin: tekoälyllä toimiva URL-osoitteiden poiminta kaikille

Tässä kohtaa astuu kuvaan. Thunderbit on tekoälyllä toimiva web-kaavin Chrome-laajennuksena, joka on suunniteltu yrityskäyttäjille — ei koodausta, ei teknistä käyttöönottoa, vain tuloksia. Tässä mikä tekee siitä erilaisen:

- Luonnollisen kielen käyttöliittymä: Kuvaile vain, mitä haluat (“Listaa kaikki tämän sivuston sivu-URL-osoitteet”), niin Thunderbitin tekoäly selvittää, miten se poimitaan.

- AI Suggest Fields: Thunderbit skannaa sivun ja ehdottaa automaattisesti sarakenimiä (kuten “Page URL”) — ei tarvitse säätää CSS-valitsimia tai XPathia.

- Käsittelee sivutuksen ja loputtoman vierityksen: Thunderbit osaa klikata “Seuraava”-painiketta tai vierittää automaattisesti alaspäin, joten et missaa yhtään sivua.

- Alasivunavigointi: Tarvitsetko syvemmälle? Thunderbit voi seurata linkkejä alasivuille ja poimia dataa myös sieltä.

- Rakenteinen vienti: Vie tulokset suoraan Google Sheetsiin, Exceliin, Notioniin, Airtableen tai CSV:ksi — ilmaiseksi ja yhdellä klikkauksella.

- Ei koodausta: Jos osaat selata verkkosivua, osaat käyttää Thunderbitia. Niin yksinkertaista se on.

Ja koska Thunderbit on pystysuuntainen tekoälyagentti, se on rakennettu vakaaksi ja toistettavaksi — täydellinen yrityskäyttäjille, joiden täytyy automatisoida samoja tehtäviä yhä uudelleen.

Vaihe vaiheelta: kuinka löydät kaikki URL-osoitteet verkkotunnukselta Thunderbitillä

Haluatko nähdä, miten tämä toimii? Tässä teknisestä näkökulmasta helppo opastus siihen, miten poimit kaikki tarvitsemasi URL-osoitteet.

1. Asenna Thunderbit Chrome -laajennus

Aloita tästä: . Se toimii Chromessa, Edgessä, Brave-selaimessa ja muissa Chromium-pohjaisissa selaimissa. Kiinnitä se työkalupalkkiin, jotta saat sen helposti käyttöön.

2. Avaa kohdelistasi tai hakemistosivusi

Siirry sivustolle, josta haluat poimia URL-osoitteet. Tämä voi olla etusivu, sivukartta, hakemisto tai mikä tahansa listasivu, joka linkittää tarvitsemaasi sisältöön.

3. Käynnistä Thunderbit ja määritä kenttäsi

Klikkaa Thunderbit-kuvaketta avataksesi laajennuksen. Aloita uusi scraper-malli. Tässä tapahtuu taika:

- Klikkaa “AI Suggest Fields”. Thunderbitin tekoäly skannaa sivun ja ehdottaa sarakkeita — etsi sellaista, jonka nimi on “Page URL”, “Link” tai vastaava.

- Jos et näe juuri haluamaasi kenttää, lisää vain sarake nimellä “Page URL” (tai mikä ikinä onkaan järkevää). Thunderbitin tekoäly tunnistaa nämä termit ja yhdistää ne oikeaan dataan.

4. Ota käyttöön sivutus tai vieritys tarvittaessa

Jos kohdesivulla on useita sivuja (kuten “Sivu 1, 2, 3…” tai “Lataa lisää” -painike), ota sivutus käyttöön Thunderbitissä:

- Vaihda “Click Pagination” -tilaan sivustoilla, joilla on “Seuraava”-painikkeita, tai “Infinite Scroll” -tilaan, jos sivu lataa lisää sisältöä vierityksen aikana.

- Thunderbit pyytää sinua valitsemaan “Seuraava”-painikkeen tai vieritysalueen — klikkaa sitä, ja tekoäly hoitaa loput.

5. Aloita poiminta ja tarkista tulokset

Paina “Scrape”-painiketta. Thunderbit käy läpi kaikki sivut ja kerää jokaisen löytämänsä URL-osoitteen. Näet tulokset taulukkona suoraan laajennuksessa. Suurilla sivustoilla tämä voi kestää muutaman minuutin, mutta se on silti paljon nopeampaa kuin käsin tekeminen.

6. Vie URL-listasi

Kun poiminta on valmis, klikkaa Export. Voit lähettää datasi suoraan seuraaviin:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Viennit ovat ilmaisia ja säilyttävät kaiken muotoilun. Ei enää kopioi ja liitä -sähläystä.

Thunderbitin vertailu muihin URL-osoitteiden poistoratkaisuihin

| Menetelmä | Käytettävyys | Tarkkuus ja kattavuus | Skaalautuvuus | Vientivaihtoehdot |

|---|---|---|---|---|

| Manuaalinen kopioi ja liitä | Kivulias | Heikko (helppo missata) | Ei lainkaan | Manuaalinen (Excel jne.) |

| Selaimen linkinpoimijat | OK yhdelle sivulle | Keskitaso | Heikko | Manuaalinen |

Googlen site:-haku | Helppo | Keskitaso (ei täydellinen) | Rajoitettu noin 1 000:een | Manuaalinen |

| XML-sivukartta | Helppo (jos olemassa) | Hyvä (jos ajan tasalla) | Hyvä | Manuaalinen/Skripti |

| SEO-työkalut (Screaming Frog) | Tekninen | Korkea | Korkea (maksullinen) | CSV, Excel |

| Python-skriptit (Scrapy jne.) | Erittäin tekninen | Korkea | Korkea | Räätälöity |

| Thunderbit | Erittäin helppo | Erittäin korkea | Korkea | Google Sheets, CSV jne. |

Thunderbit antaa sinulle ammattimaisen crawlerin tarkkuuden ja mittakaavan yhdistettynä selaimen laajennuksen helppokäyttöisyyteen. Ei koodia, ei käyttöönottoa, vain tuloksia.

Bonus: poimi Thunderbitillä muutakin kuin URL-osoitteita

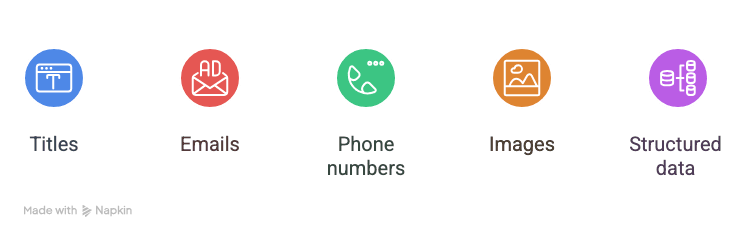

Tässä kohtaa homma muuttuu todella kiinnostavaksi. Thunderbit ei ole vain URL-osoitteita varten — voit poimia myös:

- Otsikoita

- Sähköposteja

- Puhelinnumeroita

- Kuvia

- Mitä tahansa rakenteista dataa sivulta

Jos esimerkiksi rakennat liidilistaa, voit pyytää Thunderbitia poimimaan jokaisesta hakemistomerkinnästä profiilin URL-osoitteen, nimen, sähköpostin ja puhelinnumeron — kaikki yhdellä ajolla. Jos auditoin tuotesivuja, voit kerätä tuote-URL-osoitteen, nimen, hinnan ja varastotilanteen. Thunderbit tukee jopa , joten se voi klikata jokaiseen linkkiin ja poimia tiedot sieltäkin.

Ja kyllä, Thunderbitin sähköposti- ja puhelinpoimijat ovat täysin ilmaisia. Se on iso juttu myynti- ja markkinointitiimeille.

Keskeiset opit: kuinka löydät kaikki sivut verkkosivustolta tekoälyllä

Kerrataanpa:

- Kaikkien URL-osoitteiden poimiminen verkkotunnukselta on hankalaa manuaalisilla tai yleisillä työkaluilla.

- Yleiset tekoälymallit kuten GPT eivät osaa käsitellä verkkonavigointia, sivutusta tai dynaamista sisältöä.

- Pystysuuntaiset tekoälyagentit kuten Thunderbit on rakennettu juuri web-datan poimintaan — vakaiksi, toistettaviksi ja yrityskäyttäjille helpoiksi.

- Thunderbit tekee siitä yksinkertaista: asenna laajennus, anna tekoälyn ehdottaa kentät, ota sivutus käyttöön, poimi ja vie. Ei koodia, ei säätöä.

- Voit poimia muutakin kuin URL-osoitteita: otsikoita, sähköposteja, puhelinnumeroita ja paljon muuta — täydellistä liidien hankintaan, auditointeihin tai tutkimukseen.

Jos olet kyllästynyt kopioimaan linkkejä käsin tai taistelemaan teknisten crawlerin kanssa, . Tarjolla on ilmainen versio, joten voit itse nähdä, kuinka paljon aikaa — ja hermoja — säästät.

Ja jos olet utelias muista tavoista, joilla Thunderbit voi auttaa — kuten , tai — katso lisää oppaita ja vinkkejä .

Valmis ottamaan aikasi takaisin manuaaliselta tiedonkeruulta? Web-datan poiminnan tulevaisuus on pystysuuntaisissa tekoälyagenteissa — ja Thunderbit on tämän kehityksen kärjessä. Kokeile sitä, ja tee seuraavasta auditoinnistasi, liidilistastasi tai tutkimusprojektistasi helpoin ikinä.

Lue lisää

P.S. Jos huomaat joskus houkuttelevaksi kopioida ja liittää 1 000 URL-osoitetta käsin, muista vain tämä: siihen on nykyään tekoäly. Ranteesi — ja pomosi — kiittävät.