Verkko on täynnä arvokasta dataa – mutta valtaosa siitä ei ole tehty “lataa tästä” -napilla mukaan otettavaksi. Vuonna 2025 web scraping on noussut nörttien erikoistaidosta ihan pakolliseksi työkaluksi tiimeille, jotka seuraavat hintoja, työpaikkoja, asuntoja ja kilpailijoita. Ongelma? web scraping github -maailma on yhtä aikaa aarreaitta ja miinakenttä: GitHub on täynnä github-projektit, joista osa on viimeisen päälle hiottuja, osa taas suorastaan tuskastuttavia, ja monia ei ole päivitetty vuosiin. Miten ihmeessä valitset oikean – varsinkin jos et ole kehittäjä?

Tässä oppaassa käyn läpi 15 parasta web scraping -projektia GitHubissa vuodelle 2025. En kuitenkaan vain listaa nimiä, vaan vertailen niitä asennuksen ja käyttöönoton vaativuuden, käyttötarkoituksen, dynaamisen sisällön tuen, ylläpidon tilanteen, vientimahdollisuuksien sekä sen mukaan, kenelle ne oikeasti sopivat. Ja jos koodin kanssa vääntäminen alkaa tökkiä, näytän miksi no-code- ja AI-vetoiset työkalut kuten muuttavat peliä myös liiketoimintakäyttäjille ja ei-teknisille tekijöille.

Miten valitsimme 15 parasta web scraping -projektia GitHubista

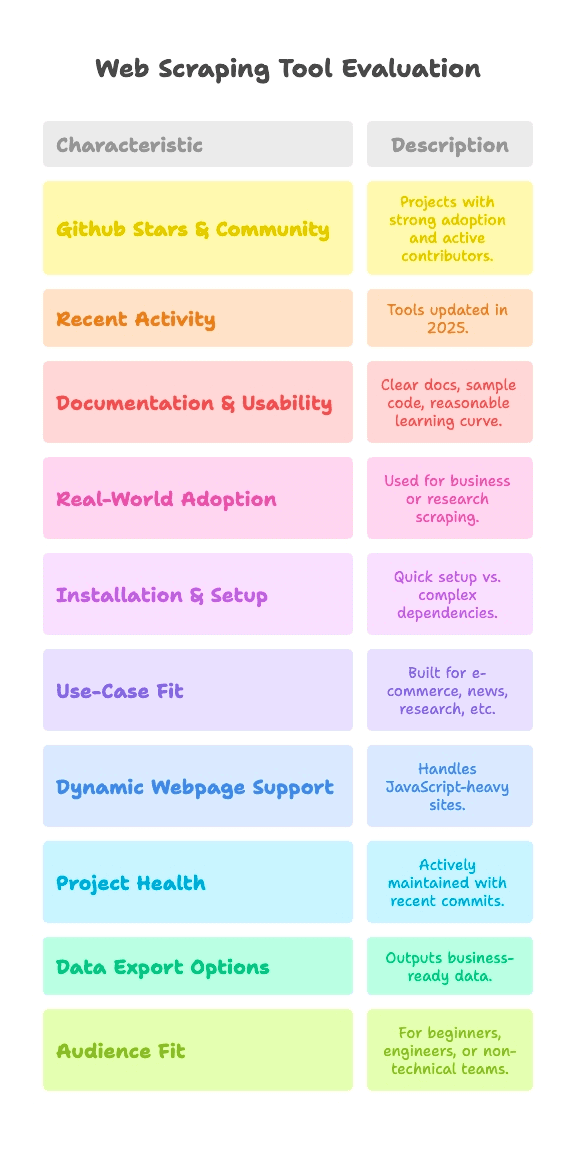

Rehellisesti: kaikki GitHub-projektit eivät ole samalla viivalla. Osa on “battle-tested” tuhansien käyttäjien toimesta, osa taas viikonloppuhack, joka jäi kesken. Tähän listaan valitsin projektit, jotka täyttävät nämä kriteerit:

- GitHub-tähdet & yhteisö: Selkeä käyttöönotto ja vahva yhteisö (muutamasta tuhannesta aina 90k+ tähteen) sekä aktiivisia tekijöitä.

- Tuore aktiivisuus: Työkalut, joita päivitetään edelleen vuonna 2025 – ei digitaalisia fossiileja.

- Dokumentaatio & käytettävyys: Selkeät ohjeet, esimerkkikoodi ja järkevä oppimiskynnys.

- Oikea käyttö arjessa: Käytössä oikeissa yritys- tai tutkimuskeisseissä, ei vain “hello world” -demoissa.

Koska web scraping ei ole one-size-fits-all, vertailen jokaista projektia myös näillä mittareilla:

- Asennus & käyttöönoton vaativuus: Pääsetkö alkuun minuuteissa vai tappeletko ajureiden ja riippuvuuksien kanssa?

- Sopivuus käyttötapaukseen: Onko se tehty verkkokauppaan, uutisiin, tutkimukseen vai johonkin muuhun?

- Dynaamisten sivujen tuki: Selviääkö se moderneista, JavaScript-painotteisista sivuista?

- Projektin kunto: Onko sitä ylläpidetty aktiivisesti vai onko viimeisin commit jo äänestysikäinen?

- Datan vienti: Saatko ulos liiketoimintakelpoista dataa vai pelkkää raakaa HTML:ää?

- Kenelle se sopii: Python-aloittelijoille, data-insinööreille vai ei-teknisille tiimeille?

Jokainen projekti saa näistä kriteereistä pikatunnisteet, jotta löydät nopeasti omaan tarpeeseesi sopivan vaihtoehdon – olitpa koodivelho tai haluat vain datan suoraan Google Sheetiin.

Asennus & käyttöönotto: kuinka nopeasti pääset scrapaamaan?

Useimmille suurin kynnys on yksinkertaisesti saada scraper ylipäätään pyörimään. Jaan käyttöönoton vaativuuden näin:

- Plug & Play (nolla konfigurointia): Asenna ja käytä. Minimaalinen säätö, sopii aloittelijoille.

- Kohtalainen (komentorivi, vähän koodausta): Vaatii jonkin verran koodia tai CLI-työskentelyä, mutta onnistuu jos olet tehnyt skriptejä aiemmin.

- Edistynyt (ajurit, anti-bot, syvää koodausta): Tarvitsee ympäristön virittelyä, selainajureita tai vahvaa Python/JS-osaamista.

Näin huippuprojektit asettuvat:

- Plug & Play: MechanicalSoup (Python), Nokogiri (Ruby), Maxun (loppukäyttäjille käyttöönoton jälkeen)

- Kohtalainen: Scrapy, Crawlee, Node Crawler, Selenium, Playwright, Colly, Puppeteer, Katana, Scrapling, WebMagic

- Edistynyt: Heritrix, Apache Nutch (molemmat vaativat Javaa, konfiguraatiota tai ison datan pinoja)

Jos et ole kehittäjä, “Plug & Play” tai no-code-vaihtoehdot ovat yleensä se fiksuin reitti. Muuten “Kohtalainen” tarkoittaa, että koodia pitää kirjoittaa – mutta harvoin mitään oikeasti pelottavaa, ellei aaltosulkeet aiheuta allergiaa.

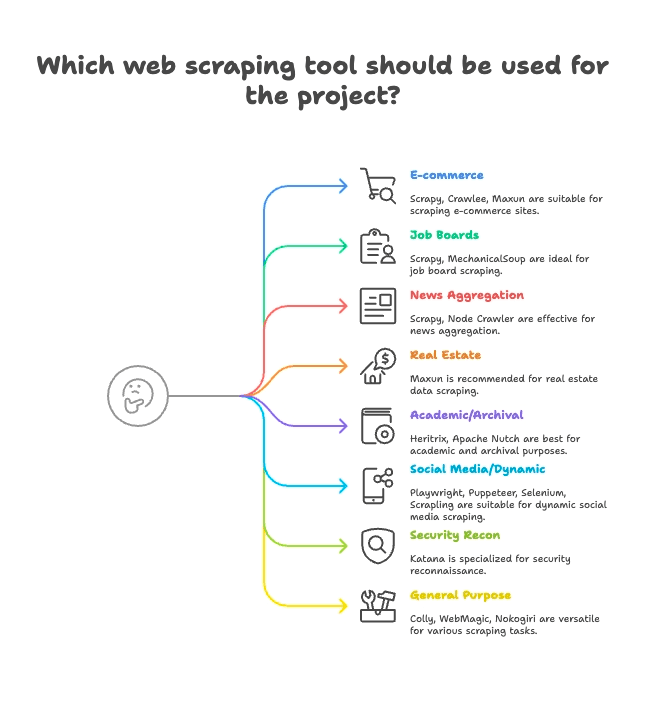

Käyttötapauksiin perustuva ryhmittely: löydä oikea scraper toimialallesi

Kaikkia scrappereita ei ole tehty samaan duuniin. Näin ryhmittelen 15 parasta niiden vahvimpien käyttötapausten mukaan:

Verkkokauppa & hintaseuranta

- Scrapy: Laajamittainen, monisivuinen tuotedatan keruu

- Crawlee: Monipuolinen, toimii sekä staattisilla että dynaamisilla verkkokauppasivuilla

- Maxun: No-code, erinomainen nopeisiin tuotelistojen poimintoihin

Työpaikkasivustot & rekrytointi

- Scrapy: Hoitaa sivutuksen ja rakenteiset listaukset

- MechanicalSoup: Toimii kirjautumista vaativilla työpaikkasivustoilla

Uutiset & sisällön koonti

- Scrapy: Rakennettu skaalautuvaan uutiscrawlaamiseen

- Node Crawler: Nopea staattisten uutissivujen aggregointiin

Asunnot & kiinteistöt

- Thunderbit: AI-pohjainen alisivujen scraping listauksille + yksityiskohtasivuille

- Maxun: Visuaalinen valinta kiinteistödatalle

Akateeminen tutkimus & web-arkistointi

- Heritrix: Koko sivuston arkistointi (WARC-tiedostot)

- Apache Nutch: Hajautettu crawlaus tutkimusdatasetille

Sosiaalinen media & dynaaminen sisältö

- Playwright, Puppeteer, Selenium: Dynaamisten feedien scraping, kirjautumisten simulointi

- Scrapling: “Stealth”-scraping anti-bot-suojauksia vastaan

Tietoturva & kartoitus

- Katana: Nopea URL-löytö ja tietoturvacrawlaus

Yleiskäyttö / monitoimi

- Colly: Suorituskykyinen Go-scraping mihin tahansa sivustoon

- WebMagic: Java-pohjainen, joustava moniin domaineihin

- Nokogiri: Ruby-parsinta omiin skripteihin

Dynaamisten sivujen tuki: pystyvätkö nämä GitHub-projektit scrapaamaan moderneja sivustoja?

Modernit sivustot rakastavat JavaScriptiä. React, Vue, infinite scroll, AJAX – jos olet joskus yrittänyt scrapaata sivua ja saanut vastaukseksi ison, pyöreän “ei mitään”, tiedät tuskan.

Näin projektit käsittelevät dynaamista sisältöä:

- Täysi JS-tuki (headless-selain):

- Selenium: Ohjaa oikeita selaimia ja suorittaa kaiken JS:n

- Playwright: Moniselain- ja monikielituki, vahva JS-tuki

- Puppeteer: Headless Chrome/Firefox, täydellinen JS-renderöinti

- Crawlee: Vaihtaa HTTP:n ja selaimen välillä (Puppeteer/Playwright)

- Katana: Valinnainen headless-tila JS:n käsittelyyn

- Scrapling: Integroi Playwrightin “stealth”-JS-scrapingiin

- Maxun: Käyttää taustalla selainta dynaamiseen sisältöön

- Ei natiivia JS-tukea (vain staattinen HTML):

- Scrapy: Tarvitsee Selenium/Playwright-lisäosan JS:lle

- MechanicalSoup, Node Crawler, Colly, WebMagic, Nokogiri, Heritrix, Apache Nutch: Hakevat vain HTML:n, eivät käsittele JS:ää suoraan

Thunderbitin AI erottuu tässä: se tunnistaa ja poimii dynaamisen sisällön automaattisesti – ilman manuaalista säätöä, lisäosia tai selektoripäänsärkyä. Klikkaa vain “AI Suggest Fields” ja anna sen tehdä raskas työ, myös React-painotteisilla sivuilla. Jos haluat ymmärtää tarkemmin, miten tämä toimii, katso .

Projektin kunto & luotettavuus: toimiiko tämä scraper vielä ensi vuonna?

Mikään ei harmita niin paljon kuin rakentaa prosessi työkalun varaan ja huomata sen jääneen heitteille. Näin projektit pärjäävät:

- Aktiivisesti ylläpidetyt (tiheät päivitykset):

- Scrapy:

- Crawlee:

- Playwright:

- Puppeteer:

- Katana:

- Colly:

- Maxun:

- Scrapling:

- Vakaa, mutta hitaammin päivittyvä:

- MechanicalSoup:

- Node Crawler:

- WebMagic:

- Nokogiri:

- Ylläpitotila (erikoistunut, hidas):

- Heritrix:

- Apache Nutch:

Thunderbit on hallinnoitu palvelu, joten sinun ei tarvitse stressata hylätystä koodista. Tiimimme pitää AI:n, templatet ja integraatiot ajan tasalla – ja saat lisäksi käyttöönotto-opastuksen, ohjeet sekä tuen, jos jumitat.

Datan käsittely & vienti: raakasta HTML:stä liiketoimintakelpoiseen dataan

Datan hakeminen on vasta puolet työstä. Tarvitset sen muotoon, jota tiimi voi käyttää – CSV, Excel, Google Sheets, Airtable, Notion tai vaikka live-API.

- Sisäänrakennettu rakenteinen vienti:

- Scrapy: CSV-, JSON- ja XML-viejät

- Crawlee: Joustavat datasetit ja tallennukset

- Maxun: CSV, Excel, Google Sheets, JSON API

- Thunderbit:

- Manuaalinen datan käsittely (käyttäjän määrittelemä):

- MechanicalSoup, Node Crawler, Selenium, Playwright, Puppeteer, Colly, WebMagic, Nokogiri, Scrapling: Tallennus/vienti tehdään itse koodissa

- Erikoistunut vienti:

- Heritrix: WARC (web-arkistotiedostot)

- Apache Nutch: Raakasisältö tallennukseen/indeksiin

Thunderbitin rakenteinen vienti ja integraatiot säästävät valtavasti aikaa liiketoimintakäyttäjiltä. Ei enää CSV:n säätöä tai “liimakoodia” – klikkaat ja data on käyttövalmista.

Kenelle mikäkin GitHubin web scraping -projekti sopii?

Kaikki työkalut eivät ole kaikille. Tässä suositusprofiilit:

- Python-aloittelijat: MechanicalSoup, Scrapling (jos haluat kokeilla rohkeasti)

- Data-insinöörit: Scrapy, Crawlee, Colly, WebMagic, Node Crawler

- QA- ja automaatioammattilaiset: Selenium, Playwright, Puppeteer

- Tietoturvatutkijat: Katana

- Ruby-kehittäjät: Nokogiri

- Java-kehittäjät: WebMagic, Heritrix, Apache Nutch

- Ei-tekniset käyttäjät / liiketoimintatiimit: Maxun, Thunderbit

- Growth-hakkerit, analyytikot: Maxun, Thunderbit

Jos koodi ei ole mukavuusalueellasi tai haluat tulokset nopeasti, Thunderbit ja Maxun ovat yleensä parhaat valinnat. Muussa tapauksessa valitse työkalu, joka sopii käyttämääsi kieleen ja käyttötapaukseen.

15 parasta web scraping -projektia GitHubissa: tarkempi vertailu

Sukelletaan jokaiseen projektiin käyttötapauksittain, pikatunnisteilla ja tärkeimmillä nostoilla.

Verkkokauppa, hintaseuranta ja yleinen crawlaus

— 57.1k tähteä, päivitys kesäkuu 2025

- Yhteenveto: Korkean tason asynkroninen Python-framework laajamittaiseen crawlaamiseen ja scrapingiin.

- Käyttöönotto: Kohtalainen (Python-koodausta, async-ajattelu)

- Käyttötapaus: Verkkokauppa, uutiset, tutkimus, monisivuiset spiderit

- JS-tuki: Ei (tarvitsee Selenium/Playwright-lisäosan)

- Projektin kunto: Aktiivisesti ylläpidetty

- Datan vienti: CSV, JSON, XML sisäänrakennettuna

- Kenelle: Kehittäjille, data-insinööreille

- Vahvuudet: Skaalautuva, luotettava, paljon lisäosia. Aloittelijalle jyrkkä oppimiskäyrä.

— 17.9k tähteä, 2025

- Yhteenveto: Täysiverinen Node.js-kirjasto staattiseen ja dynaamiseen web scrapingiin.

- Käyttöönotto: Kohtalainen (Node/TS-koodausta)

- Käyttötapaus: Verkkokauppa, sosiaalinen media, automaatio

- JS-tuki: Kyllä (Puppeteer/Playwright-integraatio)

- Projektin kunto: Erittäin aktiivinen

- Datan vienti: Joustava (datasetit, storaget)

- Kenelle: JS/TS-kehitystiimeille

- Vahvuudet: Anti-blocking-työkalut, helppo vaihtaa HTTP- ja selainmoodin välillä.

— 13k tähteä, kesäkuu 2025

- Yhteenveto: Open source -no-code-alusta web-datan poimintaan visuaalisella käyttöliittymällä.

- Käyttöönotto: Kohtalainen (palvelimen käyttöönotto), Helppo (loppukäyttäjille)

- Käyttötapaus: Yleiskäyttö, verkkokauppa, business-scraping

- JS-tuki: Kyllä (taustalla selain)

- Projektin kunto: Aktiivinen ja kasvava

- Datan vienti: CSV, Excel, Google Sheets, JSON API

- Kenelle: Ei-teknisille käyttäjille, analyytikoille, tiimeille

- Vahvuudet: Point-and-click-scraping, monitasoinen navigointi, mahdollista hostata itse.

Työpaikkasivustot, rekrytointi ja yksinkertaiset interaktiot

— 4.8k tähteä, 2024

- Yhteenveto: Python-kirjasto lomakkeiden automaatioon ja yksinkertaiseen navigointiin.

- Käyttöönotto: Plug & Play (Python, vähän koodia)

- Käyttötapaus: Kirjautumista vaativat työpaikkasivustot, staattiset sivut

- JS-tuki: Ei

- Projektin kunto: Kypsä, kevyesti ylläpidetty

- Datan vienti: Ei sisäänrakennettuna (manuaalinen)

- Kenelle: Python-aloittelijoille, nopeisiin skripteihin

- Vahvuudet: Simuloi selainistuntoja muutamalla rivillä. Ei dynaamisille sivuille.

Uutisten aggregointi & staattinen sisältö

— 6.8k tähteä, 2024

- Yhteenveto: Nopea, rinnakkainen palvelinpuolen crawler Cheerio-parsinnalla.

- Käyttöönotto: Kohtalainen (Node callbackit/async)

- Käyttötapaus: Uutiset, nopea staattinen scraping

- JS-tuki: Ei (vain HTML)

- Projektin kunto: Kohtalainen aktiivisuus (v2 beta)

- Datan vienti: Ei sisäänrakennettuna (käyttäjän määrittelemä)

- Kenelle: Node.js-kehittäjille, korkean rinnakkaisuuden tarpeisiin

- Vahvuudet: Asynkroninen crawlaus, rate limiting, tuttu jQuery-tyylinen API.

Asunnot, listaukset ja alisivujen scraping

- Yhteenveto: AI-pohjainen no-code web scraper liiketoimintakäyttäjille.

- Käyttöönotto: Plug & Play (Chrome-laajennus, 2 klikin käyttöönotto)

- Käyttötapaus: Kiinteistöt, verkkokauppa, myynti, markkinointi, mikä tahansa sivusto

- JS-tuki: Kyllä (AI tunnistaa dynaamisen sisällön automaattisesti)

- Projektin kunto: Jatkuvasti päivittyvä, hallinnoitu palvelu

- Datan vienti: Yhdellä klikkauksella Sheetiin, Airtableen, Notioniin, CSV:ksi, JSON:ksi

- Kenelle: Ei-teknisille käyttäjille, liiketoimintatiimeille, myyntiin ja markkinointiin

- Vahvuudet: AI “Suggest Fields”, alisivujen scraping, välitön vienti, onboarding, templatet, .

Akateeminen tutkimus & web-arkistointi

— 3k tähteä, 2023

- Yhteenveto: Internet Archiven web-mittakaavan arkistointicrawler.

- Käyttöönotto: Edistynyt (Java-sovellus, konfiguraatiotiedostot)

- Käyttötapaus: Web-arkistointi, domain-tason crawlit

- JS-tuki: Ei (vain haku)

- Projektin kunto: Ylläpidetty (hitaasti mutta varmasti)

- Datan vienti: WARC (web-arkistotiedostot)

- Kenelle: Arkistoille, kirjastoille, instituutioille

- Vahvuudet: Skaalautuva, luotettava, standardien mukainen. Ei kohdennettuun scrapingiin.

— 3k tähteä, 2024

- Yhteenveto: Open source -crawler big dataan ja hakukoneisiin.

- Käyttöönotto: Edistynyt (Java + Hadoop skaalaukseen)

- Käyttötapaus: Hakukonecrawlaus, big data

- JS-tuki: Ei (vain HTTP)

- Projektin kunto: Aktiivinen (Apache)

- Datan vienti: Raakasisältö tallennukseen/indeksiin

- Kenelle: Yrityksille, big data -tiimeille, akateemiseen tutkimukseen

- Vahvuudet: Plugin-arkkitehtuuri, hajautettu crawlaus.

Sosiaalinen media, dynaaminen sisältö ja automaatio

— ~30k tähteä, 2025

- Yhteenveto: Selainautomaatio scrapingiin ja testaukseen, tukee kaikkia yleisiä selaimia.

- Käyttöönotto: Kohtalainen (ajurit, useita kieliä)

- Käyttötapaus: JS-painotteiset sivut, testivirrat, sosiaalinen media

- JS-tuki: Kyllä (täysi selainautomaatio)

- Projektin kunto: Aktiivinen, kypsä

- Datan vienti: Ei (manuaalinen)

- Kenelle: QA-insinööreille, kehittäjille

- Vahvuudet: Monikielinen, simuloi oikeaa käyttäytymistä.

— 73.5k tähteä, 2025

- Yhteenveto: Moderni selainautomaatio scrapingiin ja E2E-testaukseen.

- Käyttöönotto: Kohtalainen (skriptaus useilla kielillä)

- Käyttötapaus: Modernit web-sovellukset, sosiaalinen media, automaatio

- JS-tuki: Kyllä (headless tai oikea selain)

- Projektin kunto: Erittäin aktiivinen

- Datan vienti: Ei (käyttäjä hoitaa)

- Kenelle: Kehittäjille, jotka tarvitsevat vahvaa selainkontrollia

- Vahvuudet: Cross-browser, auto-wait, verkon interceptointi.

— 90.9k tähteä, 2025

- Yhteenveto: Korkean tason API Chrome/Firefox-automaatioon.

- Käyttöönotto: Kohtalainen (Node-skriptaus)

- Käyttötapaus: Headless Chrome -scraping, dynaaminen sisältö

- JS-tuki: Kyllä (Chrome/Firefox)

- Projektin kunto: Aktiivinen (Chrome-tiimi)

- Datan vienti: Ei (koodissa räätälöity)

- Kenelle: Node.js-kehittäjille, front-end-ammattilaisille

- Vahvuudet: Laaja selainkontrolli, screenshotit, PDF, verkon interceptointi.

— 5.4k tähteä, kesäkuu 2025

- Yhteenveto: “Stealth”-henkinen, suorituskykyinen scraping anti-bot-ominaisuuksilla.

- Käyttöönotto: Kohtalainen (python scraper -tyyliin: Python-koodi)

- Käyttötapaus: Stealth-scraping, anti-bot, dynaamiset sivut

- JS-tuki: Kyllä (Playwright-integraatio)

- Projektin kunto: Aktiivinen, aivan kärjessä

- Datan vienti: Ei sisäänrakennettuna (manuaalinen)

- Kenelle: Python-kehittäjille, “hackereille”, data-insinööreille

- Vahvuudet: Stealth, proxyt, anti-blocking, async.

Tietoturvakartoitus

— 13.8k tähteä, 2025

- Yhteenveto: Nopea web-crawler tietoturvaan, automaatioon ja linkkien löytämiseen.

- Käyttöönotto: Kohtalainen (CLI-työkalu tai Go-kirjasto)

- Käyttötapaus: Tietoturvacrawlaus, endpointtien löytäminen

- JS-tuki: Kyllä (valinnainen headless-tila)

- Projektin kunto: Aktiivinen (ProjectDiscovery)

- Datan vienti: Tekstimuotoinen tuloste (URL-listat)

- Kenelle: Tietoturvatutkijoille, Go-kehittäjille

- Vahvuudet: Nopeus, rinnakkaisuus, headless-JS-parsinta.

Yleiskäyttö / monitoimi-scraping

— 24.3k tähteä, 2025

- Yhteenveto: Nopea ja elegantti scraping-framework Go:lle.

- Käyttöönotto: Kohtalainen (Go-koodi)

- Käyttötapaus: Suorituskykyinen yleisscraping

- JS-tuki: Ei (vain HTML)

- Projektin kunto: Aktiivinen, tuoreita committeja

- Datan vienti: Ei sisäänrakennettuna (käyttäjän määrittelemä)

- Kenelle: Go-kehittäjille, suorituskykyä hakeville

- Vahvuudet: Async, rate limiting, hajautettu scraping.

— 11.6k tähteä, 2023

- Yhteenveto: Joustava Java-crawler-framework Scrapy-tyyliin.

- Käyttöönotto: Kohtalainen (Java, helppo API)

- Käyttötapaus: Yleinen web scraping Javalla

- JS-tuki: Ei (laajennettavissa Seleniumilla)

- Projektin kunto: Aktiivinen yhteisö

- Datan vienti: Laajennettavat pipeline-ratkaisut

- Kenelle: Java-kehittäjille

- Vahvuudet: Thread pool, schedulerit, anti-blocking.

— 6.2k tähteä, 2025

- Yhteenveto: Nopea, natiivi HTML/XML-parseri Rubyyn.

- Käyttöönotto: Plug & Play (Ruby gem)

- Käyttötapaus: HTML/XML-parsinta Ruby-sovelluksissa

- JS-tuki: Ei (vain parsinta)

- Projektin kunto: Aktiivinen, pysyy Ruby-kehityksen mukana

- Datan vienti: Ei (muotoilu Rubylla)

- Kenelle: Ruby-kehittäjille, Rails-tekijöille

- Vahvuudet: Nopeus, standardienmukaisuus, turvallinen oletuksena.

Yhdellä silmäyksellä: ominaisuuksien vertailutaulukko

Tässä nopea skannaus – mukana myös Thunderbit vertailun vuoksi:

| Projekti | Käyttöönoton vaativuus | Käyttötapaus | JS-tuki | Ylläpito | Datan vienti | Kenelle | GitHub-tähdet |

|---|---|---|---|---|---|---|---|

| Scrapy | Kohtalainen | Verkkokauppa, uutiset | Ei | Aktiivinen | CSV, JSON, XML | Kehittäjät, data-insinöörit | 57.1k |

| Crawlee | Kohtalainen | Monipuolinen, automaatio | Kyllä | Erittäin aktiivinen | Joustavat datasetit | JS/TS-tiimit | 17.9k |

| MechanicalSoup | Plug & Play | Staattinen, lomakkeet | Ei | Kypsä | Ei (manuaalinen) | Python-aloittelijat | 4.8k |

| Node Crawler | Kohtalainen | Uutiset, staattinen | Ei | Kohtalainen | Ei (manuaalinen) | Node.js-kehittäjät | 6.8k |

| Selenium | Kohtalainen | JS-painotteinen, testaus | Kyllä | Aktiivinen | Ei (manuaalinen) | QA-insinöörit, kehittäjät | ~30k |

| Heritrix | Edistynyt | Arkistointi, tutkimus | Ei | Ylläpidetty | WARC | Arkistot, instituutiot | 3k |

| Apache Nutch | Edistynyt | Big data, haku | Ei | Aktiivinen | Raakasisältö | Yritykset, tutkimus | 3k |

| WebMagic | Kohtalainen | Java, yleinen | Ei | Aktiivinen yhteisö | Laajennettavat pipelinet | Java-kehittäjät | 11.6k |

| Nokogiri | Plug & Play | Ruby-parsinta | Ei | Aktiivinen | Ei (manuaalinen) | Ruby-kehittäjät | 6.2k |

| Playwright | Kohtalainen | Dynaaminen, automaatio | Kyllä | Erittäin aktiivinen | Ei (manuaalinen) | Kehittäjät, QA | 73.5k |

| Katana | Kohtalainen | Tietoturva, löydettävyys | Kyllä | Aktiivinen | Tekstituloste | Tietoturva, Go-kehittäjät | 13.8k |

| Colly | Kohtalainen | Suorituskyky, yleinen | Ei | Aktiivinen | Ei (manuaalinen) | Go-kehittäjät | 24.3k |

| Puppeteer | Kohtalainen | Dynaaminen, automaatio | Kyllä | Aktiivinen | Ei (manuaalinen) | Node.js-kehittäjät | 90.9k |

| Maxun | Helppo (käyttäjälle) | No-code, business | Kyllä | Aktiivinen | CSV, Excel, Sheets, API | Ei-tekniset, analyytikot | 13k |

| Scrapling | Kohtalainen | Stealth, anti-bot | Kyllä | Aktiivinen | Ei (manuaalinen) | Python-kehittäjät, “hackers” | 5.4k |

| Thunderbit | Plug & Play | No-code, business | Kyllä | Hallinnoitu, päivitetty | Sheets, Airtable, Notion | Ei-tekniset, business-käyttäjät | N/A |

Miksi Thunderbit on paras valinta ei-teknisille ja liiketoimintakäyttäjille

Useimmat open source -GitHub-projektit on tehty kehittäjiltä kehittäjille. Se tarkoittaa, että käyttöönotto, ylläpito ja vianetsintä tulevat “kaupan päälle”. Jos olet liiketoimintakäyttäjä, markkinoija, sales ops -tekijä tai haluat vain tulokset ilman regex-särkyä, Thunderbit on tehty sinulle.

Siksi Thunderbit erottuu:

- No-code + AI, aidosti helppoa: Asenna , klikkaa “AI Suggest Fields” ja scraping lähtee käyntiin. Ei Pythonia, ei selektoreita, ei “pip install” -draamaa.

- Dynaamisten sivujen tuki: Thunderbitin AI lukee ja poimii dataa moderneilta JavaScript-sivuilta (React, Vue, AJAX) ilman käsin tehtävää virittelyä.

- Alisivujen scraping: Tarvitsetko tiedot jokaisesta tuotteesta tai listauksesta? Thunderbitin AI voi avata alisivut ja yhdistää datan yhteen taulukkoon – ilman räätälöityä koodia.

- Liiketoimintavalmiit viennit: Yhden klikkauksen vienti Google Sheetiin, Airtableen, Notioniin, CSV:ksi tai JSON:ksi. Sopii liidien keruuseen, hintaseurantaan ja sisällön koontiin.

- Jatkuvat päivitykset & tuki: Thunderbit on hallinnoitu palvelu – ei “abandonware”-riskiä. Saat onboardingin, ohjeet ja kasvavan template-kirjaston yleisille sivustoille.

- Kenelle: Ei-teknisille käyttäjille, liiketoimintatiimeille ja kaikille, jotka arvostavat nopeutta ja luotettavuutta enemmän kuin koodin säätämistä.

Thunderbitiin luottaa yli 30 000 käyttäjää ympäri maailmaa, mukaan lukien tiimit Accenturella, Grammarlylla ja Pumalla. Ja kyllä – olemme olleet myös Product Huntin #1 Product of the Week.

Jos haluat nähdä, miten helppoa scraping voi olla, .

Yhteenveto: oikean web scraping -ratkaisun valinta vuodelle 2025

Ydinviesti: GitHub on aarreaitta tehokkaita scraping-työkaluja, mutta suurin osa niistä on suunniteltu kehittäjille. Jos pidät koodaamisesta, Scrapy, Crawlee, Playwright ja Colly tarjoavat maksimaalisen kontrollin. Jos olet akatemiassa tai tietoturvassa, Heritrix, Nutch ja Katana ovat vahvoja valintoja.

Mutta jos olet liiketoimintakäyttäjä, analyytikko tai kuka tahansa, joka haluaa datan nopeasti – rakenteisena ja käyttövalmiina – Thunderbit on selkein reitti. Ei asennussäätöä, ei ylläpitoa, ei koodia. Vain tulokset.

Mitä seuraavaksi? Kokeile GitHub-projektia, joka sopii taitotasollesi ja käyttötapaukseesi. Tai jos haluat ohittaa oppimiskäyrän ja nähdä tulokset minuuteissa, ja aloita scraping jo tänään.

Jos haluat syventyä web scrapingiin lisää, tutustu muihin oppaisiin , kuten tai .

Hyviä scraping-hetkiä – ja toivottavasti datasi on aina rakenteista, siistiä ja valmista käyttöön. Ja jos joskus jumitat, muista: siihen löytyy todennäköisesti GitHub-repo… tai voit antaa Thunderbitin AI:n hoitaa homman puolestasi.