CRM-järjestelmäsi on lopulta juuri niin hyvä kuin se data, jota sinne syötät. Ja usein se paras, tuorein tieto löytyy ihan julkisilta verkkosivuilta — ei kalliista kolmannen osapuolen tietokannoista.

verkkodatan poimija -työkalut muuttavat sen verkkosivujen sekamelskan siisteiksi taulukoiksi. Parhaat hoitavat homman minuuteissa, ilman koodausta.

Olen käyttänyt näitä työkaluja oikeissa projekteissa — liidilistojen rakentamisessa, kilpailijahintojen seurannassa ja tuotekatalogien keräämisessä. Tässä 12 työkalua, jotka selvisivät käytännön testistä, järjestettynä sen mukaan, miten hyvin ne toimivat aidossa bisneskäytössä.

Miksi verkkodatan poimijat ovat yrityksille välttämättömiä

Puhutaan suoraan: verkko on maailman suurin (ja sotkuisin) tietokanta. Vuonna 2026 etumatkaa ottavat ne yritykset, jotka osaavat muuttaa tämän sotkun oivalluksiksi. mukaan dataohjautuvat yritykset ovat 5 % tuottavampia ja 6 % kannattavampia kuin verrokkinsa. Se ei ole mikään pikkusäätö — se on ihan oikea kilpailuetu.

verkkodatan poiminta -työkalut (joista käytetään myös nimityksiä web page extractor tai web extracting -ratkaisu) ovat tässä se “salainen kastike”. Ne auttavat myyntitiimejä keräämään dataa julkisista hakemistoista, sosiaalisesta mediasta ja yritysten sivuilta kohdennettujen prospektilistojen rakentamiseen — ilman vanhentuneiden liidilistojen ostamista tai sitä, että harjoittelija palaa loppuun copy-paste-rumbassa (). Markkinointi- ja verkkokauppatiimit taas hyödyntävät poimijoita kilpailijahintojen seurantaan, varastotilanteen tarkkailuun ja tuotteiden vertailuun reaaliajassa — John Lewis esimerkiksi kertoo web scrapingin tuoneen 4 % myynnin kasvun pelkästään fiksumman hinnoittelun ansiosta ().

Kyse ei ole vain numeroista. verkkodatan poimija säästää järjettömästi aikaa (yksi käyttäjä kertoi säästäneensä “satoja tunteja” automatisoimalla datankeruun) ja vähentää inhimillisiä virheitä (). Operatiiviset tiimit voivat nyt rakentaa poimintoja, jotka keräävät dataa jatkuvasti — sellaista, jonka kokoamiseen harjoittelijoilta olisi mennyt viikkoja — ja vapauttaa aikaa, joka aiemmin kului puuduttavaan kopiointiin (). Ja tekoälypohjaisten poimijoiden ansiosta myös ei-tekniset käyttäjät voivat muuttaa verkkosivut rakenteiseksi dataksi analysointia varten ().

Yhteenveto? Jos et hyödynnä verkkodatan poimijaa vuonna 2026, jätät todennäköisesti oivalluksia (ja rahaa) pöydälle.

Miten valitsimme 12 parasta verkkodatan poimijaa

Kun verkkodatan poiminta -työkaluja on joka lähtöön, miten valita se oikea? Kävin läpi kymmeniä vaihtoehtoja, mutta vain 12 pääsi tälle listalle. Näihin asioihin keskityin:

- Helppokäyttöisyys: Pääseekö ei-tekninen käyttäjä nopeasti alkuun ilman koodausta? Painotin no-code- ja low-code-työkaluja, joissa on selkeä käyttöliittymä ().

- Tekoälyominaisuudet: Uuden sukupolven työkalut, joissa AI helpottaa poimintaa — esimerkiksi kenttien automaattinen tunnistus, sivuston navigoinnin käsittely tai mahdollisuus kuvata tarve tavallisella kielellä ().

- Automaatio ja ajastus: Parhaat poimijat pyörivät käytännössä “autopilotilla”. Valitsin työkaluja, jotka tukevat ajastettuja poimintoja ja sivustojen seurantaa ().

- Vienti ja integraatiot: Onko data helppo viedä Exceliin, Google Sheetsiin, Airtableen tai Notioniin? Plussaa työnkulkuintegraatioista ().

- Skaalautuvuus ja luotettavuus: Toimivatko työkalut yhtä hyvin yhdellä sivulla kuin tuhansilla? Huomioin myös käyttäjäarviot luotettavuudesta.

- Bisneslähtöiset käyttötapaukset: Korostin työkaluja, joita käyttävät myynti-, markkinointi-, verkkokauppa- ja operatiiviset tiimit — ei vain kehittäjät.

Osa työkaluista on uusia AI-vetoisia tulokkaita, osa alan klassikoita. Kaikki on tehty auttamaan sinua muuttamaan verkko omaksi yritystietokannaksesi — ilman turhaa päänvaivaa.

Pikavertailu: verkkodatan poimintatyökalut yhdellä silmäyksellä

Tässä nopea kooste 12 työkalusta, jotta näet heti, miten ne asettuvat rinnakkain:

| Työkalu | AI-automaatio | Helppokäyttöisyys | Paras käyttötapaus |

|---|---|---|---|

| Thunderbit | Kyllä – AI ehdottaa kenttiä ja hoitaa sivut automaattisesti | Erittäin helppo (Chrome-laajennus, ei koodia) | Nopea poiminta liideihin, hintoihin ym. ei-teknisille käyttäjille, jotka haluavat tulokset minuuteissa. |

| Octoparse | Rajallinen (mallipohjainen, ei AI:ta) | Helppo useimmille (visuaalinen drag-and-drop) | Räätälöidyt poimintatyönkulut (kirjautumiset, sivutus) analyytikoille, jotka haluavat kontrollia ilman koodausta. |

| Browse AI | Osittain – point-and-click “robotit” | Helppo (no-code, pilvipohjainen) | Ajastettu datan seuranta (hinnat, listaukset jne.), hälytykset ja integraatiot. |

| WebScraper.io | Ei (manuaalinen määritys) | Keskitaso (selainlaajennus ja sitemap-asetus) | Visuaalinen poiminta monitasoisilta sivustoilta käyttäjille, jotka jaksavat määrittää vaiheet. |

| ScraperAPI | Ei sovellu (API-palvelu, hoitaa proxyt API:n kautta) | Vaatii koodausta (API-integraatio) | Suurivolyymiset poiminnat teknisille tiimeille — proxyt ja CAPTCHA:t hoidettu suurissa ajoissa. |

| Data Miner | Ei | Erittäin helppo (selainlaajennus ja yhden klikkauksen mallit) | Nopeat kertapoiminnat sivuilta (erityisesti taulukot/listat) suoraan CSV/Exceliin. |

| Simplescraper | Ei (joitain AI-avusteisia ominaisuuksia) | Helppo (point-and-click reseptirakentaja) | No-code-poiminta integraatioilla — erinomainen, kun data halutaan Google Sheetsiin, Airtableen tai API:in. |

| Instant Data Scraper | Kyllä – tunnistaa taulukot automaattisesti | Erittäin helppo (klikkaa ja valmis) | Välitön ilmainen HTML-taulukoiden ja listojen poiminta kenelle tahansa (hyvä nopeisiin nostoihin). |

| ScrapeStorm | Kyllä – AI tunnistaa sivuelementit | Helppo (visuaalinen käyttöliittymä; monialustainen sovellus) | Laajat tai monimutkaiset poimintaprojektit ilman koodausta, myös ajastetut crawl-ajot. |

| Apify | Jonkin verran – valmiita “actor”-botteja | Keskitaso (web-käyttöliittymä; koodaus valinnainen) | Skaalautuva pilvipoiminta ja automaatio valmiilla tai räätälöidyillä skripteillä. |

| ParseHub | Ei (ei skriptejä, mutta manuaalinen asetus) | Helppo peruskäytössä (visuaalinen editori; desktop-sovellus) | Dynaamisten tai monimutkaisten sivustojen (AJAX) poiminta no-code-käyttöliittymällä. |

| OutWit Hub | Ei | Helppo (desktop-GUI) | Yksinkertainen offline-poiminta ja sisällön arkistointi pieniin projekteihin. |

Useimmissa työkaluissa on ilmainen taso tai kokeilu sekä porrastetut tilaukset. Tässä keskitytään ominaisuuksiin ja käyttötapauksiin, ei hintaan.

Thunderbit: tekoälyllä toimiva verkkodatan poimija kaikille

Aloitetaan Thunderbitillä — kyllä, se on “oma lapseni”, mutta anna mun perustella. verkkodatan poiminta on selvästi siirtymässä mallista “rakenna ja konfiguroi oma scraper” malliin “kerro tekoälylle mitä haluat”. Thunderbit on ensimmäinen työkalu, jonka olen nähnyt (ja ollut rakentamassa), joka tuntuu aidosti AI-data-assistentilta eikä vain yhdeltä crawlerilta lisää.

et joudu säätämään XPathien, CSS-selektoreiden tai regexien kanssa. Kerrot vain tavallisella kielellä, mitä haluat — esimerkiksi “poimi otsikko, kirjoittaja ja päivämäärä tältä sivulta” — ja Thunderbitin AI hoitaa loput (). Klikkaa “AI Suggest Fields”, ja Thunderbit lukee sivun, ehdottaa sarakkeet ja hoitaa myös alasivut sekä sivutuksen automaattisesti ().

Kyse ei ole vain datan nappaamisesta. Thunderbit pystyy siivoamaan, muuntamaan, luokittelemaan ja jopa kääntämään kenttiä poiminnan aikana. Haluatko standardoida puhelinnumerot, tiivistää kuvaukset tai kääntää tuotenimet? Lisää vain lyhyt ohje, ja AI tekee työn. Valmiin datan voit viedä suoraan Exceliin, Google Sheetsiin, Airtableen tai Notioniin ().

Thunderbitin suurin ero on nollasäätö ja olematon oppimiskynnys. Se on Chrome-laajennus, joten pääset liikkeelle sekunneissa. Ei lisäosia, ei konfigurointia, ei teknistä jargonia. Siksi se on suosikki myynnin, markkinoinnin ja operatiivisten tiimien keskuudessa, kun tuloksia tarvitaan nopeasti (). Ilmainen taso antaa kokeilla koko työnkulun, ja maksulliset paketit ovat useimmille tiimeille aidosti järkevän hintaisia.

Jos haluat nähdä, miltä AI-avusteinen verkkodatan poiminta tuntuu käytännössä, ja testaa. Copy-paste-aikakausi voi oikeasti olla ohi.

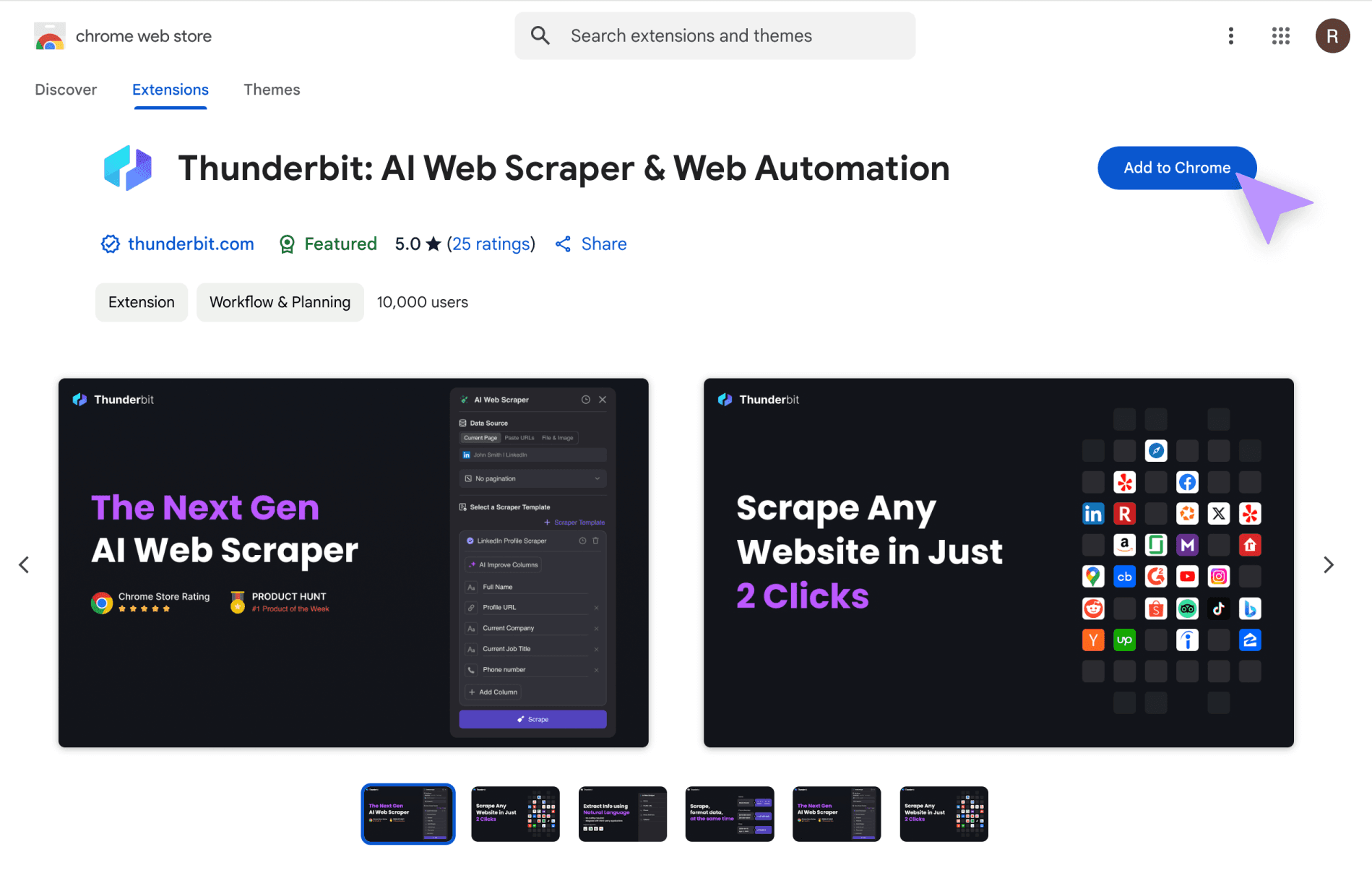

Octoparse: visuaalinen verkkodatan poimija räätälöityihin työnkulkuihin

Octoparse on visuaalisen web scrapingin klassikko. Se on desktop-sovellus, jossa on point-and-click-käyttöliittymä: käyt sivulla, valitset haluamasi datan ja Octoparse rakentaa taustalle työnkulun (). Se hoitaa kirjautumiset, sivutuksen ja jopa lomakkeiden automaation ilman koodausta.

Octoparsen vahvuus on 500+ valmiin mallin kirjasto suosittuihin sivustoihin (Amazon, Twitter, LinkedIn jne.), joten usein pääset alkuun lataamalla mallin ja poimimalla datan saman tien (). Monimutkaisemmissa tapauksissa voit siirtyä manuaalitilaan ja määrittää vaiheet visuaalisesti. Octoparse tukee klikkausten tai scrollauksen jälkeen latautuvaa sisältöä, ja se voi käyttää proxyja sekä ratkaista CAPTCHA-haasteita. Lisäksi tarjolla on pilviajo ajastuksiin ja skaalaukseen.

Miinuspuoli? Oppimiskynnystä on jonkin verran, etenkin edistyneissä skenaarioissa. Mutta ei-koodaaville analyytikoille, jotka haluavat räätälöidyn poimintatyönkulun ilman ohjelmointia, Octoparse on varma valinta ().

Browse AI: automatisoitu verkkodatan poiminta valmiilla roboteilla

Browse AI:n idea on aika nerokas: “koulutat robotin” osoittamalla ja klikkaamalla haluamasi datan, ja se oppii poimimaan samaa dataa vastaavilta sivuilta (). Kaikki toimii pilvessä ja ilman koodia.

Browse AI erottuu automaatiolla ja seurannalla. Voit ajastaa robotit pyörimään säännöllisesti ja saada hälytyksiä, kun data muuttuu (esim. kilpailija laskee hintaa tai uusi työpaikkailmoitus ilmestyy). Lisäksi tarjolla on kirjasto valmiita robotteja yleisiin tarpeisiin, joten usein pääset liikkeelle valmiilla pohjalla ja hienosäädät tarpeen mukaan ().

Browse AI integroituu tuhansiin sovelluksiin Zapierin ja Maken kautta, ja dataa voi viedä suoraan Google Sheetsiin tai API/webhookien avulla (). Se sopii erityisesti jatkuvaan seurantaan ja toistuviin poimintoihin, kun haluat mahdollisimman hands-off-tyylisen ratkaisun.

WebScraper.io: selainpohjainen web page extractor

WebScraper.io (usein vain “Web Scraper”) on selainlaajennus, jolla rakennat “sitemappeja” — visuaalisia suunnitelmia siitä, miten sivustolla liikutaan ja mitä elementtejä poimitaan (). Määrität selektorit datalle ja linkit, joita seurataan (esim. “seuraava”-painike sivutukseen tai tuotelinkit lisätietoihin).

Oppimiskynnystä on, mutta et kirjoita koodia — valitset elementit ja määrität toiminnot. Web Scraper tukee monitasoista navigointia, sivutusta ja myös infinite scrollia (vaiheet pitää kuitenkin määrittää itse). Koska se pyörii selaimessa, voit poimia myös kirjautumisen takaa, kun kirjaudut itse sisään.

WebScraper.io sopii “kansalaisanalyytikoille”, jotka ymmärtävät sivurakenteita ja haluavat ilmaisen, joustavan työkalun. Luotettava perusratkaisu, jos jaksat rakentaa omat sitemapit.

ScraperAPI: API-lähtöinen verkkodatan poimija kehittäjille ja tiimeille

Kaikki tiimit eivät halua point-and-click-käyttöliittymää — joskus tarvitaan taustaratkaisu, joka syöttää verkkodatan suoraan sovelluksiin tai tietokantoihin. ScraperAPI on API-first web extractor: annat URL:n, ja se palauttaa raaka-HTML:n tai poimitun datan, hoitaen puolestasi proxyt, maakohtaisen IP-kierron, headless-selaimet ja CAPTCHA:t ().

ScraperAPI:lla on yli 40 miljoonan proxyn pooli 50+ maassa ja se käsittelee 36 miljardia pyyntöä kuukaudessa (). Se on parhaimmillaan laajamittaisessa, automatisoidussa poiminnassa, jossa luotettavuus ja blokkausten välttäminen ovat kriittisiä. Käyttö vaatii koodausta, mutta jos rakennat dataputkia tai integroit poiminnan tuotteeseesi, ScraperAPI on vahva valinta.

Data Miner: Chrome-laajennus nopeaan web page extracting -tarpeeseen

Data Miner on Chrome-laajennus, joka on tehty yrityskäyttäjille ja tutkijoille, jotka tarvitsevat dataa nopeasti. Se tarjoaa point-and-click-poiminnan ja kirjaston valmiita “reseptejä” yleisiin rakenteisiin kuten taulukot, listat tai tietyt sivustot ().

Asenna laajennus, avaa kohdesivu ja klikkaa Data Miner -ikonia. Valitse resepti tai tee oma valitsemalla elementit sivulta. Erinomainen kertaluonteisiin tehtäviin ja nopeisiin tarpeisiin — esimerkiksi myyjä kerää liidilistan hakemistosta tai verkkokauppapäällikkö kopioi kilpailijahinnat.

Data Miner on yksinkertainen, selaimeen integroitu ja sopii interaktiiviseen, tarpeen mukaan tehtävään poimintaan.

Simplescraper: no-code-verkkodatan poimija nopeisiin tuloksiin

Simplescraper on nimensä mukainen. Se on no-code Chrome-laajennus (ja web-sovellus), jossa valitset datan visuaalisesti ja luot “reseptin” poimintaa varten (). Voit seurata linkkejä alasivuille, hoitaa sivutuksen ja jopa muuttaa poiminnan API-endpointiksi yhdellä klikkauksella.

Simplescraper loistaa integraatioissa — data voidaan lähettää suoraan Google Sheetsiin, Airtableen tai työkaluihin kuten Zapier (). Tarjolla on myös pilvipoiminta ja ajastus toistuviin ajoihin sekä “AI Enhance” -ominaisuus datan siivoamiseen tai analysointiin GPT:n avulla.

Jos haluat nopeat tulokset ja helpot integraatiot, Simplescraper on kevyt mutta monipuolinen työkalu.

Instant Data Scraper: salamannopea poiminta taulukoista ja listoista

Joskus tarvitset datan heti ilman mitään säätöä. Silloin Instant Data Scraper (IDS) on paikallaan. Se on ilmainen Chrome-laajennus, joka tunnetaan yhden klikkauksen taulukko- ja listapoiminnoista (). Aktivoi laajennus, ja IDS tunnistaa automaattisesti sivun taulukot tai listat. Se hoitaa usein myös sivutuksen ja infinite scrollin klikkaamalla sivut läpi automaattisesti.

IDS on 100 % ilmainen: ei rekisteröitymistä, ei koodausta, ei odottelua. Täydellinen satunnaisiin tai kiireellisiin poimintoihin — esimerkiksi myyjä nappaa nopeasti liidilistan tai opiskelija kerää dataa Wikipedian taulukoista. Jos IDS löytää datasi, saat sen sekunneissa.

ScrapeStorm: pilvipohjainen verkkodatan poimija AI-avustuksella

ScrapeStorm on AI-pohjainen web scraping -työkalu, joka yhdistää visuaalisen käyttöliittymän ja tehokkaat algoritmit (). Syötät URL:n, ja AI tunnistaa automaattisesti datakentät — listat, taulukot, seuraava-sivu-painikkeet ja paljon muuta.

ScrapeStorm toimii useilla alustoilla (Windows, Mac, Linux) ja tarjoaa sekä desktop- että pilviajon. Voit ajastaa tehtäviä, ajaa useita töitä rinnakkain ja viedä datan Exceliin, CSV:hen, JSONiin tai jopa tietokantaan (). Se on suosittu erityisesti verkkokaupassa ja markkinatutkimuksessa, ja se voi AI:n avulla poimia dataa myös kuvista tai PDF:istä.

Jos tarvitset älykkään avustajan laajoihin tai monimutkaisiin projekteihin, ScrapeStorm kannattaa testata.

Apify: verkkodatan poiminnan markkinapaikka ja automaatioalusta

Apify ei ole pelkkä scraper — se on web scraping- ja automaatioalusta. Voit ajaa “actoreita”, eli skriptejä poimintaan tai selaimen automaatioon. Apifyn valtti on valmiiden actorien markkinapaikka yleisiin tarpeisiin (). Haluatko poimia kaikki arvostelut verkkokaupasta? Todennäköisesti siihen löytyy actor.

Kehittäjille Apify mahdollistaa omien poimijoiden kirjoittamisen Node.js:llä tai Pythonilla ja niiden ajamisen pilvessä. Se on skaalautuva, automatisoitava ja API-integroituva. Apify sopii parhaiten tehokäyttäjille ja organisaatioille, jotka pitävät verkkodataa strategisena resurssina — jatkuvaan, laajamittaiseen poimintaan tai dataputkiin integrointiin.

ParseHub: visuaalinen web page extractor monimutkaisille sivustoille

ParseHub on desktop-sovellus (pilvivaihtoehdoilla), joka tunnetaan kyvystään käsitellä monimutkaisia ja dynaamisia sivustoja. Navigoit sivustolla selainmaisessa näkymässä, klikkaat datapisteitä ja ParseHub rakentaa poimijan (). Se tukee ehtologiikkaa, sisäkkäistä poimintaa, AJAX-sisältöä ja muuta.

ParseHub on usein se vaihtoehto, kun muut työkalut eivät saa sivua poimittua oikein. Sitä käyttävät tutkijat, analyytikot ja pienyrittäjät, jotka joutuvat käsittelemään hankalia sivustoja. Oppimiskynnystä on, mutta jos sinulla on vaikea sivusto poimittavana etkä halua koodata, ParseHub on vahva valinta.

OutWit Hub: desktop-verkkodatan poimija sisällön arkistointiin

OutWit Hub on vähän old school, mutta se on desktop-sovellus, joka sopii hyvin monenlaisen sisällön (linkit, kuvat, sähköpostiosoitteet jne.) keräämiseen ja järjestämiseen (). Se toimii kuin selain ja taulukkolaskenta samassa paketissa: avaat sivun, ja OutWit Hub voi poimia taulukot, listat, kuvat ja paljon muuta.

Se on erityisen kätevä sisällön arkistointiin ja tutkimukseen — esimerkiksi foorumin kaikkien viestien keräämiseen tai tiedostokokoelman lataamiseen. Koska se on desktop-työkalu, ajat sen paikallisesti ja pidät datan omissa käsissäsi. OutWit Hub sopii parhaiten pieniin ja keskisuuriin poimintoihin, kun haluat selkeän työpöytäkäyttöliittymän.

Mikä verkkodatan poimija sopii sinulle parhaiten?

12 työkalua, loputtomasti käyttötapauksia. Tässä oma “lunttilappuni” valintaan:

-

Täysin aloittelijoille tai nopeisiin kertatarpeisiin:

Kokeile Instant Data Scraperia perustaulukoihin ja listoihin (ilmainen ja välitön). Data Miner on toinen helppo vaihtoehto, jossa on enemmän malleja, jos poimit usein samantyyppisiä sivuja.

-

Ei-teknisille käyttäjille, jotka tarvitsevat jatkuvaa poimintaa tai integraatioita:

Thunderbit tarjoaa helpoimman työnkulun AI-lähtöisellä lähestymistavalla — täydellinen bisneskäyttäjille, jotka haluavat tulokset nopeasti ja usein. Browse AI sopii jatkuvaan seurantaan ja hälytyksiin. Simplescraper on hyvä, jos haluat datan virtaavan Google Sheetsiin tai sisäiseen sovellukseen API:n kautta.

-

Monimutkaisille sivustoille tai räätälöityihin työnkulkuihin ilman koodausta:

Valitse visuaalinen työkalu kuten Octoparse tai ParseHub. Octoparse on helppokäyttöinen ja sisältää paljon malleja. ParseHub selviää erittäin dynaamisista sivustoista ja tarjoaa tarkkaa kontrollia. Myös WebScraper.io on hyvä, jos olet valmis rakentamaan omat sitemapit.

-

Kehittäjille tai data-insinööreille, jotka tarvitsevat skaalan:

ScraperAPI on tehty web scrapingin upottamiseen ohjelmistoihin tai suuriin projekteihin. Apify on erinomainen, kun tarvitset skaalautuvan alustan ja markkinapaikan valmiille tai räätälöidyille skripteille.

-

Sisältöpainotteiseen poimintaan tai offline-käyttöön:

OutWit Hub on hyvä valinta sisällön järjestelmälliseen keräämiseen ja arkistointiin, etenkin jos haluat desktop-työkalun yksityisyyden tai kontrollin vuoksi.

Moni tiimi käyttää ihan rehellisesti useampaa työkalua tilanteen mukaan. Voit aloittaa Instant Data Scraperilla yksinkertaisessa tapauksessa, siirtyä Thunderbitiin tai Octoparseen laajemmassa projektissa ja käyttää ScraperAPI:a tai Apifya, kun prosessi pitää “teollistaa”. Hyvä uutinen: useimmissa on ilmainen taso tai kokeilu, joten voit testata rauhassa.

Yhteenveto: verkkodatan poiminnan tulevaisuus bisnestiimeille

verkkodatan poiminta -työkalut ovat kehittyneet valtavasti. Vuonna 2026 ne ovat jo arkipäivää. Suurin trendi? Web scraping muuttuu helpommaksi, automaattisemmaksi ja tiiviimmin osaksi päivittäisiä työnkulkuja (). AI-vetoiset poimijat tarkoittavat, että myös monimutkaiset ja dynaamiset sivustot saadaan hallintaan ilman erikoisosaamista. Kuten eräs data-insinööri kuvasi: “Kun AI web scraping -työkalut tulivat markkinoille, pystyin tekemään tehtävät paljon nopeammin ja suuremmassa mittakaavassa... ja AI:n ansiosta [datan siivous] sisältyy automaattisesti työnkulkuuni.”

Toinen iso muutos on rajan hämärtyminen poiminnan, seurannan ja automaation välillä. Työkalut kuten Browse AI ja Thunderbit eivät vain kerää dataa, vaan pitävät sen ajan tasalla ja voivat jopa tehdä toimintoja (kuten täyttää lomakkeita tai laukaista hälytyksiä). Käyttöönotto kasvaa oikeasti — yksi suuri alusta raportoi kuukausittaisten aktiivisten käyttäjien kasvaneen yli 140 % vuodessa (). Eri kokoiset yritykset ymmärtävät, että julkisen verkkodatan hyödyntäminen (eettisesti ja lainmukaisesti) on keskeistä kilpailukyvylle.

Bisnestiimeille tärkein viesti on voimaantuminen. Sinun ei tarvitse odottaa viikkoja kehittäjää tai tehdä päätöksiä mututuntumalla. Tämän listan työkalut tuovat verkkodatan hyödynnettäväksi suoraan myynnin, markkinoinnin, operaatioiden ja muiden tiimien käsiin — käyttöliittymillä ja ominaisuuksilla, jotka on tehty oikeisiin arjen tarpeisiin. Ja kehityksen vauhdilla odotan lähiaikoina entistä helpompia käyttöliittymiä, fiksumpaa AI:ta ja syvempiä integraatioita BI- ja analytiikka-alustoihin.

Muista kuitenkin: kunnioita sivustojen käyttöehtoja ja robots.txt-sääntöjä, ja varmista, että noudatat tietosuojalainsäädäntöä. Eettinen poiminta on tärkeää, jotta nämä käytännöt ovat kestäviä.

Olitpa liikkeellä ilmaisella laajennuksella tai rakentamassa yritystason poimintakapasiteettia, nyt on paras hetki muuttaa verkon tieto käytännön teoiksi. Verkkodatan poiminnan vallankumous on täällä — valitse työkalu, kokeile ja ota käyttöön arvo, joka piiloutuu silmien eteen. Dataohjattu tulevaisuutesi on yhden klikkauksen päässä.

UKK

1. Mikä on verkkodatan poimija ja miksi se on tärkeä yrityksille?

verkkodatan poimija on työkalu, joka kerää verkkosivuilta automaattisesti rakenteista dataa. Se on tärkeä, koska sen avulla yritys voi muuttaa hajanaisen verkkotiedon konkreettisiksi oivalluksiksi — parantaa tuottavuutta, kasvattaa kannattavuutta ja poistaa manuaalisen datankeruun.

2. Kuka voi käyttää verkkodatan poimijoita — tarvitaanko teknistä osaamista?

Monet modernit verkkodatan poimijat eivät vaadi teknistä osaamista. Työkalut kuten Thunderbit, Browse AI ja Instant Data Scraper on suunniteltu ei-teknisille käyttäjille: selkeät käyttöliittymät, AI-automaatio ja no-code-työnkulut.

3. Miten myynti-, markkinointi- ja operatiiviset tiimit hyötyvät verkkodatan poimijoista?

Myynti voi rakentaa liidilistoja verkkohakemistoista, markkinointi voi seurata kilpailijahintoja ja operatiiviset tiimit voivat automatisoida datankeruun prosesseja. Työkalut säästävät aikaa, vähentävät virheitä ja tarjoavat tuoreita, luotettavia oivalluksia päätöksenteon tueksi.

4. Mitä kannattaa huomioida verkkodatan poimijaa valitessa?

Tärkeitä kriteerejä ovat helppokäyttöisyys, AI-ominaisuudet, automaatio/ajastus, integraatiot (esim. Google Sheets tai Airtable), skaalautuvuus sekä sopivuus omaan käyttötapaukseen (liidit, hintaseuranta, sisällön arkistointi jne.).

5. Onko saatavilla ilmaisia tai edullisia verkkodatan poimijoita?

Kyllä. Monissa työkaluissa on ilmainen taso tai edulliset paketit. Instant Data Scraper on täysin ilmainen perustarpeisiin, ja Thunderbit, Simplescraper sekä Data Miner tarjoavat reilut ilmaiset paketit, joita voi tarvittaessa päivittää.

Haluatko oppia lisää verkkodatan poiminnasta, AI-scrapingista tai siitä, miten verkkosivut voivat olla tiimisi seuraava kilpailuetu? Tutustu — löydät lisää oppaita, vinkkejä ja tosielämän esimerkkejä data-automaation arjesta.