Viime kvartaalilla meidän ops-tiimi käytti 40 tuntia viikossa kilpailijadatan kopiointiin ja liittämiseen taulukoihin. Tällä kvartaalilla sama homma vie 20 minuuttia.

Mikä muuttui? automatisoidut web scraping -työkalut. Ne ovat siirtyneet kehittäjien “vain nörteille” -erikoisvehkeistä sellaisiksi, joita kuka tahansa myyjä tai markkinoija pystyy ottamaan käyttöön lounastauolla.

Olen rakentanut SaaS- ja automaatiotyökaluja vuosia (ja kyllä, olen yksi in perustajista). Vuoden 2026 työkalusukupolvi on tähän mennessä kovin: AI-natiivi, itsekorjautuva ja oikeasti myös ei-teknisten käyttäjien hyödynnettävissä.

Tässä 10 työkalua, joita olen testannut käytännössä ja vertaillut käyttötapauksen sekä osaamistason mukaan.

Miksi automatisoidut web scraping -työkalut ovat tärkeitä liiketoimintakäyttäjille

Myönnetään: manuaalisen kopioi–liitä-työn aika on ohi (ellei sitten nauti rannevaivoista ja eksistentiaalisesta ahdistuksesta). Automatisoiduista web scraping -työkaluista on tullut kriittisiä lähes kaikenkokoisille yrityksille. Itse asiassa , ja web scraping on monelle olennainen osa tätä strategiaa.

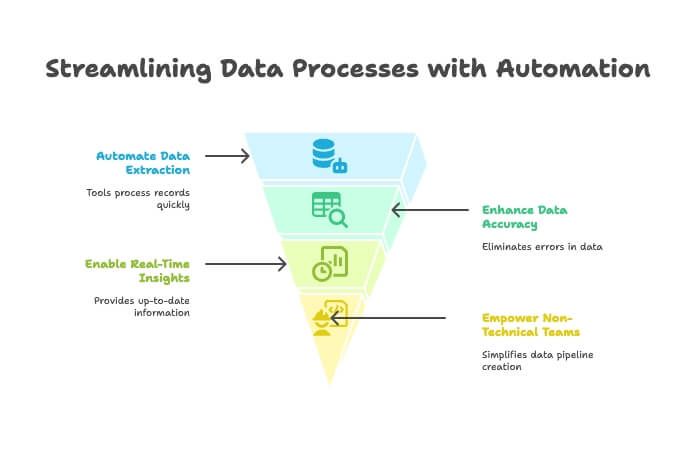

Siksi nämä työkalut ovat niin arvokkaita:

- Säästää aikaa ja vähentää käsityötä: Automatisoidut scrapers voivat käsitellä tuhansia rivejä minuuteissa ja vapauttaa tiimin arvokkaampiin tehtäviin. Eräs käyttäjä kertoi säästäneensä “satoja tunteja” automatisoimalla datankeruun ().

- Parantaa datan tarkkuutta: Ei enää kirjoitusvirheitä tai puuttuvia rivejä. Automaattinen datan poiminta tuottaa siistimpää ja luotettavampaa dataa.

- Nopeuttaa päätöksentekoa: Reaaliaikaisilla datasyötteillä seuraat kilpailijoita, hintatasoa tai rakennat liidilistoja ilman, että odotat kuukausittaista harjoittelijaraporttia.

- Mahdollistaa ei-teknisille tiimeille: No-code- ja AI-vetoisten työkalujen ansiosta myös ne, joiden mielestä “XPath” kuulostaa joogaliikkeeltä, voivat rakentaa web-dataputkia ().

Ei ole ihme, että , ja lähes 80 % sanoo, ettei organisaatio toimisi tehokkaasti ilman sitä. Vuonna 2026, jos et automatisoi datankeruuta, jätät todennäköisesti rahaa — ja oivalluksia — pöydälle.

Miten valitsimme parhaat automatisoidut web scraping -työkalut

Kun web scraping -ohjelmistomarkkinan ennustetaan , oikean työkalun valinta voi tuntua samalta kuin kenkien ostaminen liikkeestä, jossa on 10 000 vaihtoehtoa. Näin rajasin listan:

- Helppokäyttöisyys: Pääseekö ei-kehittäjä nopeasti alkuun? Onko oppimiskynnys korkea?

- AI-ominaisuudet: Tunnistaako työkalu kentät automaattisesti, selviääkö dynaamisista sivuista tai voiko tarpeen kuvata tavallisella kielellä?

- Vienti ja integraatiot: Kuinka helposti data siirtyy Exceliin, Google Sheetsiin, Airtableen, Notioniin tai CRM:ään?

- Hinnoittelu: Onko ilmainen kokeilu? Ovatko maksulliset paketit järkeviä yksilöille ja pienille tiimeille vai vain enterprise-tasoa?

- Skaalautuvuus: Hoitaako sekä pienet kertapoiminnat että isot ajastetut ajot?

- Kohdekäyttäjä: Onko tehty liiketoimintakäyttäjille, kehittäjille vai molemmille?

- Uniikit vahvuudet: Mikä erottaa työkalun muista?

Mukana on vaihtoehtoja kaikille osaamistasoille — “haluan vain taulukon” -tyypistä “haluan indeksoida koko internetin” -tasolle. Mennään listaan.

1. Thunderbit: AI Web Scraper kaikille

Aloitan työkalusta, jonka tunnen parhaiten — koska tiimini kanssa rakensimme sen ratkaisemaan juuri ne päänsäryt, joita olen nähnyt liiketoimintakäyttäjillä vuosien ajan. ei ole perinteinen “vedä ja pudota” tai “kirjoita omat selektorit” -scraper. Se on AI-pohjainen data-avustaja: kerrot mitä haluat, ja se hoitaa raskaan työn — ilman koodia, ilman XPath-säätöä, ilman tuskaa.

Miksi Thunderbit on listan kärjessä

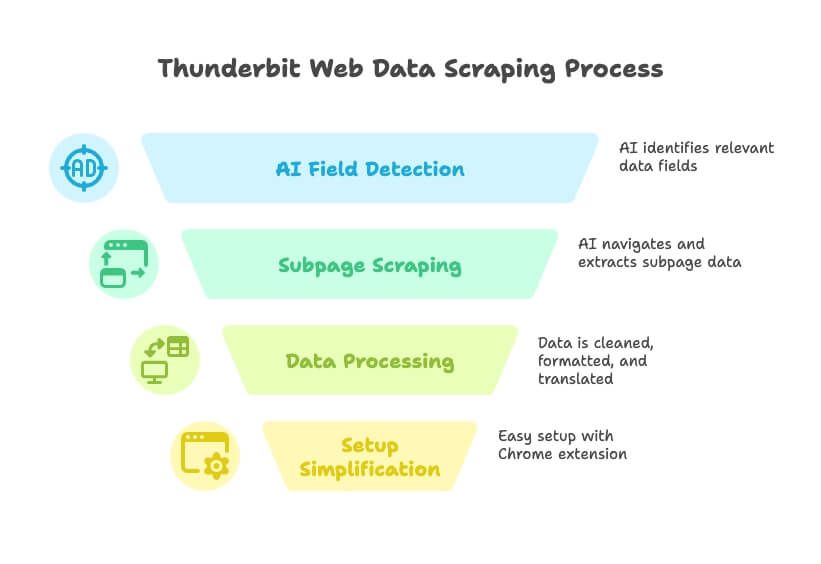

Thunderbit on lähimpänä sitä, mitä olen nähnyt “muuta mikä tahansa verkkosivu tietokannaksi” -ajatusta. Näin se toimii:

- Luonnollinen kieli edellä: Kerro vain, mitä dataa tarvitset (“haluan kaikki yritysnimet, sähköpostit ja puhelinnumerot tästä hakemistosta”), ja AI tunnistaa olennaiset kentät.

- AI Suggest Fields: Yhdellä klikkauksella Thunderbit lukee sivun ja ehdottaa parhaat sarakkeet poimittavaksi — ei enää arvailua tai yritystä ja erehdystä.

- Alasivut ja monitasoinen poiminta: Tarvitsetko lisätietoja jokaisen listauksen omalta sivulta? Thunderbit voi avata alasivut, napata lisäkentät ja lisätä ne taulukkoon.

- Datan siivous, käännös ja luokittelu: Thunderbit ei vain kerää raakadataa — se voi myös siistiä, muotoilla, kääntää ja jopa luokitella kenttiä poiminnan aikana.

- Ei asennusrumbaa: Asenna , klikkaa “AI Suggest Fields” ja olet vauhdissa alle minuutissa.

- Ilmainen kokeilu ja edullinen hinta: Reilu ilmainen taso (jopa 6 sivua ilmaiseksi), ja maksulliset paketit alkavat vain 9 $/kk. Se on vähemmän kuin mitä käytän kahviin viikossa.

Thunderbit on tehty myynnin, markkinoinnin ja operaatioiden tiimeille, jotka tarvitsevat dataa — nopeasti. Ei koodausta, ei lisäosia, ei koulutusta. Kuin dataharjoittelija, joka oikeasti kuuntelee eikä koskaan valita.

Thunderbitin erottuvat ominaisuudet

- AI-ohjattu scraping: AI ymmärtää sivun rakenteen, mukautuu layout-muutoksiin ja hoitaa myös sivutuksen sekä alasivut automaattisesti ().

- Välitön vienti: Lähetä tulokset suoraan Exceliin, Google Sheetsiin, Airtableen, Notioniin tai lataa CSV/JSON.

- Pilvi- tai paikallisajot: Aja poiminnat pilvessä nopeuden ja skaalan vuoksi tai selaimessa, jos tarvitset kirjautumisen/session.

- Scheduled Scraper: Ajasta toistuvat ajot, jotta data pysyy tuoreena — täydellinen hintaseurantaan tai säännöllisiin liidipäivityksiin.

- Huoltovapaa: Thunderbitin AI sopeutuu sivustojen muutoksiin, joten käytät vähemmän aikaa rikkoutuneiden scrapersien korjaamiseen ().

Kenelle tämä sopii? Kaikille, jotka haluavat siirtyä “tarvitsen tämän datan” -tilasta “tässä on taulukko” -tilaan minuuteissa — erityisesti ei-teknisille käyttäjille. Yli ja 4,9★-arvosanan myötä Thunderbitistä on nopeasti tulossa business-tiimien luottovalinta, kun halutaan tuloksia ilman säätöä.

Haluatko nähdä käytännössä? Katso tai selaa lisää .

2. Clay: Automatisoitu rikastus yhdistettynä web scrapingiin

Clay on kasvutiimien sveitsiläinen linkkuveitsi. Se ei ole pelkkä web scraper -työkalu — se on automaatiotaulu, joka yhdistyy yli 50 reaaliaikaiseen datalähteeseen (kuten Apollo, LinkedIn, Crunchbase) ja käyttää sisäänrakennettua AI:ta liidien rikastamiseen, outreach-viestien kirjoittamiseen ja prospektien pisteyttämiseen.

- Työnkulkuautomaatio: Jokainen rivi on liidi, jokainen sarake voi hakea dataa tai käynnistää toiminnon. Haluatko poimia yrityslistan, rikastaa LinkedIn-profiileilla ja lähettää personoidun sähköpostin? Clay hoitaa.

- AI-integraatio: Hyödyntää GPT-4:ää icebreakereihin, biojen tiivistämiseen ja muuhun.

- Integraatiot: Natiivit yhteydet HubSpotiin, Salesforceen, Gmailiin, Slackiin ja muihin.

- Hinnoittelu: Ammattipaketti alkaa noin 99 $/kk, ja kevyeen käyttöön on ilmainen kokeilu.

Paras: Outbound-myyntiin, growth-hakkereille ja markkinoijille, jotka haluavat rakentaa räätälöityjä liidiputkia — scraping + rikastus + outreach samassa paikassa. Tehokas, mutta automaatiotyökaluihin tottumattomille oppimiskynnys voi olla selvä ().

3. Bardeen: Selaimessa toimiva web scraper työnkulkuautomaatioon

Bardeen on kuin selainrobotti, joka voi kerätä dataa ja automatisoida toistuvia web-tehtäviä — kaikki Chrome-laajennuksesta.

- No-code-automaatio: Yli 500 “Playbookia” datan poimintaan, lomakkeiden täyttöön, datan siirtämiseen sovellusten välillä ja muuhun.

- AI Command Builder: Kuvaile tehtävä tavallisella kielellä, ja Bardeen rakentaa työnkulun.

- Integraatiot: Toimii Notionin, Trellon, Slackin, Salesforcen ja yli 100 muun sovelluksen kanssa.

- Hinnoittelu: Ilmainen kevyeen käyttöön (100 automaatiokrediittiä/kk), tiimeille maksulliset paketit alkavat 99 $/kk.

Paras: Tehokäyttäjille ja go-to-market-tiimeille, jotka haluavat automatisoida sekä scrapingin että jatkotoimet useissa sovelluksissa. Joustava, mutta aloittelijalle oppimiskäyrä voi olla jyrkkä ().

4. Bright Data: Enterprise-tason automatisoidut web scraping -työkalut

Bright Data (entinen Luminati) on web scrapingin raskasta kalustoa — globaaleja proxiverkkoja, edistyneitä API-rajapintoja ja kykyä indeksoida tuhansia sivuja päivässä.

- Enterprise-skaala: Yli 100 miljoonaa IP:tä, Web Scraper IDE, Web Unlocker bottisuojauksien ohittamiseen.

- Muokattavuus: Rakenna monimutkaisia, laajamittaisia poimintoja korkealla luotettavuudella.

- Hinnoittelu: Web Scraper IDE alkaa 499 $/kk, ja tarjolla on myös pienempiä “micro”-paketteja.

Paras: Suuryrityksille, data-aggrekaattoreille ja edistyneille käyttäjille, jotka tarvitsevat vahvoja ja skaalautuvia ratkaisuja. Jos keräät tuhansia sivuja päivittäin ja IP-blokit ovat arkea, Bright Data on tehty sinulle ().

5. Octoparse: Visuaalinen web scraper keskitason käyttäjille

Octoparse on suosittu no-code-työkalu visuaalisella point-and-click-käyttöliittymällä — hyvä valinta, kun haluat tehoa ilman ohjelmointia.

- Vedä ja pudota -UI: Klikkaa elementtejä määrittääksesi poiminnan, hoida kirjautumiset, sivutus ja muuta.

- Mallipohjat: 500+ valmista templatea yleisille sivustoille (Amazon, Twitter jne.).

- Pilvipoiminta: Aja työt Octoparsen palvelimilla, ajasta ajot ja käytä IP-kiertoa.

- Hinnoittelu: Ilmainen paketti rajoituksin; maksulliset alkavat 119 $/kk.

Paras: Ei-koodaajille ja data-analyytikoille, jotka haluavat pätevän scraperin ilman koodia. Toimii hyvin hintaseurantaan, tuotelistauksiin ja tutkimusprojekteihin ().

6. : Datanpoiminta-alusta yrityksille

on yksi web scrapingin pioneereista, joka on kasvanut täysiveriseksi datan poiminta -alustaksi.

- Point-and-click-poiminta: Hoitaa kirjautumiset, pudotusvalikot ja interaktiiviset elementit.

- Pilvipohjainen: Käsittele tuhansia URL-osoitteita rinnakkain, ajasta poiminnat ja käytä API:a.

- Enterprise-fokus: Käytetään hintaseurantaan, markkinatutkimukseen ja koneoppimisdatasetien rakentamiseen.

- Hinnoittelu: Starter 199 $/kk, Standard 599 $/kk, Advanced 1 099 $/kk.

Paras: Keskisuurille ja suurille yrityksille sekä datatiimeille, jotka tarvitsevat luotettavia, ylläpidettyjä ratkaisuja isoihin töihin. Harrasteprojekteihin usein liikaa, mutta yrityskäytössä erittäin vahva ().

7. Parsehub: Joustava web scraper visuaalisella editorilla

Parsehub on työpöytäsovellus (Windows, Mac, Linux), jossa rakennat scrapersit klikkailemalla sivuston käyttöliittymää.

- Visuaalinen työnkulku: Valitse elementit, määritä säännöt ja hoida kirjautumiset, pudotusvalikot sekä infinite scroll.

- Pilviominaisuudet: Aja poiminnat pilvessä, ajasta työt ja käytä API-yhteyttä.

- Hinnoittelu: Ilmainen taso pieniin töihin; maksulliset alkavat 149 $/kk.

Paras: Tutkijoille, pienyrityksille tai yksittäisille käyttäjille, jotka haluavat enemmän kontrollia kuin selainlaajennus tarjoaa, mutta eivät halua koodata omaa scraperia ().

8. Common Crawl: Avointa web-dataa AI:lle ja tutkimukselle

Common Crawl ei ole työkalu perinteisessä mielessä — se on valtava avoin dataset web-crawl-datasta, jota päivitetään kuukausittain.

- Skaala: ~400 TB web-dataa, miljardeja verkkosivuja.

- Ilmainen ja avoin: Et tarvitse omaa crawleria.

- Vaatii teknistä osaamista: Tarvitset big data -työkaluja ja insinööritaitoja datan suodattamiseen ja jäsentämiseen.

Paras: Data scientist - ja insinööritiimeille, jotka rakentavat AI-malleja tai tekevät laajamittaista tutkimusta. Jos tarvitset yleistä web-tekstiä tai pitkän aikavälin arkistoja, tämä on aarreaitta ().

9. Crawly: Kevyt automatisoitu web scraping -työkalu startupeille

Crawly (Diffbotilta) on pilvipohjainen, AI-vetoinen crawler, joka voi kerätä dataa miljoonilta sivustoilta ja palauttaa sen rakenteisena — ilman erillisiä parsintasääntöjä.

- AI-poiminta: Hyödyntää koneellista näköä ja NLP:tä sisällön tunnistamiseen ja poimintaan.

- API-yhteys: Kysy kerättyä dataa ja integroi analytiikkaan tai tietokantoihin.

- Hinnoittelu: Enterprise-taso; pyydä tarjous.

Paras: Startupeille ja tiimeille, joilla on jonkin verran teknistä osaamista ja tarve laajamittaiselle, älykkäälle web-datan poiminnalle ilman oman scraper-infran rakentamista ().

10. Apify: Kehittäjäystävällinen web scraper -alusta ja marketplace

Apify on pilvialusta, jossa voit rakentaa omia scrapersia (“Actors”) tai käyttää valmista yhteisön ylläpitämää kirjastoa.

- Kehittäjille joustavuutta: Tukee JavaScript/Python-scrapingia, headless Chromea, proxyn hallintaa ja ajastusta.

- Marketplace: Laaja valikoima valmiita scrapersia yleisille sivustoille.

- Hinnoittelu: Ilmainen taso, jossa 5 $/kk krediittejä; maksulliset alkavat 49 $/kk.

Paras: Kehittäjille ja teknisille analyytikoille, jotka haluavat täyden kontrollin ja skaalautuvuuden. Myös ei-koodaajat voivat hyödyntää valmiita Actoreita yleisiin tarpeisiin ().

Automatisoitujen web scraping -työkalujen vertailutaulukko

| Työkalu | Helppokäyttöisyys | AI-ominaisuudet | Hinta (alkaen) | Kohdekäyttäjä | Uniikit vahvuudet |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Luonnollinen kieli, AI Suggest Fields, alasivujen poiminta | 9 $/kk | Ei-tekniset liiketoimintakäyttäjät | Käyttöönotto kahdella klikkauksella, ei koodia, välitön vienti, ilmainen kokeilu |

| Clay | ★★★★☆ | AI-rikastus, GPT-4 | 99 $/kk | Growth-/sales ops | Automaatio-taulukko, rikastus, outreach |

| Bardeen | ★★★★☆ | AI-komentorakentaja | 99 $/kk | Tehokäyttäjät, GTM-tiimit | Selain-RPA, 500+ playbookia, syvät integraatiot |

| Bright Data | ★★☆☆☆ | Proxy-kierto, anti-bot AI | 499 $/kk | Suuryritykset, kehittäjät | Skaala, luotettavuus, globaalit proxyt |

| Octoparse | ★★★★☆ | Visuaalinen AI-tunnistus | 119 $/kk | Analyytikot, ei-koodaajat | Vedä ja pudota, mallipohjat, pilvipoiminta |

| Import.io | ★★★☆☆ | Interaktiiviset extractor-työkalut | 199 $/kk | Suuryritykset, datatiimit | Rinnakkaisuus, ajastus, API, tuki |

| Parsehub | ★★★★☆ | Visuaaliset työnkulut | 149 $/kk | Tutkijat, pk-yritykset | Työpöytäsovellus, selviää dynaamisista sivuista |

| Common Crawl | ★☆☆☆☆ | Ei sovellu (vain dataset) | Ilmainen | Data scientistit, insinöörit | Massiivinen avoin dataset, web-mittakaavan arkistot |

| Crawly | ★★☆☆☆ | AI-poiminta | Räätälöity/Enterprise | Startupit, tekniset tiimit | AI-vetoinen, ei parsintasääntöjä, API-yhteys |

| Apify | ★★★★☆ | Actor-marketplace | 49 $/kk | Kehittäjät, tekniset analyytikot | Rakenna itse / marketplace, pilviautomaatio, joustavuus |

Miten valita oikea web scraper omiin tarpeisiin

Paras automatisoitu web scraping -työkalu riippuu tiimin koosta, teknisestä osaamisesta ja tavoitteista. Tässä nopea ohje:

- Ei-teknisille käyttäjille (myynti, markkinointi, ops): Valitse . Se on tehty sinulle — ei koodia, ei säätöä, vain tulokset. Erinomainen liidien keruuseen, hintaseurantaan ja nopeisiin dataprojekteihin.

- Automaatioon hurahtaneille tiimeille: Clay ja Bardeen ovat vahvoja, jos haluat yhdistää scrapingin rikastukseen, outreachiin tai työnkulkuautomaatioon.

- Suuryrityksille ja kehittäjille: Bright Data, ja Apify ovat parhaat vaihtoehdot laajamittaisiin ja erittäin muokattaviin projekteihin.

- Tutkijoille ja analyytikoille: Octoparse ja Parsehub tarjoavat visuaaliset käyttöliittymät ja tehokkaat ominaisuudet ilman koodausta.

- AI- ja data science -projekteihin: Common Crawl ja Crawly tarjoavat massiivisia datasettejä ja AI-pohjaista poimintaa niille, jotka haluavat rakentaa tai kouluttaa malleja.

Kysy itseltäsi: haluatko päästä alkuun minuuteissa vai tarvitsetko räätälöidyn enterprise-tason ratkaisun? Jos et ole varma, aloita ilmaisella kokeilulla — useimmilla työkaluilla sellainen on.

Thunderbitin ainutlaatuinen arvo: AI-avustaja liiketoimintadatalle

Kaikkien näiden työkalujen joukossa Thunderbit erottuu ainoana, joka toimii aidosti “AI-avustajana” web scrapingissa ja datan muuntamisessa. Kyse ei ole vain datan nappaamisesta — vaan sotkuisten sivujen muuttamisesta siistiksi, rakenteiseksi tiedoksi ilman teknisiä esteitä.

- Luonnollisen kielen käyttöliittymä: Kuvaile tarve tavallisella kielellä, ja Thunderbit hoitaa loput.

- Koko työnkulun automaatio: Poiminnasta siivoukseen, käännökseen ja vientiin — Thunderbit kattaa koko ketjun.

- Täydellinen nopeaan kokeiluun: Haluatko validoida uuden markkinan, rakentaa liidilistan tai seurata kilpailijoita? Thunderbit on nopein ja edullisin tapa aloittaa.

Se on kuin data-analyytikko selaimessasi — sellainen, joka ei pyydä palkankorotusta eikä lähde lomalle.

Yhteenveto: aloita fiksusti oikealla automatisoidulla web scraping -työkalulla

Vuoden 2026 scraping-kenttä on täysin eri näköinen kuin kaksi vuotta sitten. Itsekorjautuvat AI-scrapersit, LLM-natiivit putket ja aidosti käyttökelpoiset no-code-työkalut ovat muuttaneet pelin. Olitpa yksinyrittäjä, ketterä myyntitiimi tai enterprise-tason data scientist, tästä listasta löytyy sopiva vaihtoehto. Olennaista on sovittaa oma työnkulku ja osaaminen oikeaan alustaan — jotta voit lopettaa koodin kanssa painimisen ja alkaa löytää oivalluksia.

Jos haluat jättää manuaalisen kopioi–liitä-työn taakse ja tehdä asiat fiksummin, ja näe, miten helppoa web scraping voi olla. Tai tutustu yllä oleviin vaihtoehtoihin tavoitteidesi mukaan. Joka tapauksessa datavetoisen liiketoiminnan tulevaisuus kuuluu niille, jotka automatisoivat.

Haluatko oppia lisää? Katso — sieltä löydät syväluotauksia, ohjeita ja vinkkejä web-datan hyödyntämiseen. Hyviä scraping-hetkiä — ja toivotaan, että data pysyy aina siistinä ja scrapersit eivät koskaan hajoa (ja jos hajoavat, anna AI:n hoitaa).

UKK

1. Miksi automatisoidut web scraping -työkalut ovat tärkeitä liiketoimintakäyttäjille vuonna 2026?

Automatisoidut web scraping -työkalut tehostavat datankeruuta, säästävät aikaa ja vähentävät käsityötä. Ne parantavat datan tarkkuutta, tukevat reaaliaikaista päätöksentekoa ja antavat ei-teknisille tiimeille mahdollisuuden hyödyntää web-dataa ilman koodausta. Nämä työkalut ovat nyt keskeisiä myynnin, markkinoinnin ja operaatioiden tarpeisiin.

2. Mikä erottaa Thunderbitin muista web scraping -työkaluista?

Thunderbit hyödyntää AI:ta niin, että käyttäjä voi kertoa haluamansa datan tavallisella kielellä. Se tunnistaa kentät automaattisesti, hoitaa alasivut ja sivutuksen sekä vie tulokset heti esimerkiksi Exceliin ja Airtableen. Se on suunniteltu ei-teknisille käyttäjille ja tarjoaa vahvoja ominaisuuksia, kuten datan siivouksen ja ajastetun scrapingin, edulliseen hintaan.

3. Mikä työkalu sopii parhaiten laajamittaisiin enterprise-tason scraping-projekteihin?

Bright Data ja ovat erinomaisia enterprise-käyttöön. Ne tarjoavat proxy-kierron, anti-bot-ratkaisuja, laajaa rinnakkaisuutta ja API-yhteyksiä, joten ne sopivat organisaatioille, joiden täytyy käsitellä tuhansia sivuja luotettavasti ja skaalautuvasti.

4. Onko työkaluja, jotka yhdistävät scrapingin automaatioon ja outreachiin?

Kyllä. Clay ja Bardeen eivät ainoastaan kerää web-dataa, vaan myös liittävät sen työnkulkuihin. Clay rikastaa liidejä ja automatisoi outreachia, kun taas Bardeen mahdollistaa selaimessa tehtävien tehtävien ja työnkulkujen automatisoinnin AI-vetoisilla playbookeilla.

5. Mikä on paras vaihtoehto käyttäjille ilman teknistä taustaa?

Thunderbit on vahvin valinta ei-teknisille käyttäjille luonnollisen kielen käyttöliittymän, AI-ohjatun käyttöönoton ja helppokäyttöisyyden ansiosta. Se ei vaadi koodausta tai monimutkaista asennusta ja sopii liiketoimintakäyttäjille, jotka tarvitsevat nopeasti luotettavaa dataa ilman teknistä monimutkaisuutta.