GitHub-haulla sanalla "amazon scraper" löytyy noin . Kun rajaat haun repoihin, joihin on pushattu viimeisen kuuden kuukauden aikana, määrä putoaa noin — eli vain noin 20 prosenttiin. Entä loput? Hylättyjä tutoriaaleja, vanhentuneita wrapper-ratkaisuja ja skriptejä, jotka lakkaavat toimimasta heti, kun Amazon kiristää puolustustaan.

Olen käyttänyt paljon aikaa Amazon-scraper-repositorioden tutkimiseen, GitHub-ongelmien lukemiseen ja yhteisökeskustelujen seuraamiseen Redditissä sekä Stack Overflow'ssa. Toistuva kuvio on selvä: joku löytää suositun repön, käyttää tunnin sen asentamiseen, ajaa sen kerran ja törmää CAPTCHA- tai 503-virheiden muuriin. Amazonin anti-bot-linja vuonna 2026 ei ole sama kuin edes kaksi vuotta sitten — TLS-jäljentäminen, käyttäytymisanalyysi ja aggressiivinen CAPTCHA-käyttöönotto ovat tehneet vanhasta "kierrätä user agentit ja toivo parasta" -pelikirjasta lähes hyödyttömän. Tämä opas käy läpi ne parhaat käytännöt, joilla on oikeasti väliä, jos haluat saada luotettavaa Amazon-dataa GitHub-reposta, ja mitä tehdä silloin, kun scraperisi hajoaa — ei siis jos, vaan kun.

Mikä on Amazon Scraper GitHubissa, ja miksi niin moni epäonnistuu?

Amazon scraper GitHub -repo on tyypillisesti avoimen lähdekoodin skripti — yleensä Python-, Node.js- tai Scrapy-pohjainen — joka poimii rakenteista dataa Amazon-sivuilta. Poimitut tiedot ovat tuttuja: tuotteen nimi, hinta, ASIN, arvosanat, arvostelujen määrä, saatavuus, myyjän tiedot, hakutulosten kortit ja arvosteluteksti.

Arkkitehtuuri on yleensä suoraviivainen:

- HTTP-asiakas tai headless-selain hakee sivun.

- HTML- tai JSON-parseri poimii kentät.

- Data tallennetaan CSV-, JSON- tai tietokantamuotoon.

Repot jakautuvat yleensä neljään koriin:

- Kevyet Python-kirjastot (esim. )

- Scrapy-hämähäkit (esim. )

- Selenium- tai Playwright-selainautomaatio

- API-wrapper-projektit, jotka ovatkin käytännössä kaupallisen scraping-palvelun käyttöliittymiä (esim. )

Epäonnistumismalli on ennustettava. Useimmat repot hajoavat, koska:

- Amazon muuttaa sivun asettelua tai HTML-osiotaan

- Amazon palauttaa oikean sisällön sijaan 503:n tai CAPTCHA:n

- Scraperin TLS- ja HTTP-jälki ei enää näytä selaimelta

- Locale-, kieli- tai header-ristiriidat herättävät epäilyksiä

- Ylläpitäjä siirtyy eteenpäin ratkottuaan alkuperäisen, rajatun käyttötapauksensa

Korkea tähtimäärä ja "tällä hetkellä käytettävissä" ovat kaksi eri asiaa. Tätä artikkelia varten tekemässäni auditoinnissa vain noin kolme kahdeksasta laajasti esillä olleesta reposta vaikutti selvästi aktiiviselta vuonna 2026.

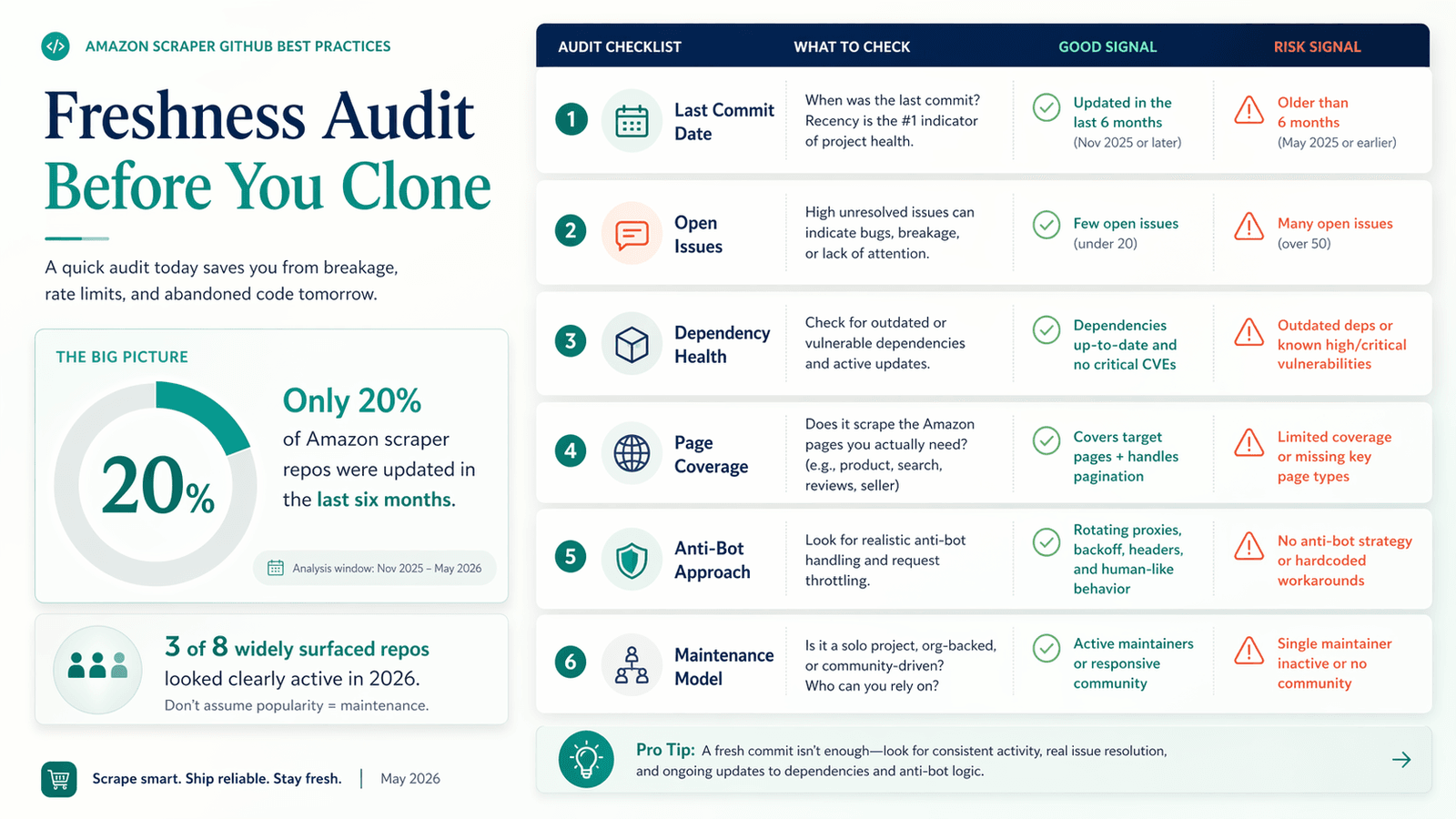

Tee tuoreusauditointi vuodelle 2026 ennen kuin kloonaat yhtäkään Amazon Scraper GitHub -repota

Tämä vaihe on Amazonille tärkeämpi kuin useimmille muille kohteille. Amazonin puolustava asenne muuttuu nopeammin kuin tavallisen verkkokauppasivuston, joten repo, joka toimii mainossivulla hyvin, voi muuttua käyttökelvottomaksi Amazonissa muutamassa viikossa. Silti useimmat "best amazon scraper github" -listat suosittelevat repoja tarkistamatta, toimivatko ne yhä. Käyttäjät hukkaavat tunteja rikkinäisten työkalujen käyttöönottoon.

Miten tarkistaa, onko GitHub-repo yhä elossa

Ennen kuin git cloneaat mitään, käy läpi nämä tarkistukset:

- Viimeisin commit-päivä: Yli 6 kuukautta vanha on Amazonissa selvä varoitusmerkki.

- Avoimet issue't vs. vastausprosentti: Etsi Issues-välilehdeltä sanoja "captcha", "503", "blocked" ja "not working". Jos raportteja kertyy eikä ylläpitäjä vastaa, siirry eteenpäin.

- Riippuvuuksien kunto: Avaa

requirements.txttaipackage.json. Vanhentuneet kirjastot (esim. vanharequestsilman modernia TLS-käsittelyä) ovat punainen lippu. - Amazon-sivutyyppien kattavuus: Käsitteleekö repo tuotepageja, hakutuloksia JA arvosteluja? Vai vain yhtä?

- Anti-bot-lähestymistapa: Kovia rivejä ja kiinteitä header-arvoja ilman proxy-tukea on vuoden 2023 tyyliä, joka ei kestä vuotta 2026.

Amazon Scraper GitHub -tuoreuden tarkistuslista

| Tuoreuden merkki | Mitä tarkistaa | Varoitusmerkki 🚩 |

|---|---|---|

| Viimeisin commit-päivä | Commit-syöte tai repon push-päivä | Yli 6 kuukautta vanha |

| Avoimet issue't | Issues-välilehti — suodata "captcha", "503", "blocked" | Toistuvat rikkoutumiset ilman ylläpitäjän vastauksia |

| Riippuvuuksien kunto | requirements.txt / package.json | Vanhentuneet kirjastot, ei modernia TLS-strategiaa |

| Amazon-sivujen kattavuus | README + koodiesimerkit | Käsittelee vain yhtä sivutyyppiä (esim. tuotepages, mutta ei hakua tai arvosteluja) |

| Anti-bot-lähestymistapa | Lähdekoodi, proxy-konfiguraatio | Pelkät kovakoodatut headerit ja UA-merkkijonot |

| Ylläpitomalli | Onko kyse aidosta scraperista, tutoriaalista vai kaupallisen API:n wrapperista? | Repo on käytännössä vain maksullisen palvelun käyttöliittymä |

Mitä auditissa oikeasti löytyi

Tarkistin kahdeksan laajasti esillä ollutta Amazon scraper -repota näitä kriteerejä vasten. Tulokset ovat karuja:

| Repo / työkalu | Tähdet | Viimeisin commit-signaali | Laajuus | 2026 tila | Huomiot |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2 872 | 2026-04-02 | Hallittu scraper-API-wrapper | Elossa, mutta ei itse tehty | Tuore, mutta kyse on oikeastaan hallitun palvelun käyttöliittymästä |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | Hallittu API hakuun, tietoihin ja arvosteluihin | Elossa, mutta ei itse tehty | Hyvä kattavuus, mutta kyse on API-tuotteesta, ei raakasta scraperista |

| theonlyanil/amzpy | ~110 | 2026-02-26 | Kevyt Python-kirjasto | Elossa | Selkein suoraan GitHubista ajettava scraper, joka käyttää curl_cffi:tä |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | Vain arvostelut | Kapea mutta käytettävä | Vanha ja hyvin arvosteluihin keskittynyt |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | Viimeisin commit 2023; repo pushattu 2024-08-20 | Scrapy-hämähäkit + proxy-middleware | Tutoriaalitasoa, vanhentuva | Hyödyllinen oppimiseen, ei suoraan käyttöön vuonna 2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | Node CLI hakuun, tietoihin ja arvosteluihin | Korkea riski | Laaja kattavuus, mutta ylläpito on liian vanhaa |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | Hausta CSV:ksi | Kuollut vuodelle 2026 | Aikanaan suosittu, mutta selvästi vanhentunut |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | Haku/tuote-tutoriaali | Kuollut vuodelle 2026 | Käytännössä arkistomateriaalia |

Julkiset issue't kertovat saman tarinan. sisältää issue'n nimeltä "All requests receive captcha response." sisältää viestin "Doesn't seem to be working." on issue "Bypass Amazon protection." Nämä eivät ole harvinaisia reuna-alueen tapauksia — ne ovat ensimmäisiä asioita, joihin käyttäjät törmäävät.

Anti-ban-pelikirja: miten välttää esto Amazon Scraper GitHub -projektilla

Estoon joutuminen on suurin kipupiste kaikille, jotka käyttävät amazon scraper github -projektia. Yleinen neuvo kuten "käytä proxyja ja kierrätä user agenteja" ei enää riitä. Amazonin vuosien 2025–2026 anti-bot-pino sisältää TLS-jäljentämisen, käyttäytymisanalyysin ja aggressiivisen CAPTCHA-käytön. Tarvitset kerroksittaisen lähestymistavan.

TLS-jäljen vastaavuus: miksi perus requests johtaa porttikieltoon

Tämä on yksi eniten sivuutetuista anti-ban-tekniikoista. TLS-jäljentäminen toimii näin: kun skriptisi avaa suojatun yhteyden Amazoniin, palvelin näkee paljon asiakkaasta sen perusteella, miten tämä "kättelee" — mitä salauspaketteja tarjotaan, missä järjestyksessä laajennukset tulevat, millaiset HTTP/2-asetukset ovat. Selaimilla on suhteellisen vakioidut TLS- ja HTTP/2-asetukset, ja nämä yhdistelmät ovat jäljitettävissä tekniikoilla kuten .

Pelkkä requests ja tavallinen httpx-asennus voivat kopioida headerit, mutta ne eivät kopioi Chrome-tyylistä TLS- ja HTTP/2-käyttäytymistä. Amazon erottaa nämä.

ratkaisee tämän suoraan. Se tarjoaa selaimen impersonoinnin — tuettuja kohteita ovat muun muassa chrome136, safari184 ja firefox133 — joten HTTP-asiakkaasi TLS-jälki vastaa oikeaa selainta. Dokumentaatio varoittaa nimenomaisesti satunnaisten JA3-merkkijonojen luomisesta: selainten jäljet ovat pääosin versioittain vakioita, ja satunnainen hölynpöly on helpompi havaita kuin kopioitu aito jälki.

Yhteisödatan perusteella tämä pitää paikkansa. vahvistaa, että impersonate-argumentti on hyödyllinen, koska se kierrättää selainprofiileja ja pitää headerit linjassa. Toinen huomauttaa, että Amazon estää asiakkaita TLS-jäljen perusteella "noin kuukauden tai kahden jälkeen." kysyy suoraan, jäljentääkö Amazon python-requestsia (spoileri: kyllä).

Jos käytät yhä tavallista requests-kirjastoa Amazon-asiakkaanasi, päivitä tuo oletus ennen kuin päivität mitään muuta.

Proxyjen kierrätys oikein tehtynä (ei vain "käytä proxyja")

Proxyjen tarkoitus ei ole kierrättää mahdollisimman paljon. Tarkoitus on saada sessiot näyttämään uskottavilta.

Residential vs. datacenter: Datacenter-proxyt ovat halvempia mutta helpommin havaittavia. Residential-proxyt maksavat enemmän, mutta Amazonin on paljon vaikeampi liputtaa ne. alkavat 4,00 dollarista/GB pay-as-you-go-mallissa ja laskevat 3,50 dollariin/GB suuremmilla paketeilla. alkaa 6 dollarista/GB. Amazon kuuluu "hienostuneet kohteet" -kategoriaan, jossa residential-proxyjen lisähinta on perusteltu.

Pyynnöittäin vs. sessiokohtainen kierrätys: Tässä useimmat tutoriaalit menevät pieleen. Proxyjen vaihtaminen jokaisella pyynnöllä samalla, kun evästeet ja headerit pysyvät samoina, voi näyttää vähemmän inhimilliseltä, ei enemmän. Turvallisempi malli:

- Pidä haku → tuote → arvostelu -kulku mahdollisuuksien mukaan samassa sticky-sessionissa

- Vaihda sessiota, kun aloitat uuden hakumatkan, ei jokaisella pyynnöllä

- Kierrätä sessioiden välillä, älä satunnaisesti yhden selaussession sisällä

Yksi huomautti, että tavalliset ISP-IP:t toimivat huomattavasti heikommin kuin mobiili-IP:t suosituilla verkkokauppasivustoilla. Toinen raportoi eston saamisesta jopa kiertävillä user agenteilla ja residential-proxyilla — hyvä muistutus siitä, etteivät proxyt yksin riitä.

Pyynnön rytmitys, backoff ja rate limiting

Amazonin 503-sivut eivät ole satunnaista huonoa tuuria. Ne ovat palautetta.

yli 500 ASINin scrapingista raportoi 503-virheen toistuvan aina samassa kohdassa, noin ASIN 101:n paikkeilla, vaikka käytössä oli viiveitä. Kuvio on vanha, mutta opetus on ajankohtainen: raakavolyymi yhdestä IP:stä tai jäljestä laukaisee lopulta puolustukset.

Parhaat käytännöt DIY-GitHub-scrapereille:

- Satunnaistetut viiveet pyyntöjen välillä (ei kiinteitä intervalleja, sillä ne voidaan havaita)

- 2–5 sekuntia yksinkertaisille HTTP-asiakkaille julkisten tuote-pyyntöjen välillä

- Eksponentiaalinen backoff 503:n tai CAPTCHA:n jälkeen — hidasta asteittain sen sijaan, että yrität heti uudelleen

- Alhaisempi rinnakkaisuus kuin luulet tarvitsevasi

- Fail-open-lokit tiukkojen retry-loopien sijaan

Useimmissa amazon scraper github -repoissa ei ole sisäänrakennettua rate limitingiä. Se pitää lisätä itse.

Headerien orkestrointi: kyse on muustakin kuin User-Agent-merkkijonoista

Amazon tarkistaa koko header-joukon, ei vain User-Agentia.

Uskottavan selain-header-setin pitäisi sisältää:

User-AgentAcceptAccept-LanguageAccept-EncodingSec-CH-*vihjeet, kun ne ovat tarkoituksenmukaisia- Yhteyskäyttäytyminen, joka vastaa valittua selainprofiilia

Headerien tulisi vastata markkinapaikan localea. Yksi huomasi, että sama bottiasetus havaittiin vain joissakin localeissa, ja toinen kommentoija viittasi alueeseen liittyviin headereihin kuten Accept-Language.

Sääntö on tämä: headerit, TLS-/ selainprofiili ja proxyjen maantiede eivät saa olla ristiriidassa keskenään. Älä lähetä Chrome-headereita Firefox-UA:n kanssa. Älä käytä Yhdysvaltain proxya ja Accept-Language: de-DE.

CAPTCHA-käsittely: milloin ratkaista ja milloin perääntyä

CAPTCHA:an törmääminen tarkoittaa, että Amazon on jo epäluuloinen. Sen ratkaiseminen ei nollaa luottamuspistettä.

Yksittäisissä, harvoin esiintyvissä CAPTCHA-tilanteissa:

- PyPI-paketti on puhdas Python-pohjainen Amazonin tekstimuotoisten CAPTCHA:iden ratkaisija, mutta sen viimeisin julkaisu on toukokuulta 2023 — pidä sitä taktisen työkaluna eikä kestävän strategian osana

- listaa Amazon Captchan hinnaksi 0,45 dollaria / 1 000 ratkaisua

Toistuvissa CAPTCHA-silmukoissa:

- Lopeta ratkaiseminen ja ala perääntyä

- Toistuvat CAPTCHA:t tarkoittavat, että sessio on palanut — niiden ratkaiseminen ei rakenna takaisin luottamusta jäljelle, sessiohistorialle tai IP:n maineelle

- Jos CAPTCHA:t kasaantuvat proxy-aliverkon mukaan, ongelma on verkkokerroksessa, ei parserissa

Milloin oikeasti tarvitset headless-selaimen, ja milloin se on liioittelua

Väärä vaisto on käyttää Playwrightia kaikkeen.

Hyvät selaimen käyttötapaukset:

- Hakutulokset, jotka riippuvat JavaScript-renderöinnistä tai locale-kohtaisesta tilasta

- Arvostelupolut, jotka ohjautuvat kirjautumis- tai sign-in-sivuille

- Työnkulut, joissa evästeet ja selainkonteksti ovat tärkeämpiä kuin raakanopeus

Huonot selaimen käyttötapaukset:

- Tavalliset julkiset tuotepages

- Staattinen tuotetietojen poiminta, jossa selainmäinen HTTP-asiakas riittää

- Suuren mittakaavan massahaku, jossa laskentatehokkuus on tärkeää

Aloita kevyimmällä asiakkaalla, joka toimii. Yksi skaalausta käsittelevästä scrapaamisesta kuvasi etenemisen näin: aloita requestsillä, sitten curl_cffi:llä, ja siirry täyteen selaimeen vasta, kun kevyemmät vaihtoehdot epäonnistuvat. Headless-selaimet ovat Amazon-tuotesivujen scrappauksessa merkittävästi hitaampia ja resurssi-intensiivisempiä kuin HTTP-asiakkaat.

Anti-ban-päätösmatriisi Amazon Scraper GitHub -projekteille

| Tilanne | Suositeltu lähestymistapa | Miksi |

|---|---|---|

| Julkiset tuotepages (pieni mittakaava) | curl_cffi + sticky residential -sessio | Halvin tapa, joka näyttää silti selaimelta |

| Hakutulossivut | curl_cffi ensin, Playwright vain jos renderöinti tai tila rikkoo HTTP:n | Haku on tilasidonnaisempi ja herkempi localeille |

| Arvostelut (kirjautuminen vaaditaan) | Selaintila oikeilla evästeillä/sessiolla | Kirjautuminen ja dynaamiset arvostelupolut on vaikeampi jäljitellä paljaalla HTTP:llä |

| Suuri mittakaava (5k+ päivässä) | Hallittu scraper-API, unlocker tai no-code-alusta | Pelkkä DIY-GitHub-koodi muuttuu infrastruktuuriongelmaksi |

Kun Amazon Scraper GitHub -projektisi hajoaa: pidä no-code-varasuunnitelma

Jokaisella kokeneella scraperilla on Plan B.

Amazon-päivitykset rikkovat lopulta minkä tahansa GitHub-repon juuri pahimpaan mahdolliseen aikaan. Verkkokauppatiimeille rikkinäinen scraper tarkoittaa missed price changes -tilanteita, vanhentunutta kilpailijatietoa ja aukkoja dashboardeissa.

Monet "amazon scraper github" -haulla etsivät ovat itse asiassa liiketoimintakäyttäjiä — verkkokauppaoperaattoreita, markkinoijia, FBA-tutkijoita — jotka päätyivät koodiratkaisuihin, koska parempia vaihtoehtoja ei löytynyt. Foorumidataa selatessa näkyy myös aitoa turhautumista Amazonin viralliseen : rajattu pääsy, niukka data ja , joita monet myyjät eivät täytä.

Miksi GitHubin Amazon-scraperit vaativat jatkuvaa ylläpitoa

Edellä tehty auditointi tekee tämän konkreettiseksi:

- Vanhat repot keräävät rikkinäisyysilmoituksia ilman korjauksia

- "Toimivat" repot puhuvat nykyään avoimesti anti-bot-toimista README:ssä

- Yhteisökeskustelut keskittyvät yhä useammin TLS-jälkiin, CAPTCHA-silmukoihin ja proxyjen laatuun — eivät CSS-valitsimiin

Liiketoimintakäyttäjille tämä ylläpitotaakka on todellinen piilokustannus. Repo on ilmainen. Sinun aikaasi, jonka käytät sen debuggaamiseen kello kahdelta yöllä, ei ole.

Thunderbit käytännöllisenä Amazon-scraper-vaihtoehtona

tarjoaa , joka poimii otsikon, hinnan, ASINin, arviot, brändin, saatavuuden, toimitusmaan ja alkuperäisen URL:n — ilman koodausta.

Miltä tämä näyttää käytännössä:

- 2 klikin scraping vs. Python-ympäristöjen, riippuvuuksien ja proxy-konfiguraatioiden rakentaminen

- Välitön Amazon-malli — ei AI-ylikuormaa, vain yhden klikin poiminta

- Selain-scraping-tila sivuille, jotka vaativat kirjautumisen (kuten arvostelusivut, jotka turhauttavat GitHub-scraperin käyttäjiä)

- Pilviscraping julkisille tuotepageille nopeasti (50 sivua kerrallaan)

- Ilmainen vienti Google Sheetsiin, Airtableen, Notioniin ja Exceliin — ei pelkästään CSV/JSON:iin

- Scheduled Scraper jatkuvaan hintaseurantaan

- AI mukautuu asettelumuutoksiin — ei ylläpitotaakkaa sinulle

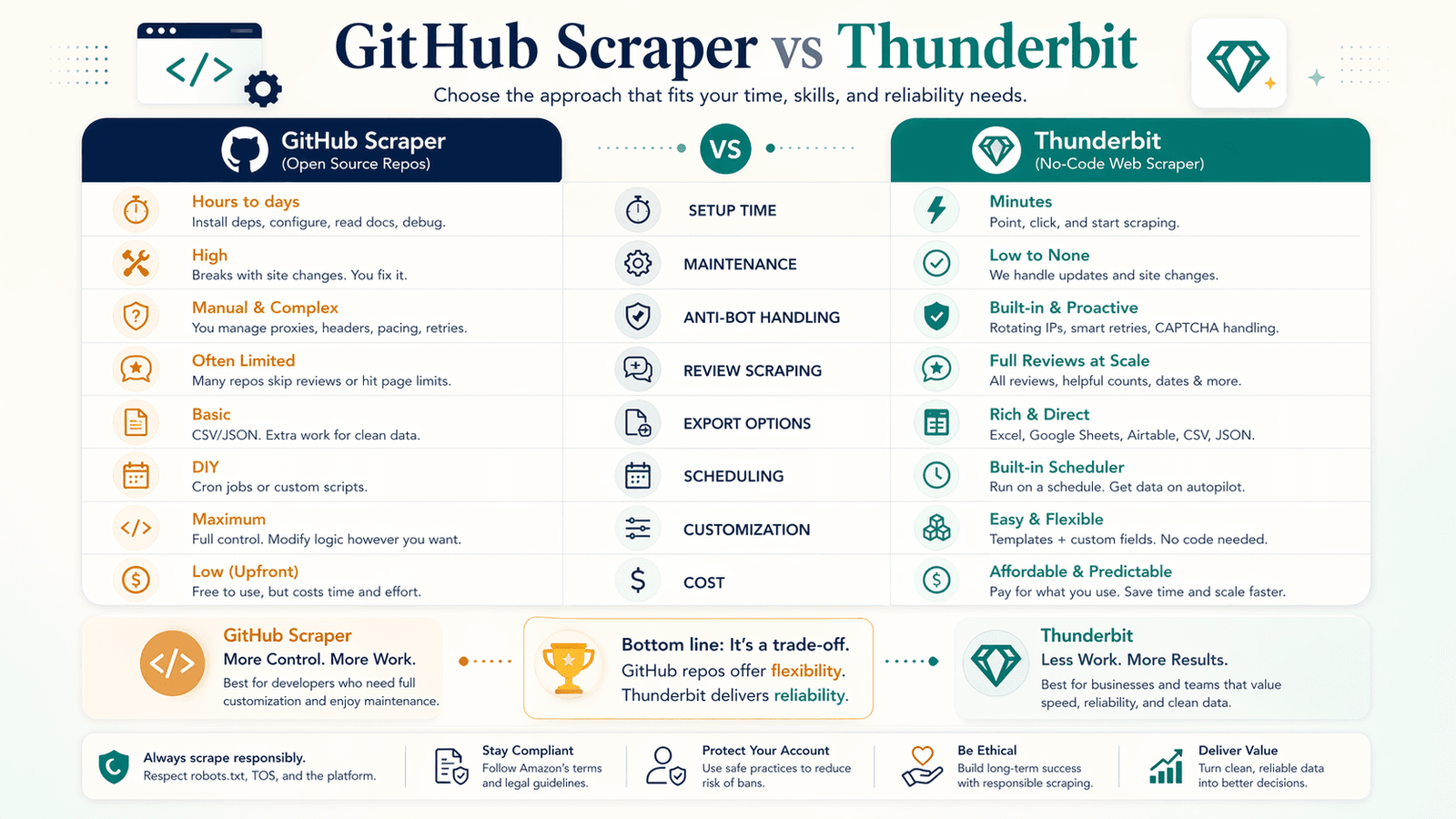

GitHub Amazon Scraper vs. Thunderbit: rehellinen vertailu

| Tekijä | GitHub-scraper (esim. AmzPy) | Thunderbit |

|---|---|---|

| Asennusaika | 15–60 min (Python, riippuvuudet, proxyt) | ~2 min (asennus Chrome-laajennus) |

| Ylläpito | Sinä korjaat rikkoutumiset | AI mukautuu asettelumuutoksiin |

| Anti-bot-käsittely | Itse tehty (proxyt, headerit, TLS) | Sisäänrakennettu (pilvi + selain-tilat) |

| Arvostelujen scraping (kirjautuneena) | Monimutkainen sessiohallinta | Selain-scraping-tila |

| Datan vienti | Vain CSV/JSON | Sheets, Airtable, Notion, Excel, CSV, JSON |

| Ajoitus | Itse tehty (cron, Airflow jne.) | Sisäänrakennettu Scheduled Scraper |

| Mukautettavuus | Korkeampi | Matalampi |

| Hinta | Ilmainen (plus proxy-kulut) | Ilmainen taso saatavilla; krediittipohjainen |

Rehellinen kompromissi: GitHub-repot tarjoavat enemmän muokattavuutta; Thunderbit tarjoaa enemmän luotettavuutta. Jos tiimillesi uptime on tärkeämpi kuin joustavuus, no-code-polku on yleensä järkevämpi valinta.

Parhaat käytännöt ajastettuun ja toistuvaan Amazon-scrapingiin

Useimmat amazon scraper github -projektit on rakennettu kertakäyttöisiä ajoja varten, mutta todelliset liiketoimintakäyttötapaukset — hintaseuranta, varaston seuranta, kilpailija-analyysi — vaativat toistuvaa scrapingia. GitHub-repot eivät lähes koskaan sisällä ajoitusta natiivisti, joten käyttäjien on yhdisteltävä cron-jobeja, Airflow'ta tai n8n-työnkulkuja.

DIY-ajastus GitHubin Amazon-scrapereille

Vähimmäiskelpoisen toistuvan ajon setup:

- Cron job Linuxissa tai macOS:ssa skriptin ajamiseen aikataulun mukaan

- Vain lisättävät lokit, jotta virheitä voi debugata jälkikäteen

- Deduplikointi ASIN + aikaleima -avaimella, jotta et tallenna samaa dataa kahdesti

- Virhehälytykset (vaikka vain yksinkertainen sähköposti epäonnistuneesta ajosta), jotta tiedät, milloin ajo hajoaa kello 3 aamulla

Monimutkaisemmille tiimeille:

- n8n kevyen työnkulkuautomaation tarpeisiin (mainitaan usein yhteisökeskusteluissa)

- Airflow raskaampiin ajastettuihin putkiin

- Tietokantaan pohjautuva tila, jos tarvitset erotuksia ja historiaa

Tärkein paras käytäntö ei ole itse ajastin — vaan tilanhallinta. Seuraa viimeisintä onnistunutta ajoa, viimeisintä ASIN-joukkoa, muuttuneita hintoja ja epäonnistuneita URL-osoitteita.

Ajastus yksinkertaistuu Thunderbitilla

Thunderbitin antaa sinun kuvata aikavälin luonnollisella kielellä, syöttää URL:t ja klikata "Schedule". AI muuntaa luonnollisen kielen cron-aikatauluksi — ilman teknistä käyttöönottoa. Ei-teknisille verkkokauppatiimeille, jotka seuraavat hintoja tai kilpailijoiden tuotelanseerauksia, tämä vähentää operatiivista kitkaa merkittävästi.

Parhaat käytännöt toistuviin Amazon-scrapeihin

Nämä pätevät riippumatta käytetystä työkalusta:

- Deduplikoi ASIN + aikaleimaikkunan perusteella — älä tallenna samaa tuotetta kahdesti per ajo

- Tallenna hinnat numeroina, ei raakatekstinä — helpottaa jälkikäsittelyä

- Lisää scrape-aikaleima jokaiseen riviin — tarvitset sitä trendianalyysiin

- Seuraa muutoksia, älä vain nykytilaa — "hinta laski 12 % viime viikosta" on hyödyllisempää kuin "hinta on 24,99 $"

- Hälytä merkittävistä muutoksista — kilpailijan 15 %:n hinnanalennus kannattaa ilmoittaa; 0,5 %:n vaihtelu on kohinaa

- Mieti tiedon tallennusta — litteät tiedostot riittävät pieniin ajoihin; 5k+ ASINille päivässä harkitse tietokantaa tai pilvilaskentataulukkoa

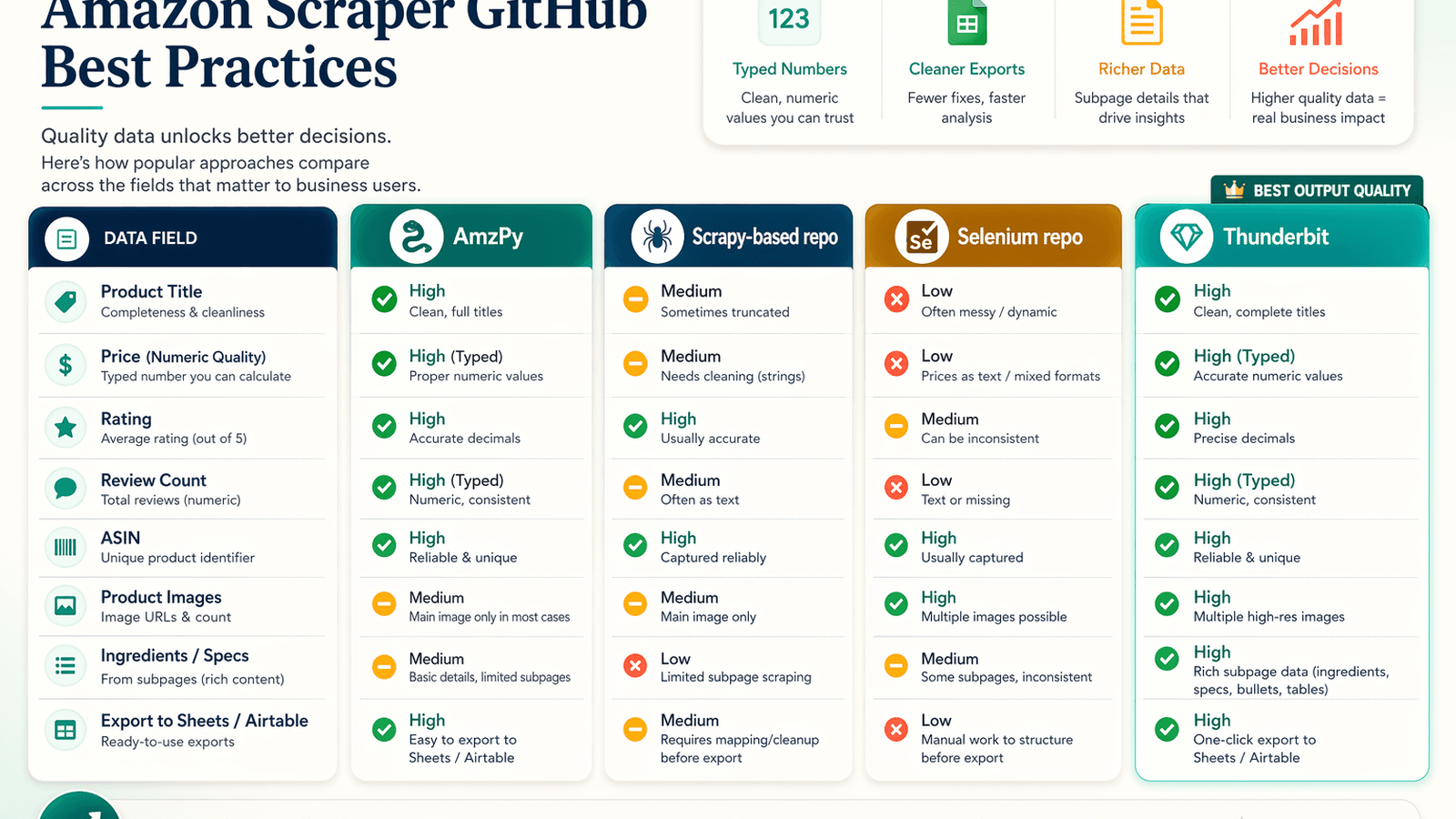

Vierekkäisen tuloksen laatu: mitä kukin Amazon Scraper GitHub -lähestymistapa oikeasti palauttaa

Kukaan ei vertaa varsinaista tulostuslaatua Amazon scraper GitHub -repositorioden välillä. Käyttäjät välittävät syvästi datan laadusta — "mikä työkalu antaa puhtaimman ja täydellisimmän datan" — mutta joutuvat itse kloonaamaan ja testaamaan jokaisen repön. Tämä osio paikkaa tuon aukon.

Mitä suositut GitHub-repot oikeasti poimivat — ja mitä ne missaavat

README-esimerkkien, julkisten esimerkkien ja dokumentoitujen tulostemuotojen perusteella:

| Lähestymistapa | Mitä se selvästi poimii | Tyypilliset puutteet / kompromissit |

|---|---|---|

| amzpy | Otsikko, hinta, valuutta, kuvan URL, arviot, arvostelut, variantit, ASIN | Painottuu tuotepageihin; vähemmän sisältöä täysissä arvostelu- tai speksiosioissa |

| tducret/amazon-scraper-python | CSV, jossa otsikko, arvio, arvostelumäärä, tuote-URL, kuvan URL, ASIN | Vanhentunut, listauspainotteinen, heikko anti-bot-tarina |

| python-scrapy-playbook scraper | Hakutulokset, tuotepages, arvostelut, CSV/JSON-putket | Tutoriaalitasoa; nojaa ulkoiseen proxy-middlewareen; vaatii todennäköisesti enemmän siivousta |

| omkarcloud/amazon-scraper | Haku, kategoria, tiedot, parhaat arvostelut, monet kuvat/videot/speksit | Ei raakascraper — se on hallittu API-palvelu |

| Thunderbit Amazon template | Otsikko, hinta, ASIN, brändi, arvosana, arvostelut, saatavuus, toimitusmaa, alasivujen rikastus | Vähemmän kooditason hallintaa kuin omissa skripteissä |

Tulostuslaadun vertailutaulukko

| Datan kenttä | AmzPy | Scrapy-pohjainen repo | Selenium-repo | Thunderbit |

|---|---|---|---|---|

| Tuotteen nimi | ✅ | ✅ | ✅ | ✅ |

| Hinta (numero) | ⚠️ merkkijono | ✅ | ⚠️ merkkijono | ✅ (numerotyyppi) |

| Arvosana | ✅ | ✅ | ✅ | ✅ |

| Arvostelujen määrä | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| Tuotekuvat | ❌ | ⚠️ vain pikkukuva | ✅ | ✅ (täysresoluutio, vietävissä) |

| Ainesosat/speksit | ❌ | ❌ | ❌ | ✅ (alasivujen scraping + AI) |

| Vienti Sheetsiin/Airtableen | ❌ | ❌ | ❌ | ✅ ilmainen |

Miksi datan muotoilu merkitsee liiketoimintakäyttäjille

Sotkuinen data luo piilotyötä. Jopa onnistunut scraper voi olla operatiivinen epäonnistuminen, jos:

- Hinnat ovat merkkijonoja valuuttasymboleilla puhtaiden numeroiden sijaan

- Puuttuvat arvot ovat epäjohdonmukaisia (tyhjä merkkijono vs. null vs. "N/A")

- Kuvat ovat vain matalan resoluution pikkukuvia

- Arvostelu- tai speksikentät vaativat jälkikäsittelyä ennen analyysiä

Verkkokauppaoperaatiotiimeille puhdas data vaikuttaa suoraan analyysinopeuteen ja päätöksentekoon. Thunderbitin AI muotoilee datan tyypin mukaan — numerot numeroiksi, päivämäärät päivämääriksi, URL:t URL:eiksi — joten se on heti käyttövalmista. GitHub-repot vaihtelevat tällä alueella paljon, ja siivousaika kasautuu nopeasti.

Nopea viite: Amazon Scraper GitHub -parhaiden käytäntöjen tarkistuslista

- Tarkista viimeisin commit-päivä ennen kloonausta. Yli kuusi kuukautta vanha on Amazonissa vahva varoitusmerkki.

- Etsi issue't sanoilla "captcha", "503", "blocked" ja "not working" ennen käyttöönottoa.

- Suosi

curl_cffi:tä tai muuta selainta impersonoivaa HTTP-asiakasta tavallisenrequests-kirjaston sijaan. - Pidä headerit, TLS-profiili, kieli ja proxyjen maantiede linjassa — ei ristiriitoja.

- Käytä sticky-sessioita selauspoluissa; älä kierrä jokaista pyyntöä sokeasti.

- Lisää satunnaistettu rytmitys ja eksponentiaalinen backoff.

- Käsittele toistuva CAPTCHA palaneena sessiona, ei pulmana, joka pitää brute forcettaa.

- Käytä headless-selaimia vain, kun HTTP-asiakkaat eivät pysty luotettavasti jäljentämään sivua.

- Tallenna checkpointit ja tila, jotta epäonnistuneet ajot voidaan jatkaa turvallisesti.

- Pidä varasuunnitelma — olipa se hallittu API tai no-code-työkalu kuten .

Oikeudelliset ja eettiset näkökohdat Amazon-scrapingissa vuonna 2026

Muutama asia, jotka on hyvä tietää lyhyesti.

Amazonin linja on rajoittava ja muuttuu yhä rajoittavammaksi. Vahvimmat signaalit:

- Amazonin omat ohjesivut palauttavat nyt , jossa sanotaan: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- Amazonin kieltää laajan joukon dynaamisia, arvostelu-, profiili-, toivelista- ja tarjouslistauspolkuja.

- Amazonin vastustaa nimenomaisesti peiteltyä tai naamioitua agenttipääsyä, turvallisuustoimien kiertämistä ja agentin väärää tunnistamista Google Chromeksi. Amazon julkaisi asiasta myös .

- Amazon on OpenAI:n crawlereita vastaan loppuvuonna 2025.

Käytännön riski kasvaa selvästi, kun siirryt julkisista tuotepageista todennettuihin flow'hin, naamioituun automaatioon tai suuren volyymin kaupalliseen tiedonkeruuseen. Tämä ei ole juridista neuvontaa — konsultoi omaa lakitiimiäsi juuri sinun tilanteeseesi.

Keskeiset opit: miten saat luotettavaa Amazon-dataa ilman estoa

Tärkeysjärjestyksessä:

- Tee auditointi ennen kloonausta. Oleta, että useimmat GitHub-haut ovat vanhentuneita, tutoriaaleja tai kaupallisten API:en wrappereita.

- Päivitä ensin verkkokerros. TLS-jälki ja session eheys merkitsevät enemmän kuin HTML-valitsimet.

- Käytä sticky residential -sessioita, älä satunnaista proxykaaosta. Kierrä sessioiden välillä, älä niiden sisällä.

- Rytmitä pyynnöt kuin käyttäjä, ei stressitesti. Satunnaistetut viiveet ja eksponentiaalinen backoff ovat pakollisia.

- Ratkaise yksittäiset CAPTCHA:t; eläköitä toistuvasti haastetut sessiot. Älä brute forcettaa palanutta jälkeä.

- Pidä varasuunnitelma. Amazon muuttaa jotain kesken viikon, ja GitHub-scraperisi hajoaa. Ylläpidetty no-code-työkalu kuten tai hallittu API voi pitää dataputkesi hengissä sillä aikaa, kun debuggaat.

- Priorisoi tulostuslaatu. Puhdas, tyypitetty data säästää enemmän aikaa myöhemmin kuin nopea mutta sotkuinen scraper.

Jos haluat luotettavuutta mukautettavuuden sijaan, Thunderbit tarjoaa ylläpidetyn vaihtoehdon — tutustu tai katso opastusvideoita . Kehittäjät, jotka haluavat täyden hallinnan, voivat ehdottomasti käyttää GitHub-repoja — mutta vain tämän oppaan anti-ban- ja ylläpitokäytäntöjen kanssa.

Usein kysytyt kysymykset

Onko Amazon-tuotedatan scraping GitHub-scraperilla laillista?

Amazonin käyttöehdot rajoittavat automaattista tiedonkeruuta, ja Amazon on aktiivisesti valvonut tätä cease-and-desist-kirjeillä ja teknisillä vastatoimilla (erityisesti vuosina 2025–2026). Julkisesti saatavilla olevan tuotedatan scraping on harmaata aluetta; kirjautumisen takana olevan sisällön scrappaus tai botin naamioiminen oikeaksi selaimeksi kasvattaa riskiä. Tämä ei ole juridista neuvontaa — konsultoi lakitiimiäsi omaan käyttötapaustasi varten.

Kuinka usein Amazon scraper GitHub -repot hajoavat?

Usein. Amazon muuttaa sivuasetteluja, lisää uusia anti-bot-kerroksia ja poistaa endpointteja säännöllisesti. Tämän artikkelin auditoinnissa vain noin 3/8 laajasti esillä olleesta reposta vaikutti selvästi toimivilta vuonna 2026. Jopa "toimivissa" repoissa on usein avoimia issue'ta CAPTCHA- ja 503-virheistä. Varaudu selvittämään ongelmia tai päivittämään setupiasi muutaman viikon tai kuukauden välein.

Mikä on paras Amazon scraper GitHubissa vuonna 2026?

Yhtä voittajaa ei ole — se riippuu käyttötapauksesta ja teknisestä osaamisesta. Kevyeen, suoraan Python-scraperiin on yksi ajankohtaisemmista vaihtoehdoista. Laajempaan kattavuuteen hallitun API:n kautta toimii, mutta ei ole oikeasti DIY. Käytä tämän artikkelin tuoreustarkistuslistaa arvioidaksesi itse mitä tahansa repoa ennen sitoutumista.

Voiko Thunderbit scrapata Amazonia ilman koodausta?

Kyllä. Thunderbitin poimii tuotteen nimen, hinnan, ASINin, arvosanat, brändin, saatavuuden ja paljon muuta yhdellä klikkauksella. Se tukee selain-scraping-tilaa kirjautumista vaativille sivuille, pilviscrapingia julkisille sivuille nopeasti, ajastettua scrapingia toistuviin tehtäviin sekä ilmaista vientiä Google Sheetsiin, Airtableen, Notioniin ja Exceliin. Aloittamisen voit tehdä asentamalla .

Miten estän IP-osoitteeni joutumasta Amazonissa porttikieltoon?

Käytä kerroksittaista lähestymistapaa: (1) vaihda tavallisesta requests-kirjastosta TLS:ää impersonoivaan asiakkaaseen kuten curl_cffi, (2) käytä residential-proxyja sticky-sessioilla satunnaisen datacenter-kierrätyksen sijaan, (3) lisää satunnaistettu rytmitys ja eksponentiaalinen backoff, (4) pidä koko header-joukko linjassa selainprofiilisi ja markkinapaikan lokalen kanssa, ja (5) käsittele toistuvat CAPTCHA:t merkkinä siitä, että sessio pitää eläköittää, ei pulmana, jota ratkaistaan loputtomiin. Lisätietoja löydät tämän artikkelin aiemmasta anti-ban-päätösmatriisista.