Billeder er seriøst overalt — i produktgallerier, boligannoncer og konkurrentkataloger. Hvis du arbejder med salg, marketing eller research, har du helt sikkert stået og skulle hente dusinvis (eller hundredvis) af billeder fra websites.

Ingen orker at højreklikke og gemme 500 billeder ét ad gangen. Det er præcis derfor, billed-scraper-værktøjer findes.

Jeg har testet 10 muligheder hos — fra browserudvidelser til Python-biblioteker. Her er, hvad der faktisk fungerer bedst til forskellige behov.

Hvorfor du har brug for en billed-scraper i 2026

Visuelt indhold er ikke bare “noget pænt” — det er ren forretningsindsigt. Indlæg med billeder kan få op til , og engagement på sociale medier kan stige med , når du tilføjer visuals. Virksomheder scraper billeder til alt fra markedsresearch (fx at spotte trends i konkurrenters kataloger) til content-produktion (opbygning af produktbilledbanker) og endda AI-træning (fodring af modeller med mærkede fotos).

Men her er problemet: Websites er blevet mere besværlige at arbejde med. Billeder loader dynamisk, gemmer sig bag infinite scroll eller ligger på undersider. Manuelle downloads er langsomme, fejlbehæftede og — lad os være ærlige — totalt drænende. Og for ikke-tekniske teams kan det at skrive en skræddersyet crawler lige så godt være raketvidenskab.

Det er her, moderne billed-scraper-værktøjer kommer ind. De automatiserer det kedelige arbejde, håndterer komplekse sites og gør det muligt for alle — ja, selv din kollega der “kun bruger Excel” — at indsamle billeder i stor skala. Markedet for web scraping-software boomer og forventes at , og over bruger allerede web scraping til forretningsindsigt. Konklusionen? Hvis du ikke bruger en billed-scraper, er du allerede bagud.

Sådan udvalgte vi de bedste billed-scraper-værktøjer

Ikke alle billed-scrapere er skabt lige. Her er, hvad jeg gik efter, da jeg udvalgte top 10:

- Brugervenlighed: Kan en ikke-programmør få resultater på få minutter? Naturligt sprog, klik-baserede flows og hurtig feedback er kæmpe plusser.

- Eksportmuligheder: Kan værktøjet downloade billeder eller eksportere URL’er til Excel, Google Sheets, Notion eller via API? Integration er afgørende i forretningsflows.

- Tilpasning & fleksibilitet: Kan det håndtere login, dynamisk indhold eller speciallogik? Avancerede brugere har brug for mere end bare “Gem som”.

- Automatisering & planlægning: Kan du sætte det op én gang og lade det køre? Planlagte scrapes og cloud-kørsel er guld værd ved gentagne opgaver.

- Skalerbarhed: Går det i knæ ved 10.000 billeder? Værktøjer skal kunne klare både små og meget store jobs.

- Pris & værdi: Findes der en gratis version? Giver prisen mening for små teams, eller er det primært til enterprise-budgetter?

Med det i baghovedet får du her 10 billed-scraper-værktøjer, der er værd at kigge på i 2026 — hver med sine styrker, særheder og ideelle use cases.

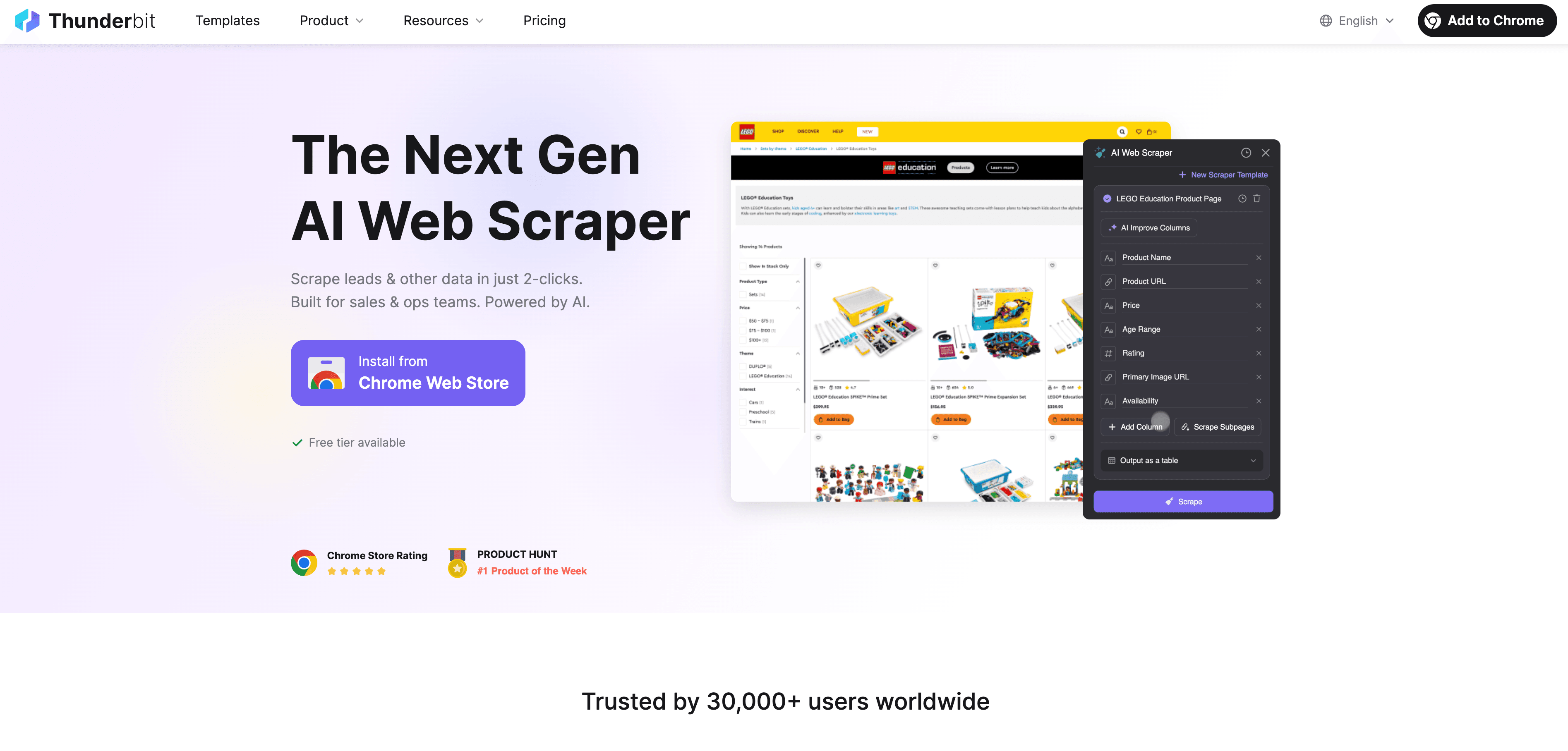

1. Thunderbit

er mit go-to valg til ikke-tekniske teams og alle, der vil udtrække billeder med mindst mulig bøvl. Som medstifter er jeg selvfølgelig lidt biased — men missionen har altid været at gøre web scraping så nemt, at selv din bedstemor kan være med (hvis hun altså går op i konkurrentanalyse).

Hvad gør Thunderbit særligt? Det handler om enkelhed. Klik på “AI Suggest Fields”, lad AI’en finde alle billeder (og andre felter du vil have), og tryk derefter “Scrape”. Thunderbit hopper automatisk ind på undersider, håndterer infinite scroll og eksporterer billeder direkte til Excel, Google Sheets, Airtable eller Notion. Du kan også bruge den gratis til at udtrække alle billeder på en side med ét klik — ingen opsætning, ingen kode.

Nøglefunktioner:

- Billedudtræk i 2 klik (AI klarer det tunge arbejde)

- Scraping af undersider (hent automatisk billeder fra detaljesider)

- Gratis udtræk af billeder/e-mails/telefonnumre

- Eksport med det samme til Sheets, Notion, Airtable, Excel, CSV eller JSON

- Gratis niveau (6 sider, ubegrænsede rækker), betalte planer fra 15 USD/måned

- Flersproget support (34 sprog)

- Ingen vedligeholdelse — AI tilpasser sig ændringer på websites

Bedst til: Salg, marketing og driftsteams, der vil have hurtige og præcise billeddata uden kode eller opsætning. Perfekt til at katalogisere konkurrentprodukter, indsamle boligfotos eller bygge content-biblioteker.

Vil du se, hvordan Thunderbit klarer sig i forhold til alternativerne, så læs vores .

2. ParseHub

er et stærkt valg, hvis du skal scrape billeder fra komplekse, dynamiske websites — fx infinite scroll, AJAX-indlæste gallerier eller sites, hvor du skal klikke dig gennem filtre og pop-ups.

Hvorfor ParseHub er stærk: Den visuelle workflow-editor gør det muligt at bygge scraping-logik i flere trin uden at skrive kode. Du kan tilføje betingelser, loops og variabler til de svære cases. ParseHub kan udfylde formularer, klikke på knapper og hente billeder, der først dukker op efter bestemte handlinger.

Nøglefunktioner:

- Visuel editor med avanceret logik (betingelser, loops)

- Håndterer JavaScript-tunge og dynamiske sider

- Cloud-planlægning og API-adgang

- Automatisk IP-rotation for at undgå blokering

- Eksport til CSV, JSON og integration med Tableau

Bedst til: Dataanalytikere, journalister eller researchere, der scraper komplekse sites og vil have fin kontrol uden at kode. Der er en gratis version (op til 200 sider pr. kørsel), men power users vil typisk vælge planen til 189 USD/måned for cloud og større volumen.

3. Octoparse

er en no-code favorit til at udtrække mange billeder ad gangen. Den regnearks-lignende brugerflade og auto-detektion gør den nem at gå til for ikke-tekniske brugere.

Hvorfor Octoparse er populær: Du peger og klikker på et billede eller en liste, og Octoparse’ AI foreslår, hvad der skal scrapes. Den er især stærk til paginering, infinite scroll og sider med login. Cloud-scraping og planlægning findes i betalte planer, så du kan køre store jobs uden at binde din egen computer.

Nøglefunktioner:

- No-code opsætning med peg-og-klik

- Auto-detektion af lister og billeder

- Håndterer paginering, infinite scroll og login

- Cloud-scraping og planlægning

- Eksport til CSV, Excel, JSON og databaser

Bedst til: Marketingteams, små virksomheder eller alle, der hurtigt skal hente mange billeder uden at kode. Gratis plan til små opgaver; betalte planer fra 119 USD/måned.

4.

er en enterprise-platform til dataudtræk, som også fungerer som en solid billed-scraper. Den interaktive brugerflade lader dig optage workflows (fx login, filtrering og klik gennem gallerier) og derefter køre dem i stor skala i skyen.

Det, der adskiller : Den er bygget til integration — scraped billeder og data kan sendes direkte til dashboards, BI-værktøjer eller databaser via API’er og webhooks. er også stærk til beskyttet eller dynamisk indhold.

Nøglefunktioner:

- Interaktiv workflow-optager

- Håndterer login, dynamisk indhold og beskyttede sider

- API/webhook-integration til analytics-workflows

- Managed services til enterprise-kunder

Bedst til: Mellemstore og store virksomheder, der har brug for stabil og skalerbar billedudtræk som del af en større datapipeline. Priser starter omkring 299 USD/måned, og der findes en gratis prøveperiode.

5. Apify

er en udviklervenlig automatiseringsplatform med en markedsplads af færdige “Actors” (forbyggede scrapers) samt mulighed for at kode dine egne i Node.js eller Python.

Hvorfor Apify er fleksibel: Du kan finde en Actor til populære sites (som Instagram eller Amazon) eller bygge en custom scraper til alt andet. Apifys cloud-infrastruktur håndterer planlægning, proxy-styring og skalering — så du kan scrape tusindvis af sider parallelt.

Nøglefunktioner:

- Actor-markedsplads (færdige scrapers til populære sites)

- Custom scripting i Node.js/Python

- Cloud-planlægning og storage

- Stærk API-integration

Bedst til: Udviklere, startups eller data engineers, der vil have programmerbar og skalerbar scraping. Gratis niveau til let brug; betalte planer fra 49 USD/måned.

6. Mozenda

er en enterprise-løsning med fokus på struktureret dataudtræk, inkl. billeder, filer og PDF’er. Den er nem at komme i gang med via peg-og-klik, men den store styrke ligger i automatisering, planlægning og teamstyring.

Hvorfor Mozenda er klar til enterprise: Den er bygget til driftssikkerhed — fx robust planlægning, notifikationer og workflow-automatisering. Mozenda kan samle data fra flere kilder, eksportere til forskellige formater og kan endda køre on-premises til følsomme projekter.

Nøglefunktioner:

- Visuel agent-builder (ingen kode)

- Håndterer komplekse sites, data i flere niveauer og billeder

- Planlægning, notifikationer og workflow-automatisering

- Teamsamarbejde og managed services

Bedst til: Store organisationer eller teams med løbende, forretningskritiske scraping-behov. Priser starter omkring 99 USD/måned, med tilpassede enterprise-muligheder.

7. VisualScraper

er et let og brugervenligt værktøj til hurtige billed-scraping-opgaver. Interfacet er enkelt — peg, klik og udtræk.

Hvorfor VisualScraper er praktisk: Den passer godt til små opgaver eller engangsprojekter. Du kan planlægge jobs, eksportere til CSV/JSON/XML og endda få resultater via e-mail eller FTP. Den er ikke lige så kraftig som de største spillere, men til basale behov er enkelheden (og prisen — gratis for de fleste) svær at slå.

Nøglefunktioner:

- Enkel peg-og-klik UI

- Live preview af data

- Planlægning og eksport i flere formater

- Gratis Windows-app til små opgaver

Bedst til: Privatpersoner, hobbybrugere eller små virksomhedsejere, der kun indimellem har brug for at scrape billeder uden en stejl læringskurve.

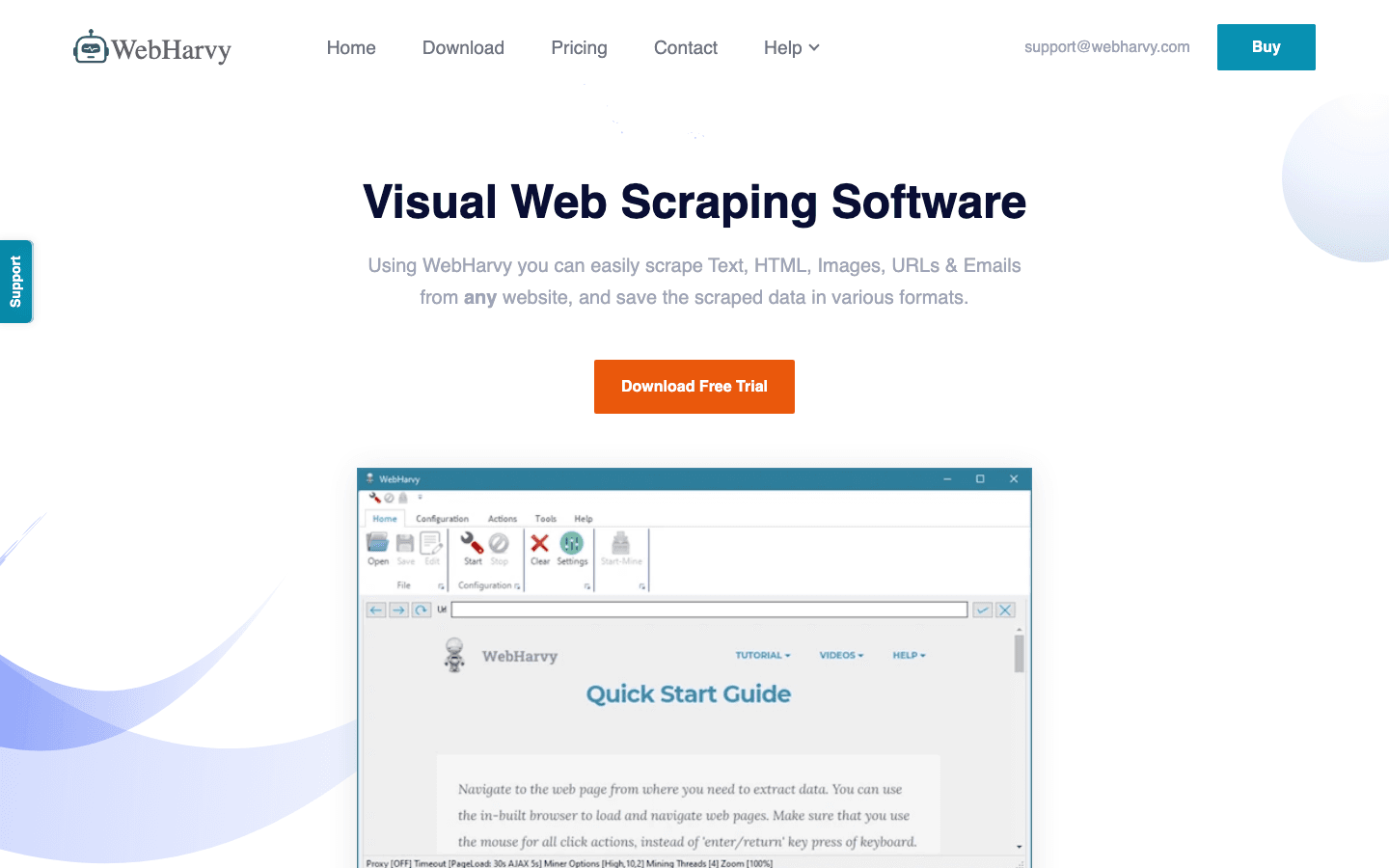

8. WebHarvy

er en Windows-baseret visuel scraper, kendt for smart mønstergenkendelse. Klik på ét billede, og WebHarvy finder og scraper automatisk alle lignende billeder på siden.

Hvorfor WebHarvy er smart: Den kan lave scraping i flere niveauer (fx hente galleri-billeder fra produktdetaljesider), udfylde formularer, klikke på knapper og endda køre custom JavaScript til svære sites. Det er et engangskøb, så du slipper for månedlige abonnementer.

Nøglefunktioner:

- Intelligent mønstergenkendelse

- Scraping i flere niveauer og galleribilleder

- Eksport til Excel, CSV, JSON, SQL

- Engangslicens (ingen abonnement)

Bedst til: Ikke-programmører, der vil have en blanding af enkelhed og avancerede funktioner — især på Windows. God til researchere og små virksomheder.

9. Diffbot

er AI-hjernen bag web data extraction. Giv den en URL (eller en million), og dens computer vision og NLP identificerer og udtrækker de vigtigste billeder — uden regler eller selectors.

Hvorfor Diffbot er anderledes: Den er API-first, ekstremt skalerbar og robust over for ændringer på websites (AI’en tilpasser sig automatisk). Diffbots Knowledge Graph gør det endda muligt at søge i en web-dækkende database af billeder og strukturerede data.

Nøglefunktioner:

- AI-drevet udtræk (ingen opsætning)

- Håndterer millioner af sider via API

- Returnerer billed-URL’er, metadata og tags

- Knowledge Graph til web-dækkende forespørgsler

Bedst til: Enterprise, AI-virksomheder eller dataleverandører, der har brug for enorme billeddatasæt uden vedligeholdelse. Gratis op til 10k API-kald/måned; betalte planer fra 299 USD/måned. Kræver typisk lidt kode at bruge.

10. Scrapy

er open source Python-frameworket til custom web scraping. Hvis du er udvikler, giver Scrapy dig fuld kontrol — skriv spiders til at crawle ethvert site, udtrække billeder og behandle dem præcis, som du vil.

Hvorfor Scrapy er kraftfuldt: Den indbyggede Images Pipeline automatiserer download af billeder, generering af thumbnails og filtrering efter størrelse eller format. Scrapy er hurtigt, skalerbart og har et stort økosystem af udvidelser til proxies, cloud crawling og meget mere.

Nøglefunktioner:

- Code-first og maksimal fleksibilitet

- Asynkron og hurtig crawling

- Indbygget download og behandling af billeder

- Gratis og open source

Bedst til: Udviklere og tekniske teams med custom eller storskala scraping-behov. Den eneste “pris” er din tid og serverressourcer.

Sammenligningstabel: billed-scraper-værktøjer

| Tool | Ease of Use | Export Formats | Automation/Scheduling | Best For | Pricing (approx.) |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Excel, Sheets, Notion | Yes | Non-tech teams, SMBs | Free, $15/mo+ |

| ParseHub | ★★★★☆ | CSV, JSON, Tableau | Yes (cloud) | Analysts, complex sites | Free, $189/mo+ |

| Octoparse | ★★★★☆ | CSV, Excel, JSON | Yes (cloud) | No-coders, bulk extraction | Free, $119/mo+ |

| Import.io | ★★★★☆ | API, CSV, DB | Yes (cloud) | Enterprise, BI integration | $299/mo+ |

| Apify | ★★★☆☆ | JSON, CSV, API | Yes (cloud) | Developers, scalable projects | Free, $49/mo+ |

| Mozenda | ★★★★☆ | CSV, Excel, API, DB | Yes | Enterprise, team workflows | $99/mo+ |

| VisualScraper | ★★★★☆ | CSV, JSON, XML, Email | Yes | Individuals, small projects | Free, $49/mo+ (cloud) |

| WebHarvy | ★★★★☆ | Excel, CSV, JSON, SQL | Yes | Non-coders, Windows users | $99 one-time |

| Diffbot | ★★★☆☆ | API (JSON, metadata) | Yes (API) | Enterprise, AI, devs | Free, $299/mo+ |

| Scrapy | ★★★☆☆ | Any (custom code) | Yes (custom) | Developers, custom pipelines | Free |

Sådan vælger du den rigtige billed-scraper til din virksomhed

Her er min hurtige beslutningsguide:

- Ikke-teknisk og vil have fart og enkelhed? Start med eller .

- Skal du scrape komplekse, dynamiske sites? Prøv eller .

- Enterprise og har brug for integration og support? Kig på , eller .

- Udvikler og vil have fuld kontrol? eller er de bedste valg.

- Har du bare brug for et hurtigt, gratis værktøj til små opgaver? er et solidt bud.

Udnyt altid gratis prøveperioder eller gratis niveauer — kør en lille test på dit målsite og se, hvilket værktøj der passer bedst til din arbejdsgang og dine databehov.

Konklusion: Find din ideelle billed-scraper til 2026

Webben er en visuel guldmine, der bare venter på at blive udnyttet — hvis du har den rigtige billed-scraper. Uanset om du bygger et produktkatalog, overvåger konkurrenter eller skal bruge brændstof til din næste virale kampagne, kan disse værktøjer spare dig for mange timer (og et par hovedpiner). Mit råd? Tag udgangspunkt i din konkrete use case, match den med et værktøj, der passer til dine kompetencer og dit budget, og vær ikke bange for at teste dig frem.

Hvis du vil opleve, hvor nemt billedudtræk kan være, så og prøv den. Din Ctrl+S-finger vil takke dig.

Vil du læse flere guides om scraping, så kig forbi .

FAQs

1. Hvad er et billed-scraper-værktøj, og hvordan fungerer det?

Et billed-scraper-værktøj automatiserer processen med at udtrække billeder (eller deres URL’er) fra websites. De fleste værktøjer lader dig angive, hvad der skal scrapes (via AI, peg-og-klik eller kode), og derefter indsamle og eksportere billeder i bulk — så du sparer timevis af manuelt arbejde.

2. Kan jeg bruge billed-scraper-værktøjer uden at kunne kode?

Ja. Værktøjer som , og er lavet til ikke-tekniske brugere med naturligt sprog eller visuelle interfaces.

3. Hvad er forskellen på gratis og betalte billed-scraper-værktøjer?

Gratis værktøjer er fine til små, sporadiske opgaver, men har ofte begrænsninger på volumen, funktioner eller support. Betalte værktøjer giver mere automatisering, cloud-kørsel og avancerede funktioner — ideelt til forretnings- og enterprise-behov.

4. Hvordan eksporterer jeg billeder til Excel, Google Sheets eller Notion?

De fleste moderne scrapers (som ) kan eksportere direkte til Excel, Sheets, Notion eller Airtable med ét klik. Andre tilbyder CSV/JSON-downloads eller API-integration til custom workflows.

5. Er det lovligt at scrape billeder fra alle websites?

Du bør altid respektere et websites vilkår og ophavsret. Scrape kun offentligt tilgængelige billeder, og undgå at bruge scraped indhold kommercielt uden tilladelse. Er du i tvivl, så tal med juridisk rådgivning eller brug materialet til intern analyse.

Klar til at gøre billedudtræk til den nemmeste del af din arbejdsgang? Prøv et par værktøjer fra listen og se, hvilket der passer bedst — dit næste store projekt kan være et scrape væk.

Læs mere: