Hvis du nogensinde har prøvet at bygge en målrettet salgsliste, finde nye markeder eller benchmarke konkurrenter, ved du, at Google Maps er en sand guldmine. Men her er det afgørende: Med over 1,5 milliarder søgninger med “nær mig” hver måned og 76 % af lokale søgere, der besøger en virksomhed inden for 24 timer (), har efterspørgslen på opdaterede, lokationsbaserede virksomhedsdata aldrig været større.

Uanset om du arbejder med salg, marketing eller drift, kan udtræk af strukturerede data fra Google Maps være forskellen på et koldt opkald og et varmt lead med høj konvertering.

Jeg har arbejdet i årevis med SaaS og automation, og jeg har set på første hånd, hvordan teams bruger Python (og nu AI-drevne værktøjer som ) til at gøre Google Maps til et strategisk aktiv.

I denne guide gennemgår jeg præcis, hvordan du udtrækker Google Maps-data med Python i 2026 — trin for trin, med kode, compliance-tips og en sammenligning med no-code-løsninger. Uanset om du er Python-ekspert eller bare vil have den hurtigste vej til brugbare data, er du kommet til det rette sted.

Hvad vil det sige at udtrække Google Maps med Python?

Lad os starte med det grundlæggende: at udtrække Google Maps med Python betyder, at man programmæssigt henter virksomhedsoplysninger — som navne, adresser, vurderinger, anmeldelser, telefonnumre og koordinater — fra Google Maps, så man kan analysere, filtrere og eksportere dem til forretningsbrug.

Der er to primære måder at gøre det på:

- Google Maps Places API: Den officielle, licenserede metode. Du bruger en API-nøgle til at forespørge Google’s servere og få strukturerede JSON-data retur. Det er stabilt, forudsigeligt og (for det meste) compliant, men det kommer med kvoter og omkostninger.

- Web scraping af HTML: Du automatiserer en browser (med værktøjer som Playwright eller Selenium) for at indlæse Google Maps, udføre søgninger og parse den renderede side. Det er mere fleksibelt, men også mere skrøbeligt — Google ændrer ofte sin sidestruktur, og scraping af HTML kan være i strid med Google’s vilkår.

Typiske datafelter, du kan udtrække:

- Virksomhedsnavn

- Kategori/type

- Fulde adresseoplysninger (plus by, stat, postnummer, land)

- Breddegrad og længdegrad

- Telefonnummer

- Website-URL

- Bedømmelse og antal anmeldelser

- Prisniveau

- Virksomhedsstatus (åben/lukket)

- Åbningstider

- Place ID (Googles unikke identifikator)

- Google Maps-URL

Hvorfor er det vigtigt? Fordi disse felter driver alt fra leadgenerering og områdplanlægning til konkurrentbenchmarking og markedsanalyse. Nøglen er at målrette de rigtige data til dine forretningsmål — du skal ikke bare scrape løs uden plan.

Hvorfor salgs- og marketingteams udtrækker data fra Google Maps med Python

Lad os gøre det konkret. Hvorfor er så mange salgs- og marketingteams optagede af Google Maps-data i 2026?

- Leadgenerering: Byg hypermålrettede lister over lokale virksomheder med kontaktinfo og vurderinger til outreach-kampagner.

- Områdplanlægning: Kortlæg salgsterritorier, leveringszoner eller serviceområder baseret på reel virksomhedstæthed og virksomhedstyper.

- Konkurrentovervågning: Følg konkurrenters placeringer, vurderinger og anmeldelser over tid for at spotte trends og muligheder.

- Markedsanalyse: Analyser virksomhedskategorier, åbningstider og stemningen i anmeldelser for at understøtte go-to-market-strategier.

- Lokationsvalg: For ejendom og detailhandel kan du vurdere mulige placeringer ud fra nærliggende faciliteter, kundestrøm og konkurrence.

Effekt i praksis: Ifølge planlægger 92 % af salgsorganisationer at øge investeringerne i AI/data, og teams, der bruger målrettede, lokale data, ser konverteringsrater op til 8× højere end dem, der bygger på generiske cold lists (). En undersøgelse af leadgenerering for franchiser viste endda 15 $ i ny omsætning for hver 1 $ brugt på leadlister baseret på Google Maps.

Kobling mellem forretningsmål og Google Maps-felter:

| Forretningsmål | Nødvendige Google Maps-felter |

|---|---|

| Lokal leadliste | name, address, phone, website, category |

| Områdplanlægning | name, lat/lng, business_status, opening_hours |

| Konkurrentbenchmarking | name, rating, userRatingCount, priceLevel, reviews |

| Lokationsvalg | category, lat/lng, review density, openingDate |

| Sentiment/menu-intel | reviews, editorialSummary, photos, types |

| Email-/telefon-outreach | nationalPhoneNumber, websiteUri (berig derefter efter behov) |

Sådan opsætter du din Python Google Maps-scraper: værktøjer og krav

Før du går i gang med scraping, skal du sætte dit Python-miljø op og samle de rigtige værktøjer. Her er, hvad du skal bruge i 2026:

1. Installer Python og de nødvendige biblioteker

Anbefalet Python-version: 3.10 eller nyere.

Installer de vigtigste biblioteker:

1pip install \

2 requests==2.33.1 httpx==0.28.1 \

3 beautifulsoup4==4.14.3 lxml==6.0.3 \

4 pandas==2.3.3 \

5 selenium==4.43.0 playwright==1.58.0 \

6 googlemaps==4.10.0 google-maps-places==0.8.0 \

7 schedule==1.2.2 APScheduler==3.11.2 \

8 python-dotenv==1.2.2 tenacity==9.1.4

9playwright install chromiumHvad disse gør:

requests,httpx: HTTP-forespørgsler (API-kald)beautifulsoup4,lxml: HTML-parsing (til web scraping)pandas: Datavask, analyse, eksportselenium,playwright: Browserautomatisering (til HTML scraping)googlemaps,google-maps-places: Google Maps API-klienterschedule,APScheduler: Opgaveskemaerpython-dotenv: Indlæs API-nøgler sikkert fra.env-filertenacity: Retry-logik til fejlhåndtering

2. Få en Google Maps API-nøgle (til API-baseret scraping)

- Gå til .

- Opret eller vælg et projekt.

- Aktivér fakturering (påkrævet, også ved gratis forbrug).

- Aktivér “Places API (New)” under APIs & Services > Library.

- Gå til Credentials > Create Credentials > API Key.

- Begræns din nøgle til specifikke API’er og IP’er af sikkerhedshensyn.

- Gem API-nøglen i en

.env-fil (committ aldrig nøglen i kode):

1GOOGLE_MAPS_API_KEY=your_actual_api_key_hereBemærk: Pr. marts 2025 tilbyder Google ikke længere en universel gratis kredit på 200 $ om måneden. I stedet får du gratis månedlige tærskler pr. API-niveau (se ).

Sådan udtrækker du data fra Google Maps med Python: trin-for-trin guide

Lad os gennemgå de to vigtigste tilgange — API-baseret og HTML scraping — så du kan vælge det, der passer til dit behov.

Tilgang 1: Brug Google Maps Places API (anbefalet)

Trin 1: Installer og importér de nødvendige biblioteker

1import os

2import httpx

3import pandas as pd

4from dotenv import load_dotenvTrin 2: Indlæs din API-nøgle sikkert

1load_dotenv()

2API_KEY = os.environ["GOOGLE_MAPS_API_KEY"]Trin 3: Byg din søgeforespørgsel

Du bruger Text Search-endpointet til at finde virksomheder, der matcher dine kriterier.

1URL = "https://places.googleapis.com/v1/places:searchText"

2FIELD_MASK = ",".join([

3 "places.id", "places.displayName", "places.formattedAddress",

4 "places.location", "places.rating", "places.userRatingCount",

5 "places.priceLevel", "places.types",

6 "places.nationalPhoneNumber", "places.websiteUri",

7 "nextPageToken",

8])Trin 4: Send API-forespørgslen

1def text_search(query, lat, lng, radius=3000, min_rating=4.0):

2 body = {

3 "textQuery": query,

4 "minRating": min_rating, # server-side filter

5 "includedType": "restaurant",

6 "openNow": False,

7 "pageSize": 20,

8 "locationBias": {

9 "circle": {

10 "center": {"latitude": lat, "longitude": lng},

11 "radius": radius,

12 }

13 },

14 }

15 headers = {

16 "Content-Type": "application/json",

17 "X-Goog-Api-Key": API_KEY,

18 "X-Goog-FieldMask": FIELD_MASK, # Always set this!

19 }

20 r = httpx.post(URL, json=body, headers=headers, timeout=30)

21 r.raise_for_status()

22 return r.json()Trin 5: Håndtér pagination og saml resultaterne

1def collect_all_results(query, lat, lng, radius=3000, min_rating=4.0):

2 results = []

3 next_page_token = None

4 while True:

5 data = text_search(query, lat, lng, radius, min_rating)

6 places = data.get('places', [])

7 results.extend(places)

8 next_page_token = data.get('nextPageToken')

9 if not next_page_token:

10 break

11 return resultsTrin 6: Eksportér data med Pandas

1df = pd.DataFrame(collect_all_results("coffee shops in Brooklyn", 40.6782, -73.9442))

2df.to_csv("brooklyn_coffee_shops.csv", index=False)Pro-tip:

- Sæt altid

X-Goog-FieldMask-headeren for at styre omkostningerne. Hvis du beder om anmeldelser eller fotos, kan din pris pr. 1.000 forespørgsler stige fra 5 $ til 25 $ (). - Brug server-side filtre (som

minRating,includedType,locationBias) for at undgå at spilde kredit på irrelevante resultater. - Cache

place_id-værdier til deduplikering og fremtidige opdateringer.

Tilgang 2: Webscraping af Google Maps HTML (til undervisning eller enkeltstående brug)

Advarsel: Google Maps er en single-page app. Du skal bruge browserautomatisering (Playwright eller Selenium), og scraping af HTML kan være i strid med Google’s vilkår. Brug dette til research, ikke til produktion.

Trin 1: Installer Playwright og start en browser

1from playwright.sync_api import sync_playwright

2import time, re

3def scrape_maps(query, max_results=100):

4 with sync_playwright() as pw:

5 browser = pw.chromium.launch(headless=True)

6 ctx = browser.new_context(

7 user_agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

8 locale="en-US",

9 )

10 page = ctx.new_page()

11 page.goto("https://www.google.com/maps", timeout=60_000)

12 page.fill("#searchboxinput", query)

13 page.click('button[aria-label="Search"]')

14 page.wait_for_selector('div[role="feed"]')

15 feed = page.locator('div[role="feed"]')

16 prev = 0

17 while True:

18 feed.evaluate("el => el.scrollBy(0, el.scrollHeight)")

19 time.sleep(2)

20 count = page.locator('div[role="feed"] > div > div[jsaction]').count()

21 if count == prev or count >= max_results:

22 break

23 prev = count

24 if page.locator("text=You've reached the end of the list").count():

25 break

26 rows = []

27 cards = page.locator('div[role="feed"] > div > div[jsaction]')

28 for i in range(cards.count()):

29 c = cards.nth(i)

30 name = c.locator("div.fontHeadlineSmall").inner_text() if c.locator("div.fontHeadlineSmall").count() else ""

31 rating_el = c.locator('span[role="img"]').first

32 raw = rating_el.get_attribute("aria-label") if rating_el.count() else ""

33 m = re.search(r"([\d.]+)\s+stars?\s+([\d,]+)\s+Reviews", raw or "")

34 rating = float(m.group(1)) if m else None

35 reviews = int(m.group(2).replace(",", "")) if m else None

36 rows.append({"name": name, "rating": rating, "reviews": reviews})

37 browser.close()

38 return rowsTips:

- Google randomiserer CSS-klasser hver few uger, så denne kode kan kræve løbende opdateringer.

- Brug menneskelignende pauser og undgå at scrape for hurtigt for at reducere risikoen for at blive blokeret.

- Forsøg aldrig at omgå CAPTCHA’er eller Googles SearchGuard-system — det kan udsætte dig for juridisk risiko.

Undgå blind scraping: sådan målretter du præcist de data, du har brug for

At scrape alt er en opskrift på spildtid og oppustede datasæt. Her er, hvordan du kun målretter de data, der betyder noget:

- Generér målrettede URL-lister: Brug Google Maps’ egne søgefiltre (kategori, lokation, vurdering, åben nu) til at indsnævre resultaterne før scraping.

- Brug frase-matchning: Søg efter præcise virksomhedstyper eller nøgleord (fx “vegan bakery in Austin”).

- Lokationsfiltre: Angiv by, kvarter eller endda koordinater og radius for præcis træfsikkerhed.

- Server-side filtrering (API): Brug

minRating,includedTypeoglocationBiasi din API-request body. - Client-side filtrering (Python): Efter scraping kan du bruge pandas til at filtrere virksomheder med vurderinger over 4,0, mere end 50 anmeldelser eller bestemte kategorier.

Eksempel: Filtrér kun restauranter på Manhattan med vurderinger over 4,0

1df = pd.DataFrame(results)

2filtered = df[(df['rating'] >= 4.0) & (df['types'].apply(lambda x: 'restaurant' in x))]

3filtered.to_csv("manhattan_top_restaurants.csv", index=False)Brug Python-biblioteker til at organisere og eksportere Google Maps-data

Når du har scraped dine data, er det tid til at rense, analysere og eksportere dem til dit team.

Rens og strukturer data med Pandas

1import pandas as pd

2df = pd.read_json("brooklyn_restaurants.json")

3df = (

4 df.dropna(subset=["name", "address"])

5 .drop_duplicates(subset=["place_id"])

6 .assign(

7 name=lambda d: d["name"].str.strip(),

8 phone=lambda d: d["phone"].astype(str)

9 .str.replace(r"\D", "", regex=True)

10 .str.replace(r"^1?(\d{10})$", r"+1\1", regex=True),

11 rating=lambda d: pd.to_numeric(d["rating"], errors="coerce"),

12 user_ratings_total=lambda d: pd.to_numeric(

13 d["user_ratings_total"], errors="coerce"

14 ).fillna(0).astype("int32"),

15 )

16)Analyser og opsummer data

Eksempel: Gennemsnitlig vurdering efter kvarter

1by_neighborhood = (

2 df.groupby("neighborhood", as_index=False)

3 .agg(avg_rating=("rating", "mean"),

4 n_places=("place_id", "nunique"),

5 median_reviews=("user_ratings_total", "median"))

6 .sort_values("avg_rating", ascending=False)

7)Eksportér til Excel eller CSV

1df.to_csv("brooklyn_top.csv", index=False)

2df.to_excel("brooklyn_top.xlsx", index=False, sheet_name="Top Rated")Store datasæt? Brug Parquet-format for hurtighed og mindre filstørrelse:

1df.to_parquet("brooklyn_top.parquet", compression="zstd")Thunderbit: AI-drevet alternativ til Python Google Maps-scraper

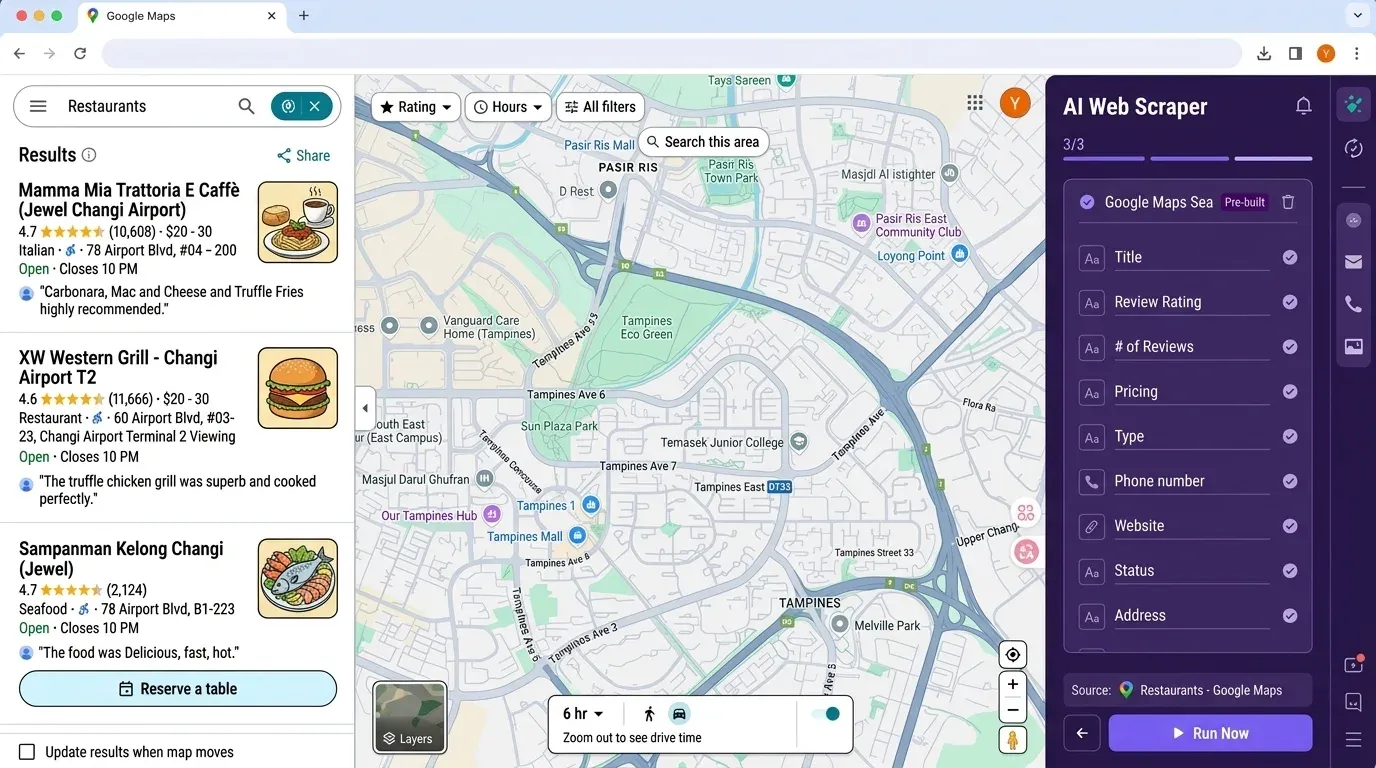

Hvis du tænker: “Det her er meget opsætning for en simpel leadliste,” er du ikke alene. Det er netop derfor, vi byggede — en AI-drevet, no-code web scraper, der gør det lige så let som et par klik at udtrække Google Maps-data (og meget mere).

Hvorfor Thunderbit?

- Ingen kodning eller API-nøgler kræves: Åbn bare , gå til Google Maps, og klik på “AI Foreslå felter”.

- AI-feltgenkendelse: Thunderbits AI læser siden og foreslår de rigtige kolonner — navn, adresse, vurdering, telefon, website og mere.

- Subpage scraping: Vil du berige din tabel med data fra hver virksomheds website? Thunderbit kan besøge hver underside og hente ekstra info automatisk.

- Eksport til Excel, Google Sheets, Airtable eller Notion: Slut med at rode med pandas — klik bare på “Eksportér”, så er data klar til teamet.

- Planlagt scraping: Opret tilbagevendende jobs til at overvåge konkurrenter eller opdatere din leadliste automatisk.

- Ingen vedligeholdelse: Thunderbits AI tilpasser sig ændringer på siden, så du slipper for konstant at reparere ødelagte scripts.

Thunderbit vs. Python-workflow:

| Trin | Python-scraper | Thunderbit |

|---|---|---|

| Installér værktøjer | 30–60 min. (Python, pip, biblioteker) | 2 min. (Chrome-udvidelse) |

| Opsætning af API-nøgle | 10–30 min. (Cloud Console) | Ikke nødvendigt |

| Valg af felter | Manuel kode, field masks | AI Foreslå felter (1 klik) |

| Dataudtræk | Skriv/kør scripts, håndtér fejl | Klik på “Scrape” |

| Eksport | pandas til CSV/Excel | Eksportér til Excel/Sheets/Notion |

| Vedligeholdelse | Manuelle opdateringer ved ændringer | AI tilpasser sig automatisk |

Bonus: Thunderbit har over , og gratisniveauet lader dig scrape op til 6 sider (eller 10 med en prøveforøgelse) uden omkostninger.

Overhold reglerne: Google Maps’ servicevilkår og scraping-etik

Det er her, mange Python-guides bliver farligt forældede. Her er, hvad du skal vide i 2026:

- Google Maps Platform ToS §3.2.3 forbyder udtrykkeligt scraping, caching eller eksport af data uden for de officielle API’er (). Den eneste undtagelse: bredde-/længdegrad kan caches i op til 30 dage; Place IDs kan gemmes ubegrænset.

- API-brugere er bundet af kontrakt: Hvis du bruger en API-nøgle, har du accepteret Google’s vilkår — også selv om du kun scraper offentlige data.

- Omgåelse af tekniske barrierer (CAPTCHA’er, SearchGuard) kan nu være en mulig overtrædelse af DMCA §1201, hvilket kan medføre strafferetlige sanktioner ().

- GDPR og privatlivslovgivning: Hvis du indsamler persondata (emails, telefonnumre, anmeldernavne) fra Google Maps, skal du have et lovligt grundlag og respektere sletningsanmodninger. Den franske CNIL bødebelagde KASPR med 200.000 € i 2024 for scraping af LinkedIn-kontakter ().

- Best practices:

- Brug som udgangspunkt Places API, hvor det er muligt.

- Rate-limit forespørgsler (≤10 QPS for API, 1–2 req/s for HTML scraping).

- Omgå aldrig CAPTCHA’er eller tekniske blokeringer.

- Genuddel ikke scraped persondata.

- Respekter frameldings- og sletningsanmodninger.

- Gennemgå altid lokale love — GDPR, CCPA og andre håndhæves aktivt.

Kort sagt: Hvis compliance er en bekymring, så hold dig til API’en og minimer mængden af data, du indsamler. For de fleste forretningsbrugere reducerer et no-code-værktøj som Thunderbit din risiko betydeligt (ingen API-nøgle, ingen videreformidling).

Planlægning og automatisering af din Google Maps-scraping med Python

Hvis du skal holde dine data friske — fx til ugentlig konkurrentovervågning eller månedlige opdateringer af leadlister — er automation din ven.

Simpel planlægning med schedule

1import schedule, time

2from my_scraper import run_job

3schedule.every().day.at("03:00").do(run_job, query="restaurants in Brooklyn")

4schedule.every(6).hours.do(run_job, query="coffee shops in Manhattan")

5while True:

6 schedule.run_pending()

7 time.sleep(30)Produktionsklar planlægning med APScheduler

1from apscheduler.schedulers.background import BackgroundScheduler

2from apscheduler.triggers.cron import CronTrigger

3sched = BackgroundScheduler(timezone="America/New_York")

4sched.add_job(

5 run_job,

6 CronTrigger(hour=3, minute=15, jitter=600), # 3:15 AM ± 10 min

7 kwargs={"query": "restaurants in Brooklyn"},

8 id="brooklyn_daily",

9 max_instances=1,

10 coalesce=True,

11 misfire_grace_time=3600,

12)

13sched.start()Tips til sikker automatisering

- Tilføj tilfældig jitter til din planlægning for at undgå forudsigelige mønstre.

- Ved HTML scraping bør du aldrig køre mere end 1–2 forespørgsler i sekundet.

- Ved API-brug skal du overvåge dit forbrug og opsætte faktureringsalarmer.

- Log altid fejl og hav en “dead-letter”-fil til forespørgsler, der fejler.

Thunderbit-bonus: Med Thunderbit kan du planlægge tilbagevendende scraping direkte i UI’et — ingen kode, ingen cron-jobs, ingen serveropsætning.

Vigtigste pointer: effektiv, målrettet og compliant dataudtræk fra Google Maps

Lad os opsummere det vigtigste:

- Google Maps er den største kilde til virksomheds- og lokationsdata, og driver alt fra leadgenerering til markedsanalyse.

- Python scraping giver fleksibilitet og kontrol, men kræver opsætning, vedligeholdelse og compliance-arbejde — især i takt med, at Googles anti-bot-foranstaltninger og håndhævelse skærpes.

- API-baseret udtræk er den sikreste og mest skalerbare vej for de fleste teams. Brug altid field masks og server-side filtre til at styre omkostningerne.

- HTML scraping er skrøbeligt og risikabelt — brug det kun til enkeltstående research, og omgå aldrig tekniske barrierer.

- Målret dine data: Brug frase-matchning, lokationsfiltre og pandas-workflows til kun at udtrække det, du har brug for.

- Thunderbit er den hurtigste vej for ikke-kodere: AI-drevet, ingen opsætning, øjeblikkelig eksport og indbygget planlægning.

- Compliance betyder noget: Respekter Google’s vilkår, privatlivslovgivning og rate limits for at undgå juridiske problemer.

For flere tutorials og tips, tjek og vores .

Ofte stillede spørgsmål

1. Er det lovligt at scrape Google Maps-data med Python i 2026?

Scraping af Google Maps via den officielle API er tilladt inden for Google’s vilkår, så længe du respekterer kvoter og ikke genuddeler begrænsede data. HTML scraping af Google Maps er udtrykkeligt forbudt af Google’s ToS og indebærer juridisk risiko, især hvis du omgår tekniske barrierer eller indsamler persondata uden samtykke. Tjek altid lokale love (GDPR, CCPA osv.) og følg best practices for compliance.

2. Hvad er forskellen på at bruge Google Maps API og webscraping af HTML?

API’en er stabil, licenseret og designet til dataudtræk, men kræver en API-nøgle og er underlagt kvoter og omkostninger. HTML scraping bruger browserautomatisering til at hente data fra den renderede side, men er skrøbelig (siden ændrer sig ofte), kan være i strid med vilkår og er juridisk mere risikabelt. Til de fleste forretningsbehov er API’en den anbefalede vej.

3. Hvad koster det at udtrække data fra Google Maps med Python i 2026?

Google’s Places API-priser er pr. 1.000 forespørgsler og ligger fra 5 $ (Essentials) til 25 $ (Enterprise+Atmosphere), afhængigt af hvilke felter du beder om. Der er gratis månedlige tærskler (10.000 for Essentials, 5.000 for Pro, 1.000 for Enterprise), men scraping i stor skala kan hurtigt blive dyrt. Brug altid field masks og server-side filtre til at styre omkostningerne.

4. Hvordan sammenligner Thunderbit sig med Python-baserede Google Maps-scrapere?

Thunderbit er en no-code, AI-drevet webscraper, der lader dig udtrække Google Maps-data (og meget mere) uden programmering, API-nøgler eller vedligeholdelse. Det er ideelt til salgs- og marketingteams, der vil have hurtige, pålidelige eksportmuligheder til Excel, Google Sheets, Airtable eller Notion. For tekniske brugere, der har brug for speciallogik, giver Python mere fleksibilitet, men kræver mere opsætning og compliance-håndtering.

5. Hvordan kan jeg automatisere tilbagevendende udtræk af Google Maps-data?

Med Python kan du bruge planlægningsbiblioteker som schedule eller APScheduler til at køre din scraper med faste intervaller (dagligt, ugentligt osv.). Tilføj tilfældig jitter for at undgå opdagelse, og overvåg din API-kvote. Med Thunderbit kan du planlægge tilbagevendende scraping direkte i UI’et — ingen kode eller serveropsætning kræves.

Klar til at gøre Google Maps til din superkraft inden for salg og marketing? Uanset om du er Python-entusiast eller vil have den hurtigste no-code-løsning, findes værktøjerne her i 2026. Prøv for øjeblikkelig, AI-drevet scraping — eller smøg ærmerne op og dyk ned i API’en. Uanset hvad: må dine leadlister være friske, dine eksportfiler rene, og dine kampagner fulde af lokale prospects med høj konverteringsrate. God scraping!

Læs mere