Web scraping er ikke længere kun for kodere og data scientists. Med et boom i no-code-værktøjer kan næsten alle indsamle data fra websites — hvis de vælger det rigtige værktøj. ParseHub er et af de mest kendte navne i feltet og lover at gøre web scraping tilgængeligt for alle. Men holder det virkelig, især for begyndere? Og findes der bedre og nemmere alternativer til dem, der vil have resultater hurtigt uden en stejl læringskurve?

Hvis du overvejer ParseHub til dit næste data-projekt, eller du har prøvet det og er blevet frustreret, er du landet det rigtige sted. Jeg har brugt timer på at dykke ned i brugeranmeldelser, teste funktioner og sammenligne ParseHub med nyere og mere brugervenlige løsninger — især , den AI-drevne Chrome-udvidelse, som hurtigt er ved at blive en favorit blandt erhvervsbrugere, marketingfolk og alle, der vil scrape data med blot et par klik. I dette indlæg gennemgår jeg, hvad ParseHub tilbyder, hvem det er bedst til, hvor det kommer til kort, og hvorfor Thunderbit måske er det bedre valg for de fleste ikke-tekniske brugere i 2025.

Hvad er ParseHub?

ParseHub er en virksomhed fra Toronto, grundlagt i 2013, og den har opbygget et ry som et stærkt no-code web scraping-værktøj. Grundideen er enkel: I stedet for at skrive kode bruger du en visuel grænseflade til at vælge de data, du vil hente fra et hvilket som helst website. ParseHubs desktop-app (tilgængelig til Windows, Mac og Linux) lader dig åbne en side, klikke på de elementer, du vil udtrække, og så klarer den det tunge arbejde — scraper data og eksporterer det i formater som CSV eller JSON.

Vigtige produkter og funktioner:

- Visuel point-and-click-scraping: Vælg dataelementer direkte på siden.

- Understøttelse af dynamisk indhold: Håndterer AJAX, formularer, login og uendelig scrolling.

- Cloud-baseret planlægning: Kør scraping efter en tidsplan fra ParseHubs servere.

- Automatisk IP-rotation: Hjælper med at undgå blokering fra websites.

- Avancerede selectors: Brug XPath eller regex til mere kompliceret dataudtræk.

- REST API og webhooks: Integrer med andre apps eller automatiser workflows.

- På tværs af platforme: Fungerer på Windows, Mac og Linux.

ParseHubs mål er at gøre web-dataudtræk tilgængeligt for folk uden kodeerfaring, men værktøjet indeholder også nok kraft til mere avancerede brugere, der vil automatisere komplekse scraping-opgaver.

Hvem er ParseHub til?

ParseHub markedsfører sig som en no-code-løsning til alle, der har brug for webdata, men ikke vil skrive scripts. I praksis er målgruppen primært:

- Marketingfolk, der følger konkurrenters priser eller produktlister.

- Forskere, der indsamler anmeldelser, nyheder eller akademiske data.

- Dataanalytikere, som har brug for strukturerede data fra webben.

- Erhvervsbrugere, der vil automatisere gentagen dataindsamling.

Udviklere bruger nogle gange ParseHub til hurtige opgaver eller til at automatisere rutinemæssig scraping, men det egentlige sweet spot er begyndere og brugere på mellem-niveau — folk, der har behov for data, men kun lidt eller slet ingen programmeringserfaring. Hvis du er marketingansvarlig, ejendomsmægler eller ejer af en lille virksomhed og bare vil have data ind i et regneark, er ParseHub meningen at skulle passe godt.

ParseHubs prisplaner

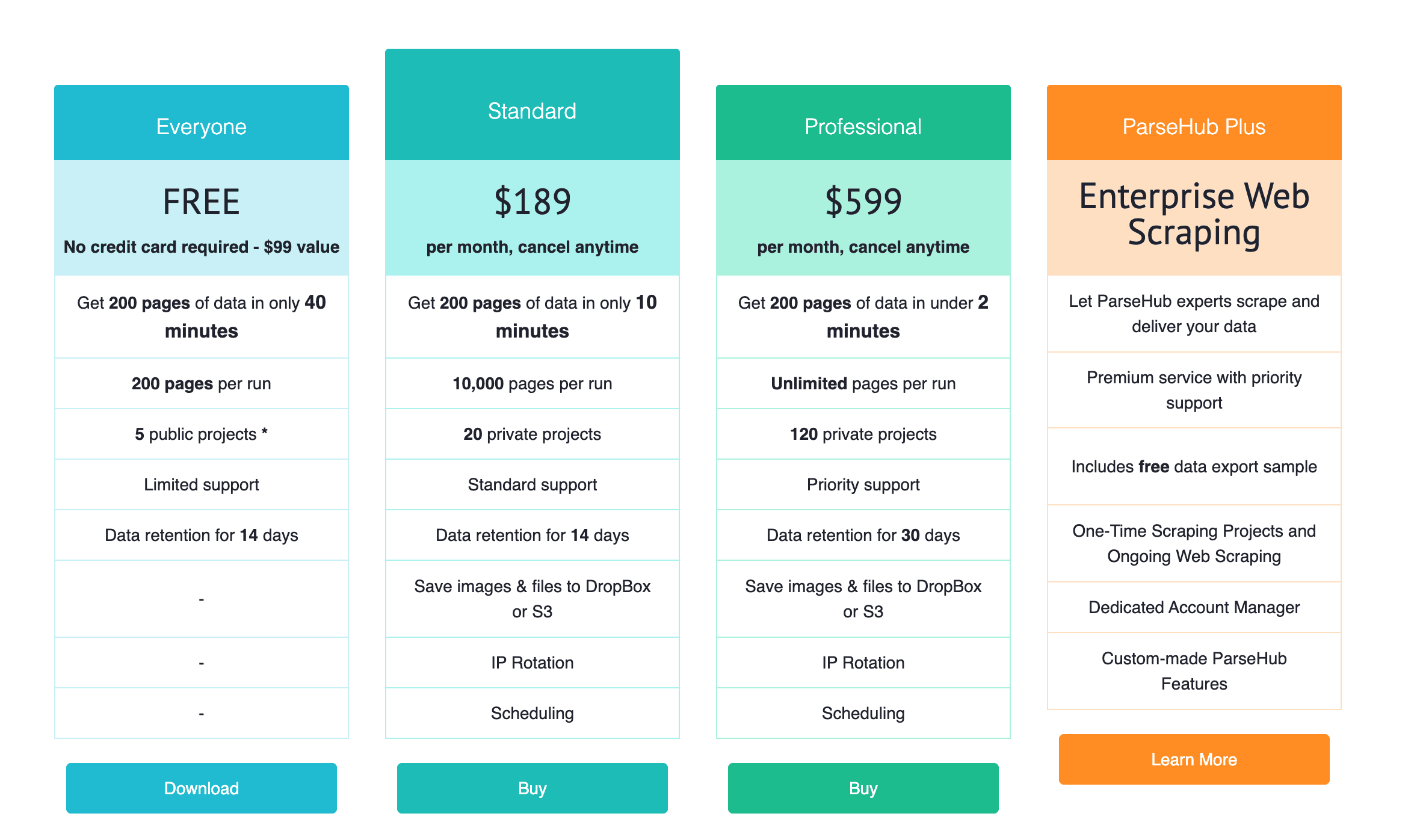

Pris er en stor faktor, når du vælger en web scraper, især hvis du lige er startet eller arbejder med et lille team. Sådan er ParseHubs planer skruet sammen:

- Gratis plan:

- Op til 5 offentlige projekter (dine scrapers er synlige for fællesskabet)

- Scrape op til 200 sider pr. kørsel (ca. 200 sider på 40 minutter)

- Begrænset support, data gemmes i 14 dage

- God til små engangsprojekter eller til at teste værktøjet

- Standardplan ($189/måned):

- 20 private projekter

- Scrape op til 10.000 sider pr. kørsel (200 sider på ca. 10 minutter)

- Planlægning, IP-rotation, gem filer til Dropbox/S3

- Standard support

- Professional-plan ($599/måned):

- 120 private projekter

- Ubegrænsede sider pr. kørsel (200 sider på under 2 minutter)

- 30 dages datalagring, prioriteret support

- Enterprise (ParseHub Plus):

- Skræddersyet pris

- “Done-for-you”-scraping udført af ParseHub-teamet

- Dedikeret account manager, tilpassede funktioner

Den gratis plan er generøs nok til små projekter, men hvis du skal scrape tusindvis af sider eller vil have private projekter, skal du opgradere — og de betalte planer ligger bestemt i den dyre ende sammenlignet med andre værktøjer.

Brugerfeedback på ParseHub

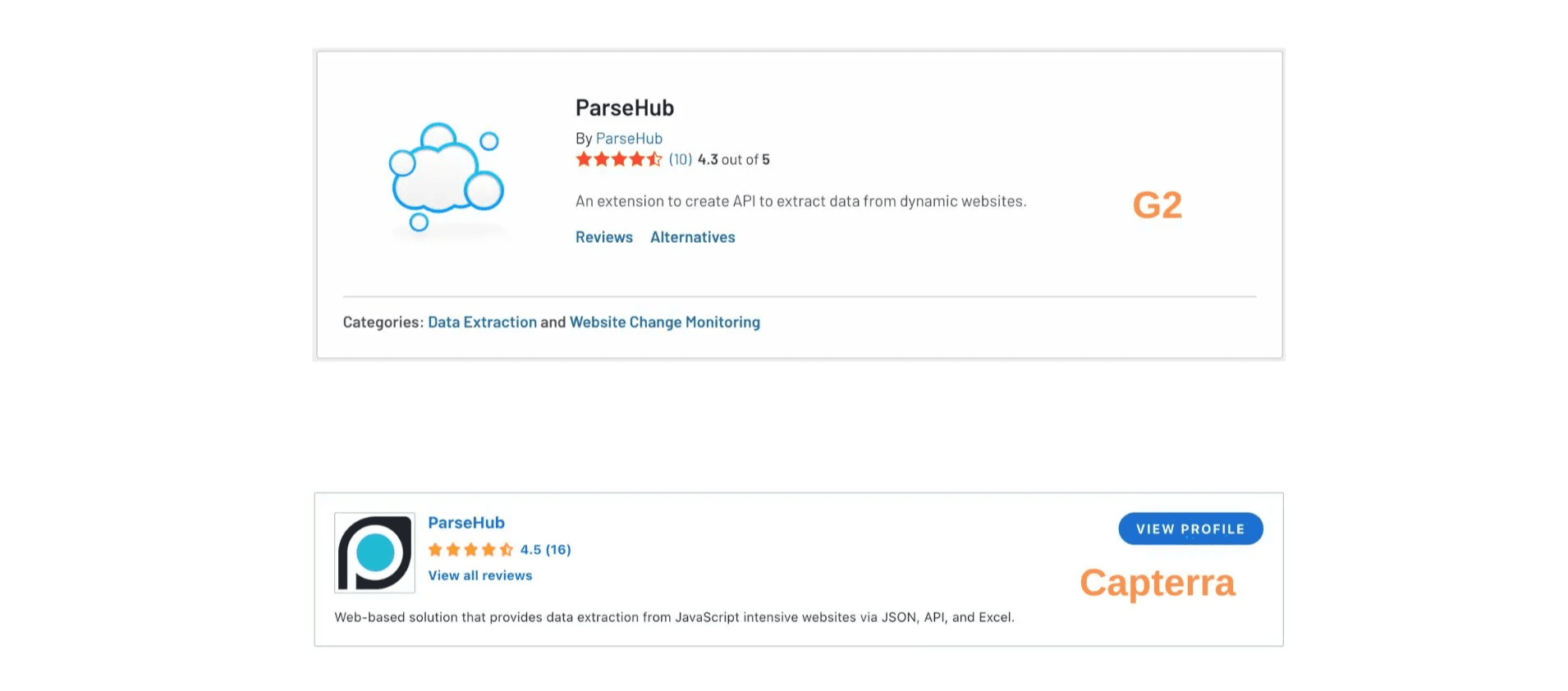

For at få en reel fornemmelse af, hvordan ParseHub fungerer, dykkede jeg ned i brugeranmeldelser på og . De samlede bedømmelser er solide — 4,3/5 på G2 og 4,5/5 på Capterra — men de skriftlige kommentarer fortæller en mere nuanceret historie.

Det brugerne godt kan lide

- Ingen kodning nødvendig: Den største fordel ved ParseHub er, at du ikke behøver at skrive kode. Brugerne elsker at kunne pege og klikke for at vælge data, hvilket gør web scraping tilgængeligt for ikke-programmører.

- Stærk til komplekse opgaver: Avancerede brugere sætter pris på funktioner som regex, XPath og evnen til at håndtere dynamisk indhold. ParseHub kan klare svære scraping-opgaver, som ville være besværlige at udføre manuelt.

- Gratis plan: Mange anmeldere fremhæver gratisniveauet som en god måde at afprøve værktøjet eller håndtere små projekter på.

- Understøttelse på tværs af platforme: Mac- og Linux-brugere er glade for, at ParseHub ikke kun findes til Windows.

- Responsiv support: Flere brugere nævner, at supportteamet er hjælpsomt, især ved fejlfinding.

- Visuel fejlsøgning: Muligheden for at se skærmbilleder af hvert trin hjælper brugerne med at finde ud af, hvad der går galt.

Hvor ParseHub kommer til kort

1. Stejl læringskurve

Selv om det markedsføres som et no-code-værktøj, er ParseHub ikke så begyndervenligt, som det påstår. Mange brugere siger, at det er svært at lære, især når man kommer ud over det allermest basale. En anmelder formulerede det meget direkte: “Det var svært at lære og implementere. At lave en scraper til et givent site er en oplevelse på 1–3 timer, når man er ny.” Det er en stor tidsinvestering, hvis du bare vil hente lidt data hurtigt.

Grænsefladen kan føles klodset og ikke helt intuitiv, især ved komplekse opgaver. Nogle brugere fortæller, at de må starte forfra flere gange for at få tingene til at fungere, og tutorials dækker kun det grundlæggende. Hvis du vil scrape en tricky hjemmeside, kan du være nødt til at dykke ned i avancerede koncepter som XPaths eller logik til sidenavigation — ting, der kan virke skræmmende for ikke-tekniske brugere.

2. Ikke venligt for helt nye begyndere

Selv brugere, der til sidst fik styr på ParseHub, indrømmer, at læringskurven er “ret lang”. For helt nye begyndere kan processen være overvældende. Dokumentationen er fin til enkle projekter, men hvis du støder på problemer, kan du ende med at sidde fast uden klar vejledning. En anmelder ønskede sig en bedre vidensbase til avancerede teknikker, mens en anden sagde, at de havde brug for support til at “vise dig triksene”.

3. Fejlfinding og fejlbehandling

Web scraping er i sig selv skrøbeligt, og når noget går galt i ParseHub, er det ikke altid tydeligt hvorfor. Fejlmeddelelser kan være vage, og brugerne må ofte gætte sig til, hvad der skal justeres. Den trial-and-error-proces kan være frustrerende og tidskrævende. Nogle brugere beskrev ParseHub som “det største spild af tid” efter at have brugt timer på at få et projekt til at virke, for til sidst at opgive i frustration.

4. Begrænsninger i gratisplanen

Selv om gratisplanen bliver værdsat, er grænsen på 200 sider for lav for mange brugere. Nogle ønsker, at den var mindst 500 eller 1.000 sider. Den gratis version kører også langsommere, og hvis du hurtigt skal scrape et stort site, må du opgradere. Gratisbrugere får kun community-support, hvilket kan være et problem, hvis du sidder fast og har brug for hjælp hurtigt.

5. Pris

Springet fra gratis til betalt er stort. Med $189/måned for Standard-planen er ParseHub en betydelig investering — især for enkeltpersoner eller små teams. Nogle brugere føler ikke, at prisen kan retfærdiggøres, medmindre du scraper i stor skala.

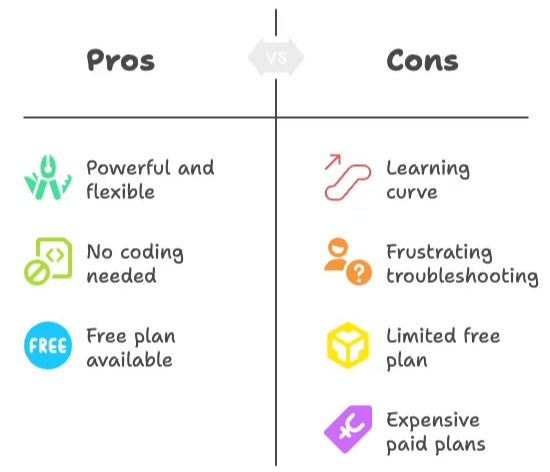

Vigtige pointer fra ParseHub-anmeldelserne

- ParseHub er kraftfuldt og fleksibelt, især til komplekse scraping-opgaver.

- Ingen kodning er nødvendig, men læringskurven er reel — især for begyndere.

- Fejlfinding kan være frustrerende, med vage fejlmeddelelser og begrænset vejledning til avancerede opgaver.

- Gratisplanen er nyttig til små projekter, men begrænsningerne rammer hurtigt.

- De betalte planer er dyre, hvilket placerer ParseHub i et premium-prisleje.

Hvis du er en ikke-teknisk bruger, der bare vil have data hurtigt og nemt, er ParseHub måske ikke så begyndervenligt, som det ser ud ved første øjekast. Tidsforbruget til at lære værktøjet — og frustrationen, når noget går galt — er almindelige smertepunkter.

Introduktion til Thunderbit: Den nemmeste AI Web Scraper til alle

Thunderbit er en , designet til erhvervsbrugere, marketingfolk, ejendomsmæglere, ecommerce-teams og alle, der vil scrape data fra websites — uden teknisk hovedpine. Her er, hvad der får Thunderbit til at skille sig ud:

Thunderbit-funktioner i overblik

- AI-drevet scraping: Klik bare på “AI Suggest Columns”, og Thunderbits AI finder den bedste måde at udtrække data fra ethvert website på. Du slipper for at rode med selectors eller XPaths.

- Dataudtræk med 2 klik: Vælg dine kolonner, klik på “Scrape”, og du er færdig. Så enkelt er det.

- Scraping af undersider: Thunderbits AI kan automatisk besøge undersider (som produktdetaljer eller profilsider) og berige din datatabel.

- Øjeblikkelige data scraper-skabeloner: Til populære sites som Amazon, Zillow, Instagram og Shopify kan du eksportere data med ét klik ved hjælp af forudbyggede skabeloner.

- Gratis dataeksport: Eksportér dine scraped data til Excel, Google Sheets, Airtable eller Notion — uden ekstra omkostninger.

- AI Autofill (helt gratis): Brug AI til at udfylde onlineformularer og automatisere workflows. Vælg bare konteksten og tryk enter.

- Scheduled Scraper: Opsæt automatisk scraping i faste intervaller — beskriv bare tidspunktet og indtast URL’erne.

- Email-, telefon- og image extractors: Udtræk emails, telefonnumre eller billeder fra ethvert website med ét klik (helt gratis).

- Image/document parser: Udtræk tabeller fra PDF’er, Word, Excel eller billeder. Upload dit dokument, lad AI strukturere dataene, og klik på “Scrape”.

- Ingen kodning, ingen opsætning: Alt kører i din browser — ingen desktop-app og ingen besværlig installation.

Thunderbit er bygget til hastighed og enkelhed. Hvis du nogensinde har været frustreret over ParseHubs opsætningsproces eller brugt timer på fejlfinding, vil du elske, hvor hurtigt Thunderbit bare virker.

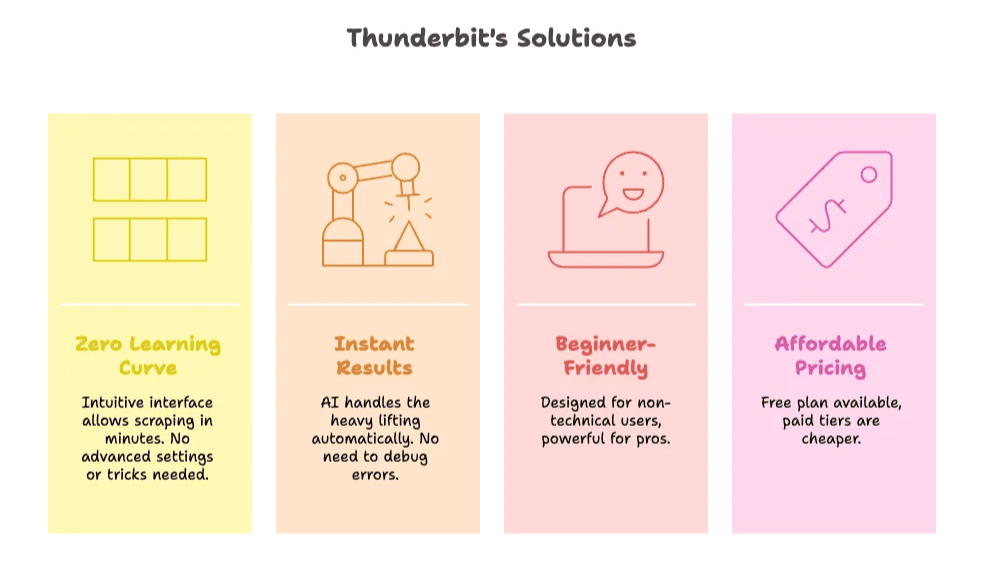

Sådan løser Thunderbit ParseHubs problemer

- Næsten ingen læringskurve: Thunderbits grænseflade er så intuitiv, at du kan gå fra nul til scraping på få minutter. Ingen tutorials, ingen avancerede indstillinger, ingen “tricks” nødvendige.

- Resultater med det samme: AI’en klarer det tunge arbejde, så du slipper for at rode med selectors eller fejlfinde.

- Virkelig begyndervenligt: Designet til ikke-tekniske brugere, men stadig stærkt nok til professionelle.

- Prisvenlig: Thunderbits planer starter gratis, og de betalte niveauer koster kun en brøkdel af ParseHubs pris.

Thunderbit-priser

Thunderbit bruger et enkelt creditsystem: 1 credit = 1 output-række. Sådan ser planerne ud:

| Niveau | Månedlig pris | Årlig pris (pr. måned) | Credits (månedligt) |

|---|---|---|---|

| Gratis | Gratis | Gratis | 6 sider |

| Starter | $15 | $9 | 500 |

| Pro 1 | $38 | $16.5 | 3.000 |

| Pro 2 | $75 | $33.8 | 6.000 |

| Pro 3 | $125 | $68.4 | 10.000 |

| Pro 4 | $249 | $137.5 | 20.000 |

Du kan . Gratisniveauet lader dig scrape 6 sider (uanset antal rækker pr. side), og de betalte planer er langt mere tilgængelige end ParseHubs startpris på $189/måned.

Thunderbit vs. ParseHub: Sammenligning side om side

Her er en hurtig tabel, der viser, hvordan Thunderbit og ParseHub klarer sig på de funktioner, der betyder mest for ikke-tekniske brugere:

| Funktion | Thunderbit | ParseHub |

|---|---|---|

| No-code, visuel scraping | ✅ – AI foreslår kolonner, 2-klik opsætning | ⚖️ – Visuel grænseflade, men stejlere læringskurve |

| AI-drevet udtræk | ✅ – AI håndterer selectors, undersider og struktur | ❌ – Manuel markering, avancerede muligheder kræver XPath/regex |

| Scraping af undersider | ✅ – AI besøger undersider automatisk | ⚙️ – Men kræver manuel opsætning |

| Øjeblikkelige skabeloner | ✅ – 1 klik til Amazon, Zillow, Instagram, Shopify osv. | ❌ – Hvert projekt skal bygges manuelt |

| Gratis dataeksport | ✅ – Excel, Google Sheets, Airtable, Notion | ✅ – CSV, JSON, Excel |

| Email-/telefon-/image extractors | ✅ – 1 klik, helt gratis | ❌ |

| Parsing af billeder/dokumenter | ✅ – Udtræk tabeller fra PDF, Word, Excel, billeder | ❌ |

| Planlagt scraping | ✅ – Enkel opsætning i naturligt sprog | 💳 – På betalte planer |

| Platform | 🌐 – Chrome-udvidelse (virker på alle OS med Chrome) | 💻 – Desktop-app (Windows, Mac, Linux) |

| Læringskurve | 🟢 – Minimal – designet til helt nye begyndere | 🔴 – Stejl for alt ud over det grundlæggende |

| Support | 💬 – Email, chat, voksende vidensbase | 👫 – Community (gratis), standard/prioriteret (betalt) |

| Gratis plan | ✅ – 6 sider om måneden, alle funktioner inkluderet | ✅ – 200 sider pr. kørsel, begrænset support |

| Startpris for betalt plan | $15/måned ($9/måned årligt) | $189/måned |

Konklusion: Thunderbit er det bedste valg for ikke-tekniske brugere

Efter at have brugt timer på at sammenligne ParseHub og Thunderbit er dommen klar: Hvis du er en ikke-teknisk bruger, der vil scrape webdata hurtigt, nemt og billigt, er vejen frem.

ParseHub er stærkt, men det kommer med en stejl læringskurve, frustrerende fejlfinding og en høj pris for de betalte planer. For begyndere eller erhvervsbrugere, der bare vil have data ind i et regneark uden teknisk besvær, er Thunderbit et bedre valg. Den AI-drevne workflow med 2 klik betyder, at du kan gå fra website til Excel på minutter — ikke timer. Og med funktioner som scraping af undersider, øjeblikkelige skabeloner og gratis dataeksport får du alt, hvad du har brug for — uden kompleksiteten.

Ofte stillede spørgsmål

1. Hvad er de største forskelle mellem ParseHub og Thunderbit?

ParseHub er en stærk no-code web scraper, men den har en stejl læringskurve og dyre betalte planer. bruger derimod AI til at gøre scraping virkelig begyndervenligt med dataudtræk med 2 klik, øjeblikkelige skabeloner og langt mere overkommelig pris. For de fleste ikke-tekniske brugere er Thunderbit hurtigere, nemmere og mindre frustrerende.

2. Hvordan gør Thunderbit web scraping lettere for begyndere?

Thunderbits AI Suggest Columns-funktion finder automatisk den bedste måde at udtrække data fra ethvert website på. Du klikker bare på “Scrape”, og AI’en klarer resten — du behøver ikke lære selectors, XPaths eller avancerede indstillinger. Det er designet, så alle kan bruge det, også helt uden teknisk baggrund.

3. Kan Thunderbit håndtere komplekse scraping-opgaver som undersider eller PDF’er?

Helt sikkert! Thunderbits AI kan besøge undersider (som produktdetaljer eller profiler) og automatisk berige din datatabel. Det lader dig også udtrække tabeller fra PDF’er, Word, Excel og billeder — upload bare dit dokument, og lad AI gøre arbejdet. Læs mere om disse funktioner på .

Læs mere