Sidste uge brugte jeg en hel eftermiddag på at få en AI-agent til at udfylde en leverandørformular på en portal bag login. Efter tre timer sad jeg bare og gloede på en "Connection Refused"-fejl, min VPS var løbet tør for hukommelse, og jeg overvejede helt seriøst bare at gøre det hele manuelt.

Den oplevelse er i praksis startpakken til OpenClaw browserautomatisering. Værktøjet kan navigere på sider, hente data, udfylde formularer og kæde komplekse workflows sammen ved hjælp af almindelige engelske instruktioner — ret imponerende. Men kløften mellem "det her lyder fantastisk" og "det virker faktisk på min maskine" er dér, de fleste går i stå.

Jeg har brugt meget tid på begge sider af den kløft, både på at bygge automatiseringsværktøjer hos og på at teste, hvad open source-miljøet kan tilbyde. Denne guide er den, jeg selv ville ønske, jeg havde haft: en reel gennemgang af opsætningen, beslutningen om browser-tilstand, som forvirrer alle, en Windows-native løsning (for WSL burde ikke være et krav), en overlevelsesguide mod bot-beskyttelse, konkrete output-eksempler, typiske fejl med faktiske fixes og et ærligt blik på, hvornår OpenClaw er det rigtige valg — og hvornår det er overkill.

Hvad er OpenClaw browserautomatisering?

OpenClaw er en gratis AI-agentplatform med open source-kode (MIT-licens), som kan styre en browser på dine vegne. I stedet for at skrive Selenium-scripts eller Puppeteer-kode beskriver du blot, hvad du vil have gjort på almindeligt engelsk — "Gå til denne side og udtræk alle produktnavne og priser" — og AI'en finder selv ud af, hvordan det skal gøres. Den bruger et nummereret snapshot-system, hvor agenten identificerer sideelementer, tildeler reference-numre og interagerer med dem trin for trin.

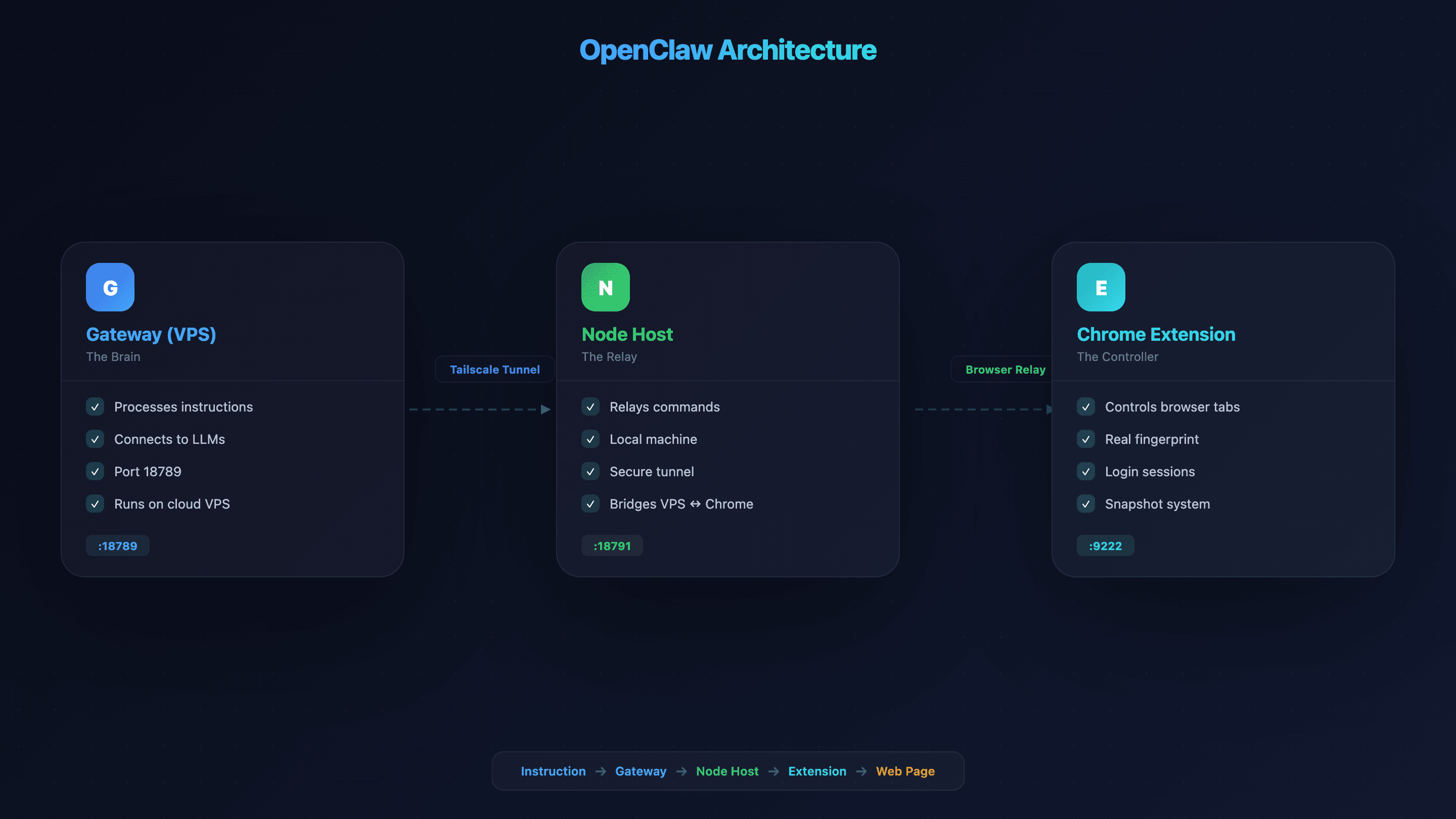

Arkitekturen består af tre dele — og derfor er opsætningen mere end bare at installere en udvidelse:

- Gateway (VPS/server): "Hjernen", som behandler dine instruktioner og forbinder til LLM'er. Kører som standard på port 18789.

- Node Host (lokal maskine): En relay, der lader Gateway sende browserinstruktioner til din lokale Chrome. Forbindes via en sikker tunnel som Tailscale.

- Chrome Extension (Browser Relay): Giver agenten direkte kontrol over browserfaner i din rigtige browser.

Yderligere porte omfatter Control Service (18791), CDP Relay (18792) og managed browser CDP (, med understøttelse af op til 100 parallelle profiler).

Ja, der er mange bevægelige dele. Men når du først forstår, hvad hver del gør, giver opsætningen mening. Tænk på det som en fjernstyret bil: Gateway er controlleren, Node Host er radiosignalet, og Chrome Extension er selve bilen.

Hvorfor OpenClaw browserautomatisering er vigtig for forretningsteams

Vidensarbejdere bruger op til i stedet for opgaver med høj værdi, herunder 1,8 timer dagligt bare på at søge og indsamle information. Smartsheet fandt, at bruger mindst en fjerdedel af deres ugentlige arbejdstid på manuelle, gentagne opgaver. Alene manuel dataindtastning koster amerikanske virksomheder anslået .

Det er det problem, OpenClaw browserautomatisering er bygget til at løse. I praksis passer det til konkrete forretningsprocesser:

| Use Case | Hvad OpenClaw gør | Forretningsresultat | |---|---|---| | Leadgenerering | Henter kontaktoplysninger fra kataloger og virksomhedsider | Fylder salgspipelinen hurtigere | | Overvågning af konkurrentpriser | Navigerer dagligt på produktsider og udtrækker priser | Konkurrenceindsigt i realtid | | Formularudfyldning / dataindtastning | Udfylder gentagne webformularer (CRM, portaler, ansøgninger) | Timer sparet hver uge | | Indholdsovervågning | Tjekker konkurrentblogs, jobopslag og pressemeddelelser | Tidlige konkurrencesignaler | | QA / test | Kører gennem webflows for at verificere, at de virker | Færre ødelagte brugeroplevelser |

Markedet for AI-agenter nåede , næsten en fordobling fra $3,7 mia. i 2023, og bruger nu AI-automatisering i mindst én funktion. Det er ikke længere en nichekategori.

Sandbox Chromium vs. Browser Relay vs. Chrome Remote Debugging: vælg den rigtige tilstand

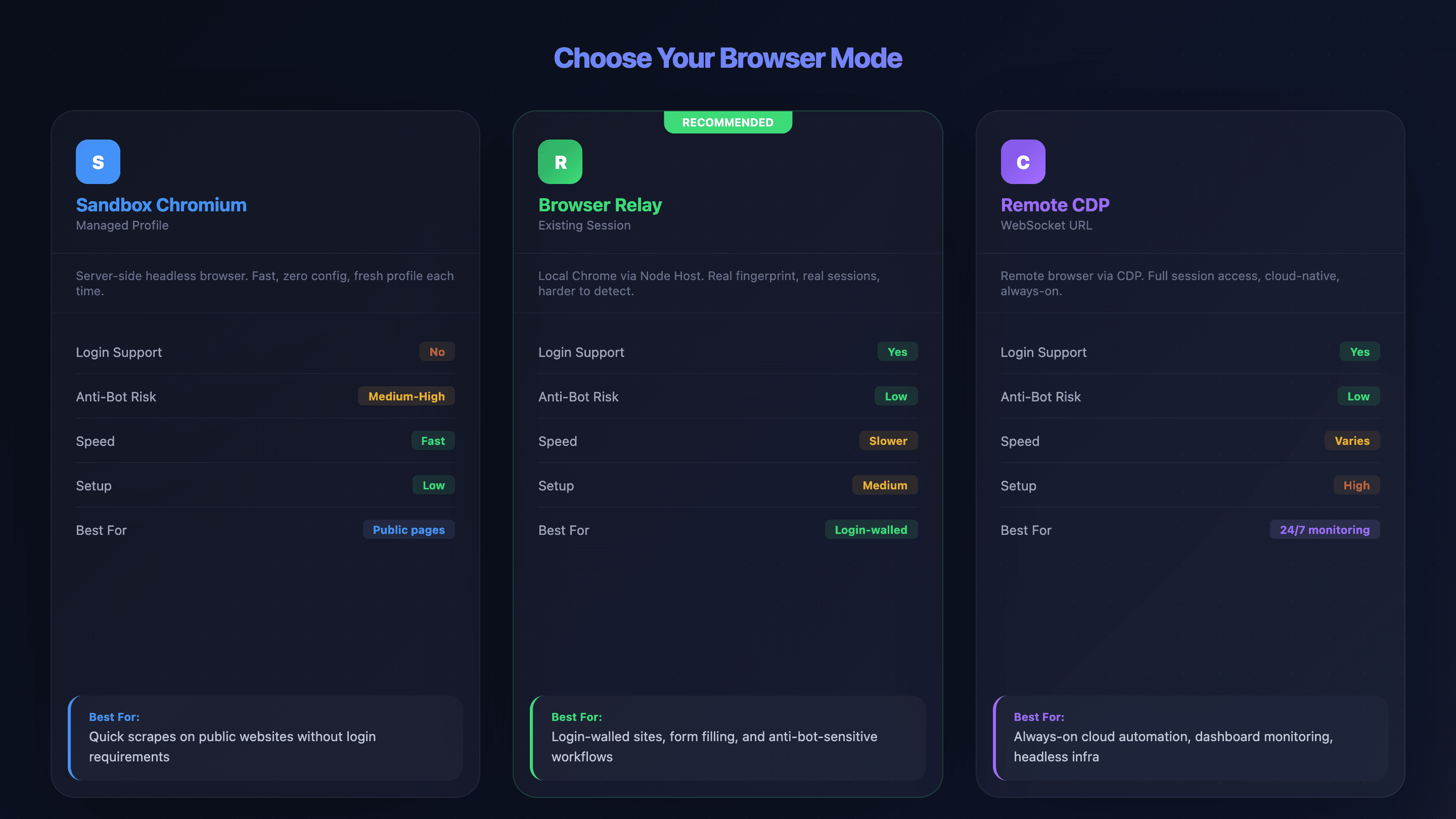

At vælge den forkerte browsertilstand er efter min erfaring den største frustrationen for nye OpenClaw-brugere. Jeg har set folk bruge timer på at debugge forbindelsesproblemer, som kunne være undgået ved at vælge en anden tilstand fra starten. OpenClaw tilbyder tre måder at forbinde på, og hver har reelle fordele og ulemper:

- Sandbox Chromium (Managed Profile): OpenClaw starter sin egen headless browser på serveren. Ingen login-sessioner, hurtig, lav opsætning — men mere synlig for bot-beskyttelse.

- Browser Relay (Existing-Session): En node host på din lokale maskine videresender instruktioner fra VPS'en til din faktiske Chrome-browser. Understøtter login-sessioner og cookies og bruger din rigtige browserfingeraftryk.

- Chrome Remote Debugging (Remote CDP): Forbinder til eksterne browsere via WebSocket-URL. Fuld sessionsadgang, højeste opsætningskompleksitet. Virker med cloud-udbydere som Browserless eller Browserbase.

Sammenligningstabel: alle tre browsertilstande

| Faktor | Sandbox Chromium | Browser Relay | Remote CDP | |---|---|---|---| | Login-understøttelse | ❌ Nej (frisk profil) | ✅ Ja (rigtige sessioner) | ✅ Ja (forudautentificeret) | | Risiko for bot-detektion | ⚠️ Mellem-høj | ✅ Lav (ægte fingerprint) | ✅ Lav (styret af udbyder) | | Hastighed | ✅ Hurtig | ⚠️ Langsommere (netværksrelay) | ⚠️ Varierer | | Opsætningskompleksitet | Lav | Mellem | Høj | | Fuld funktionsunderstøttelse | ✅ Ja (alle funktioner) | ⚠️ Begrænset (ingen batch, ingen download-intercept) | Afhænger af udbyder | | Bedst til | Offentlige sider, hurtige scraping-opgaver | Sider bag login, formularudfyldning | Cloud-infrastruktur, konstant overvågning |

Beslutningsflow: hvilken tilstand skal du vælge?

Gå gennem disse spørgsmål i rækkefølge:

- "Skal du være logget ind?" — Nej → Sandbox Chromium. Ja → næste spørgsmål.

- "Har siden stærk anti-bot-beskyttelse?" — Ja → Browser Relay (dit rigtige browserfingeraftryk reducerer detektion). Nej → enten Browser Relay eller Remote CDP.

- "Har du brug for en vedvarende, altid-aktiv session (fx overvågning af et dashboard 24/7)?" — Ja → Remote CDP med en cloud-udbyder. Nej → Browser Relay.

Eksempler fra virkeligheden:

- Scrape offentlige Amazon-lister → Sandbox Chromium

- Udfylde en CRM-form bag login → Browser Relay

- Overvåge et internt analytics-dashboard døgnet rundt → Remote CDP med Browserless/Browserbase

Får du det valg rigtigt fra starten, sparer du dig selv for timevis af debugging. Helt seriøst.

Før du går i gang

- Sværhedsgrad: Mellem (CLI-fortrolighed kræves)

- Tidsforbrug: 45–75 minutter til fuld opsætning; 10–15 minutter pr. trin

- Det skal du bruge: En VPS (minimum 2 GB RAM, 4 GB anbefales), Node.js v22.12.0+, en Tailscale-konto (gratis), Chrome-browser og tålmodighed

Trin 1: Få OpenClaw i gang på en VPS (eller lokalt)

VPS'en er dér, hvor OpenClaws "hjerne" bor. Der er to veje til at få det i gang:

Mulighed A: VPS-hosting med ét klik

Flere udbydere tilbyder prækonfigurerede OpenClaw-images:

| Udbyder | Startpris | Bemærkninger | |---|---|---| | Hostinger | Fra $6,99/md. | Prækonfigureret image | | Tencent Cloud Lighthouse | Fra ca. $0,08/år (kampagne) | 2 kerner / 4 GB anbefales | | Hetzner | Fra $4,09/md. (CX22) | Mest værdi for pengene; manuel installation | | DigitalOcean | Fra $4/md. | Manuel installation | | Vultr | Fra $3,50/md. | Manuel installation |

Mulighed B: Manuel CLI-installation

1# Installer via npm (kræver Node.js v22.12.0+)

2npm install -g openclaw

3# Kør onboarding-guide

4openclaw onboard

5# Generer gateway-token (gem denne — du skal bruge den til node host)

6openclaw doctor --generate-gateway-token

7# Validér konfigurationen

8openclaw doctor --fixMinimumskrav: 2 GB RAM (crasher ved 1 GB), 4 GB anbefales. Hver headless browserinstans bruger 400–800 MB i idle. Hvis du bruger Docker, skal du sætte shm_size: '2gb' — det er afgørende for stabilitet.

Når dette trin er færdigt, bør du have OpenClaw kørende og et Gateway-token gemt et sikkert sted. (Jeg lægger mit i en password manager. Gå ikke og mist det.)

Trin 2: Opsæt Tailscale for at forbinde VPS og lokal maskine

Tailscale opretter en privat, krypteret tunnel mellem din VPS og din lokale enhed, så browserinstruktioner ikke bliver eksponeret for det offentlige internet. Når man tænker på, at OpenClaw havde i begyndelsen af 2026, er det en dårlig idé at springe dette trin over.

1# På VPS

2curl -fsSL https://tailscale.com/install.sh | sh

3sudo tailscale up --ssh=true

4# Notér VPS'ens Tailscale-IP (100.x.x.x)

5# Konfigurer Gateway til at lytte på Tailscale-netværket

6openclaw config set gateway.listen "100.x.x.x:18789"Installer Tailscale på din lokale maskine fra . Begge enheder skal bruge den samme Tailscale-konto.

Alternativer hvis Tailscale ikke er noget for dig:

| Faktor | Tailscale | Cloudflare Tunnel | WireGuard | |---|---|---|---| | Opsætningstid | 5 min | 10–15 min | 20–30 min | | Pris | Gratis (personligt) | Gratis | Gratis | | NAT-traversering | Automatisk | Automatisk | Manuel |

Du bør nu kunne pinge VPS'ens Tailscale-IP fra din lokale maskine. Hvis ikke, så tjek, at begge enheder er på samme Tailscale-konto.

Trin 3: Installer Node Host på din lokale enhed

Node hosten videresender browserinstruktioner fra VPS-Gatewayen til din lokale Chrome — oversætteren mellem server og browser.

1# Installer node host-pakken

2npm install -g @openclaw/node-host

3# Sæt gateway-token fra trin 1

4export OPENCLAW_GATEWAY_TOKEN="your-token-here"

5# Start node hosten og peg på din VPS Tailscale-IP

6openclaw node install --host 100.x.x.x --port 18789

7# Godkend forbindelsen fra VPS-siden

8openclaw node approve <node-id>Du bør se en bekræftelse på, at noden er forbundet og godkendt. Hvis godkendelsestrinnet hænger, så genstart Gateway-processen på VPS'en.

Trin 4: Installer OpenClaw Chrome-udvidelsen

Udvidelsen giver agenten direkte kontrol over browserfaner. Du kan også hente den fra Chrome Web Store ved at søge på "OpenClaw Browser Relay."

1# Installer udvidelsesfilerne

2openclaw browser extension install

3# Eller manuelt:

4# 1. Åbn chrome://extensions

5# 2. Slå "Developer mode" til (knappen øverst til højre)

6# 3. Klik "Load unpacked" → vælg udvidelsesmappen

7# 4. Fastgør den til værktøjslinjen

8# 5. Bekræft, at badge viser "ON"Hvis badgen viser "ON", er du klar. Hvis den bliver ved med at stå på "OFF", så gå ned til fejlfindingsafsnittet nedenfor.

Trin 5: Kør din første OpenClaw browserautomatiseringsopgave

Åbn en mål-fane, og prøv derefter noget simpelt fra OpenClaw-chatinterfacet:

1Gå til https://books.toscrape.com og udtræk titel og pris for hver bog på sidenForventet forløb: Instruktion sendt → agent tager et snapshot (identificerer sideelementer med nummererede referencer) → agent udtrækker data → struktureret output returneres som JSON eller CSV.

Et tip fra erfaring: start med helt enkle prompts. Hvis du beskriver alt for detaljeret, kan det faktisk forvirre AI'en — tilføj kun mere, hvis agenten misforstår din første instruktion.

For 20 bøger på første side kan du forvente ca. 30–60 sekunder. Får du strukturerede data tilbage? Så virker din OpenClaw browserautomatiseringsopsætning.

OpenClaw browserautomatisering på Windows: den native opsætningsvej

De fleste OpenClaw-guides antager macOS eller Linux. Hvis du er på Windows, har du sikkert allerede lagt mærke til det. En bruger i et forum ramte det meget præcist: "mange løsninger virkede teoretisk fornuftige, men ingen var designet til native Windows."

Her er det, der faktisk virker.

Mulighed A: Chrome Remote Debugging på Windows (anbefalet native løsning)

Den mest pålidelige Windows-native tilgang. Åbn PowerShell og start Chrome med remote debugging aktiveret:

1& "C:\Program Files\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222Hvis Chrome ikke ligger dér, så prøv:

1# Tjek alternative placeringer

2Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse

3# Eller tjek AppData

4& "$env:LOCALAPPDATA\Google\Chrome\Application\chrome.exe" --remote-debugging-port=9222Konfigurer derefter OpenClaw til at forbinde via Remote CDP ved at sætte cdpUrl til ws://localhost:9222 i din openclaw.json-konfiguration.

Mulighed B: Docker Desktop som Windows-fallback

Hvis den native løsning driller, kan Docker Desktop på Windows køre en headless Chromium-container:

1docker run -d --name openclaw-browser -p 9222:9222 --shm-size=2g browserless/chrome

2# Peg OpenClaw på: cdpUrl: "ws://localhost:9222"Det tilføjer endnu et lag kompleksitet, men er mere stabilt for nogle brugere. Det virker, men det er ikke elegant.

Windows-specifik fejloversigt

| Fejl | Årsag | Fix (PowerShell) |

|---|---|---|

| Port 9222 er allerede i brug | En anden DevTools-session er åben | Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -Force |

| Chrome-binær ikke fundet | Forkert sti | Get-ChildItem "C:\Program Files*\Google\Chrome\Application\chrome.exe" -Recurse |

| Tailscale connection refused | Windows Firewall blokerer | New-NetFirewallRule -DisplayName "OpenClaw" -Direction Inbound -LocalPort 18789 -Protocol TCP -Action Allow |

| npm-tilladelsesfejl | Kører ikke som administrator | Kør PowerShell som Administrator, eller brug nvm-windows |

Alle kommandoerne ovenfor er PowerShell, ikke bash. Kopiér og indsæt direkte.

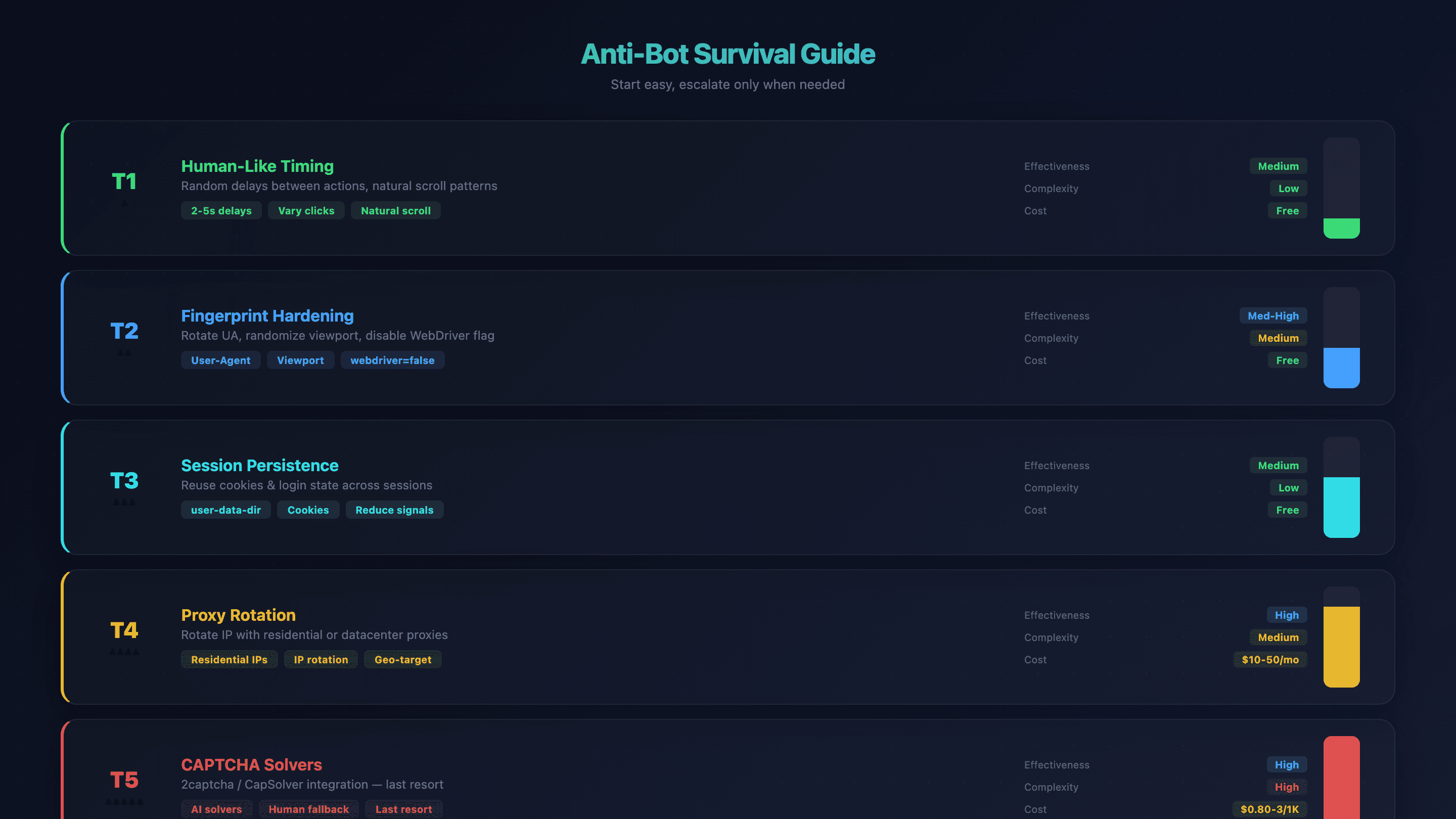

Overlevelsesguide mod bot-beskyttelse til OpenClaw browserautomatisering

Bot-detektion er den største frustration for OpenClaw-brugere. OpenClaws standard-Chromium har — sider opdager det via WebDriver-flaget, skærmstørrelser, font-fingerprinting og IP-ry. Jeg har set agenter blive blokeret inden for få sekunder på nogle sider.

Men der er en trinvis tilgang. Start med den letteste løsning og eskalér kun, hvis det er nødvendigt.

Trin 1: Menneskelignende timing og adfærd

Tilføj tilfældige pauser mellem handlinger i dine prompts. I stedet for at få agenten til at klikke i maskinhastighed, så instruér den: "vent 2–5 sekunder mellem hvert klik." AI'en varierer naturligt timingen til en vis grad, men eksplicitte instruktioner hjælper.

Effekt: Mellem | Kompleksitet: Lav | Pris: Gratis

Trin 2: Styrkelse af fingerprint

Skift user-agent-strenge, randomiser viewport-størrelsen, og lad OpenClaw automatisk deaktivere navigator.webdriver-flaget (via --disable-blink-features=AutomationControlled).

1# Sæt brugerdefinerede headers

2openclaw browser set headers --headers-json '{"User-Agent":"Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 Chrome/124.0.0.0 Safari/537.36"}'

3# Randomiser viewport

4openclaw browser set viewport 1366 768

5# Sæt tidszone og lokalitet

6openclaw browser set timezone America/New_York

7openclaw browser set locale en-USFor dybere anti-detektion anbefaler community'et Camoufox (en Firefox-baseret anti-detect-browser med fingerprint-spoofing på C++-motor-niveau).

Effekt: Mellem-høj | Kompleksitet: Mellem | Pris: Gratis

Trin 3: Sessionsbevaring

Brug user-data-dir til at bevare cookies og loginstatus mellem sessioner. Det reducerer signaler om en "frisk browser", som ellers udløser bot-beskyttelse.

1openclaw config set browser.profiles.persistent.userDataDir "/path/to/chrome-profile"

2openclaw config set browser.profiles.persistent.cdpPort 18802Effekt: Mellem | Kompleksitet: Lav | Pris: Gratis

Trin 4: Proxy-rotation

Når timing og fingerprinting ikke er nok, så rotér din IP-adresse. Residential proxies er sværere at opdage; datacenter-proxies er hurtigere og billigere.

1export OPENCLAW_BROWSER_PROXY="http://user:pass@proxy.example.com:8080"Bemærk: proxy-konfiguration på browserniveau er stadig et ønsket feature (GitHub Issue #8079). Lige nu skal proxies sættes på OS- eller miljøniveau.

| Udbyder | Residential | Datacenter | Bedst til | |---|---|---|---| | Bright Data | $4–8,40/GB | $0,43–0,60/GB | Enterprise, højeste kvalitet | | Oxylabs | $6–8/GB | $0,48–5/GB | Scraping i stor skala | | Decodo (Smartproxy) | $4–5,50/GB | $0,70–5/GB | Mellemstore budgetter | | IPRoyal | $5–7/GB | -- | Budgetvenligt | | DataImpulse | $1/GB | -- | Laveste pris |

Effekt: Høj | Kompleksitet: Mellem | Pris: $10–50/md.

Trin 5: CAPTCHA-løsere

Sidste udvej. Integrér tjenester som 2captcha eller CapSolver.

| Tjeneste | reCAPTCHA v2 | Cloudflare Turnstile | Latency | |---|---|---|---| | 2Captcha | $2,99/1K | $2,99/1K | 15–45 sek. (menneskelige løsere) | | CapSolver | $0,80–1,50/1K | $0,80/1K | 0,5–10 sek. (AI) |

FlareSolverr (open source Cloudflare-bypass) beskrives som upålidelig i 2025–2026 på grund af Cloudflares stadigt stærkere forsvar.

Effekt: Høj | Kompleksitet: Høj | Pris: $0,80–3/1K løsninger

Oversigtstabel over bot-beskyttelse

| Teknik | Effekt | Kompleksitet | Pris | |---|---|---|---| | Menneskelignende timing | Mellem | Lav | Gratis | | Fingerprint-styrkelse | Mellem-høj | Mellem | Gratis | | Sessionsbevaring | Mellem | Lav | Gratis | | Proxy-rotation | Høj | Mellem | $10–50/md. | | CAPTCHA-løsere | Høj | Høj | $0,80–3/1K løsninger |

For brugere, der igen og igen rammer anti-bot-vægge og bare har brug for dataene: 's cloud scraping håndterer bot-beskyttelse automatisk for offentlige websites — ingen proxyopsætning, ingen fingerprint-tuning. Det er en fundamentalt anden tilgang (AI læser siden hver gang via styret cloud-infrastruktur), som omgår hele anti-bot-kapløbet for almindelige dataudtræksopgaver.

Rigtigt output: hvad OpenClaw browserautomatisering faktisk producerer

Før du bruger 45–75 minutter på opsætning, vil du sikkert gerne se, hvordan slutresultatet ser ud. Helt fair — her er tre workflow-eksempler med faktisk output.

Eksempel 1: Webscraping — udtræk af produktdata

Prompt: "Gå til https://books.toscrape.com og udtræk titel og pris for hver bog på siden"

Output (første 5 rækker):

| Titel | Pris | |---|---| | A Light in the Attic | £51,77 | | Tipping the Velvet | £53,74 | | Soumission | £50,10 | | Sharp Objects | £47,82 | | Sapiens: A Brief History of Humankind | £54,23 |

Tidsforbrug: ca. 45 sekunder for 20 rækker (én side). Pagination krævede en opfølgende instruktion: "Klik på Next-knappen og gentag for 5 sider." I alt: ca. 100 rækker på omkring 3 minutter.

Eksempel 2: Formularautomatisering — udfyldning af en webformular med flere felter

Scenario: Udfyldning af en leverandørhenvendelsesformular med virksomhedsnavn, kontaktoplysninger og interesse i produkt.

Agenten tager et snapshot af formularen, identificerer hvert felt med et reference-nummer og udfylder dem sekventielt. Før: tomme formularfelter. Efter: alle felter udfyldt, og en bekræftelsesbesked vises. Eventuelle dropdown-menuer eller afkrydsningsfelter håndteres af snapshot-systemet — agenten "ser" valgmulighederne og vælger det rigtige.

Tidsforbrug: ca. 30 sekunder for en formular med 6 felter.

Eksempel 3: Pagination — scraping på tværs af flere sider

Første resultat: 20 rækker fra side 1. Efter instruktionen "klik Next og gentag for alle sider": 1.000 rækker på tværs af 50 sider på books.toscrape.com. Agenten opdager "Next"-knappen via snapshot og klikker videre i en løkke.

Tidsforbrug: ca. 12 minutter for det fulde datasæt på 1.000 rækker.

Side om side: samme scrapingopgave i Thunderbit

For det samme books.toscrape.com-eksempel ser workflowet sådan ud i :

- Installer (~30 sekunder)

- Gå til siden

- Klik på "AI Suggest Fields" → AI registrerer Title, Price, Availability, Rating

- Klik på "Scrape" → 20 rækker udtrukket

- Brug pagination-kontroller → alle sider bliver scraped

- Eksportér til Google Sheets (gratis)

Samlet tid: ca. 3 minutter fra nul til eksporterede data, uden VPS, uden CLI og uden konfiguration.

Pointen er ikke, at det ene værktøj er "bedre". Det rigtige valg afhænger af, hvad du faktisk prøver at gøre.

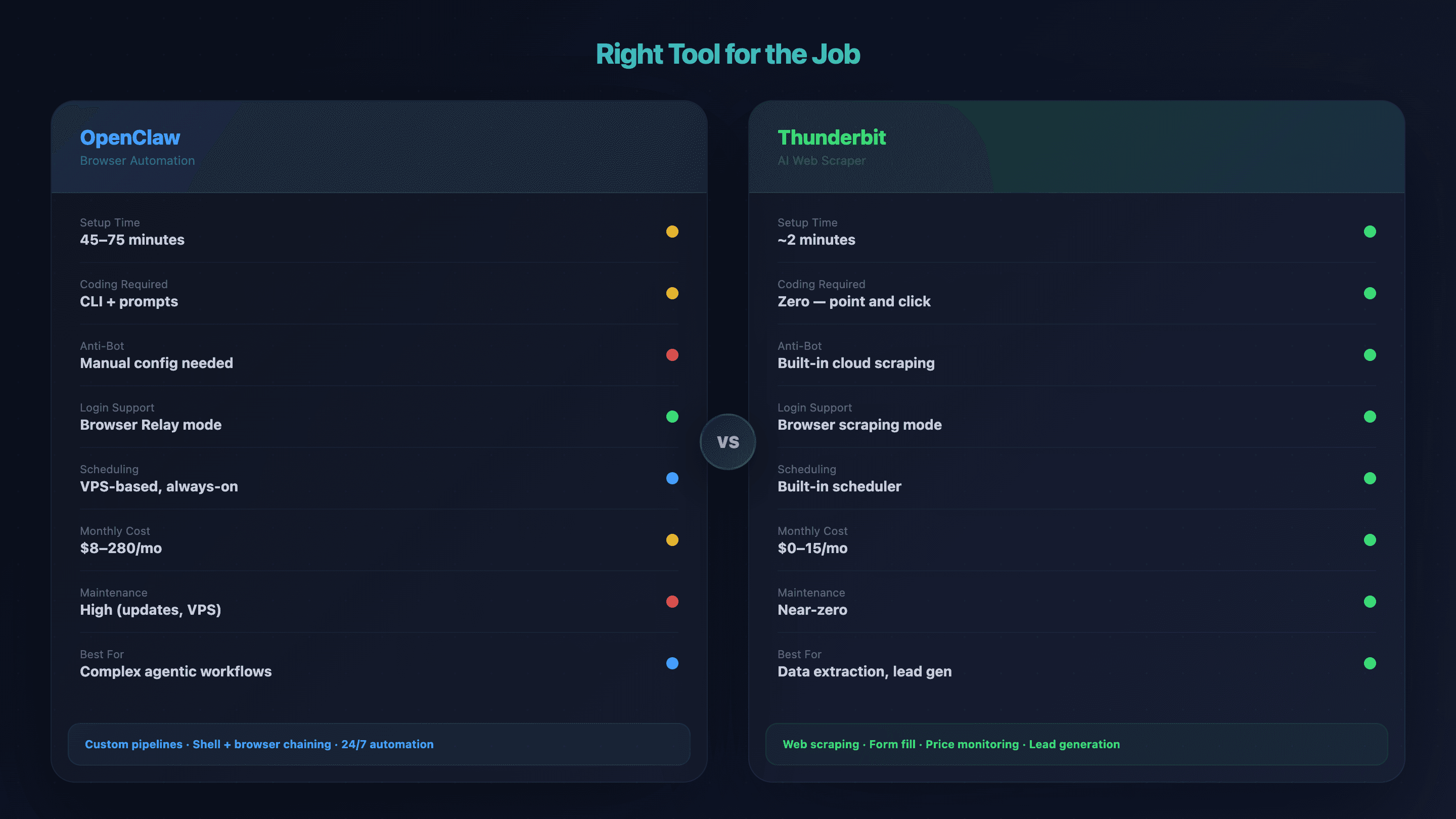

Hvornår OpenClaw browserautomatisering er overkill (og hvad du skal bruge i stedet)

OpenClaw er stærkt til komplekse, flertrins, agentiske automatiseringer — workflows bag login, kædning af browserhandlinger med shell-kommandoer, og drift 24/7 på en VPS. Men hvis målet er "udtræk produktdata fra en listingside" eller "hent e-mails fra en directory-side", så er hele VPS + Tailscale + node host-stakken sandsynligvis overdesignet.

Jeg har set folk bruge 60+ minutter på opsætning til en opgave, der tager 2 minutter med et enklere værktøj. Det er ikke en god handel.

Det rigtige værktøj til opgaven: sammenligningstabel

| Faktor | OpenClaw browserautomatisering | Thunderbit | |---|---|---| | Opsætningstid | 45–75 min (VPS + Tailscale + node host) | Ca. 2 min (installation af Chrome-udvidelse) | | Kræver kodning | CLI + naturlige sproginstruktioner | Ingen — klik "AI Suggest Fields" → "Scrape" | | Håndtering af bot-beskyttelse | Manuel (proxy, fingerprint-konfiguration) | Indbygget cloud scraping | | Navigation bag login | ✅ Browser Relay / remote debug | ✅ Browser scraping mode | | Berigelse af undersider | Tilpasset scripting pr. workflow | 1-klik scraping af undersider | | Planlagte / 24×7-kørsler | VPS-baseret, altid aktiv | Indbygget | | Månedlig pris | $8–14 (hobby) til $110–280 (tung brug) | $0 (gratis niveau) til $15/md. | | Vedligeholdelsesbyrde | Høj (opdateringer, VPS, debugging) | Næsten nul — AI tilpasser sig layoutændringer | | Bedst til | Komplekse agentiske workflows, custom pipelines | Dataudtræk, formularudfyldning, leadgenerering, prisovervågning |

Brugsscenarie-routing

- Du har brug for flertrins agentiske workflows, der kæder browserhandlinger sammen med shell-kommandoer, beskedapps og databaser → OpenClaw er det rigtige valg.

- Du vil hente data fra websites, udfylde formularer eller overvåge priser uden at røre en terminal → får dig hurtigere i mål. Du kan også se for korte demoer.

- Du skal bruge et let script til et bestemt API-endpoint → Et simpelt Python-script med requests kan være alt, hvad du behøver.

Det er helt ærligt den ramme, jeg selv bruger, når nogen på mit team spørger: "hvilket værktøj skal jeg bruge til det her?"

Almindelige OpenClaw browserautomatiseringsfejl og hvordan du løser dem

Bogmærk dette afsnit. Det er organiseret efter symptom, så du kan bruge Ctrl+F til at finde en løsning.

"Connection Refused" eller Node Host kan ikke forbinde

Sandsynlige årsager (tjek i denne rækkefølge):

- Tailscale kører ikke på begge enheder → kør

tailscale statuspå begge - Gateway er ikke sat til at lytte på Tailscale-netværket (står stadig på localhost) →

openclaw config set gateway.listen "100.x.x.x:18789" - Forkert IP-adresse → dobbelttjek med

tailscale ip -4 - Firewall blokerer port 18789 →

sudo ufw allow 18789/tcp(Linux) eller tilføj en Windows Firewall-regel

Udvidelsesbadgen bliver ved med at stå på "OFF" eller fanen opdages ikke

- Udvidelsen er ikke indlæst i Developer mode →

chrome://extensions→ slå Developer mode til → genindlæs - Node host kører ikke → genstart med

openclaw node start - Konflikt med Chrome-instans → luk alle Chrome-instanser, start igen og genindlæs udvidelsen

Agenten returnerer tomme eller forkerte data

- Siden er ikke fuldt indlæst: Instruér agenten til at "vente 3 sekunder efter navigation, før der udtrækkes data." Mange SPA'er skal bruge tid på at rendere.

- Anti-bot-blokering: Tjek om du får en CAPTCHA-side i stedet for rigtigt indhold. Skift fra Sandbox Chromium til Browser Relay.

- Forældet snapshot: Bed agenten om at "tage et nyt snapshot" — reference-numre bliver ugyldige efter navigation.

"Port 9222 Already in Use"

Det er almindeligt, når Chrome DevTools eller et andet automatiseringsværktøj allerede bruger porten.

1# macOS/Linux

2lsof -i :9222 | grep LISTEN

3kill -9 <PID>

4# Windows PowerShell

5Get-Process -Id (Get-NetTCPConnection -LocalPort 9222).OwningProcess | Stop-Process -ForceVPS'en løber tør for hukommelse

Hver headless browserinstans bruger 400–800 MB RAM. Hvis du kører flere samtidig, kan en lille VPS crashe.

Løsninger:

- Deaktivér indlæsning af billeder/CSS/font-filer:

openclaw browser network route --abort "**/*.{png,jpg,gif,css,woff2}" - Begræns antallet af samtidige instanser til det, din RAM kan håndtere

- Sæt

shm_size: '2gb'i Docker-konfigurationer - Aktivér session-hibernation:

OPENCLAW_HIBERNATE_AFTER=300 - Opgradér til en VPS med 4 GB+ RAM, hvis du har brug for mere plads

Tips til at holde din OpenClaw browserautomatisering kørende gnidningsfrit

Her er nogle best practices, jeg har lært af at køre disse opsætninger over tid:

- Deaktivér billeder, stylesheets og fonte til opgaver, hvor du kun skal hente data. Det reducerer ressourceforbruget markant og gør tingene hurtigere.

- Genbrug browserinstanser i stedet for at starte en ny for hver opgave. Friske instanser er dyre i RAM og udløser flere anti-bot-signaler.

- Start med simple prompts. Tilføj kun flere detaljer, hvis agenten misforstår. For meget beskrivelse kan forvirre AI'en mere, end det hjælper.

- Overvåg VPS'ens ressourceforbrug (CPU, RAM) og skaler op, før du rammer grænserne. En crashet VPS kl. 2 om natten er ikke sjov at debugge.

- Hold OpenClaw og Chrome-udvidelsen opdateret — men test opdateringer i et staging-miljø først. OpenClaw sender cirka , og de er ikke alle problemfrie.

- Til tilbagevendende opgaver (daglige prischecks, ugentlige lead-udtræk) lader Thunderbits dig sætte intervaller i almindeligt sprog og helt slippe for VPS-vedligeholdelse.

Etiske og juridiske overvejelser

Kort, men vigtigt. Respekter robots.txt (formaliseret som en IETF-standard i ), begræns din request-rate, gennemgå målsidernes vilkår, og håndter persondata efter GDPR og gældende privatlivslovgivning. Præcedensen fra (2022) fastslog, at scraping af offentligt tilgængelige data ikke bryder CFAA, men det betyder ikke, at alt er tilladt. Ansvarlig brug af automatisering beskytter både dig og din virksomhed. Læs også vores guide om .

Afrunding

OpenClaw browserautomatisering er et stærkt valg til komplekse, flertrins webflows, der styres med naturligt sprog. Det vigtigste er dette:

- Vælg den rigtige browsertilstand fra starten (Sandbox, Relay, Remote CDP) — det ene valg kan spare dig for timevis af debugging.

- Windows-brugere har en fungerende vej, men du skal følge Windows-specifikke kommandoer og holde øje med firewall- og sti-problemer.

- Håndtering af bot-beskyttelse er en reel udfordring — start med de letteste teknikker (timing, fingerprinting) og eskalér kun efter behov.

- Se outputtet, før du binder dig. Hvis strukturerede data fra en listingside er alt, du behøver, får et no-code-værktøj som dig i mål på få minutter uden vedligeholdelse.

- Budgetér med vedligeholdelse. OpenClaw sender omkring 13 releases om måneden, VPS-omkostninger løber op, og debugging er en del af pakken.

Hvis du vil prøve den enkle vej først, tilbyder — installér udvidelsen, scrape en side, og se, om det dækker dit behov, før du investerer i en fuld VPS-opsætning. Hvis du går OpenClaw-vejen, så bogmærk denne guide. Du får brug for fejloversigten før eller siden — og må dine browserinstanser altid have nok RAM.

Ofte stillede spørgsmål

Hvad er forskellen på OpenClaw Sandbox Chromium og Browser Relay?

Sandbox Chromium kører en headless browser på serveren — det er hurtigt og kræver lidt opsætning, men opretter en frisk profil hver gang (ingen login-sessioner) og er lettere at opdage for bot-beskyttelse. Browser Relay sender instruktioner til din rigtige Chrome-browser på din lokale maskine, så den understøtter login, arver dit rigtige browserfingeraftryk og er sværere for sider at identificere som automation. Ulempen er, at Browser Relay er langsommere på grund af netværksrelæet og har nogle funktionsbegrænsninger (ingen batch-handlinger, ingen download-intercept).

Kan jeg køre OpenClaw browserautomatisering på Windows uden WSL?

Ja, men med forbehold. Den mest pålidelige native Windows-vej er Chrome Remote Debugging via PowerShell (chrome.exe --remote-debugging-port=9222). Docker Desktop er en fallback, hvis det viser sig ustabilt. Fuld native Node Host-understøttelse på Windows kan stadig have små ujævnheder — tjek den aktuelle dokumentation og vær forberedt på Windows-specifikke problemer som firewall-blokeringer og forskelle i filstier. Alle kommandoerne i Windows-afsnittet i denne guide er PowerShell, ikke bash.

Hvordan håndterer jeg CAPTCHA'er i OpenClaw browserautomatisering?

Start med at reducere risikoen for detektion: tilføj menneskelignende timing, styrk browserens fingerprint, og brug sessionsbevaring for at undgå signaler om en frisk browser. Hvis CAPTCHA'er stadig dukker op, så integrér en løsetjeneste som 2captcha ($2,99/1K løsninger) eller CapSolver ($0,80–1,50/1K, AI-drevet). For offentlige websites, hvor du bare skal bruge dataene, håndterer Thunderbits cloud scraping bot-beskyttelse automatisk uden nogen proxy- eller CAPTCHA-konfiguration.

Er OpenClaw browserautomatisering gratis at bruge?

OpenClaw er open source (MIT-licens) og gratis. Men at køre det kræver infrastruktur — en VPS til $4–15/md. samt eventuelle ekstra tjenester som proxy-rotation ($10–50/md.) eller CAPTCHA-løsere (betaling pr. løsning). Den samlede månedlige pris ligger fra $8–14 ved hobbybrug til $110–280 ved tung automationsbelastning. Til sammenligning dækker grundlæggende scraping uden infrastrukturudgifter.

Hvad gør jeg, hvis min OpenClaw-agent hele tiden returnerer tomme resultater?

Tjek tre ting i denne rækkefølge: For det første er siden måske ikke fuldt indlæst — instruér agenten til at "vente 3 sekunder efter navigation, før der udtrækkes data." For det andet kan du ramme en anti-bot-væg — hvis agenten "ser" en CAPTCHA-side i stedet for rigtigt indhold, så skift fra Sandbox Chromium til Browser Relay. For det tredje kan snapshot-referencerne være forældede — bed agenten om at "tage et nyt snapshot" efter enhver navigation. Hvis intet af det virker, så tjek VPS'ens hukommelsesforbrug — en crashet browserinstans returnerer stille og roligt tomme resultater.