At ansætte en web scraping-udvikler var før i tiden lidt en niche—sådan noget, der mest var forbeholdt data scientists eller den der sjældne, teknisk stærke marketingperson. Spol frem til 2025, og det føles ærligt talt som om alle salgs-, drifts- og marketingteams, jeg taler med, jagter én, der kan ansæt web scraping-udvikler, finde en freelance web scraping-ekspert eller få fat i en specialist i webdataudtræk. Hvorfor? Fordi nettet er verdens største og mest kaotiske database, og presset for at omsætte rod til brugbare indsigter bliver kun større. Jeg har selv set, hvordan den rigtige (eller forkerte) ansættelse kan afgøre et projekt—nogle gange på ret spektakulær vis.

Markedet for web scraping og dataudtræk er i vild vækst, og de globale udgifter forventes at blive firedoblet over det næste årti (). Men når websites konstant ændrer sig, anti-bot-forsvar bliver skarpere, og forretningsbrugere kræver renere og hurtigere data, er det vigtigere end nogensinde at vælge den rette person (eller det rette værktøj). Så uanset om du er founder, teamleder eller bare “datapersonen”, der trak det korte strå, så lad os gennemgå, hvordan du ansætter en web scraping-udvikler—og hvornår du måske slet ikke behøver en.

Hvad laver en web scraping-udvikler?

En web scraping-udvikler er bindeleddet mellem internettets vilde vesten og de pæne regneark, dit team faktisk kan arbejde med. Jobbet er at forvandle skiftende, ustrukturerede websider til strukturerede og stabile datasæt—fx CSV, JSON eller direkte feeds ind i en database. Men det er ikke bare “lige at skrive et script”. Det vigtige (og svære) er at sikre, at løsningen bliver ved med at virke, når websites ændrer sig, og at håndtere paginering, undersider, anti-bot-forhindringer og alle de mærkelige hjørner, det moderne web gemmer på ().

Typiske ansvarsområder omfatter:

- At analysere websider og vælge den bedste metode til udtræk (HTML-scraping, API-kald, headless browsers)

- At håndtere dynamisk indhold, JavaScript-rendering og login-flows

- At styre paginering og berigelse via undersider (fx scrape en produktliste og derefter besøge hver produktside for flere detaljer)

- At levere rene data klar til analyse (CSV, JSON, database eller direkte integration)

- At opsætte overvågning, retries og alarmer, når noget går i stykker (for det gør det)

- At dokumentere dataspecifikationer, feltdefinitioner og opdateringsfrekvens

Freelance web scraping-eksperter bliver ofte hyret til enkeltstående opgaver, niche-mål eller hurtige prototyper. Interne specialister i webdataudtræk giver typisk mest mening, når dataudtræk er en central og løbende del af forretningen—fx daglig prisovervågning, leadgenerering eller drift af et internt dashboard ().

For ikke-tekniske teams er de her roller ren guld. De forvandler timers manuel copy-paste til automatiserede workflows, så analytikere og sælgere kan bruge tiden på det, der faktisk flytter noget.

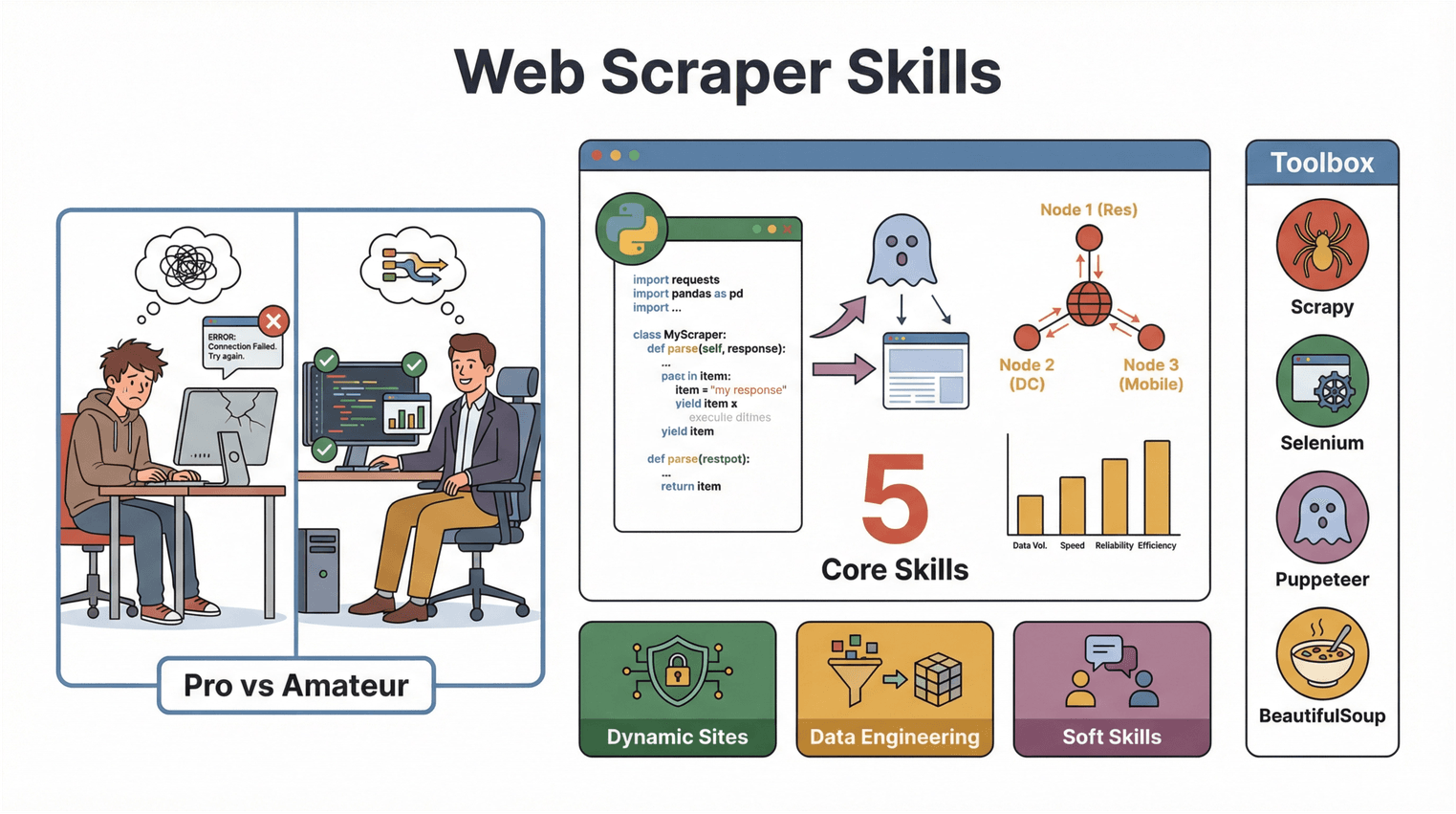

Vigtige kompetencer og erfaring, du bør kigge efter, når du ansætter en web scraping-udvikler

Ikke alle scrapers er skabt lige. Jeg har set udviklere, der kan smække et script sammen på en eftermiddag—men som ikke kan holde det kørende i en uge. Her er det, der typisk skiller de erfarne fra amatørerne:

- Stærke programmeringskompetencer: Python er mest udbredt, men JavaScript, Node.js eller endda Go er også helt normalt. Kig efter erfaring med biblioteker som BeautifulSoup, Scrapy, Selenium eller Puppeteer.

- Erfaring med web scraping-værktøjer: Kendskab til både kodebaserede og no-code værktøjer (som ) er et stort plus. De bedste ved, hvornår man skal bruge et værktøj, og hvornår man bør bygge fra bunden.

- Håndtering af dynamiske og beskyttede sites: Moderne websites elsker JavaScript og anti-bot-forsvar. Din udvikler bør være hjemmevant i headless browsers, proxies, CAPTCHAs og session-håndtering.

- Data engineering-tilgang: Det handler ikke kun om at hente data—rensning, deduplikering, validering og strukturering er mindst lige så vigtigt.

- Bløde kompetencer: Kommunikation, sans for detaljer og evnen til at løse problemer. Du vil have en, der stiller opklarende spørgsmål—ikke bare en, der siger “klart, jeg scraper det.”

Tjekliste over tekniske kompetencer

Her er en hurtig tjekliste, du kan bruge til at screene kandidater:

| Skal-have kompetencer | Rart-at-have kompetencer |

|---|---|

| Python (eller JS/Node) | Erfaring med cloud-baserede scraping-platforme |

| HTML/CSS/DOM-parsing | Kendskab til containerisering (Docker) |

| Håndtering af paginering og undersider | Opsætning af monitoring, logging og alarmer |

| Anti-bot-strategier (proxies, throttling) | Integration i datapipelines (ETL, API’er) |

| Datavalidering og QA | Forståelse for compliance og privatliv |

| Erfaring med værktøjer som Thunderbit, Octoparse | Erfaring med AI-assisteret udtræk |

Et ekstra plus: kandidater, der kan bruge værktøjer som , kan ofte levere hurtigere og med mindre vedligehold—særligt til rutineopgaver i forretningen.

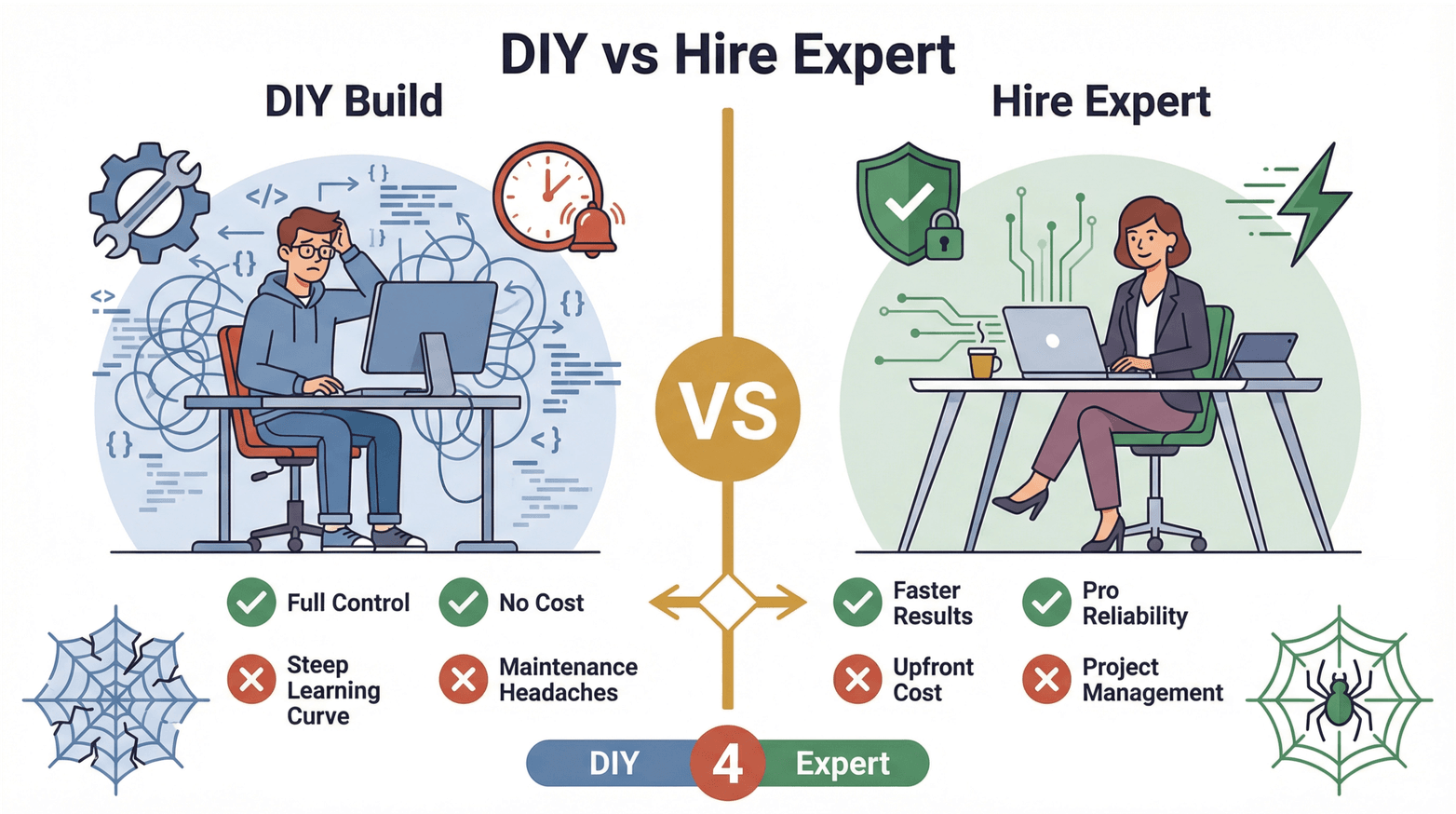

Gør-det-selv vs. at hyre en web scraping-ekspert: sammenligning af pris og effektivitet

Så hvad er smartest: at bygge din egen scraper eller at hente en freelance web scraping-ekspert ind? Lad os skille det ad.

DIY (gør det selv):

- Fordele: Fuld kontrol, ingen eksterne omkostninger, godt til læring.

- Ulemper: Stejl læringskurve, tidskrævende, vedligeholdelsesbøvl, let at undervurdere kompleksiteten.

Hyre en freelance web scraping-ekspert:

- Fordele: Hurtigere resultater, professionel stabilitet, mindre risiko for at løsningen “knækker”, når sites ændrer sig, adgang til nichekompetencer.

- Ulemper: Upfront-omkostning, kræver projektstyring, risiko for misforståelser.

Tabel: pris-sammenligning

| Tilgang | Typisk pris | Tid til levering | Vedligehold |

|---|---|---|---|

| DIY | Din tid (alternativomkostning) | Dage til uger (hvis du skal lære) | Du står for alt break/fix |

| Freelance (timepris) | $20–$40/time (upwork.com) | 1–2 uger for de fleste projekter | Kan aftale løbende support |

| Freelance (fast pris) | $500–$5.000+ (upwork.com) | 1–4 uger afhængigt af scope | Vedligehold kan koste ekstra |

| Intern ansættelse | $100k+/år (glassdoor.com) | Løbende | Fuld ejerskab (og fuld omkostning) |

Hvornår giver DIY mening? Hvis du har en teknisk baggrund, opgaven er enkel, og du ikke har noget imod at nørkle. For alt, der er forretningskritisk, i stor volumen eller ofte ændrer sig, betaler en specialist sig hurtigt hjem.

Hvornår du bør vælge en specialist i webdataudtræk

Overvej at hyre en specialist i webdataudtræk, når:

- Du skal scrape komplekse, dynamiske eller beskyttede sites

- Data er forretningskritiske eller skal opdateres regelmæssigt

- Du har brug for integration med andre systemer (CRM, databaser, API’er)

- Compliance, privatliv eller juridiske hensyn spiller ind

- Du vil undgå smerterne ved løbende vedligehold og fejlfinding

Til hurtige engangsudtræk eller simpel listeopbygning kan et værktøj som være alt, du behøver.

Hvor finder og ansætter du web scraping-udviklere og freelance-eksperter?

Der er masser af steder at finde web scraping-talent, men hver platform har sine egne “regler i praksis”.

- : Den bredeste pulje—fra juniorer til meget erfarne. Brug time- eller fastpriskontrakter, og arbejd med milepæle for at reducere risiko.

- : God til prisfølsomme projekter med tydelige leverancer. Brug milepælsbetalinger for at sikre fremdrift.

- : High-end, forhåndsscreenet talent. Ideelt hvis du vil outsource udvælgelsen og er villig til at betale ekstra.

- Fiverr: Bedst til små, velafgrænsede opgaver (“gigs”). Vær forsigtig med komplekse eller løbende projekter.

Tips til at sortere kandidater:

- Kig efter profiler med konkret web scraping-erfaring (ikke kun “Python developer”)

- Tjek relevant brancheerfaring (fx ecommerce, ejendom, B2B-leads)

- Gennemgå porteføljer og bed om eksempler eller kodeudsnit

- Læs anmeldelser og ratings grundigt

Tips til screening og interview

Tag ikke bare deres ord for gode varer. Sådan kan du screene kandidater:

Gode spørgsmål at stille:

- Kan du gennemgå et nyligt web scraping-projekt, du har leveret? Hvad var udfordringerne?

- Hvordan håndterer du sites, der bruger JavaScript eller har anti-bot-beskyttelse?

- Hvad er din proces for at sikre datakvalitet og stabilitet?

- Hvordan dokumenterer du dit arbejde til overdragelse eller fremtidig vedligehold?

- Hvad er din compliance-tjekliste, før du starter et nyt projekt?

Praktiske tests:

- Giv et eksempel-site med liste + detaljeside. Bed om en CSV med berigede data.

- Bed om en kort “datakontrakt” (feltdefinitioner, obligatoriske felter, opdateringsfrekvens), før de koder.

- Bed om en kort demo, hvor de scraper en JavaScript-tung tabel.

Hvordan Thunderbit kan mindske dit behov for web scraping-udviklere

Her er en lille hemmelighed: De fleste forretningsbrugere behøver ikke en specialkodet scraper til hvert projekt. Værktøjer som har rykket spillereglerne markant for ikke-tekniske teams.

Thunderbit er en , der lader dig udtrække strukturerede data fra næsten enhver hjemmeside med få klik. Du beskriver bare, hvad du vil have, klikker “AI Suggest Fields”, og Thunderbits AI klarer resten. Den håndterer også scraping af undersider, paginering og eksporterer direkte til Excel, Google Sheets, Airtable eller Notion.

Hvorfor er det vigtigt i forhold til ansættelse? Fordi Thunderbit skærer ned på antallet af opgaver, der reelt kræver en udvikler. For salgs-, ecommerce- og researchteams er det ofte hurtigere (og billigere) at bruge Thunderbit til rutineudtræk, leadlister eller prisovervågning. Gem den tunge engineering til det, der faktisk er komplekst.

Thunderbit vs. traditionelle web scraping-tilgange

Lad os sammenligne Thunderbits workflow med at hyre en freelance web scraping-ekspert:

| Faktor | Thunderbit | Freelance-ekspert |

|---|---|---|

| Opsætningstid | Minutter (ingen kode) | Dage til uger |

| Pris | Gratis niveau, derefter $15–$249/md. (Thunderbit Pricing) | $500–$5.000+ pr. projekt |

| Vedligehold | AI tilpasser sig site-ændringer | Manuelle opdateringer kræves |

| Eksportmuligheder | Excel, Sheets, Airtable, Notion, CSV, JSON | Varierer (ofte CSV/JSON) |

| Undersider/paginering | Indbygget, 2 klik | Kræver specialkode |

| Bedst til | Hurtige, hyppige, lette opgaver | Komplekse, store mængder, specialintegrationer |

Hvornår bør du stadig hyre en udvikler? Til forretningskritiske pipelines, “svære mål” (fx login-beskyttede eller hårdt beskyttede sites), eller når du har brug for specialintegrationer og overvågning.

Sådan styrer du outsourcede web scraping-projekter til succes

At ansætte den rigtige er kun starten. God projektstyring er det, der holder det hele på sporet (og redder dig fra de klassiske “hvor er mine data?”-øjeblikke).

Best practices:

- Definér en tydelig “datakontrakt” fra start: List alle felter, datatyper, opdateringsfrekvens og acceptkriterier ().

- Brug milepæle og escrow: Del projektet op (prøvedatasæt, fuld kørsel, planlagt kørsel, monitoring) og frigiv først betaling, når hver del er leveret ().

- Opsæt QA-gates: Sørg for, at data er deduplikerede, validerede og klar til jeres use case.

- Planlæg vedligehold: Scrapers går i stykker. Aftal en retainer eller vedligeholdsplan, hvis data er forretningskritiske.

- Dokumentér alt: Kræv README, runbook og kendte fejlsituationer. God dokumentation sparer dyre overraskelser senere.

Tips til kommunikation og samarbejde

- Regelmæssige check-ins: Ugentlige opdateringer eller demoer holder alle på linje.

- Fælles projektværktøjer: Brug Trello, Asana eller Google Docs til at følge fremdrift og feedback.

- Klare eskaleringsveje: Aftal på forhånd, hvordan blokeringer og problemer håndteres.

- Opfordr til spørgsmål: De bedste freelancere stiller opklarende spørgsmål tidligt og ofte.

Juridiske, etiske og compliance-hensyn, når du ansætter en web scraping-udvikler

Web scraping er ikke længere helt så “vilde vesten”, som det engang var. Der er reelle juridiske og etiske hensyn—særligt omkring persondata, vilkår for brug og anti-bot-beskyttelse.

Vigtige pointer:

- Offentlige data ≠ frit spil: Selv scraping af offentligt tilgængelige data kan indebære juridisk risiko, især hvis du omgår tekniske barrierer eller ignorerer vilkår ().

- Privatlivslovgivning betyder noget: GDPR, CCPA og andre regler kræver, at du kan begrunde indsamlingen, minimere påvirkning og respektere fravalg ().

- Compliance-tjekliste: Begræns scraping til godkendte sites og datatyper, undgå følsomme/personlige data medmindre det er eksplicit tilladt, dokumentér processen, og håndtér credentials sikkert ().

- Transparens: Vær tydelig over for din udvikler om compliance-krav, og få dem med i scope/statement of work.

Værktøjer som Thunderbit hjælper ved at fokusere på offentlige, forretningsrelevante data og gøre det nemt at dokumentere, hvad du indsamler—og hvorfor.

Trin-for-trin: Sådan ansætter du en web scraping-udvikler

Klar til at komme i gang? Her er en enkel, praktisk proces:

- Definér behovet: Hvilke data skal du bruge? Fra hvilke sites? Hvor ofte? I hvilket format?

- Lav en “datakontrakt”: List felter, datatyper, opdateringsfrekvens og acceptkriterier.

- Vælg platform: Upwork, Freelancer, Toptal eller Fiverr—vælg efter budget, tidsplan og behov for screening.

- Slå projektet op: Vær konkret om leverancer, deadlines og compliance-krav.

- Screen kandidater: Brug tjeklisten og spørgsmålene ovenfor. Bed om eksempler eller en lille betalt test.

- Forhandl milepæle: Del projektet op i logiske dele med tydelige outputs.

- Styr projektet: Brug faste check-ins, QA-gates og fælles værktøjer til at følge fremdrift.

- Planlæg vedligehold: Aftal, hvordan opdateringer, rettelser og ændringer håndteres.

- Dokumentér alt: Kræv README, runbook og en klar overdragelsesproces.

Og husk: Til mange rutineopgaver behøver du måske slet ikke ansætte—prøv først og se, om det dækker dit behov.

Konklusion og vigtigste takeaways

At ansætte en web scraping-udvikler er ikke længere kun for tech-giganter—det er relevant for ethvert team, der vil omsætte webdata til forretningsværdi. Men når markedet for web scraping og dataudtræk vokser med over , bliver både indsatsen (og kompleksiteten) større end nogensinde.

Det vigtigste at huske:

- Kig efter udviklere med stærke programmeringskompetencer, praktisk scraping-erfaring og en data engineering-tilgang.

- Brug platforme som Upwork, Freelancer og Toptal til at finde og vurdere talent—men styr projektet med klare kontrakter, milepæle og QA-gates.

- Til rutineopgaver med hurtig turnaround kan værktøjer som spare tid, penge og hovedpine—uden kode.

- Hold altid compliance, privatliv og dokumentation i fokus.

- De bedste resultater kommer af klare forventninger, løbende kommunikation og viljen til at tilpasse sig, når websites (uundgåeligt) ændrer sig.

Før du ansætter, så spørg dig selv: Er det en engangsopgave, et tilbagevendende behov eller en forretningskritisk pipeline? Nogle gange er det klogeste at give teamet et brugervenligt værktøj—og gemme det tunge arbejde til, når det virkelig er nødvendigt.

Vil du se, hvor meget du kan klare uden at hyre en udvikler? og prøv selv. Og hvis du vil have flere tips om web scraping, dataautomatisering eller at bygge en moderne datastack, så kig forbi .

FAQs

1. Hvad er forskellen på en freelance web scraping-ekspert og en intern specialist i webdataudtræk?

En freelance-ekspert hyres typisk til afgrænsede, kortvarige projekter eller niche-mål, mens en intern specialist driver løbende, forretningskritiske datapipelines og integrationer.

2. Hvad koster det at ansætte en web scraping-udvikler?

Freelancere tager ofte $20–$40 i timen eller $500–$5.000+ pr. projekt afhængigt af kompleksitet. Interne roller kan koste $100k+ om året. Værktøjer som Thunderbit tilbyder abonnementer fra $15/md.

3. Hvilke kompetencer skal jeg kigge efter, når jeg ansætter en web scraping-udvikler?

Kig efter stærke programmeringskompetencer (Python, JS), erfaring med dynamiske sites og anti-bot-strategier, data engineering-forståelse samt kendskab til både kodebaserede og no-code værktøjer som Thunderbit.

4. Hvornår bør jeg bruge et værktøj som Thunderbit i stedet for at hyre en udvikler?

Thunderbit er oplagt til hurtige, hyppige eller enkeltstående dataudtræk, leadgenerering eller prisovervågning—særligt når du vil have struktureret eksport og minimal opsætning. Hyr en udvikler til komplekse, forretningskritiske eller meget specialtilpassede projekter.

5. Hvilke juridiske eller compliance-udfordringer skal jeg overveje ved web scraping?

Respektér altid websites’ vilkår, privatlivslovgivning (som GDPR/CCPA), og undgå at scrape følsomme eller personlige data uden eksplicit tilladelse. Dokumentér processen, og sørg for, at din udvikler følger best practices for compliance.

Klar til at få dit næste dataprojekt til at lykkes? Start med den rigtige plan, de rigtige mennesker og de rigtige værktøjer—så vil du blive overrasket over, hvor meget mere du kan nå.

Læs mere