Jeg vil være ærlig: første gang jeg prøvede at hente hver eneste URL fra en stor hjemmeside, tænkte jeg: “Hvor svært kan det være?” Et par timer senere sad jeg stadig og klikkede mig gennem endeløse sider, kopierede links ind i et regneark og stillede spørgsmålstegn ved mine livsvalg. Hvis du nogensinde har prøvet at finde alle sider på en hjemmeside — hvad enten det er til et content-audit, en lead-liste eller konkurrentanalyse — så kender du smerten. Det er tidskrævende, fejlbehæftet og ærligt talt spild af både tid og talent.

Men her er den gode nyhed: Du behøver ikke længere gøre det på den hårde måde. AI-drevne værktøjer som ændrer spillet for forretningsbrugere og gør det muligt at finde alle URL’er på et domæne på minutter i stedet for dage. Faktisk rapporterer virksomheder, der bruger AI-drevne web scraping-værktøjer, på dataindsamlingsopgaver, og nogle ser op til sammenlignet med manuelle metoder. Det er ikke bare en statistik — det er timer (eller dage) af dit liv tilbage.

Så lad os dykke ned i, hvorfor det er så svært at finde alle sider på en hjemmeside, hvorfor generiske AI-modeller som GPT eller Claude ikke rigtig kan hjælpe, og hvordan specialiserede AI-agenter — som Thunderbit — gør processen let som en leg. Og ja, jeg guider dig gennem de præcise trin til at udtrække hver eneste URL, du har brug for, også selvom du ikke er udvikler.

Hvorfor det er så udfordrende at finde alle URL’er på et domæne

Lad os være ærlige: Hjemmesider er ikke designet til at give dig en pæn liste over alle deres sider. De er bygget til besøgende, ikke til folk, der vil finde alle sider på en hjemmeside på én gang. Her er grunden til, at opgaven er så besværlig:

- Manuel kopi-indsæt-galskab: Hvis du klikker dig gennem hver menu, liste og mappe, kopierer URL’er én for én og indsætter dem i et regneark, er det en opskrift på musearm — og på at overse halvdelen af siderne.

- Pagination og infinite scroll: Mange sites deler indhold op i flere sider eller loader flere resultater, mens du scroller. Hvis du overser en “Næste”-knap eller ikke scroller langt nok, går hele sektioner tabt.

- Uens sidestrukturer: Nogle sider viser links i ét format, andre i et helt andet layout. Det er et mareridt at holde styr på det hele.

- Skjulte eller forældreløse sider: Ikke alle sider er linket fra hovednavigationen. Nogle ligger begravet dybt og kan kun nås via sitemaps eller intern søgning.

- Menneskelige fejl: Jo flere sider du skal kopiere, desto større er sandsynligheden for fejl — dublerede URL’er, stavefejl eller bare helt oversprungne sider.

Og hvis du arbejder med et site med hundreder eller tusinder af sider? Så kan du godt opgive. Manuel udtrækning skalerer simpelthen ikke. Som et datateam udtrykte det, gælder der for alt andet end de helt trivielle tilfælde, .

Hvad betyder det egentlig at “finde alle sider på en hjemmeside”?

Før vi springer til løsningerne, så lad os blive helt skarpe på, hvad vi faktisk leder efter.

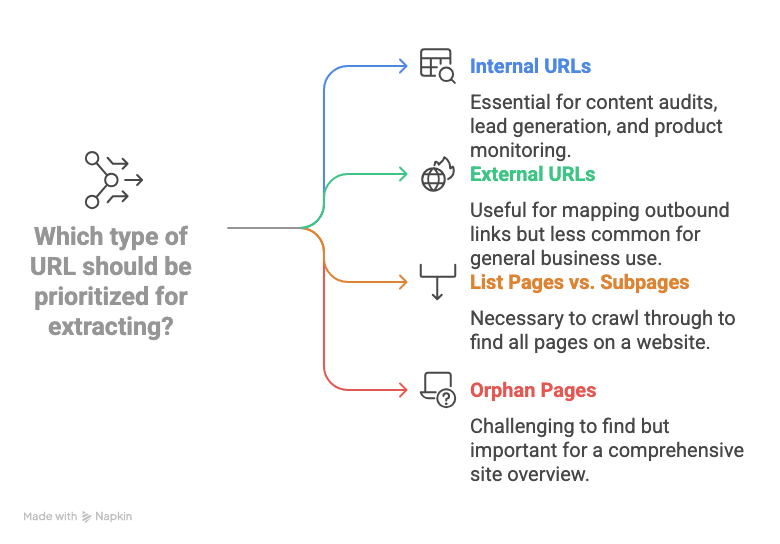

- Interne URL’er: Det er links, der peger på sider på samme domæne (som /om-os eller /produkter/widget-123). Til de fleste forretningsbehov — content-audit, leadgenerering, produktmonitorering — er interne URL’er det primære mål.

- Eksterne URL’er: Links, der går til andre hjemmesider. Dem har du normalt ikke brug for, medmindre du kortlægger udgående links.

- Listesider vs. undersider: Mange sites har “hub”- eller listesider (tænk: kategorisider, blogarkiver, kataloger), som linker videre til detaljesider (som produkt- eller profilsider). Hvis du virkelig vil finde alle sider på en hjemmeside, skal du crawle gennem disse lister og hente hver eneste underside, de linker til.

- Forældreløse sider: Det er sider, som ikke er linket fra noget oplagt sted. Nogle gange kan du fange dem via sitemaps eller intern søgning, men de er lette at overse.

Når vi taler om at finde alle URL’er på et domæne, mener vi altså: Hent hver eneste interne side-URL, fra forsiden til den dybeste produkt- eller artikelside, helst i et format du kan bruge direkte, som et regneark.

Traditionelle metoder til at finde alle URL’er på et domæne

Der findes nogle gammeldags måder at løse det på, men hver af dem har sine egne hovedpiner:

Manuel kopi-indsæt og browserværktøjer

Det er den “brute force”-tilgang: klik på hvert link, kopiér hver URL, indsæt den i et regneark, og håb at du ikke overser noget. Nogle bruger browserudvidelser til at hente alle links fra den aktuelle side, men du skal stadig gentage processen for hver side, og pagination eller skjulte sektioner må du selv håndtere. Det er fint til en side med fem sider — men ikke til meget andet.

Brug af søgning på sitet og sitemaps

- Googles site:-søgning: Skriv site:ditdomæne.dk i Google, og så ser du en række indekserede sider. Men Google viser kun det, der er indekseret (ofte med en grænse på omkring 1.000 resultater), så du går glip af nye, skjulte eller lavkvalitets sider. indrømmer, at det ikke er en fuldstændig løsning.

- XML-sitemaps: Mange sites har en /sitemap.xml, der lister vigtige URL’er. Det er fint — hvis sitemapet er opdateret og indeholder alle sider. Men ikke alle sites har et, og nogle deler deres sitemaps op i flere filer. Forældreløse sider kommer ofte ikke med.

Tekniske crawlers og scripts

- SEO-værktøjer (som Screaming Frog): De crawler et site som en søgemaskine og spytter en liste over URL’er ud. De er kraftfulde, men kræver opsætning, konfiguration og nogle gange en betalt licens til store sites.

- Python-scripts (som Scrapy): Udviklere kan skrive scripts til at crawle og udtrække URL’er. Men lad os være realistiske: Hvis du ikke er tryg ved kode, er det ikke en mulighed. Og scripts går i stykker, når sitets layout ændrer sig, så du er hele tiden bagud.

Kort sagt: Traditionelle metoder er enten for manuelle, for ufuldstændige eller for tekniske for de fleste forretningsbrugere. Der er en grund til, at så mange giver op halvvejs.

Hvorfor generiske AI-modeller ikke kan automatisere URL-udtrækning helt

Du tænker måske: “Kan jeg ikke bare bede ChatGPT eller Claude om at finde alle siderne på en hjemmeside for mig?” Det ville jeg også ønske, det var så let. Men virkeligheden er denne:

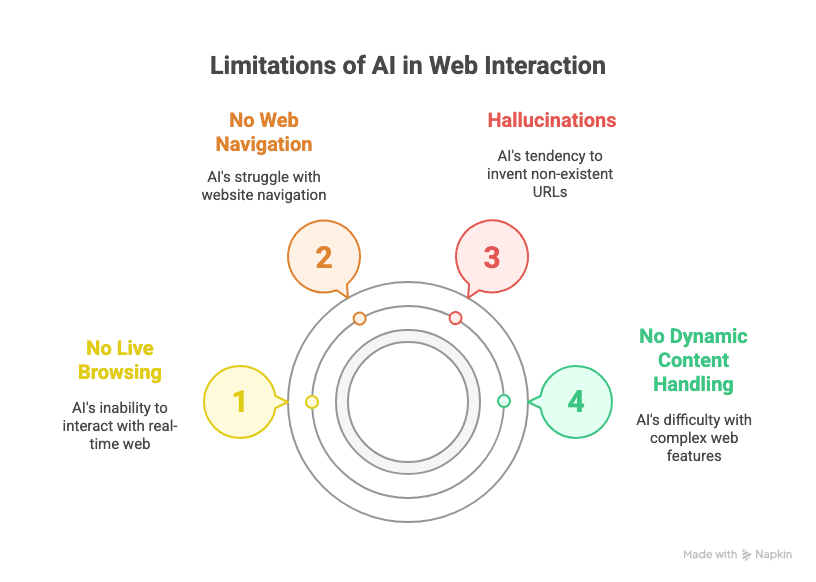

- Ingen live-browsing: Generelle AI-modeller som GPT eller Claude kan faktisk ikke browse nettet i realtid. De “ser” ikke den aktuelle tilstand på en hjemmeside — de arbejder bare ud fra deres træningsdata eller det, du indsætter.

- Ingen webnavigation: Selv med plugins eller browsing slået til ved LLM’er ved de ikke, hvordan de klikker på “Næste”, håndterer infinite scroll eller systematisk følger hvert link på et site.

- Hallucinationer: Bed en generisk AI om alle URL’er på et domæne, og den vil ofte opfinde links, der lyder plausible, men som ikke findes i virkeligheden. (Jeg har set den opfinde /om-os-sider til sites, der aldrig har haft en.)

- Ingen håndtering af dynamisk indhold: Sites, der loader indhold med JavaScript, kræver login eller bruger kompleks navigation, er uden for rækkevidde for generelle LLM’er.

Som siger: “Hvis du vil scrape sider i hundrede- eller tusindvis… så er ChatGPT alene ikke nok.” Du har brug for et værktøj, der er bygget specifikt til opgaven.

Vertikale AI-agenter er fremtiden (og derfor betyder det noget)

Her kommer min erfaring fra SaaS og automation ind: vertikale AI-agenter — AI-værktøjer bygget til et specifikt domæne, som web data extraction — er den eneste måde at få pålidelige, skalerbare resultater til forretningsopgaver. Hvorfor?

- Generelle LLM’er er gode til skrivning og søgning, men de er tilbøjelige til “hallucinationer” og kan ikke håndtere flertrins-workflows, der skal kunne gentages stabilt, sådan som virksomheder har brug for.

- Enterprise-SaaS-værktøjer skal automatisere mange gentagne, strukturerede opgaver. Her skinner vertikale AI-agenter — de er bygget til at gøre én ting og gøre det godt, med minimale fejl.

- Eksempler findes på tværs af brancher: Thunderbit til udtræk af webdata, Devin AI til softwareudvikling, Alta til salgsautomation, Infinity Learn’s IL VISTA til uddannelse, Rippling til HR, Harvey til jura… listen fortsætter.

Kort sagt: Hvis du vil finde alle sider på en hjemmeside pålideligt, har du brug for en vertikal AI-agent, der er bygget til opgaven — ikke en generel chatbot.

Mød Thunderbit: AI-drevet URL-udtrækning for alle

Her kommer ind i billedet. Som en AI-webscraper Chrome-udvidelse er Thunderbit designet til forretningsbrugere — ingen kode, ingen teknisk opsætning, bare resultater. Her er, hvad der gør den anderledes:

- Naturligt sprog-interface: Beskriv bare, hvad du vil have (“List alle side-URL’er på dette site”), så finder Thunderbits AI ud af, hvordan det skal udtrækkes.

- AI-forslag til felter: Thunderbit scanner siden og foreslår automatisk kolonnenavne (som “Side-URL”) — du behøver ikke rode med CSS-selektorer eller XPath.

- Håndterer pagination og infinite scroll: Thunderbit kan klikke “Næste” eller scrolle automatisk, så du ikke misser nogen sider.

- Navigation til undersider: Skal du dybere ned? Thunderbit kan følge links til undersider og hente data derfra også.

- Struktureret eksport: Eksportér dine resultater direkte til Google Sheets, Excel, Notion, Airtable eller CSV — gratis og med ét klik.

- Ingen kode nødvendig: Hvis du kan browse en hjemmeside, kan du bruge Thunderbit. Så enkelt er det.

Og fordi Thunderbit er en vertikal AI-agent, er den bygget til stabilitet og gentagelighed — perfekt til forretningsbrugere, der har brug for at automatisere de samme opgaver igen og igen.

Trin for trin: Sådan finder du alle URL’er på et domæne med Thunderbit

Klar til at se, hvordan det virker? Her er en ikke-teknisk gennemgang af, hvordan du udtrækker hver eneste URL, du har brug for.

1. Installér Thunderbit Chrome-udvidelsen

Først det vigtigste: . Den virker i Chrome, Edge, Brave og andre Chromium-browsere. Fastgør den til værktøjslinjen for nem adgang.

2. Åbn din mål-liste eller katalogside

Gå til den hjemmeside, du vil udtrække URL’er fra. Det kan være forsiden, et sitemap, et katalog eller en hvilken som helst listeside, der linker til de sider, du er interesseret i.

3. Start Thunderbit og opsæt dine felter

Klik på Thunderbit-ikonet for at åbne udvidelsen. Start en ny scraper-skabelon. Her sker magien:

- Klik på “AI-forslag til felter”. Thunderbits AI scanner siden og foreslår kolonner — kig efter en, der hedder “Side-URL”, “Link” eller noget tilsvarende.

- Hvis du ikke ser det helt rigtige felt, så tilføj bare en kolonne med navnet “Side-URL” (eller hvad der nu giver mening). Thunderbits AI er trænet til at genkende disse termer og mappe dem til de rigtige data.

4. Slå pagination eller scrolling til, hvis det er nødvendigt

Hvis din målside har flere sider (som “Side 1, 2, 3…” eller en “Indlæs mere”-knap), så slå pagination til i Thunderbit:

- Skift til “Klik-pagination”-tilstand for sites med “Næste”-knapper, eller “Infinite Scroll” for sider, der loader mere, mens du scroller.

- Thunderbit beder dig vælge “Næste”-knappen eller scrolleområdet — klik bare, så klarer AI’en resten.

5. Start scraping og gennemgå resultaterne

Tryk på “Scrape”-knappen. Thunderbit crawler alle sider og samler hver URL, den finder. Du ser resultaterne udfyldes i en tabel direkte i udvidelsen. På store sites kan det tage et par minutter, men det er stadig langt hurtigere end at gøre det manuelt.

6. Eksportér din URL-liste

Når scraping er færdig, klik på Eksportér. Du kan sende dine data direkte til:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

Eksport er gratis og bevarer al din formatering. Slut med kopi-indsæt-hovedpine.

Sammenligning af Thunderbit med andre løsninger til URL-udtrækning

| Metode | Brugervenlighed | Nøjagtighed og dækning | Skalerbarhed | Eksportmuligheder |

|---|---|---|---|---|

| Manuel kopi-indsæt | Pinefuld | Lav (let at overse) | Ingen | Manuel (Excel osv.) |

| Browser-linkudtrækkere | OK til 1 side | Mellem | Dårlig | Manuel |

Google site:-søgning | Let | Mellem (ikke fuldstændig) | Begrænset til ca. 1.000 | Manuel |

| XML-sitemap | Let (hvis det findes) | God (hvis opdateret) | God | Manuel/Script |

| SEO-værktøjer (Screaming Frog) | Teknisk | Høj | Høj (betalt) | CSV, Excel |

| Python-scripts (Scrapy osv.) | Meget teknisk | Høj | Høj | Tilpasset |

| Thunderbit | Meget let | Meget høj | Høj | Google Sheets, CSV osv. |

Thunderbit giver dig nøjagtigheden og skalaen fra en professionel crawler kombineret med brugervenligheden fra en browserudvidelse. Ingen kode, ingen opsætning, bare resultater.

Bonus: Udtræk mere end bare URL’er med Thunderbit

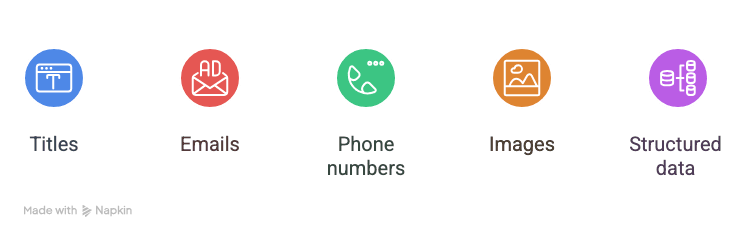

Her bliver det virkelig interessant. Thunderbit er ikke kun til URL’er — du kan udtrække:

- Titler

- E-mails

- Telefonnumre

- Billeder

- Alle strukturerede data på siden

For eksempel, hvis du bygger en lead-liste, kan du få Thunderbit til at hente profil-URL, navn, e-mail og telefonnummer fra hver eneste opføring i et katalog — alt i ét hug. Hvis du laver produkt-audit, kan du hente produkt-URL, navn, pris og lagerstatus. Thunderbit understøtter endda , så den kan klikke ind på hvert link og udtrække detaljer derfra.

Og ja, Thunderbits e-mail- og telefonudtrækkere er helt gratis. Det er en stor fordel for salgs- og marketingteams.

Vigtigste pointer: Sådan finder du alle sider på en hjemmeside med AI

Lad os samle op:

- Det er svært at udtrække alle URL’er fra et domæne med manuelle eller generiske værktøjer.

- Generiske AI-modeller som GPT kan ikke håndtere webnavigation, pagination eller dynamisk indhold.

- Vertikale AI-agenter som Thunderbit er bygget specifikt til web data extraction — stabile, gentagelige og nemme for forretningsbrugere.

- Thunderbit gør det enkelt: installér udvidelsen, brug AI til at foreslå felter, slå pagination til, scrape og eksportér. Ingen kode, intet besvær.

- Du kan udtrække mere end bare URL’er: titler, e-mails, telefonnumre og meget mere — perfekt til leadgenerering, audits eller research.

Hvis du er træt af at kopiere og indsætte links eller kæmpe med tekniske crawlers, så . Der er en gratis version, så du selv kan se, hvor meget tid — og mental energi — du sparer.

Og hvis du er nysgerrig på andre måder, Thunderbit kan hjælpe på — som , eller — så tjek for flere guides og tips.

Klar til at tage din tid tilbage fra manuel dataindsamling? Fremtiden for web data extraction er vertikale AI-agenter — og Thunderbit går forrest. Prøv det, og lad dit næste audit, din næste lead-liste eller dit næste researchprojekt blive det letteste til dato.

Læs mere

P.S. Hvis du nogensinde får lyst til at kopiere og indsætte 1.000 URL’er manuelt, så husk: der findes nu en AI til det. Dine håndled — og din chef — vil takke dig.