Næsten halvdelen af al internettrafik kommer nu fra bots. Og helt ærligt: de fleste af dem skrab links, data og URL’er i stor skala. Hvis du stadig sidder og gør det manuelt, så er du allerede ved at falde bagud.

Jeg testede 12 værktøjer til linkudtræk — alt fra AI-drevne Chrome-udvidelser til Python-biblioteker — for at finde ud af, hvilke der faktisk leverer, når du skal have skrabet tusindvis af URL’er hurtigt.

Her er, hvad jeg fandt.

Hvorfor linkudtrækkere er vigtige

Lad os være ærlige: Webben er proppet med data, og virksomheder prøver konstant at forvandle støj til noget, der kan bruges i praksis. og er derfor blevet helt centrale værktøjer for teams, der vil:

- Skabe leads: Salg kan hente links til virksomhedsprofiler fra kataloger eller LinkedIn på få minutter og sende URL’erne videre til værktøjer, der udtrækker kontaktinfo. Slut med endeløs klikken.

- Samle indhold og styrke SEO: Marketing kan samle alle artikel-URL’er fra en blog, holde øje med konkurrenters backlinks eller gennemgå sitestrukturer for døde links.

- Overvåge konkurrenter og lave markedsresearch: Driftsteams kan automatisk samle links til nye produkter, prissider eller pressemeddelelser — og følge markedet uden at brænde tid og ressourcer af.

- Automatisere arbejdsgange og spare tid: Moderne link scraper-værktøjer kan håndtere store URL-lister, crawle undersider og eksportere data i strukturerede formater (CSV, Excel, Google Sheets, Notion — you name it). Det betyder farvel til copy-paste-maraton og oprydning i rodede tekstfiler.

Når man samtidig tænker på, at , giver manuel håndtering bare ikke mening. Den rigtige linkudtrækker er som en turbo-assistent: bliver aldrig træt, overser aldrig et link og beder aldrig om en kaffepause.

Sådan udvalgte vi de bedste linkudtrækkere

Med så mange muligheder kan det føles som speed-dating på en tech-konference at vælge den rigtige linkudtrækker — alle lover guld og grønne skove, men kun få leverer. Sådan skar jeg feltet ned til de 12 bedste:

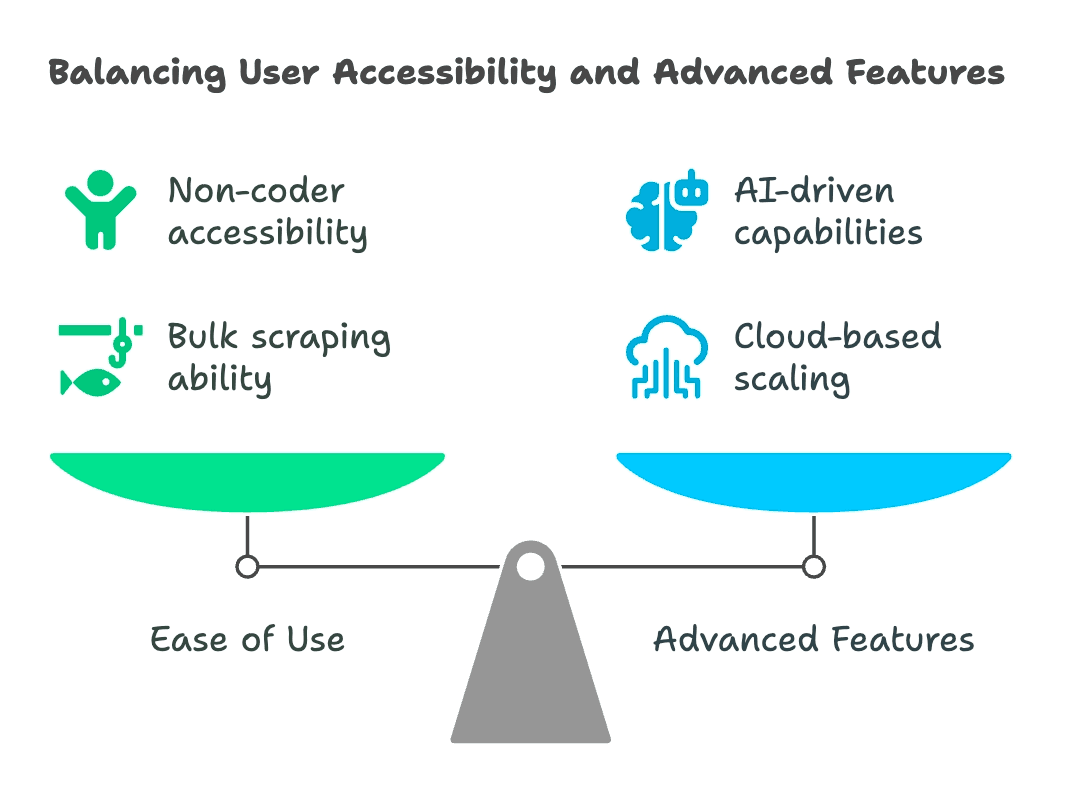

- Brugervenlighed: Kan ikke-tekniske brugere komme i gang uden en PhD i regex? No-code og low-code fik ekstra point.

- Bulk- og multi-level scraping: Kan den håndtere hundredvis af URL’er på én gang? Crawler den undersider og følger links automatisk?

- Eksport og integration: Kan den eksportere til CSV, Excel, Google Sheets, Notion, Airtable eller via API? Jo mindre manuelt arbejde, jo bedre.

- Brugertype og fleksibilitet: Er den lavet til forretningsbrugere, analytikere eller udviklere? Nogle værktøjer passer til alle, andre er mere niche.

- Avancerede funktioner: AI-baseret genkendelse, planlægning, cloud-skalering, datarensning og skabeloner til typiske sites.

- Pris og skalerbarhed: Gratis niveauer, pay-as-you-go eller enterprise? Jeg kiggede på, hvad du reelt får for pengene.

Jeg har taget alt med fra browserudvidelser til enterprise-platforme, så uanset om du er solo-founder eller et Fortune 500-datateam, er der noget, der passer.

Thunderbit: Den mest intelligente linkudtrækker til forretningsbrugere

Vi starter helt i toppen. er min foretrukne anbefaling til linkudtræk — og ikke kun fordi jeg har været med til at bygge det. Thunderbit er en , lavet til forretningsbrugere, der vil have resultater hurtigt.

Hvad gør Thunderbit anderledes? Det føles som at have en AI-praktikant, der faktisk fatter opgaven. Du kan forklare, hvad du vil have, med helt almindeligt sprog (“Hent alle produktlinks og priser fra denne side”), og Thunderbits AI klarer resten. Ingen bøvl med selectors og ingen scripts.

Og det stopper ikke der:

- Understøttelse af mange URL’er: Indsæt én URL eller en liste med hundredvis — Thunderbit tager dem i samme omgang.

- Navigation på undersider: Skal du udtrække links fra en oversigtsside og derefter besøge hver detaljeside for flere URL’er? Thunderbits multi-layer scraping klarer det.

- Struktureret eksport: Når links er udtrukket, kan du omdøbe felter, kategorisere dem og eksportere direkte til Google Sheets, Notion, Airtable, Excel eller CSV. Ingen efterbehandlingshovedpine.

Thunderbit bruges af over 30.000 brugere verden over — fra salgsteams til ejendomsmæglere og små e-commerce-butikker. Og ja, der findes et (skrabe op til 6 sider, eller 10 med en trial-boost), så du kan teste uden risiko.

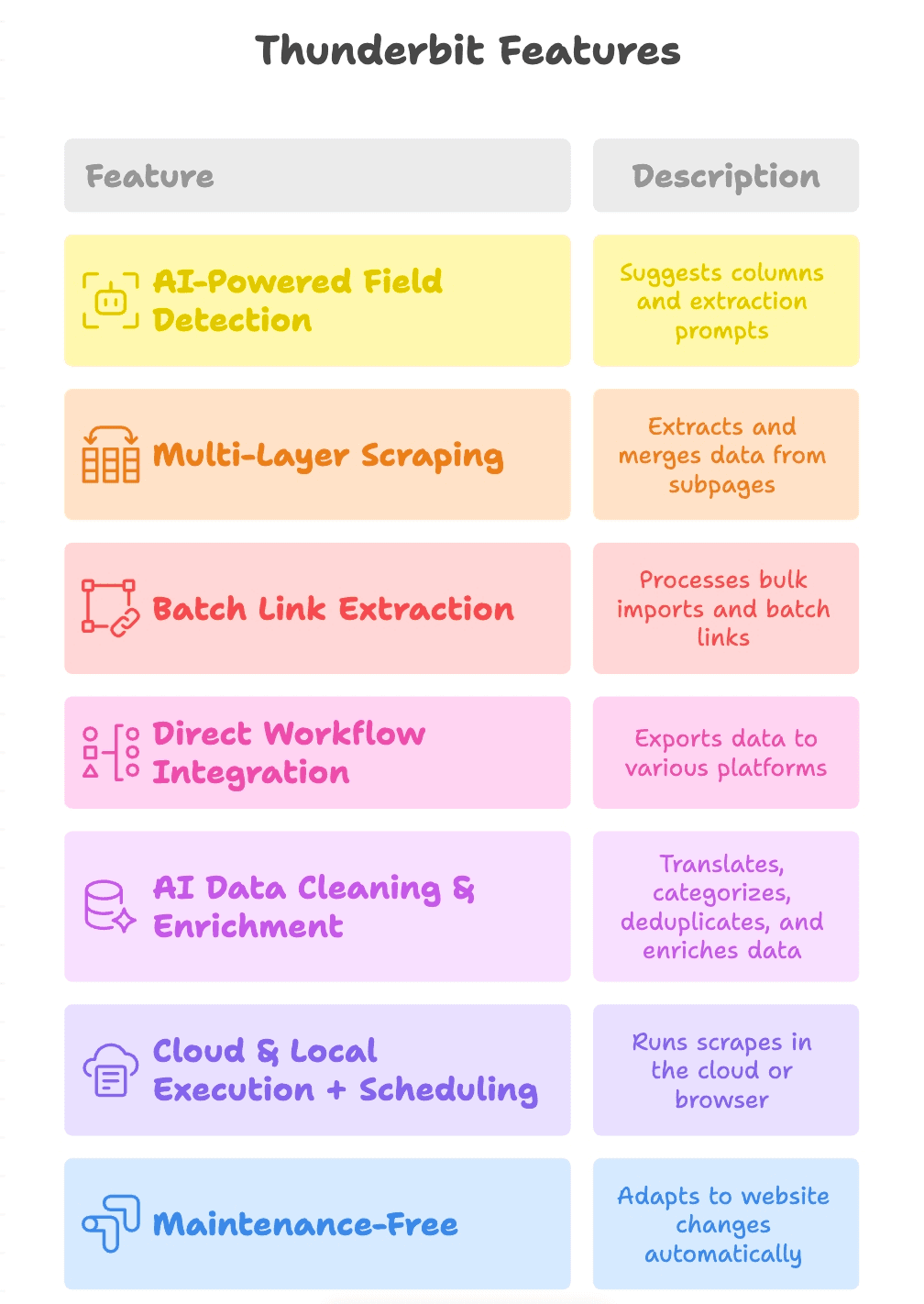

Thunderbits stærkeste funktioner

Lad os lige zoome ind på det, der virkelig gør Thunderbit til noget særligt:

- AI-drevet feltdetektion: Klik på “AI Suggest Fields”, så læser Thunderbit siden, foreslår kolonner (fx “Produktlink”, “PDF-URL”, “Kontakt-e-mail”) og laver endda udtræks-prompts til hvert felt.

- Multi-layer scraping: Thunderbit kan følge links fra en hovedside til undersider (fx produktdetaljer eller PDF-downloads), udtrække flere links og samle det hele i én tabel.

- Batch-udtræk af links: Uanset om du skraber én side eller tusind, kan Thunderbit håndtere bulk-import og batch-udtræk uden besvær.

- Direkte integration i arbejdsgange: Eksportér til Google Sheets, Notion, Airtable eller download som CSV/Excel. Data lander præcis dér, hvor teamet skal bruge dem.

- AI-datarensning og berigelse: Thunderbit kan oversætte, kategorisere, fjerne dubletter og endda berige data undervejs — så outputtet er klar til brug, ikke bare et råt dump.

- Cloud- og lokal kørsel + planlægning: Kør scraping i skyen for fart, eller i browseren til sites, der kræver login. Planlæg gentagne jobs, så data altid er opdaterede.

- Næsten vedligeholdelsesfrit: Thunderbits AI tilpasser sig ændringer på websites, så du bruger mindre tid på at reparere scrapers og mere tid på at få resultater.

Octoparse: No-code link-scraper til alle

er en klassiker inden for no-code scraping. Det er en desktop-app (Windows/Mac) med en visuel point-and-click-grænseflade. Du åbner en webside, klikker på de links, du vil have, og Octoparse spotter mønsteret.

- God til begyndere: Ingen kode. Klik, udtræk, færdig.

- Håndterer paginering og dynamisk indhold: Octoparse kan klikke på “Næste”, scrolle og endda logge ind.

- Cloud scraping og planlægning: Betalte planer giver cloud-kørsel og planlagte, tilbagevendende opgaver.

- Eksportmuligheder: Download som CSV, Excel, JSON eller send til databaser.

Gratisplanen er fin til mindre opgaver (op til 10 tasks og 50.000 rækker/måned), men ved større behov kræver det en betalt plan (fra ca. 75 USD/måned).

Apify: Fleksibel URL-udtrækker til skræddersyede workflows

er web scraping’s schweizerkniv. Du får en markedsplads med færdige “actors” (scraping-værktøjer) og mulighed for at skrive dine egne scripts i JavaScript eller Python.

- Færdige løsninger og tilpasning: Brug community-actors til standardopgaver, eller byg dine egne til specialflows.

- Bulk og planlagt scraping: Sæt URL’er i kø, kør jobs parallelt og planlæg gentagne scrapes.

- API-first: Eksportér til JSON, CSV, Excel eller Google Sheets, og integrér i din datapipeline.

- Pay-as-you-go: Gratis credits hver måned, derefter forbrugsbaseret betaling.

Apify passer især godt til semi-tekniske teams og udviklere, der vil have fleksibilitet og skalerbarhed.

Bright Data URL Scraper: Link-scraping i enterprise-klassen

er bygget til virksomheder, der skal skrabe i stor skala. Deres Data Collector har en foruddefineret URL Scraper til højvolumen-jobs.

- Håndterer enorm skala: Skrab tusindvis eller millioner af sider med stærk proxy-infrastruktur, der reducerer risikoen for blokering.

- Skabeloner klar til brug: Færdige scrapers til e-commerce, sociale medier, ejendom, m.m.

- Enterprise-funktioner: Compliance-værktøjer, ekspertsupport og avanceret anti-blocking.

- Pris: Starter omkring 350 USD for 100.000 page loads — tydeligt målrettet større virksomheder.

For startups kan det være overkill. Men til forretningskritisk scraping i høj volumen er Bright Data en tung spiller.

WebHarvy: Visuel linkudtrækker med enkel point-and-click

er en desktop-app (Windows), hvor du udtrækker links ved bare at klikke på dem i den indbyggede browser.

- Meget enkel: Klik på et link, og WebHarvy markerer automatisk lignende elementer til udtræk.

- Understøtter regulære udtryk: Indbyggede mønstre til typiske opgaver uden kode.

- Eksport til Excel, CSV, JSON, XML, SQL: Godt til forretningsbrugere, der vil have data i velkendte formater.

- Engangslicens: Betal én gang, brug for altid.

Perfekt til små virksomheder, forskere eller alle, der vil have en hurtig og ukompliceret måde at hente links uden at kode.

Web Scraper (Chrome-udvidelse): Hurtig link-scraping direkte i browseren

er et gratis open-source værktøj, der gør din browser til en scraper.

- Definér sitemaps: Fortæl den, hvordan den skal navigere, og hvad den skal udtrække.

- Håndterer paginering og multi-level crawling: Crawl kategorier, underkategorier og detaljesider.

- Eksport til CSV/XLSX: Download data direkte fra browseren.

- Community-skabeloner: Mange delte sitemaps til populære sites.

God til hurtige engangsopgaver, studerende og små teams med stramt budget.

ScraperAPI: Skalerbar link-scraper til udviklere

er til udviklere, der vil hente websider i stor skala uden at bekymre sig om proxies, blokeringer eller CAPTCHAs.

- API-drevet: Send en URL, få HTML eller skrabede data tilbage.

- Skala og anti-bot indbygget: Proxy-rotation, JS-rendering og CAPTCHA-løsning.

- Integrerer med din kode: Brug med Python, Node.js eller hvilket som helst sprog.

- Pris: Gratis niveau (~1000 API-kald), derefter betaling pr. request.

Rigtig stærk til custom crawlers — eller når du bare har brug for stabilitet og fart i stor skala.

ParseHub: Visuel link-scraper med avanceret udvælgelse

er en desktop-app (Windows, Mac, Linux), hvor du bygger scraping-projekter visuelt.

- Avanceret udvælgelse og navigation: Klik, loop og udtræk betinget — også fra dynamiske eller skjulte elementer.

- Håndterer indlejrede sider: Crawl kategorier, derefter detaljesider, og udtræk flere links.

- Eksport til CSV, Excel, JSON: Cloud-kørsler og API-adgang på betalte planer.

- Gratis plan: 5 projekter, op til 200 sider pr. kørsel.

ParseHub er populær blandt marketingfolk og researchere, der vil have power uden kode.

Scrapy: Python-linkudtrækker til udviklere

er guldstandarden for Python-udviklere, der vil have fuld kontrol.

- Kode først: Byg dine egne spiders til at crawle og udtrække links i enhver skala.

- Understøtter distribueret crawling: Effektiv, asynkron og ekstremt tilpasningsbar.

- Eksport til CSV, JSON, XML eller database: Du styrer output.

- Open-source og gratis: Men du skal selv håndtere miljø og drift.

Hvis du er tryg ved Python, er Scrapy noget af det mest kraftfulde, du kan bruge.

Diffbot: AI-drevet link-scraper til strukturerede data

er “AI-hjernen” bag web scraping. Den analyserer sider og returnerer strukturerede data — inklusive links — uden manuel opsætning.

- Automatisk indholdsgenkendelse: Giv den en URL, få strukturerede data tilbage (artikler, produkter, links osv.).

- Crawlbot og Knowledge Graph: Crawl hele sites eller forespørg i deres store webindeks.

- API-drevet: Integrér med BI-værktøjer eller datapipeline.

- Enterprise-priser: Starter omkring 299 USD/måned, men du betaler for kvaliteten.

Bedst til virksomheder, der vil have rene, strukturerede data uden at vedligeholde scrapers.

Cheerio: Letvægts link-scraper til Node.js

er en hurtig, jQuery-lignende HTML-parser til Node.js.

- Meget hurtig: Parser HTML på millisekunder.

- Velkendt syntaks: Kan du jQuery, kan du Cheerio.

- Perfekt til statiske sider: Renderer ikke JS, men er ideel til server-renderet indhold.

- Open-source og gratis: Kombinér med axios eller fetch til requests.

Ideel til udviklere, der bygger egne scripts og vil have fart og enkelhed.

Puppeteer: Browserautomatisering til avanceret link-scraping

er et Node.js-bibliotek til at styre Chrome i headless mode.

- Fuld browserautomatisering: Indlæs sider, klik, scroll og interagér som en rigtig bruger.

- Håndterer dynamisk indhold og logins: Perfekt til JavaScript-tunge sites eller komplekse flows.

- Fin kontrol: Vent på elementer, tag screenshots, opsnap netværksrequests.

- Open-source og gratis: Men tungere og langsommere end letvægtsværktøjer.

Brug Puppeteer, når du skal udtrække links fra sites, der ikke spiller godt med simple scrapers.

Hurtigt overblik: Hvilken linkudtrækker passer til dit behov?

Her er en hurtig sammenligning af alle 12 værktøjer:

| Værktøj | Bedst til | Bulk- og undersidestøtte | Eksportmuligheder | Pris |

|---|---|---|---|---|

| Thunderbit | Ikke-tekniske brugere, business | Ja (AI, multi-level) | Excel, CSV, Sheets, Notion, Airtable | Gratis prøve, fra ~9 USD/md. |

| Octoparse | No-code brugere, analytikere | Ja | CSV, Excel, JSON, cloud storage | Gratis niveau, ~75 USD/md. |

| Apify | Semi-tekniske teams, udviklere | Ja | CSV, JSON, Sheets via API | Gratis credits, forbrugsbaseret |

| Bright Data | Enterprise | Ja (høj volumen) | CSV, JSON, NDJSON via API | ~350 USD/100k sider |

| WebHarvy | Ikke-tekniske brugere, desktop | Ja | Excel, CSV, JSON, XML, SQL | Betalt licens |

| Web Scraper Extension | Alle, hurtigt/gratis | Ja | CSV, XLSX | Gratis, open-source |

| ScraperAPI | Udviklere, API-brugere | Ja | JSON (HTML via API) | Gratis 1k req, betalte niveauer |

| ParseHub | Ikke-tekniske brugere, avanceret | Ja | CSV, Excel, JSON, API | Gratis 5 projekter, betalt |

| Scrapy | Udviklere, Python | Ja | CSV, JSON, XML, DB | Gratis, open-source |

| Diffbot | Enterprise, AI | Ja (AI crawl) | JSON (strukturerede data via API) | ~299 USD/md.+ |

| Cheerio | Udviklere, Node.js | Ja (custom kode) | Custom (JSON m.m.) | Gratis, open-source |

| Puppeteer | Udviklere, komplekse sites | Ja (fuld automatisering) | Custom (scriptet output) | Gratis, open-source |

Sådan vælger du den rigtige link-scraper til din virksomhed

Hvordan vælger du så? Her er min hurtige huskeliste:

- Ingen kodeerfaring? Start med Thunderbit, Octoparse, ParseHub, WebHarvy eller Web Scraper-udvidelsen.

- Brug for skræddersyede workflows? Apify, ScraperAPI eller Cheerio er stærke valg for udviklere.

- Enterprise-skala? Bright Data eller Diffbot er bygget til det.

- Python- eller Node.js-udvikler? Scrapy (Python) eller Cheerio/Puppeteer (Node.js) giver fuld kontrol.

- Vil du eksportere direkte til Sheets/Notion? Thunderbit er det oplagte valg.

Match værktøjet med dit tekniske niveau, datamængde og integrationsbehov. De fleste tilbyder gratis prøveperioder, så vær ikke bange for at teste.

Thunderbits unikke værdi til linkudtræk i 2026

Lad os lige vende tilbage til, hvad der gør Thunderbit reelt anderledes:

- AI-drevet enkelhed: Beskriv ønsket med almindeligt sprog — Thunderbits AI klarer resten.

- Multi-layer scraping: Udtræk links fra hovedsider, følg til undersider og hent flere URL’er — i ét flow.

- Bulk-import og batch-behandling: Indsæt hundredvis af URL’er, udtræk links i bulk og eksportér strukturerede data med det samme.

- Integration i arbejdsgange: Eksportér direkte til Google Sheets, Notion, Airtable eller download som CSV/Excel.

- Nul vedligeholdelse: Thunderbits AI tilpasser sig ændringer på websites, så du ikke konstant skal reparere scrapers.

Thunderbit bygger bro mellem “bare at skrabe data” og “at få data, du faktisk kan bruge”. Det er værktøjet, jeg ville ønske, jeg havde haft for år tilbage, da jeg druknede i manuelle dataopgaver.

Konklusion: Skrab links smartere og få mere ud af din arbejdsdag

Webdata er brændstof til vækst — og den rigtige linkudtrækker er motoren. Uanset om du bygger leadlister, overvåger konkurrenter eller automatiserer research, findes der et værktøj her, der matcher både behov og kompetencer.

Hvis du vil se, hvordan moderne linkudtræk ser ud i praksis, så . Du vil sandsynligvis blive overrasket over, hvor meget du kan nå med få klik. Og hvis Thunderbit ikke er det perfekte match, så test et par andre fra listen — der har aldrig været et bedre tidspunkt at automatisere det kedelige og fokusere på det, der virkelig rykker.

God scraping — og må dine links altid være rene, strukturerede og klar til brug. Vil du dykke dybere ned i web scraping, så kig forbi for flere guides og tips.

Ofte stillede spørgsmål (FAQ)

1. Hvorfor er linkudtrækkere uundværlige?

Når næsten halvdelen af internettrafikken kommer fra bots, og virksomheder aggressivt indsamler data, er linkudtrækkere afgørende for at omsætte web-kaos til brugbar indsigt. De automatiserer opgaver som leadgenerering, indholdsindsamling, SEO-audits og konkurrentovervågning — og sparer enorme mængder tid og arbejde.

2. Hvad får Thunderbit til at skille sig ud blandt andre linkudtrækkere?

Thunderbit bruger AI til at gøre scraping enkelt: Beskriv målet med almindeligt sprog, og så klarer den resten. Den understøtter bulk-URL’er, multi-layer scraping, smart feltdetektion og nem eksport til fx Google Sheets og Notion. Den er ideel til ikke-tekniske brugere og teams, der vil have stærke resultater uden teknisk bøvl.

3. Findes der linkudtrækkere til udviklere og skræddersyede workflows?

Ja. Værktøjer som Apify, ScraperAPI, Cheerio, Puppeteer og Scrapy er målrettet udviklere. De tilbyder scripting, API-integration og fleksibilitet til komplekse scraping-opgaver, store jobs og avanceret automatisering.

4. Hvilke værktøjer er bedst, hvis man ikke kan kode?

Thunderbit, Octoparse, ParseHub, WebHarvy og Web Scraper Chrome-udvidelsen er blandt de bedste valg for ikke-tekniske brugere. De tilbyder visuelle interfaces, færdige skabeloner og AI-funktioner, der gør linkudtræk tilgængeligt for alle.

5. Hvordan vælger jeg den rigtige linkudtrækker til mit behov?

Tænk over dit tekniske niveau, datamængde og eksportbehov. Ikke-tekniske brugere bør vælge værktøjer som Thunderbit eller Octoparse, mens udviklere ofte foretrækker Scrapy eller Puppeteer. Virksomheder med stor skala kan kigge på Bright Data eller Diffbot. Start altid med en gratis prøveperiode for at se, hvad der passer bedst.