I sidste kvartal sad vores driftsteam og brugte 40 timer om ugen på at copy-paste konkurrentdata ind i regneark. I dette kvartal? 20 minutter.

Hvad ændrede sig? automatiserede web scraping-værktøjer. De er gået fra at være noget, kun udviklere gad (eller kunne) sætte op, til noget enhver sælger eller marketingmedarbejder kan konfigurere i frokostpausen.

Jeg har bygget SaaS- og automatiseringsværktøjer i årevis (og ja, jeg var med til at stifte ). Udvalget af værktøjer i 2026 er det stærkeste, jeg har set — AI-first, selvreparerende og faktisk brugbart for ikke-tekniske teams.

Her er 10, jeg har testet i praksis, sammenlignet efter use case og kompetenceniveau.

Hvorfor automatiserede web scraping-værktøjer er vigtige for forretningsbrugere

Lad os være ærlige: æraen med manuelt at kopiere og indsætte data fra websites er slut (medmindre du er til musearm og eksistentiel udmattelse). automatiserede web scraping-værktøjer er blevet forretningskritiske for virksomheder i alle størrelser. Faktisk , og web scraping er en helt central brik i den strategi.

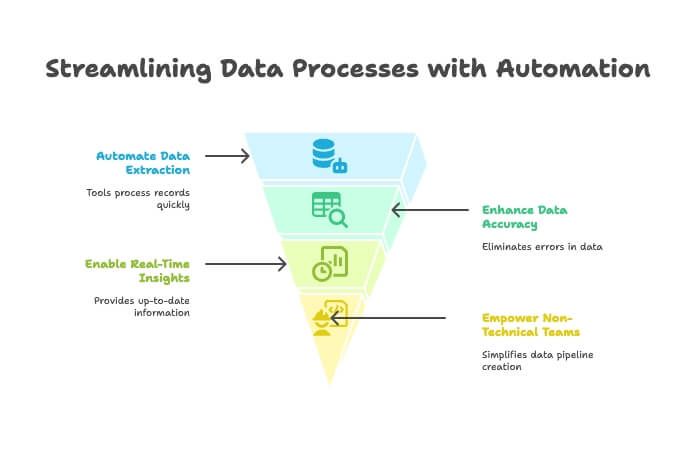

Derfor er værktøjerne så værdifulde:

- Spar tid og skær ned på manuelt arbejde: Automatiserede scrapers kan behandle tusindvis af poster på få minutter, så teamet kan bruge tiden på opgaver med højere værdi. En bruger fortalte, at de sparede “hundredvis af timer” ved at automatisere dataindsamling ().

- Bedre datakvalitet: Slut med tastefejl og oversete rækker. Automatisk udtræk giver renere, mere konsistente og mere pålidelige data.

- Hurtigere beslutninger: Med data i (næsten) realtid kan du overvåge konkurrenter, følge priser eller bygge leadlister uden at vente på månedens praktikant-rapport.

- Gør ikke-tekniske teams selvkørende: Takket være no-code og AI-drevne værktøjer kan selv dem, der tror “XPath” er en yogastilling, nu bygge web-datapipelines ().

Det er heller ikke tilfældigt, at , og at næsten 80% siger, at deres organisation ikke kunne fungere effektivt uden. I 2026 gælder det: hvis du ikke automatiserer din data scraping, så efterlader du sandsynligvis både penge — og indsigter — på bordet.

Sådan valgte vi de bedste automatiserede web scraping-værktøjer

Når markedet for web scraping-software forventes at , kan det føles som at købe sko i en butik med 10.000 modeller. Sådan skar jeg feltet ned:

- Brugervenlighed: Kan en ikke-udvikler komme hurtigt i gang? Eller er læringskurven stejl?

- AI-funktioner: Bruger værktøjet AI til automatisk at finde felter, håndtere dynamiske sites eller lade dig beskrive behov på almindeligt sprog?

- Eksport og integrationer: Hvor nemt er det at få data ind i Excel, Google Sheets, Airtable, Notion eller dit CRM?

- Pris: Findes der en gratis prøveperiode? Er betalte planer realistiske for enkeltpersoner og små teams — eller kun for enterprise?

- Skalerbarhed: Kan værktøjet klare både små engangsopgaver og store, planlagte udtræk?

- Målgruppe: Er det bygget til forretningsbrugere, udviklere eller begge?

- Særlige styrker: Hvad gør værktøjet anderledes end resten?

Jeg har taget værktøjer med til alle niveauer — fra “jeg vil bare have et regneark” til “jeg vil crawle hele internettet”. Lad os hoppe ud i det.

1. Thunderbit: AI Web Scraper til alle

Jeg starter med det værktøj, jeg kender bedst — fordi mit team og jeg byggede det for at løse præcis de problemer, jeg igen og igen har set hos forretningsbrugere. er ikke en klassisk “drag-and-drop” eller “byg dine egne selectors”-løsning. Det er en AI-drevet dataassistent, hvor du beskriver, hvad du vil have — og så klarer den resten. Ingen kode, intet bøvl med XPath, ingen frustration.

Hvorfor Thunderbit ligger øverst

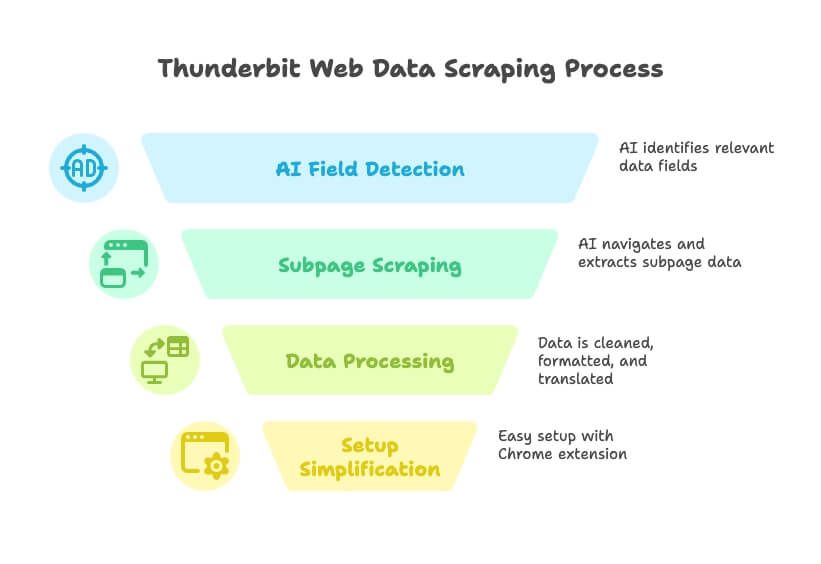

Thunderbit er det tætteste, jeg har set på “at gøre ethvert website til en database”. Sådan fungerer det:

- Styret af naturligt sprog: Fortæl Thunderbit, hvilke data du skal bruge (fx “jeg vil have alle virksomhedsnavne, e-mails og telefonnumre fra dette katalog”), og AI’en finder automatisk de relevante felter.

- AI Suggest Fields: Med ét klik læser Thunderbit siden og foreslår de bedste kolonner at udtrække — ingen gætteri og ingen trial-and-error.

- Undersider og scraping i flere niveauer: Skal du bruge detaljer fra hver listings underside? Thunderbit kan klikke videre, hente ekstra info og tilføje det til din tabel.

- Datarensning, oversættelse og klassificering: Thunderbit stopper ikke ved rå data — den kan rense, formatere, oversætte og endda kategorisere felter undervejs.

- Ingen opsætningshovedpine: Installer , klik “AI Suggest Fields”, og du er i gang på under et minut.

- Gratis prøve og lav pris: En generøs gratis plan (skrabe op til 6 sider gratis), og betalte planer starter ved kun $9/måned. Det er mindre end mit ugentlige kaffebudget.

Thunderbit er lavet til salg, marketing og drift, der har brug for data — hurtigt. Ingen kodning, ingen plugins, ingen træning. Som at have en data-praktikant, der faktisk lytter og aldrig brokker sig.

Thunderbits mest markante funktioner

- AI-drevet scraping: AI’en forstår sidestrukturen, tilpasser sig layoutændringer og håndterer endda paginering og undersider automatisk ().

- Øjeblikkelig eksport: Send resultater direkte til Excel, Google Sheets, Airtable, Notion eller download som CSV/JSON.

- Cloud eller lokalt: Kør scraping i skyen for fart og skala — eller i browseren, hvis du skal bruge login/session.

- Scheduled Scraper: Opsæt tilbagevendende jobs, så dine data altid er opdaterede — perfekt til prisovervågning eller løbende lead-opdateringer.

- Minimal vedligeholdelse: Thunderbits AI tilpasser sig website-ændringer, så du bruger mindre tid på at reparere scrapers ().

Hvem er det til? Alle, der vil gå fra “jeg mangler de her data” til “her er dit regneark” på få minutter — især ikke-tekniske brugere. Med og en 4,9★ rating er Thunderbit hurtigt ved at blive standardvalget for forretningsteams, der vil have resultater uden bøvl.

Vil du se det i praksis? Besøg eller find flere guides på .

2. Clay: Automatiseret data enrichment møder web scraping

Clay er lidt som en schweizerkniv til growth-teams. Det er ikke kun en web scraper — det er et automatiserings-regneark, der forbinder til 50+ live datakilder (fx Apollo, LinkedIn, Crunchbase) og bruger indbygget AI til at berige leads, skrive outreach-mails og score prospects.

- Workflow-automatisering: Hver række er et lead, og hver kolonne kan hente data eller udløse en handling. Vil du skrabe en virksomhedsliste, berige med LinkedIn-profiler og sende en personlig mail? Clay kan det.

- AI-integration: Bruger GPT-4 til at skrive icebreakers, opsummere bios og mere.

- Integrationer: Forbinder direkte til HubSpot, Salesforce, Gmail, Slack m.fl.

- Pris: Starter omkring $99/måned for Pro-planen, med gratis prøve til let brug.

Bedst til: Outbound sales, growth hackers og marketingfolk, der vil bygge deres egne lead-pipelines ved at kombinere scraping, enrichment og outreach ét sted. Det er kraftfuldt, men kræver lidt tilvænning, hvis du er ny i automatiseringsværktøjer ().

3. Bardeen: Browserbaseret web scraper-værktøj til workflow-automatisering

Bardeen er som at have en browser-robot, der kan skrabe data og automatisere gentagne webopgaver — direkte fra en Chrome-udvidelse.

- No-code automatisering: 500+ “Playbooks” til scraping, udfyldning af formularer, flytning af data mellem apps og meget mere.

- AI Command Builder: Beskriv opgaven med almindelige ord, og Bardeen bygger workflowet.

- Integrationer: Virker med Notion, Trello, Slack, Salesforce og 100+ andre apps.

- Pris: Gratis til let brug (100 automationskreditter/måned), betalte planer starter ved $99/måned for teams.

Bedst til: Power users og go-to-market teams, der vil automatisere scraping og efterfølgende handlinger på tværs af flere apps. Fleksibiliteten er stor, men begyndere kan opleve en lidt stejl læringskurve ().

4. Bright Data: Automatiserede web scraping-værktøjer i enterprise-klassen

Bright Data (tidligere Luminati) er den tunge maskinpark inden for web scraping — tænk globale proxy-netværk, avancerede API’er og mulighed for at crawle tusindvis af sider om dagen.

- Enterprise-skala: Over 100 millioner IP’er, Web Scraper IDE, Web Unlocker til at omgå anti-bot.

- Kan tilpasses: Byg komplekse udtræk i stor skala med høj stabilitet.

- Pris: Starter ved $499/måned for Web Scraper IDE, med mindre “micro”-pakker.

Bedst til: Store virksomheder, dataaggregatorer og avancerede brugere, der har brug for robuste, skalerbare løsninger. Hvis du crawler tusindvis af sider dagligt og skal undgå IP-blokeringer, er Bright Data bygget til det ().

5. Octoparse: Visuelt web scraper-værktøj til øvede

Octoparse er et populært no-code værktøj med en visuel point-and-click-grænseflade — perfekt, hvis du vil have power uden at programmere.

- Drag-and-drop UI: Klik på elementer for at definere udtræk, håndtere login, paginering m.m.

- Skabeloner: 500+ færdige templates til typiske sites (Amazon, Twitter osv.).

- Cloud scraping: Kør jobs på Octoparses servere, planlæg udtræk og brug IP-rotation.

- Pris: Gratis plan med begrænsninger; betalte planer starter ved $119/måned.

Bedst til: Ikke-programmører og dataanalytikere, der vil have en stærk scraper uden kode. God til prisovervågning, produktlister og researchprojekter ().

6. : Data scraping-platform til virksomheder

er en af de oprindelige spillere inden for web scraping og er i dag vokset til en fuld dataudtræksplatform.

- Point-and-click udtræk: Håndterer login, dropdowns og interaktive elementer.

- Cloud-baseret: Behandl tusindvis af URL’er parallelt, planlæg udtræk og få adgang via API.

- Enterprise-fokus: Bruges til prisovervågning, markedsanalyse og opbygning af ML-datasæt.

- Pris: Starter-plan $199/måned, Standard $599/måned, Advanced $1.099/måned.

Bedst til: Mellemstore til store virksomheder og datateams, der har brug for stabile, vedligeholdte løsninger til store opgaver. Overkill til hobbyprojekter, men stærkt til business-skala ().

7. Parsehub: Fleksibelt web scraper-værktøj med visuel editor

Parsehub er en desktop-app (Windows, Mac, Linux), hvor du bygger scrapers ved at klikke dig gennem et websites interface.

- Visuelt workflow: Vælg elementer, opsæt regler og håndter login, dropdowns og infinite scroll.

- Cloud-funktioner: Kør scraping i skyen, planlæg jobs og brug API-adgang.

- Pris: Gratis niveau til små opgaver; betalte planer starter ved $149/måned.

Bedst til: Researchere, små virksomheder eller enkeltpersoner, der vil have mere kontrol end en browser-udvidelse, men ikke er klar til at kode selv ().

8. Common Crawl: Åbne webdata til AI og forskning

Common Crawl er ikke et værktøj i klassisk forstand — det er et enormt åbent datasæt med web crawl-data, opdateret hver måned.

- Skala: ~400 TB webdata, der dækker milliarder af websider.

- Gratis og åbent: Du behøver ikke køre din egen crawler.

- Kræver tekniske kompetencer: Du skal bruge big data-værktøjer og lidt engineering for at filtrere og parse data.

Bedst til: Data scientists og ingeniører, der bygger AI-modeller eller laver forskning i stor skala. Hvis du har brug for generel webtekst eller historiske arkiver, er det en guldgrube ().

9. Crawly: Letvægts automatiseret web scraping-værktøj til startups

Crawly (fra Diffbot) er en cloud-baseret, AI-drevet crawler, der kan indsamle data fra millioner af websites og returnere strukturerede resultater — uden at du skal definere parsing-regler.

- AI-udtræk: Bruger machine vision og NLP til at identificere og udtrække indhold.

- API-adgang: Forespørg de indsamlede data og integrér med analytics eller databaser.

- Pris: Enterprise; kontakt for pris.

Bedst til: Startups og teams med lidt teknisk erfaring, der vil lave intelligent dataudtræk i stor skala uden at bygge egne scrapers ().

10. Apify: Udviklervenligt web scraper-værktøj med marketplace

Apify er en cloud-platform, hvor du kan bygge dine egne scrapers (“Actors”) eller bruge et bibliotek af færdige community-scrapers.

- Udviklerfleksibilitet: Understøtter JavaScript/Python-scraping, headless Chrome, proxy-håndtering og planlægning.

- Marketplace: Stort bibliotek af færdige scrapers til populære sites.

- Pris: Gratis niveau med $5/måned i credits; betalte planer starter ved $49/måned.

Bedst til: Udviklere og teknisk stærke analytikere, der vil have fuld kontrol og skalerbarhed. Ikke-kodere kan stadig bruge færdige Actors til standardopgaver ().

Sammenligningstabel: automatiserede web scraping-værktøjer

| Værktøj | Brugervenlighed | AI-funktioner | Pris (fra) | Målgruppe | Særlige styrker |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Naturligt sprog, AI Suggest Fields, scraping af undersider | $9/md | Ikke-tekniske forretningsbrugere | Opsætning i 2 klik, ingen kode, øjeblikkelig eksport, gratis prøve |

| Clay | ★★★★☆ | AI enrichment, GPT-4 | $99/md | Growth/sales ops | Automatiserings-regneark, enrichment, outreach |

| Bardeen | ★★★★☆ | AI command builder | $99/md | Power users, GTM-teams | Browser-RPA, 500+ playbooks, dybe integrationer |

| Bright Data | ★★☆☆☆ | Proxy-rotation, anti-bot AI | $499/md | Enterprise, udviklere | Skala, stabilitet, globale proxies |

| Octoparse | ★★★★☆ | Visuel AI-detektion | $119/md | Analytikere, ikke-kodere | Drag-and-drop, templates, cloud scraping |

| Import.io | ★★★☆☆ | Interaktive extractors | $199/md | Enterprise, datateams | Parallelisering, planlægning, API, support |

| Parsehub | ★★★★☆ | Visuelle workflows | $149/md | Researchere, SMB | Desktop-app, håndterer dynamiske sites |

| Common Crawl | ★☆☆☆☆ | N/A (kun datasæt) | Gratis | Data scientists, ingeniører | Massivt åbent datasæt, web-skala arkiver |

| Crawly | ★★☆☆☆ | AI-udtræk | Custom/Enterprise | Startups, tech-teams | AI-drevet, ingen parsing-regler, API-adgang |

| Apify | ★★★★☆ | Actor marketplace | $49/md | Udviklere, tech-analytikere | Byg selv/marketplace, cloud-automatisering, fleksibilitet |

Sådan vælger du det rigtige web scraper-værktøj til dine behov

Det bedste automatiserede web scraping-værktøj afhænger af teamets størrelse, tekniske niveau og forretningsmål. Her er min hurtige guide:

- Til ikke-tekniske brugere (salg, marketing, drift): Vælg . Det er lavet til jer — ingen kode, ingen opsætning, bare resultater. Perfekt til leadgenerering, prisovervågning og hurtige dataprojekter.

- Til teams, der elsker automatisering: Clay og Bardeen er stærke, hvis du vil kombinere scraping med enrichment, outreach eller workflow-automatisering.

- Til enterprise og udviklere: Bright Data, og Apify er de bedste valg til store, meget tilpassede projekter.

- Til researchere og analytikere: Octoparse og Parsehub giver visuelle interfaces og kraftige funktioner uden at du behøver kode.

- Til AI- og data science-projekter: Common Crawl og Crawly leverer enorme datasæt og AI-drevet udtræk til dem, der vil bygge eller træne modeller.

Spørg dig selv: Skal du være i gang på få minutter, eller har du brug for en skræddersyet enterprise-løsning? Hvis du er i tvivl, så start med en gratis prøve — de fleste værktøjer tilbyder det.

Thunderbits unikke værdi: AI-assistent til forretningsdata

Blandt alle værktøjerne skiller Thunderbit sig ud som det eneste, der reelt fungerer som en “AI-assistent” til web scraping og datatransformation. Det handler ikke kun om at hente data — men om at gøre rodede websites til rene, strukturerede indsigter uden tekniske barrierer.

- Interface på naturligt sprog: Beskriv behovet med almindelige ord, og Thunderbit klarer resten.

- Automatisering af hele flowet: Fra udtræk til rensning, oversættelse og eksport — Thunderbit dækker hele processen.

- Perfekt til hurtige eksperimenter: Skal du validere et nyt marked, bygge en leadliste eller overvåge konkurrenter? Thunderbit er den hurtigste og billigste måde at komme fra idé til data på.

Det er som at have en dataanalytiker indbygget i browseren — en der aldrig beder om lønforhøjelse eller ferie.

Konklusion: Vælg det rigtige automatiserede web scraping-værktøj og arbejd smartere

Scraping-landskabet i 2026 ligner ikke det, vi kendte for bare to år siden. Selvreparerende AI-scrapers, LLM-native pipelines og no-code værktøjer, der rent faktisk er til at bruge, har ændret spillet. Uanset om du er solo-founder, et sultent salgsteam eller en enterprise data scientist, findes der et værktøj på listen, der passer. Nøglen er at matche workflow og kompetencer med den rigtige platform — så du kan stoppe med at slås med kode og begynde at udnytte indsigter.

Hvis du vil droppe manuel copy-paste og arbejde smartere, så og oplev, hvor enkelt web scraping kan være. Eller vælg en af de andre muligheder ovenfor ud fra dine mål. Uanset hvad: fremtiden for datadrevne virksomheder tilhører dem, der automatiserer.

Vil du lære mere? Kig forbi for dybdegående guides, tutorials og tips til at få mest muligt ud af dine webdata. God scraping — og må dine data altid være rene, og dine scrapers aldrig gå i stykker (og hvis de gør, så lad AI’en tage den).

FAQs

1. Hvorfor er automatiserede web scraping-værktøjer vigtige for forretningsbrugere i 2026?

automatiserede web scraping-værktøjer gør dataindsamling langt mere effektiv, sparer tid og reducerer manuelt arbejde. De løfter datakvaliteten, understøtter beslutninger baseret på opdaterede data og gør ikke-tekniske teams i stand til at udtrække og bruge webdata uden at skrive kode. I dag er de centrale for salg, marketing og drift.

2. Hvad gør Thunderbit anderledes end andre web scraping-værktøjer?

Thunderbit bruger AI, så du kan beskrive, hvilke data du vil have, med almindeligt sprog. Den finder automatisk felter, håndterer undersider og paginering og eksporterer resultater med det samme til fx Excel og Airtable. Den er designet til ikke-tekniske brugere og tilbyder stærke funktioner som datarensning og Scheduled Scraper til en lav pris.

3. Hvilket værktøj er bedst til enterprise-projekter i stor skala?

Bright Data og er oplagte til enterprise. De tilbyder proxy-rotation, anti-bot-funktioner, høj parallelisering og API-adgang, hvilket gør dem velegnede til organisationer, der skal behandle tusindvis af websider stabilt og i stor skala.

4. Findes der værktøjer, der kombinerer scraping med automatisering og outreach?

Ja. Clay og Bardeen kan både skrabe webdata og bygge workflows omkring dem. Clay beriger leads og automatiserer outreach, mens Bardeen lader dig automatisere browseropgaver og workflows med AI-drevne playbooks.

5. Hvad er den bedste løsning for brugere uden teknisk baggrund?

Thunderbit er det stærkeste valg for ikke-tekniske brugere takket være interface på naturligt sprog, AI-drevet opsætning og høj brugervenlighed. Det kræver ingen kodning eller opsætning og er ideelt til forretningsbrugere, der vil have hurtige, stabile data uden teknisk kompleksitet.