Potřeboval jsem hlídat přes 200 zpravodajských zdrojů kvůli trendujícím článkům. Ručně? To je regulérně práce na plný úvazek. Klasický scraper článků? Ten se mi rozpadal pokaždé, když web jen trochu přehodil layout.

Pak jsem sáhl po AI scraperech na články. Jedno kliknutí, čistá data, žádné CSS selektory a žádné nekonečné ladění. Ten rozdíl byl fakt propastný.

Jestli jsi novinář, SEO specialista nebo výzkumník a potřebuješ tahat články ve velkém, tohle srovnání ti ušetří hromadu pokusů a omylů. Otestoval jsem tradiční no‑code nástroje i AI varianty — a tady je, co v reálu opravdu funguje.

TL;DR

| Výhody | Nevýhody | Nejlepší pro | |

|---|---|---|---|

| AI Scraper článků | - Umí s vysokou přesností scrapovat více webů - Automaticky odfiltruje šum - Přizpůsobí se změnám struktury webu - Podporuje dynamické načítání obsahu - Nízké náklady na čištění dat | - Vyšší výpočetní náročnost - Delší doba zpracování - Některé stránky mohou vyžadovat ruční zásah - Může spouštět anti-scraping ochrany | - Scrapování složitých nebo dynamických webů (např. zpravodajské portály, sociální sítě) - Sběr dat ve velkém |

| Tradiční no‑code Scraper článků | - Rychlé spuštění - Nižší cena - Nízké nároky na server i lokální zdroje - Vysoká míra kontroly | - Častá údržba kvůli změnám struktury webu - Neumí scrapovat více webů najednou - Nezvládá dynamický obsah - Vysoké náklady na čištění dat | - Rychlé hromadné scrapování jednoduchých statických stránek - Omezené výpočetní zdroje, tlak na rozpočet |

Co je Scraper článků? Proč je AI Scraper článků důležitý?

je typ , který umí najít a vytáhnout informace jako titulky, autory, datum publikace, obsah, klíčová slova, obrázky i videa ze zpravodajských webů a poskládat je do strukturovaných formátů typu JSON, CSV nebo Excel.

většinou stojí na , které tahají obsah podle struktury . Jenže tenhle přístup má pár zásadních háčků:

- Nízká univerzálnost: Každý web má jinou strukturu, takže potřebuješ jiné . Jakmile se struktura změní, selektory přestanou fungovat a začíná kolotoč údržby.

- Slabina u dynamického obsahu: Spousta webů dnes načítá obsah přes AJAX nebo JavaScript, což samotné neumí spolehlivě scrapovat.

- Omezené zpracování dat: vytáhnou jen kusy — bez následného čištění, formátování, sémantické analýzy nebo třeba analýzy sentimentu.

Tady nastupuje .

Tady nastupuje .

-

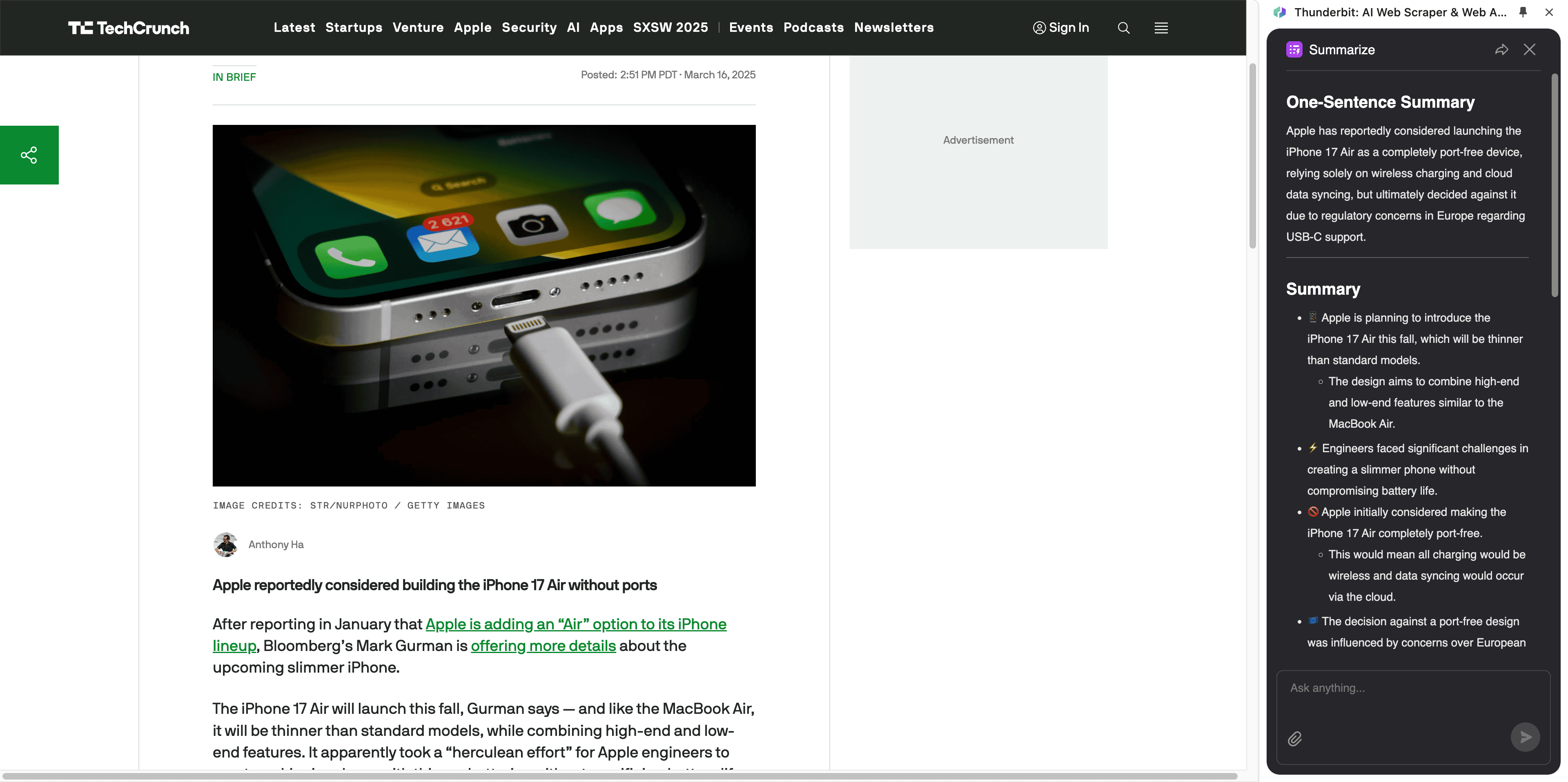

Tahle technologie používá LLM k porozumění webovým stránkám a přináší:

- Chytré rozpoznávání: Dokáže identifikovat titulky, autory, shrnutí i hlavní text.

- Automatické odstranění balastu: Oddělí hlavní obsah od navigace, reklam a „souvisejících článků“ — tím zvedne kvalitu dat i efektivitu scrapování.

- Odolnost vůči změnám webu: I když se změní struktura nebo styly, AI díky sémantice a vizuálním signálům často jede dál bez úprav.

- Použitelnost napříč weby: Na rozdíl od můžeš AI scraper použít na různé weby bez ručního ladění.

- Napojení na NLP a deep learning: Zvládne i věci jako překlad, sumarizaci nebo analýzu sentimentu.

Co dělá z nástroje nejlepší Scraper článků v roce 2026?

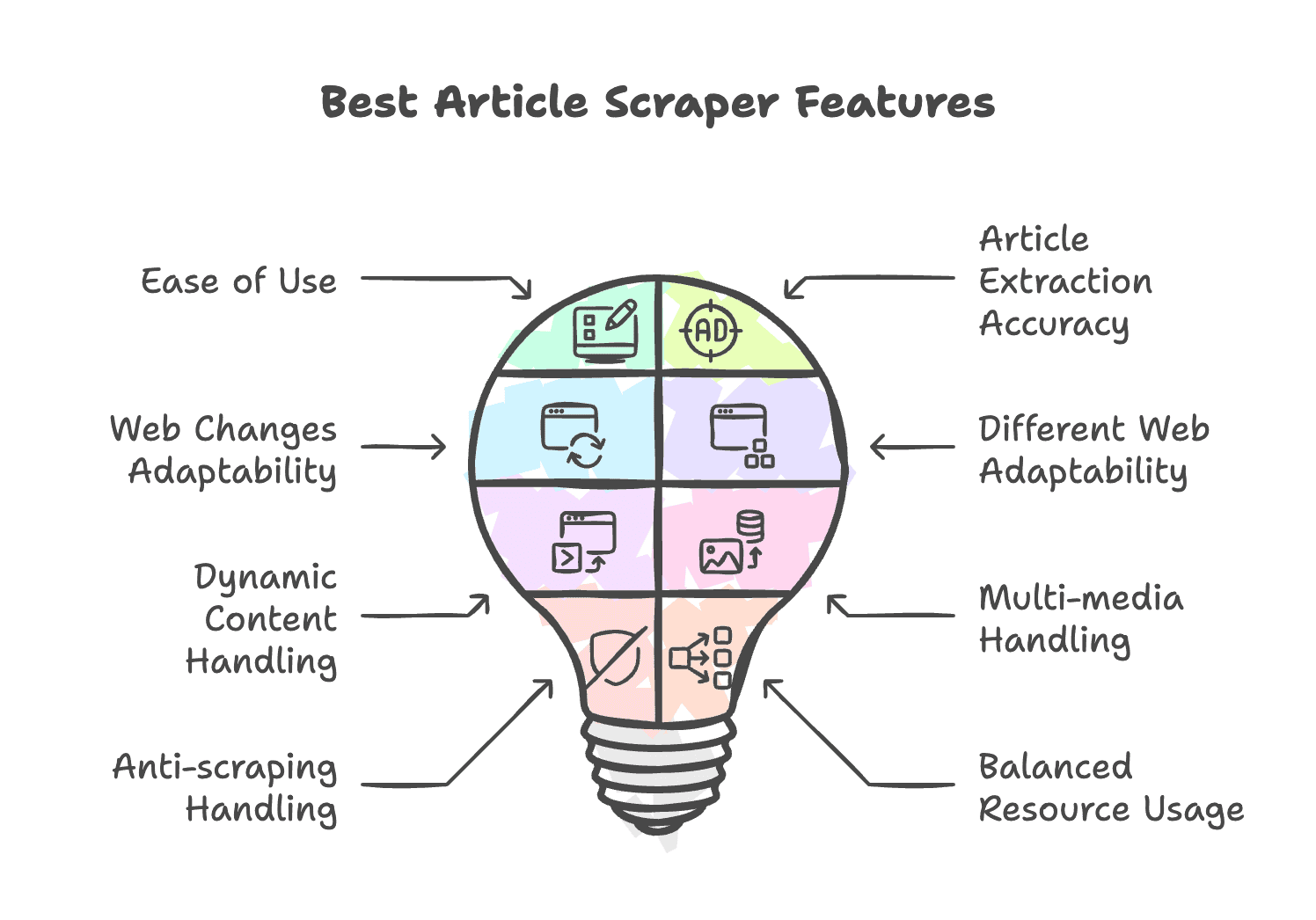

Top scraper článků musí umět vybalancovat výkon, cenu, jednoduchost, flexibilitu i škálování. Tohle jsou kritéria, podle kterých dává smysl vybírat nejlepší scraper článků pro rok 2026:

- Snadné použití: Intuitivní ovládání bez programování.

- Přesnost extrakce článků: Spolehlivě vytáhne relevantní informace bez reklam a navigace.

- Přizpůsobení změnám webu: Automaticky se adaptuje na změny struktury či stylu bez neustálé údržby.

- Adaptace na různé weby: Funguje napříč různými strukturami.

- Práce s dynamickým obsahem: Podpora JavaScriptu/AJAX načítání.

- Multimédia: Rozpozná obrázky, videa i audio.

- Obrana proti anti-scrapingu: Rotace IP, řešení CAPTCHA a proxy pro obcházení ochran.

- Rozumné nároky na zdroje: Neplýtvá pamětí ani výpočetním výkonem.

Nejlepší Scraper článků a zpráv – rychlý přehled

| Nástroje | Klíčové funkce | Nejlepší pro | Cena |

|---|---|---|---|

| Thunderbit | Scraper poháněný AI; předpřipravené šablony; podpora scrapování PDF, obrázků a dokumentů; pokročilé možnosti zpracování dat | Uživatelé bez technického zázemí, kteří potřebují scrapovat více specializovaných webů | 7denní zkušební verze zdarma, od 9 $/měs. (roční plán) |

| WebScraper.io | Rozšíření do prohlížeče; podpora dynamického obsahu; bez integrace proxy | Uživatelé, kteří neřeší složité stránky ani pokročilé funkce | 7denní zkušební verze zdarma, od 40 $/měs. (roční plán) |

| Browse.ai | No‑code scraper a monitoring; hotoví roboti; virtuální prohlížeč; různé metody stránkování; silné integrace | Firmy, které potřebují ve velkém scrapovat složité weby | 19 $/měs. (roční plán) |

| Octoparse | No‑code scraper postavený na CSS selektorech; automatická detekce a generování workflow; šablony pro scrapování článků; virtuální prohlížeč; anti‑anti scraping funkce | Firmy, které potřebují scrapovat komplexní weby | Od 99 $/měs. (roční plán) |

| Bardeen | Široké možnosti webové automatizace; šablony; no‑code scraper; hladká integrace s pracovním prostředím | GTM týmy, které chtějí scrapování článků zapojit do existujících workflow | 7denní zkušební verze zdarma, od 99 $/měs. (roční plán) |

| PandaExtract | Uživatelsky přívětivé UI; automatická detekce a označování | Uživatelé, kteří chtějí rychlou extrakci na jedno kliknutí bez složitého nastavování | 49 $ LTD |

Nejsilnější AI Scraper článků pro business uživatele

- Výhody:

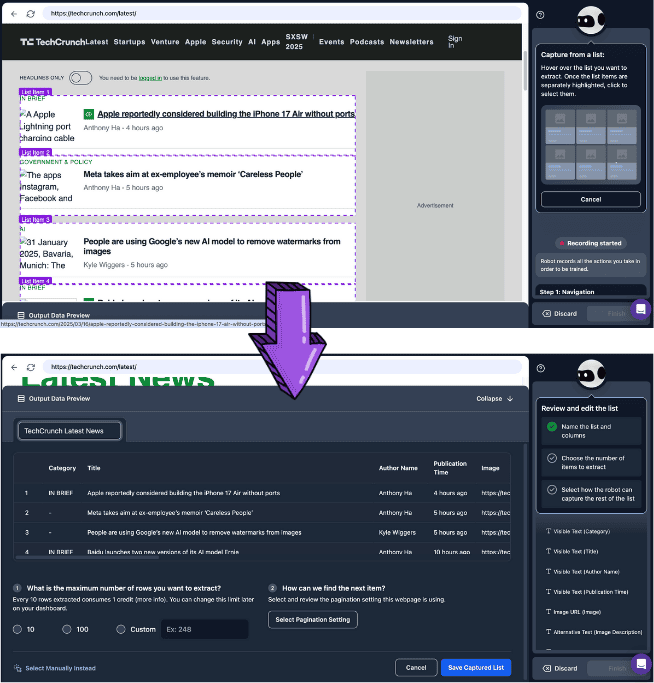

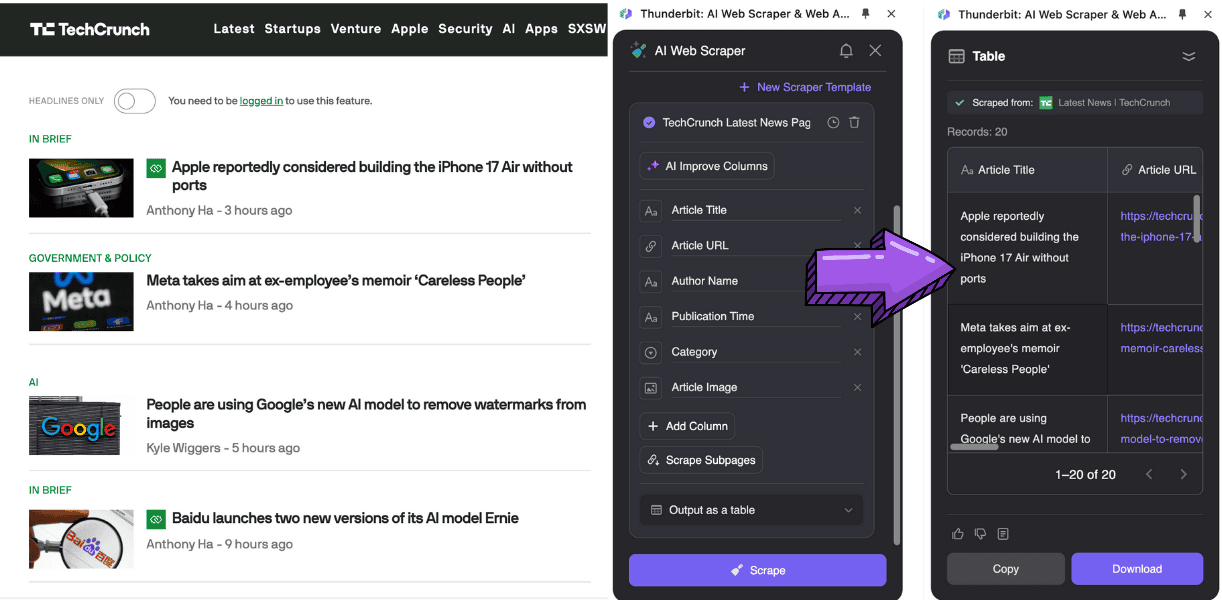

- Používá přirozený jazyk pro volání AI, aby rozpoznal a analyzoval informace na webu — bez CSS selektorů

- AI asistované zpracování dat včetně převodu formátů, , klasifikace, překladu a tagování

- pro scrapování seznamů i obsahu článků na jedno kliknutí

- Nevýhody:

- Zatím dostupné jen jako

- Není to ideální pro masivní scrapování ve velkém měřítku

- U vícestránkového scrapování může být pomalejší, ale umí běžet na pozadí, takže se k výsledkům dostaneš efektivněji

AI Scraper článků pro enterprise použití

Browse.ai

- Výhody:

- No‑code scraper článků i monitoring

- Podpora virtuálního prohlížeče pro snížení rizika spuštění anti-scraping ochran

- Spousta hotových robotů pro scrapování článků na jedno kliknutí z , , a dalších

- Hluboká integrace s platformami jako a pro propojování nástrojů

- Nevýhody:

- Pro deep extract je potřeba vytvořit dva roboty, což celý proces zbytečně komplikuje

- CSS selektory nejsou u specializovaných webů dost přesné

- Vysoká cena — větší smysl to dává pro dlouhodobé a velkoobjemové scrapování

No‑code scraper pro menší objemy dat

PandaExtract

- Výhody:

- Automaticky rozpozná seznamy článků i detail v přívětivém rozhraní

- Umí vytahovat seznamy, detaily, e-maily i obrázky — hodí se pro menší, strukturované sběry dat

- Jednorázová platba s doživotní licencí

- Nevýhody:

- Jen jako rozšíření do prohlížeče, nejde spouštět v cloudu

- Bezplatná verze podporuje jen kopírování, ne export do CSV/JSON apod.

Hotový Scraper článků „out of the box“ pro organizace

Octoparse

- Výhody:

- No‑code scraper článků s auto‑detect, který rozpozná strukturu webu a vygeneruje workflow

- Spousta předpřipravených šablon pro scrapování článků, rovnou připravených k použití

- Virtuální prohlížeč s rotací IP, řešením CAPTCHA a proxy pro obcházení anti-scraping ochran

- Nevýhody:

- Auto‑detect pořád vychází z logiky CSS selektorů, takže přesnost bývá spíš průměrná

- Pokročilé funkce vyžadují učení a určitou technickou zručnost

- Při velkém objemu dat je to drahé

Nejkomplexnější automatizace pro GTM tým

Bardeen

- Výhody:

- No‑code scraper článků využívající LLM pro automatizaci na jedno kliknutí

- Integrace s více než 100 aplikacemi včetně , a

- Silné nástroje webové automatizace pro AI analýzu po scrapování

- Skvělé pro zapojení scrapování do existujících workflow

- Nevýhody:

- Velká závislost na hotových playboocích; vlastní workflow často znamená ladění metodou pokus–omyl

- I když jde o no‑code platformu, složitější automatizace může být pro netechnické uživatele časově náročná na pochopení

- Nastavení extrakce podstránek je komplikované

- Je to hodně drahé

Lehký Scraper článků pro okamžitou extrakci dat

Webscraper.io

- Výhody:

- No‑code scraper s point‑and‑click ovládáním

- Podpora dynamického načítání obsahu

- Provoz v cloudu

- Integrace s , a

- Nevýhody:

- Bez hotových šablon — musíš si vytvořit vlastní sitemap

- Pro uživatele bez zkušeností s CSS selektory může být učení náročnější

- Složitější nastavení stránkování a extrakce podstránek

- Cloudová verze je drahá

Pokročilejší řešení pro vývojáře

Pro technicky zdatné uživatele existují i . Tyhle varianty obvykle nabízejí:

- Flexibilitu: Přímé API volání pro vlastní scrapování, včetně dynamického renderování a rotace IP

- Škálování: Snadné zapojení do vlastních datových pipeline pro enterprise potřeby (vysoká frekvence, velké objemy)

- Nízké náklady na údržbu: Nemusíš spravovat proxy pool ani anti-scraping strategii, což šetří provozní čas

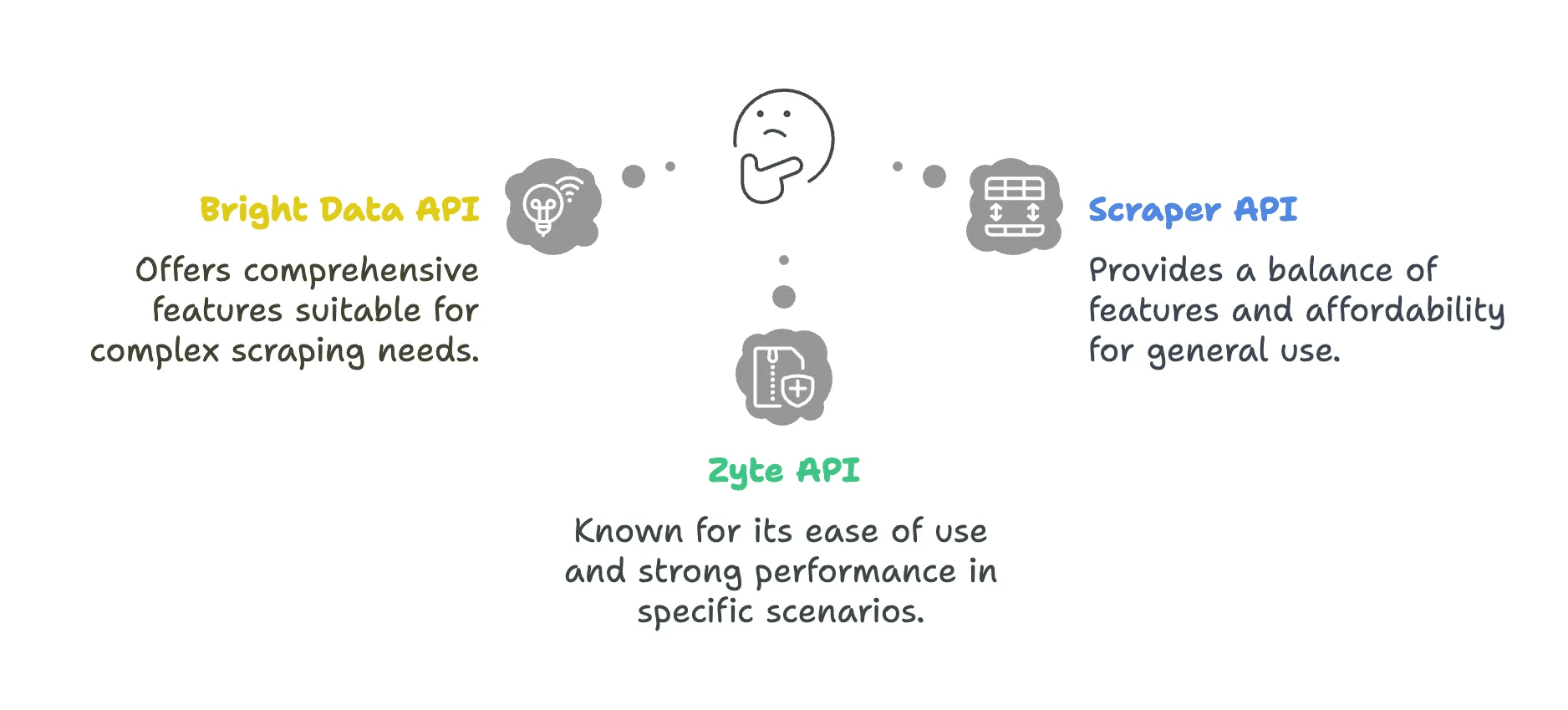

Přehled API řešení

| API | Výhody | Nevýhody |

|---|---|---|

| Bright Data API | - Rozsáhlá proxy síť (72M+ IP ve 195 zemích) - Pokročilé geo‑targeting až na úroveň města/PSČ - Robustní Proxy Manager pro rotaci IP | - Pomalejší odezva (průměrně 22,08 s) - Vyšší cena nevhodná pro menší týmy - Strmější křivka učení při konfiguraci |

| ScraperAPI | - Nižší vstupní cena od 49 $ - Funkce autoparse pro automatickou extrakci dat - Webové UI pro testování | - Často účtuje i blokované požadavky - Omezené možnosti renderování JavaScriptu - Náklady mohou růst při použití prémiových parametrů |

| Zyte API | - AI parsing schopnosti - Neúčtuje neúspěšné požadavky | - Vyšší startovní cena (~450 $/měs.) - Kredity se nepřevádějí do dalšího měsíce |

- Bright Data Web Scraper API

- Výhody:

- Pokrytí 195 zemí se 72M+ rezidenčními IP, automatická rotace IP a simulace geolokace — ideální pro weby s přísnou ochranou (např. , )

- Podpora dynamického načítání přes JavaScript a ukládání snapshotů stránky

- Nevýhody:

- Vysoká cena (účtování za requesty i bandwidth), pro malé projekty nízká návratnost

- Výhody:

- Scraper API

- Výhody:

- 40M proxy globálně, automatické přepínání datacentrových/rezidenčních IP, obcházení Cloudflare, integrace externích CAPTCHA řešení (např. )

- Strukturované endpointy a asynchronní scrapery pro vyšší rychlost

- Nevýhody:

- Dynamické renderování je za příplatek, omezená podpora pro složité AJAX weby

- Výhody:

- Zyte API

- Výhody:

- Automatická extrakce webových dat pomocí AI — bez nutnosti vyvíjet a udržovat pravidla pro každý web

- Flexibilní pay‑as‑you‑go model

- Nevýhody:

- Pokročilé funkce (např. práce se sessions, skriptovatelný prohlížeč) vyžadují učení

- Výhody:

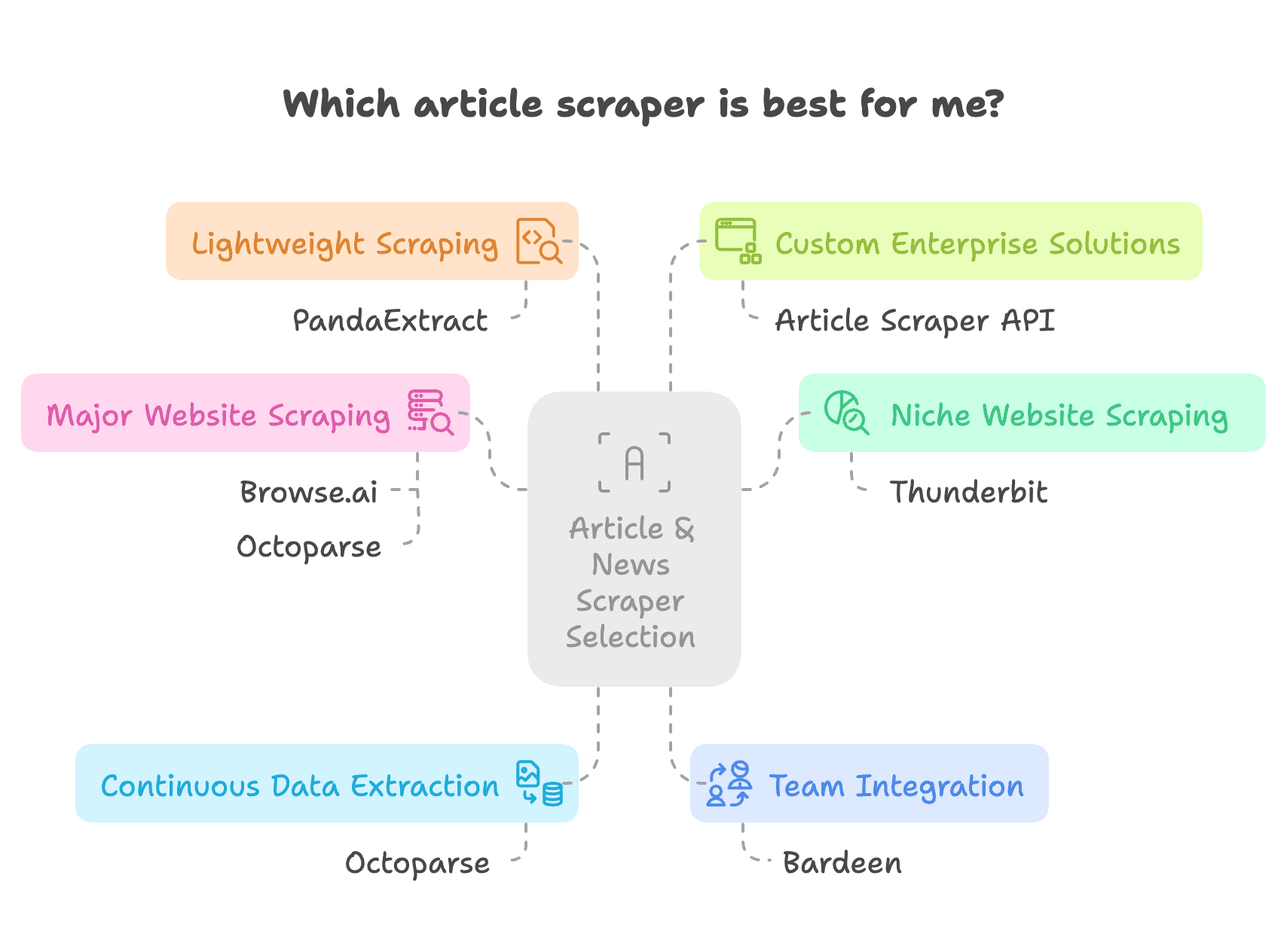

Jak vybrat Scraper článků a zpráv?

Při výběru scraperu zpravodajských článků si srovnej, co přesně potřebuješ, jaké máš technické zázemí a kolik do toho chceš dát peněz.

- Pokud potřebuješ scrapovat víc specializovaných webů bez toho, abys pro každý stavěl vlastní scraper, a rozpočet ti to dovolí, je nejlepší volba. Nejede na , ale používá AI k analýze struktury webu a umožní i následnou AI analýzu po scrapování. Pro Thunderbit AI jsou všechny weby „stejné“, takže umí přesně vytáhnout celé články.

- Pro scrapování zpráv a článků z velkých webů jako nebo budeš potřebovat nástroj se silnou anti-scraping výbavou a hotovými šablonami, třeba Browse.ai nebo Octoparse. Zároveň ale často vyhrává praktičnost: rozšíření pro Chrome jako , protože scrapování se chová jako běžné prohlížení a kopírování, takže můžeš použít přihlášení bez složitého nastavování.

- Pokud potřebuješ dlouhodobé scrapování ve velkém, hodí se nástroje s plánováním (např. Octoparse).

- Pro týmové použití a hladké zapojení do existujících procesů je super Bardeen, protože nabízí i širokou automatizaci nad rámec scrapování.

- Pokud chceš lehký nástroj na menší extrakce bez času utopeného v učení, sáhni po point‑and‑click řešení jako PandaExtract.

- Pokud máš technické zázemí nebo stavíš enterprise řešení, zvaž kromě těchto i API nástroje nebo vlastní scraper.

Závěr

Tenhle článek ukázal, co jsou scrapery článků a zpráv a v jakých business scénářích dávají největší smysl. stojí na a vyžadují určitou znalost webového a , hlavně pokud chceš dělat pokročilejší věci. Nová generace staví na sémantickém porozumění a vizuálním rozpoznávání, takže překonává v adaptaci na změny struktury webu, použitelnosti napříč weby, práci s dynamickým obsahem i v následném čištění a analýze dat.

Zároveň jsme dali dohromady šest užitečných nástrojů na scrapování článků a zpráv a také API pro vývojáře — včetně srovnání výhod/nevýhod, vhodného měřítka, vlastností webů a cílových uživatelů. Při výběru řešení pro scrapování článků a zpráv si vyber variantu, která sedí tvým potřebám a zároveň dává smysl výkonově i cenově.

Nejčastější dotazy (FAQ)

1. Co je AI scraper článků a jak funguje?

- Využívá AI k analýze a extrakci obsahu z webových stránek bez nutnosti CSS selektorů.

- S vysokou přesností rozpozná titulky, autory, datum publikace i hlavní text.

- Automaticky odstraní reklamy, navigaci a další nerelevantní prvky.

- Přizpůsobí se změnám struktury webu a funguje napříč různými stránkami.

2. Jaké jsou výhody AI scraperu oproti tradičním scraperům?

- Jedním nástrojem vytáhneš obsah z více webů.

- Zvládá dynamický obsah včetně stránek načítaných přes JavaScript a AJAX.

- Oproti CSS scraperům vyžaduje méně ručního nastavování a údržby.

- Nabízí i funkce navíc, jako sumarizaci, překlad nebo analýzu sentimentu.

3. Můžu Thunderbit používat pro AI scrapování článků bez programování?

- Ano, Thunderbit je navržený pro netechnické uživatele a má jednoduché no‑code rozhraní.

- AI automaticky rozpozná a vytáhne obsah článků.

- Nabízí hotové šablony pro rychlé a efektivní scrapování.

- Umožňuje export do formátů jako CSV, JSON nebo Google Sheets.

Zjistěte více: