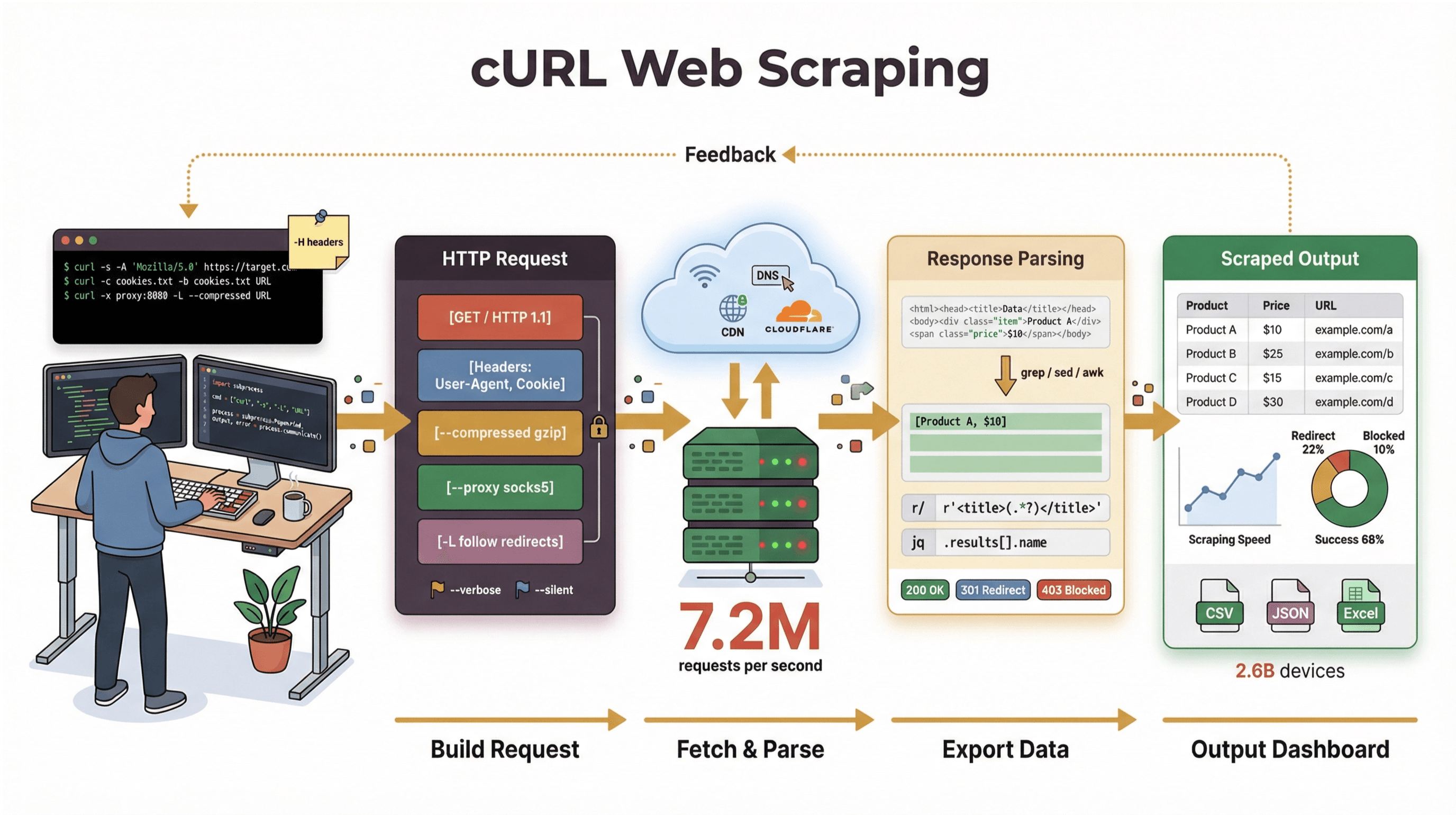

هناك شيء “레트로” ولطيف في إنك تفتح الطرفية، تكتب أمر واحد، وفجأة تشوف بيانات الويب الخام تتدفّق قدامك كأنك فتحت “매트릭스”. بالنسبة للمطورين والناس التقنيين المحترفين، تظلّ هي الـ “마법 지팡이”—أداة سطر أوامر شكلها بسيط، لكنها شغّالة بهدوء على مليارات الأجهزة، من خوادم 클라우드 إلى ثلاجتك الذكية. وحتى في 2026، ومع كل أدوات الاستخراج اللامعة المعتمدة على الذكاء الاصطناعي أو no-code، ما يزال web-scraping-with-curl خيارًا مفضّلًا للي يدورون على السرعة، والتحكم، وقابلية الأتمتة بالسكربتات—خصوصًا لو هدفك هو استخراج بيانات الويب باستخدام curl أو استخراج الويب عبر curl بشكل مباشر.

قضيت سنوات أبني أدوات أتمتة وأساعد فرق تتعامل مع بيانات الويب، ولسه أرجع لـ cURL كل ما احتجت أجيب صفحة بسرعة، أو أتتبّع مشكلة في API، أو أجرّب سير عمل للاستخراج كـ “프로토타입” سريع. في هذا الدليل، سأقدّم لك curl web scraping tutorial يغطي الأساسيات وحيل المحترفين—مع أمثلة أوامر حقيقية، ونصائح عملية، ونظرة واقعية لمتى تتألق cURL (ومتى توصل لحدودها). وإذا كنت من جانب الأعمال وما تبي تقرّب من سطر الأوامر، بشرح لك كيف —مستخرج الويب المدعوم بالذكاء الاصطناعي عندنا—يقدر ينقلك من “أحتاج هذه البيانات” إلى “هذه هي ورقة البيانات” بنقرتين فقط—بدون أي كود.

قضيت سنوات أبني أدوات أتمتة وأساعد فرق تتعامل مع بيانات الويب، ولسه أرجع لـ cURL كل ما احتجت أجيب صفحة بسرعة، أو أتتبّع مشكلة في API، أو أجرّب سير عمل للاستخراج كـ “프로토타입” سريع. في هذا الدليل، سأقدّم لك curl web scraping tutorial يغطي الأساسيات وحيل المحترفين—مع أمثلة أوامر حقيقية، ونصائح عملية، ونظرة واقعية لمتى تتألق cURL (ومتى توصل لحدودها). وإذا كنت من جانب الأعمال وما تبي تقرّب من سطر الأوامر، بشرح لك كيف —مستخرج الويب المدعوم بالذكاء الاصطناعي عندنا—يقدر ينقلك من “أحتاج هذه البيانات” إلى “هذه هي ورقة البيانات” بنقرتين فقط—بدون أي كود.

خلّنا نبدأ ونشوف ليش cURL لسه مهمة لاستخراج بيانات الويب في 2025، وكيف تستخدمها بفعالية، ومتى يكون الوقت مناسب تنتقل لخيار أقوى.

ما هي cURL؟ الأساس في web-scraping-with-curl

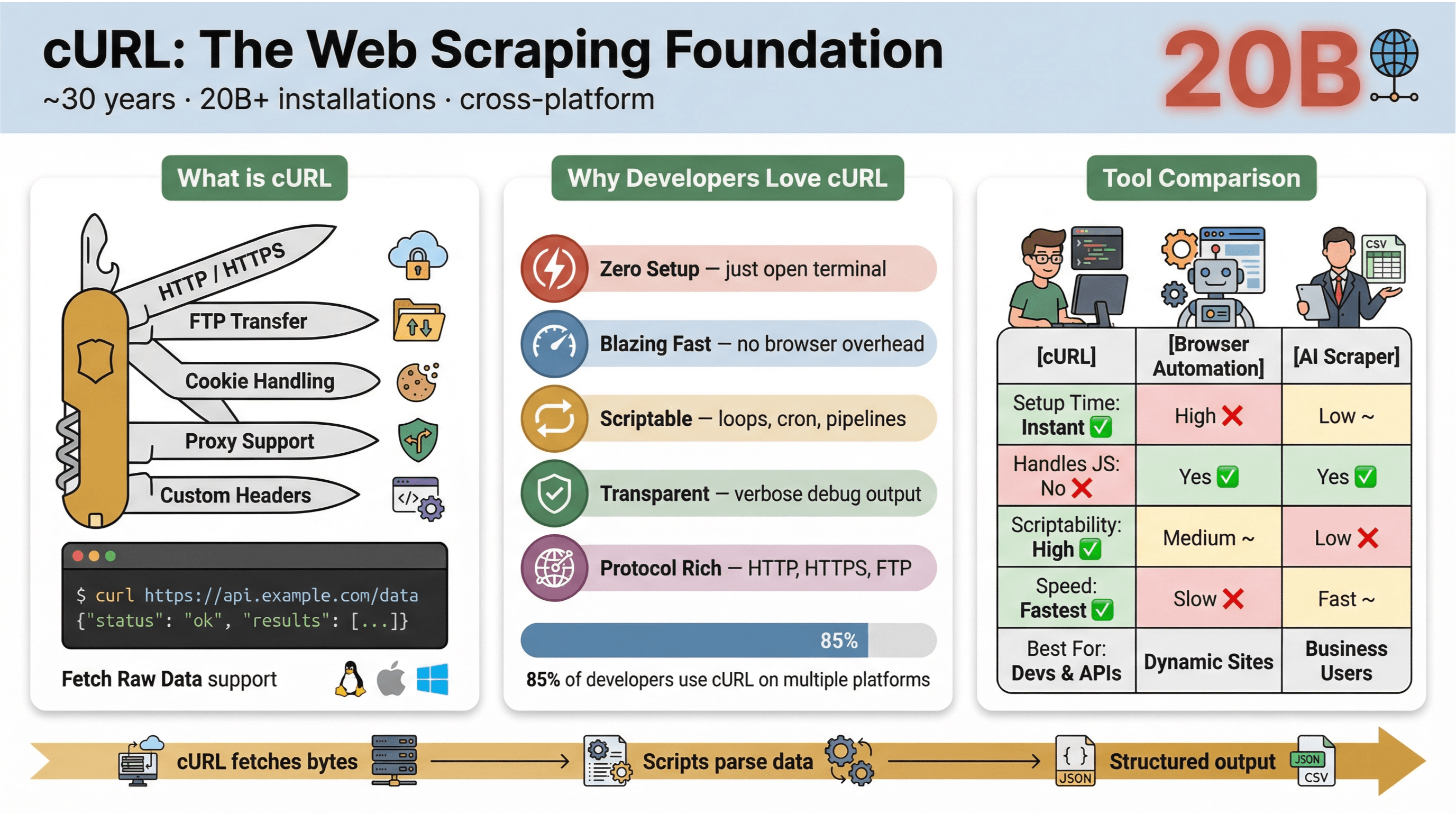

في جوهرها، هي أداة ومكتبة لسطر الأوامر لنقل البيانات عبر عناوين URL. عمرها يقارب 30 سنة (إيه، فعلًا)، وموجودة في كل مكان—مضمنة في أنظمة التشغيل، تشغّل سكربتات، وتتعامل بصمت مع نقل البيانات في أكثر من . إذا سبق وسويت أمر سريع لجلب صفحة ويب، أو اختبار API، أو تنزيل ملف، فاحتمال كبير إنك استخدمت cURL.

وهذه الأشياء اللي تخلي cURL مشهورة في استخراج بيانات الويب:

وهذه الأشياء اللي تخلي cURL مشهورة في استخراج بيانات الويب:

- خفيفة ومتعددة المنصات: تشتغل على Linux وmacOS وWindows وحتى الأجهزة المضمنة.

- دعم البروتوكولات: تتعامل مع HTTP وHTTPS وFTP وغيرها.

- قابلة للبرمجة بالسكربتات: ممتازة للأتمتة وcron jobs و“glue code”.

- لا تتطلب تفاعلًا من المستخدم: مصممة تشتغل بدون تدخل—مناسبة للمهام الدُفعية وخطوط المعالجة.

بس خلّنا نكون واضحين: وظيفة cURL الأساسية إنها تجيب البيانات الخام—HTML أو JSON أو صور… أي شيء. ما تحلل البيانات، ولا ترتّبها، ولا تحوّلها لهيكل منظم. اعتبر cURL “الميل الأول” في الاستخراج: تعطيك البايتات، لكن تحتاج أدوات ثانية (مثل سكربتات Python أو grep/sed/awk أو AI Web Scraper) عشان تحوّلها لمعلومات مرتبة.

لو تبي التوثيق الرسمي، شوف .

لماذا نستخدم cURL لاستخراج بيانات الويب؟ (curl web scraping tutorial)

ليش المطورين والناس التقنيين يرجعون لـ cURL مرة بعد مرة لاستخراج بيانات الويب رغم كثرة الأدوات الحديثة؟ هذه أهم نقاط قوتها:

- إعداد شبه معدوم: بدون تثبيت وبدون تبعيات—افتح الطرفية وابدأ.

- سرعة: جلب فوري للبيانات بدون انتظار تحميل متصفح.

- قابلية الأتمتة: تكرار الطلبات على عدة روابط، وأتمتة الاستدعاءات، وربط الأوامر بسهولة.

- دعم ميزات وبروتوكولات متعددة: كوكيز، بروكسي، إعادة توجيه، ترويسات مخصصة… وغيرها.

- شفافية: تقدر تشوف كل شيء يصير بدقة عبر مخرجات verbose/debug.

حسب ، أكثر من 85% من المشاركين قالوا إنهم يستخدمون cURL عبر سطر الأوامر، ومعظمهم يستخدمها على أكثر من منصة. لسه هي “스위스 아미 나이프” لطلبات HTTP، والسحب السريع للبيانات، واستكشاف الأعطال.

وهنا مقارنة سريعة بين cURL وطرق استخراج ثانية:

| الميزة | cURL | أتمتة المتصفح (مثل Selenium) | AI Web Scraper (مثل Thunderbit) |

|---|---|---|---|

| وقت الإعداد | فوري | مرتفع | منخفض |

| قابلية الأتمتة بالسكربتات | عالية | متوسطة | منخفضة (لا حاجة للكود) |

| التعامل مع JavaScript | لا | نعم | نعم (Thunderbit: عبر المتصفح) |

| دعم الكوكيز/الجلسات | يدوي | تلقائي | تلقائي |

| تنظيم البيانات | يدوي (تحليل لاحقًا) | يدوي (تحليل لاحقًا) | بالذكاء الاصطناعي/قوالب |

| الأنسب لـ | المطورين/سحب سريع | مواقع ديناميكية ومعقدة | مستخدمي الأعمال/تصدير منظم |

الخلاصة: cURL ما لها منافس في الجلب السريع القابل للأتمتة—خصوصًا للصفحات الثابتة وواجهات API أو لما تبي سير عمل بسيط. لكن إذا احتجت تحليل HTML معقد، أو التعامل مع JavaScript، أو تصدير بيانات منظمة، بتحتاج أداة أكثر تخصصًا.

البداية: أمثلة أوامر أساسية لاستخراج الويب عبر cURL

خلّنا ندخل على التطبيق. هذه طريقة استخدام cURL لمهام استخراج أساسية خطوة بخطوة.

جلب HTML الخام باستخدام cURL

أبسط سيناريو: تجيب HTML لصفحة ويب.

1curl https://books.toscrape.com/هذا الأمر يجلب الصفحة الرئيسية لموقع ، وهو موقع تجريبي عام للاستخراج. بتشوف HTML الخام في الطرفية—دوّر على وسوم مثل <title> أو عبارات مثل “In stock.”

حفظ المخرجات في ملف

تبي تحفظ HTML عشان تحلله بعدين؟ استخدم الخيار -o:

1curl -o page.html https://books.toscrape.com/الحين عندك ملف page.html فيه كامل HTML. هذا ممتاز للتحليل أو المعالجة بأدوات ثانية.

إرسال طلبات POST باستخدام cURL

تحتاج ترسل نموذج أو تتفاعل مع API؟ استخدم -d لطلبات POST. مثال باستخدام المخصص لاختبار HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"بتحصل استجابة JSON ترجع لك البيانات اللي أرسلتها—ممتاز للاختبار وبناء الـ 프로토타입.

فحص الترويسات وتصحيح الأخطاء

أحيانًا تحتاج تشوف ترويسات الاستجابة أو تتبّع المشكلة:

-

الترويسات فقط (طلب HEAD):

1curl -I https://books.toscrape.com/ -

إظهار الترويسات مع المحتوى:

1curl -i https://httpbin.org/get -

مخرجات تفصيلية/تصحيح:

1curl -v https://books.toscrape.com/

هذه الخيارات تساعدك تفهم اللي يصير “خلف الكواليس”—وهي أساسية وقت الاستكشاف.

وهذا جدول مرجعي سريع للأوامر:

| المهمة | مثال الأمر | ملاحظات |

|---|---|---|

| جلب HTML | curl URL | يعرض HTML في الطرفية |

| الحفظ في ملف | curl -o file.html URL | يكتب المخرجات في ملف |

| فحص الترويسات | curl -I URL أو curl -i URL | -I لطلب HEAD فقط، و-i يعرض الترويسات مع المحتوى |

| إرسال بيانات نموذج (POST) | curl -d "a=1&b=2" URL | يرسل بيانات بصيغة form-encoded |

| تصحيح الطلب/الاستجابة | curl -v URL | يعرض تفاصيل الطلب/الاستجابة |

للمزيد من الأمثلة، راجع .

ارتقِ بالمستوى: استخراج متقدم باستخدام cURL (web-scraping-with-curl)

بعد ما تتقن الأساسيات، cURL تفتح لك ميزات متقدمة لمهام أعقد.

التعامل مع الكوكيز والجلسات

مواقع كثيرة تحتاج كوكيز عشان تحافظ على جلسة تسجيل الدخول أو تتبّع المستخدم. مع cURL تقدر تحفظ الكوكيز وتعيد استخدامها:

1# Store cookies after login

2curl -c cookies.txt https://example.com/login

3# Use cookies for subsequent requests

4curl -b cookies.txt https://example.com/accountهذا يساعدك تحاكي جلسة المتصفح وتوصل لصفحات خلف تسجيل الدخول (إلا إذا فيه تحديات JavaScript).

محاكاة User-Agent وترويسات مخصصة

بعض المواقع تعرض محتوى مختلف حسب User-Agent أو الترويسات. افتراضيًا cURL تعرّف نفسها كـ “curl/VERSION”، وهذا ممكن يسبب حظر أو محتوى بديل. لمحاكاة متصفح:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/وتقدر تضبط ترويسات مخصصة مثل تفضيلات اللغة:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/كذا تزيد فرص إنك تحصل نفس المحتوى اللي يشوفه المتصفح الحقيقي.

استخدام البروكسي في استخراج الويب

تحتاج تمرّر الطلبات عبر بروكسي (لاختبار جغرافي أو لتقليل احتمالات الحظر)؟ استخدم -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/انتبه تستخدم البروكسي بمسؤولية وضمن شروط الموقع.

أتمتة استخراج صفحات متعددة

تبي تستخرج عدة صفحات مثل قوائم منتجات متعددة الصفحات؟ استخدم حلقة بسيطة في الشِل:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneهذا يجلب الصفحات من 2 إلى 5 من كتالوج Books to Scrape ويحفظ كل صفحة في ملف مستقل. (الصفحة 1 هي الصفحة الرئيسية.)

قيود web-scraping-with-curl: ما الذي يجب معرفته

مع إني أحب cURL، لكنها مو حل سحري لكل شيء. هذه أبرز القيود:

- لا تنفّذ JavaScript: ما تقدر تتعامل مع الصفحات اللي تعتمد على JavaScript لعرض المحتوى أو حل تحديات منع البوتات ().

- تحتاج لتحليل يدوي: بتاخذ HTML أو JSON خام، لكن لازم تحلله بنفسك—غالبًا عبر سكربتات أو أدوات إضافية.

- إدارة جلسات محدودة: تسجيلات دخول معقدة أو توكنات أو نماذج متعددة الخطوات ممكن تصير “فوضى” بسرعة.

- لا يوجد تنظيم بيانات مدمج: cURL ما تحوّل الصفحات لصفوف وجداول أو ملفات جاهزة.

- عرضة لاكتشاف أنظمة مكافحة البوتات: كثير من المواقع تستخدم دفاعات متقدمة (JavaScript، بصمة المتصفح، CAPTCHA) ما تقدر cURL تتجاوزها ().

وهذا جدول مقارنة سريع:

| القيد | cURL وحدها | أدوات استخراج حديثة (مثل Thunderbit) |

|---|---|---|

| دعم JavaScript | لا | نعم |

| تنظيم البيانات | يدوي | تلقائي (ذكاء اصطناعي/قوالب) |

| إدارة الجلسات | يدوي | تلقائي |

| تجاوز أنظمة منع البوتات | محدود | متقدم (عبر المتصفح/ذكاء اصطناعي) |

| سهولة الاستخدام | للمستخدم التقني | لغير التقنيين |

للصفحات الثابتة وواجهات API، cURL ممتازة. أما للمواقع الديناميكية أو المحمية، غالبًا بتحتاج تروح لأدوات أعلى في السلسلة.

Thunderbit مقابل cURL: أفضل نهج لاستخراج الويب لغير التقنيين

الحين خلّنا نتكلم عن ، إضافة Chrome لاستخراج الويب بالذكاء الاصطناعي. إذا شغلك مبيعات أو تسويق أو عمليات وتبي تنقل بيانات موقع إلى Excel أو Google Sheets أو Notion—بدون سطر أوامر—Thunderbit معمولة لك.

هكذا تقارن Thunderbit بـ cURL:

| الميزة | cURL | Thunderbit |

|---|---|---|

| واجهة الاستخدام | سطر أوامر | نقر وتحديد (إضافة Chrome) |

| اقتراح الحقول بالذكاء الاصطناعي | لا | نعم (يقرأ الصفحة ويقترح الأعمدة) |

| التعامل مع الترقيم/الصفحات الفرعية | سكربتات يدوية | تلقائي (الذكاء الاصطناعي يكتشف ويستخرج) |

| تصدير البيانات | يدوي (تحليل + حفظ) | مباشرة إلى Excel وGoogle Sheets وNotion وAirtable |

| صفحات JavaScript/المحمية | لا | نعم (استخراج عبر المتصفح) |

| بدون كود | لا (يتطلب سكربتات) | نعم (يمكن لأي شخص استخدامه) |

| الخطة المجانية | مجانية دائمًا | مجانية حتى 6 صفحات (10 مع تعزيز التجربة) |

مع Thunderbit، تفتح الإضافة، تضغط “AI Suggest Fields”، وتخلي الذكاء الاصطناعي يحدد لك إيش تستخرج. تقدر تستخرج جداول وقوائم وتفاصيل منتجات، وحتى تزور الصفحات الفرعية تلقائيًا. وبعدها تصدّر البيانات مباشرة لأدوات الشغل—بدون تحليل يدوي ولا صداع.

يثق بـ Thunderbit أكثر من ، وهي شائعة خصوصًا عند فرق المبيعات والتجارة الإلكترونية والعقارات اللي تحتاج بيانات منظمة بسرعة.

تبي تجرب؟ .

الجمع بين cURL وThunderbit: استراتيجيات مرنة لاستخراج الويب

إذا كنت تقني، مو لازم تختار أداة وحدة. كثير من الفرق تستخدم cURL وThunderbit مع بعض عشان أقصى مرونة:

- ابدأ بالنمذجة عبر cURL: لاختبار endpoints بسرعة، وفحص الترويسات، وفهم استجابة الموقع.

- وسّع العمل عبر Thunderbit: لما تحتاج بيانات منظمة، أو استخراج متعدد الصفحات، أو سير عمل قابل للتكرار، انتقل لـ Thunderbit للاستخراج بالنقر والتصدير المباشر.

مثال سير عمل لأبحاث السوق:

- استخدم cURL لجلب بعض الصفحات وفحص بنية HTML.

- حدّد الحقول المطلوبة (مثل أسماء المنتجات والأسعار والمراجعات).

- افتح Thunderbit واضغط “AI Suggest Fields” وخلي الذكاء الاصطناعي يجهّز المستخرج.

- استخرج كل الصفحات (بما فيها الصفحات الفرعية أو القوائم المرقمة) وصدّر إلى Google Sheets.

- حلّل البيانات وشاركها واتخذ قراراتك—بدون تحليل يدوي.

جدول قرار سريع:

| السيناريو | استخدم cURL | استخدم Thunderbit | استخدم الاثنين |

|---|---|---|---|

| جلب سريع لـ API أو صفحة ثابتة | ✅ | ||

| تحتاج بيانات منظمة في جدول بيانات | ✅ | ||

| تصحيح الترويسات/الكوكيز | ✅ | ||

| استخراج صفحات ديناميكية تعتمد على JS | ✅ | ||

| بناء سير عمل متكرر بدون كود | ✅ | ||

| نمذجة أولية ثم التوسّع | ✅ | ✅ | سير عمل هجين |

تحديات شائعة ومطبات عند استخراج الويب عبر cURL

قبل ما تنطلق بقوة مع cURL، هذه أبرز التحديات الواقعية:

- أنظمة مكافحة البوتات: كثير من المواقع تستخدم دفاعات متقدمة (تحديات JavaScript، CAPTCHA، بصمة المتصفح) ما تقدر cURL تتجاوزها ().

- مشكلات جودة البيانات: تغيّر HTML، أو غياب حقول، أو اختلاف التخطيطات ممكن يكسر سكربتاتك.

- عبء الصيانة: كل ما تغيّر الموقع، لازم تحدّث منطق التحليل.

- مخاطر قانونية وامتثال: راجع شروط الخدمة وrobots.txt والقوانين ذات الصلة قبل الاستخراج. كون البيانات عامة ما يعني إنها متاحة للاستخدام بلا قيود (، ).

- حدود التوسّع: cURL ممتازة للمهام الصغيرة، لكن للاستخراج واسع النطاق بتحتاج إدارة بروكسيات وحدود المعدّل ومعالجة الأخطاء.

نصائح للاستكشاف والالتزام:

- ابدأ دائمًا بمواقع تجريبية أو مسموح بها (مثل ).

- احترم حدود المعدّل—لا “تغرق” endpoints بالطلبات.

- تجنّب استخراج البيانات الشخصية إلا إذا عندك أساس قانوني.

- إذا واجهت جدران JavaScript أو CAPTCHA، فكّر تنتقل لأداة تعتمد على المتصفح مثل Thunderbit.

ملخص خطوة بخطوة: كيفية استخراج بيانات المواقع باستخدام cURL

هذه قائمة مرجعية سريعة لـ web-scraping-with-curl:

- حدّد رابط/روابط الهدف: ابدأ بصفحة ثابتة أو endpoint لـ API.

- اجلب الصفحة:

curl URL - احفظ المخرجات في ملف:

curl -o file.html URL - افحص الترويسات/صحّح:

curl -I URL,curl -v URL - أرسل بيانات POST:

curl -d "a=1&b=2" URL - تعامل مع الكوكيز/الجلسات:

curl -c cookies.txt ...,curl -b cookies.txt ... - اضبط الترويسات وUser-Agent:

curl -A "..." -H "..." URL - اتبع إعادة التوجيه:

curl -L URL - استخدم بروكسي (عند الحاجة):

curl -x proxy:port URL - أتمت استخراج صفحات متعددة: عبر حلقات الشِل أو سكربتات.

- حلّل البيانات ونظّمها: باستخدام أدوات/سكربتات إضافية حسب الحاجة.

- انتقل إلى Thunderbit للاستخراج المنظم بدون كود أو للصفحات الديناميكية.

الخلاصة وأهم النقاط: اختيار أداة استخراج الويب المناسبة

ما يزال web-scraping-with-curl مهارة قوية للمستخدمين التقنيين في 2026—خصوصًا للسحب السريع للبيانات، وبناء النماذج الأولية، والأتمتة. سرعة cURL وقابليتها للسكربتات وانتشارها تخليها عنصر أساسي في صندوق أدوات أي مطور. لكن مع ازدياد ديناميكية الويب وحمايته، ومع رغبة مستخدمي الأعمال في بيانات منظمة بدون كود، أدوات مثل صارت تعيد تعريف اللي تقدر تسويه فعليًا.

أهم النقاط:

- استخدم cURL للصفحات الثابتة وواجهات API والنمذجة السريعة—خصوصًا لما تبي تحكم كامل.

- انتقل إلى Thunderbit (أو أدوات AI Web Scraper مشابهة) لما تحتاج بيانات منظمة، أو تتعامل مع صفحات ديناميكية تعتمد على JavaScript، أو تبي سير عمل no-code مناسب للأعمال.

- اجمع بينهما لأقصى مرونة: نمذجة عبر cURL ثم توسّع وتنظيم عبر Thunderbit.

- استخرج بمسؤولية دائمًا—احترم شروط المواقع وحدود المعدّل والضوابط القانونية.

تبي تشوف قد إيش استخراج الويب صار سهل؟ جرّب واختبر استخراج البيانات بالذكاء الاصطناعي بنفسك. وللمزيد، راجع لمزيد من الشروحات والنصائح ورؤى الصناعة. قد يعجبك أيضًا:

استخراجًا موفقًا—ولتكن بياناتك دائمًا نظيفة ومنظمة وعلى بُعد أمر واحد (أو نقرة) فقط. وإذا كنت تدور على موقع curl الرسمي، تقدر تلاقيه هنا: https://curl.se/

الأسئلة الشائعة

1. هل يمكن لـ cURL التعامل مع صفحات الويب التي تُعرض عبر JavaScript؟

لا، cURL لا تنفّذ JavaScript. هي تجلب HTML الخام كما يرسله الخادم. إذا كانت الصفحة تحتاج JavaScript لعرض المحتوى أو لحل تحديات منع البوتات، فلن تتمكن cURL من الوصول للبيانات. في هذه الحالات استخدم أدوات تعتمد على المتصفح مثل .

2. كيف أحفظ مخرجات cURL مباشرة في ملف؟

استخدم الخيار -o: curl -o filename.html URL. سيكتب هذا محتوى الاستجابة في ملف بدل عرضه في الطرفية.

3. ما الفرق بين cURL وThunderbit في استخراج بيانات الويب؟

cURL أداة سطر أوامر لجلب بيانات الويب الخام—ممتازة للمستخدمين التقنيين والأتمتة. أما Thunderbit فهي إضافة Chrome مدعومة بالذكاء الاصطناعي وموجهة لمستخدمي الأعمال الذين يريدون استخراج بيانات منظمة من أي موقع، والتعامل مع الصفحات الديناميكية، والتصدير مباشرة إلى أدوات مثل Excel أو Google Sheets—بدون كود.

4. هل استخراج بيانات المواقع باستخدام cURL قانوني؟

استخراج البيانات العامة قانوني عمومًا في الولايات المتحدة بعد أحكام قضائية حديثة، لكن يجب دائمًا مراجعة شروط خدمة الموقع وrobots.txt والقوانين ذات الصلة. تجنّب استخراج البيانات الشخصية أو المحمية دون إذن، واحترم حدود المعدّل والإرشادات الأخلاقية (، ).

5. متى ينبغي أن أنتقل من cURL إلى أداة أكثر تقدمًا مثل Thunderbit؟

إذا كنت تحتاج لاستخراج صفحات ديناميكية تعتمد على JavaScript، أو تريد بيانات منظمة في جدول بيانات، أو تفضّل سير عمل بدون كود، فـ Thunderbit هو الخيار الأفضل. استخدم cURL للمهام التقنية السريعة؛ واستخدم Thunderbit لاستخراج بيانات قابل للتكرار ومناسب للأعمال.

للمزيد من نصائح ودروس استخراج الويب، زر أو اطّلع على .