“يمكنك أن تمتلك بيانات من دون معلومات، لكن لا يمكنك أن تمتلك معلومات من دون بيانات.” — *

تشير التقديرات الحديثة إلى أن الإنترنت يضم أكثر من موقع، مع نشر نحو مليوني منشور جديد كل يوم. هذا الكم الهائل من البيانات يحمل رؤى مهمة تساعد على اتخاذ القرار، لكن المشكلة أن نحو منها غير مُنظَّم، وهذا يعني أنه يحتاج إلى معالجة إضافية ليصبح مفيدًا. وهنا تأتي أدوات استخراج بيانات الويب لتصبح ضرورة لكل من يريد الاستفادة من البيانات المتاحة عبر الإنترنت.

إذا كنت جديدًا على استخراج البيانات من الويب، فقد تبدو مصطلحات مثل و مخيفة قليلًا. لكن في عصر الذكاء الاصطناعي، أصبحت هذه التحديات أسهل بكثير. أدوات الاستخراج المدعومة بالذكاء الاصطناعي اليوم تساعدك على البدء من دون حاجة إلى معرفة تقنية عميقة. هذه الأدوات تتيح جمع البيانات ومعالجتها بسرعة، ومن دون أي مهارات برمجة.

أفضل أدوات وبرامج استخراج بيانات الويب

- لأداة استخراج ويب بالذكاء الاصطناعي سهلة الاستخدام وبأفضل النتائج

- للمراقبة في الوقت الفعلي واستخراج البيانات على نطاق واسع

- لأتمتة بلا كود مع تكاملات واسعة مع التطبيقات

- لاستخراج ويب بصري أكثر احترافية

- لاستخراج قوي بلا كود مع تجنب حظر IP وكشف الروبوتات

- لواجهة برمجة تطبيقات متقدمة لاستخراج البيانات بالذكاء الاصطناعي والرسوم البيانية المعرفية

جرّب استخدام الذكاء الاصطناعي لاستخراج بيانات الويب

جرّبها! يمكنك النقر والاستكشاف وتشغيل سير العمل أثناء المشاهدة.

كيف يعمل استخراج بيانات الويب؟

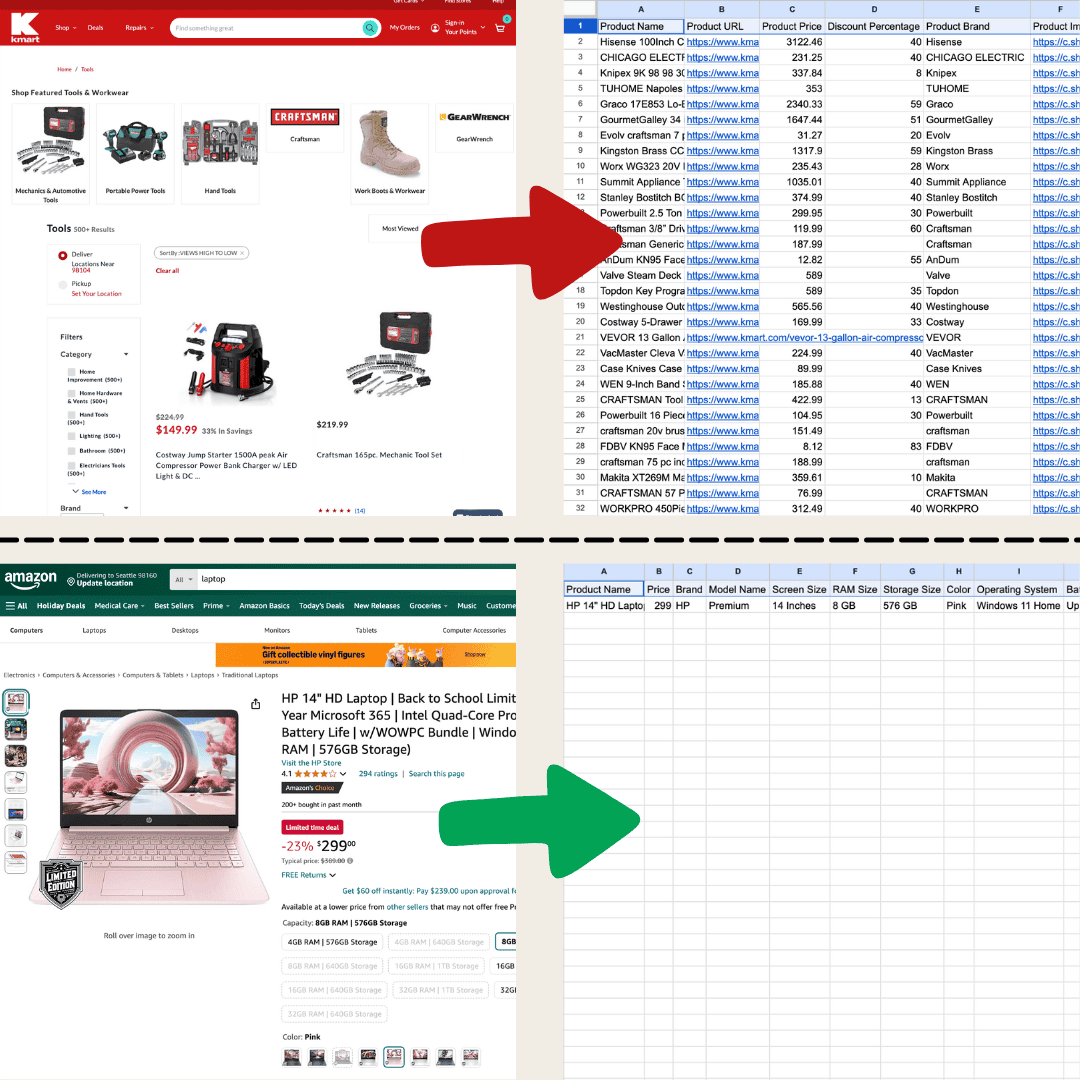

استخراج بيانات الويب يعني ببساطة جمع البيانات من المواقع. تعطي الأداة مجموعة من التعليمات، ثم تعمل على سحب النصوص أو الصور أو أي شيء تحتاج إليه إلى جدول من صفحة ويب. وهذا مفيد في كل شيء، من تتبع الأسعار في مواقع التجارة الإلكترونية إلى جمع بيانات بحثية، أو حتى مجرد بناء ملف Excel جيد أو جداول Google.

أنجزتُ هذا باستخدام Thunderbit عبر أداة استخراج الويب بالذكاء الاصطناعي.

أنجزتُ هذا باستخدام Thunderbit عبر أداة استخراج الويب بالذكاء الاصطناعي.

هناك عدة طرق للقيام بذلك. على أبسط مستوى، يمكنك فقط النسخ واللصق بنفسك، لكن ذلك يتطلب جهدًا كبيرًا إذا كانت البيانات كثيرة. لذلك يستخدم معظم الناس واحدة من ثلاث طرق: أدوات استخراج ويب تقليدية، أو أدوات استخراج ويب بالذكاء الاصطناعي، أو برمجة مخصصة.

أدوات استخراج الويب التقليدية تعمل عبر وضع قواعد محددة لما يجب سحبه من البيانات بناءً على بنية الصفحة. على سبيل المثال، يمكنك إعدادها لاستخراج أسماء المنتجات أو الأسعار من وسوم HTML معينة. وهي تعمل بشكل أفضل على المواقع التي لا يتغير تصميمها كثيرًا، لأن أي تعديل في التخطيط يعني أنك ستحتاج إلى العودة وتعديل الأداة.

استخدام أداة استخراج تقليدية يستغرق وقتًا طويلًا لتعلمه، ومن المرجح أن تحتاج إلى عشرات النقرات لإكمال الإعداد.

استخدام أداة استخراج تقليدية يستغرق وقتًا طويلًا لتعلمه، ومن المرجح أن تحتاج إلى عشرات النقرات لإكمال الإعداد.

أدوات استخراج الويب بالذكاء الاصطناعي تعني ببساطة أن ChatGPT يقرأ الموقع كاملًا ثم يستخرج المحتوى وفقًا لاحتياجك. ويمكنه التعامل مع استخراج البيانات والترجمة والتلخيص في الوقت نفسه. وهي تستخدم معالجة اللغة الطبيعية لتحليل بنية الموقع وفهمها، ما يجعلها تتعامل مع تغييرات المواقع بسلاسة أكبر. فإذا أعاد الموقع ترتيب بعض أقسامه قليلًا، فقد تتمكن أداة استخراج الويب بالذكاء الاصطناعي من التكيف من دون أن تحتاج إلى إعادة كتابة أي شيء. لذلك فهي ممتازة للمواقع كثيرة التحديث أو ذات البنى الأكثر تعقيدًا.

أداة استخراج الويب بالذكاء الاصطناعي سهلة البدء وتعطيك بيانات مفصلة في بضع نقرات فقط!

أداة استخراج الويب بالذكاء الاصطناعي سهلة البدء وتعطيك بيانات مفصلة في بضع نقرات فقط!

أيّها ينبغي أن تختار؟ يعتمد ذلك. إذا كنت مرتاحًا للتعديل على البرمجة أو تحتاج إلى جمع كميات كبيرة من البيانات من موقع مشهور، فقد تكون أدوات الاستخراج التقليدية فعّالة جدًا. لكن إذا كنت جديدًا على استخراج البيانات من الويب أو تريد شيئًا يتأقلم مع تحديثات المواقع، فعادةً ما تكون أدوات استخراج الويب بالذكاء الاصطناعي هي الخيار الأفضل. راجع الجدول أدناه لمزيد من السيناريوهات التفصيلية!

| الحالة | الخيار الأفضل |

|---|---|

| استخراج خفيف من صفحات مثل الأدلة أو مواقع التسوق أو أي موقع يحتوي على قائمة | أداة استخراج ويب بالذكاء الاصطناعي |

| تحتوي الصفحة على أقل من 200 صف من البيانات، وبناء أداة باستخدام أداة استخراج ويب تقليدية يستغرق وقتًا طويلًا | أداة استخراج ويب بالذكاء الاصطناعي |

| البيانات التي تحتاج إلى استخراجها تتطلب تنسيقًا معينًا لرفعها إلى مكان آخر. مثلًا: استخراج معلومات التواصل لرفعها إلى HubSpot. | أداة استخراج ويب بالذكاء الاصطناعي |

| مواقع واسعة الاستخدام وعلى نطاق كبير، مثل عشرات الآلاف من صفحات منتجات Amazon أو قوائم العقارات في Zillow. | أداة استخراج ويب تقليدية |

أفضل أدوات وبرامج استخراج الويب في لمحة

| الأداة | السعر | أهم الميزات | المزايا | العيوب |

|---|---|---|---|---|

| Thunderbit | يبدأ من 9 دولارات شهريًا، مع خطة مجانية | أداة استخراج ويب بالذكاء الاصطناعي، تكتشف البيانات وتنسقها تلقائيًا، تدعم صيغًا متعددة، تصدير بنقرة واحدة، واجهة سهلة الاستخدام. | بلا كود، دعم بالذكاء الاصطناعي، تكامل مع تطبيقات مثل Google Sheets | قد يكون الاستخراج واسع النطاق بطيئًا، والميزات المتقدمة قد تكون أعلى تكلفة |

| Browse AI | يبدأ من 48.75 دولارًا شهريًا، مع خطة مجانية | واجهة بلا كود، مراقبة في الوقت الفعلي، استخراج بيانات على دفعات، تكامل مع سير العمل. | سهل الاستخدام، يتكامل مع Google Sheets وZapier | الصفحات المعقدة تحتاج إعدادًا إضافيًا، والاستخراج الجماعي قد يسبب انتهاء المهلة |

| Bardeen AI | يبدأ من 60 دولارًا شهريًا، مع خطة مجانية | أتمتة بلا كود، يتكامل مع أكثر من 130 تطبيقًا، وMagicBox يحول المهام إلى سير عمل. | تكاملات واسعة، قابل للتوسع للشركات | منحنى تعلم حاد للمستخدمين الجدد، والإعداد يستغرق وقتًا |

| Web Scraper | مجاني للاستخدام المحلي، و50 دولارًا شهريًا للحوسبة السحابية | إنشاء بصري للمهام، يدعم المواقع الديناميكية (AJAX/JavaScript)، استخراج سحابي. | يعمل جيدًا مع المواقع الديناميكية | يحتاج إلى معرفة تقنية للحصول على أفضل إعداد |

| Octoparse | يبدأ من 119 دولارًا شهريًا، مع خطة مجانية | استخراج بلا كود، اكتشاف تلقائي لعناصر الصفحة، استخراج سحابي مع مهام مجدولة، مكتبة قوالب للمواقع الشائعة. | ميزات قوية للمواقع الديناميكية، ويتعامل مع القيود | المواقع المعقدة تتطلب تعلمًا |

| Diffbot | يبدأ من 299 دولارًا شهريًا | واجهة برمجة تطبيقات لاستخراج البيانات، API من دون قواعد، معالجة اللغة الطبيعية للنصوص غير المنظمة، رسم بياني معرفي واسع. | استخراج قوي بالذكاء الاصطناعي، تكامل واسع مع واجهات API، استخراج واسع النطاق | منحنى تعلم للمستخدمين غير التقنيين، ووقت إعداد |

أفضل أداة استخراج ويب في عصر الذكاء الاصطناعي

Thunderbit أداة قوية وسهلة الاستخدام لأتمتة الويب بالذكاء الاصطناعي، تتيح للمستخدمين من دون مهارات برمجة استخراج البيانات وتنظيمها بسهولة. ومع ، تبسط من Thunderbit عملية جمع البيانات؛ إذ يمكن للمستخدمين سحب بيانات الويب بسرعة من دون التفاعل يدويًا مع عناصر الصفحة أو إعداد أدوات منفصلة لتخطيطات مختلفة.

أهم الميزات

- مرونة مدعومة بالذكاء الاصطناعي: تكتشف أداة استخراج الويب بالذكاء الاصطناعي من Thunderbit بيانات الويب وتنسقها تلقائيًا، ما يلغي الحاجة إلى محددات CSS.

- أسهل تجربة استخراج: كل ما عليك فعله هو النقر على “AI suggest column” ثم النقر على “Scrape” في الصفحة التي تريد الاستخراج منها. هذا كل شيء.

- دعم صيغ بيانات متنوعة: تستطيع Thunderbit استخراج الروابط والصور وعرض البيانات الملتقطة بصيغ متعددة.

- معالجة بيانات مؤتمتة: يمكن لذكاء Thunderbit إعادة تنسيق البيانات أثناء العمل، بما في ذلك تلخيصها وتصنيفها وترجمتها إلى الصيغة المطلوبة.

- تصدير سهل للبيانات: صدّر البيانات إلى Google Sheets أو Airtable أو Notion بنقرة واحدة، ما يبسط إدارة البيانات.

- واجهة سهلة الاستخدام: واجهة بديهية تجعلها مناسبة للمستخدمين بمختلف مستوياتهم.

السعر

تقدم Thunderbit خططًا متدرجة، تبدأ من 9 دولارات شهريًا مقابل 5,000 رصيد. وتصل حتى 199 دولارًا مقابل 240,000 رصيد. كما أنك في الخطة السنوية تحصل على جميع الأرصدة مقدمًا.

المزايا:

- دعم قوي بالذكاء الاصطناعي يبسط استخراج البيانات ومعالجتها.

- بلا كود، ومناسبة للمستخدمين من جميع المستويات.

- مثالية للاستخراج الخفيف مثل الأدلة ومواقع التسوق وغيرها.

- قدرات تكامل عالية للتصدير المباشر إلى التطبيقات الشائعة.

العيوب:

- قد يستغرق استخراج البيانات على نطاق واسع بعض الوقت لضمان الدقة.

- بعض الميزات المتقدمة قد تتطلب اشتراكًا مدفوعًا.

تريد مزيدًا من المعلومات؟ ابدأ بـ، أو اكتشف باستخدام Thunderbit.

أفضل أداة استخراج ويب لمراقبة البيانات والاستخراج الجماعي

Browse AI

Browse AI أداة قوية لاستخراج البيانات بلا كود، صُممت لمساعدة المستخدمين على استخراج البيانات ومراقبتها من دون كتابة أي برمجة. لدى Browse AI بعض ميزات الذكاء الاصطناعي، لكنها ليست بمستوى الاستخراج الكامل بالذكاء الاصطناعي. ومع ذلك، فهي تسهّل على المستخدمين البدء.

أهم الميزات

- واجهة بلا كود: تتيح للمستخدمين إنشاء سير عمل مخصص عبر نقرات بسيطة.

- المراقبة في الوقت الفعلي: تستخدم روبوتات لتتبع تغييرات صفحات الويب وتقديم المعلومات المحدثة.

- استخراج البيانات على دفعات: قادرة على معالجة ما يصل إلى 50,000 مدخلة بيانات دفعة واحدة.

- تكامل سير العمل: تربط عدة روبوتات لمعالجة بيانات أكثر تعقيدًا.

السعر

يبدأ من 48.75 دولارًا شهريًا، ويشمل 2,000 رصيد. وهناك خطة مجانية توفر 50 رصيدًا شهريًا لتجربة الميزات الأساسية.

المزايا:

- يوفر تكاملًا مع Google Sheets وZapier.

- الروبوتات الجاهزة تبسط مهام استخراج البيانات الشائعة.

العيوب:

- قد يتطلب إعدادات إضافية للصفحات المعقدة.

- قد تختلف سرعة الاستخراج الجماعي، وأحيانًا يؤدي ذلك إلى انتهاء المهلة.

أفضل أداة استخراج ويب لتكامل سير العمل

Bardeen AI

Bardeen AI أداة أتمتة بلا كود صُممت لتبسيط سير العمل عبر ربط تطبيقات مختلفة. ورغم أنها تستخدم الذكاء الاصطناعي لإنشاء الأتمتة المخصصة، فإنها تفتقر إلى مرونة أداة استخراج كاملة بالذكاء الاصطناعي.

أهم الميزات

- أتمتة بلا كود: تتيح للمستخدمين إعداد سير العمل بالنقر.

- MagicBox: يصف المهام بلغة بسيطة، ثم يحولها Bardeen AI إلى سير عمل.

- خيارات تكامل واسعة: يتكامل مع أكثر من 130 تطبيقًا، بما في ذلك Google Sheets وSlack وLinkedIn.

السعر

يبدأ من 60 دولارًا شهريًا، مع 1,500 رصيد (حوالي 1,500 صف من البيانات). وتوفر الخطة المجانية 100 رصيد شهريًا لتجربة الميزات الأساسية.

المزايا:

- خيارات التكامل الواسعة تدعم احتياجات الأعمال المتنوعة.

- مرن وقابل للتوسع للشركات من جميع الأحجام.

العيوب:

- قد يحتاج المستخدمون الجدد إلى وقت لتعلم المنصة كاملة.

- قد يستغرق الإعداد الأولي وقتًا طويلًا.

أفضل أداة استخراج ويب بصري لمن لديهم خبرة

Web Scraper

نعم، قرأت ذلك صحيحًا: اسم الأداة هو "Web Scraper". Web Scraper إضافة متصفح شائعة لكل من Chrome وFirefox، تتيح للمستخدمين استخراج البيانات من دون برمجة، وتوفر طريقة بصرية لإنشاء مهام الاستخراج. لكنك قد تحتاج إلى قضاء بضعة أيام في مشاهدة الدروس التعليمية أعلاه والتعلم منها حتى تتقن هذه الأداة بالكامل. إذا كنت تريد أن تجعل الاستخراج سهلًا على عقلك، فاختر أداة استخراج الويب بالذكاء الاصطناعي.

أهم الميزات

- إنشاء بصري: يتيح للمستخدمين إعداد مهام الاستخراج عبر النقر على عناصر الويب.

- دعم المواقع الديناميكية: يمكنه التعامل مع طلبات AJAX وJavaScript للمواقع الديناميكية.

- استخراج سحابي: جدولة المهام عبر Web Scraper Cloud لإجراء استخراج دوري.

السعر

مجاني للاستخدام المحلي؛ وتبدأ الخطط المدفوعة من 50 دولارًا شهريًا لميزات السحابة.

المزايا:

- يعمل جيدًا مع المواقع الديناميكية.

- مجاني للاستخدام المحلي.

العيوب:

- يتطلب معرفة تقنية للحصول على أفضل إعداد.

- يلزم اختبار معقد عند حدوث تغييرات.

أفضل أداة استخراج ويب لتجنب حظر IP واكتشاف الروبوتات

Octoparse

Octoparse برنامج متعدد الاستخدامات للمستخدمين الأكثر تقنية لجمع بيانات ويب محددة ومراقبتها من دون برمجة، وهو مثالي لاحتياجات البيانات واسعة النطاق. لا يعتمد Octoparse على متصفح المستخدم للتشغيل؛ بل يستخدم خوادم سحابية لاستخراج البيانات. لذلك يمكنه توفير طرق مختلفة لتجاوز حظر IP وبعض آليات كشف الروبوتات في المواقع.

أهم الميزات

- تشغيل بلا كود: يمكن للمستخدمين إنشاء مهام استخراج من دون كتابة برمجة، ما يجعله مناسبًا لمستويات تقنية مختلفة.

- اكتشاف تلقائي ذكي: يكتشف بيانات الصفحة تلقائيًا، ويحدد بسرعة العناصر المتاحة للاستخراج، ما يبسط الإعداد.

- استخراج سحابي: يدعم استخراج البيانات السحابي على مدار الساعة مع مهام مجدولة لمرونة في جلب البيانات.

- مكتبة قوالب واسعة: يوفر مئات القوالب الجاهزة، ما يتيح للمستخدمين الوصول بسرعة إلى البيانات من المواقع الشائعة من دون إعداد معقد.

السعر

تبدأ خطة أسعار Octoparse من 119 دولارًا شهريًا، وتشمل 100 مهمة. كما تتوفر خطة مجانية مع 10 مهام شهريًا لاختبار الوظائف الأساسية.

المزايا:

- ميزات قوية تدعم استخراج المواقع الديناميكية بمرونة عالية.

- يوفر حلولًا للتعامل مع قيود الاستخراج ومشكلات المحتوى الديناميكي.

العيوب:

- هياكل المواقع المعقدة قد تتطلب وقتًا أطول في الإعداد.

- قد يحتاج المستخدمون الجدد إلى وقت لتعلم أساليب الاستخدام.

أفضل أداة استخراج ويب لواجهة API متقدمة لاستخراج البيانات بالذكاء الاصطناعي

Diffbot

Diffbot أداة متقدمة لاستخراج بيانات الويب تستخدم الذكاء الاصطناعي لتحويل المحتوى غير المنظم إلى بيانات منظمة. ومع واجهات API قوية ورسم بياني معرفي، تساعد Diffbot المستخدمين على استخراج المعلومات وتحليلها وإدارتها من الويب، وهي مناسبة لمختلف الصناعات والتطبيقات.

أهم الميزات

- واجهة برمجة تطبيقات لاستخراج البيانات: توفر Diffbot واجهة استخراج بيانات من دون قواعد، بحيث يكفي أن يقدّم المستخدم رابط URL ليتم استخراج البيانات تلقائيًا، من دون الحاجة إلى إعداد قواعد مخصصة لكل موقع.

- واجهة معالجة اللغة الطبيعية: تستخرج الكيانات والعلاقات والمشاعر من النصوص غير المنظمة، ما يساعد المستخدمين على بناء رسومهم البيانية المعرفية الخاصة.

- الرسم البياني المعرفي: تمتلك Diffbot أحد أكبر الرسوم البيانية المعرفية، ويربط بيانات كيان واسعة، بما في ذلك تفاصيل عن الأفراد والمنظمات.

السعر

تبدأ خطة أسعار Diffbot من 299 دولارًا شهريًا، وتشمل 250,000 رصيد (ما يعادل تقريبًا 250,000 عملية استخراج صفحات عبر API).

المزايا:

- قدرات قوية لاستخراج البيانات من دون قواعد مع مرونة عالية.

- خيارات تكامل واسعة عبر API لتسهيل الاندماج مع الأنظمة الحالية.

- يدعم استخراج البيانات على نطاق واسع، ومناسب لتطبيقات الشركات.

العيوب:

- قد يتطلب الإعداد الأولي بعض وقت التعلم للمستخدمين غير التقنيين.

- يجب على المستخدمين كتابة برنامج لاستدعاء API لاستخدامه.

فيما يمكنك استخدام أدوات الاستخراج؟

إذا كنت جديدًا على استخراج بيانات الويب، فإليك بعض حالات الاستخدام الشائعة لتبدأ منها. يستخدم كثيرون أدوات الاستخراج للحصول على قوائم منتجات Amazon، أو سحب بيانات العقارات من Zillow، أو جمع تفاصيل الشركات من Google Maps. لكن هذا مجرد بداية — يمكنك استخدام من Thunderbit لجمع البيانات من כמעט أي موقع، ما يبسّط المهام ويوفر الوقت في سير عملك اليومي. سواء كان الهدف البحث أو تتبع الأسعار أو بناء قواعد بيانات، فإن استخراج بيانات الويب يفتح طرقًا لا حصر لها لتوظيف بيانات الإنترنت لصالحك.

الأسئلة الشائعة

-

هل استخراج بيانات الويب قانوني؟

يكون استخراج بيانات الويب قانونيًا عادةً، لكن يجب الالتزام بشروط استخدام الموقع وطبيعة البيانات التي يتم الوصول إليها. راجع السياسات ذات الصلة دائمًا وامتثل للإرشادات القانونية.

-

هل أحتاج إلى مهارات برمجة لاستخدام أدوات استخراج الويب؟

معظم الأدوات المذكورة هنا لا تتطلب مهارات برمجة، لكن أدوات مثل Octoparse وWeb Scraper قد تستفيد من امتلاك المستخدم معرفة أساسية بهياكل الويب وعقلية برمجية للحصول على أفضل استخدام.

-

هل توجد أدوات مجانية لاستخراج بيانات الويب؟

نعم، تتوفر أدوات مجانية مثل BeautifulSoup وScrapy وWeb Scraper، كما أن بعض الأدوات تقدم خططًا مجانية بميزات محدودة.

-

ما التحديات الشائعة في استخراج بيانات الويب؟

تشمل التحديات الشائعة التعامل مع المحتوى الديناميكي، وCAPTCHAs، وحظر IP، وهياكل HTML المعقدة. ويمكن للأدوات والتقنيات المتقدمة معالجة هذه المشكلات بفعالية.

اعرف المزيد:

-

استخدم الذكاء الاصطناعي لإنجاز العمل من دون أي مجهود.