إذا سبق لك أن حاولت بناء قائمة مبيعات مستهدفة، أو استكشاف أسواق جديدة، أو مقارنة أداء المنافسين، فأنت تعرف جيدًا أن Google Maps كنز حقيقي. لكن المفاجأة الأهم هي أنه مع أكثر من 1.5 مليار عملية بحث «بالقرب مني» كل شهر، ومع قيام 76% من الباحثين المحليين بزيارة نشاط تجاري خلال 24 ساعة ()، لم يكن الطلب على بيانات الأعمال المحدثة والمبنية على الموقع أعلى مما هو عليه الآن.

سواء كنت تعمل في المبيعات أو التسويق أو العمليات، فإن استخراج بيانات منظمة من Google Maps قد يكون الفارق بين اتصال بارد وفرصة دافئة عالية التحويل.

لقد أمضيت سنوات في مجالي SaaS والأتمتة، وشاهدت بنفسي كيف تستخدم الفرق Python — والآن أدوات مدعومة بالذكاء الاصطناعي مثل — لتحويل Google Maps إلى أصل استراتيجي.

في هذا الدليل، سأشرح بالضبط كيفية استخراج بيانات Google Maps باستخدام Python في عام 2026 — خطوة بخطوة، مع الأكواد، ونصائح الامتثال، ومقارنة مع الحلول دون كود. سواء كنت محترفًا في Python أو تبحث فقط عن أسرع طريق إلى بيانات قابلة للتنفيذ، فأنت في المكان الصحيح.

ماذا يعني استخراج بيانات Google Maps باستخدام Python؟

لنبدأ من الأساسيات: استخراج بيانات Google Maps باستخدام Python يعني سحب معلومات الأنشطة التجارية برمجيًا — مثل الأسماء، والعناوين، والتقييمات، والمراجعات، وأرقام الهواتف، والإحداثيات — من Google Maps، حتى تتمكن من تحليلها وتصفيةها وتصديرها للاستخدام التجاري.

هناك طريقتان رئيسيتان للقيام بذلك:

- واجهة Places API الخاصة بـ Google Maps: الطريقة الرسمية المرخّصة. تستخدم مفتاح API للاستعلام من خوادم Google والحصول على بيانات JSON منظمة. هذه الطريقة مستقرة ويمكن التنبؤ بها وملتزمة إلى حد كبير، لكنها تأتي مع حصص استخدام وتكاليف.

- استخراج HTML من الويب: تقوم بأتمتة متصفح (باستخدام أدوات مثل Playwright أو Selenium) لتحميل Google Maps، وإجراء عمليات البحث، وتحليل الصفحة المعروضة. هذه الطريقة أكثر مرونة لكنها هشة — فـ Google تغيّر بنية موقعها كثيرًا، وقد يخالف استخراج HTML شروطها.

حقول البيانات الشائعة التي يمكنك استخراجها:

- اسم النشاط التجاري

- الفئة/النوع

- العنوان الكامل (مع المدينة، والولاية، والرمز البريدي، والبلد)

- خط العرض وخط الطول

- رقم الهاتف

- رابط الموقع الإلكتروني

- التقييم وعدد المراجعات

- مستوى الأسعار

- حالة النشاط التجاري (مفتوح/مغلق)

- ساعات العمل

- معرّف المكان (Place ID، وهو المعرّف الفريد من Google)

- رابط Google Maps

لماذا هذا مهم؟ لأن هذه الحقول تدعم كل شيء، من توليد العملاء المحتملين وتخطيط المناطق إلى مقارنة المنافسين وأبحاث السوق. الأهم هو استهداف البيانات المناسبة لأهداف عملك — لا تقم بالاستخراج بشكل عشوائي.

لماذا تستخرج فرق المبيعات والتسويق البيانات من Google Maps باستخدام Python

لنكن عمليين. لماذا أصبحت بيانات Google Maps هوسًا لدى هذا العدد الكبير من فرق المبيعات والتسويق في عام 2026؟

- توليد العملاء المحتملين: أنشئ قوائم شديدة الاستهداف للشركات المحلية، مع معلومات الاتصال والتقييمات، لحملات التواصل.

- تخطيط المناطق: ارسم مناطق المبيعات أو نطاقات التوصيل أو مناطق الخدمة بناءً على كثافة الأعمال وأنواعها الفعلية.

- مراقبة المنافسين: تتبع مواقع المنافسين وتقييماتهم ومراجعاتهم بمرور الوقت لاكتشاف الاتجاهات والفرص.

- أبحاث السوق: حلّل فئات الأعمال، وساعات العمل، ومشاعر المراجعات لتوجيه استراتيجيات دخول السوق.

- اختيار المواقع: في العقارات والتجزئة، قيّم المواقع المحتملة بناءً على المرافق القريبة، وحركة المرور، والمنافسة.

الأثر الواقعي: وفقًا لتقرير ، فإن 92% من مؤسسات المبيعات تخطط لزيادة استثماراتها في الذكاء الاصطناعي/البيانات، والفرق التي تستخدم بيانات محلية مستهدفة تحقق معدلات تحويل أعلى حتى 8 مرات من تلك التي تعتمد على قوائم باردة عامة (). ووجدت دراسة عن توليد العملاء المحتملين للامتيازات أن هناك 15 دولارًا من الإيرادات الجديدة مقابل كل 1 دولار يُنفق على قوائم العملاء المحتملين المبنية على Google Maps.

ربط أهداف العمل بحقول Google Maps:

| هدف العمل | حقول Google Maps المطلوبة |

|---|---|

| قائمة عملاء محتملين محلية | الاسم، العنوان، الهاتف، الموقع الإلكتروني، الفئة |

| تخطيط المناطق | الاسم، خط العرض/الطول، حالة النشاط، ساعات العمل |

| مقارنة المنافسين | الاسم، التقييم، عدد تقييمات المستخدمين، مستوى الأسعار، المراجعات |

| اختيار الموقع | الفئة، خط العرض/الطول، كثافة المراجعات، تاريخ الفتح |

| رؤى المشاعر/القائمة | المراجعات، الملخص التحريري، الصور، الأنواع |

| التواصل عبر البريد/الهاتف | رقم الهاتف الوطني، رابط الموقع الإلكتروني (ثم الإثراء حسب الحاجة) |

إعداد أداة استخراج Google Maps بـ Python: الأدوات والمتطلبات

قبل أن تبدأ بالاستخراج، ستحتاج إلى إعداد بيئة Python وتجهيز الأدوات المناسبة. إليك ما تحتاجه في 2026:

1. تثبيت Python والمكتبات المطلوبة

إصدار Python الموصى به: 3.10 أو أحدث.

ثبّت المكتبات الأساسية:

1pip install \

2 requests==2.33.1 httpx==0.28.1 \

3 beautifulsoup4==4.14.3 lxml==6.0.3 \

4 pandas==2.3.3 \

5 selenium==4.43.0 playwright==1.58.0 \

6 googlemaps==4.10.0 google-maps-places==0.8.0 \

7 schedule==1.2.2 APScheduler==3.11.2 \

8 python-dotenv==1.2.2 tenacity==9.1.4

9playwright install chromiumما الذي تفعله هذه الأدوات؟

requestsوhttpx: طلبات HTTP (استدعاءات API)beautifulsoup4وlxml: تحليل HTML (لاستخراج بيانات الويب)pandas: تنظيف البيانات وتحليلها وتصديرهاseleniumوplaywright: أتمتة المتصفح (لاستخراج HTML)googlemapsوgoogle-maps-places: عملاء Google Maps APIscheduleوAPScheduler: جدولة المهامpython-dotenv: تحميل مفاتيح API بأمان من ملفات.envtenacity: منطق إعادة المحاولة لمعالجة الأخطاء

2. الحصول على مفتاح Google Maps API (للاستخراج المعتمد على API)

- انتقل إلى .

- أنشئ مشروعًا أو اختر مشروعًا قائمًا.

- فعّل الفوترة (مطلوبة حتى لاستخدام الطبقة المجانية).

- فعّل “Places API (New)” ضمن APIs & Services > Library.

- انتقل إلى Credentials > Create Credentials > API Key.

- قيّد المفتاح على واجهات API وعناوين IP محددة لأسباب أمنية.

- خزّن مفتاح API في ملف

.env(ولا تضفه أبدًا إلى الكود):

1GOOGLE_MAPS_API_KEY=your_actual_api_key_hereملاحظة: اعتبارًا من مارس 2025، لم تعد Google تقدم رصيدًا مجانيًا موحدًا بقيمة 200 دولار شهريًا. بدلًا من ذلك، تحصل على حدود شهرية مجانية بحسب فئة كل API (راجع ).

كيفية استخراج البيانات من Google Maps باستخدام Python: دليل خطوة بخطوة

لنقسّم الطريقتين الرئيسيتين — الاعتماد على API واستخراج HTML — حتى تتمكن من اختيار ما يناسب احتياجاتك.

الطريقة 1: استخدام Places API الخاصة بـ Google Maps (موصى بها)

الخطوة 1: تثبيت المكتبات المطلوبة واستيرادها

1import os

2import httpx

3import pandas as pd

4from dotenv import load_dotenvالخطوة 2: تحميل مفتاح API بأمان

1load_dotenv()

2API_KEY = os.environ["GOOGLE_MAPS_API_KEY"]الخطوة 3: بناء استعلام البحث

ستستخدم نقطة نهاية Text Search للعثور على الأنشطة التجارية المطابقة لمعاييرك.

1URL = "https://places.googleapis.com/v1/places:searchText"

2FIELD_MASK = ",".join([

3 "places.id", "places.displayName", "places.formattedAddress",

4 "places.location", "places.rating", "places.userRatingCount",

5 "places.priceLevel", "places.types",

6 "places.nationalPhoneNumber", "places.websiteUri",

7 "nextPageToken",

8])الخطوة 4: إرسال طلب API

1def text_search(query, lat, lng, radius=3000, min_rating=4.0):

2 body = {

3 "textQuery": query,

4 "minRating": min_rating, # فلتر على جانب الخادم

5 "includedType": "restaurant",

6 "openNow": False,

7 "pageSize": 20,

8 "locationBias": {

9 "circle": {

10 "center": {"latitude": lat, "longitude": lng},

11 "radius": radius,

12 }

13 },

14 }

15 headers = {

16 "Content-Type": "application/json",

17 "X-Goog-Api-Key": API_KEY,

18 "X-Goog-FieldMask": FIELD_MASK, # يجب ضبط هذا دائمًا!

19 }

20 r = httpx.post(URL, json=body, headers=headers, timeout=30)

21 r.raise_for_status()

22 return r.json()الخطوة 5: التعامل مع الترقيم وجمع النتائج

1def collect_all_results(query, lat, lng, radius=3000, min_rating=4.0):

2 results = []

3 next_page_token = None

4 while True:

5 data = text_search(query, lat, lng, radius, min_rating)

6 places = data.get('places', [])

7 results.extend(places)

8 next_page_token = data.get('nextPageToken')

9 if not next_page_token:

10 break

11 return resultsالخطوة 6: تصدير البيانات باستخدام Pandas

1df = pd.DataFrame(collect_all_results("coffee shops in Brooklyn", 40.6782, -73.9442))

2df.to_csv("brooklyn_coffee_shops.csv", index=False)نصائح احترافية:

- احرص دائمًا على ضبط ترويسة

X-Goog-FieldMaskللتحكم في التكاليف. إذا طلبت المراجعات أو الصور، فقد يقفز السعر لكل 1000 طلب من 5 دولارات إلى 25 دولارًا (). - استخدم فلاتر على جانب الخادم مثل

minRatingوincludedTypeوlocationBiasلتجنب إهدار الاعتمادات على نتائج غير مهمة. - خزّن قيم

place_idلإزالة التكرار وللتحديثات المستقبلية.

الطريقة 2: استخراج HTML من Google Maps عبر الويب (للاستخدام التعليمي أو لمرة واحدة)

تحذير: Google Maps تطبيق أحادي الصفحة. يجب استخدام أتمتة المتصفح (Playwright أو Selenium)، كما أن استخراج HTML قد يخالف شروط Google. استخدم هذا للأبحاث وليس للإنتاج.

الخطوة 1: تثبيت Playwright وتشغيل متصفح

1from playwright.sync_api import sync_playwright

2import time, re

3def scrape_maps(query, max_results=100):

4 with sync_playwright() as pw:

5 browser = pw.chromium.launch(headless=True)

6 ctx = browser.new_context(

7 user_agent="Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/124.0.0.0 Safari/537.36",

8 locale="en-US",

9 )

10 page = ctx.new_page()

11 page.goto("https://www.google.com/maps", timeout=60_000)

12 page.fill("#searchboxinput", query)

13 page.click('button[aria-label="Search"]')

14 page.wait_for_selector('div[role="feed"]')

15 feed = page.locator('div[role="feed"]')

16 prev = 0

17 while True:

18 feed.evaluate("el => el.scrollBy(0, el.scrollHeight)")

19 time.sleep(2)

20 count = page.locator('div[role="feed"] > div > div[jsaction]').count()

21 if count == prev or count >= max_results:

22 break

23 prev = count

24 if page.locator("text=You've reached the end of the list").count():

25 break

26 rows = []

27 cards = page.locator('div[role="feed"] > div > div[jsaction]')

28 for i in range(cards.count()):

29 c = cards.nth(i)

30 name = c.locator("div.fontHeadlineSmall").inner_text() if c.locator("div.fontHeadlineSmall").count() else ""

31 rating_el = c.locator('span[role="img"]').first

32 raw = rating_el.get_attribute("aria-label") if rating_el.count() else ""

33 m = re.search(r"([\d.]+)\s+stars?\s+([\d,]+)\s+Reviews", raw or "")

34 rating = float(m.group(1)) if m else None

35 reviews = int(m.group(2).replace(",", "")) if m else None

36 rows.append({"name": name, "rating": rating, "reviews": reviews})

37 browser.close()

38 return rowsنصائح:

- تغيّر Google أصناف CSS عشوائيًا كل بضعة أسابيع، لذا قد يحتاج هذا الكود إلى تحديثات منتظمة.

- استخدم تأخيرات تشبه سلوك البشر وتجنب الاستخراج بسرعة كبيرة لتقليل خطر الحظر.

- لا تحاول أبدًا تجاوز CAPTCHA أو نظام SearchGuard الخاص بـ Google — فقد يعرّضك ذلك لمخاطر قانونية.

تجنب الاستخراج العشوائي: كيف تستهدف البيانات التي تحتاجها بدقة

إن استخراج كل شيء وصفة لضياع الوقت وتضخم مجموعات البيانات. إليك كيفية استهداف البيانات المهمة فقط:

- أنشئ قوائم روابط مستهدفة: استخدم فلاتر البحث الخاصة بـ Google Maps (الفئة، الموقع، التقييم، مفتوح الآن) لتضييق النتائج قبل الاستخراج.

- استخدم مطابقة العبارات: ابحث عن أنواع أعمال أو كلمات مفتاحية دقيقة (مثل: “مخبز نباتي في أوستن”).

- فلاتر الموقع: حدّد المدينة أو الحي أو حتى الإحداثيات ونطاق البحث للحصول على دقة عالية.

- الترشيح على جانب الخادم (API): استخدم

minRatingوincludedTypeوlocationBiasفي جسم طلب API. - الترشيح على جانب العميل (Python): بعد الاستخراج، استخدم pandas لتصفية الأنشطة التي تقييمها أعلى من 4.0، أو التي لديها أكثر من 50 مراجعة، أو التي تنتمي إلى فئات محددة.

مثال: تصفية المطاعم فقط في مانهاتن ذات التقييم أعلى من 4.0

1df = pd.DataFrame(results)

2filtered = df[(df['rating'] >= 4.0) & (df['types'].apply(lambda x: 'restaurant' in x))]

3filtered.to_csv("manhattan_top_restaurants.csv", index=False)استخدام مكتبات Python لتنظيم بيانات Google Maps وتصديرها

بعد أن تستخرج البيانات، حان وقت تنظيفها وتحليلها وتصديرها لفريقك.

تنظيف البيانات وتنظيمها باستخدام Pandas

1import pandas as pd

2df = pd.read_json("brooklyn_restaurants.json")

3df = (

4 df.dropna(subset=["name", "address"])

5 .drop_duplicates(subset=["place_id"])

6 .assign(

7 name=lambda d: d["name"].str.strip(),

8 phone=lambda d: d["phone"].astype(str)

9 .str.replace(r"\D", "", regex=True)

10 .str.replace(r"^1?(\d\{10\})$", r"+1\1", regex=True),

11 rating=lambda d: pd.to_numeric(d["rating"], errors="coerce"),

12 user_ratings_total=lambda d: pd.to_numeric(

13 d["user_ratings_total"], errors="coerce"

14 ).fillna(0).astype("int32"),

15 )

16)تحليل البيانات وتلخيصها

مثال: متوسط التقييم حسب الحي

1by_neighborhood = (

2 df.groupby("neighborhood", as_index=False)

3 .agg(avg_rating=("rating", "mean"),

4 n_places=("place_id", "nunique"),

5 median_reviews=("user_ratings_total", "median"))

6 .sort_values("avg_rating", ascending=False)

7)التصدير إلى Excel أو CSV

1df.to_csv("brooklyn_top.csv", index=False)

2df.to_excel("brooklyn_top.xlsx", index=False, sheet_name="Top Rated")هل لديك مجموعات بيانات كبيرة؟ استخدم تنسيق Parquet من أجل السرعة وكفاءة الحجم:

1df.to_parquet("brooklyn_top.parquet", compression="zstd")Thunderbit: البديل المدعوم بالذكاء الاصطناعي لأداة استخراج Google Maps بـ Python

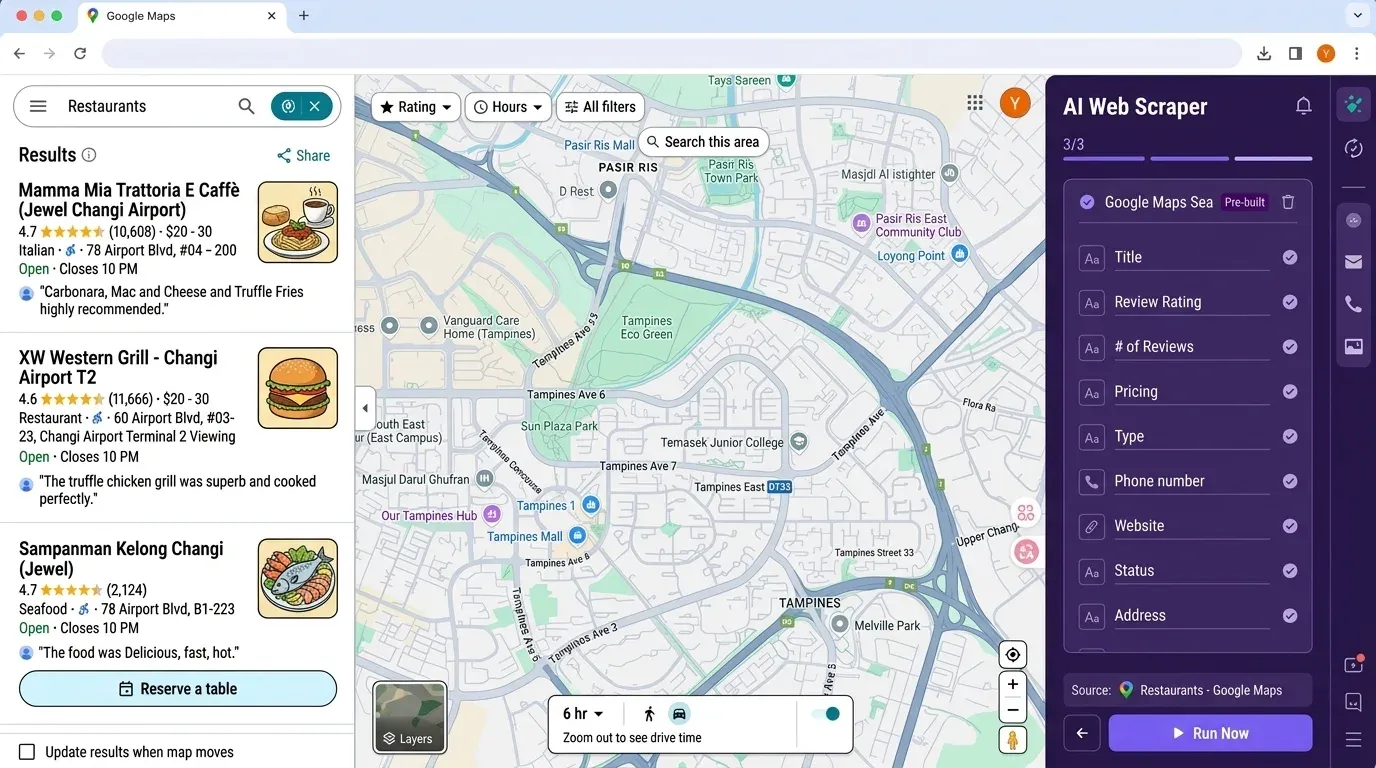

إذا كنت تفكر الآن: “كل هذا إعداد كثير جدًا من أجل قائمة عملاء محتملين بسيطة”، فأنت لست وحدك. لهذا السبب بنينا — أداة استخراج ويب دون كود ومدعومة بالذكاء الاصطناعي تجعل استخراج بيانات Google Maps (وغيرها الكثير) سهلاً للغاية، ببضع نقرات فقط.

لماذا Thunderbit؟

- لا تحتاج إلى برمجة أو مفاتيح API: فقط افتح ، وانتقل إلى Google Maps، ثم انقر على “اقتراح الحقول بالذكاء الاصطناعي”.

- اكتشاف الحقول بالذكاء الاصطناعي: يقرأ ذكاء Thunderbit الصفحة ويقترح الأعمدة المناسبة — الاسم، العنوان، التقييم، الهاتف، الموقع الإلكتروني، وغيرها.

- استخراج الصفحات الفرعية: هل تريد إثراء جدولك ببيانات من موقع كل نشاط تجاري؟ يستطيع Thunderbit زيارة كل صفحة فرعية وسحب معلومات إضافية تلقائيًا.

- التصدير إلى Excel أو Google Sheets أو Airtable أو Notion: لا مزيد من التعقيد مع pandas — فقط انقر “تصدير” وستكون بياناتك جاهزة لفريقك.

- الاستخراج المجدول: أنشئ مهام متكررة لمراقبة المنافسين أو تحديث قائمة العملاء المحتملين تلقائيًا.

- صيانة شبه معدومة: يتكيف ذكاء Thunderbit مع تغييرات الموقع، لذلك لن تضطر إلى إصلاح السكربتات المعطلة باستمرار.

مقارنة بين Thunderbit وسير العمل عبر Python:

| الخطوة | أداة استخراج Python | Thunderbit |

|---|---|---|

| تثبيت الأدوات | 30–60 دقيقة (Python، pip، المكتبات) | دقيقتان (إضافة Chrome) |

| إعداد مفتاح API | 10–30 دقيقة (Cloud Console) | غير مطلوب |

| اختيار الحقول | برمجة يدوية، أقنعة الحقول | اقتراح الحقول بالذكاء الاصطناعي (نقرة واحدة) |

| استخراج البيانات | كتابة/تشغيل السكربتات، معالجة الأخطاء | انقر “استخراج” |

| التصدير | pandas إلى CSV/Excel | تصدير إلى Excel/Sheets/Notion |

| الصيانة | تحديثات يدوية عند تغيّر الموقع | تكيف تلقائي بالذكاء الاصطناعي |

إضافة مميزة: يثق أكثر من بـ Thunderbit، وتتيح لك الخطة المجانية استخراج ما يصل إلى 6 صفحات (أو 10 مع تعزيز تجريبي) دون أي تكلفة.

الالتزام: شروط خدمة Google Maps وأخلاقيات الاستخراج

هنا تصبح معظم شروحات Python قديمة وخطرة. إليك ما تحتاج إلى معرفته في 2026:

- شروط Google Maps Platform §3.2.3 تحظر بصرامة استخراج البيانات أو تخزينها مؤقتًا أو تصديرها خارج واجهات API الرسمية (). الاستثناء الوحيد: يمكن تخزين قيم خط العرض/الطول لمدة تصل إلى 30 يومًا؛ ويمكن تخزين Place IDs إلى أجل غير مسمى.

- مستخدمو API ملزمون تعاقديًا: إذا استخدمت مفتاح API، فأنت قد وافقت على شروط Google — حتى لو كنت تستخراج بيانات عامة فقط.

- تجاوز الحواجز التقنية (CAPTCHA وSearchGuard) قد يُعد الآن انتهاكًا محتملاً للمادة DMCA §1201، وهو ما قد يترتب عليه عقوبات جنائية ().

- اللائحة العامة لحماية البيانات وقوانين الخصوصية: إذا جمعت بيانات شخصية (مثل الإيميلات، وأرقام الهواتف، وأسماء المراجعين) من Google Maps، فيجب أن يكون لديك أساس قانوني وأن تستجيب لطلبات الحذف. وقد فرضت CNIL الفرنسية غرامة قدرها 200,000 يورو على KASPR في عام 2024 بسبب استخراج جهات اتصال من LinkedIn ().

- أفضل الممارسات:

- استخدم Places API افتراضيًا متى كان ذلك ممكنًا.

- حدّ من معدل الطلبات (≤10 طلبات/ثانية للـ API، و1–2 طلب/ثانية لاستخراج HTML).

- لا تتجاوز أبدًا CAPTCHA أو الحواجز التقنية.

- لا تعِد توزيع البيانات الشخصية المستخرجة.

- احترم طلبات الانسحاب والحذف.

- راجع القوانين المحلية دائمًا — مثل GDPR وCCPA وغيرها، فهي تُطبَّق بجدية.

الخلاصة: إذا كان الامتثال مصدر قلق، فالتزم بالـ API وقلّل البيانات التي تجمعها قدر الإمكان. بالنسبة لمعظم المستخدمين التجاريين، فإن أداة دون كود مثل Thunderbit تقلّل من مساحة المخاطر لديك (لا مفتاح API، ولا إعادة توزيع).

جدولة وأتمتة استخراج Google Maps باستخدام Python

إذا كنت بحاجة إلى إبقاء بياناتك محدثة — مثلًا لمراقبة المنافسين أسبوعيًا أو تحديث قوائم العملاء المحتملين شهريًا — فالأتمتة هي صديقك.

جدولة بسيطة باستخدام schedule

1import schedule, time

2from my_scraper import run_job

3schedule.every().day.at("03:00").do(run_job, query="restaurants in Brooklyn")

4schedule.every(6).hours.do(run_job, query="coffee shops in Manhattan")

5while True:

6 schedule.run_pending()

7 time.sleep(30)جدولة احترافية باستخدام APScheduler

1from apscheduler.schedulers.background import BackgroundScheduler

2from apscheduler.triggers.cron import CronTrigger

3sched = BackgroundScheduler(timezone="America/New_York")

4sched.add_job(

5 run_job,

6 CronTrigger(hour=3, minute=15, jitter=600), # 3:15 صباحًا ± 10 دقائق

7 kwargs={"query": "restaurants in Brooklyn"},

8 id="brooklyn_daily",

9 max_instances=1,

10 coalesce=True,

11 misfire_grace_time=3600,

12)

13sched.start()نصائح للأتمتة الآمنة

- أضف تذبذبًا عشوائيًا إلى الجدول الزمني لتجنب الأنماط المتوقعة.

- في حالة استخراج HTML، لا تتجاوز أبدًا 1–2 طلب في الثانية.

- في الاستخدام عبر API، راقب الحصة وحدد تنبيهات للفوترة.

- سجّل الأخطاء دائمًا واحتفظ بملف “dead-letter” للطلبات الفاشلة.

ميزة Thunderbit: باستخدام Thunderbit، يمكنك جدولة عمليات استخراج متكررة مباشرة من الواجهة — بدون كود، وبدون مهام cron، وبدون إعداد خادم.

الخلاصة الرئيسية: استخراج بيانات Google Maps بكفاءة واستهداف وامتثال

لنراجع الأساسيات:

- Google Maps هو المصدر الأول لبيانات المواقع التجارية، ويدعم كل شيء من توليد العملاء المحتملين إلى أبحاث السوق.

- الاستخراج باستخدام Python يمنحك مرونة وتحكمًا، لكنه يأتي مع عبء الإعداد والصيانة والامتثال — خصوصًا مع تشديد Google لإجراءات مكافحة الروبوتات وتزايد التطبيق القانوني.

- الاستخراج المعتمد على API هو المسار الأكثر أمانًا والأكثر قابلية للتوسع لمعظم الفرق. استخدم دائمًا أقنعة الحقول وفلاتر جانب الخادم للتحكم في التكاليف.

- استخراج HTML هش ومحفوف بالمخاطر — استخدمه فقط للأبحاث لمرة واحدة، ولا تتجاوز أبدًا الحواجز التقنية.

- استهدف بياناتك بدقة: استخدم مطابقة العبارات، وفلاتر الموقع، وسير عمل pandas لاستخراج ما تحتاجه فقط.

- Thunderbit هو الطريق الأسرع لغير المبرمجين: مدعوم بالذكاء الاصطناعي، بدون إعداد، مع تصدير فوري وجدولة مدمجة.

- الامتثال مهم: احترم شروط Google، وقوانين الخصوصية، وحدود المعدل لتجنب المتاعب القانونية.

لمزيد من الشروحات والنصائح، اطّلع على و.

الأسئلة الشائعة

1. هل من القانوني استخراج بيانات Google Maps باستخدام Python في 2026؟

يُسمح بالاستخراج عبر API الرسمي ضمن شروط Google، طالما التزمت بالحصص ولم تعِد توزيع البيانات المقيدة. أما استخراج HTML من Google Maps فهو محظور صراحةً في شروط Google وينطوي على مخاطر قانونية، خصوصًا إذا تجاوزت الحواجز التقنية أو جمعت بيانات شخصية دون موافقة. تحقّق دائمًا من القوانين المحلية (مثل GDPR وCCPA وغيرها) والتزم بأفضل ممارسات الامتثال.

2. ما الفرق بين استخدام Google Maps API واستخراج HTML من الويب؟

الـ API مستقر ومرخّص ومصمم لاستخراج البيانات، لكنه يتطلب مفتاح API وهو خاضع للحصص والتكاليف. أما استخراج HTML فيستخدم أتمتة المتصفح لسحب البيانات من الصفحة المعروضة، لكنه هش (إذ تتغير بنية الموقع كثيرًا)، وقد يخالف الشروط، وهو أكثر خطورة قانونيًا. بالنسبة لمعظم الاستخدامات التجارية، يُنصح بالاعتماد على الـ API.

3. كم تبلغ تكلفة استخراج بيانات Google Maps باستخدام Python في 2026؟

تسعير Places API من Google يكون لكل 1000 طلب، ويتراوح من 5 دولارات (Essentials) إلى 25 دولارًا (Enterprise+Atmosphere) حسب الحقول التي تطلبها. توجد حدود شهرية مجانية (10,000 لـ Essentials، و5,000 لـ Pro، و1,000 لـ Enterprise)، لكن الاستخراج واسع النطاق قد يتراكم بسرعة. استخدم دائمًا أقنعة الحقول وفلاتر جانب الخادم للتحكم في التكاليف.

4. كيف تقارن Thunderbit بأدوات استخراج Google Maps المبنية على Python؟

Thunderbit هو أداة استخراج ويب دون كود ومدعومة بالذكاء الاصطناعي تتيح لك استخراج بيانات Google Maps (وغيرها الكثير) من دون برمجة أو مفاتيح API أو صيانة. وهو مثالي لفرق المبيعات والتسويق التي تريد تصديرًا سريعًا وموثوقًا إلى Excel أو Google Sheets أو Airtable أو Notion. أما للمستخدمين التقنيين الذين يحتاجون منطقًا مخصصًا، فتوفر Python مرونة أكبر لكنها تتطلب إعدادًا وإدارة امتثال أكثر.

5. كيف يمكنني أتمتة استخراج بيانات Google Maps بشكل متكرر؟

مع Python، استخدم مكتبات الجدولة مثل schedule أو APScheduler لتشغيل أداة الاستخراج على فترات محددة (يوميًا، أسبوعيًا، إلخ). أضف تذبذبًا عشوائيًا لتقليل فرص الاكتشاف وراقب حصة API. ومع Thunderbit، يمكنك جدولة عمليات الاستخراج المتكررة مباشرة من الواجهة — بدون كود أو إعداد خادم.

هل أنت مستعد لتحويل Google Maps إلى قوة خارقة للمبيعات والتسويق؟ سواء كنت من عشاق Python أو تريد أسرع حل دون كود، فالأدوات متاحة في 2026. جرّب لاستخراج فوري مدعوم بالذكاء الاصطناعي — أو ارفع كمّاتك وانغمس في الـ API. في كلتا الحالتين، نتمنى أن تكون قوائم العملاء المحتملين لديك محدثة، وتصديراتك نظيفة، وحملاتك مليئة بعملاء محليين ذوي احتمالية تحويل عالية. استخراج موفق!

اعرف المزيد