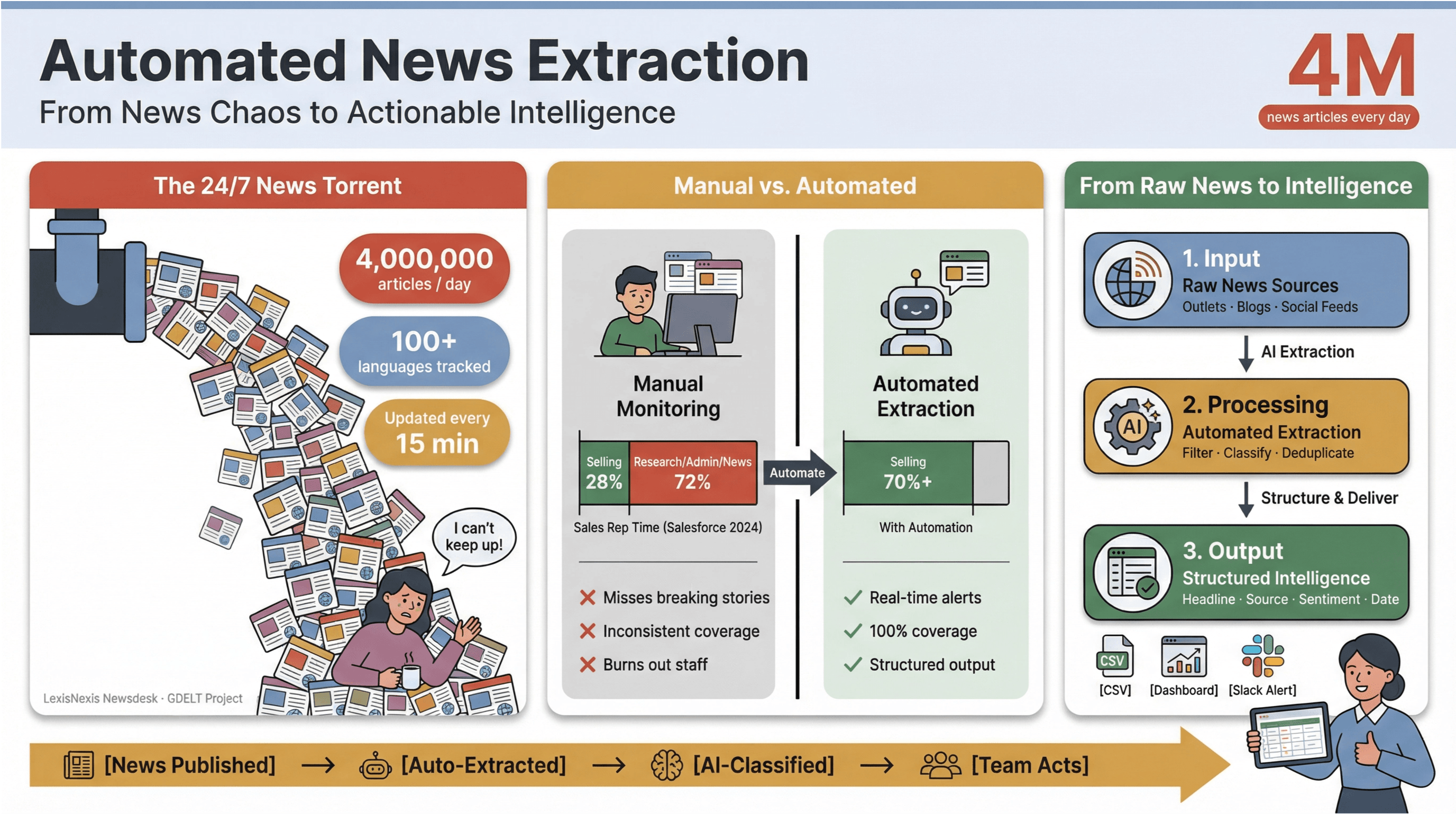

وتيرة الأخبار الرقمية اليوم تكاد تكون مربكة إلى حدٍّ مذهل. ففي كل دقيقة تُنشر آلاف العناوين أو تُحدَّث أو يُجرى عليها تعديل بصمت — عبر وسائل الإعلام الرئيسية والمدونات المتخصصة ومنصات التواصل الاجتماعي. ولإعطاء الصورة حجمها الحقيقي، فإن يستوعب أكثر من 4 ملايين مقال إخباري يوميًا، بينما يتابع الأخبار بأكثر من 100 لغة ويُحدّث موجزه العالمي كل 15 دقيقة. ولأي شخص يعمل في الإعلام أو البحث أو ذكاء الأعمال، فإن محاولة مواكبة هذا السيل يدويًا تشبه محاولة إفراغ سفينة غارقة بفنجان قهوة.

لقد رأيت بنفسي كيف يلتهم رصد الأخبار يدويًا الوقت ويستنزف الموارد. فرق المبيعات لا تقضي أكثر من ثلث أسبوعها في البيع فعليًا — — بينما يضيع الباقي في البحث والمهام الإدارية، ونعم، التنقل اللانهائي بين تبويبات الأخبار. لذلك أصبح استخراج الأخبار الآلي السلاح السري للفرق الحديثة: فهو الطريقة الوحيدة لتحويل فوضى دورة الأخبار التي لا تتوقف إلى معلومات منظمة وقابلة للتنفيذ — من دون إنهاك الفريق أو تفويت القصص الأهم.

دعنا نتعمق في معنى استخراج الأخبار الآلي حقًا، ولماذا هو ضروري لكل من يهتم ببيانات الأخبار اللحظية، وكيف تبني سير عمل قويًا ومتوافقًا مع القوانين باستخدام أفضل الأدوات (بما في ذلك كيف يجعل العملية برمتها سهلة بشكل مدهش — حتى لغير التقنيين مثل أمي).

استخراج الأخبار آليًا: لماذا هو ضروري لغرف الأخبار الحديثة

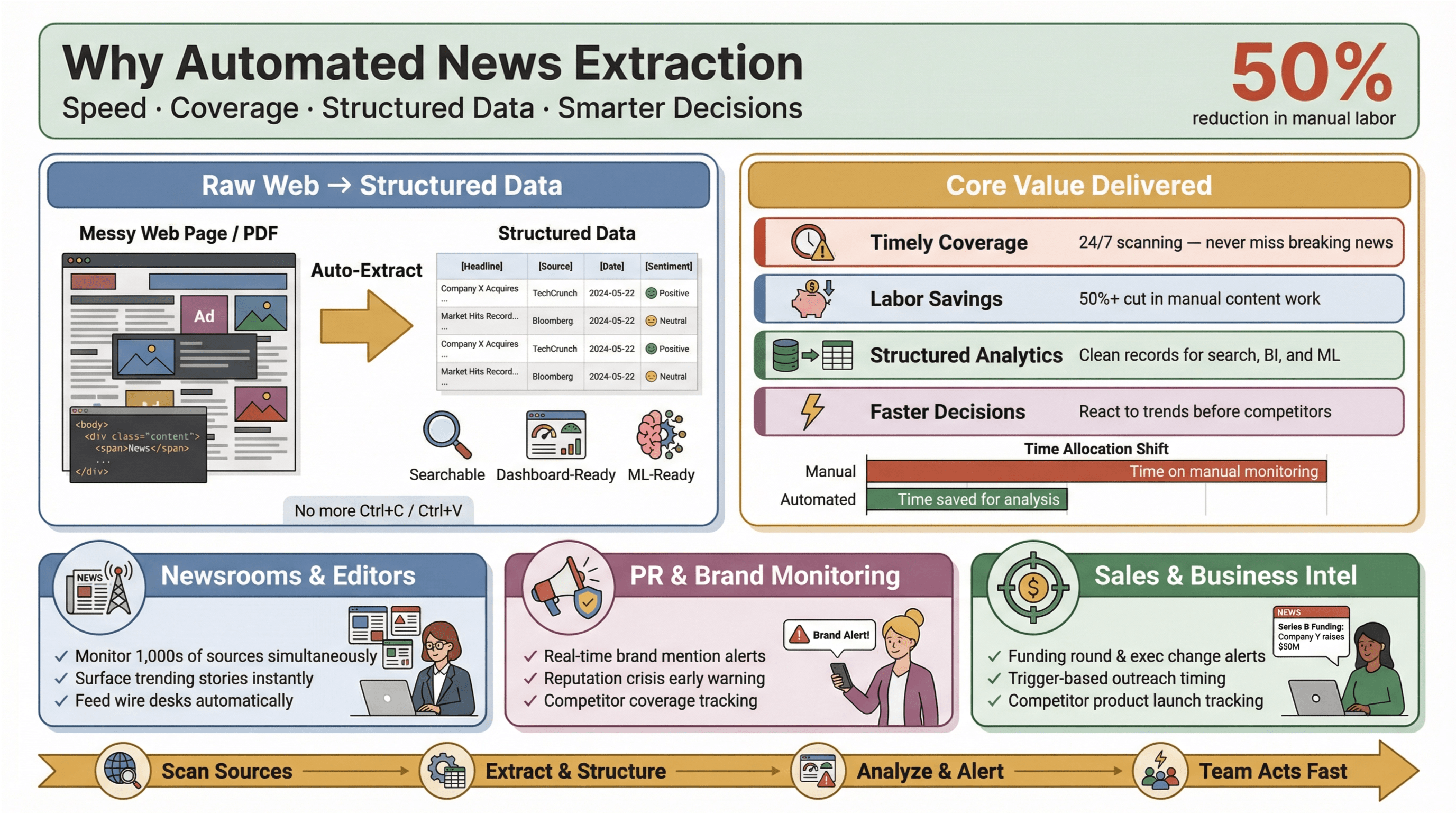

استخراج الأخبار الآلي هو بالضبط ما يوحي به اسمه: استخدام البرمجيات لجمع محتوى الأخبار تلقائيًا وتحويله إلى بيانات منظمة قابلة للبحث — أي صفوف وأعمدة بدل صفحات ويب فوضوية أو ملفات PDF. عمليًا، يعني هذا أنه يمكنك مراقبة مئات المصادر أو آلافها، واستخراج الحقول الرئيسية مثل العنوان والطابع الزمني والكاتب والنص، ثم إرسال هذه البيانات إلى لوحات المعلومات أو التنبيهات أو التحليلات اللاحقة — من دون لمس Ctrl+C/Ctrl+V.

لماذا يهم هذا؟ لأن السرعة هي كل شيء في مشهد الأخبار اليوم. سواء كنت محررًا في غرفة أخبار، أو مدير علاقات عامة يراقب الإشارات إلى العلامة التجارية، أو محلل أعمال يتتبع تحركات المنافسين، فإن معرفة الحدث أولًا قد تعني الفرق بين اقتناص الفرصة أو الركض خلفها. أدوات الاستخراج الآلي تمكّن حتى الفرق الصغيرة من التفوق على حجمها الحقيقي — عبر جمع بيانات الأخبار اللحظية من الويب، وتقليل العبء اليدوي، وإبراز القصص الأهم.

لماذا يهم هذا؟ لأن السرعة هي كل شيء في مشهد الأخبار اليوم. سواء كنت محررًا في غرفة أخبار، أو مدير علاقات عامة يراقب الإشارات إلى العلامة التجارية، أو محلل أعمال يتتبع تحركات المنافسين، فإن معرفة الحدث أولًا قد تعني الفرق بين اقتناص الفرصة أو الركض خلفها. أدوات الاستخراج الآلي تمكّن حتى الفرق الصغيرة من التفوق على حجمها الحقيقي — عبر جمع بيانات الأخبار اللحظية من الويب، وتقليل العبء اليدوي، وإبراز القصص الأهم.

والأثر حقيقي: إذ تشير الدراسات إلى أن الأتمتة يمكن أن تخفض العمل اليدوي لتحديث المحتوى بنسبة 50% على الأقل، ما يتيح وقتًا أكبر للتحليل واتخاذ القرار فعلًا.

القيمة الأساسية لاستخراج الأخبار الآلي في صناعة الأخبار

لنكن عمليين. ماذا يقدّم استخراج الأخبار الآلي فعليًا لغرف الأخبار وفرق الأعمال؟

- تغطية شاملة وفي الوقت المناسب: لا مزيد من ضياع الأخبار العاجلة لأن أحدًا نسي فحص المصدر. الأدوات الآلية تفحص المصادر على مدار الساعة، بحيث لا يفوتك شيء.

- توفير في العمل والتكلفة: يمكن للفرق الصغيرة والمتوسطة مراقبة عدد المصادر نفسه الذي تراقبه المؤسسات الكبرى — من دون توظيف جيش من المتدربين.

- بيانات منظمة للتحليلات: بدلًا من فرز المقالات غير المنظمة، تحصل على سجلات نظيفة ومنسقة جاهزة للبحث ولوحات المعلومات وتعلم الآلة.

- قرارات أسرع وأذكى: بيانات الأخبار اللحظية تعني أنك تستطيع التفاعل مع تحركات السوق أو الأزمات الإعلامية أو الاتجاهات الناشئة قبل منافسيك.

خذ العلاقات العامة والاتصالات مثلًا: منصات مثل و تضع مراقبة الوسائط اللحظية في قلب حماية السمعة والتصرف السريع تجاه التغطية الضارة. وفي المبيعات، تتحول تنبيهات الأخبار اللحظية إلى «بطاقات سياقية» للاستهداف — مثل جولات التمويل أو تغييرات التنفيذيين أو إطلاق المنتجات التي توقظ التواصل في اللحظة المناسبة تمامًا.

اختيار أدوات استخراج الأخبار المناسبة لمختلف السيناريوهات

ليست كل أدوات استخراج الأخبار متساوية. فالاختيار الصحيح يعتمد على أهدافك ومدى ارتياحك التقني وأنواع الأخبار التي تهمك. إليك إطارًا يساعدك على اختيار الأنسب:

تقييم سهولة الاستخدام وإمكانية الوصول

بالنسبة لمعظم مستخدمي الأعمال والصحفيين، سهولة الاستخدام غير قابلة للتفاوض. أنت تريد أداة تعمل مباشرة من أول استخدام، من دون برمجة أو إعداد معقد. المنصات قليلة البرمجة وعديمة البرمجة مثل , ، و تتيح لك إنشاء أدوات الاستخراج بصريًا — فقط أشر وانقر واستخرج.

ويتميّز Thunderbit على وجه الخصوص بـعملية من خطوتين: صف ما تريد، ودع الذكاء الاصطناعي يقترح الحقول، ثم اضغط «استخراج». حتى المستخدمون غير التقنيين يمكنهم إعداد مسار بيانات للأخبار في دقائق لا في ساعات.

اعتبارات الأمان وخصوصية البيانات

لكل بيانات قوية مسؤولية أكبر. أدوات استخراج الأخبار كثيرًا ما تصل إلى محتوى حساس، لذا يجب أن تكون الأمان والامتثال في مقدمة اهتماماتك. ابحث عن:

- تشفير البيانات (أثناء النقل وفي وضع التخزين)

- سياسات خصوصية واضحة (Thunderbit مثلًا يصرح بأنه لا يبيع بيانات المستخدم ولا يصل إلا إلى المحتوى الذي تختار أنت استخراجه)

- صلاحيات دقيقة (خصوصًا لإضافات المتصفح — تحقّق دائمًا من البيانات التي تستطيع الأداة الوصول إليها)

- الامتثال للقوانين المحلية (GDPR وCCPA، وبالنسبة لمستخدمي الاتحاد الأوروبي، )

ولمزيد من راحة البال، اختر مورّدين موثوقين، وتحقق من أذونات الإضافة، وقلّل الوصول إلى الحد الأدنى الضروري.

مواءمة الأدوات مع أنواع الأخبار واحتياجات القطاع

بعض الأدوات تتفوق في مجالات أخبار معينة:

- القطاع المالي: واجهات برمجة التطبيقات مثل و تقدم التجميع وتحليل المشاعر واكتشاف الأحداث للأخبار المالية.

- التقنية والشركات الناشئة: يتيح لك الاستخراج المخصص باستخدام Thunderbit أو Octoparse استهداف المدونات المتخصصة أو البيانات الصحفية أو قوائم الفعاليات.

- السياسة والشؤون العامة: قواعد البيانات المرخصة مثل و توفر وصولًا إلى مصادر مميزة وأرشيفات.

إذا كنت تحتاج إلى مراقبة مزيج من المصادر الرئيسية والمتخصصة والدولية — بما في ذلك المصادر التي لا تملك واجهات برمجة تطبيقات — فإن أدوات الاستخراج المرنة المدعومة بالذكاء الاصطناعي مثل Thunderbit هي أفضل خيار.

المزايا الفريدة لـ Thunderbit في استخراج بيانات الأخبار اللحظية

والآن، دعنا نتحدث عمّا يجعل خيارًا بارزًا لاستخراج الأخبار الآلي — خصوصًا إذا كنت تريد بيانات أخبار لحظية من دون صداع تقني.

Thunderbit هو إضافة كروم لاستخراج الويب مدعومة بالذكاء الاصطناعي ومصممة لمستخدمي الأعمال والصحفيين والمحللين الذين يحتاجون إلى محتوى إخباري محدث ومنظم من أي موقع. إليك لماذا أصبح خياري المفضل:

- اقتراح الحقول بالذكاء الاصطناعي: يقرأ Thunderbit صفحة الأخبار ويقترح تلقائيًا أفضل الأعمدة للاستخراج — العنوان والطابع الزمني والكاتب والملخص وغير ذلك. لا حاجة للعبث بالاختيارات أو القوالب.

- استخراج الصفحات الفرعية: هل تحتاج إلى المقال الكامل لا مجرد العنوان؟ يستطيع Thunderbit زيارة كل رابط إخباري، واستخراج النص الكامل والكيانات والوسوم، ثم دمج كل شيء في جدول واحد منظم.

- تصدير جماعي وتحديثات فورية: صدّر بيانات الأخبار مباشرة إلى Excel أو Google Sheets أو Airtable أو Notion بنقرة واحدة. لا مزيد من ماراثونات النسخ واللصق أو معاناة ملفات CSV.

- استخراج مجدول: أنشئ مهام متكررة (كل ساعة أو يوميًا أو بفواصل مخصصة) للحفاظ على تدفق الأخبار جديدًا — وهو مثالي للأخبار العاجلة أو مراقبة السوق أو البحث المستمر.

- المرونة: يتكيف ذكاء Thunderbit مع تغيّرات التخطيط والمواقع الإخبارية طويلة الذيل، بحيث تقضي وقتًا أقل في إصلاح أدوات معطلة ووقتًا أكثر في تحليل البيانات.

ومع أكثر من وتقييم 4.8 نجوم، يثق به فريق العمل حول العالم في كل شيء من مراقبة العلاقات العامة إلى استخبارات المنافسين.

اكتشاف الحقول بالذكاء الاصطناعي واستخراج الصفحات الفرعية

إحدى أقوى ميزات Thunderbit هي اكتشاف الحقول المدعوم بالذكاء الاصطناعي. فقط انقر «اقتراح الحقول بالذكاء الاصطناعي»، وستفحص الأداة صفحة الأخبار وتتعرف على الحقول الرئيسية مثل العنوان والتاريخ والكاتب والملخص. يمكنك تعديل الحقول أو إضافة حقول مخصصة (مثل: «صنّف هذه المقالة على أنها أرباح إذا ذكرت النتائج الفصلية»)، وسيتولى ذكاء Thunderbit الباقي.

ويُعد استخراج الصفحات الفرعية نقطة تحول للأخبار: استخرج صفحة رئيسية أو قائمة قسم للحصول على العناوين، ثم دع Thunderbit يزور كل رابط مقال لاستخراج القصة الكاملة والكيانات وحتى الصور. بهذا تحصل على سجلات أخبار كاملة وغنية — جاهزة للبحث أو لوحات المعلومات أو التحليل اللاحق بالذكاء الاصطناعي.

التصدير الجماعي والتحديثات الفورية

يجعل Thunderbit تصدير بيانات الأخبار أمرًا سهلًا للغاية. بنقرة واحدة، يمكنك إرسال موجز الأخبار المنظم إلى Google Sheets أو Airtable أو Notion، أو تنزيله كملف CSV/Excel. وللفرق التي تعيش داخل الجداول أو أدوات ذكاء الأعمال، فهذا يوفر وقتًا هائلًا.

وبما أن Thunderbit يدعم الاستخراج المجدول، يمكنك ضبطه ليعمل كل ساعة أو كل يوم أو وفق جدولك المخصص — بما يضمن أن بيانات أخبارك محدثة دائمًا. لا مزيد من انتظار Google Alerts حتى يفهرس القصص بعد أيام.

التغلب على التحديات التشغيلية في حلول بيانات الأخبار اللحظية

حتى مع أفضل الأدوات، يأتي استخراج الأخبار اللحظي مع مجموعة من التحديات الخاصة به. إليك كيفية التعامل مع أكثرها شيوعًا:

إدارة التأخير وحداثة البيانات

- جدولة عمليات الاستخراج وفق سرعة الأخبار: للأخبار العاجلة، اجعل أدوات الاستخراج تعمل كل 15–30 دقيقة (متماشية مع ). أما للمتابعات الأبطأ، فقد تكفي المرة اليومية أو كل ساعة.

- مراقبة الفجوة بين وقت النشر ووقت الجلب: تتبّع الفرق بين وقت نشر المقال ووقت استلام نظامك له. إذا اتسعت الفجوة، فتحقق من الحظر أو البطء.

- إعادة الاستخراج للتعديلات الصامتة: غالبًا ما تُحدَّث مقالات الأخبار بعد النشر. جدولة استخراج ثانٍ بعد 24 ساعة لالتقاط التصحيحات أو التعديلات الخفية ().