ما زلت أذكر اليوم الذي سألني فيه أحدهم لأول مرة: "Shuai، هل يمكنك استخراج البيانات من هذا الموقع؟" في ذلك الوقت، كان web scraping شغلة متخصصة ما يعرفها إلا عدد قليل من المطوّرين—وكان Python وBeautifulSoup تقريبًا كل ما تحتاجه. أمّا اليوم، فقد صار سوق web scraping الحر ، ومن المتوقع أن يتضاعف مرة ثانية بحلول 2030. فرص العمل عن بُعد مزدهرة، والعملاء ما عادوا يطلبون فقط "سكريبت يشتغل"—بل يدورون على حلول أعمال جاهزة للاستخدام (وملف CSV لو سمحت!) وبأسرع وقت ممكن.

والحقيقة أن دور مطوّر web scraping المستقل تغيّر بشكل جذري. ما عاد الموضوع مجرد كتابة كود. اليوم يتوقع منك تمسك العملية من أولها لآخرها: من فهم المتطلبات واستخراج البيانات، إلى تنظيفها وتسليمها بالشكل الصحيح، وحتى التعامل مع المخاطر القانونية. ومع أدوات مثل التي ترفع مستوى السرعة والجودة، تصير التوقعات أعلى وأشد. سواء كنت محترفًا متمرسًا أو لسه بادئ، خلنا نفصّل ما تحتاجه عشان تنجح في هذا العصر الجديد. سأشاركك خبرة عملية، ونصائح قابلة للتطبيق، وكيف يمكن أن تكون Thunderbit سلاحك السري.

ماذا يفعل مطوّر Web Scraping المستقل اليوم فعلًا؟

بصراحة: مطوّر web scraping المستقل في 2025 ما له أي شبه بنظيره قبل خمس سنوات. زمان، كان تسليم سكريبت Python يكفي. أمّا الآن، فالمطلوب منك تدير خط الإنتاج كامل—من أول مكالمة Zoom إلى تسليم النتيجة النهائية عبر Google Sheets.

ليش هذا التغيير؟ لأن الطلب على web scraping انفجر بشكل كبير جدًا. سوق رايح يوصل إلى 2.5 مليار دولار بحلول 2032، و تستخدمه أصلًا في الذكاء الاصطناعي والتحليلات. التجارة الإلكترونية، والعقارات، والتمويل—كل قطاع يبي البيانات، و منتشر بقوة في Upwork وFreelancer. لكن المنافسة بعد كذا صارت أقوى أيضًا.

اللي يتوقعه العملاء الآن يتجاوز بكثير مجرد "الكود":

- فهم أهداف العمل (مو بس بنية HTML—ليش هم أصلًا يحتاجون هذي البيانات؟)

- تواصل واضح (جملة "يشتغل عندي" ما عادت تكفي)

- تسليم بيانات نظيفة وجاهزة للاستخدام

- الالتزام القانوني وإدارة المخاطر

- دعم مستمر

باختصار، لازم تكون مهندسًا، ومستشارًا، ومدير مشروع، ومهندس بيانات في شخص واحد. المستقلون اللي يقدّمون هذه القيمة "الكاملة" هم اللي يحصلون على شغل متكرر وأسعار أعلى.

المهارات التي تحتاجها في وظائف Web Scraping: Python وحده لا يكفي

Python وBeautifulSoup وPlaywright هي الأساسيات. لكن إذا أردت تفوز بمشاريع عن بُعد وعلى مستوى عالمي، فستحتاج مجموعة مهارات أوسع.

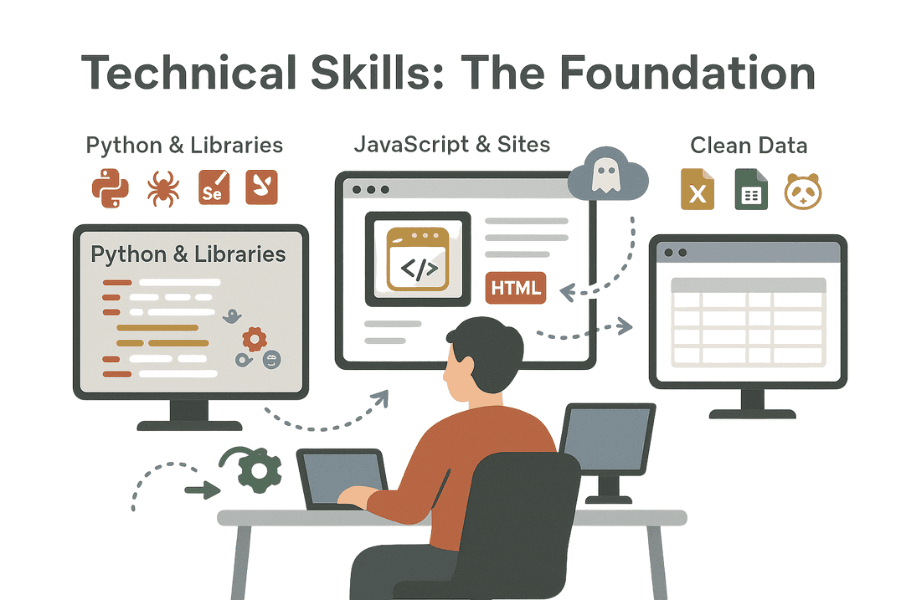

المهارات التقنية: الأساس

- Python والمكتبات: يعتمدون على Python، مع BeautifulSoup وScrapy وSelenium وPlaywright كأدوات أساسية.

- JavaScript والمواقع الديناميكية: المواقع الحديثة تعتمد كثيرًا على JavaScript في العرض الديناميكي، لذلك المتصفحات بدون واجهة والتعامل مع المحتوى الديناميكي صاروا ضروريين.

- API والأتمتة: معرفة التعامل مع واجهات Web Scraper APIs وأطر الأتمتة تعطيك أفضلية واضحة.

- تنظيف البيانات: قدرتك على تسليم بيانات مرتبة ومصقولة باستخدام Pandas أو Excel أو Google Sheets أهم مما تتخيل.

عوامل التميّز الجديدة

هنا الأشياء اللي كثير من المستقلين يغفلون عنها:

- التواصل: هل تقدر تشرح المفاهيم التقنية بوضوح؟ وهل تقدر تضبط المتطلبات بدقة في اجتماع البداية؟ هذا اللي يحوّل المشاريع المؤقتة إلى عقود طويلة الأمد.

- إدارة المشاريع: الالتزام بالمواعيد والتعامل بمرونة مع تغييرات النطاق—الاعتمادية تنلاحظ وتنقدر.

- تعدد الأدوات: إلى جانب الكود، هل تقدر تستفيد من أدوات no-code مثل وواجهات web scraper APIs عشان تشتغل أسرع؟

- الامتثال القانوني والأخلاقي: تعطي أولوية للاستخراج الأخلاقي. معرفة GDPR وrobots.txt مو خيار، بل ضرورة.

لماذا Thunderbit وأدوات مشابهة مهمة؟

استخدام أدوات مدعومة بالذكاء الاصطناعي مثل Thunderbit يغيّر اللعبة في الإنتاجية. ما عاد فيه داعي لساعات طويلة في كتابة selectors أو إصلاح مشاكل pagination.

- جرّب المتطلبات الأولية خلال دقائق

- تعامل بسهولة مع العملاء غير التقنيين

- ركّز على تقديم القيمة—وخُذ مشاريع أكثر

مطور web scraping المستقل المثالي اليوم هو مزيج: جزء مهندس، جزء مستشار، وجزء شريك أعمال.

Thunderbit: السلاح السري لمطوّر Web Scraping المستقل

لقد أمضيت سنوات في بناء SaaS وأدوات الأتمتة، وجعل الأشياء أبسط وأسرع هو شغلي الحقيقي. ولهذا السبب بالضبط أنشأت —عشان أشيل الأجزاء المتعبة من web scraping، خصوصًا للمستقلين.

Thunderbit هو تنقلك من "أحتاج هذه البيانات" إلى "تفضل جدولك" ببضع نقرات فقط. ما فيه حاجة لضبط selectors، ولا صداع debugging. وإليك كيف يساعد مطوري العمل الحر على التسليم أسرع وبجودة أعلى.

ميزات Thunderbit المدعومة بالذكاء الاصطناعي مصممة عشان تساعدك تسلم بيانات جاهزة للأعمال بسرعة.

AI Suggest Fields: لا مزيد من التخمين في اختيار الحقول

أنت تعرف الروتين: تفتح HTML، وتخمّن CSS selectors، وتتمنى الموقع ما يغيّر تصميمه. ميزة AI Suggest Fields في Thunderbit تغيّر كل هذا. بنقرة واحدة، يحلل الذكاء الاصطناعي الصفحة، ويقترح أفضل الأعمدة اللي تستخرجها، ويولّد prompts مخصصة لكل حقل.

- السرعة: اللي كان ياخذ ساعة صار ياخذ دقائق

- الدقة: الذكاء الاصطناعي يلقط حقول ممكن تفوتك، وهذا يقلل فجوات البيانات

- العروض التوضيحية للعملاء: اعرض استخراجًا تجريبيًا فورًا عشان تبني الثقة من البداية

هذه الميزة وحدها تقدر تخفّض وقت الإعداد بشكل كبير. كأن عندك مساعد شغال 24/7 وما ينام.

Subpage & Cloud Scraping: التعامل مع المشاريع المعقدة بسهولة

المشاريع الحقيقية نادرًا ما تكون "استخرج هذا الجدول فقط".

- التنقل إلى الصفحات الفرعية (تفاصيل المنتجات، الملفات الشخصية للمستخدمين)

- التعامل مع pagination (التمرير اللانهائي، أزرار "التالي")

- عمليات استخراج واسعة النطاق عبر مئات أو آلاف الصفحات

تخليك Subpage Scraping في Thunderbit تخلي الذكاء الاصطناعي يزور كل صفحة فرعية تلقائيًا ويسحب التفاصيل الإضافية—من دون الحاجة إلى crawler مخصص.

ومع Cloud Scraping، تقدر تجلب ما يصل إلى 50 صفحة بالتوازي من جهة الخادم.

- تسليم أسرع: أنجز المشاريع الكبيرة في ساعة واحدة أحيانًا

- بدون تدخل كبير: البروكسيات، وحدود المعدل، وإعادة المحاولة تُدار تلقائيًا

- Browser Mode: للمواقع اللي تتطلب تسجيل دخول أو فيها بيانات حساسة، تقدر تسحب البيانات بأمان باستخدام جلسة المتصفح الخاصة بالعميل

القوالب والتصدير والمزيد

- قوالب بنقرة واحدة: مواقع مشهورة مثل Amazon وZillow وInstagram وShopify عندها قوالب جاهزة—طبّقها وابدأ مباشرة

- تصدير بيانات مجاني: حمّل بصيغة CSV أو صدّر مباشرة إلى Google Sheets أو Excel أو Airtable أو Notion—من دون رسوم إضافية

- Scheduled Scrapers: اضبط تشغيلات متكررة (يومية أو أسبوعية) وحوّل المشاريع المؤقتة إلى دخل اشتراك

يدعم Thunderbit ، لذلك تقدر تمسك مشاريع عالمية بثقة من طوكيو إلى ساو باولو.

استراتيجيات عالمية للحصول على فرص Web Scraping عن بُعد

ليت أحد قال لي هذا من بدري: العالم كله هو عميلك المحتمل. فرص web scraping عن بُعد مو محصورة في أمريكا وبريطانيا—أسواق النمو تمتد أيضًا إلى آسيا والمحيط الهادئ وأمريكا اللاتينية. سوق العمل الحر يكبر باستمرار، مع ، ونمو من رقمين في دول مثل جنوب أفريقيا وكندا.

كيف تستفيد من الطلب العالمي

- استفد من تعدد اللغات: مع دعم Thunderbit لـ 34 لغة، تقدر تتقدم بثقة لمشاريع استخراج بيانات عقارية ألمانية، أو scraping لمواقع التجارة الإلكترونية اليابانية، أو استخراج بيانات وسائل التواصل في البرازيل.

- تميّز على المنصات: أبرز قدراتك في التسليم متعدد اللغات ومتعدد الصيغ على Upwork وFreelancer ولوحات الوظائف المتخصصة.

- اعرض خبرتك الدولية: إذا سبق لك استخراج بيانات من مواقع بلغات أجنبية، حط هذا في الواجهة داخل ملفك الشخصي. دراسات الحالة المرتبطة تعطيك مصداقية مباشرة.

كيف تبرز عن الآخرين

- سرعة الاستجابة: حتى مع اختلاف المناطق الزمنية، توضيح مدى توافرك بوضوح يفرق كثيرًا.

- عينات تسليم سريعة: استخدم Thunderbit لإنشاء بيانات نموذجية من الموقع المستهدف فورًا—وهذا يبني الثقة ويرفع نسبة الفوز.

- أبرز الالتزام: كثير من العملاء يقلقون من المخاطر القانونية. خلّ نهجك الأخلاقي والمتوافق مع الأنظمة نقطة بيع واضحة.

في عصر العمل عن بُعد، الجغرافيا ما عادت عائق. ومع الأدوات والاستراتيجية المناسبة، تقدر تفوز بعملاء من Silicon Valley إلى Shanghai.

التسعير والتسليم: كيف تعظّم دخلك كمطوّر Web Scraping مستقل

خلنا نتكلم عن المال. تسعير مشاريع web scraping ممكن يكون معقّد، لكن الطريقة الصح تقدر ترفع دخلك ورضا العميل معًا.

نماذج التسعير الشائعة

- بالساعة: غالبًا تتراوح الأسعار بين بحسب مستوى التعقيد والخبرة.

- بسعر ثابت للمشروع: رسوم محددة مقابل المخرجات. العملاء يحبون وضوح التكلفة.

- حسب القيمة: التسعير بناءً على القيمة اللي تقدمها البيانات (مثل أتمتة 50 ساعة من العمل اليدوي أو دعم نمو الإيرادات).

كيف ترفع Thunderbit قوتك التسعيرية

مع Thunderbit، تحصل على أفضلية في السرعة والجودة معًا:

- تسليم أسرع: مشاريع كانت تأخذ أيام صارت تأخذ ساعات

- أخطاء أقل: debugging أقل يعني إعادة عمل أقل

- فرص خدمة متكررة: اضبط scraping مجدول وقدم اشتراكات شهرية (مثل 200 دولار/شهريًا)

العملاء مستعدون يدفعون أكثر مقابل السرعة والاعتمادية والدعم المستمر. لا تحدد سعرك على أساس الساعات—حدده على أساس القيمة اللي تقدمها.

كيف توضح القيمة

- ابدأ بعائد الاستثمار: اشرح كيف تساعد البيانات في زيادة الإيرادات أو توفير الوقت أو تقليل المخاطر للعميل

- كن واضحًا: حدّد بوضوح الإعداد والصيانة والتحديثات وكيف ستتعامل مع تغييرات الموقع

- قدّم مستويات خدمة: أساسي (مرة واحدة)، قياسي (مع التنظيف والتحليل)، مميز (تحديثات متكررة ودعم أولوية)

تذكّر: العملاء ما يدفعون مقابل الكود. هم يدفعون مقابل النتائج.

الامتثال للبيانات وإدارة المخاطر: بناء الثقة والعلاقات طويلة الأمد

إليك الحقيقة المزعجة: خطأ واحد في الامتثال ممكن ينهي العلاقة مع العميل فورًا. ومع قلق بشأن قانونية جمع البيانات، تصبح إدارة المخاطر ضرورة وليست خيارًا.

أفضل الممارسات

- احترم شروط الاستخدام: راجع دائمًا شروط الموقع المستهدف. وإذا شكّيت، استشر العميل أو اطلب إذنًا.

- التزم بقوانين حماية البيانات: مثل GDPR وCCPA وغيرها—اكتفِ بالبيانات العامة غير الحساسة. لا تتعامل مع البيانات الشخصية من دون موافقة.

- استخدم scraping عبر المتصفح: يتيح لك Browser Mode في Thunderbit استخراج البيانات بشكل أخلاقي باستخدام جلسة تسجيل الدخول الخاصة بالعميل.

- انتبه لحدود المعدل: لا تغرق الخوادم بالطلبات. Cloud Mode في Thunderbit يتولى هذا تلقائيًا، لكن راقب دائمًا.

كيف تتحدث عن الامتثال

إضافة جملة بسيطة إلى عروضك تحدث فرقًا كبيرًا:

"تتم جميع عمليات جمع البيانات وفق قوانين الخصوصية وسياسات المواقع ذات الصلة. نستخدم فقط المعلومات المتاحة للعامة. وعند الحاجة إلى تسجيل الدخول، نعتمد على وصول العميل المصرح به لاستخراج أخلاقي للبيانات."

هذه الفقرة وحدها تخليك تظهر كمهني حقيقي، مو مجرد كاتب كود.

من المشاريع لمرة واحدة إلى دخل اشتراك: أتمتة نجاح العميل

إذا أردت دخلًا ثابتًا، فالمفتاح هو تحويل المشاريع المؤقتة إلى خدمات متكررة.

كيف تفعل ذلك

- Scheduled scrapers: استخدم جدولة Thunderbit لتشغيلات يومية أو أسبوعية أو شهرية

- مخرجات منتظمة: اقترح مراقبة أسعار أسبوعية، أو تحليلات يومية لوسائل التواصل، أو تقارير سوق شهرية

- نموذج الاحتفاظ المستمر: خذ رسوم إعداد أولية مع رسوم صيانة شهرية. كثير من العملاء ما يمانعون دفع 100–400 دولار شهريًا مقابل تسليم بيانات مستمر.

مثال حقيقي

حوّل أحد المستقلين مشروع استخراج أسعار التجارة الإلكترونية اليومية إلى لوحة تحكم تتحدّث تلقائيًا بعقد شهري. ومع تولي Thunderbit للأتمتة، صار الجهد اليومي بسيطًا—لكن الدخل ثابت.

نصيحة احترافية

بعد كل تسليم لمرة واحدة، اعرض دائمًا خدمة متكررة. كثير من العملاء أصلًا ما فكروا بمدى قيمة البيانات المستمرة.

بناء علامتك الشخصية: كيف تبرز في سوق Web Scraping الحر

في سوق مزدحم بالمستقلين، علامتك الشخصية هي اللي تخليك عالق في الذاكرة. إليك كيف تبني حضورًا قويًا لفرص العمل عن بُعد والعالمية.

خطوات عملية

- صقل ملفك الشخصي: على Upwork وLinkedIn وموقعك الشخصي، أبرز المهارات التقنية والأثر التجاري معًا

- اعرض نتائجك: انشر دراسات حالة، وشهادات العملاء، وبيانات نموذجية. واذكر الأثر بالأرقام—إيرادات تحققت، وساعات تم توفيرها

- أنشئ محتوى: اكتب عن تحديات web scraping، والامتثال، وقصص النجاح على مدونتك أو LinkedIn (وهذه المقالة مثال على ذلك!)

- تفاعل مع المجتمعات: أجب عن الأسئلة في Reddit ومجموعات LinkedIn ومنتديات web scraping. والمساهمات مفتوحة المصدر مفيدة أيضًا

- أبرز مهارات التقنية والأعمال معًا: العملاء يريدون شريكًا، لا مجرد مزود خدمة. أظهر أنك تفهم أهدافهم وتقدر تسلّم بيانات قابلة للتنفيذ

هذه الصناعة ما توقف عن التطور. استمر في تعلم أدوات جديدة مثل Thunderbit، وابقَ على اطلاع على التغييرات القانونية، وجرّب تقنيات جديدة—بهالطريقة تبقى في المقدمة.

الخلاصة: خارطة طريقك للنجاح كمستقل في Web Scraping

سوق web scraping الحر ينمو بسرعة، لكن التوقعات تنمو معه أيضًا. هذه هي خطة العمل:

- قدّم قيمة متكاملة: كن محلًّا للمشكلات، لا مجرد مبرمج

- وسّع مهاراتك: أتقن الأدوات التقليدية (Python وAPIs) والمنصات الحديثة المدعومة بالذكاء الاصطناعي (مثل Thunderbit)

- اجعل الامتثال أولوية: ابنِ الثقة عبر ممارسات أخلاقية وواضحة

- انتقل إلى الخدمات المتكررة: أتمت وسوّق لخدمات بيانات بنظام الاشتراك

- ابنِ علامتك: استثمر في حضورك الرقمي، ومحفظة أعمالك، والتعلم المستمر

المستقلون اللي يسوّون كذا ما ينجون فقط—بل يحصلون على عملاء أفضل، وأسعار أعلى، ويبنون أعمالًا تدوم.

سواء كنت لسه بادئ أو تبغى ترفع مستواك، تذكر هذا: النجاح في web scraping الحر ما يتعلق فقط باستخراج البيانات—بل باستخراج الفرص. استمر في التعلم، واستمر في التكيّف، واستمر في تقديم القيمة. وسيتبعك العملاء والنجاح.

هل أنت مستعد لتسريع مسيرتك في web scraping الحر؟

جرّب مجانًا، وتصفّح ، واستكشف لمزيد من النصائح والأدلة.

وإذا لقيت نفسك يومًا تصلح selectors عند الثانية صباحًا... فتذكر بس أن الذكاء الاصطناعي صار الآن في صفك (أو على الأقل، اشرب قهوة).

قراءات موصى بها:

إليك الفوز الكبير القادم. أتمنى أن تبقى بياناتك نظيفة دائمًا، وعملاؤك راضين، وسكربتاتك قادرة على الصمود أمام أي إعادة تصميم للموقع!

الأسئلة الشائعة

1. ما المهارات التي يحتاجها مطوّر web scraping مستقل حديث؟

إلى جانب Python وBeautifulSoup، ستحتاج إلى مكتبات مثل Scrapy وSelenium وPlaywright، بالإضافة إلى القدرة على التعامل مع المواقع المعتمدة بكثافة على JavaScript، والعمل مع APIs، وتنظيف البيانات باستخدام Pandas أو Excel. كما أن التواصل، وإدارة المشاريع، ومعرفة الامتثال القانوني لا تقل أهمية. وإتقان أدوات no-code/AI مثل Thunderbit يمنحك أفضلية تنافسية كبيرة.

2. كيف تغيّر دور مطوّر web scraping المستقل في السنوات الأخيرة؟

تطور من تسليم سكريبتات بسيطة إلى حلول شاملة من البداية للنهاية: فهم أهداف العمل، وتسليم بيانات نظيفة، وضمان الامتثال القانوني، وتقديم دعم مستمر. كما أصبح المستقلون اليوم مستشارين ومديري مشاريع أيضًا.

3. ما هو Thunderbit وكيف يساعد مطوّري web scraping المستقلين؟

Thunderbit هو إضافة Chrome مدعومة بالذكاء الاصطناعي لاستخراج البيانات من الويب. يوفّر اقتراحات ذكية للحقول، واستخراجًا من الصفحات الفرعية والسحابة، وقوالب جاهزة للمواقع الشائعة، ودعمًا متعدد اللغات. من النماذج الأولية السريعة إلى المشاريع المعقدة والأتمتة المجدولة، يساعد المستقلين على إنجاز المزيد من العمل بكفاءة أعلى.

4. كيف يمكن للمستقلين تعظيم الدخل من مشاريع web scraping؟

استخدم مزيجًا من نماذج التسعير—بالساعة، أو بسعر المشروع، أو حسب القيمة. أدوات مثل Thunderbit تساعدك على التسليم أسرع وبأخطاء أقل. قدّم خدمات scraping متكررة وتسليم بيانات قائمًا على الاشتراك. ووضح العائد على الاستثمار وقدم باقات خدمة متدرجة لزيادة هامش الربح.

5. ما أفضل الممارسات للامتثال وإدارة المخاطر في web scraping؟

راجع دائمًا شروط استخدام الموقع المستهدف والتزم بقوانين حماية البيانات مثل GDPR وCCPA. استخرج فقط البيانات العامة غير الحساسة ما لم تحصل على موافقة صريحة. استخدم Browser Mode في Thunderbit للوصول المصرح به والأخلاقي. واحترم حدود المعدل، ووضح نهجك في الامتثال للعملاء بشكل صريح.