سأكون صريحًا: عندما حاولتُ لأول مرة استخراج كل عنوان URL من موقع كبير، ظننتُ: «ما مدى صعوبة هذا؟» وبعد بضع ساعات، كنتُ لا أزال أتصفّح صفحات لا تنتهي، وأنسخ الروابط وألصقها في جدول بيانات، وأعيد التفكير في اختياراتي الحياتية. إذا سبق لك أن حاولت العثور على كل الصفحات في موقع إلكتروني — سواءً لتدقيق المحتوى، أو إعداد قائمة عملاء محتملين، أو إجراء بحث تنافسي — فأنت تعرف حجم المعاناة. إنه عمل ممل، ومعرّض للأخطاء، وبصراحة إهدار لوقتك ومهارتك.

لكن الخبر السار هو: لم تعد مضطرًا إلى القيام بذلك بالطريقة الشاقة. الأدوات المدعومة بالذكاء الاصطناعي مثل تغيّر قواعد اللعبة لمستخدمي الأعمال، إذ تجعل من الممكن العثور على كل عناوين URL على نطاق معيّن في دقائق بدلًا من أيام. في الواقع، تشير الشركات التي تستخدم أدوات استخراج الويب المعتمدة على الذكاء الاصطناعي إلى في مهام جمع البيانات، وبعضها يرى ما يصل إلى مقارنة بالأساليب اليدوية. هذه ليست مجرد إحصائية — إنها ساعات، بل أيام، تستعيدها من حياتك.

لذا، دعنا نتعمّق في سبب صعوبة العثور على كل الصفحات في موقع إلكتروني، ولماذا لا تستطيع نماذج الذكاء الاصطناعي العامة مثل GPT أو Claude مساعدتك فعليًا، وكيف تجعل الوكلاء المتخصصون بالذكاء الاصطناعي — مثل Thunderbit — هذه العملية سهلة للغاية. ونعم، سأرشدك إلى الخطوات الدقيقة لاستخراج كل عنوان URL تحتاج إليه، حتى لو لم تكن مبرمجًا.

لماذا يُعد العثور على كل عناوين URL على نطاقٍ معيّن أمرًا صعبًا إلى هذا الحد؟

لنواجه الحقيقة: لم تُصمَّم المواقع الإلكترونية لتسلّمك قائمة مرتبة بكل صفحة تحتويها. فهي بُنيت للزوار، لا للأشخاص الذين يحاولون العثور على كل الصفحات في موقع إلكتروني دفعة واحدة. إليك أسباب هذه الصعوبة:

- هوس النسخ واللصق اليدوي: التنقل بين كل قائمة وأخرى ودليلٍ وآخر، ونسخ عناوين URL واحدًا تلو الآخر، وصفة مؤكدة لإجهاد المعصم (وأيضًا لتفويت نصف الصفحات).

- تعدد الصفحات والتمرير اللانهائي: كثير من المواقع تقسم المحتوى على صفحات متعددة أو تحمل المزيد من النتائج أثناء التمرير. إذا فاتك زر «التالي» أو لم تتمرر بما يكفي، ستفوتك أقسام كاملة.

- بُنى الصفحات غير المتسقة: بعض الصفحات تعرض الروابط بصيغة، وأخرى تستخدم تخطيطًا مختلفًا. متابعة كل ذلك تتحول إلى كابوس.

- الصفحات المخفية أو اليتيمة: ليست كل صفحة مرتبطة من التنقل الرئيسي. فبعضها مدفون في العمق، ولا يمكن الوصول إليه إلا عبر خرائط الموقع أو البحث الداخلي.

- الخطأ البشري: كلما زاد عدد الصفحات التي عليك نسخها، زادت احتمالية الوقوع في أخطاء — عناوين URL مكررة، أخطاء إملائية، أو ببساطة تجاهل عنصر ما.

وإذا كنت تعمل على موقع يضم مئات أو آلاف الصفحات؟ انسَ الأمر. الاستخراج اليدوي لا يتوسع بهذه الطريقة. وكما قال أحد فرق البيانات: ما يتجاوز الحالات البسيطة، .

ماذا يعني «العثور على كل الصفحات في موقع إلكتروني»؟

قبل أن ننتقل إلى الحلول، دعنا نوضح تمامًا ما الذي نبحث عنه.

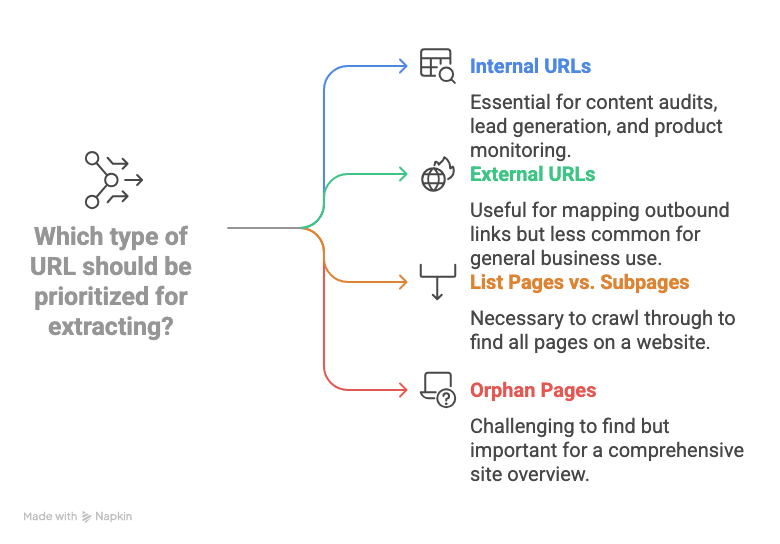

- عناوين URL الداخلية: هي الروابط التي تشير إلى صفحات على النطاق نفسه (مثل /about-us أو /products/widget-123). في معظم حالات الاستخدام التجارية — تدقيق المحتوى، توليد العملاء المحتملين، مراقبة المنتجات — تكون عناوين URL الداخلية هي الهدف الأساسي.

- عناوين URL الخارجية: روابط تؤدي إلى مواقع أخرى. عادةً لا تحتاجها إلا إذا كنت ترسم خريطة للروابط الخارجية.

- صفحات القوائم مقابل الصفحات الفرعية: لدى كثير من المواقع صفحات «مركزية» أو «قائمة» (مثل صفحات الفئات، وأرشيف المدونات، والأدلة) ترتبط بصفحات تفصيلية (مثل صفحات المنتجات أو الملفات الشخصية). لكي تعثر فعلًا على كل الصفحات في موقع إلكتروني، عليك الزحف عبر هذه القوائم وجمع كل صفحة فرعية ترتبط بها.

- الصفحات اليتيمة: وهي صفحات لا ترتبط بها أي صفحة واضحة. أحيانًا يمكنك التقاطها عبر خرائط الموقع أو البحث الداخلي، لكنها سهلة الفوت.

لذا، عندما نتحدث عن العثور على كل عناوين URL على نطاق معيّن، فنحن نعني: الحصول على كل عنوان URL لصفحة داخلية، من الصفحة الرئيسية إلى أعمق صفحة منتج أو مقال، ويفضل أن يكون ذلك بصيغة يمكنك استخدامها مباشرة، مثل جدول بيانات.

الطرق التقليدية للعثور على كل عناوين URL على نطاق معيّن

هناك بعض الطرق القديمة للتعامل مع هذا، لكن لكل منها مجموعة خاصة من المتاعب:

النسخ واللصق اليدوي وأدوات المتصفح

هذا هو الأسلوب «القوي»؛ تنقر على كل رابط، تنسخ كل عنوان URL، تلصقه في جدول بيانات، وتأمل ألا يفوتك شيء. يستخدم بعض الأشخاص إضافات متصفح لجلب كل الروابط من الصفحة الحالية، لكنك لا تزال مضطرًا لتكرار ذلك لكل صفحة، وستكون وحدك في التعامل مع التعدد الصفحي أو الأقسام المخفية. هذا مقبول لموقع من خمس صفحات — لكنه لا يصلح لما هو أكبر من ذلك.

استخدام بحث الموقع وخرائط الموقع

- بحث Google بصيغة site: اكتب site:yourdomain.com في Google، وسترى عددًا من الصفحات المفهرسة. لكن Google يعرض فقط ما فهرسه (وغالبًا ما يكون العدد محدودًا بحوالي 1000 نتيجة)، لذا ستفوتك الصفحات الجديدة أو المخفية أو منخفضة الجودة. وتقر بأن هذا ليس حلًا كاملًا.

- خرائط موقع XML: لدى كثير من المواقع ملف /sitemap.xml يسرد عناوين URL المهمة. رائع — إذا كانت خريطة الموقع محدثة وتضم كل صفحة. لكن ليس كل المواقع تملك واحدة، وبعضها يقسم خرائطه إلى عدة ملفات. وغالبًا ما لا تدخل الصفحات اليتيمة ضمنها.

أدوات الزحف التقنية والسكريبتات

- أدوات تحسين محركات البحث (مثل Screaming Frog): هذه تزحف في الموقع مثل محرك بحث وتخرج قائمة بعناوين URL. إنها قوية، لكنها تحتاج إلى إعداد وضبط، وأحيانًا إلى ترخيص مدفوع للمواقع الكبيرة.

- سكريبتات Python (مثل Scrapy): يمكن للمطورين كتابة سكريبتات للزحف واستخراج عناوين URL. لكن لنكن واقعيين: إذا لم تكن مرتاحًا للتعامل مع الكود، فهذا خيار غير عملي من الأساس. إضافةً إلى ذلك، تتعطل السكريبتات عندما يتغير تخطيط الموقع، فتجد نفسك دائمًا في سباقٍ للحاق بالتغييرات.

الخلاصة: الطرق التقليدية إما يدوية أكثر من اللازم، أو غير مكتملة، أو تقنية أكثر من اللازم لمعظم مستخدمي الأعمال. ولهذا السبب يتوقف كثير من الناس في منتصف الطريق.

لماذا لا تستطيع نماذج الذكاء الاصطناعي العامة أتمتة استخراج عناوين URL بالكامل

قد تفكر: «ألا يمكنني فقط أن أطلب من ChatGPT أو Claude أن يجد لي كل الصفحات في موقع إلكتروني؟» أتمنى لو كان الأمر بهذه السهولة. لكن الواقع مختلف:

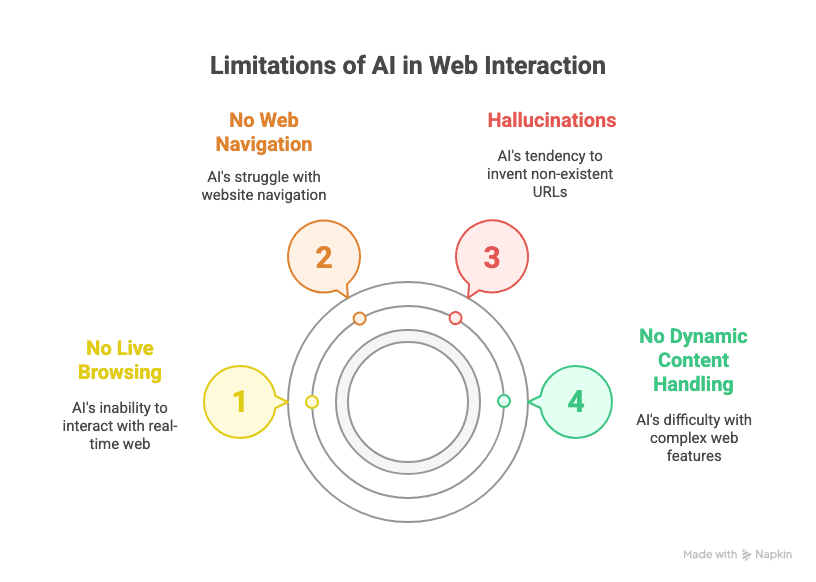

- لا يوجد تصفح مباشر: النماذج العامة مثل GPT أو Claude لا تستطيع فعليًا تصفح الويب في الوقت الحقيقي. فهي لا «ترى» الحالة الحالية للموقع — بل تعمل فقط اعتمادًا على بيانات التدريب أو ما تلصقه لها.

- لا توجد قدرة على التنقل في الويب: حتى مع الإضافات أو تفعيل التصفح، لا تعرف نماذج اللغة الكبيرة كيف تنقر على «التالي»، أو تتعامل مع التمرير اللانهائي، أو تتبع كل رابط في الموقع بطريقة منهجية.

- الهلوسة: إذا طلبت من ذكاء اصطناعي عام كل عناوين URL على نطاق معيّن، فغالبًا ما يخترع روابط تبدو معقولة لكنها غير موجودة أصلًا. (رأيتُه يخترع صفحات /about-us لمواقع لم تكن تملكها قط.)

- عدم التعامل مع المحتوى الديناميكي: المواقع التي تحمل المحتوى عبر JavaScript، أو تتطلب تسجيل الدخول، أو تستخدم تنقلًا معقدًا، تكون خارج متناول نماذج اللغة العامة.

وكما يذكر فإن: «إذا كنت تريد استخراج مئات أو آلاف الصفحات… فإن ChatGPT وحده لا يكفي». أنت تحتاج إلى أداة مصممة خصيصًا للمهمة.

الوكلاء العموديون للذكاء الاصطناعي هم المستقبل (ولماذا يهم هذا)

هنا يأتي دوري في عالم SaaS والأتمتة: الوكلاء العموديون للذكاء الاصطناعي — أي أدوات ذكاء اصطناعي مبنية لمجال محدد، مثل استخراج بيانات الويب — هي الطريقة الوحيدة للحصول على نتائج موثوقة وقابلة للتوسع في مهام الأعمال. لماذا؟

- نماذج اللغة العامة ممتازة للكتابة أو البحث، لكنها عرضة لـ«الهلوسة» ولا تستطيع التعامل مع سير عمل متعدد الخطوات وقابل للتكرار بالثبات الذي تحتاجه الشركات.

- أدوات SaaS المؤسسية تحتاج إلى أتمتة الكثير من المهام المتكررة والمنظمة. وهنا تتألق الوكلاء العموديون للذكاء الاصطناعي — فهي مبنية لتفعل شيئًا واحدًا، وتفعله جيدًا، مع أقل قدر من الأخطاء.

- الأمثلة كثيرة عبر الصناعات: Thunderbit لاستخراج بيانات الويب، وDevin AI لتطوير البرمجيات، وAlta لأتمتة المبيعات، وIL VISTA من Infinity Learn للتعليم، وRippling للموارد البشرية، وHarvey للشؤون القانونية… والقائمة تطول.

باختصار: إذا كنت تريد العثور على كل الصفحات في موقع إلكتروني بشكل موثوق، فأنت تحتاج إلى وكيل ذكاء اصطناعي عمودي بُني لهذه المهمة — لا إلى شات بوت عام.

تعرّف على Thunderbit: استخراج عناوين URL بالذكاء الاصطناعي للجميع

هنا يأتي دور . بوصفه إضافة كروم لأداة استخراج الويب بالذكاء الاصطناعي، صُمم Thunderbit لمستخدمي الأعمال — بلا برمجة، بلا إعداد تقني، فقط نتائج. إليك ما يميّزه:

- واجهة بلغة طبيعية: فقط صف ما تريد («أدرج كل عناوين URL للصفحات في هذا الموقع»)، وسيستنتج ذكاء Thunderbit كيف يستخرجها.

- اقتراح الحقول بالذكاء الاصطناعي: يفحص Thunderbit الصفحة ويقترح تلقائيًا أسماء الأعمدة (مثل «عنوان URL للصفحة») — فلا حاجة للتعامل مع محددات CSS أو XPath.

- التعامل مع التعدد الصفحي والتمرير اللانهائي: يستطيع Thunderbit النقر على «التالي» أو التمرير تلقائيًا، حتى لا تفوتك أي صفحة.

- التنقل إلى الصفحات الفرعية: تحتاج إلى التعمق أكثر؟ يستطيع Thunderbit اتباع الروابط إلى الصفحات الفرعية واستخراج البيانات منها أيضًا.

- تصدير منظم: صدّر نتائجك مباشرة إلى Google Sheets أو Excel أو Notion أو Airtable أو CSV — مجانًا وبنقرة واحدة.

- لا حاجة إلى البرمجة: إذا كنت تستطيع تصفح موقع إلكتروني، يمكنك استخدام Thunderbit. بهذه البساطة.

ولأن Thunderbit وكيل ذكاء اصطناعي عمودي، فهو مبني على الاستقرار وقابلية التكرار — مثالي لمستخدمي الأعمال الذين يحتاجون إلى أتمتة المهام نفسها مرارًا وتكرارًا.

خطوة بخطوة: كيف تعثر على كل عناوين URL على نطاق معيّن باستخدام Thunderbit

هل أنت مستعد لترى كيف يعمل؟ إليك شرحًا غير تقني لاستخراج كل عنوان URL تحتاج إليه.

1. ثبّت إضافة Thunderbit على Chrome

أولًا وقبل كل شيء: . يعمل على Chrome وEdge وBrave وغيرها من متصفحات Chromium. ثبّته في شريط الأدوات لتسهيل الوصول إليه.

2. افتح صفحة القائمة أو الدليل المستهدفة

انتقل إلى الموقع الذي تريد استخراج عناوين URL منه. قد تكون الصفحة الرئيسية، أو خريطة موقع، أو دليلًا، أو أي صفحة قائمة تربط بالصفحات التي تهمك.

3. شغّل Thunderbit وأعد إعداد الحقول

انقر على أيقونة Thunderbit لفتح الإضافة. ابدأ قالب استخراج جديد. وهنا تبدأ السحر:

- انقر على «اقتراح الحقول بالذكاء الاصطناعي». سيقوم ذكاء Thunderbit بفحص الصفحة واقتراح الأعمدة — ابحث عن عمود بعنوان «عنوان URL للصفحة» أو «الرابط» أو ما شابه.

- إذا لم ترَ الحقل الدقيق الذي تريده، فأضف ببساطة عمودًا باسم «عنوان URL للصفحة» (أو أي اسم مناسب). تم تدريب ذكاء Thunderbit على التعرّف على هذه المصطلحات وربطها بالبيانات الصحيحة.

4. فعّل التعدد الصفحي أو التمرير إذا لزم الأمر

إذا كانت الصفحة المستهدفة تحتوي على عدة صفحات (مثل «الصفحة 1، 2، 3…» أو زر «تحميل المزيد»)، ففعّل التعدد الصفحي في Thunderbit:

- بدّل إلى وضع «النقر على التعدد الصفحي» للمواقع التي تحتوي على أزرار «التالي»، أو «التمرير اللانهائي» للمواقع التي تحمل المزيد أثناء التمرير.

- سيطلب منك Thunderbit تحديد زر «التالي» أو منطقة التمرير — فقط انقر عليها، وسيتولى الذكاء الاصطناعي الباقي.

5. ابدأ الاستخراج وراجع النتائج

اضغط على زر «استخراج». سيزحف Thunderbit عبر جميع الصفحات، جامعًا كل عنوان URL يجده. سترى النتائج تظهر في جدول داخل الإضافة مباشرة. في المواقع الكبيرة، قد يستغرق ذلك بضع دقائق، لكنه لا يزال أسرع بكثير من القيام به يدويًا.

6. صدّر قائمة عناوين URL الخاصة بك

بمجرد انتهاء الاستخراج، انقر على «تصدير». يمكنك إرسال بياناتك مباشرة إلى:

- Google Sheets

- Excel/CSV

- Notion

- Airtable

عمليات التصدير مجانية وتحافظ على كل التنسيق. لا مزيد من صداع النسخ واللصق.

مقارنة Thunderbit مع حلول استخراج عناوين URL الأخرى

| الطريقة | سهولة الاستخدام | الدقة والتغطية | قابلية التوسع | خيارات التصدير |

|---|---|---|---|---|

| النسخ واللصق اليدوي | مؤلم | منخفضة (من السهل الفوت) | لا شيء | يدوي (Excel، إلخ) |

| مستخرجات الروابط في المتصفح | جيد لصفحة واحدة | متوسطة | ضعيفة | يدوي |

بحث Google باستخدام site: | سهل | متوسطة (غير كاملة) | محدود بحوالي 1000 | يدوي |

| خريطة موقع XML | سهل (إن وجدت) | جيدة (إذا كانت محدثة) | جيدة | يدوي/سكريبت |

| أدوات تحسين محركات البحث (Screaming Frog) | تقني | عالية | عالية (مدفوعة) | CSV، Excel |

| سكريبتات Python (Scrapy، إلخ) | تقني جدًا | عالية | عالية | مخصص |

| Thunderbit | سهل جدًا | عالية جدًا | عالية | Google Sheets، CSV، إلخ |

يمنحك Thunderbit دقة وقدرة زحف احترافية مع سهولة استخدام إضافة متصفح. لا برمجة، لا إعداد، فقط نتائج.

ميزة إضافية: استخراج أكثر من مجرد عناوين URL باستخدام Thunderbit

وهنا يصبح الأمر أكثر إثارة للاهتمام. Thunderbit لا يقتصر على عناوين URL — يمكنك استخراج:

- العناوين

- رسائل البريد الإلكتروني

- أرقام الهواتف

- الصور

- أي بيانات منظمة على الصفحة

على سبيل المثال، إذا كنت تبني قائمة عملاء محتملين، يمكنك أن تجعل Thunderbit يجلب عنوان URL للملف الشخصي، والاسم، والبريد الإلكتروني، ورقم الهاتف من كل إدخال في الدليل — دفعة واحدة. وإذا كنت تُجري تدقيقًا للمنتجات، يمكنك سحب عنوان URL للمنتج، والاسم، والسعر، وحالة المخزون. بل يدعم Thunderbit أيضًا ، بحيث يمكنه النقر داخل كل رابط واستخراج التفاصيل من هناك.

ونعم، أدوات Thunderbit لاستخراج البريد الإلكتروني والهاتف مجانية تمامًا. وهذا أمر مهم جدًا لفرق المبيعات والتسويق.

الخلاصة: كيف تعثر على كل الصفحات في موقع إلكتروني باستخدام الذكاء الاصطناعي

دعنا نلخّص ما سبق:

- استخراج كل عناوين URL من نطاق معيّن صعب باستخدام الأدوات اليدوية أو العامة.

- نماذج الذكاء الاصطناعي العامة مثل GPT لا تستطيع التعامل مع التنقل في الويب، أو التعدد الصفحي، أو المحتوى الديناميكي.

- الوكلاء العموديون للذكاء الاصطناعي مثل Thunderbit مبنيون خصيصًا لاستخراج بيانات الويب — مستقرون، قابلون للتكرار، وسهلون لمستخدمي الأعمال.

- Thunderbit يجعل الأمر بسيطًا: ثبّت الإضافة، استخدم الذكاء الاصطناعي لاقتراح الحقول، فعّل التعدد الصفحي، ابدأ الاستخراج، ثم صدّر النتائج. لا برمجة، لا عناء.

- يمكنك استخراج أكثر من مجرد عناوين URL: العناوين، رسائل البريد الإلكتروني، أرقام الهواتف، والمزيد — مثالي لتوليد العملاء المحتملين، أو التدقيق، أو البحث.

إذا سئمت من النسخ واللصق أو من التعامل مع أدوات الزحف التقنية، . هناك خطة مجانية، لذا يمكنك أن ترى بنفسك مقدار الوقت (والراحة النفسية) الذي ستوفره.

وإذا كنت فضوليًا بشأن طرق أخرى يمكن أن يساعدك بها Thunderbit — مثل ، أو ، أو — فاطّلع على لمزيد من الأدلة والنصائح.

هل أنت مستعد لاستعادة وقتك من جمع البيانات يدويًا؟ مستقبل استخراج بيانات الويب هو الوكلاء العموديون للذكاء الاصطناعي — وThunderbit يقود الطريق. جرّبه، ودع تدقيقك أو قائمة العملاء المحتملين أو مشروع البحث التالي يكون الأسهل حتى الآن.

اقرأ المزيد

م.س. إذا وجدت نفسك يومًا ما تميل إلى نسخ 1000 عنوان URL ولصقها يدويًا، فتذكّر فقط: هناك الآن ذكاء اصطناعي لهذا. معصماك (ومديرك) سيشكرانك.