يُظهر بحث على GitHub عن "amazon scraper" ما يقارب . وإذا ضيّقت البحث إلى المستودعات التي تم الدفع إليها خلال الأشهر الستة الماضية، فسينخفض العدد إلى نحو — أي أقل بقليل من 20%. والبقية؟ شروحات مهجورة، وواجهات تغليف قديمة، وبرامج توقفت عن العمل في اللحظة التي شددت فيها أمازون دفاعاتها.

لقد قضيت وقتًا طويلًا في التعمق داخل مستودعات Amazon scraper، وقراءة مشكلات GitHub، ومتابعة النقاشات المجتمعية على Reddit وStack Overflow. النمط واضح: يجد شخص ما مستودعًا مشهورًا، يقضي ساعة في إعداده، يشغله مرة واحدة، ثم يصطدم بجدار من CAPTCHAs أو أخطاء 503. وضع أمازون لمكافحة الروبوتات في 2026 ليس كما كان قبل عامين فقط — فبصمة TLS، والتحليل السلوكي، والنشر العدواني لـ CAPTCHA جعلت خطة "بدّل user-agent وانتظر الأفضل" شبه عديمة الفائدة. يغطي هذا الدليل أفضل الممارسات التي تهم فعلًا إذا كنت تريد الحصول على بيانات موثوقة من أمازون عبر مستودع GitHub، وماذا تفعل عندما — وليس إذا — يتعطل السكريبر الخاص بك.

ما هو Amazon Scraper على GitHub ولماذا يفشل كثير منها؟

عادةً ما يكون مستودع Amazon scraper على GitHub برنامجًا مفتوح المصدر — غالبًا مبنيًا على Python أو Node.js أو Scrapy — لاستخراج بيانات منظمة من صفحات أمازون. والبيانات المستهدفة مألوفة: عنوان المنتج، والسعر، وASIN، والتقييمات، وعدد المراجعات، وتوفر المنتج، ومعلومات البائع، وبطاقات نتائج البحث، ونص المراجعات.

تكون البنية عادةً بسيطة:

- يجلب عميل HTTP أو متصفح بلا واجهة الصفحة.

- يستخرج محلل HTML أو JSON الحقول.

- تُحفَظ البيانات في CSV أو JSON أو قاعدة بيانات.

تنقسم المستودعات عادةً إلى أربع فئات:

- مكتبات Python خفيفة (مثل )

- عناكب Scrapy (مثل )

- أدوات أتمتة المتصفح عبر Selenium أو Playwright

- مشاريع واجهات برمجية مغلّفة تكون في الواقع واجهات أمامية لخدمة استخراج مدفوعة (مثل )

نمط الفشل يمكن التنبؤ به. معظم المستودعات تتعطل لأن:

- أمازون تغيّر تخطيط الصفحة أو مقاطع HTML

- أمازون تُرجع 503 أو CAPTCHA بدل المحتوى الحقيقي

- بصمة TLS وHTTP لا تبدو بعد الآن كمتصفح

- عدم تطابق الإقليم أو اللغة أو الترويسات يثير الشك

- يغادر المشرف على المشروع بعد حل حالة استخدامه الأصلية الضيقة

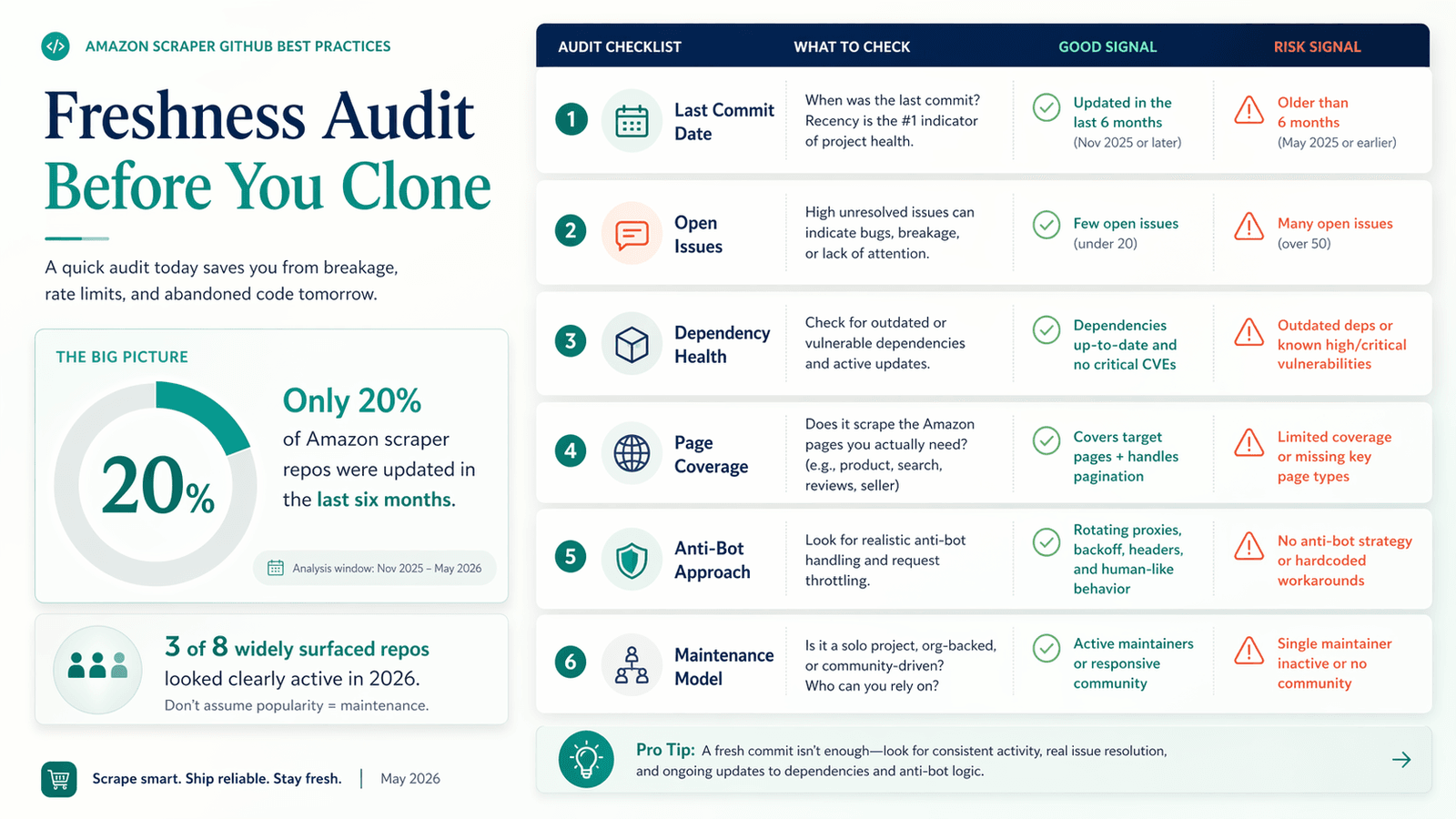

النجوم الكثيرة و"قابل للاستخدام حاليًا" شيئان مختلفان تمامًا. في المراجعة التي أجريتها لهذا المقال، بدا أن نحو ثلاثة فقط من أصل ثمانية مستودعات بارزة نشطة بوضوح في 2026.

أجرِ تدقيقًا حداثيًا لعام 2026 قبل أن تستنسخ أي مستودع Amazon Scraper على GitHub

هذه الخطوة أهم لأمازون من معظم الأهداف الأخرى. يتغير موقف أمازون الدفاعي أسرع من موقع تجارة إلكترونية نموذجي، لذا قد يصبح مستودع يعمل جيدًا على موقع تعريفي عديم الفائدة على أمازون خلال أسابيع قليلة. ومع ذلك، فإن معظم قوائم "best amazon scraper github" توصي بمستودعات من دون التحقق مما إذا كانت لا تزال تعمل. يضيّع المستخدمون ساعات في إعداد أدوات معطلة.

كيف تتحقق مما إذا كان مستودع GitHub لا يزال حيًا

قبل أن تشغل git clone لأي شيء، مرّ على هذه النقاط:

- تاريخ آخر commit: أي شيء أقدم من 6 أشهر يُعد إشارة تحذير قوية مع أمازون.

- المشكلات المفتوحة مقابل معدل الاستجابة: ابحث في تبويب Issues عن "captcha" و"503" و"blocked" و"not working". إذا تراكمت هذه البلاغات من دون ردود من المشرف، ابتعد.

- صحة التبعيات: افتح

requirements.txtأوpackage.json. المكتبات المهجورة (مثلrequestsقديمة من دون معالجة TLS الحديثة) تُعد علامة خطر. - تغطية أنواع صفحات أمازون: هل يتعامل المستودع مع صفحات المنتجات، ونتائج البحث، والمراجعات؟ أم مع نوع واحد فقط؟

- نهج مكافحة الروبوتات: الترويسات الثابتة من دون دعم بروكسي هي مقاربة من عصر 2023 لن تصمد حتى 2026.

قائمة تدقيق حداثة Amazon Scraper على GitHub

| إشارة الحداثة | ما الذي يجب التحقق منه | علامة خطر 🚩 |

|---|---|---|

| تاريخ آخر commit | موجز الـ commit أو تاريخ الدفع للمستودع | أقدم من 6 أشهر |

| المشكلات المفتوحة | تبويب Issues — فلتر لـ "captcha" و"503" و"blocked" | أعطال متكررة من دون ردود من المشرف |

| صحة التبعيات | requirements.txt / package.json | مكتبات مهجورة، بلا استراتيجية TLS حديثة |

| تغطية صفحات أمازون | README + أمثلة الكود | يتعامل مع نوع صفحة واحد فقط (مثل صفحات المنتجات لكن ليس البحث أو المراجعات) |

| نهج مكافحة الروبوتات | الشيفرة المصدرية، إعدادات البروكسي | ترويسات ثابتة وسلاسل UA فقط |

| نموذج الصيانة | هل هو سكريبر حقيقي، أم شرح تعليمي، أم واجهة API تجارية؟ | المستودع في الحقيقة مجرد واجهة أمامية لخدمة مدفوعة |

ما الذي كشفه التدقيق فعليًا

راجعت ثمانية مستودعات Amazon scraper بارزة وفق هذه المعايير. والنتائج غير مريحة:

| المستودع / الأداة | النجوم | إشارة آخر commit | النطاق | حالة 2026 | ملاحظات |

|---|---|---|---|---|---|

| oxylabs/amazon-scraper | ~2,872 | 2026-04-02 | غلاف API لسكريبر مُدار | حي، لكنه ليس DIY | حديث، لكنه في الحقيقة واجهة أمامية لخدمة مُدارة |

| omkarcloud/amazon-scraper | ~214 | 2026-02-25 | API مُدار للبحث والتفاصيل والمراجعات | حي، لكنه ليس DIY | تغطية جيدة، لكنه منتج API لا سكريبر خام |

| theonlyanil/amzpy | ~110 | 2026-02-26 | مكتبة Python خفيفة | حي | أوضح سكريبر مباشر على GitHub يستخدم curl_cffi |

| philipperemy/amazon-reviews-scraper | ~134 | 2024-11-21 | المراجعات فقط | ضيق لكنه قابل للاستخدام | قديم ومتمحور جدًا حول المراجعات |

| python-scrapy-playbook/amazon-python-scrapy-scraper | ~74 | آخر commit في 2023؛ تم الدفع للمستودع في 2024-08-20 | عناكب Scrapy + middleware للبروكسي | بمستوى تعليمي، ويشيخ | مفيد للتعلم، لا كحزمة جاهزة لعام 2026 |

| drawrowfly/amazon-product-api | ~744 | 2022-11-13 | واجهة سطر أوامر Node للبحث والتفاصيل والمراجعات | عالي المخاطر | تغطية واسعة، لكن الصيانة قديمة جدًا |

| tducret/amazon-scraper-python | ~881 | 2020-10-13 | من البحث إلى CSV | ميت لعام 2026 | كان شائعًا تاريخيًا، لكنه قديم بوضوح |

| scrapehero-code/amazon-scraper | ~432 | 2020-06-21 | شرح تعليمي للبحث/المنتج | ميت لعام 2026 | أشبه بأرشيف فعليًا |

وتحكي المشكلات العامة القصة نفسها. لدى مشكلة بعنوان "All requests receive captcha response." ولدى "Doesn't seem to be working." ولدى "Bypass Amazon protection." هذه ليست حالات هامشية نادرة — بل هي أول ما يصطدم به المستخدمون.

خطة منع الحظر: كيف تتجنب أن يتم حظرك باستخدام Amazon Scraper من GitHub

الحظر هو أكبر مشكلة يواجهها أي شخص يستخدم مشروع amazon scraper github. لم يعد كافيًا النصيحة العامة مثل "استخدم بروكسي وبدّل user agents". فحزمة أمازون لمكافحة الروبوتات في 2025-2026 تشمل بصمة TLS، والتحليل السلوكي، والنشر العدواني لـ CAPTCHA. تحتاج إلى نهج متعدد الطبقات.

مطابقة بصمة TLS: لماذا requests العادي يعرّضك للحظر

هذه واحدة من أكثر تقنيات منع الحظر إهمالًا. تعمل بصمة TLS كالتالي: عندما يفتح سكريبتك اتصالًا آمنًا مع أمازون، يمكن للخادم أن يستنتج الكثير عن العميل من طريقة "المصافحة" — مجموعات التشفير المعروضة، وترتيب الإضافات، وإعدادات HTTP/2. تستخدم المتصفحات إعدادات TLS وHTTP/2 ثابتة نسبيًا، ويمكن التعرف على هذه التركيبات عبر تقنيات مثل .

يمكن لـ requests العادي وتهيئات httpx الشائعة أن تنسخ الترويسات، لكنها لا تنسخ سلوك TLS وHTTP/2 المشابه لـ Chrome. أمازون تستطيع التمييز.

تعالج ذلك مباشرة. فهي توفّر تقمّص المتصفح — وتشمل الأهداف المدعومة chrome136 وsafari184 وfirefox133 — بحيث تطابق بصمة TLS لعميل HTTP لديك بصمة متصفح حقيقي. وتحذر الوثائق صراحةً من توليد سلاسل JA3 عشوائية: فبصمات المتصفح شبه ثابتة لكل إصدار، وأي عشوائية عبثية أسهل في الكشف من بصمة حقيقية منسوخة.

وتتوافق بيانات المجتمع مع ذلك. تؤكد أن وسيط impersonate مفيد لأنه يبدّل ملفات المتصفح ويحافظ على اتساق الترويسات. وتشير إلى أن أمازون تحظر العملاء بناءً على بصمة TLS "بعد نحو شهر أو شهرين". كما يسأل تحديدًا عمّا إذا كانت أمازون تبصم python-requests (والإجابة: نعم).

إذا كنت لا تزال تستخدم requests العادي كعميلك الأول لأمازون، فغيّر هذا الافتراض قبل أن تغيّر أي شيء آخر.

تدوير البروكسي بالطريقة الصحيحة (وليس مجرد "استخدم بروكسي")

الفكرة من البروكسيات ليست تدويرها بأكبر قدر ممكن. الفكرة هي جعل الجلسات تبدو معقولة.

السكني مقابل مراكز البيانات: بروكسيات مراكز البيانات أرخص لكنها أسهل في الكشف. بروكسيات Residential أغلى لكنها أصعب كثيرًا على أمازون. تبدأ من 4.00 دولارات/GB بنظام الدفع حسب الاستخدام، وتنخفض إلى 3.50 دولارات/GB في الخطط الأكبر. وتبدأ من 6 دولارات/GB. تنتمي أمازون إلى فئة "الهدف المتطور" حيث تستحق البروكسيات السكنية هذا الفارق السعري.

التدوير لكل طلب مقابل لكل جلسة: هنا تخطئ معظم الشروحات. تدوير البروكسي في كل طلب مع الإبقاء على الكوكيز والترويسات ثابتة قد يبدو أقل بشرية، لا أكثر. النمط الأكثر أمانًا:

- حافظ على مسار البحث → المنتج → المراجعة داخل نفس الجلسة الثابتة كلما أمكن

- غيّر الجلسات عند بدء رحلة بحث جديدة، لا مع كل طلب

- دوّر بين الجلسات، لا بشكل عشوائي داخل جلسة تصفح واحدة

أشار أحد إلى أن عناوين IP العادية لمقدمي خدمة الإنترنت لم تؤدِ جيدًا مثل عناوين IP الخاصة بالهواتف المحمولة على مواقع التجارة الإلكترونية الشهيرة. وأفاد بأنه تم الحظر حتى مع تدوير user agents والبروكسيات السكنية — وهو تذكير جيد بأن البروكسيات وحدها لا تكفي.

وتيرة الطلبات، والتراجع التدريجي، وتحديد المعدل

صفحات 503 على أمازون ليست سوء حظ عشوائيًا. إنها تغذية راجعة.

أفاد حول استخراج أكثر من 500 ASIN بأنه كان يحصل على 503 في النقطة نفسها كل مرة، قرب ASIN 101، حتى مع التوقف المؤقت. النمط قديم، لكن العبرة ما تزال معاصرة: الحجم الخام من عنوان IP واحد أو بصمة واحدة سيستفز الدفاعات في النهاية.

أفضل وتيرة تشغيل لسكريبرات GitHub التي تعتمد على DIY:

- تأخيرات عشوائية بين الطلبات (لا فواصل ثابتة، لأنها قابلة للكشف)

- 2 إلى 5 ثوانٍ بين طلبات المنتجات العامة لعملاء HTTP البسطاء

- تراجع تدريجي أُسّي بعد 503 أو CAPTCHA — أي خفف المحاولة تدريجيًا بدل إعادة المحاولة فورًا

- تقليل التوازي أكثر مما تعتقد أنك تحتاج

- تسجيلات fail-open بدل حلقات إعادة المحاولة الضيقة

معظم مستودعات amazon scraper github تفتقر إلى تحديد المعدل المدمج. ستحتاج إلى إضافته بنفسك.

تنسيق الترويسات: أكثر من مجرد سلاسل User-Agent

تتحقق أمازون من مجموعة الترويسات الكاملة، وليس من User-Agent فقط.

يجب أن تتضمن مجموعة ترويسات المتصفح الواقعية:

User-AgentAcceptAccept-LanguageAccept-Encoding- مؤشرات

Sec-CH-*عند الاقتضاء - سلوك اتصال متسق مع ملف المتصفح المختار

ينبغي أن تتوافق الترويسات مع إقليم السوق. وجد أحد أن الإعداد نفسه لم يُكتشف إلا في بعض المناطق، وأشار معلق آخر إلى ترويسات مرتبطة بالإقليم مثل Accept-Language.

القاعدة: لا ينبغي أن تتناقض الترويسات، وملف TLS/المتصفح، وجغرافيا البروكسي مع بعضها البعض. لا ترسل ترويسات Chrome مع UA خاص بـ Firefox. ولا تستخدم بروكسيًا أمريكيًا مع Accept-Language: de-DE.

التعامل مع CAPTCHA: متى تحلها ومتى تتراجع

الاصطدام بـ CAPTCHA يعني أن أمازون أصبحت بالفعل متشككة. وحلّها لا يعيد ضبط مستوى الثقة.

لحالات CAPTCHA المنعزلة ومنخفضة التكرار:

- حزمة PyPI هي محلّل CAPTCHA نصي لأمازون مكتوب بالكامل بـ Python، رغم أن أحدث إصدار لها يعود إلى مايو 2023 — لذا عاملها كأداة تكتيكية لا كاستراتيجية دائمة

- يذكر أن تكلفة Amazon Captcha هي 0.45 دولار لكل 1,000 عملية حل

لحلقات CAPTCHA المتكررة:

- توقف عن الحل وابدأ بالتراجع

- تكرار CAPTCHA يعني أن الجلسة احترقت — وحلها لا يعيد بناء الثقة في البصمة أو تاريخ الجلسة أو سمعة IP

- إذا تجمعت CAPTCHAs حسب نطاق البروكسي الفرعي، فالمشكلة في طبقة الشبكة لا في المحلل

متى تحتاج فعلًا إلى متصفح بلا واجهة، ومتى يكون ذلك مبالغة

الاندفاع الخاطئ هو تشغيل Playwright لكل شيء.

حالات جيدة لاستخدام المتصفح:

- نتائج البحث التي تعتمد على عرض JavaScript أو حالة تتأثر بالإقليم

- تدفقات المراجعات التي تعيد التوجيه إلى صفحات تسجيل الدخول

- سير العمل الذي تكون فيه الكوكيز وسياق المتصفح أهم من السرعة الخام

حالات سيئة لاستخدام المتصفح:

- صفحات المنتجات العامة العادية

- استخراج تفاصيل المنتج الثابتة حيث يكفي عميل HTTP يشبه المتصفح

- السحب الضخم واسع النطاق حيث تهم كفاءة الحوسبة

ابدأ بأخف عميل ينجح. وصفت إحدى حول السحب واسع النطاق هذا التسلسل: ابدأ بـ requests، ثم curl_cffi، ولا تنتقل إلى متصفح كامل إلا عندما تفشل الخيارات الأخف. المتصفحات بلا واجهة أبطأ بكثير وأكثر استهلاكًا للموارد من عملاء HTTP عند استخراج صفحات منتجات أمازون.

مصفوفة القرار لمكافحة الحظر في مشاريع Amazon Scraper على GitHub

| السيناريو | النهج الموصى به | لماذا |

|---|---|---|

| صفحات المنتجات العامة (على نطاق صغير) | curl_cffi + جلسة سكنية ثابتة | أرخص مسار وما يزال يبدو كمتصفح |

| صفحات نتائج البحث | ابدأ بـ curl_cffi، ولا تستخدم Playwright إلا إذا أدى العرض أو الحالة إلى كسر HTTP | البحث أكثر ارتباطًا بالحالة وأكثر حساسية للإقليم |

| المراجعات (تتطلب تسجيل دخول) | وضع المتصفح مع كوكيز/جلسة حقيقية | تسجيل الدخول وتدفقات المراجعات الديناميكية أصعب في المحاكاة عبر HTTP فقط |

| النطاق الكبير (5 آلاف+ يوميًا) | API مُدار للاستخراج، أو أداة رفع الحظر، أو منصة no-code | يصبح كود GitHub وحده مشكلة بنية تحتية |

عندما يتعطل مشروع Amazon Scraper على GitHub: امتلك خطة بديلة بدون كود

كل من لديه خبرة في الاستخراج يحتفظ بالخطة ب.

ستكسر تحديثات أمازون في النهاية أي مستودع GitHub في أسوأ وقت ممكن. وبالنسبة لفرق التجارة الإلكترونية، يعني السكريبر المعطل ضياع تغييرات الأسعار، وبيانات المنافسين القديمة، وفجوات في لوحات التحكم.

كثير من الأشخاص الذين يبحثون عن "amazon scraper github" هم في الحقيقة مستخدمون أعمال — فرق تشغيل تجارة إلكترونية، ومسوقون، وباحثون في FBA — لجؤوا إلى حلول برمجية لأنهم لم يجدوا خيارات أفضل. وتُظهر بيانات المنتديات أيضًا إحباطًا حقيقيًا من الرسمية من أمازون: وصولًا مقيدًا، وبيانات محدودة، و لا يستطيع كثير من البائعين استيفاءها.

لماذا تحتاج سكريبرات أمازون على GitHub إلى صيانة مستمرة

يجعل التدقيق أعلاه هذا الأمر ملموسًا:

- المستودعات القديمة تتكدس فيها بلاغات الأعطال من دون إصلاحات

- المستودعات "العاملة" تتحدث الآن بصراحة عن تدابير مكافحة الروبوتات في README

- تدور النقاشات المجتمعية بشكل متزايد حول بصمات TLS، وحلقات CAPTCHA، وجودة البروكسي — لا حول محددات CSS

بالنسبة لمستخدمي الأعمال، فإن عبء الصيانة هذا هو التكلفة الخفية الحقيقية. المستودع مجاني. أما وقتك وأنت تصلحه عند الثانية صباحًا فليس مجانيًا.

Thunderbit كبديل عملي لـ Amazon Scraper

توفّر الذي يستخرج العنوان، والسعر، وASIN، والتقييمات، والعلامة التجارية، والتوفر، وبلد الشحن، والرابط الأصلي — من دون كتابة أي كود.

وهذا ما يبدو عليه عمليًا:

- استخراج بنقرتين بدل إعداد بيئات Python والتبعيات وتهيئات البروكسي

- قالب أمازون فوري — بلا عبء AI، فقط استخراج بنقرة واحدة

- وضع استخراج عبر المتصفح للصفحات التي تتطلب تسجيل دخول (مثل صفحات المراجعات التي تربك مستخدمي سكريبرات GitHub)

- استخراج عبر السحابة لصفحات المنتجات العامة بسرعة (50 صفحة في المرة الواحدة)

- تصدير مجاني إلى Google Sheets وAirtable وNotion وExcel — وليس فقط CSV/JSON

- Scheduled scraper لمراقبة الأسعار المستمرة

- يتكيّف الذكاء الاصطناعي مع تغييرات التخطيط — من دون عبء صيانة عليك

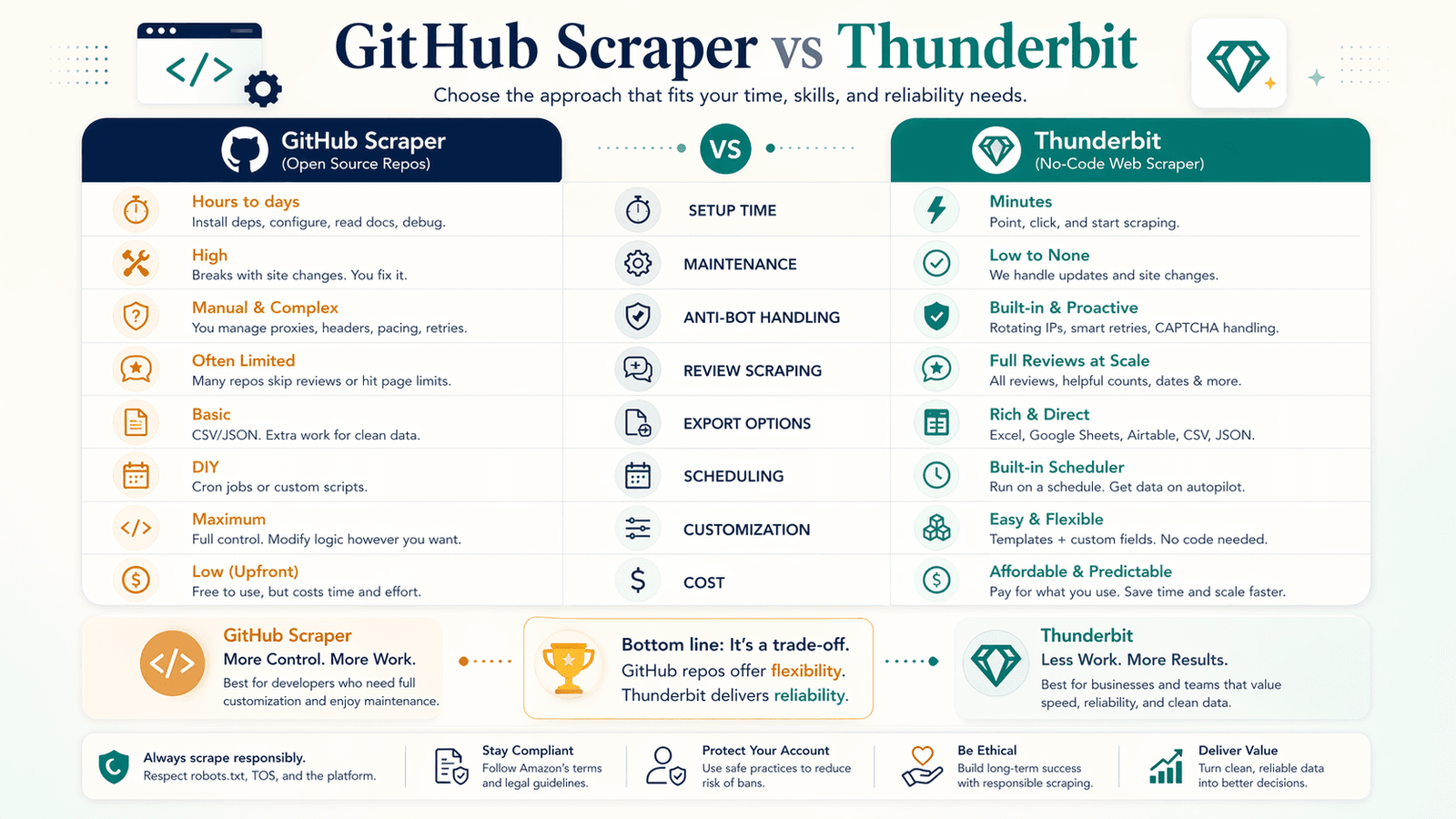

Amazon Scraper على GitHub مقابل Thunderbit: مقارنة صريحة

| العامل | سكريبر GitHub (مثل AmzPy) | Thunderbit |

|---|---|---|

| وقت الإعداد | 15–60 دقيقة (Python، تبعيات، بروكسيات) | نحو دقيقتين (ثبّت ملحق Chrome) |

| الصيانة | أنت من يصلح الأعطال | يتكيف الذكاء الاصطناعي مع تغييرات التخطيط |

| التعامل مع مكافحة الروبوتات | DIY (بروكسيات، ترويسات، TLS) | مدمج (وضع السحابة + وضع المتصفح) |

| استخراج المراجعات (مع تسجيل الدخول) | إدارة معقدة للجلسات | وضع استخراج عبر المتصفح |

| تصدير البيانات | CSV/JSON فقط | Sheets وAirtable وNotion وExcel وCSV وJSON |

| الجدولة | DIY (cron وAirflow وغيرها) | Scheduled scraper مدمج |

| التخصيص | أعلى | أقل |

| التكلفة | مجاني (بالإضافة إلى تكاليف البروكسي) | تتوفر خطة مجانية؛ بنظام الرصيد |

المفاضلة الصادقة: مستودعات GitHub تمنحك تخصيصًا أكبر؛ وThunderbit يمنحك موثوقية أعلى. إذا كان فريقك يهتم بالتشغيل المستمر أكثر من المرونة، فعادةً يكون المسار بدون كود هو الخيار الأكثر عقلانية.

أفضل الممارسات للاستخراج المجدول والمتكرر من أمازون

معظم مشاريع amazon scraper github مبنية للتشغيل مرة واحدة، لكن حالات الاستخدام الحقيقية في الأعمال — مراقبة الأسعار، وتتبع المخزون، وتحليل المنافسين — تحتاج إلى عمليات استخراج متكررة. ونادرًا ما تتضمن مستودعات GitHub الجدولة بشكل أصلي، ما يترك المستخدمين ليجمعوا cron jobs أو Airflow أو n8n.

الجدولة الذاتية لسكريبرات أمازون على GitHub

الإعداد الأدنى القابل للحياة للتشغيل المتكرر:

- cron job على Linux أو macOS لتشغيل السكريبت وفق جدول

- سجلات append-only لتتمكن من تشخيص الأعطال لاحقًا

- منع التكرار عبر ASIN + الطابع الزمني حتى لا تخزن بيانات مكررة

- تنبيهات فشل (حتى بريد إلكتروني بسيط عند خروج غير صفري) لتعرف متى انهارت عملية تشغيل عند 3 صباحًا

للفِرق الأكثر تعقيدًا:

- n8n لأتمتة سير العمل الخفيف (يُذكر كثيرًا في النقاشات المجتمعية)

- Airflow لخطوط معالجة مجدولة أثقل

- حالة مخزنة في قاعدة بيانات إذا كنت تحتاج إلى الفروقات والسجل التاريخي

أفضل ممارسة مهمة هنا ليست المجدول نفسه — بل إدارة الحالة. تتبّع آخر تشغيل ناجح، وآخر مجموعة ASIN، وتغيّرات الأسعار، وروابط URL الفاشلة.

جعل الجدولة أسهل مع Thunderbit

يتيح لك في Thunderbit وصف الفاصل الزمني باللغة الطبيعية، وإدخال الروابط، ثم النقر على "Schedule". يحوّل الذكاء الاصطناعي اللغة الطبيعية إلى جدول cron — من دون أي إعداد تقني. بالنسبة لفرق التجارة الإلكترونية غير التقنية التي تراقب الأسعار أو إطلاق منتجات المنافسين، يمثل ذلك خفضًا ملموسًا في العبء التشغيلي.

أفضل الممارسات لاستخراج أمازون المتكرر

تنطبق هذه الممارسات مهما كانت الأداة التي تستخدمها:

- منع التكرار عبر نافذة ASIN + الطابع الزمني — لا تخزن المنتج نفسه مرتين في التشغيل الواحد

- خزّن الأسعار كأرقام، لا كسلاسل خام — لتسهيل التنظيف لاحقًا

- أضف طوابع زمنية للاستخراج إلى كل صف — ستحتاجها لتحليل الاتجاهات

- تتبع الفروقات، لا الحالة الحالية فقط — "انخفض السعر 12% منذ الأسبوع الماضي" أكثر فائدة من "السعر هو 24.99 دولار"

- أطلق تنبيهًا عند التغييرات المهمة — خفض المنافس للسعر 15% يستحق إشعارًا؛ أما تذبذب 0.5% فهو ضجيج

- فكّر في تخزين البيانات — الملفات المسطحة تكفي للتشغيلات الصغيرة؛ أما مع 5 آلاف ASIN يوميًا فأعد التفكير في قاعدة بيانات أو جدول بيانات سحابي

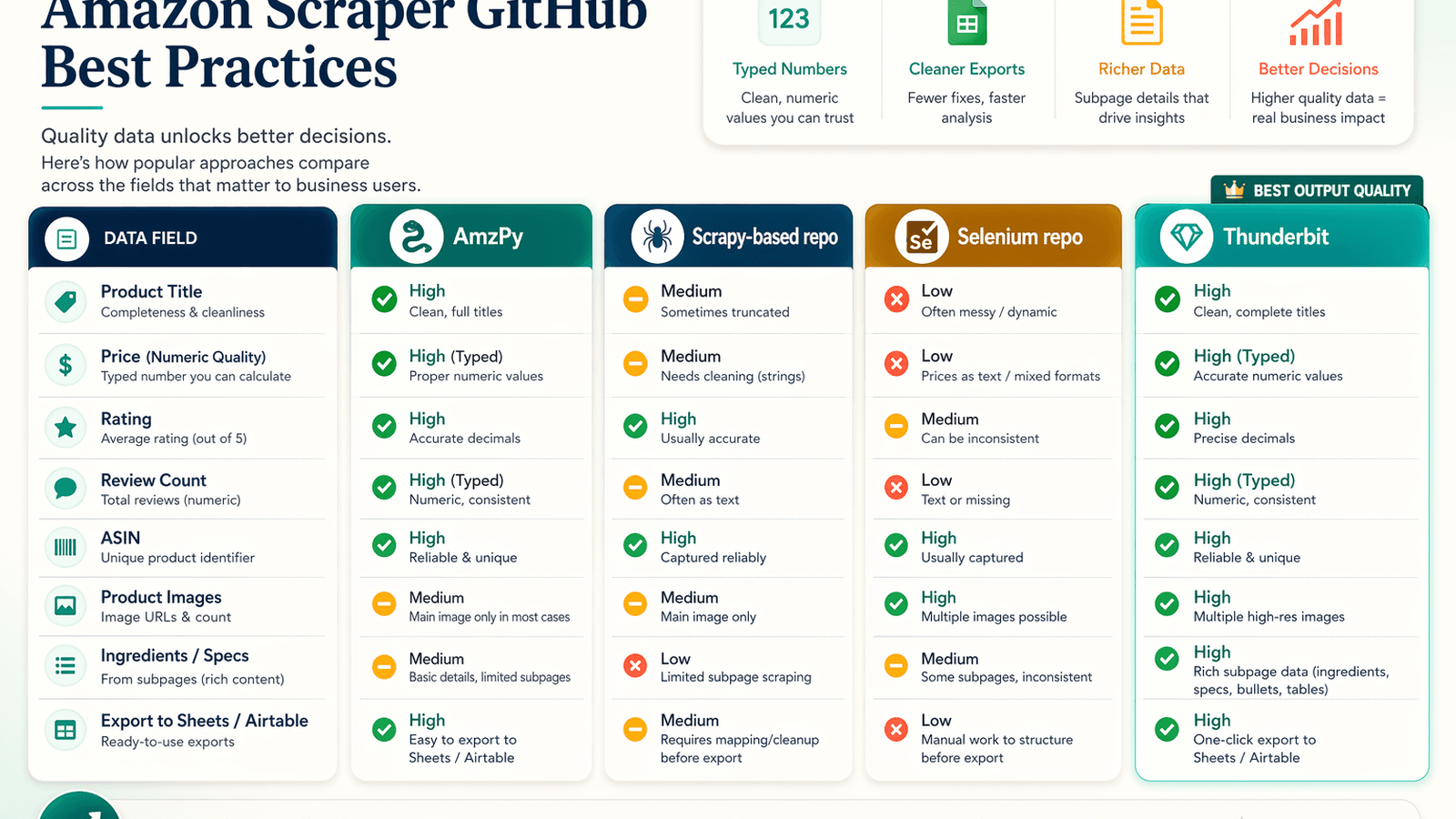

جودة المخرجات جنبًا إلى جنب: ماذا يُرجع كل نهج من Amazon Scraper على GitHub فعليًا

لا أحد يقارن جودة المخرجات الفعلية بين مستودعات amazon scraper github. يهتم المستخدمون بشدة بجودة البيانات — "أي أداة تمنح أنظف وأكمل بيانات" — لكن عليهم استنساخ كل مستودع وتجربته بأنفسهم. هذا القسم يسد هذه الفجوة.

ماذا تستخرج مستودعات GitHub الشهيرة فعليًا وما الذي تفوّته

استنادًا إلى عينات README والأمثلة العامة وصيغ المخرجات الموثقة:

| النهج | ما الذي يستخرجه بوضوح | الفجوات/المقايضات الشائعة |

|---|---|---|

| amzpy | العنوان، السعر، العملة، رابط الصورة، التقييمات، المراجعات، المتغيرات، ASIN | موجه أكثر لصفحات المنتجات؛ أقل غنى في المراجعات الكاملة/أقسام المواصفات |

| tducret/amazon-scraper-python | CSV يحوي العنوان، التقييم، عدد المراجعات، رابط المنتج، رابط الصورة، ASIN | قديم، متمركز حول القوائم، وقصته مع مكافحة الروبوتات ضعيفة |

| python-scrapy-playbook scraper | نتائج البحث، صفحات المنتجات، المراجعات، مسارات CSV/JSON | بمستوى تعليمي؛ يعتمد على middleware بروكسي خارجي؛ ويحتاج غالبًا إلى تنظيف إضافي |

| omkarcloud/amazon-scraper | البحث، الفئات، التفاصيل، أفضل المراجعات، الكثير من الصور/الفيديوهات/المواصفات | ليس سكريبرًا خامًا — بل خدمة API مُدارة |

| Thunderbit Amazon template | العنوان، السعر، ASIN، العلامة التجارية، التقييم، المراجعات، التوفر، مصدر الشحن، إثراء الصفحات الفرعية | تحكم أقل على مستوى الكود من السكريبتات المخصصة |

جدول مقارنة جودة المخرجات

| حقل البيانات | AmzPy | مستودع قائم على Scrapy | مستودع Selenium | Thunderbit |

|---|---|---|---|---|

| عنوان المنتج | ✅ | ✅ | ✅ | ✅ |

| السعر (رقمي) | ⚠️ نص | ✅ | ⚠️ نص | ✅ (نوع رقمي) |

| التقييم | ✅ | ✅ | ✅ | ✅ |

| عدد المراجعات | ❌ | ✅ | ✅ | ✅ |

| ASIN | ✅ | ✅ | ✅ | ✅ |

| صور المنتج | ❌ | ⚠️ صورة مصغرة فقط | ✅ | ✅ (بدقة كاملة، قابلة للتصدير) |

| المكونات/المواصفات | ❌ | ❌ | ❌ | ✅ (عبر استخراج الصفحات الفرعية + الذكاء الاصطناعي) |

| التصدير إلى Sheets/Airtable | ❌ | ❌ | ❌ | ✅ مجاني |

لماذا يهم تنسيق البيانات للمستخدمين التجاريين

تخلق البيانات غير النظيفة عملاً خفيًا. حتى السكريبر الناجح يمكن أن يكون فشلًا تشغيليًا إذا:

- كانت الأسعار سلاسل نصية مع رموز عملة بدل أرقام نظيفة

- كانت القيم المفقودة غير متسقة (سلسلة فارغة vs null vs "N/A")

- كانت الصور مجرد صور مصغرة منخفضة الدقة

- احتاجت حقول المراجعات أو المواصفات إلى معالجة لاحقة قبل التحليل

بالنسبة لفرق تشغيل التجارة الإلكترونية، تؤثر البيانات النظيفة مباشرة في سرعة التحليل واتخاذ القرار. ينسّق الذكاء الاصطناعي في Thunderbit البيانات حسب نوعها — الأرقام كأرقام، والتواريخ كتاريخ، والروابط كروابط — لذا تكون جاهزة للاستخدام فورًا. تختلف مستودعات GitHub كثيرًا في هذا الجانب، ويتراكم وقت التنظيف بسرعة.

مرجع سريع: قائمة أفضل ممارسات Amazon Scraper على GitHub

- تحقق من تاريخ آخر commit قبل الاستنساخ. أي شيء أقدم من ستة أشهر يُعد إشارة تحذير قوية مع أمازون.

- ابحث في Issues عن "captcha" و"503" و"blocked" و"not working" قبل الإعداد.

- فضّل

curl_cffiأو عميل HTTP آخر يتقمص المتصفح بدلrequestsالعادي. - أبقِ الترويسات وملف TLS واللغة والجغرافيا الخاصة بالبروكسي متسقة — بلا تناقضات.

- استخدم جلسات ثابتة لتدفقات التصفح؛ لا تدوّر مع كل طلب بشكل أعمى.

- أضف وتيرة عشوائية وتراجعًا تدريجيًا أُسيًا.

- اعتبر CAPTCHA المتكرر جلسة محترقة، لا لغزًا يجب كسره بالقوة.

- استخدم المتصفحات بلا واجهة فقط عندما لا يستطيع عملاء HTTP محاكاة الصفحة بشكل موثوق.

- خزّن نقاط التحقق والحالة حتى يمكن استئناف التشغيلات الفاشلة بأمان.

- امتلك خطة بديلة — سواء كانت API مُدارة أو أداة no-code مثل .

الاعتبارات القانونية والأخلاقية لاستخراج بيانات أمازون في 2026

بعض الأمور التي يجدر معرفتها، باختصار.

موقف أمازون تقييدي، ويزداد تقييدًا. أقوى الإشارات:

- تعرض صفحات المساعدة الخاصة بأمازون الآن تقول: "To discuss automated access to Amazon data please contact api-services-support@amazon.com."

- يحظر الخاص بأمازون نطاقًا واسعًا من المسارات الديناميكية ومسارات المراجعات والملفات الشخصية وقوائم الرغبات وقوائم العروض.

- تعترض صراحةً على وصول الوكلاء الخفي أو المتنكر، والتحايل على التدابير الأمنية، وانتحال وكيل على أنه Google Chrome. كما حول الحادثة.

- وسّعت أمازون ضد زواحف OpenAI في أواخر 2025.

يزداد الخطر العملي بوضوح عندما تنتقل من صفحات المنتجات العامة إلى التدفقات التي تتطلب تسجيل دخول، أو الأتمتة المتخفية، أو الاستخراج التجاري عالي الحجم. هذا ليس نصيحة قانونية — راجع فريقك القانوني بحسب حالتك الخاصة.

الخلاصة الأساسية: كيف تحصل على بيانات موثوقة من أمازون من دون أن تُحظر

حسب الأهمية:

- أجرِ تدقيقًا قبل أن تستنسخ. افترض أن معظم نتائج GitHub قديمة، أو تعليمية، أو مجرد أغلفة حول واجهات API تجارية.

- حدّث طبقة الشبكة أولًا. بصمة TLS واتساق الجلسة أهم من محددات HTML.

- استخدم جلسات سكنية ثابتة، لا فوضى بروكسي عشوائية. دوّر بين الجلسات لا داخلها.

- وتيرة الطلبات يجب أن تشبه المستخدم، لا اختبار ضغط. التأخيرات العشوائية والتراجع التدريجي الأُسي غير قابلين للتفاوض.

- حلّ CAPTCHAs المنعزلة؛ واعتزل الجلسات التي تتكرر فيها المحاولات. لا تحاول كسر بصمة محترقة بالقوة.

- امتلك خطة بديلة. ستغيّر أمازون شيئًا ما في منتصف الأسبوع، وسيتعطل سكريبر GitHub الخاص بك. أداة no-code مُصانة مثل أو API مُدارة يمكنها إبقاء خط البيانات حيًا بينما تُصلح الأعطال.

- أعطِ الأولوية لجودة المخرجات. البيانات النظيفة والمكتوبة حسب النوع توفّر وقتًا أكبر لاحقًا من سكريبر سريع لكنه فوضوي.

إذا كنت تريد الموثوقية أكثر من التخصيص، فإن Thunderbit يقدّم بديلًا مُصانًا — اطّلع على أو شاهد الشروحات على . ويمكن للمطورين الذين يريدون تحكمًا كاملًا استخدام مستودعات GitHub بالتأكيد — ولكن فقط مع ممارسات منع الحظر والصيانة التي يغطيها هذا الدليل.

الأسئلة الشائعة

هل من القانوني استخراج بيانات منتجات أمازون باستخدام سكريبر على GitHub؟

تقيّد شروط خدمة أمازون جمع البيانات الآلي، وقد طبقت أمازون ذلك فعليًا عبر خطابات الكفّ والامتناع والإجراءات التقنية المضادة (خصوصًا في 2025-2026). إن استخراج بيانات المنتجات المتاحة للعامة يقع في منطقة رمادية؛ أما الاستخراج خلف تسجيل دخول أو تنكّر روبوتك على أنه متصفح حقيقي فيحمل مخاطر أعلى. هذا ليس نصيحة قانونية — استشر فريقك القانوني وفق حالة الاستخدام الخاصة بك.

كم مرة تتعطل مستودعات Amazon scraper على GitHub؟

بشكل متكرر. تغيّر أمازون تخطيطات الصفحات، وتضيف طبقات جديدة لمكافحة الروبوتات، وتوقف نقاط النهاية بانتظام. في التدقيق الذي أجريناه لهذا المقال، كان نحو 3 فقط من أصل 8 مستودعات بارزة يعملون بوضوح في 2026. وحتى المستودعات "العاملة" غالبًا ما تحتوي على مشكلات مفتوحة حول CAPTCHAs وأخطاء 503. توقّع أن تحتاج إلى استكشاف الأخطاء أو تحديث إعدادك كل بضعة أسابيع إلى بضعة أشهر.

ما أفضل Amazon scraper على GitHub في 2026؟

لا يوجد فائز واحد — الأمر يعتمد على حالة الاستخدام ومدى ارتياحك التقني. إذا كنت تريد سكريبر Python خفيفًا ومباشرًا، فإن من أكثر الخيارات حداثة. أما إذا أردت تغطية أوسع عبر API مُدارة، فـ يعمل، لكنه ليس DIY حقيقيًا. طبّق قائمة التدقيق الخاصة بالحداثة الواردة في هذا المقال لتقيّم أي مستودع بنفسك قبل الالتزام به.

هل يستطيع Thunderbit استخراج بيانات أمازون من دون كود؟

نعم. يستخرج في Thunderbit عنوان المنتج، والسعر، وASIN، والتقييمات، والعلامة التجارية، والتوفر، والمزيد بنقرة واحدة. وهو يدعم وضع الاستخراج عبر المتصفح للصفحات التي تتطلب تسجيل دخول، والاستخراج السحابي للصفحات العامة بسرعة، والاستخراج المجدول للمهام المتكررة، والتصدير المجاني إلى Google Sheets وAirtable وNotion وExcel. يمكنك البدء بتثبيت .

كيف أتجنب حظر عنوان IP الخاص بي أثناء استخراج أمازون؟

استخدم نهجًا متعدد الطبقات: (1) انتقل من requests العادي إلى عميل يتقمص TLS مثل curl_cffi، (2) استخدم بروكسيات سكنية مع جلسات ثابتة بدل تدوير عشوائي لبروكسيات مراكز البيانات، (3) أضف وتيرة عشوائية وتراجعًا تدريجيًا أُسيًا، (4) اجعل مجموعة الترويسات كاملة ومتسقة مع ملف متصفحك وإقليم السوق، و(5) اعتبر CAPTCHAs المتكررة إشارة إلى إنهاء الجلسة، لا لغزًا يجب حله إلى ما لا نهاية. لمزيد من التفاصيل، راجع مصفوفة القرار لمكافحة الحظر في وقت سابق من هذا المقال.