Na práci v terminálu je něco fakt nadčasového: otevřeš konzoli, napíšeš jeden příkaz a surová webová data se začnou sypat, jako bys právě nakoukl do Matrixu. Pro vývojáře a technicky zdatné lidi je taková kouzelná hůlka — nenápadný nástroj do příkazové řádky, který tiše běží na miliardách zařízení, od cloudových serverů až po chytrou lednici. A i v roce 2026, kdy je všude plno naleštěných no‑code a AI nástrojů, je web-scraping-with-curl pořád jistota pro každého, kdo chce rychlost, kontrolu a možnost všechno skriptovat.

Roky stavím automatizační nástroje a pomáhám týmům zkrotit webová data — a stejně po cURL sahám pokaždé, když potřebuju rychle stáhnout stránku, odladit API nebo si nanečisto otestovat scrapingový postup. V tomhle průvodci tě provedu curl web scraping tutorialem, který bere základy i pokročilejší fígle — s reálnými příklady příkazů, praktickými tipy a střízlivým pohledem na to, kde cURL září (a kde naráží na strop). A pokud jsi spíš „byznys“ typ a do příkazové řádky se ti nechce, ukážu ti, jak , náš AI web scraper, zkrátí cestu od „potřebuju tahle data“ k „tady je tabulka“ na dvě kliknutí — bez kódu.

Pojďme na to: proč je cURL pro web scraping pořád relevantní i v roce 2025, jak ho používat chytře a kdy už dává smysl sáhnout po něčem ještě silnějším.

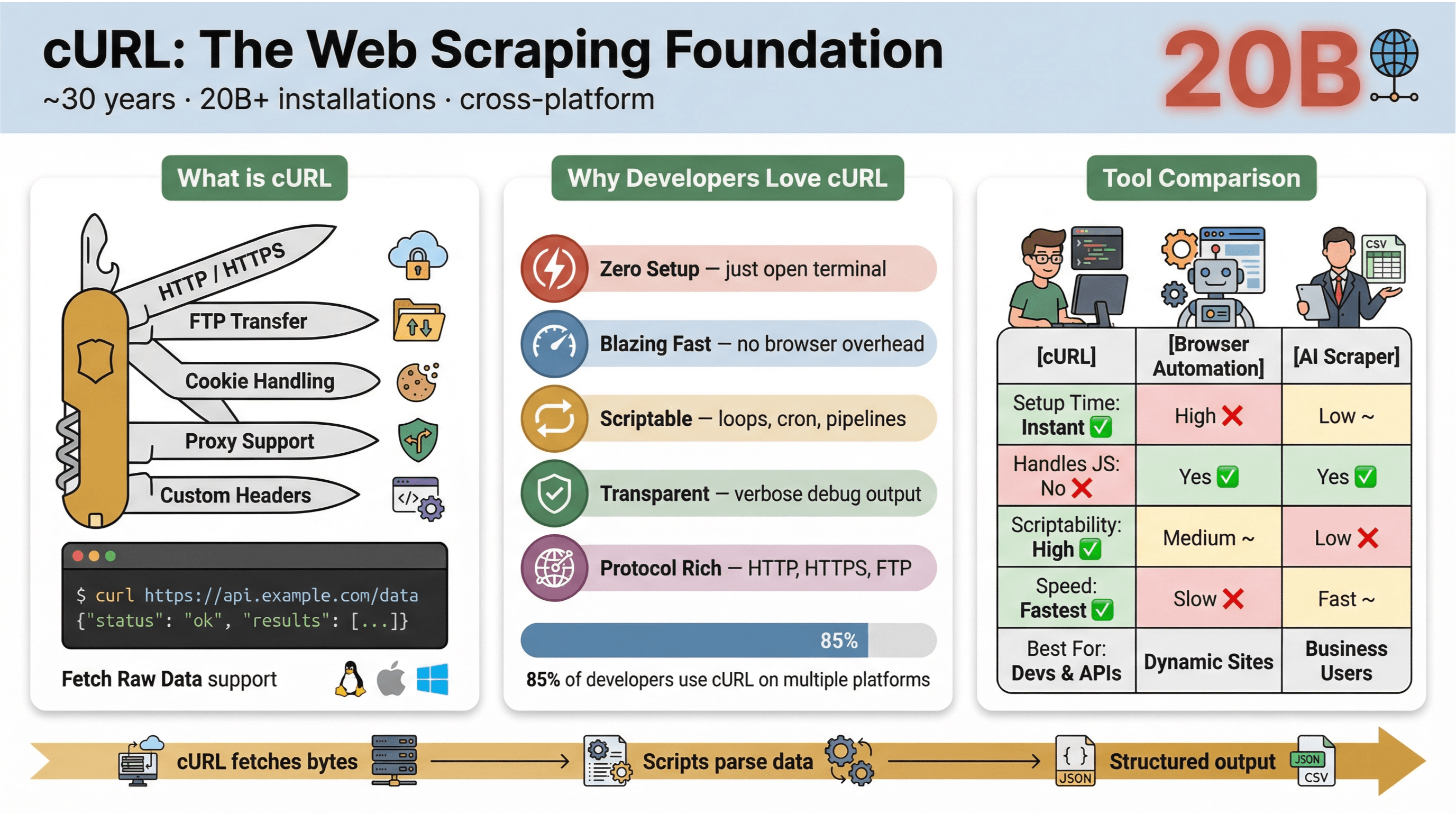

Co je cURL? Základ web-scraping-with-curl

V jádru je nástroj pro příkazovou řádku a knihovna na přenos dat přes URL. Je tu už skoro 30 let (jo, fakt) a je prakticky všude — je součástí operačních systémů, pohání skripty a nenápadně zajišťuje přenosy dat ve víc než . Pokud jsi někdy rychle stáhl webovou stránku, otestoval API nebo stáhl soubor jedním příkazem, je dost možné, že jsi cURL už použil.

Co dělá cURL tak oblíbeným pro web scraping:

- Lehký a multiplatformní: Běží na Linuxu, macOS, Windows i na embedded zařízeních.

- Podpora protokolů: Zvládá HTTP, HTTPS, FTP a další.

- Skriptovatelnost: Ideální pro automatizaci, cron joby a „lepicí“ skripty.

- Bez interakce uživatele: Je stavěný na neinteraktivní použití — super pro dávkové úlohy a pipeline.

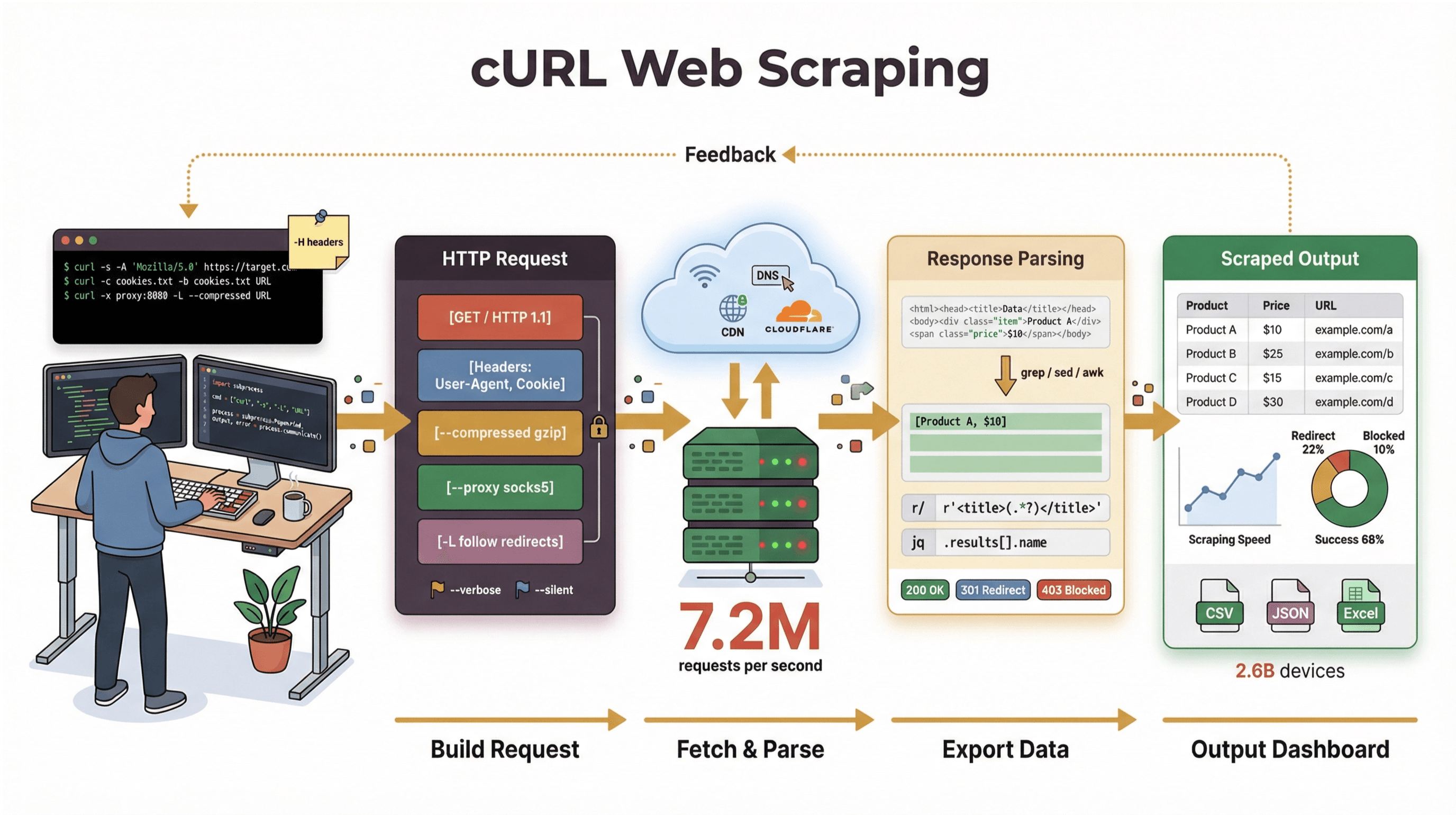

Je ale fér říct: hlavní práce cURL je stáhnout surová data — HTML, JSON, obrázky, cokoliv. Neumí je sám parsovat, renderovat ani převádět do struktury. Ber cURL jako „první kilometr“ web scrapingu: přinese ti bajty, ale na převod do použitelných informací budeš potřebovat další nástroje (třeba Python, grep/sed/awk nebo AI web scraper).

Oficiální dokumentaci najdeš v .

Proč používat cURL pro web scraping? (curl web scraping tutorial)

Proč se vývojáři a techničtí uživatelé k cURL pořád vracejí, i když je kolem tolik nových nástrojů? Tohle jsou jeho největší trumfy:

- Minimum příprav: Žádné instalace, žádné závislosti — otevřeš terminál a jedeš.

- Rychlost: Data stáhneš hned, bez čekání na načítání prohlížeče.

- Skriptovatelnost: Snadno iteruješ přes URL, automatizuješ požadavky a řetězíš příkazy.

- Podpora funkcí a protokolů: Cookies, proxy, přesměrování, vlastní hlavičky a další.

- Transparentnost: Díky verbose/debug výstupu přesně vidíš, co se děje.

V uvedlo přes 85 % respondentů, že používají cURL v příkazové řádce, a skoro všichni ho používají na více platformách. Pořád je to švýcarský nůž pro HTTP požadavky, rychlé stažení dat a troubleshooting.

Rychlé srovnání cURL s jinými přístupy:

| Funkce | cURL | Automatizace prohlížeče (např. Selenium) | AI Web Scraper (např. Thunderbit) |

|---|---|---|---|

| Čas na nastavení | Okamžitě | Vysoký | Nízký |

| Skriptovatelnost | Vysoká | Střední | Nízká (bez kódu) |

| Zvládá JavaScript | Ne | Ano | Ano (Thunderbit: přes prohlížeč) |

| Podpora cookies/sessions | Ručně | Automaticky | Automaticky |

| Strukturování dat | Ručně (parsování později) | Ručně (parsování později) | AI / šablony |

| Nejlepší pro | Dev, rychlé tahy | Složité, dynamické weby | Byznys uživatele, export dat |

Shrnutí: cURL je bezkonkurenční na rychlé, skriptovatelné „stažení dat“ — hlavně u statických stránek, API nebo jednoduchých automatizací. Jakmile ale potřebuješ parsovat složité HTML, řešit JavaScript nebo exportovat strukturovaná data, vyplatí se sáhnout po specializovanějším nástroji.

Začínáme: základní příklady příkazů pro web scraping s cURL

Pojďme si to osahat. Takhle použiješ cURL pro základní scrapingové úlohy krok za krokem.

Stažení surového HTML pomocí cURL

Nejjednodušší scénář: stáhnout HTML stránky.

1curl https://books.toscrape.com/Příkaz stáhne domovskou stránku , veřejného demo webu pro scraping. V terminálu uvidíš surové HTML — zkus hledat třeba <title> nebo texty jako „In stock.“

Uložení výstupu do souboru

Chceš si HTML uložit na pozdější parsování? Použij -o:

1curl -o page.html https://books.toscrape.com/Vznikne soubor page.html s kompletním HTML. Ideální pro další analýzu nebo zpracování jinými nástroji.

Odesílání POST požadavků přes cURL

Potřebuješ odeslat formulář nebo pracovat s API? Pro POST použij -d. Ukázka s , webem určeným pro testování HTTP:

1curl -X POST https://httpbin.org/post -d "key1=value1&key2=value2"Dostaneš JSON odpověď, která ti vrátí odeslaná data — skvělé na testování a prototypování.

Kontrola hlaviček a ladění

Někdy potřebuješ vidět response hlavičky nebo ladit požadavek:

-

Pouze hlavičky (HEAD):

1curl -I https://books.toscrape.com/ -

Hlavičky i tělo odpovědi:

1curl -i https://httpbin.org/get -

Verbose/debug výstup:

1curl -v https://books.toscrape.com/

Tyhle přepínače ti ukážou, co se děje „pod kapotou“ — zásadní při řešení problémů.

Rychlá tabulka pro orientaci:

| Úkol | Příklad příkazu | Poznámky |

|---|---|---|

| Stáhnout HTML | curl URL | Vypíše HTML do terminálu |

| Uložit do souboru | curl -o file.html URL | Zapíše výstup do souboru |

| Zobrazit hlavičky | curl -I URL nebo curl -i URL | -I jen HEAD, -i hlavičky i tělo |

| POST formulářová data | curl -d "a=1&b=2" URL | Odešle data ve formátu form-encoded |

| Ladit request/response | curl -v URL | Detailní informace o requestu/response |

Další příklady najdeš v .

O úroveň výš: pokročilý web scraping s cURL (web-scraping-with-curl)

Jakmile máš základy v malíku, cURL nabízí spoustu pokročilých možností pro složitější scénáře.

Práce s cookies a sessions

Spousta webů vyžaduje cookies kvůli přihlášení nebo sledování relace. V cURL si cookies můžeš uložit a znovu použít:

1# Uložit cookies po přihlášení

2curl -c cookies.txt https://example.com/login

3# Použít cookies pro další požadavky

4curl -b cookies.txt https://example.com/accountTím napodobíš relaci prohlížeče a dostaneš se i na stránky za loginem (pokud tam není JavaScriptová výzva).

Změna User-Agentu a vlastní hlavičky

Některé weby vrací jiný obsah podle User-Agentu nebo hlaviček. cURL se standardně hlásí jako „curl/VERSION“, což může spustit blokace nebo alternativní obsah. Pro napodobení prohlížeče:

1curl -A "Mozilla/5.0 (Windows NT 10.0; Win64; x64)" https://example.com/Můžeš přidat i vlastní hlavičky, třeba jazyk:

1curl -H "Accept-Language: en-US,en;q=0.9" https://example.com/Pomůže to získat stejný obsah, jaký vidí běžný uživatel v prohlížeči.

Použití proxy pro web scraping

Potřebuješ posílat požadavky přes proxy (geo testování nebo omezení IP banů)? Použij -x:

1curl -x http://proxy.example.org:4321 https://remote.example.org/Proxy používej zodpovědně a v souladu s podmínkami webu.

Automatizace scrapingu více stránek

Chceš stáhnout víc stránek — třeba stránkované výpisy produktů? Stačí jednoduchý shell loop:

1for p in $(seq 2 5); do

2 curl -s -o "books-page-${p}.html" \

3 "https://books.toscrape.com/catalogue/category/books_1/page-${p}.html"

4 sleep 1

5doneTím stáhneš stránky 2 až 5 katalogu Books to Scrape a uložíš je do samostatných souborů. (Stránka 1 je homepage.)

Limity web-scraping-with-curl: co je dobré vědět

I když mám cURL rád, není to univerzální kladivo na všechno. Tady jsou jeho slabiny:

- Bez spouštění JavaScriptu: cURL nezvládne stránky, které potřebují JavaScript pro vykreslení obsahu nebo pro anti-bot výzvy ().

- Parsování je na tobě: Dostaneš surové HTML/JSON, ale zpracování si musíš udělat sám — často pomocí dalších skriptů.

- Omezená práce se sessions: Složitější přihlášení, tokeny nebo vícekrokové formuláře se rychle zamotají.

- Žádné vestavěné strukturování: cURL nepřevede web na řádky, tabulky ani spreadsheet.

- Snadno odhalitelný bot: Moderní weby používají pokročilé obrany (JavaScript, fingerprinting, CAPTCHA), které cURL obvykle nepřekoná ().

Rychlé srovnání:

| Omezení | Jen cURL | Moderní scraping nástroje (např. Thunderbit) |

|---|---|---|

| Podpora JavaScriptu | Ne | Ano |

| Strukturování dat | Ručně | Automaticky (AI/šablony) |

| Správa sessions | Ručně | Automaticky |

| Obcházení anti-bot | Omezeně | Pokročilé (prohlížeč/AI) |

| Snadnost použití | Pro technické | I pro netechnické |

Na statické stránky a API je cURL parádní. Jakmile je web dynamický nebo chráněný, je čas posunout se o level výš.

Thunderbit vs. cURL: nejlepší přístup pro netechnické uživatele

Teď , náš AI web scraper jako Chrome rozšíření. Pokud jsi obchodník, marketér nebo člověk z operations a chceš dostat data z webu do Excelu, Google Sheets nebo Notion — bez příkazové řádky — Thunderbit je přesně pro tebe.

Srovnání s cURL:

| Funkce | cURL | Thunderbit |

|---|---|---|

| Uživatelské rozhraní | Příkazová řádka | Klikací (Chrome rozšíření) |

| AI návrh polí | Ne | Ano (AI přečte stránku a navrhne sloupce) |

| Stránkování/podstránky | Ruční skriptování | Automaticky (AI detekuje a stáhne) |

| Export dat | Ručně (parsovat + uložit) | Přímo do Excelu, Google Sheets, Notion, Airtable |

| JavaScript/chráněné stránky | Ne | Ano (scraping přes prohlížeč) |

| Bez kódu | Ne (vyžaduje skripty) | Ano (zvládne kdokoliv) |

| Free verze | Vždy zdarma | Zdarma až 6 stránek (10 s trial boostem) |

V Thunderbitu jen otevřeš rozšíření, klikneš na „AI Suggest Fields“ a AI sama navrhne, co vytáhnout. Umí tabulky, seznamy, detaily produktů a zvládne i automatické procházení podstránek. Pak data vyexportuješ rovnou do oblíbených nástrojů — bez parsování a bez nervů.

Thunderbit používá přes a nejvíc frčí u týmů v sales, ecommerce a realitách, které potřebují rychle získat strukturovaná data.

Chceš to zkusit? .

Kombinace cURL a Thunderbit: flexibilní strategie web scrapingu

Jestli jsi technický uživatel, nemusíš si vybírat jen jeden nástroj. Spousta týmů naopak kombinuje cURL a Thunderbit, aby měla maximální flexibilitu:

- Prototypuj s cURL: Rychle otestuj endpointy, zkontroluj hlavičky a pochop, jak web odpovídá.

- Škáluj s Thunderbit: Když potřebuješ strukturovaná data, scraping více stránek nebo opakovatelný workflow, přepni na Thunderbit.

Ukázkový postup pro market research:

- Pomocí cURL stáhni pár stránek a mrkni na strukturu HTML.

- Urči, jaká pole chceš (např. názvy produktů, ceny, recenze).

- Otevři Thunderbit, klikni na „AI Suggest Fields“ a nech AI nastavit scraper.

- Stáhni všechny stránky (včetně podstránek nebo stránkování) a exportuj do Google Sheets.

- Data analyzuj, sdílej a použij — bez ručního parsování.

Rozhodovací tabulka:

| Scénář | Použít cURL | Použít Thunderbit | Použít obojí |

|---|---|---|---|

| Rychlé stažení API nebo statické stránky | ✅ | ||

| Potřebuji strukturovaná data v tabulce | ✅ | ||

| Ladění hlaviček/cookies | ✅ | ||

| Dynamické stránky s JS | ✅ | ||

| Opakovatelný no-code workflow | ✅ | ||

| Prototyp a následné škálování | ✅ | ✅ | Hybridní postup |

Časté problémy a nástrahy při web scrapingu s cURL

Než se do toho pustíš naplno, tady jsou reálné překážky, na které narazíš:

- Anti-bot systémy: JavaScriptové výzvy, CAPTCHA, fingerprinting — cURL tohle obvykle neobejde ().

- Kvalita dat: Změny HTML, chybějící pole nebo nekonzistentní layouty ti rozbijí skripty.

- Údržba: Jakmile se web změní, musíš upravit parsování.

- Právní a compliance rizika: Před scrapingem vždy zkontroluj podmínky webu, robots.txt a relevantní zákony. To, že jsou data veřejná, neznamená, že je můžeš používat jakkoliv (, ).

- Limity škálování: Na malé úlohy je cURL super, ale ve velkém začneš řešit proxy, rate limiting a error handling.

Tipy pro troubleshooting a dodržování pravidel:

- Začínej na povolených nebo demo webech (např. ).

- Respektuj limity — nezahlcuj endpointy.

- Vyhni se scrapingu osobních dat, pokud k tomu nemáš právní důvod.

- Pokud narazíš na JavaScript nebo CAPTCHA, zvaž přechod na prohlížečový nástroj jako Thunderbit.

Shrnutí krok za krokem: jak scrapovat weby pomocí cURL

Rychlý checklist pro web-scraping-with-curl:

- Vyber cílové URL: Začni statickou stránkou nebo API endpointem.

- Stáhni stránku:

curl URL - Ulož výstup do souboru:

curl -o file.html URL - Zkontroluj hlavičky / laď:

curl -I URL,curl -v URL - Odešli POST data:

curl -d "a=1&b=2" URL - Cookies/sessions:

curl -c cookies.txt ...,curl -b cookies.txt ... - Vlastní hlavičky/User-Agent:

curl -A "..." -H "..." URL - Sleduj přesměrování:

curl -L URL - Proxy (když je potřeba):

curl -x proxy:port URL - Automatizuj více stránek: Použij smyčky nebo skripty.

- Parsuj a strukturuj data: Podle potřeby dalšími nástroji.

- Přejdi na Thunderbit pro strukturovaný no-code scraping nebo dynamické stránky.

Závěr a hlavní myšlenky: jak vybrat správný nástroj pro web scraping

Web-scraping-with-curl je i v roce 2026 silná dovednost pro technické uživatele — hlavně na rychlé stažení dat, prototypování a automatizaci. Rychlost, skriptovatelnost a všudypřítomnost dělají z cURL stálici ve výbavě každého vývojáře. Jak se ale web stává dynamičtějším a líp chráněným a byznys uživatelé chtějí strukturovaná data bez kódu, nástroje jako posouvají hranice toho, co je reálně možné.

Hlavní takeaway:

- Používej cURL pro statické stránky, API a rychlé prototypy — když chceš plnou kontrolu.

- Přepni na Thunderbit (nebo podobné AI web scrapery), když potřebuješ strukturovaná data, řešíš dynamické/JavaScriptové weby nebo chceš no-code workflow.

- Kombinuj obojí pro maximální flexibilitu: prototyp v cURL, škálování a struktura v Thunderbit.

- Scrapuj zodpovědně — respektuj podmínky webu, limity a právní rámec.

Chceš vidět, jak snadný může web scraping být? a otestuj AI extrakci dat na vlastní kůži. A pokud chceš jít víc do hloubky, mrkni na — najdeš tam další návody, tipy i postřehy z praxe. Mohlo by se ti líbit i:

Ať se scraping daří — a ať jsou tvoje data vždy čistá, strukturovaná a na dosah jednoho příkazu (nebo kliknutí).

Nejčastější dotazy (FAQ)

1. Umí cURL pracovat se stránkami renderovanými JavaScriptem?

Ne. cURL JavaScript nespouští. Stáhne jen surové HTML tak, jak ho server pošle. Pokud stránka potřebuje JavaScript pro vykreslení obsahu nebo pro vyřešení anti-bot výzvy, cURL se k datům nedostane. V takových případech použij prohlížečové nástroje jako .

2. Jak uložit výstup z cURL přímo do souboru?

Použij přepínač -o: curl -o filename.html URL. Tím se tělo odpovědi zapíše do souboru místo vypsání do terminálu.

3. Jaký je rozdíl mezi cURL a Thunderbit pro web scraping?

cURL je nástroj pro příkazovou řádku, který stahuje surová webová data — skvělý pro technické uživatele a automatizaci. Thunderbit je AI Chrome rozšíření pro byznys uživatele, kteří chtějí získat strukturovaná data z libovolného webu, zvládnout dynamické stránky a exportovat rovnou do nástrojů jako Excel nebo Google Sheets — bez kódu.

4. Je scraping webů pomocí cURL legální?

Scraping veřejných dat je v USA obecně považován za legální po nedávných soudních rozhodnutích, ale vždy si ověř podmínky webu, robots.txt a relevantní zákony. Nezískávej osobní nebo chráněná data bez svolení a respektuj rate limity i etická pravidla (, ).

5. Kdy přejít z cURL na pokročilejší nástroj jako Thunderbit?

Když potřebuješ scrapovat dynamické/JavaScriptové stránky, chceš strukturovaná data v tabulce nebo preferuješ no-code workflow, Thunderbit je lepší volba. cURL používej na rychlé technické úlohy; Thunderbit na opakovatelné, „byznysově“ přívětivé získávání dat.

Další tipy a návody k web scrapingu najdeš na nebo na našem .