Pokud jsi už někdy skládal seznam B2B kontaktů, dělal analýzu konkurence nebo se jen snažil držet CRM v cajku, víš, jaký poklad LinkedIn představuje. Ale řekněme si to na rovinu — ruční kopírování údajů z profilů je asi stejně zábavné jako koukat na schnoucí barvu a vlastní nástroje LinkedInu navíc málokdy dodají přesně ta data, která fakt potřebuješ. Proto v roce 2026 hledá víc obchodních a provozních týmů než kdy dřív způsob, jak scrapovat LinkedIn v Pythonu — místo hodin otravných klikání stačí pár řádků kódu a tabulka plná potenciálních zákazníků.

Jenže je tu háček: LinkedIn je dnes pevnost business dat. Má přes 1,3 miliardy členů a obrovských 310 milionů měsíčně aktivních uživatelů (), takže je zdrojem číslo jedna pro B2B leady — a zároveň platformou, která se proti botům a scraperům brání nejtvrději. Jen v roce 2025 LinkedIn podle dostupných údajů omezil přes 30 milionů účtů kvůli scrapování nebo automatizaci (). Jak tedy v roce 2026 opravdu získávat data z LinkedInu pomocí Pythonu, aniž by tvůj účet skončil v digitálním gulagu? Pojďme si to rozebrat krok za krokem — od nastavení přes bezpečnější scraping až po čištění dat a taky to, jak ti nástroje jako Thunderbit můžou workflow výrazně zrychlit.

Co vlastně znamená scrapovat LinkedIn v Pythonu?

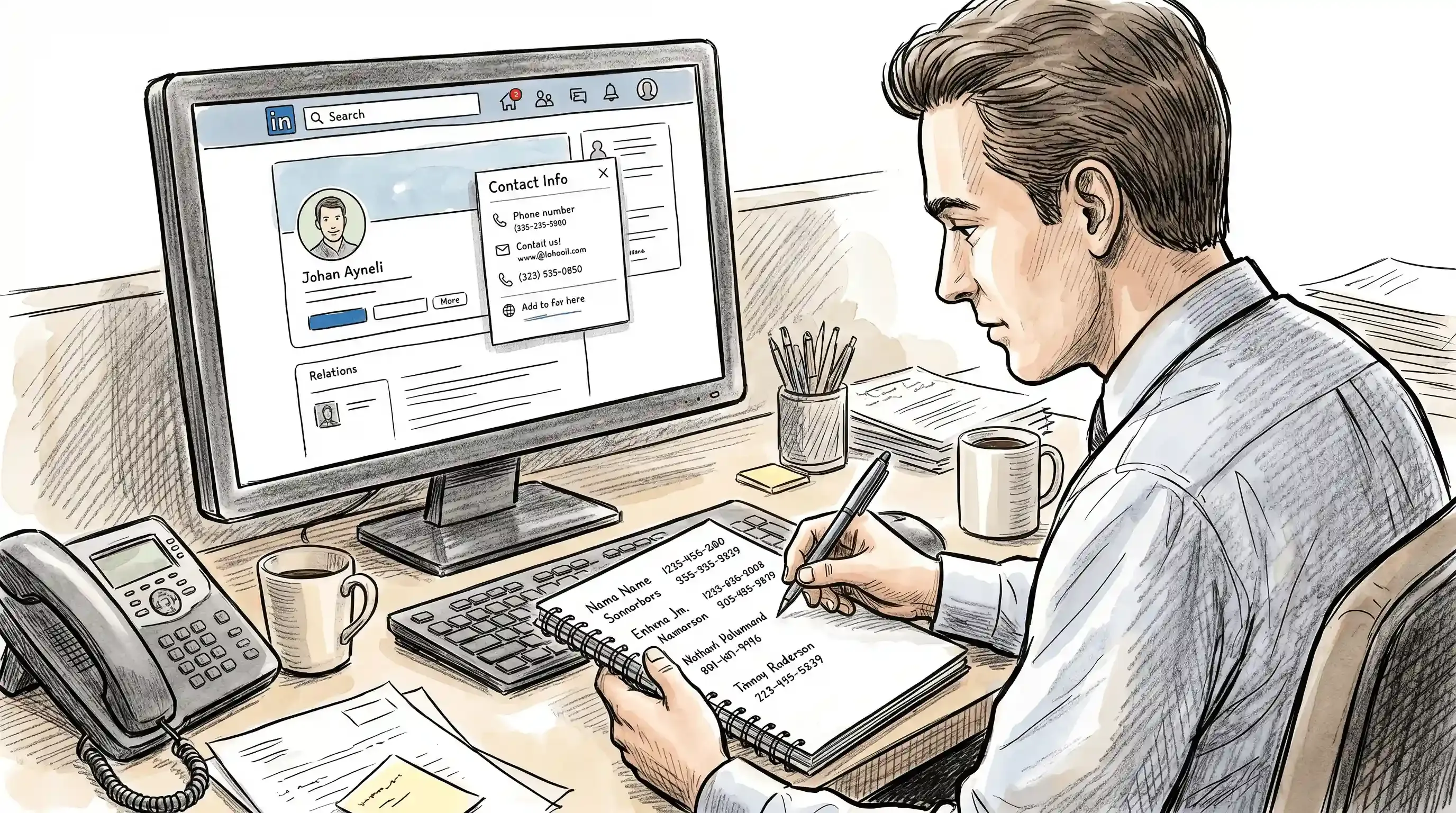

Když mluvíme o scrapování LinkedInu v Pythonu, myslíme tím použití Python skriptů a knihoven k automatizovanému sběru dat z webových stránek LinkedInu. Místo toho, abys ručně kopíroval jména, pracovní pozice nebo informace o firmách po jednom, napíšeš skript, který udělá těžkou práci za tebe — prochází profily, vytahuje požadovaná pole a ukládá je do strukturované podoby.

Ruční sběr dat je jako trhat jablka po jednom. Extrakce dat z LinkedInu v Pythonu je spíš jako zatřást stromem a chytat jablka do koše. Klíčová hledaná spojení — linkedin data extraction python, python linkedin scraper a automate linkedin scraping — všechny míří ke stejné myšlence: využít kód ke sběru dat z LinkedInu ve velkém, rychleji a (ideálně) bezpečněji, než by to kdy zvládl člověk.

Typické obchodní scénáře využití scrapování LinkedInu:

- Tvorba cílených seznamů leadů pro obchodní oslovování

- Doplňování CRM záznamů o aktuální pracovní pozice a firmy

- Sledování náborových trendů konkurence nebo pohybů vedení

- Mapování firemních sítí pro průzkum trhu

- Agregace firemních příspěvků nebo pracovních nabídek pro analýzu

Zkrátka, pokud potřebuješ strukturovaná data z LinkedInu a nechceš celý víkend klikat na „Connect“, Python je tvůj kámoš.

Proč automatizovat scrapování LinkedInu? Hlavní firemní využití

Řekněme si to natvrdo: LinkedIn není jen sociální síť — je to páteř moderního B2B obchodu a marketingu. Tady je důvod, proč týmy v roce 2026 tolik řeší automatizaci scrapování LinkedInu:

- Generování leadů: a 62 % říká, že jim skutečně přináší leady. LinkedIn generuje o 277 % více leadů než Facebook a Twitter dohromady.

- Průzkum trhu a konkurence: LinkedIn je jedno z mála míst, kde v reálném čase vidíš organizační struktury, trendy v náboru i novinky z firem.

- Obohacení CRM: Udržovat CRM aktuální bez automatizace je za trest. Scrapování LinkedInu ti umožní hromadně aktualizovat pozice, firmy i kontaktní údaje.

- Analýza obsahu a eventů: Chceš vědět, kdo ve tvém oboru publikuje, vystupuje nebo nabírá lidi? LinkedIn scraping ti ta data dá.

Tady je rychlá tabulka nejběžnějších scénářů použití:

| Tým | Příklad využití | Přínos |

|---|---|---|

| Obchod | Tvorba seznamů leadů, příprava oslovení | Více schůzek, vyšší konverze |

| Marketing | Průzkum publika, kurátorství obsahu | Lepší cílení, vyšší engagement |

| Operace | Obohacení CRM, mapování organizací | Čistší data, méně ruční práce |

| Nábor | Vyhledávání talentů, sledování konkurence | Rychlejší nábor, chytřejší pipeline |

A návratnost investice? Týmy používající AI automatizaci pro prospecting hlásí úsporu 2–3 hodin denně () a firmy jako TripMaster dosáhly 650% ROI z lead generation založené na LinkedInu (). To není jen úspora času — to je násobení obchodního pipeline.

Python vs. jiné způsoby scrapování LinkedInu: co je dobré vědět

Proč tedy použít Python místo rozšíření do prohlížeče nebo SaaS nástroje? Tady je upřímné srovnání:

Ruční kopírování a vkládání

- Výhody: Žádné nastavování, žádné riziko (pokud nepočítáš karpální tunel)

- Nevýhody: Pomalé, chybové, prakticky nescálovatelné

Rozšíření do prohlížeče (např. PhantomBuster, Evaboot)

- Výhody: Snadné nastavení, bez kódování, vhodné pro menší úlohy

- Nevýhody: Omezené škálování, vysoké riziko blokace, často vyžadují Sales Navigator, měsíční poplatky

SaaS API (např. Bright Data, Apify)

- Výhody: Velké objemy, nízká údržba, compliance řeší poskytovatel

- Nevýhody: Při větším objemu drahé, někdy zpožděná nebo cachovaná data, menší flexibilita

Python skripty

- Výhody: Maximální flexibilita, nejnižší cena na řádek při větším měřítku, data v reálném čase

- Nevýhody: Vysoké technické nároky, nejvyšší riziko blokace, nutná průběžná údržba

Tady je přímé porovnání:

| Parametr | DIY Python | Rozšíření do prohlížeče | SaaS API |

|---|---|---|---|

| Doba nastavení | Dny až týdny | Minuty | Hodiny |

| Technická náročnost | Vysoká | Nízká | Střední |

| Cena (10 tis. řádků) | ~200 USD (proxy) | 50–300 USD | 300–500 USD |

| Možnost škálování | Vysoká | Nízká až střední | Vysoká |

| Riziko blokace | Nejvyšší | Vysoké | Nejnižší |

| Čerstvost dat | V reálném čase | V reálném čase | Cachovaná |

| Údržba | Průběžná | Nízká | Žádná |

| Compliance | Riziko na straně uživatele | Riziko na straně uživatele | Riziko na straně poskytovatele |

Shrnutí: Pokud jsi technicky zdatný a chceš plnou kontrolu, Python je těžko překonatelný. Ale pro většinu firemních uživatelů nabízejí nástroje jako mnohem rychlejší a bezpečnější cestu k datům z LinkedInu — zvlášť s tím, jak LinkedIn rok od roku přitvrzuje.

Začínáme: jak nastavit Python LinkedIn scraper

Jsi připravený do toho skočit? Takhle si v roce 2026 nastavíš Python prostředí pro scraping LinkedInu:

1. Nainstaluj Python a klíčové knihovny

- Pro nejlepší kompatibilitu se doporučuje Python 3.10+.

- Základní knihovny:

- Playwright (nový standard pro automatizaci prohlížeče)

- Selenium (stále populární, ale pomalejší a snadněji odhalitelný)

- Beautiful Soup (pro parsování HTML)

- Requests (pro jednoduché HTTP požadavky; na LinkedIn má omezené použití)

- pandas (pro čištění a export dat)

Instalace přes pip:

1pip install playwright selenium beautifulsoup4 pandasU Playwrightu je ještě potřeba nainstalovat binárky prohlížeče:

1playwright install2. Nastav si ovladače prohlížeče

- Playwright si spravuje vlastní ovladače.

- Selenium potřebuje nebo .

- Ujisti se, že verze prohlížeče a ovladače sedí.

3. Připrav se na přihlášení

- Budeš potřebovat účet na LinkedInu (ideálně starší, s reálnou aktivitou).

- U většiny skriptů budeš buď:

- automatizovat přihlašování (riziko CAPTCHA),

- nebo vložíš svůj session cookie

li_at(rychlejší, ale pořád rizikové).

4. Respektuj podmínky LinkedInu

Upozornění: Scrapování LinkedInu, a to i s vlastním účtem, porušuje jejich Uživatelskou smlouvu. Právní situace je složitá (viz kauza hiQ vs. LinkedIn) a LinkedIn dnes při vymáhání postupuje hodně tvrdě. Používej tyto skripty jen pro vzdělávací nebo interní výzkumné účely a nikdy neprodávej ani veřejně nešiř nascrapovaná data.

Jak obejít omezení LinkedInu: jak snížit riziko blokace účtu v roce 2026

Tady se to začíná komplikovat. Ochrana LinkedInu proti botům je v roce 2026 fakt nekompromisní. Už zrušili celé firmy (RIP Proxycurl) a jen v roce 2025 omezili více než 30 milionů účtů kvůli scrapování (). Jak tedy scrapovat a nespálit se?

Hlavní rizika

- Rate limit: Neautentizovaní uživatelé mají zhruba 50 zobrazení profilů denně na jednu IP adresu. Přihlášené účty zvládnou pár stovek, než narazí na CAPTCHA nebo blokaci ().

- CAPTCHA: Objevuje se často, hlavně po rychlém procházení profilů nebo přihlášení.

- Omezení účtu: LinkedIn může účet zamknout, omezit nebo trvale zablokovat při podezřelé aktivitě.

Osvědčené strategie, jak snížit riziko

- Používej mobilní nebo starší rezidenční proxy: Mobilní proxy mají na LinkedInu 85% míru přežití, oproti 50 % u rezidenčních a téměř nulové u datacentrových IP ().

- Náhodně měň prodlevy: Nepoužívej pevné

time.sleep(5). Místo toho náhodně střídej pauzy mezi 2–8 sekundami. - Zahřívej účty postupně: Nepusť se na čerstvém účtu hned do 100 profilů. Začínej pomalu a napodobuj běžné chování uživatele.

- Scrapuj v pracovní době: Drž se časového pásma účtu.

- Měň user agent pro každou relaci: Ale ne uprostřed relace — LinkedIn to vyhodnocuje jako podezřelé.

- Scrolluj přirozeně: Používej automatizaci prohlížeče tak, aby simulovala běžný scroll a načítání obsahu.

- Každý účet na vlastní IP: Nikdy nespouštěj více účtů přes jednu proxy.

- Sleduj varovné signály: Chyby 429, přesměrování na

/authwallnebo prázdné stránky profilů znamenají, že zákaz je blízko.

Tip: Ani nejlepší stealth pluginy (Playwright Stealth, undetected-chromedriver) řeší jen povrchové otisky. LinkedIn detekuje mnohem hlouběji — nepodceňuj ho.

Jak vybrat správné Python knihovny pro extrakci dat z LinkedInu

V roce 2026 je Python ekosystém pro scraping přehlednější než dřív. Takhle si vedou hlavní knihovny:

| Knihovna | Statické HTML | JS-renderované | Přihlašovací flow | Rychlost | Nejlepší pro |

|---|---|---|---|---|---|

| Requests + BS4 | ✅ | ❌ | ❌ | Nejširší | Menší veřejné stránky |

| Selenium 4.x | ✅ | ✅ | ✅ | Pomalá | Legacy projekty, široká podpora prohlížečů |

| Playwright (Python) | ✅ | ✅ | ✅ | Rychlá | Výchozí volba pro LinkedIn v roce 2026 |

| Scrapy | ✅ | S pluginem | S úsilím | Rychlá | Strukturovaný crawling ve velkém |

Proč Playwright vyhrává u LinkedInu:

- O 12 % rychlejší načítání stránek a o 15 % nižší spotřeba paměti než Selenium ()

- Bez problémů zvládá asynchronní načítání LinkedInu bez ručních hacků

- Nativní práce s více záložkami pro paralelní scraping

- Oficiální stealth plugin pro základní maskování otisků

Tip pro začátečníky: Pokud teprve začínáš, Playwright je nejlepší volba. Selenium má pořád smysl u starších projektů, ale je pomalejší a snadněji odhalitelný.

Krok za krokem: váš první LinkedIn scraper v Pythonu

Pojďme si ukázat jednoduchý příklad v Selenium (pro začátečníky) a Playwrightu (pro produkci). Nezapomeň: tyto skripty jsou jen pro vzdělávací účely.

Příklad 1: Minimální přihlášení přes Selenium a scrapování profilu

1from selenium import webdriver

2from selenium.webdriver.common.by import By

3from selenium.webdriver.common.keys import Keys

4import time, random

5driver = webdriver.Chrome()

6driver.get("https://www.linkedin.com/login")

7driver.find_element(By.ID, "username").send_keys("you@example.com")

8driver.find_element(By.ID, "password").send_keys("yourpassword" + Keys.RETURN)

9time.sleep(random.uniform(3, 6)) # náhodná prodleva

10# Otevření profilu

11driver.get("https://www.linkedin.com/in/some-profile/")

12time.sleep(random.uniform(4, 8))

13# Scroll pro spuštění lazy-load obsahu

14driver.execute_script("window.scrollTo(0, document.body.scrollHeight);")

15# Extrakce dat (zjednodušeně)

16name = driver.find_element(By.CSS_SELECTOR, "h1").text

17print("Jméno:", name)

18driver.quit()Poznámka: Pro produkci je lepší vložit cookie li_at místo toho, abys se pokaždé přihlašoval znovu (snížíš tím riziko CAPTCHA).

Příklad 2: Asynchronní Playwright scraper (doporučeno pro rok 2026)

1import asyncio

2from linkedin_scraper import BrowserManager, PersonScraper

3async def main():

4 async with BrowserManager() as browser:

5 await browser.load_session("session.json") # uložená přihlašovací relace

6 scraper = PersonScraper(browser.page)

7 person = await scraper.scrape("https://linkedin.com/in/username")

8 print(person.name, person.experiences)

9asyncio.run(main())()

Kam přidat anti-ban opatření:

- Používej mobilní proxy ve svém browser manageru

- Náhodně měň prodlevy mezi akcemi

- Scrapuj po menších dávkách, ne všechno najednou

Upozornění: Každý scraper založený na selektorech se rozbije ve chvíli, kdy LinkedIn změní DOM (což se děje zhruba každých pár týdnů). S údržbou skriptů je potřeba počítat.

Čištění a formátování dat z LinkedInu pomocí Pythonu

Scraping je jen půlka práce. Data z LinkedInu bývají nepořádná — duplicitní jména, nekonzistentní pracovní pozice i zvláštní Unicode znaky. Takhle je dostaneš do pořádku:

1. Použij pandas pro práci s tabulkami

1import pandas as pd

2df = pd.read_csv("linkedin_raw.csv")

3df = df.drop_duplicates(subset=["email", "phone"]) # přesné odstranění duplicit

4df["name"] = df["name"].str.lower().str.strip()2. Fuzzy matching pro názvy firem

1from rapidfuzz import fuzz

2def is_similar(a, b):

3 return fuzz.ratio(a, b) > 90

4# Příklad: "Acme Corp" vs "ACME Corporation"3. Normalizace telefonních čísel a e-mailů

1import phonenumbers

2from email_validator import validate_email, EmailNotValidError

3# Normalizace telefonu

4num = phonenumbers.parse("+1 415-555-1234", None)

5print(phonenumbers.format_number(num, phonenumbers.PhoneNumberFormat.E164))

6# Validace e-mailu

7try:

8 v = validate_email("someone@example.com")

9 print(v.email)

10except EmailNotValidError as e:

11 print("Neplatný e-mail:", e)4. Export do Excelu, Google Sheets nebo CRM

- Excel:

df.to_excel("cleaned_data.xlsx") - Google Sheets: použij knihovnu

gspread - Airtable: použij

pyairtable - Salesforce/HubSpot: použij jejich příslušné Python API klienty

Tip: Před importem do CRM vždy data vyčisti a odstraň duplicity. Nic nezkazí náladu obchodníkovi víc než dvojité volání stejnému leadu.

Zrychlení scrapování LinkedInu s Thunderbit

Teď se podíváme na to, jak si život ještě víc usnadnit. Python mám rád, ale údržba scraperů pro LinkedIn je nekonečná hra na kočku a myš. Proto jsme v Thunderbit vytvořili , které z LinkedIn extrakce dat dělá mnohem méně bolestivou záležitost.

Proč právě Thunderbit?

- Scraping na 2 kliknutí: Stačí kliknout na „AI Suggest Fields“ a Thunderbit stránku přečte, navrhne sloupce a vytáhne data — bez kódu, bez selektorů, bez nervů.

- Scraping podstránek: Projdi výsledkovou stránku a nech Thunderbit otevřít každý profil a automaticky obohatit tabulku.

- Okamžité šablony: Předpřipravené pro LinkedIn, Amazon, Google Maps a další — můžeš začít během několika sekund.

- Export zdarma: Pošli data do Excelu, Google Sheets, Airtable, Notion nebo si je stáhni jako CSV/JSON.

- AI Autofill: Automatizuj vyplňování formulářů a opakující se workflow — ideální pro sales ops a CRM adminy.

- Scraping v cloudu nebo v prohlížeči: Vyber si režim podle use casu a potřeby přihlášení.

- Žádná údržba: AI v Thunderbit se přizpůsobuje změnám rozvržení LinkedInu, takže nemusíš pořád opravovat rozbité skripty.

Thunderbit používá více než 100 000 uživatelů po celém světě a má hodnocení 4,4★ v Chrome Web Store (). Pro většinu firemních uživatelů je to nejrychlejší a nejbezpečnější způsob, jak získat data z LinkedInu — bez rizika pro účet nebo pro duševní zdraví.

Pokročilé tipy: škálování a automatizace LinkedIn scraping workflow

Pokud to chceš vzít profesionálně, tady je návod, jak LinkedIn scraping posunout na vyšší úroveň:

1. Plánování skriptů

- cron (Linux/Mac) nebo Plánovač úloh (Windows) pro jednoduché úlohy

- APScheduler nebo Prefect 3 pro plánování a retry přímo v Pythonu

- Airflow pro orchestrace na enterprise úrovni

2. Nasazení do cloudu

- AWS Lambda (s Playwrightem v kontejneru)

- GCP Cloud Run

- Railway / Fly.io / Render pro snadný hosting Playwrightu

- Apify pro cloudové workflow zaměřené na scraping

3. Monitoring a detekce změn

- Sentry pro sledování chyb

- Vlastní upozornění na nárůst chyb 429 nebo změny DOM

- Hash-based diffing pro zjištění změn layoutu LinkedInu

4. Napojení na CRM

- Použij API pro Salesforce, HubSpot, Notion nebo Airtable a posílej vyčištěná data automaticky

- Sestav pipeline: plánovač → scraper → čištění/dedup v pandas → obohacení → zápis do CRM → upozornění

5. Zůstat v souladu s pravidly

- Nikdy nescrapuj víc než pár stovek profilů denně na jeden účet

- Střídej proxy a user agenty

- Sleduj rané signály blokace a při jejich výskytu skripty pozastav

Tip: I když všechno zautomatizuješ, LinkedIn může pravidla kdykoli změnit. Měj vždy záložní plán — a u nejdůležitějších workflow zvaž Thunderbit.

Závěr a klíčové poznatky

Scrapování LinkedInu v Pythonu je v roce 2026 silnější i riskantnější než kdy dřív. Tohle by sis měl odnést:

- LinkedIn je nejdůležitější zdroj B2B dat — ale zároveň platforma nejvíc chráněná proti scraperům.

- Python dává maximální flexibilitu pro extrakci dat z LinkedInu, ale přináší vysoké riziko blokace a průběžnou údržbu.

- Playwright je dnes zlatý standard pro LinkedIn scraping — rychlejší a spolehlivější než Selenium.

- Snížení rizika blokace stojí na proxy, prodlevách a napodobování skutečného chování uživatele — mobilní proxy přežívají v 85 %, rezidenční v 50 % a datacentrové v 0 %.

- Čištění dat je nutnost — před importem do CRM používej pandas, fuzzy matching a validační knihovny.

- Thunderbit nabízí bezpečnější a rychlejší alternativu — AI scraping, obohacení podstránek, okamžitý export a žádné kódování.

- Škálování znamená automatizovat všechno — od plánování přes monitoring až po integraci s CRM.

A hlavně: scrapuj eticky a zodpovědně. Právní oddělení LinkedInu není zrovna známé smyslem pro humor.

Jestli už tě unavuje neustálý boj s proměnlivou ochranou LinkedInu, . Je to nástroj, který bych si přál mít, když jsem začínal — a možná právě tobě (i tvému LinkedIn účtu) ušetří spoustu problémů.

Chceš jít víc do hloubky? Podívej se na , kde najdeš další průvodce web scrapingem, automatizací a best practices pro sales ops.

Často kladené otázky

1. Je scrapování LinkedInu v Pythonu v roce 2026 legální?

Právní situace je složitá. Ačkoli kauza hiQ vs. LinkedIn rozhodla, že scraping veřejných dat neporušuje CFAA, LinkedIn může — a taky to dělá — vymáhat své Uživatelské podmínky, které scraping zakazují. V roce 2025 LinkedIn vypnul Proxycurl a omezil přes 30 milionů účtů kvůli scrapování. Používej proto skripty jen pro interní nebo vzdělávací účely a nikdy nascrapovaná data neprodávej ani veřejně nešiř.

2. Jaký je nejbezpečnější způsob automatizace scrapování LinkedInu?

Používej starší účty, mobilní proxy (85% míra přežití), náhodně měň prodlevy a scrapuj během pracovní doby. Nikdy nepoužívej datacentrové IP a sleduj rané signály blokace. Pro většinu firemních uživatelů představují nástroje jako výrazně méně rizikovou alternativu než vlastní Python skripty.

3. Která Python knihovna je pro LinkedIn scraping v roce 2026 nejlepší?

Playwright je dnes výchozí volba — je rychlejší, spolehlivější a lépe zvládá dynamický obsah LinkedInu než Selenium. Pro jednoduché veřejné stránky stále funguje Requests + Beautiful Soup, ale pro cokoli s přihlášením nebo JavaScriptem použij Playwright.

4. Jak po scrapování vyčistit a naformátovat data z LinkedInu?

Použij pandas pro práci s tabulkami a odstraňování duplicit, RapidFuzz pro fuzzy matching, phonenumbers a email-validator pro kontaktní údaje a exportuj do Excelu, Google Sheets nebo CRM pomocí jejich příslušných Python knihoven.

5. Jak Thunderbit zlepšuje extrakci dat z LinkedInu?

Thunderbit využívá AI k návrhu polí, zvládá scraping podstránek a exportuje data přímo do tvých oblíbených nástrojů — bez nutnosti kódování. Přizpůsobuje se častým změnám rozvržení LinkedInu, čímž snižuje údržbu i riziko blokace. Navíc si ho můžeš zdarma vyzkoušet a důvěřuje mu více než 100 000 uživatelů po celém světě.

Chceš vidět LinkedIn scraping v praxi — bez starostí? a začni získávat data během dvou kliknutí. Tvůj obchodní tým (i tvůj LinkedIn účet) ti poděkuje.

Zjistit více