V minulém čtvrtletí náš ops tým strávil 40 hodin týdně kopírováním dat o konkurenci do tabulek. V tomto čtvrtletí to trvá 20 minut.

Rozdíl? Automatizované nástroje pro web scraping. Z nástroje určeného jen pro vývojáře se stal něco, co si během oběda nastaví i obchodník nebo marketér.

Už léta buduju SaaS a automatizační nástroje (a ano, spoluzaložil jsem ). Výběr nástrojů pro rok 2026 je zatím nejsilnější — jsou nativně postavené pro AI, samoléčící a opravdu použitelné i pro netechnické lidi.

Tady je 10 nástrojů, které jsem otestoval na vlastní kůži, přehledně rozdělené podle využití a úrovně dovedností.

Proč automatizované nástroje pro web scraping dávají smysl pro firemní uživatele

Přiznejme si to: doba ručního kopírování a vkládání dat z webů je pryč (pokud vás zrovna netěší opakované přetěžování a existenciální úzkost). Automatizované nástroje pro web scraping se staly pro firmy všech velikostí klíčové. Ve skutečnosti , a web scraping je důležitou součástí této strategie.

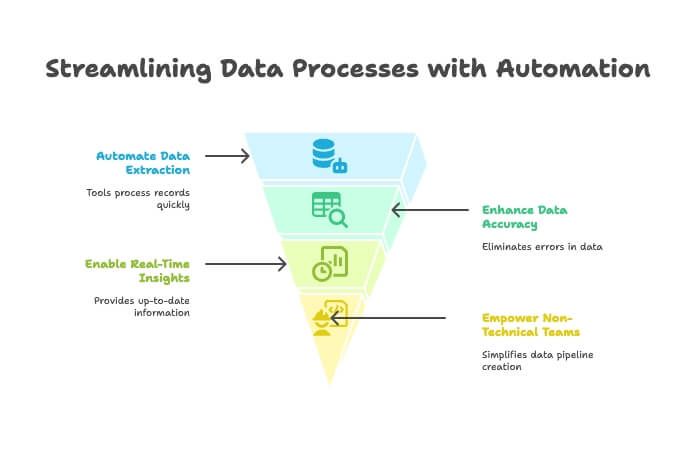

Tady je, proč jsou tyto nástroje tak užitečné:

- Šetří čas a snižují manuální práci: Automatizované scrapery dokážou zpracovat tisíce záznamů během minut a uvolní vašemu týmu ruce pro práci s vyšší přidanou hodnotou. Jeden uživatel uvedl, že automatizací sběru dat ušetřil „stovky hodin“ ().

- Zlepšují přesnost dat: Konec překlepů a vynechaných položek. Automatizovaná extrakce znamená čistší a spolehlivější data.

- Podporují rychlejší rozhodování: Díky datům v reálném čase můžete sledovat konkurenci, ceny nebo sestavovat seznamy leadů, aniž byste čekali na měsíční report od stážisty.

- Umožňují práci i netechnickým týmům: Díky no-code a AI nástrojům dnes i lidé, kteří si myslí, že „XPath“ je jógová pozice, zvládnou vytvořit datový pipeline z webu ().

Není divu, že , a téměř 80 % říká, že by jejich organizace bez nich nemohla efektivně fungovat. V roce 2026, pokud neautomatizujete sběr dat, dost možná necháváte peníze — i insighty — ležet na stole.

Jak jsme vybírali nejlepší automatizované nástroje pro web scraping

S trhem softwaru pro web scraping, který má podle projekcí , může výběr správného nástroje připomínat nákup bot v obchodě s 10 000 možnostmi. Takhle jsem to zúžil:

- Snadné použití: Dokáže se nerozvojář rychle rozjet? Je tam strmá křivka učení?

- AI schopnosti: Využívá nástroj AI pro automatické rozpoznání datových polí, práci s dynamickými weby nebo pro zadání požadavku v běžné angličtině?

- Export a integrace dat: Jak snadno dostanete data do Excelu, Google Sheets, Airtable, Notion nebo do vašeho CRM?

- Cena: Existuje bezplatná zkušební verze? Jsou placené plány dostupné pro jednotlivce a malé týmy, nebo jen pro enterprise?

- Škálovatelnost: Zvládne nástroj jak malé jednorázové úlohy, tak velké plánované extrakce?

- Cílový uživatel: Je postavený pro firemní uživatele, vývojáře, nebo pro obě skupiny?

- Jedinečné přednosti: Čím se tento nástroj odlišuje od ostatních?

Zařadil jsem nástroje pro každou úroveň — od „chci jen tabulku“ až po „chci prolézt celý internet“. Pojďme na seznam.

1. Thunderbit: AI nástroj pro web scraping pro každého

Začnu nástrojem, který znám nejlépe — protože ho můj tým a já vybudovali přesně proto, abychom vyřešili bolesti, které jsem u firemních uživatelů vídal roky. není typický „drag-and-drop“ ani „napiš si vlastní selektor“ scraper. Je to AI datový asistent, který vám umožní popsat, co chcete, a pak udělá těžkou práci za vás — bez kódu, bez hraní si s XPath, bez slz.

Proč je Thunderbit na prvním místě

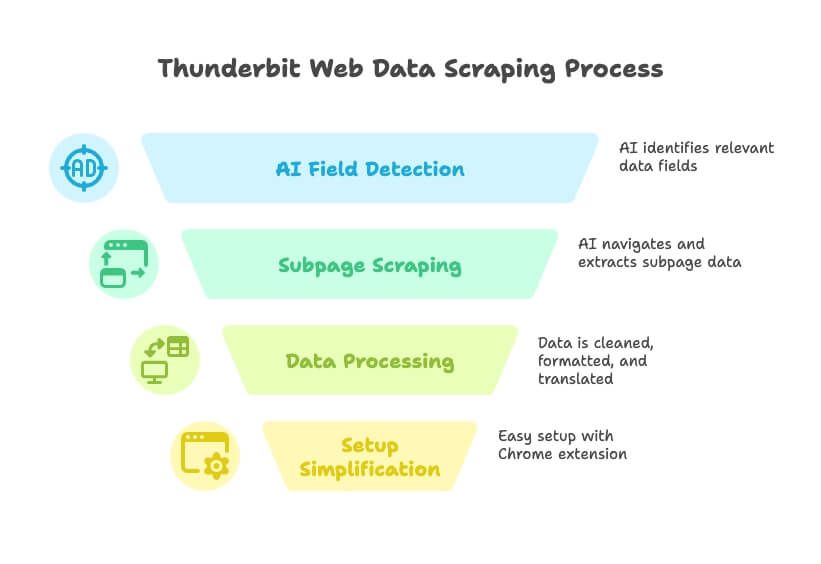

Thunderbit je zatím to nejbližší, co jsem viděl k tomu, jak „proměnit jakýkoli web v databázi“. Funguje to takto:

- Řízení přirozeným jazykem: Stačí Thunderbitu říct, jaká data potřebujete („Chci ze seznamu všechny názvy firem, e-maily a telefonní čísla“), a AI automaticky rozpozná relevantní pole.

- AI navrhne pole: Jedním kliknutím Thunderbit přečte stránku a navrhne nejlepší sloupce k extrakci — žádné hádání ani metoda pokus-omyl.

- Substránky a vícestupňové scrapování: Potřebujete detaily z podstránky každé položky? Thunderbit na ni klikne, vytáhne další informace a připojí je do vaší tabulky.

- Čištění dat, překlad a klasifikace: Thunderbit nebere jen syrová data — při scrapování je umí čistit, formátovat, překládat a dokonce i kategorizovat.

- Žádné problémy s nastavením: Nainstalujte , klikněte na „AI Suggest Fields“ a během minuty scrapujete.

- Bezplatná zkušební verze a nízká cena: Štědrý free tarif (až 6 stránek zdarma), placené plány od pouhých 9 USD měsíčně. To je míň, než utratím za kávu za týden.

Thunderbit je stavěný pro sales, marketing a ops týmy, které potřebují data rychle. Žádné programování, žádné pluginy, žádné školení. Je to jako mít datového stážistu, který opravdu poslouchá a nikdy si nestěžuje.

Výrazné funkce Thunderbitu

- Scraping řízený AI: AI rozumí struktuře stránky, přizpůsobí se změnám layoutu a automaticky zvládá i stránkování a podstránky ().

- Okamžitý export dat: Výsledky pošlete přímo do Excelu, Google Sheets, Airtable, Notion nebo si je stáhněte jako CSV/JSON.

- Cloud nebo lokální běh: Scrapování můžete spustit v cloudu pro rychlost a škálování, nebo v prohlížeči, pokud potřebujete používat přihlášení/sesi.

- Plánované scrapování: Nastavte opakované úlohy, aby byla data stále čerstvá — ideální pro sledování cen nebo pravidelné aktualizace leadů.

- Bez údržby: AI Thunderbitu se přizpůsobuje změnám na webu, takže trávíte méně času opravami rozbitých scraperů ().

Pro koho je? Pro každého, kdo chce během pár minut přejít od „potřebuju tato data“ k „tady je vaše tabulka“ — zejména pro netechnické uživatele. S a hodnocením 4,9★ se Thunderbit rychle stává volbou číslo jedna pro firemní týmy, které chtějí výsledky, ne starosti.

Chcete to vidět v akci? Podívejte se na nebo si projděte další .

2. Clay: Automatizované obohacování dat potkává web scraping

Clay je jako švýcarský nůž pro růstové týmy. Není to jen web scraper — je to automatizační tabulka, která se připojuje k více než 50 živým datovým zdrojům (např. Apollo, LinkedIn, Crunchbase) a využívá vestavěnou AI k obohacování leadů, psaní outreach e-mailů a hodnocení potenciálních zákazníků.

- Automatizace workflow: Každý řádek je lead, každý sloupec může vytáhnout data nebo spustit akci. Chcete scrapovat seznam firem, obohatit ho o profily z LinkedIn a poslat personalizovaný e-mail? Clay to zvládne.

- Integrace AI: Používá GPT-4 pro psaní icebreakerů, shrnutí biografií a další úkoly.

- Integrace: Nativně se napojuje na HubSpot, Salesforce, Gmail, Slack a další.

- Cena: Profesionální plán začíná zhruba na 99 USD měsíčně, s bezplatnou zkušební verzí pro lehké použití.

Nejlepší pro: outbound sales, growth hackery a marketéry, kteří chtějí stavět vlastní pipeline pro leady — kombinovat scraping, obohacování a outreach na jednom místě. Je to výkonné, ale pokud s automatizačními nástroji teprve začínáte, čeká vás určitá křivka učení ().

3. Bardeen: Webový scraper v prohlížeči pro automatizaci workflow

Bardeen je jako prohlížečový robot, který umí scrapovat data a automatizovat opakující se webové úkoly — vše z rozšíření do Chrome.

- No-code automatizace: Více než 500 „Playbooks“ pro scrapování, vyplňování formulářů, přesun dat mezi aplikacemi a další.

- AI Command Builder: Popište úkol běžnou angličtinou a Bardeen vytvoří workflow.

- Integrace: Funguje s Notion, Trello, Slack, Salesforce a více než 100 dalšími aplikacemi.

- Cena: Zdarma pro lehké použití (100 automatizačních kreditů/měsíc), placené plány od 99 USD měsíčně pro týmy.

Nejlepší pro: power usery a go-to-market týmy, které chtějí automatizovat scraping i navazující akce napříč více aplikacemi. Je tu hodně flexibility, ale začátečníkům může křivka učení připadat poměrně strmá ().

4. Bright Data: Automatizované nástroje pro web scraping pro enterprise

Bright Data (dříve Luminati) je těžká váha web scrapingu — představte si globální proxy sítě, pokročilá API a schopnost procházet tisíce stránek denně.

- Pro enterprise škálu: Více než 100 milionů IP, Web Scraper IDE, Web Unlocker pro obejití anti-bot opatření.

- Přizpůsobitelné: Sestavte si komplexní, velkoobjemové extrakce s vysokou spolehlivostí.

- Cena: Web Scraper IDE začíná na 499 USD měsíčně, k dispozici jsou i menší „micro“ balíčky.

Nejlepší pro: velké firmy, datové agregátory a pokročilé uživatele, kteří potřebují robustní a škálovatelné řešení. Pokud denně procházíte tisíce stránek a musíte se vyhnout blokacím IP, Bright Data je stavěná právě pro vás ().

5. Octoparse: Vizuální web scraper pro pokročilejší uživatele

Octoparse je populární no-code nástroj s vizuálním rozhraním typu point-and-click — ideální pro uživatele, kteří chtějí výkon bez programování.

- Drag-and-drop UI: Kliknutím vybíráte prvky, určíte, co se má extrahovat, a zvládnete i přihlašování, stránkování a další.

- Šablony: Více než 500 hotových šablon pro běžné weby (Amazon, Twitter atd.).

- Cloud scraping: Úlohy běží na serverech Octoparse, můžete je plánovat a využívat rotaci IP.

- Cena: Zdarma s omezeními; placené plány od 119 USD měsíčně.

Nejlepší pro: netechnické uživatele a datové analytiky, kteří chtějí schopný scraper bez psaní kódu. Skvělé pro sledování cen, produktové nabídky a výzkumné projekty ().

6. : Platforma pro scraping dat pro firmy

je jedním z původních hráčů ve web scrapingu, který se postupně vyvinul v plnohodnotnou platformu pro extrakci dat.

- Extrakce point-and-click: Zvládá přihlášení, rozbalovací nabídky i interaktivní prvky.

- Cloudový provoz: Zpracuje tisíce URL současně, umí plánovat extrakce a nabízí API.

- Zaměření na enterprise: Používá se pro sledování cen, průzkum trhu a tvorbu datasetů pro machine learning.

- Cena: Starter plán za 199 USD měsíčně, Standard za 599 USD měsíčně, Advanced za 1 099 USD měsíčně.

Nejlepší pro: střední a velké firmy a datové týmy, které potřebují spolehlivá, udržovaná řešení pro velké úlohy. Pro hobby projekty je to asi zbytečně moc, ale pro firemní použití je to silný nástroj ().

7. Parsehub: Flexibilní web scraper s vizuálním editorem

Parsehub je desktopová aplikace (Windows, Mac, Linux), která vám umožní vytvářet scrapery klikáním přes rozhraní webu.

- Vizuální workflow: Vyberete prvky, nastavíte pravidla extrakce a zvládnete přihlašování, rozbalovací nabídky i nekonečný scroll.

- Cloudové funkce: Scrapování lze spustit v cloudu, plánovat úlohy a využívat přístup přes API.

- Cena: Free tarif pro menší úlohy; placené plány od 149 USD měsíčně.

Nejlepší pro: výzkumníky, malé firmy nebo jednotlivce, kteří chtějí víc kontroly než nabízí rozšíření do prohlížeče, ale ještě nejsou připraveni napsat si vlastního scrapera ().

8. Common Crawl: Otevřená webová data pro AI a výzkum

Common Crawl není nástroj v tradičním smyslu — je to obrovský otevřený dataset webových crawl dat, aktualizovaný každý měsíc.

- Měřítko: Zhruba 400 TB webových dat pokrývajících miliardy webových stránek.

- Zdarma a otevřené: Nemusíte provozovat vlastní crawler.

- Vyžaduje technické dovednosti: K filtrování a parsování dat budete potřebovat big data nástroje a nějaké inženýrské znalosti.

Nejlepší pro: datové vědce a inženýry, kteří staví AI modely nebo dělají rozsáhlý výzkum. Pokud potřebujete obecný webový text nebo dlouhodobé archivy, je to zlatý důl ().

9. Crawly: Lehký automatizovaný nástroj pro web scraping pro startupy

Crawly (od Diffbotu) je cloudový, AI poháněný crawler, který dokáže získávat data z milionů webů a vracet strukturované výsledky — bez nutnosti psát pravidla pro parsování.

- AI extrakce: Využívá strojové vidění a NLP pro rozpoznání a extrakci obsahu.

- API přístup: Dotazujte se na nasbíraná data a propojte je s analytikou nebo databázemi.

- Cena: Enterprise úroveň; cenu je potřeba řešit individuálně.

Nejlepší pro: startupy a týmy s nějakými technickými dovednostmi, které potřebují inteligentní extrakci webových dat ve velkém bez toho, aby si musely postavit vlastní scrapery ().

10. Apify: Web scraper pro vývojáře s marketplace

Apify je cloudová platforma, kde si můžete postavit vlastní scrapery („Actors“) nebo využít knihovnu předpřipravených komunitních scraperů.

- Flexibilita pro vývojáře: Podporuje scrapování v JavaScriptu/Pythonu, headless Chrome, správu proxy i plánování.

- Marketplace: Rozsáhlá knihovna hotových scraperů pro běžné weby.

- Cena: Free tarif s kredity v hodnotě 5 USD měsíčně; placené plány od 49 USD měsíčně.

Nejlepší pro: vývojáře a technicky zdatné analytiky, kteří chtějí plnou kontrolu a škálovatelnost. I netechnici mohou používat předpřipravené Actors pro běžné úkoly ().

Srovnávací tabulka automatizovaných nástrojů pro web scraping

| Nástroj | Snadné použití | AI funkce | Cena (od) | Cílový uživatel | Jedinečné přednosti |

|---|---|---|---|---|---|

| Thunderbit | ★★★★★ | Přirozený jazyk, AI Suggest Fields, scraping podstránek | 9 USD/měs. | Netechnicky založení firemní uživatelé | Nastavení na 2 kliknutí, bez kódu, okamžitý export, bezplatná zkušební verze |

| Clay | ★★★★☆ | AI obohacování, GPT-4 | 99 USD/měs. | Growth / sales ops | Automatizační tabulka, obohacování, outreach |

| Bardeen | ★★★★☆ | AI Command Builder | 99 USD/měs. | Power usery, GTM týmy | Browser RPA, více než 500 playbooků, hluboké integrace |

| Bright Data | ★★☆☆☆ | Rotace proxy, anti-bot AI | 499 USD/měs. | Firmy, vývojáři | Škála, spolehlivost, globální proxy |

| Octoparse | ★★★★☆ | Vizuální AI detekce | 119 USD/měs. | Analytici, neprogramátoři | Drag-and-drop, šablony, cloud scraping |

| Import.io | ★★★☆☆ | Interaktivní extraktory | 199 USD/měs. | Firmy, datové týmy | Současné zpracování, plánování, API, podpora |

| Parsehub | ★★★★☆ | Vizuální workflow | 149 USD/měs. | Výzkumníci, malé a střední firmy | Desktopová aplikace, zvládá dynamické weby |

| Common Crawl | ★☆☆☆☆ | N/A (pouze dataset) | Zdarma | Datoví vědci, inženýři | Obrovský otevřený dataset, archivy webového měřítka |

| Crawly | ★★☆☆☆ | AI extrakce | Individuálně / enterprise | Startupy, technické týmy | AI poháněný, bez pravidel parsování, API přístup |

| Apify | ★★★★☆ | Marketplace s Actors | 49 USD/měs. | Vývojáři, techničtí analytici | Stavba/marketplace, cloudová automatizace, flexibilita |

Jak vybrat správný nástroj pro web scraping podle vašich potřeb

Výběr nejlepšího automatizovaného nástroje pro web scraping závisí na velikosti vašeho týmu, technických dovednostech a obchodních cílech. Tady je můj rychlý průvodce:

- Pro netechnické uživatele (sales, marketing, ops): Zvolte . Je stavěný pro vás — žádný kód, žádné nastavování, jen výsledky. Ideální pro generování leadů, sledování cen a rychlé datové projekty.

- Pro týmy posedlé automatizací: Clay a Bardeen zazáří, pokud chcete kombinovat scraping s obohacováním, outreach nebo automatizací workflow.

- Pro firmy a vývojáře: Bright Data, a Apify jsou nejlepší volba pro velké, vysoce přizpůsobitelné projekty.

- Pro výzkumníky a analytiky: Octoparse a Parsehub nabízejí vizuální rozhraní a silné funkce bez nutnosti programovat.

- Pro AI a datově-vědecké projekty: Common Crawl a Crawly poskytují masivní datasety a AI poháněnou extrakci pro ty, kdo chtějí stavět nebo trénovat modely.

Zeptejte se sami sebe: Chcete začít během minut, nebo potřebujete postavit řešení na míru pro enterprise? Pokud si nejste jistí, začněte bezplatnou zkušební verzí — většina nástrojů ji nabízí.

Jedinečná hodnota Thunderbitu: AI asistent pro firemní data

Mezi všemi těmito nástroji Thunderbit vyniká jako jediný, který skutečně funguje jako „AI asistent“ pro web scraping a transformaci dat. Nejde jen o získávání dat — jde o proměnu chaotických webů v čisté, strukturované insighty bez jakýchkoli technických bariér.

- Rozhraní v přirozeném jazyce: Popište, co potřebujete, běžnou angličtinou, a Thunderbit se postará o zbytek.

- Plná automatizace workflow: Od extrakce přes čištění, překlad až po export — Thunderbit pokrývá celý proces.

- Ideální pro rychlé experimenty: Potřebujete ověřit nový trh, sestavit seznam leadů nebo sledovat konkurenci? Thunderbit je nejrychlejší a cenově nejdostupnější začátek.

Je to, jako byste měli datového analytika přímo v prohlížeči — takového, který nikdy nežádá přidání platu a nebere si dovolenou.

Závěr: Začněte chytřeji se správným automatizovaným nástrojem pro web scraping

Scéna scrapingu v roce 2026 je k nepoznání oproti tomu, co jsme znali před dvěma lety. Samoléčící AI scrapery, pipeline nativní pro LLM a skutečně použitelné no-code nástroje změnily pravidla hry. Ať už jste sólo zakladatel, dravý sales tým nebo enterprise datový vědec, na tomhle seznamu najdete nástroj, který se hodí právě vám. Klíč je sladit svůj workflow a dovednosti se správnou platformou — abyste přestali bojovat s kódem a začali odemykat insighty.

Pokud jste připraveni zahodit ruční kopírování a vkládání a začít chytřeji, a uvidíte, jak snadný web scraping může být. Nebo si podle svých cílů projděte další možnosti výše. Ať tak či onak, budoucnost datově řízeného byznysu patří těm, kdo automatizují.

Chcete se dozvědět víc? Podívejte se na pro hlubší rozbory, tutoriály a tipy, jak z webových dat vytěžit maximum. Příjemné scrapování — a nezapomeňte: ať jsou vaše data vždy čistá a scrapery se nikdy nerozbijí (a když ano, nechte to na AI).

Časté dotazy

1. Proč jsou automatizované nástroje pro web scraping v roce 2026 důležité pro firemní uživatele?

Automatizované nástroje pro web scraping zefektivňují sběr dat, šetří čas a snižují manuální práci. Zvyšují přesnost dat, podporují rozhodování v reálném čase a umožňují netechnickým týmům extrahovat a používat webová data bez psaní kódu. Tyto nástroje jsou dnes klíčové pro sales, marketing i ops.

2. Čím se Thunderbit liší od ostatních nástrojů pro web scraping?

Thunderbit využívá AI, aby uživatelé mohli popsat, jaká data chtějí, běžnou angličtinou. Automaticky rozpozná datová pole, zvládá podstránky i stránkování a výsledky okamžitě exportuje do platforem jako Excel a Airtable. Je navržen pro netechnické uživatele a nabízí silné funkce, jako je čištění dat a plánované scrapování, za nízkou cenu.

3. Který nástroj je nejlepší pro rozsáhlé enterprise scraping projekty?

Pro enterprise použití jsou ideální Bright Data a . Nabízejí funkce jako rotace proxy, anti-bot opatření, vysokou souběžnost a API přístup, takže se hodí pro organizace, které potřebují spolehlivě a ve velkém zpracovávat tisíce webových stránek.

4. Existují nástroje, které kombinují scraping s automatizací a outreach?

Ano, nástroje jako Clay a Bardeen nejen scrapují webová data, ale také je zapojují do workflow. Clay obohacuje leady a automatizuje outreach, zatímco Bardeen umožňuje automatizovat prohlížečové úlohy a workflow pomocí AI playbooků.

5. Jaká je nejlepší volba pro uživatele bez technického zázemí?

Thunderbit vyniká pro netechnické uživatele díky rozhraní v přirozeném jazyce, AI řízenému nastavení a snadnému použití. Nevyžaduje žádné programování ani nastavování a je ideální pro firemní uživatele, kteří potřebují rychlá a spolehlivá data bez technické složitosti.